mjlab

mjlab 是一个专为强化学习与机器人研究打造的开源框架。它将 Isaac Lab 灵活的管理器式 API 与 MuJoCo Warp 的 GPU 加速引擎相结合,解决了传统仿真环境搭建繁琐、训练速度受限的痛点。通过提供可组合的环境设计模块,mjlab 让用户能以更少的依赖直接操作原生 MuJoCo 数据结构,显著提升开发效率。

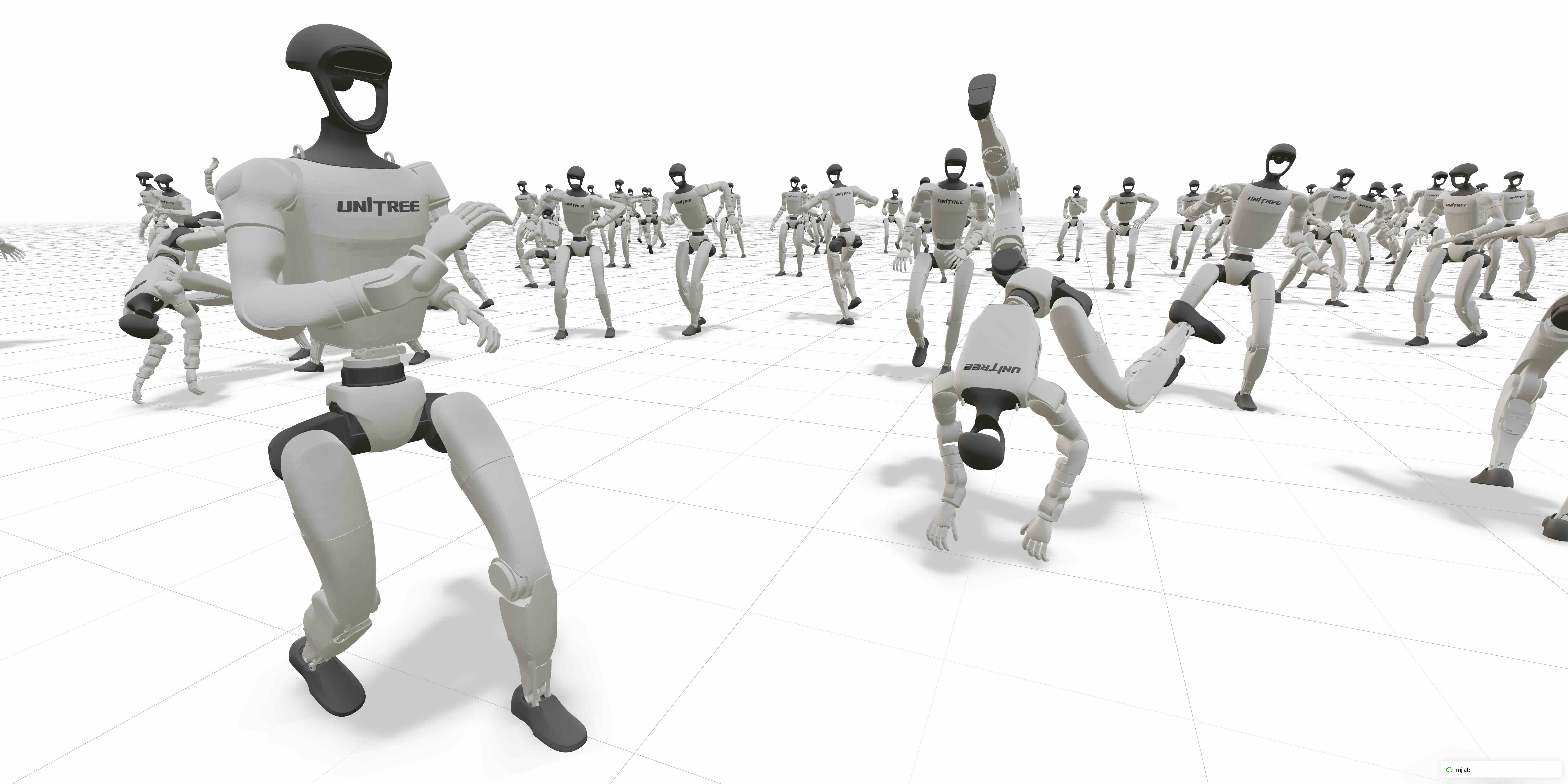

mjlab 特别适合需要高性能仿真的研究人员和开发者。无论是训练人形机器人进行速度跟踪还是动作模仿,mjlab 都提供了丰富的现成示例。mjlab 支持多 GPU 分布式训练,还能在 Google Colab 上无需本地配置即可运行演示。此外,内置的智能体功能帮助开发者在正式训练前快速验证任务逻辑。如果你正在寻找高效、易用的机器人仿真平台,不妨关注 mjlab。

使用场景

某高校机器人实验室团队正在基于 Unitree G1 人形机器人开发自适应行走策略,急需一个高效的仿真平台来验证强化学习算法。

没有 mjlab 时

- 环境配置极其繁琐,需手动整合 MuJoCo 与 Isaac Sim 接口,常因 CUDA 版本不兼容导致项目无法启动。

- 仿真运行主要依赖 CPU,单步计算慢,导致一次完整的策略训练周期长达数天,严重拖慢算法迭代进度。

- 调试过程中难以深入底层,无法直接读取物理引擎内部状态,排查碰撞或关节异常耗时费力且容易出错。

使用 mjlab 后

- mjlab 内置组合式 API 和最小化依赖,配合 Google Colab 即可零安装快速启动实验环境,减少运维时间。

- 利用 MuJoCo-Warp 的 GPU 加速能力,支持 4096 个并行环境及多卡分布式训练,训练效率提升数十倍。

- 提供对原生 MuJoCo 数据结构的直接访问,结合内置的随机代理脚本,能快速验证任务逻辑是否正确。

mjlab 通过降低环境搭建门槛与释放 GPU 算力,将机器人强化学习的研发周期从周级缩短至小时级。

运行环境要求

- Linux

- macOS

需要 NVIDIA GPU(训练必需),具体型号、显存大小及 CUDA 版本未说明

未说明

快速开始

mjlab

mjlab 结合了 Isaac Lab 的基于管理器(manager-based)API 与 MuJoCo Warp,后者是 MuJoCo 的 GPU 加速版本。 该框架为环境设计提供了可组合的构建模块, 依赖极少,并可直接访问原生的 MuJoCo 数据结构。

入门指南

mjlab 需要 NVIDIA GPU 进行训练。macOS 仅支持评估用途。

立即尝试:

运行演示(无需安装):

uvx --from mjlab --refresh demo

或者在 Google Colab 中尝试(无需本地设置)。

从源码安装:

git clone https://github.com/mujocolab/mjlab.git && cd mjlab

uv run demo

对于其他安装方法(PyPI、Docker),请参阅 安装指南。

训练示例

1. 速度跟踪

训练 Unitree G1 人形机器人在平坦地形上跟随速度指令:

uv run train Mjlab-Velocity-Flat-Unitree-G1 --env.scene.num-envs 4096

多 GPU 训练: 使用 --gpu-ids 扩展至多个 GPU:

uv run train Mjlab-Velocity-Flat-Unitree-G1 \

--gpu-ids "[0, 1]" \

--env.scene.num-envs 4096

详见 分布式训练指南。

训练时评估策略(从 Weights & Biases 获取最新检查点):

uv run play Mjlab-Velocity-Flat-Unitree-G1 --wandb-run-path your-org/mjlab/run-id

2. 运动模仿

训练人形机器人模仿参考动作。详见 运动模仿指南 以了解预处理设置。

uv run train Mjlab-Tracking-Flat-Unitree-G1 --registry-name your-org/motions/motion-name --env.scene.num-envs 4096

uv run play Mjlab-Tracking-Flat-Unitree-G1 --wandb-run-path your-org/mjlab/run-id

3. 使用虚拟代理进行健全性检查

在训练前使用内置代理对您的 MDP(马尔可夫决策过程)进行健全性检查:

uv run play Mjlab-Your-Task-Id --agent zero # 发送零动作

uv run play Mjlab-Your-Task-Id --agent random # 发送均匀随机动作

运行运动跟踪任务时,请在命令中添加 --registry-name your-org/motions/motion-name。

文档

完整文档可在 mujocolab.github.io/mjlab 获取。

开发

make test # 运行所有测试

make test-fast # 跳过慢速测试

make format # 格式化与代码检查

make docs # 本地构建文档

开发环境设置:uvx pre-commit install

引用

mjlab 被用于已发表的研究和开源机器人项目中。请查看 研究 页面以获取出版物和项目,或在 Show and Tell 中分享您自己的项目。

如果您在研究中使用了 mjlab,请考虑引用:

@misc{zakka2026mjlablightweightframeworkgpuaccelerated,

title={mjlab: A Lightweight Framework for GPU-Accelerated Robot Learning},

author={Kevin Zakka and Qiayuan Liao and Brent Yi and Louis Le Lay and Koushil Sreenath and Pieter Abbeel},

year={2026},

eprint={2601.22074},

archivePrefix={arXiv},

primaryClass={cs.RO},

url={https://arxiv.org/abs/2601.22074},

}

许可

mjlab 采用 Apache License, Version 2.0 许可。

第三方代码

mjlab 的部分部分是从外部项目分叉而来的:

src/mjlab/utils/lab_api/— 从 NVIDIA Isaac Lab 分叉的工具(BSD-3-Clause 许可,见文件 头部)

分叉组件保留其原始许可。详情请参见文件头部。

致谢

如果没有 Isaac Lab 团队的杰出工作,mjlab 就不会存在,mjlab 正是建立在其 API 设计和抽象之上。

感谢 MuJoCo Warp 团队 —— 特别是 Erik Frey 和 Taylor Howell —— 回答我们的问题,提供有益反馈,并根据我们的请求无数次实现功能。

版本历史

v1.2.02026/03/06v1.1.12026/02/15v1.1.02026/02/13v1.0.02026/01/29v0.1.02025/09/29常见问题

相似工具推荐

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。

awesome-machine-learning

awesome-machine-learning 是一份精心整理的机器学习资源清单,汇集了全球优秀的机器学习框架、库和软件工具。面对机器学习领域技术迭代快、资源分散且难以甄选的痛点,这份清单按编程语言(如 Python、C++、Go 等)和应用场景(如计算机视觉、自然语言处理、深度学习等)进行了系统化分类,帮助使用者快速定位高质量项目。 它特别适合开发者、数据科学家及研究人员使用。无论是初学者寻找入门库,还是资深工程师对比不同语言的技术选型,都能从中获得极具价值的参考。此外,清单还延伸提供了免费书籍、在线课程、行业会议、技术博客及线下聚会等丰富资源,构建了从学习到实践的全链路支持体系。 其独特亮点在于严格的维护标准:明确标记已停止维护或长期未更新的项目,确保推荐内容的时效性与可靠性。作为机器学习领域的“导航图”,awesome-machine-learning 以开源协作的方式持续更新,旨在降低技术探索门槛,让每一位从业者都能高效地站在巨人的肩膀上创新。

scikit-learn

scikit-learn 是一个基于 Python 构建的开源机器学习库,依托于 SciPy、NumPy 等科学计算生态,旨在让机器学习变得简单高效。它提供了一套统一且简洁的接口,涵盖了从数据预处理、特征工程到模型训练、评估及选择的全流程工具,内置了包括线性回归、支持向量机、随机森林、聚类等在内的丰富经典算法。 对于希望快速验证想法或构建原型的数据科学家、研究人员以及 Python 开发者而言,scikit-learn 是不可或缺的基础设施。它有效解决了机器学习入门门槛高、算法实现复杂以及不同模型间调用方式不统一的痛点,让用户无需重复造轮子,只需几行代码即可调用成熟的算法解决分类、回归、聚类等实际问题。 其核心技术亮点在于高度一致的 API 设计风格,所有估算器(Estimator)均遵循相同的调用逻辑,极大地降低了学习成本并提升了代码的可读性与可维护性。此外,它还提供了强大的模型选择与评估工具,如交叉验证和网格搜索,帮助用户系统地优化模型性能。作为一个由全球志愿者共同维护的成熟项目,scikit-learn 以其稳定性、详尽的文档和活跃的社区支持,成为连接理论学习与工业级应用的最

keras

Keras 是一个专为人类设计的深度学习框架,旨在让构建和训练神经网络变得简单直观。它解决了开发者在不同深度学习后端之间切换困难、模型开发效率低以及难以兼顾调试便捷性与运行性能的痛点。 无论是刚入门的学生、专注算法的研究人员,还是需要快速落地产品的工程师,都能通过 Keras 轻松上手。它支持计算机视觉、自然语言处理、音频分析及时间序列预测等多种任务。 Keras 3 的核心亮点在于其独特的“多后端”架构。用户只需编写一套代码,即可灵活选择 TensorFlow、JAX、PyTorch 或 OpenVINO 作为底层运行引擎。这一特性不仅保留了 Keras 一贯的高层易用性,还允许开发者根据需求自由选择:利用 JAX 或 PyTorch 的即时执行模式进行高效调试,或切换至速度最快的后端以获得最高 350% 的性能提升。此外,Keras 具备强大的扩展能力,能无缝从本地笔记本电脑扩展至大规模 GPU 或 TPU 集群,是连接原型开发与生产部署的理想桥梁。