LimiX

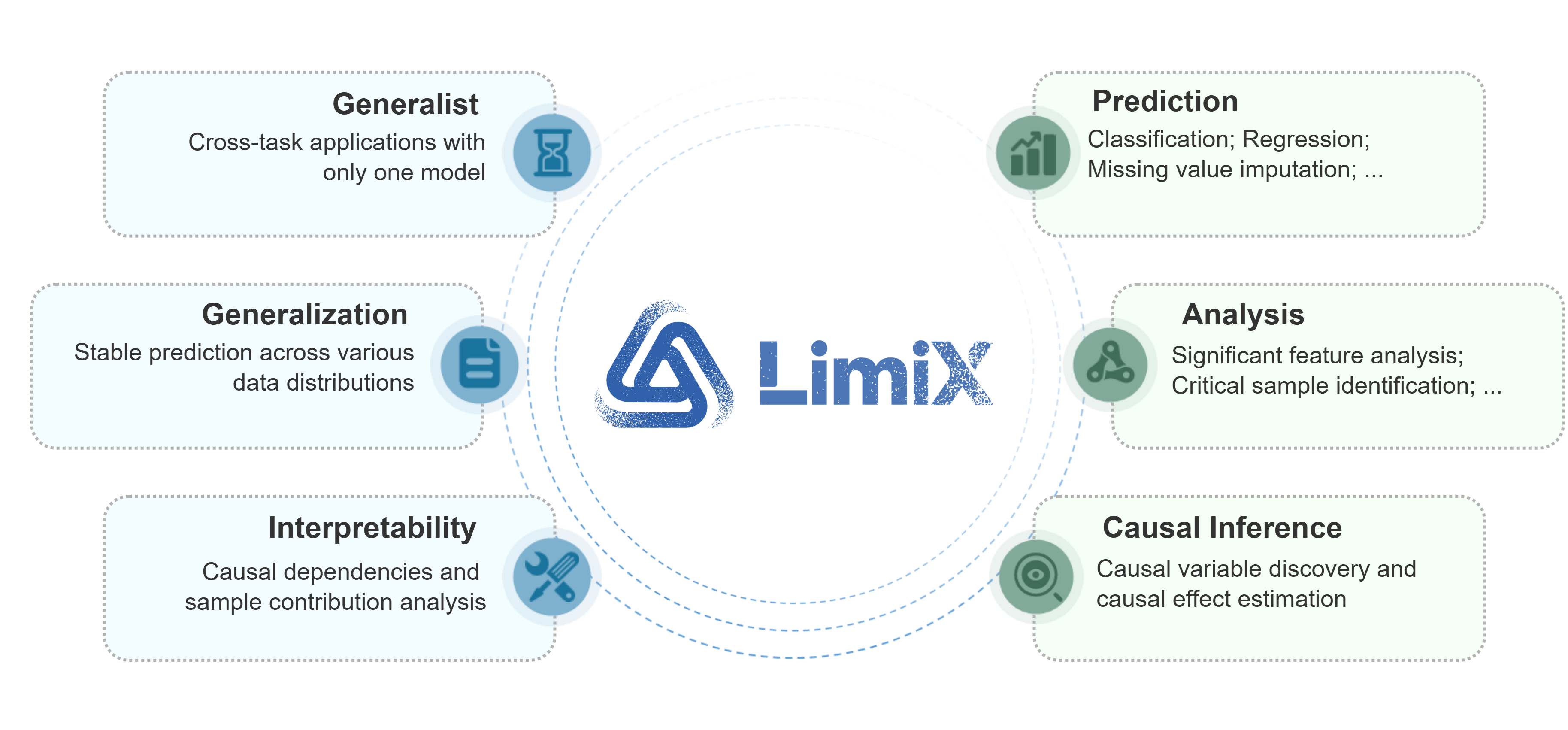

LimiX 是一款专为结构化数据设计的通用人工智能模型,旨在打破传统表格学习中“一个任务一个模型”的局限。它通过统一的训练和推理框架,能够同时处理分类、回归、缺失值填补、特征选择、样本筛选乃至因果推断等多种复杂任务,将原本分散的定制流程整合为高效的基础模型方案。

对于需要处理复杂表格数据的研究人员和开发者而言,LimiX 解决了以往需针对不同目标构建独立管道的痛点,显著提升了建模效率与泛化能力。其核心采用针对结构化数据优化的 Transformer 架构,创新地在样本和特征两个维度上应用注意力机制,精准捕捉关键数据模式。此外,最新发布的 LimiX-2M 版本在保持高性能的同时,大幅降低了显存占用并加快了推理速度,使得在资源受限环境下部署成为可能。无论是从事数据挖掘的算法工程师,还是探索通用智能边界的科研人员,LimiX 都能提供强大的底层支持,助力从专用小模型向统一大模型的范式转变。

使用场景

某金融风控团队正在构建新一代信贷违约预测系统,需同时处理包含大量缺失值的异构表格数据,并兼顾分类(是否违约)与回归(违约概率)任务。

没有 LimiX 时

- 流程割裂严重:数据科学家需分别搭建缺失值填补、特征选择、分类建模和回归估算的独立流水线,维护多套代码库导致协作效率低下。

- 模型泛化能力弱:针对特定任务定制的 XGBoost 或 LightGBM 模型难以迁移,一旦业务目标从“判断违约”调整为“预估损失金额”,必须重新训练全新模型。

- 缺失值处理粗糙:传统插补方法(如均值填充)破坏了数据分布特性,导致关键风险特征失真,直接影响最终模型的准确率。

- 推理资源消耗大:为覆盖不同任务部署多个专用模型实例,显著增加了 GPU 内存占用和线上推理延迟。

使用 LimiX 后

- 统一架构提效:LimiX 通过单一模型即可原生支持分类、回归及缺失值自动填补,将原本分散的五个处理步骤整合为一套训练推理配方,开发周期缩短 60%。

- 通用智能适配:利用其强大的结构化数据建模能力,同一套权重无需重新训练即可灵活切换预测目标,快速响应业务部门对新指标的分析需求。

- 高精度数据修复:基于注意力机制在样本与特征维度的双向挖掘,LimiX 能精准识别关键模式并智能还原缺失数据,使下游任务 AUC 指标提升 3.5%。

- 轻量高效部署:采用 LimiX-2M 变体后,在保持 SOTA 性能的同时大幅降低显存占用,单卡即可并发处理多类任务,推理速度提升近两倍。

LimiX 通过将繁琐的定制化表格学习流水线重构为统一的基座模型,真正实现了结构化数据处理的“一模型多用”。

运行环境要求

- Linux

- 必需(用于混合精度推理和检索增强)

- 基础推理支持单 GPU

- 若使用基于样本检索的集成推理(Ensemble Inference Based on Sample Retrieval),官方建议硬件规格高于 NVIDIA RTX 4090

- Docker 镜像基于 CUDA 12.2.0,手动安装需匹配 flash_attn (cu12)

未说明(但检索模式对显存要求极高,建议系统内存充足)

快速开始

:boom: 新闻

- 2025年11月10日:LimiX-2M正式发布!相较于LimiX-16M,这一更小的版本在显存占用上显著降低,推理速度更快。同时,检索机制也得到了增强,进一步提升了模型性能,并减少了推理时间和内存消耗。

- 2025年8月29日:LimiX V1.0发布。

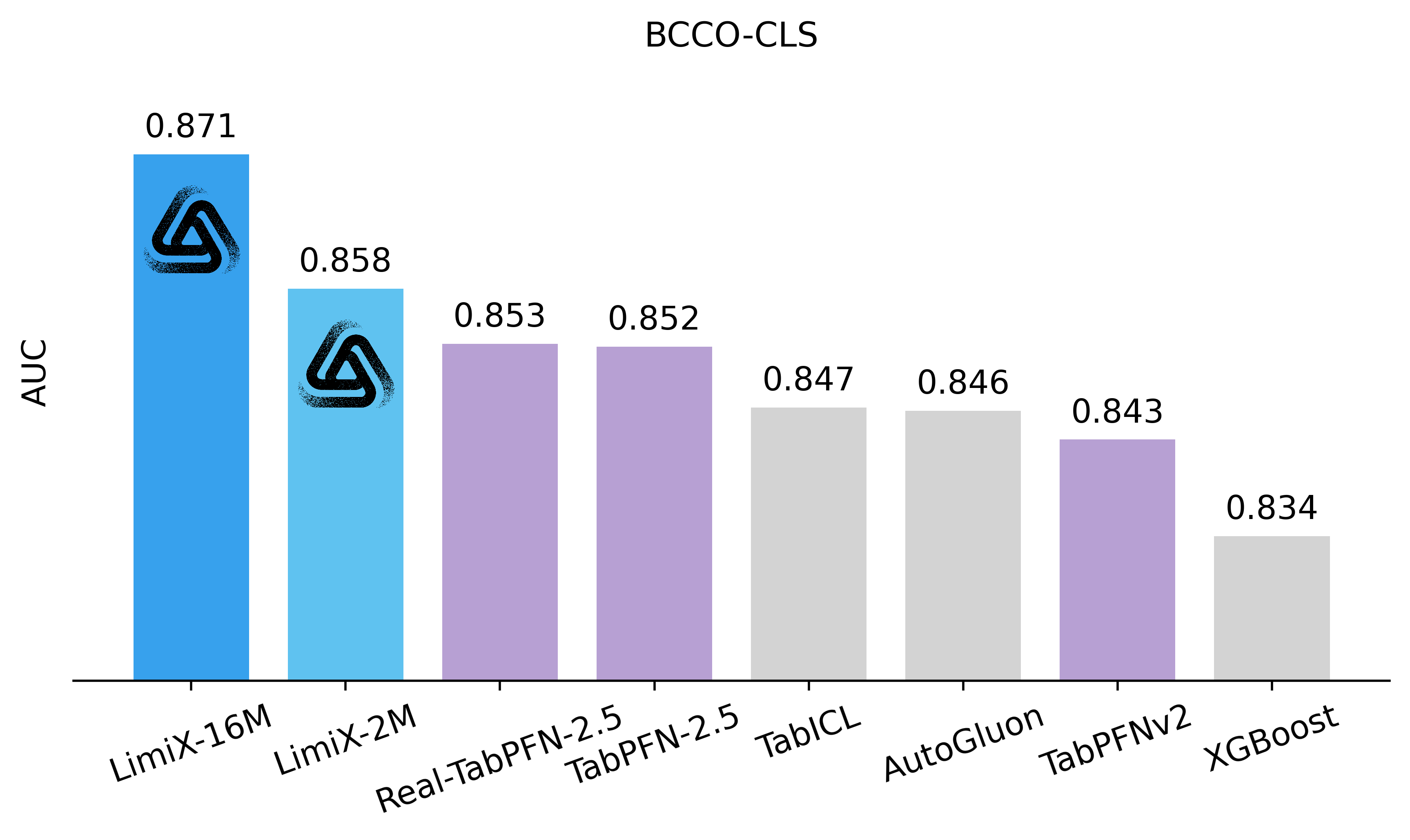

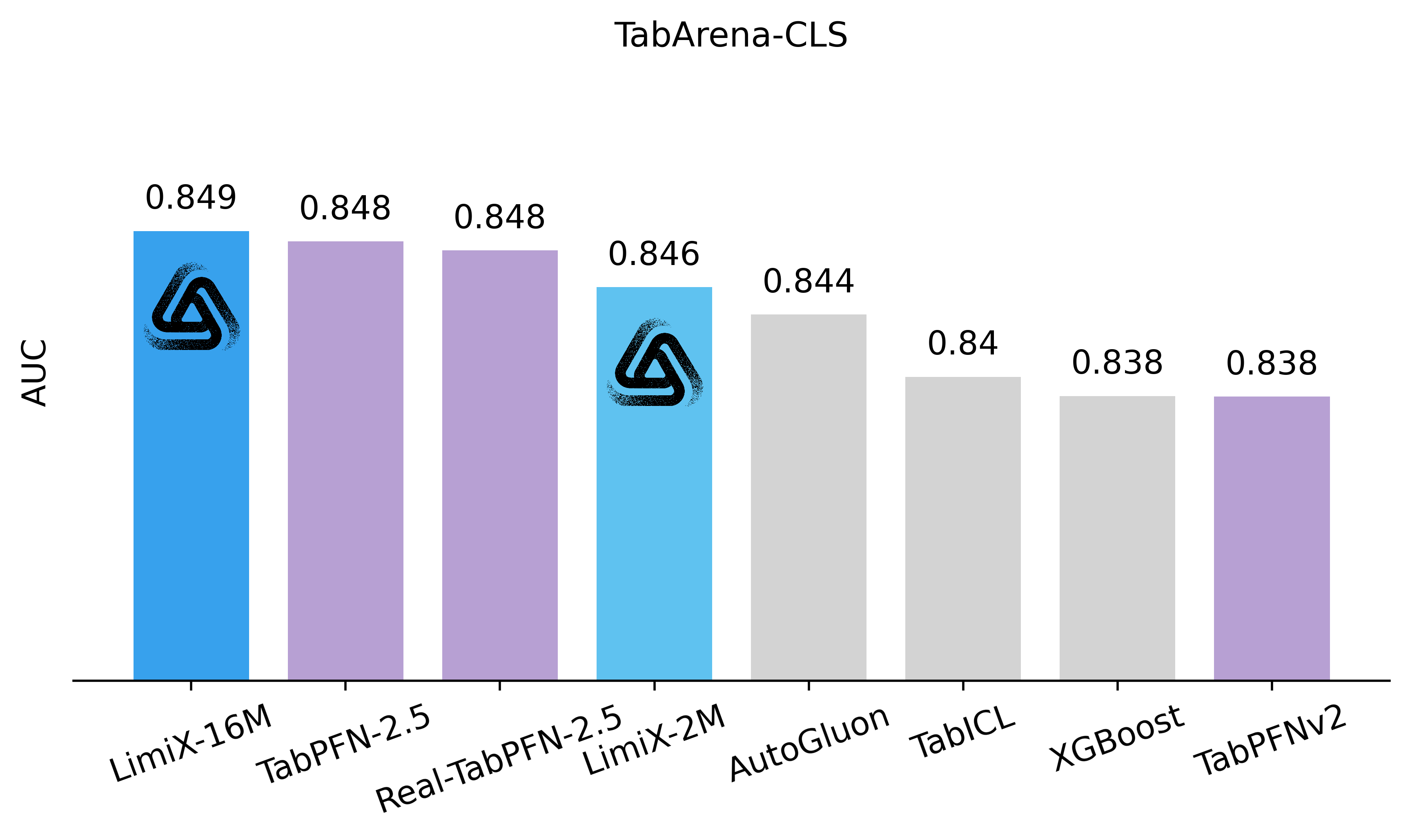

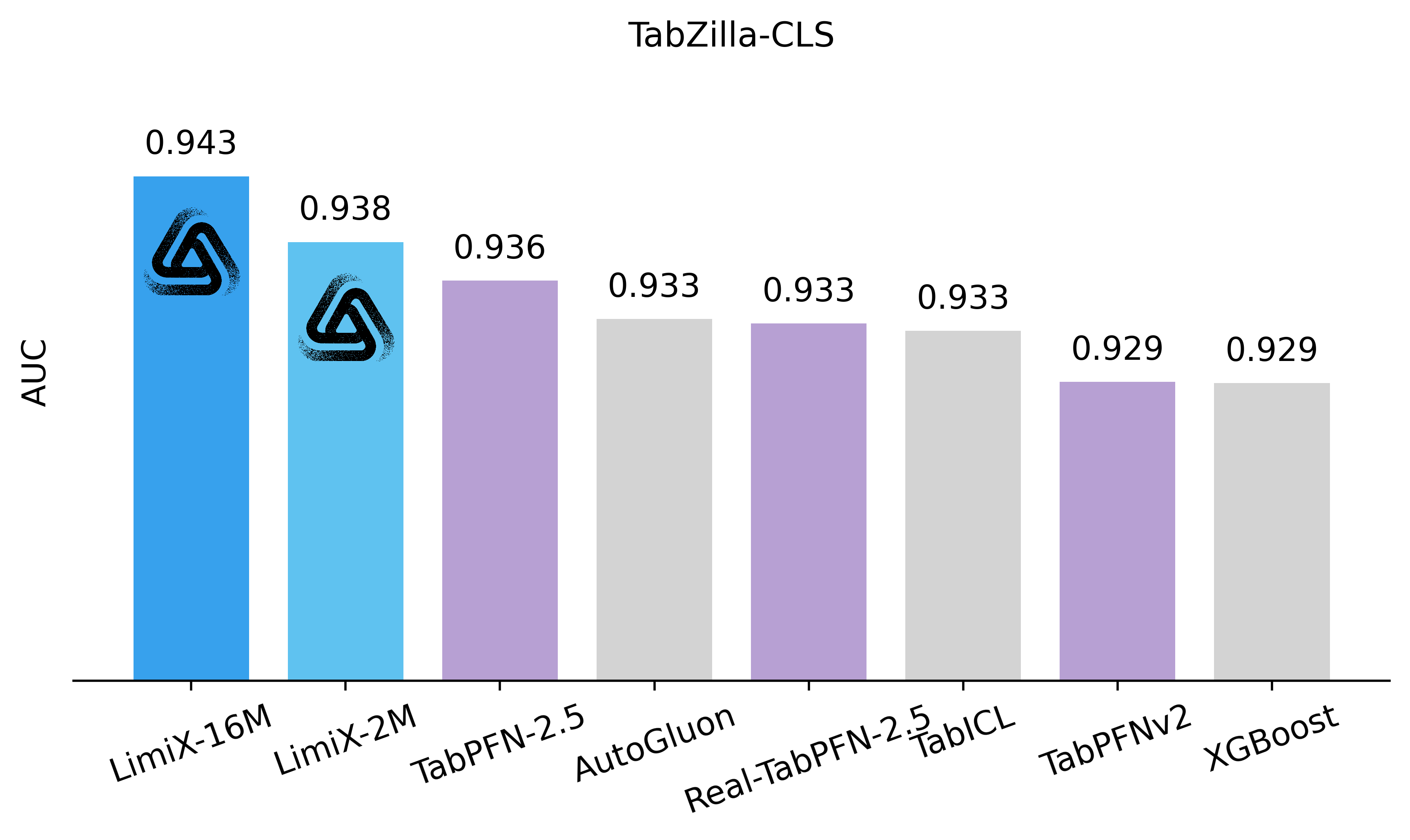

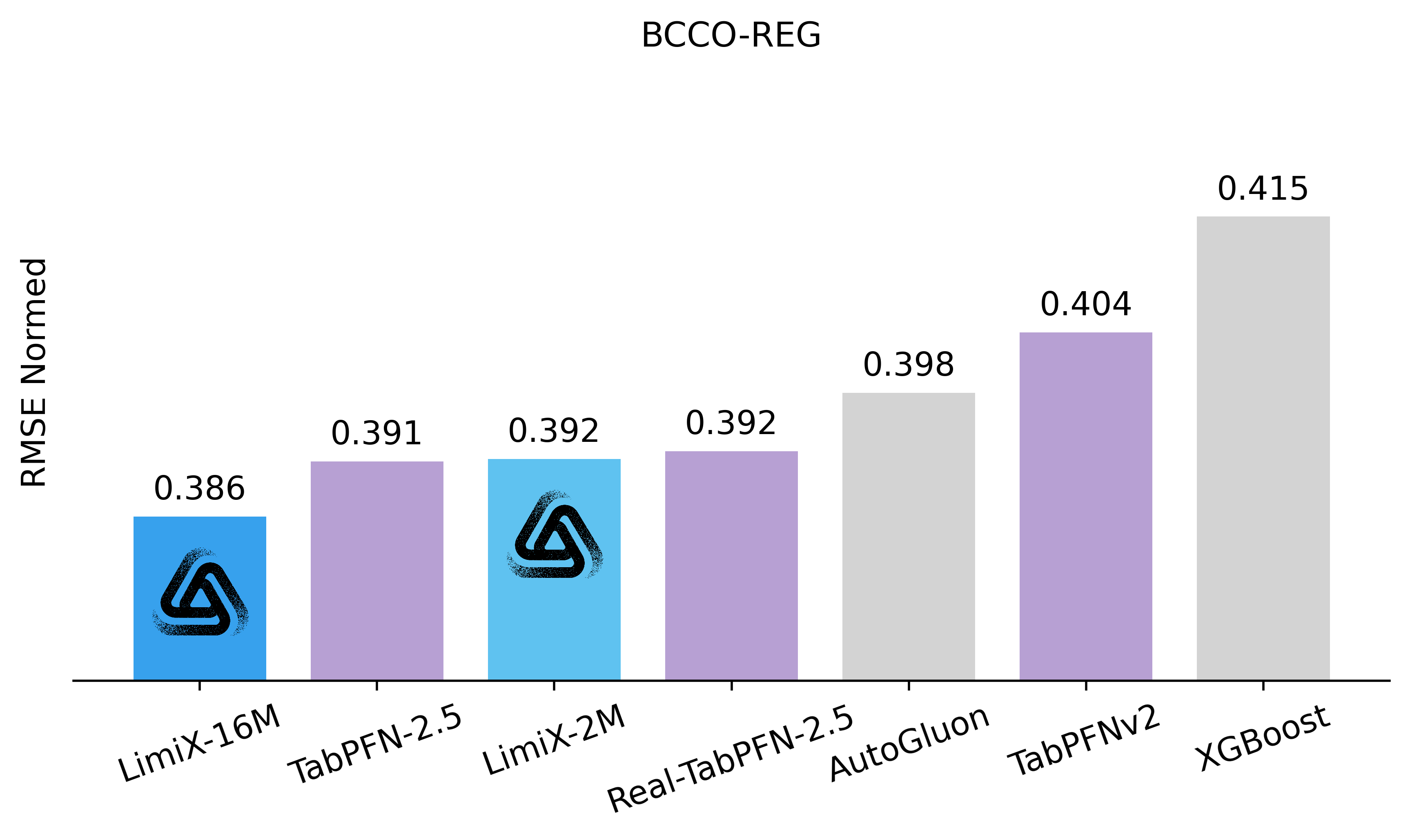

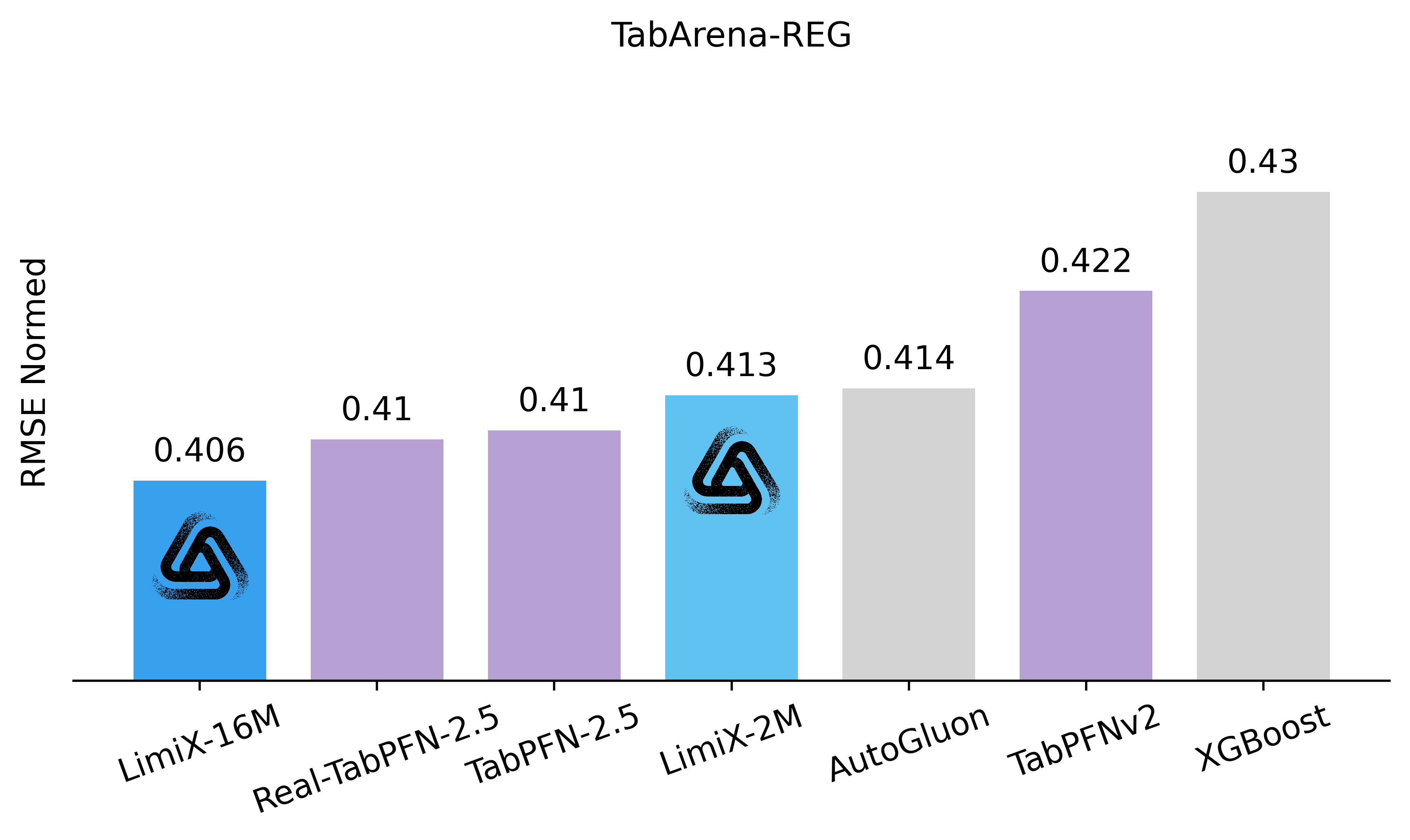

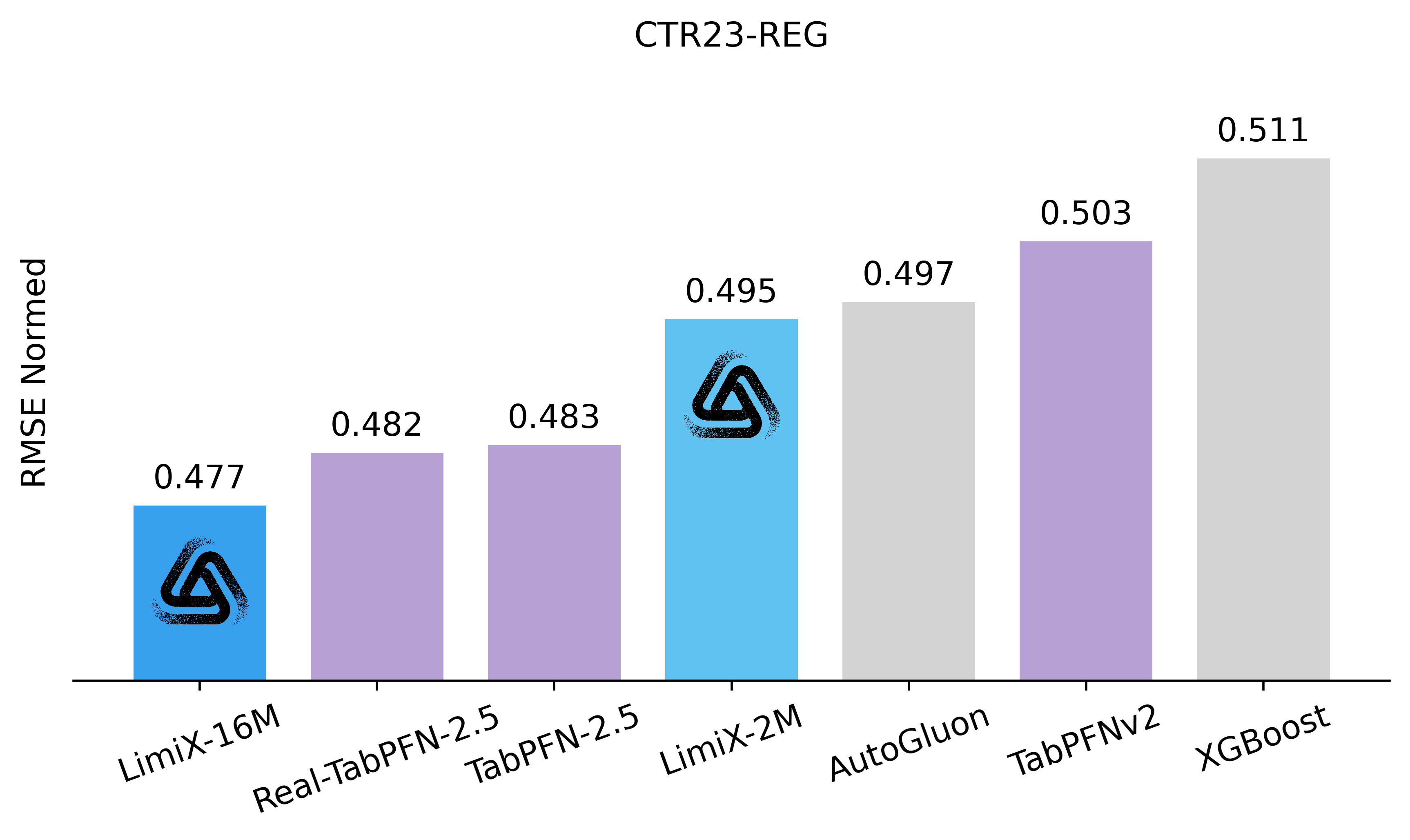

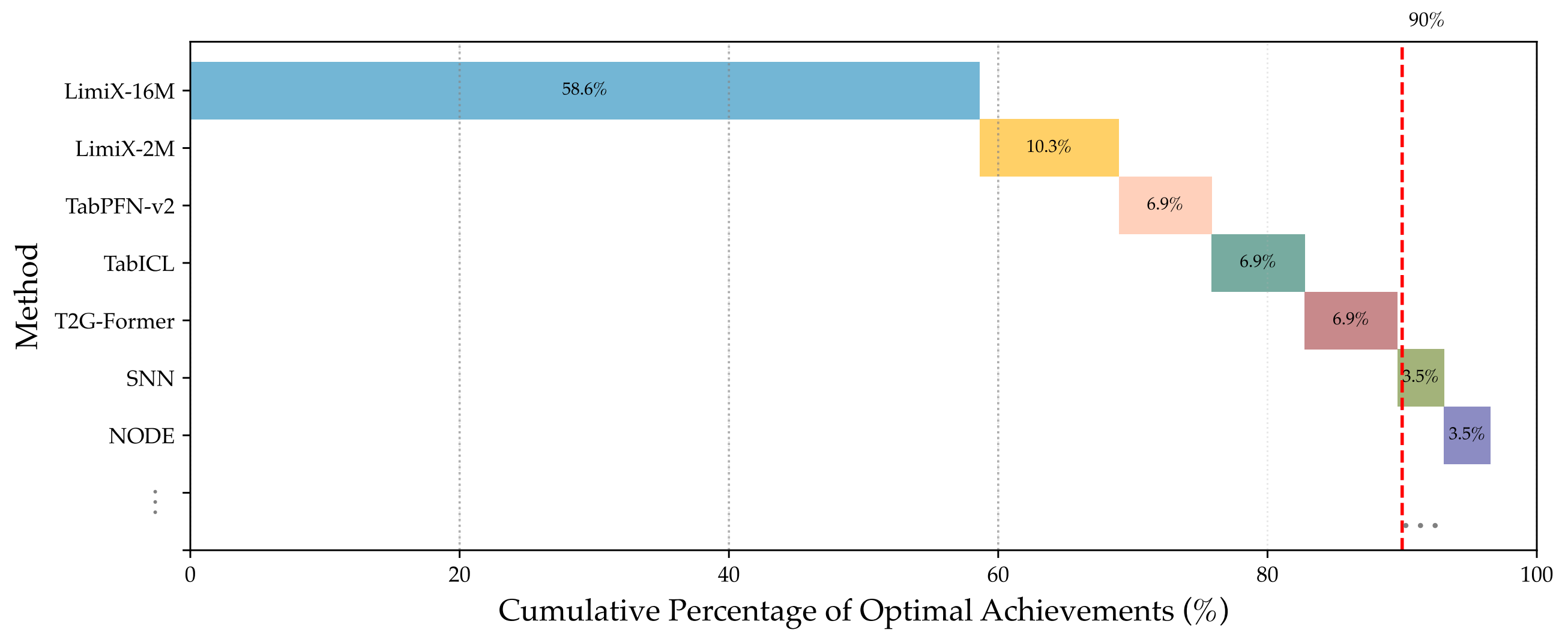

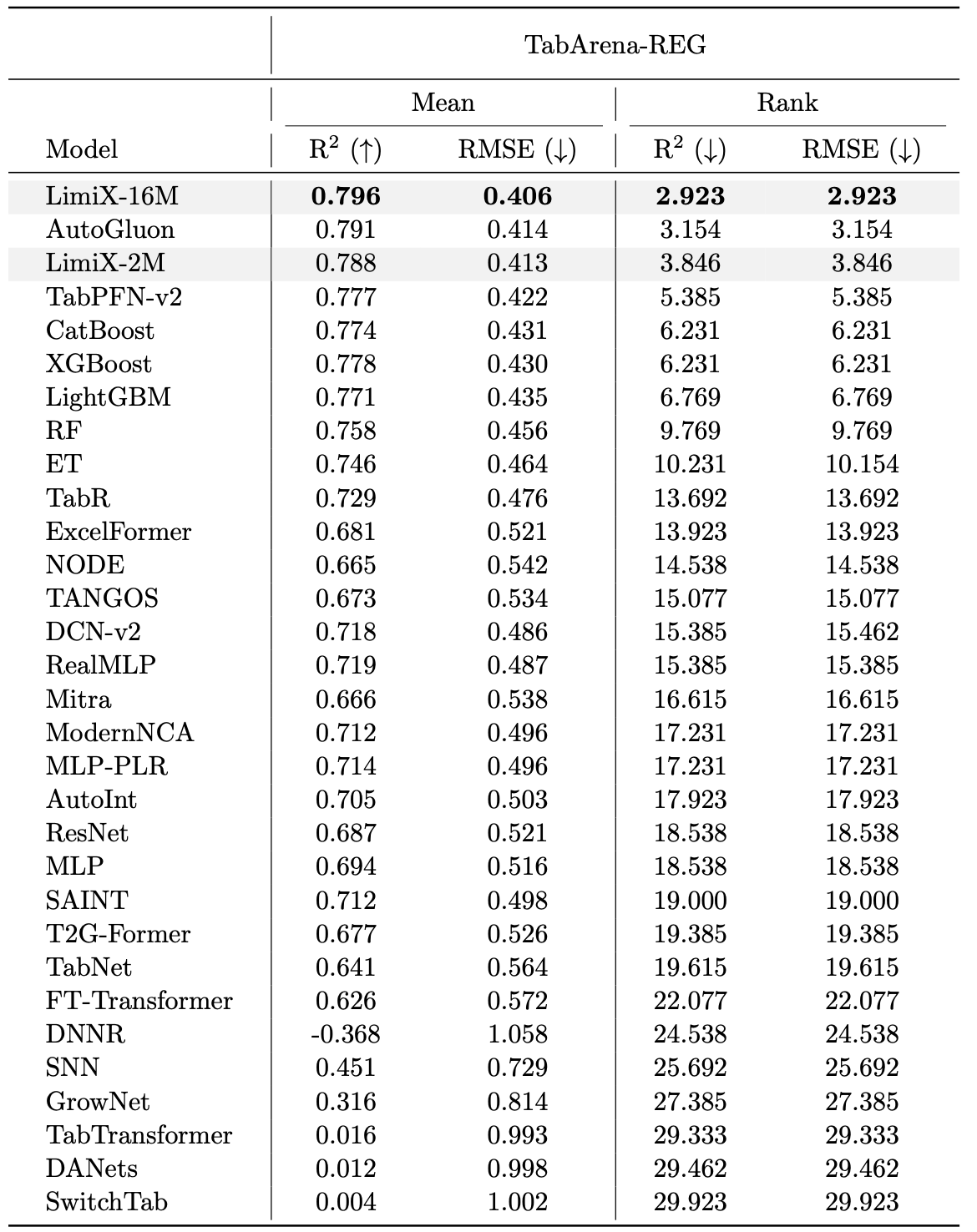

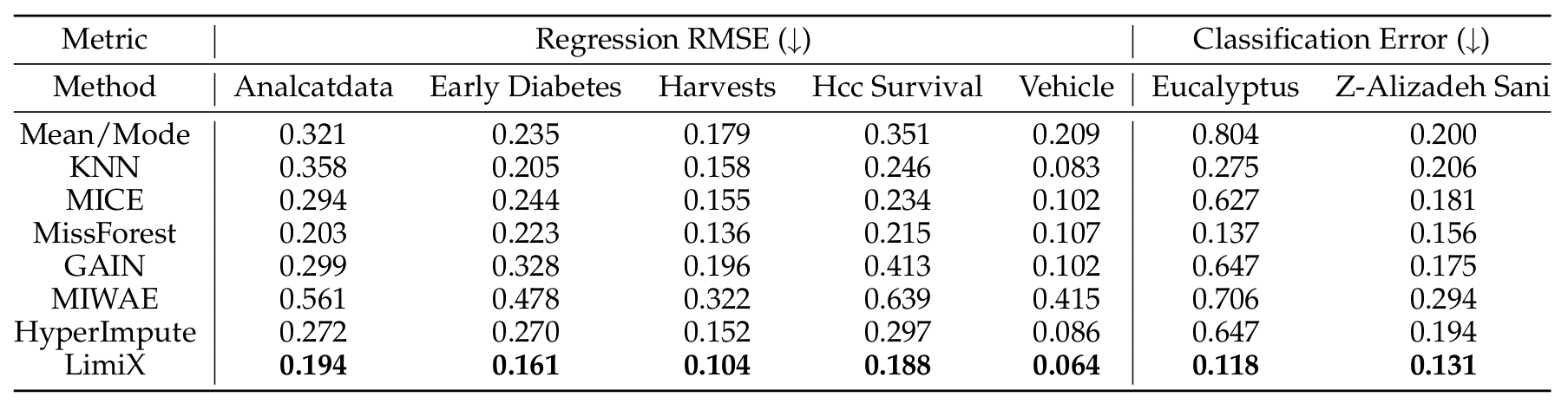

⚡ 最新结果与SOTA模型对比

➤ 概述

LimiX采用专为结构化数据建模和任务泛化优化的Transformer架构。该模型首先将来自先验知识库的特征X和目标Y嵌入为标记表示。在核心模块中,注意力机制同时作用于样本和特征维度,以识别关键样本和特征中的重要模式。随后,这些高维表示会被传递到回归和分类头,从而使模型能够支持多种预测任务。

有关详细信息,请参阅以下技术报告:LimiX:释放结构化数据建模能力,助力通用智能 或 LimiX_Technical_Report.pdf。

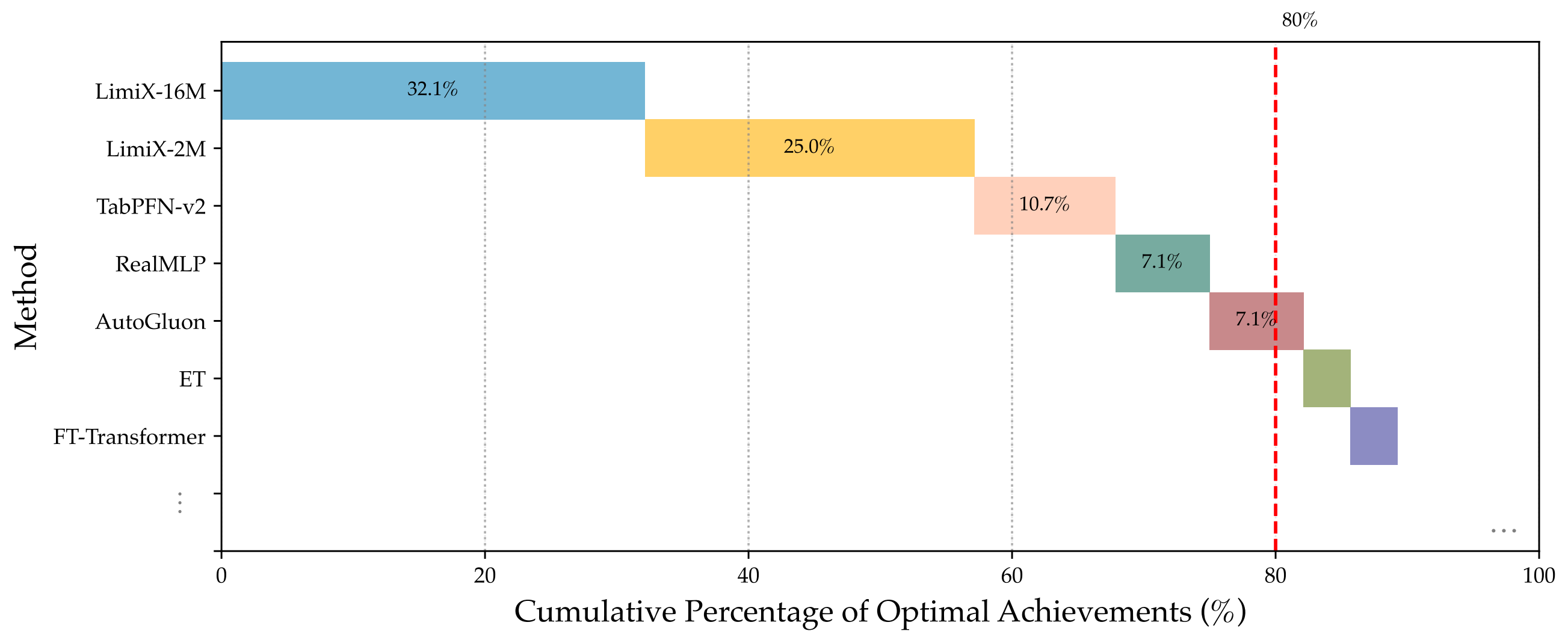

➤ 卓越性能

LimiX模型在多项任务中均取得了SOTA水平的表现。

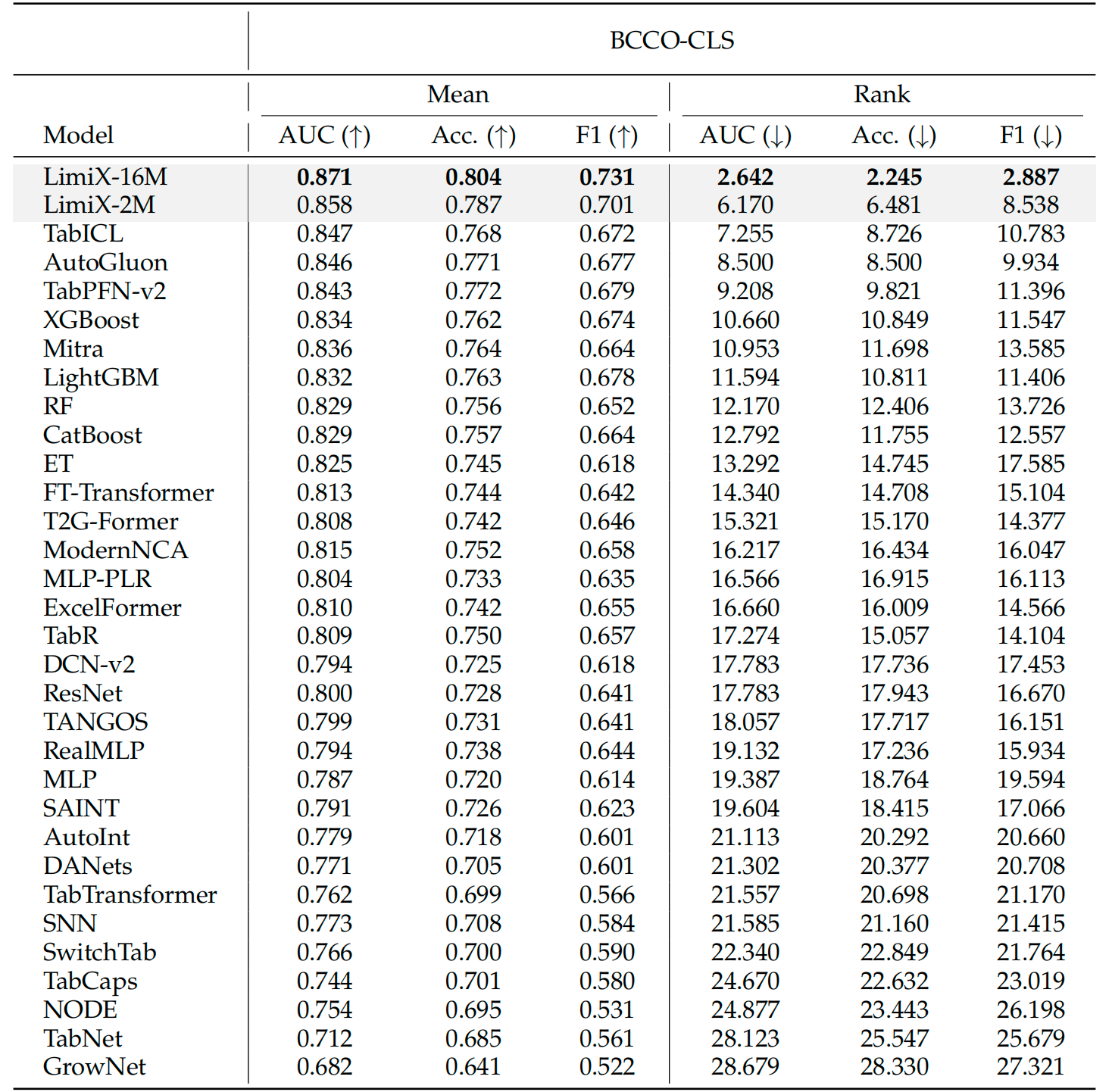

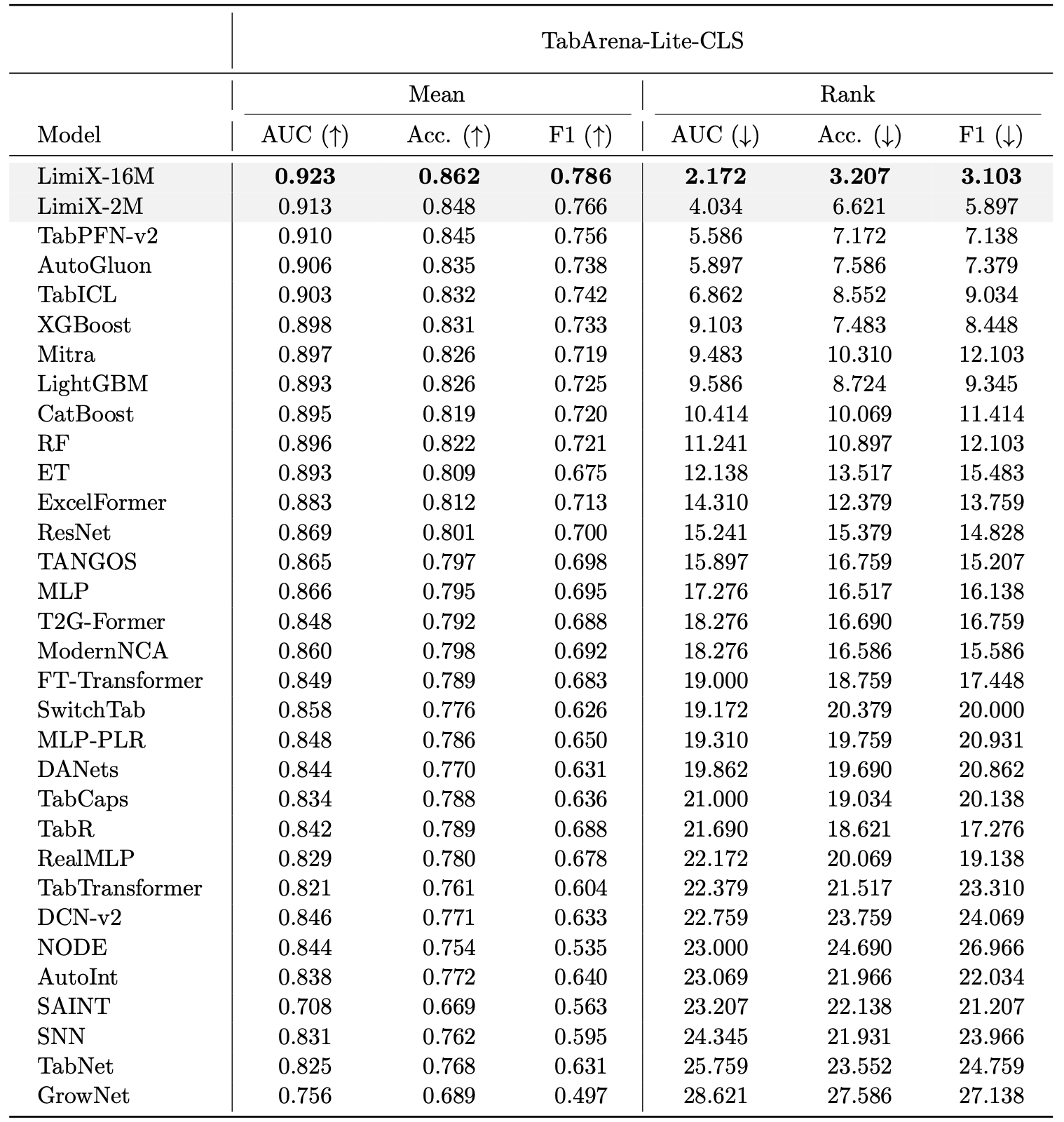

➩ 分类

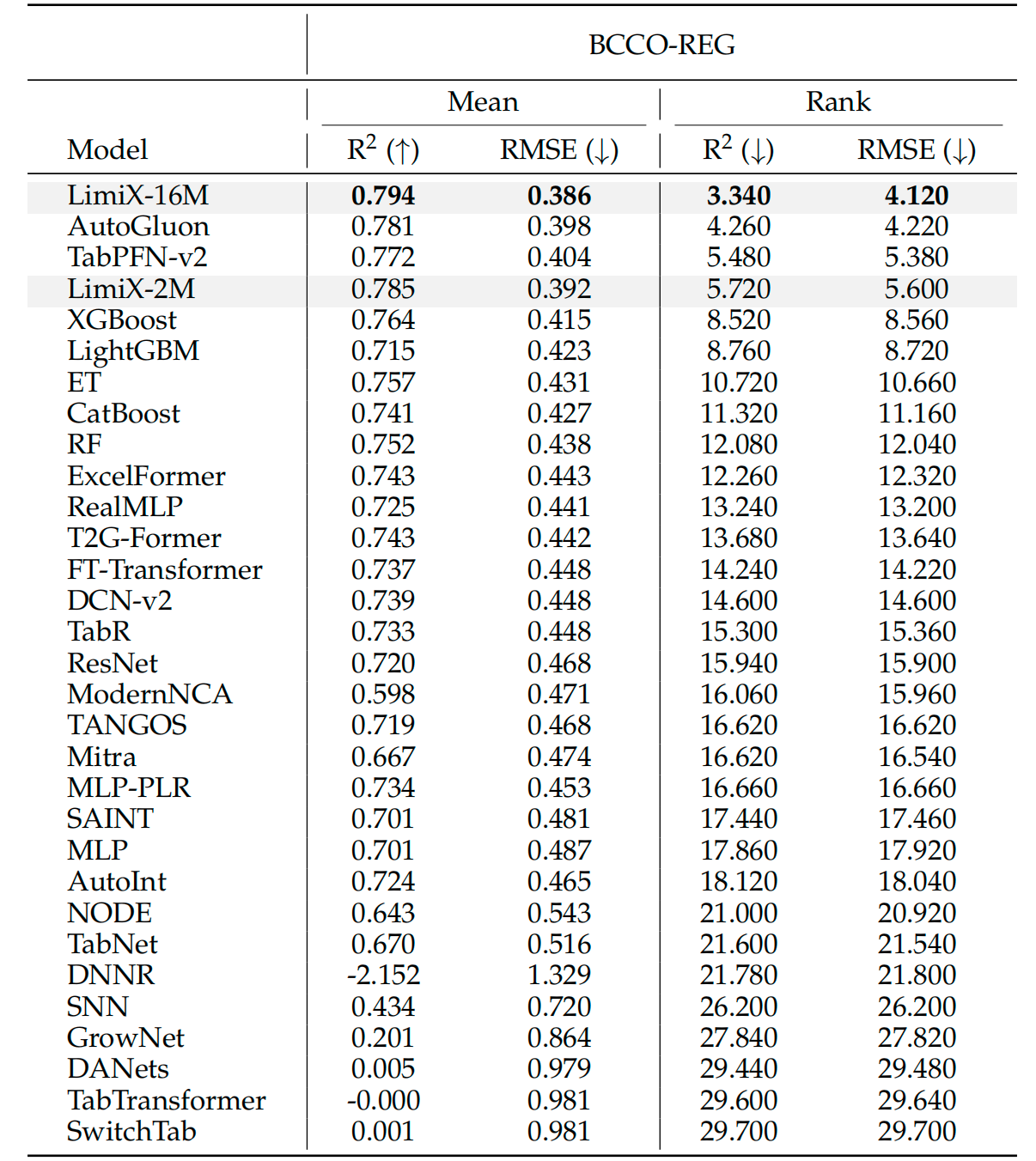

➩ 回归

➩ 缺失值填补

➤ 教程

➩ 安装

方案一(推荐):使用Dockerfile

下载 Dockerfile

docker build --network=host -t limix/infe:v1 --build-arg FROM_IMAGES=nvidia/cuda:12.2.0-base-ubuntu22.04 -f Dockerfile .

方案二:手动构建

下载预编译的flash_attn文件

wget -O flash_attn-2.8.0.post2+cu12torch2.7cxx11abiTRUE-cp312-cp312-linux_x86_64.whl https://github.com/Dao-AILab/flash-attention/releases/download/v2.8.0.post2/flash_attn-2.8.0.post2+cu12torch2.7cxx11abiTRUE-cp312-cp312-linux_x86_64.whl

安装Python依赖

pip install python==3.12.7 torch==2.7.1 torchvision==0.22.1 torchaudio==2.7.1

pip install flash_attn-2.8.0.post2+cu12torch2.7cxx11abiTRUE-cp312-cp312-linux_x86_64.whl

pip install scikit-learn einops huggingface-hub matplotlib networkx numpy pandas scipy tqdm typing_extensions xgboost kditransform hyperopt

下载源代码

git clone https://github.com/limix-ldm/LimiX.git

cd LimiX

➤ 推理

LimiX支持分类、回归和缺失值填补等任务

➩ 模型下载

| 模型大小 | 下载链接 | 支持的任务 |

|---|---|---|

| LimiX-16M | LimiX-16M.ckpt | ✅ 分类 ✅回归 ✅缺失值填补 |

| LimiX-2M | LimiX-2M.ckpt | ✅ 分类 ✅回归 |

➩ 接口说明

模型创建

class LimiXPredictor:

def __init__(self,

device:torch.device,

model_path:str,

mix_precision:bool=True,

inference_config: list|str,

categorical_features_indices:List[int]|None=None,

outlier_remove_std: float=12,

softmax_temperature:float=0.9,

task_type: Literal['Classification', 'Regression']='Classification',

mask_prediction:bool=False,

inference_with_DDP: bool = False,

seed:int=0)

| 参数 | 数据类型 | 描述 |

|---|---|---|

| device | torch.device | 加载模型的硬件设备 |

| model_path | str | 需要加载的模型路径 |

| mix_precision | bool | 是否启用混合精度推理 |

| inference_config | list/str | 用于推理的配置文件 |

| categorical_features_indices | list | 表格数据中分类列的索引 |

| outlier_remove_std | float | 用于去除异常值的阈值,定义为标准差的倍数 |

| softmax_temperature | float | 用于控制Softmax操作行为的温度 |

| task_type | str | 任务类型,可为“分类”或“回归” |

| mask_prediction | bool | 是否启用缺失值填补 |

| inference_with_DDP | bool | 是否在推理过程中启用DDP |

| seed | int | 用于控制随机状态的种子 |

预测

def predict(self, x_train:np.ndarray, y_train:np.ndarray, x_test:np.ndarray) -> np.ndarray:

| 参数 | 数据类型 | 描述 |

|---|---|---|

| x_train | np.ndarray | 训练集的输入特征 |

| y_train | np.ndarray | 训练集的目标变量 |

| x_test | np.ndarray | 测试集的输入特征 |

推理配置文件说明

| 配置文件名 | 说明 | 区别 |

|---|---|---|

| cls_default_retrieval.json | 默认的分类任务推理配置文件,带检索 | 分类性能更优 |

| cls_default_noretrieval.json | 默认的分类任务推理配置文件,不带检索 | 速度更快,内存需求更低 |

| reg_default_retrieval.json | 默认的回归任务推理配置文件,带检索 | 回归性能更优 |

| reg_default_noretrieval.json | 默认的回归任务推理配置文件,不带检索 | 速度更快,内存需求更低 |

| reg_default_noretrieval_MVI.json | 默认的缺失值插补任务推理配置文件 |

➩ 基于样本检索的集成推理

有关基于样本检索的集成推理的详细技术介绍,请参阅技术报告。

考虑到推理速度和内存需求,基于样本检索的集成推理目前仅支持硬件规格高于NVIDIA RTX 4090 GPU的设备。

分类任务

python inference_classifier.py --save_name your_save_name --inference_config_path path_to_retrieval_config --data_dir path_to_data

回归任务

python inference_regression.py --save_name your_save_name --inference_config_path path_to_retrieval_config --data_dir path_to_data

自定义推理任务的数据预处理

首先生成推理配置文件

generate_inference_config()

分类任务

单GPU或CPU

python inference_classifier.py --save_name your_save_name --inference_config_path path_to_retrieval_config --data_dir path_to_data

多GPU分布式推理

torchrun --nproc_per_node=8 inference_classifier.py --save_name your_save_name --inference_config_path path_to_retrieval_config --data_dir path_to_data --inference_with_DDP

回归任务

单GPU或CPU

python inference_regression.py --save_name your_save_name --inference_config_path path_to_retrieval_config --data_dir path_to_data

多GPU分布式推理

torchrun --nproc_per_node=8 inference_regression.py --save_name your_save_name --inference_config_path path_to_retrieval_config --data_dir path_to_data --inference_with_DDP

检索优化项目

该项目实现了一个优化的检索系统。为了达到最佳性能,我们使用Optuna对检索参数进行超参数调优。

安装

请确保已安装所需依赖:

pip install optuna

使用

对于使用预先优化参数的标准推理,请参考以下代码:

searchInference = RetrievalSearchHyperparameters(

dict(device_id=0,model_path=model_path), X_train, y_train, X_test, y_test,

)

config, result = searchInference.search(n_trials=10, metric="AUC",

inference_config='config/cls_default_retrieval.json',task_type="cls")

这将启动一个Optuna研究,为您特定的数据集和用例寻找最佳的检索参数组合。

➩ 分类

from sklearn.datasets import load_breast_cancer

from sklearn.metrics import accuracy_score, roc_auc_score

from sklearn.model_selection import train_test_split

from huggingface_hub import hf_hub_download

import numpy as np

import os, sys

os.environ["RANK"] = "0"

os.environ["WORLD_SIZE"] = "1"

os.environ["MASTER_ADDR"] = "127.0.0.1"

os.environ["MASTER_PORT"] = "29500"

ROOT_DIR = os.path.abspath(os.path.join(os.path.dirname(__file__), ".."))

if ROOT_DIR not in sys.path:

sys.path.insert(0, ROOT_DIR)

from inference.predictor import LimiXPredictor

X, y = load_breast_cancer(return_X_y=True)

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.5, random_state=42)

model_file = hf_hub_download(repo_id="stableai-org/LimiX-16M", filename="LimiX-16M.ckpt", local_dir="./cache")

clf = LimiXPredictor(device=torch.device('cuda'), model_path=model_file, inference_config='config/cls_default_retrieval.json')

prediction = clf.predict(X_train, y_train, X_test)

print("roc_auc_score:", roc_auc_score(y_test, prediction[:, 1]))

print("accuracy_score:", accuracy_score(y_test, np.argmax(prediction, axis=1)))

更多示例请参阅inference_classifier.py

➩ 回归

from functools import partial

from sklearn.datasets import fetch_california_housing

from sklearn.model_selection import train_test_split

from sklearn.metrics import r2_score

from huggingface_hub import hf_hub_download

try:

from sklearn.metrics import root_mean_squared_error as mean_squared_error

except:

from sklearn.metrics import mean_squared_error

mean_squared_error = partial(mean_squared_error, squared=False)

import os, sys

os.environ["RANK"] = "0"

os.environ["WORLD_SIZE"] = "1"

os.environ["MASTER_ADDR"] = "127.0.0.1"

os.environ["MASTER_PORT"] = "29500"

ROOT_DIR = os.path.abspath(os.path.join(os.path.dirname(__file__), ".."))

if ROOT_DIR not in sys.path:

sys.path.insert(0, ROOT_DIR)

from inference.predictor import LimiXPredictor

house_data = fetch_california_housing()

X, y = house_data.data, house_data.target

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.33, random_state=42)

y_mean = y_train.mean()

y_std = y_train.std()

y_train_normalized = (y_train - y_mean) / y_std

y_test_normalized = (y_test - y_mean) / y_std

model_path = hf_hub_download(repo_id="stableai-org/LimiX-16M", filename="LimiX-16M.ckpt", local_dir="./cache")

model = LimiXPredictor(device=torch.device('cuda'), model_path=model_path, inference_config='config/reg_default_retrieval.json')

y_pred = model.predict(X_train, y_train_normalized, X_test)

# 计算RMSE和R²

y_pred = y_pred.to('cpu').numpy()

rmse = mean_squared_error(y_test_normalized, y_pred)

r2 = r2_score(y_test_normalized, y_pred)

print(f'RMSE: {rmse}')

print(f'R2: {r2}')

更多示例请参阅inference_regression.py

➩ 缺失值插补

演示文件请参见examples/demo_missing_value_imputation.py

➤ 链接

- LimiX:释放通用智能的结构化数据建模能力:LimiX:释放通用智能的结构化数据建模能力

- LimiX 技术报告:LimiX_Technical_Report.pdf

- 使用 LimiX 的详细说明:访问 LimiX 官方文档

- 平衡综合挑战性全领域分类基准:bcco_cls

- 平衡综合挑战性全领域回归基准:bcco_reg

➤ 许可证

本仓库中的代码以 Apache-2.0 许可证开源,而 LimiX 模型权重的使用则受模型许可证约束。LimiX 权重完全可用于学术研究,并在获得适当授权后也可用于商业用途。

➤ 引用

@article{zhang2025limix,

title={Limix: Unleashing structured-data modeling capability for generalist intelligence},

author={Zhang, Xingxuan and Ren, Gang and Yu, Han and Yuan, Hao and Wang, Hui and Li, Jiansheng and Wu, Jiayun and Mo, Lang and Mao, Li and Hao, Mingchao and others},

journal={arXiv preprint arXiv:2509.03505},

year={2025}

}

版本历史

V1.1.02025/11/10V1.0.12025/09/19常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。