KrillinAI

KrillinAI 是一款极简且强大的 AI 视频翻译与配音工具,旨在帮助用户轻松实现音视频内容的全球化本地化。它解决了跨语言视频制作中流程繁琐、字幕对齐困难以及配音不自然等痛点,让用户只需一键操作,即可将原始素材转化为适配 YouTube、TikTok、抖音、小红书、哔哩哔哩等主流平台的高质量多语言内容。

无论是希望拓展海外市场的创作者、需要处理多语言素材的媒体从业者,还是对技术部署有顾虑的普通用户,KrillinAI 都能提供友好的使用体验。它无需复杂的环境配置,支持 Windows、macOS 和 Linux 系统,并提供桌面版与服务器版,真正实现了“开箱即用”。

在技术亮点方面,KrillinAI 深度融合了大语言模型(LLM)与 Whisper 语音识别技术。不仅能高精度识别语音,还能利用 LLM 进行智能断句、上下文感知的专业翻译及术语替换,确保译文自然流畅。此外,工具集成了 CosyVoice 声音克隆功能,可保留原声特色或定制专属音色,并自动完成横竖屏视频的合成与字幕布局。从视频下载、识别、翻译到最终成片,KrillinAI 以端到端的全自动化流程,让跨国内容创作变得简单高效。

使用场景

一位专注于科技评测的自媒体博主,需要将长达 40 分钟的英文深度访谈视频快速转化为中文内容,以同步发布在 B 站和抖音上。

没有 KrillinAI 时

- 流程割裂且耗时:需要分别使用不同软件进行语音转写、人工翻译字幕、寻找配音员录制,最后再导入剪辑软件对齐音画,整个流程耗时数天。

- 专业术语翻译生硬:通用翻译工具无法识别特定的芯片型号或算法名称,导致字幕中出现大量错误译名,需人工逐句校对修正。

- 口型与节奏不匹配:传统配音难以还原原说话人的语气和情感,且中文字幕时间轴往往与语速不符,出现字幕重叠或遗漏,观看体验极差。

- 多平台适配困难:为适应抖音(竖屏)和 B 站(横屏)的不同比例,需要手动重新调整字幕位置和画面构图,重复劳动量大。

使用 KrillinAI 后

- 一键全流程自动化:只需上传原始视频文件,KrillinAI 自动完成从语音识别、LLM 智能翻译到 CosyVoice 配音合成的全过程,数小时内即可交付成品。

- 语境化精准翻译:基于大模型的上下文理解能力,KrillinAI 能准确处理科技专有词汇,并通过术语替换功能确保专业度,译文自然流畅无需大幅修改。

- 高保真语音克隆:利用语音克隆技术,KrillinAI 生成的中文配音不仅音色接近原讲者,还能通过智能分段完美对齐口型和停顿,消除机械感。

- 智能多端布局:针对横竖屏需求,KrillinAI 自动调整视频构图与字幕排版,一次性生成适配 YouTube、TikTok 及国内各大平台的多种格式版本。

KrillinAI 将原本繁琐的跨国视频本地化工程缩减为“一键式”操作,让创作者能以最低成本实现全球内容的即时分发。

运行环境要求

- Windows

- Linux

- macOS

- 未说明(支持纯本地模型如 FasterWhisper/WhisperCpp,也支持云端 API

- macOS M 系列芯片有原生优化)

未说明

快速开始

极简AI视频翻译与配音工具

English|简体中文|日本語|한국어|Tiếng Việt|Français|Deutsch|Español|Português|Русский|اللغة العربية

项目介绍 (立即体验在线版!)

KrillinAI是由Krillin AI开发的一款多功能音视频本地化与增强解决方案。这款极简而强大的工具集成了视频翻译、配音和语音克隆功能,支持横屏和竖屏两种格式,确保在各大主流平台上都能完美呈现(哔哩哔哩、小红书、抖音、微信视频号、快手、YouTube、TikTok等)。通过端到端的工作流,您只需点击几下,就能将原始素材转化为精美且可直接使用的跨平台内容。

核心特性与功能:

🎯 一键启动:无需复杂环境配置,自动安装依赖,即开即用,并推出全新桌面版,使用更便捷!

📥 视频获取:支持yt-dlp下载或本地文件上传

📜 精准识别:基于Whisper的高精度语音识别

🧠 智能分段:利用LLM进行字幕分段与对齐

🔄 术语替换:一键替换专业词汇

🌍 专业翻译:结合上下文的LLM翻译,保持自然语义

🎙️ 语音克隆:提供CosyVoice精选音色或自定义语音克隆

🎬 视频合成:自动处理横屏、竖屏视频及字幕布局

💻 跨平台:支持Windows、Linux、macOS,提供桌面版和服务器版

效果展示

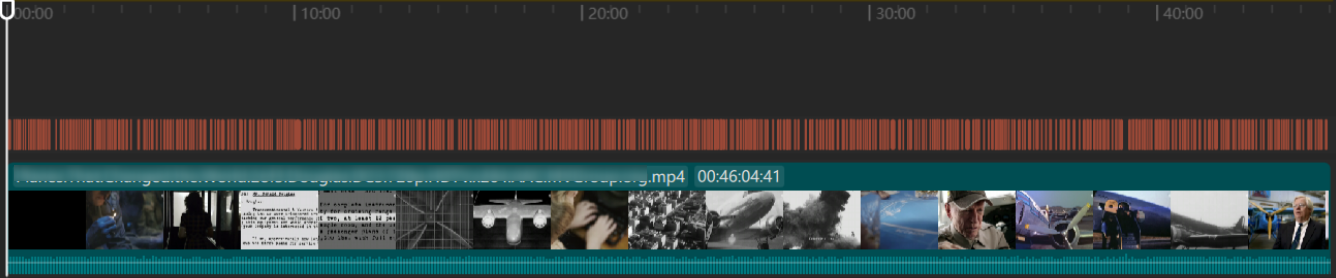

下图展示了导入一段46分钟的本地视频并一键执行后生成的字幕文件效果,全程无需任何手动调整。字幕无遗漏、无重叠,分段自然,翻译质量极高。

🔍 支持的语音识别服务

下表中的所有本地模型均支持可执行文件+模型文件的自动安装;您只需选择,Klic便会为您准备好一切。

| 服务来源 | 支持平台 | 模型选项 | 本地/云端 | 备注 |

|---|---|---|---|---|

| OpenAI Whisper | 所有平台 | - | 云端 | 速度快,效果好 |

| FasterWhisper | Windows/Linux | tiny/medium/large-v2(推荐使用medium及以上) |

本地 | 速度更快,无需支付云服务费用 |

| WhisperKit | macOS(仅M系列) | large-v2 |

本地 | 苹果芯片原生优化 |

| WhisperCpp | 所有平台 | large-v2 |

本地 | 支持所有平台 |

| 阿里云ASR | 所有平台 | - | 云端 | 可避免中国大陆地区的网络问题 |

🚀 大语言模型支持

✅ 兼容所有符合OpenAI API规范的云服务或本地大语言模型服务,包括但不限于:

- OpenAI

- Gemini

- DeepSeek

- 通义千问

- 本地部署的开源模型

- 其他兼容OpenAI格式的API服务

🎤 TTS 文本转语音支持

- 阿里云语音服务

- OpenAI TTS

语言支持

输入语言支持:中文、英语、日语、德语、土耳其语、韩语、俄语、马来语(持续增加中)

翻译语言支持:英语、中文、俄语、西班牙语、法语以及其他101种语言

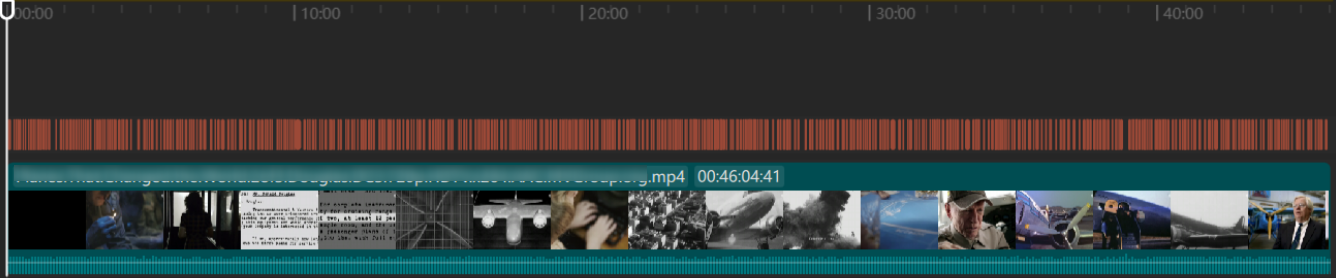

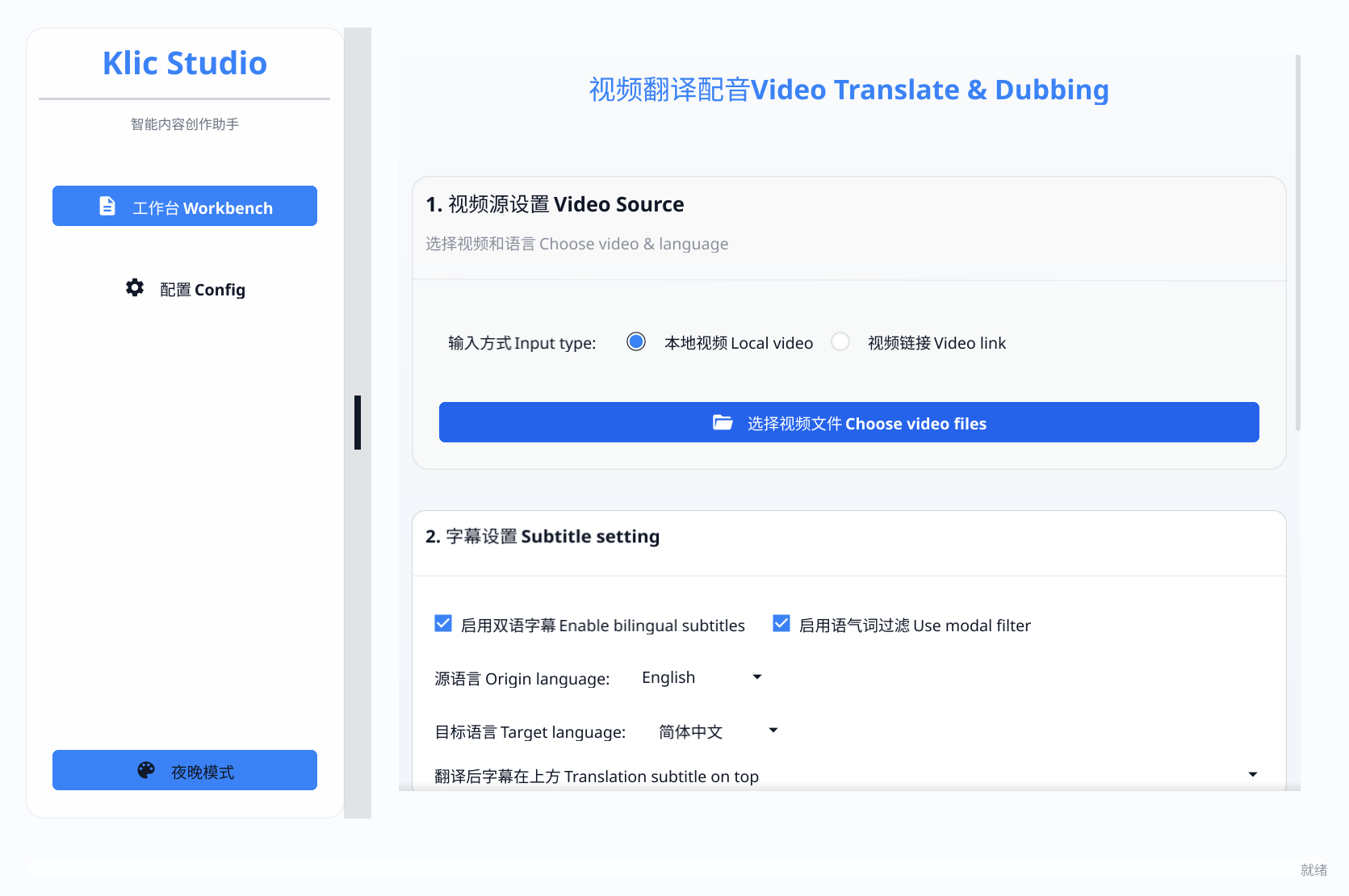

界面预览

🚀 快速开始

您可以在KrillinAI的Deepwiki上提问。该平台索引了仓库中的文件,因此您可以快速找到答案。

基本步骤

首先,请从 Release 下载与您设备系统匹配的可执行文件,然后按照以下教程选择桌面版或非桌面版。请将软件下载放置在一个空文件夹中,因为运行时会生成一些目录,放在空文件夹里便于管理。

【如果是桌面版,即带有“desktop”字样的发布文件,请参阅此处】 桌面版是新推出的版本,旨在解决新用户难以正确编辑配置文件的问题,并且目前仍存在一些正在持续修复的 bug。

- 双击该文件即可开始使用(桌面版同样需要在软件内部进行配置)

【如果是非桌面版,即不带“desktop”字样的发布文件,请参阅此处】 非桌面版是初始版本,配置较为复杂,但功能稳定,适合服务器部署,因为它提供了基于网页的用户界面。

- 在软件所在文件夹内创建一个

config文件夹,然后在config文件夹中创建一个config.toml文件。将源代码config目录下的config-example.toml文件内容复制到config.toml中,并根据注释填写您的配置信息。 - 双击可执行文件,或在终端中运行该文件以启动服务。

- 打开浏览器并输入

http://127.0.0.1:8888即可开始使用(请将 8888 替换为您在配置文件中指定的端口)。

致 macOS 用户

【如果是桌面版,即带有“desktop”字样的发布文件,请参阅此处】 由于签名问题,桌面版目前无法通过双击运行或通过 dmg 安装;您需要手动信任该应用程序。具体方法如下:

- 打开终端,进入可执行文件所在的目录(假设文件名为 KrillinAI_1.0.0_desktop_macOS_arm64)。

- 按照顺序执行以下命令:

sudo xattr -cr ./KrillinAI_1.0.0_desktop_macOS_arm64

sudo chmod +x ./KrillinAI_1.0.0_desktop_macOS_arm64

./KrillinAI_1.0.0_desktop_macOS_arm64

【如果是非桌面版,即不带“desktop”字样的发布文件,请参阅此处】 该软件未经过签名,因此在 macOS 上运行时,在完成“基本步骤”中的文件配置后,您还需要手动信任该应用程序。具体方法如下:

打开终端,进入可执行文件所在的目录(假设文件名为 KrillinAI_1.0.0_macOS_arm64)。

按照顺序执行以下命令:

sudo xattr -rd com.apple.quarantine ./KrillinAI_1.0.0_macOS_arm64 sudo chmod +x ./KrillinAI_1.0.0_macOS_arm64 ./KrillinAI_1.0.0_macOS_arm64这样即可启动服务。

Docker 部署

本项目支持 Docker 部署,请参考 Docker 部署说明。

基于提供的配置文件,以下是更新后的 README 文件中“配置帮助(必读)”部分:

配置帮助(必读)

配置文件分为几个部分:[app]、[server]、[llm]、[transcribe] 和 [tts]。一项任务由语音识别 (transcribe) + 大模型翻译 (llm) + 可选的语音服务 (tts) 组成。理解这一点将有助于您更好地掌握配置文件。

最简单快捷的配置:

仅用于字幕翻译:

- 在

[transcribe]部分,将provider.name设置为openai。 - 然后只需在

[llm]模块中填写您的 OpenAI API 密钥,即可开始进行字幕翻译。app.proxy、model和openai.base_url可根据需要填写。

成本、速度和质量的平衡配置(使用本地语音识别):

- 在

[transcribe]部分,将provider.name设置为fasterwhisper。 - 将

transcribe.fasterwhisper.model设置为large-v2。 - 在

[llm]模块中填写您的大语言模型配置。 - 所需的本地模型将自动下载并安装。

文本转语音 (TTS) 配置(可选):

- TTS 配置是可选的。

- 首先,在

[tts]部分设置provider.name(例如aliyun或openai)。 - 然后,填写所选提供商对应的配置模块。例如,如果您选择

aliyun,则必须填写[tts.aliyun]部分。 - 用户界面上的语音代码应根据所选提供商的文档进行选择。

- 注意: 如果您计划使用语音克隆功能,则必须选择

aliyun作为 TTS 提供商。

阿里云配置:

- 关于如何获取阿里云服务所需的

AccessKey、Bucket和AppKey的详细信息,请参阅 阿里云配置说明。重复的 AccessKey 等字段设计是为了保持清晰的配置结构。

常见问题解答

请访问 常见问题解答。

贡献指南

- 请勿提交无用文件,如

.vscode、.idea等;请使用.gitignore进行过滤。 - 请勿提交

config.toml,而是提交config-example.toml。

联系我们

- 如有任何问题,请加入我们的 QQ 群:754069680。

- 关注我们的社交媒体账号,Bilibili,我们每天都会分享人工智能领域的优质内容。

星标历史

版本历史

v1.4.02025/08/12v1.3.12025/07/27v1.3.02025/07/06v1.2.22025/06/19v1.2.1-hotfix-22025/05/27v1.2.12025/05/26v1.1.52025/05/06v1.1.42025/04/23v1.1.32025/04/19v1.1.22025/04/13v1.1.12025/04/11v1.1.02025/03/30v1.0.02025/03/06v1.0.0-beta.72025/01/22v1.0.0-beta.62025/01/14v1.0.0-beta.52025/01/08v1.0.0-beta.42025/01/03v1.0.0-beta.32024/12/30v1.0.0-beta.22024/12/26v1.0.0-beta2024/12/24相似工具推荐

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。

spec-kit

Spec Kit 是一款专为提升软件开发效率而设计的开源工具包,旨在帮助团队快速落地“规格驱动开发”(Spec-Driven Development)模式。传统开发中,需求文档往往与代码实现脱节,导致沟通成本高且结果不可控;而 Spec Kit 通过将规格说明书转化为可执行的指令,让 AI 直接依据明确的业务场景生成高质量代码,从而减少从零开始的随意编码,确保产出结果的可预测性。 该工具特别适合希望利用 AI 辅助编程的开发者、技术负责人及初创团队。无论是启动全新项目还是在现有工程中引入规范化流程,用户只需通过简单的命令行操作,即可初始化项目并集成主流的 AI 编程助手。其核心技术亮点在于“规格即代码”的理念,支持社区扩展与预设模板,允许用户根据特定技术栈定制开发流程。此外,Spec Kit 强调官方维护的安全性,提供稳定的版本管理,帮助开发者在享受 AI 红利的同时,依然牢牢掌握架构设计的主动权,真正实现从“凭感觉写代码”到“按规格建系统”的转变。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。