PyEPO

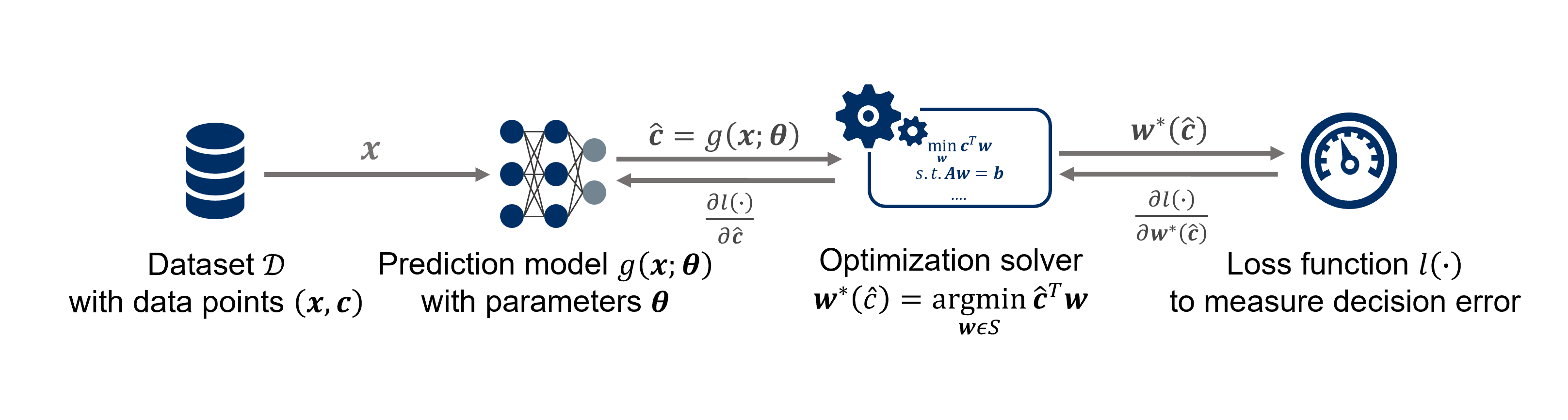

PyEPO 是一款基于 PyTorch 的开源库,专为解决“先预测后优化”(Predict-then-Optimize)问题而设计。在传统流程中,机器学习预测与数学规划求解往往是割裂的,导致最终决策并非全局最优。PyEPO 通过将线性或整数规划模型无缝嵌入神经网络,实现了从数据输入到优化决策的端到端联合训练,让模型能直接以最终决策质量为目标进行优化。

这款工具特别适合人工智能研究人员、运筹学专家以及需要处理复杂决策系统的开发者使用。它支持 Gurobi、COPT、Pyomo、Google OR-Tools 等多种主流求解器,并提供了独特的 GPU 加速亮点:通过集成基于 JAX 的 MPAX 求解器,PyEPO 利用原始 - 对偶混合梯度(PDHG)算法,不仅实现了原生 GPU 求解和批量并行计算,还彻底消除了传统方案中频繁的 CPU-GPU 数据传输瓶颈。这使得大规模优化问题的训练效率显著提升,让用户能够更流畅地构建和部署高效的智能决策系统。

使用场景

某大型物流公司的算法团队正在构建智能调度系统,需要根据实时预测的路况和订单量,动态规划货车的最优配送路线以最小化总成本。

没有 PyEPO 时

- 流程割裂导致次优解:预测模型(如神经网络)与运筹优化求解器(如 Gurobi)分步训练,预测目标仅为降低误差,忽略了最终决策质量,导致“预测很准但路线很贵”。

- 训练效率低下:传统求解器运行在 CPU 上,而深度学习在 GPU 上,每次迭代都需要频繁的 GPU-CPU 数据搬运,严重拖慢端到端训练速度。

- 梯度传递受阻:由于优化步骤不可微,无法将最终决策的损失直接反向传播给预测网络,只能依赖复杂的代理损失函数,调参难度极大。

- 难以批量处理:传统方法难以对迷你批次(Mini-batch)中的数百个调度场景进行并行求解,限制了模型从大规模数据中学习的能力。

使用 PyEPO 后

- 端到端联合优化:PyEPO 将线性规划嵌入 PyTorch 计算图,直接以“最终调度成本”为损失函数训练预测网络,确保预测结果服务于最优决策。

- GPU 原生加速:通过集成 MPAX 求解器,PyEPO 实现了纯 GPU 环境的推理与求解,消除了数据拷贝开销,训练吞吐量提升数倍。

- 自动微分支持:利用 PyTorch Autograd 机制,PyEPO 自动计算优化层关于预测参数的梯度,让模型能直观地学习如何修正预测以改善决策。

- 高效批量求解:借助向量化技术,PyEPO 可同时在 GPU 上并行求解整个批次的优化问题,大幅缩短模型收敛时间。

PyEPO 的核心价值在于打破了预测与决策的壁垒,让 AI 模型不再盲目追求预测精度,而是直接为业务结果的最优化负责。

运行环境要求

- Linux

- macOS

- Windows

- 非必需

- 基础功能依赖 CPU 求解器(如 Gurobi)

- 若使用 MPAX 进行 GPU 加速批量求解,则需支持 CUDA 的 NVIDIA GPU(具体型号和显存未说明)

未说明

快速开始

PyEPO:基于 PyTorch 的端到端预测-优化工具

学习框架

出版物

本仓库是以下论文的官方实现: PyEPO:用于线性和整数规划的基于 PyTorch 的端到端预测-优化库(已被《数学规划计算》(MPC) 接收)

引用:

@article{tang2024,

title={PyEPO: a PyTorch-based end-to-end predict-then-optimize library for linear and integer programming},

author={Tang, Bo and Khalil, Elias B},

journal={Mathematical Programming Computation},

issn={1867-2957},

doi={10.1007/s12532-024-00255-x},

year={2024},

month={July},

publisher={Springer}

}

简介

PyEPO(基于 PyTorch 的端到端预测-优化工具)是一款基于 Python 的开源软件,支持建模和求解具有线性目标函数的预测-优化问题。PyEPO 的核心功能是利用 GurobiPy、COPT、Pyomo、Google OR-Tools、MPAX 或其他求解器与算法构建优化模型,然后将该优化模型嵌入人工神经网络中进行端到端训练。为此,PyEPO 将多种方法实现为 PyTorch 自动微分模块。

特别地,PyEPO 集成了 MPAX,这是一款基于 JAX 的数学规划求解器,采用 PDHG(原始-对偶混合梯度)算法进行 GPU 加速优化。MPAX 为端到端训练带来了三大优势:(1) GPU 原生求解 — 一阶 PDHG 方法本身具有并行性,可在 GPU 上高效运行;(2) 批量求解 — 整个 mini-batch 的优化实例可通过向量化在 GPU 上同时求解;以及 (3) 无需 GPU–CPU 数据传输开销 — 传统求解器(如 Gurobi)运行在 CPU 上,每次训练迭代都需要在 GPU 和 CPU 之间进行昂贵的数据传输,而 MPAX 则将神经网络和求解器都保留在 GPU 上,从而消除了这一瓶颈。

文档

PyEPO 的官方文档可在 https://khalil-research.github.io/PyEPO 查看。

幻灯片

我们最近的教程是在 ACC 2024 大会上进行的。您可以通过此链接查看演讲幻灯片:https://github.com/khalil-research/PyEPO/blob/main/slides/PyEPO.pdf。

教程

01 优化模型: 构建优化求解器

02 优化数据集: 生成合成数据并使用 optDataset

03 训练与测试: 训练和测试不同的方法

04 二维背包问题解可视化: 可视化背包问题的解

05 战术争霸最短路径: 在 Warcraft 地形数据集上训练最短路径模型

06 实际能源调度: 将 PyEPO 应用于真实能源数据

07 kNN 鲁棒损失: 使用 optDatasetKNN 进行鲁棒损失计算

08 使用 MPAX 和 PDHG 求解: 使用 MPAX 进行 GPU 加速的批量求解

实验

要复现原论文中的实验,请使用此代码并按照该分支中的说明操作:https://github.com/khalil-research/PyEPO/tree/MPC。请注意,该分支仍处于非常早期的版本阶段。

功能

- 实现 SPO+ [1]、DBB [3]、NID [7]、DPO [4]、PFYL [4]、NCE [5]、LTR [6]、I-MLE [8]、AI-MLE [9] 以及 PG [11]。

- 支持 Gurobi、COPT、Pyomo、Google OR-Tools 和 MPAX 的 API。

- 支持优化求解器的并行计算。

- 支持解缓存 [5],以加速训练。

- 支持 kNN 稳健损失 [10],以提高决策质量。

安装

从本仓库克隆并安装

您可以从我们的 GitHub 仓库下载 PyEPO。

git clone -b main --depth 1 https://github.com/khalil-research/PyEPO.git

然后进行安装:

pip install PyEPO/pkg/.

使用 pip 安装

该软件包现已在 PyPI 上架。您可以通过运行以下命令轻松使用 pip 安装 PyEPO:

pip install pyepo

使用 conda 安装

PyEPO 也已在 Anaconda Cloud 上发布。如果您更倾向于使用 conda 进行安装,可以使用以下命令安装 PyEPO:

conda install -c pyepo pyepo

依赖项

示例代码

#!/usr/bin/env python

# coding: utf-8

import gurobipy as gp

from gurobipy import GRB

import numpy as np

import pyepo

from pyepo.model.grb import optGrbModel

import torch

from torch import nn

from torch.utils.data import DataLoader

# 优化模型

class myModel(optGrbModel):

def __init__(self, weights):

self.weights = np.array(weights)

self.num_item = len(weights[0])

super().__init__()

def _getModel(self):

# 创建模型

m = gp.Model()

# 变量

x = m.addVars(self.num_item, name="x", vtype=GRB.BINARY)

# 目标函数方向

m.modelSense = GRB.MAXIMIZE

# 约束条件

m.addConstr(gp.quicksum([self.weights[0,i] * x[i] for i in range(self.num_item)]) <= 7)

m.addConstr(gp.quicksum([self.weights[1,i] * x[i] for i in range(self.num_item)]) <= 8)

m.addConstr(gp.quicksum([self.weights[2,i] * x[i] for i in range(self.num_item)]) <= 9)

return m, x

# 预测模型

class LinearRegression(nn.Module):

def __init__(self):

super(LinearRegression, self).__init__()

self.linear = nn.Linear(num_feat, num_item)

def forward(self, x):

out = self.linear(x)

return out

if __name__ == "__main__":

# 生成数据

num_data = 1000 # 数据数量

num_feat = 5 # 特征维度

num_item = 10 # 项目数量

weights, x, c = pyepo.data.knapsack.genData(num_data, num_feat, num_item,

dim=3, deg=4, noise_width=0.5, seed=135)

# 初始化优化模型

optmodel = myModel(weights)

# 初始化预测模型

predmodel = LinearRegression()

# 设置优化器

optimizer = torch.optim.Adam(predmodel.parameters(), lr=1e-2)

# 初始化 SPO+ 损失函数

spop = pyepo.func.SPOPlus(optmodel, processes=1)

# 构建数据集

dataset = pyepo.data.dataset.optDataset(optmodel, x, c)

# 获取数据加载器

dataloader = DataLoader(dataset, batch_size=32, shuffle=True)

# 训练

num_epochs = 10

for epoch in range(num_epochs):

for data in dataloader:

x, c, w, z = data

# 前向传播

cp = predmodel(x)

loss = spop(cp, c, w, z)

# 反向传播

optimizer.zero_grad()

loss.backward()

optimizer.step()

# 评估

regret = pyepo.metric.regret(predmodel, optmodel, dataloader)

print("训练集上的遗憾值:{:.4f}".format(regret))

参考文献

- [1] Elmachtoub, A. N., & Grigas, P. (2021). 智能“先预测、后优化”。管理科学。

- [2] Mandi, J., Stuckey, P. J., & Guns, T. (2020). 面对困难组合优化问题的智能预测-优化方法。收录于AAAI人工智能会议论文集。

- [3] Vlastelica, M., Paulus, A., Musil, V., Martius, G., & Rolínek, M. (2019). 黑盒组合求解器的差异化。arXiv预印本,arXiv:1912.02175。

- [4] Berthet, Q., Blondel, M., Teboul, O., Cuturi, M., Vert, J. P., & Bach, F. (2020). 基于可微扰动优化器的学习。神经信息处理系统进展,第33卷,页9508–9519。

- [5] Mulamba, M., Mandi, J., Diligenti, M., Lombardi, M., Bucarey, V., & Guns, T. (2021). 用于预测-优化的对比损失与解缓存技术。第三十届国际人工智能联合会议论文集。

- [6] Mandi, J., Bucarey, V., Mulamba, M., & Guns, T. (2022). 以决策为中心的学习:从排序学习的视角看。第三十九届国际机器学习会议论文集。

- [7] Sahoo, S. S., Paulus, A., Vlastelica, M., Musil, V., Kuleshov, V., & Martius, G. (2022). 通过组合算法进行反向传播:带投影的恒等映射有效。arXiv预印本,arXiv:2205.15213。

- [8] Niepert, M., Minervini, P., & Franceschi, L. (2021). 隐式最大似然估计:通过离散指数族分布进行反向传播。神经信息处理系统进展,第34卷,页14567–14579。

- [9] Minervini, P., Franceschi, L., & Niepert, M. (2023年6月). 面向离散潜在变量模型的自适应扰动梯度估计。收录于AAAI人工智能会议论文集(第37卷,第8期,页9200–9208)。

- [10] Schutte, N., Postek, K., & Yorke-Smith, N. (2023). 用于以决策为中心学习的鲁棒损失函数。arXiv预印本,arXiv:2310.04328。

- [11] Gupta, V., & Huang, M. (2024). 基于方向梯度的以决策为中心的学习。培训,第50卷第100期,第150页。

版本历史

v1.1.12026/02/11v1.1.02026/02/10v1.0.52026/02/09v1.0.42026/02/09v1.0.02025/03/06v0.4.02024/12/20v0.3.92024/06/11v0.3.8a2024/05/20v0.3.82024/04/24v0.3.72024/04/19v0.3.62024/02/14v0.3.52023/10/21v0.3.32023/07/17v0.3.02023/07/10v0.2.42023/03/15v0.2.02022/10/06v0.1.02022/10/05常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。