tokscale

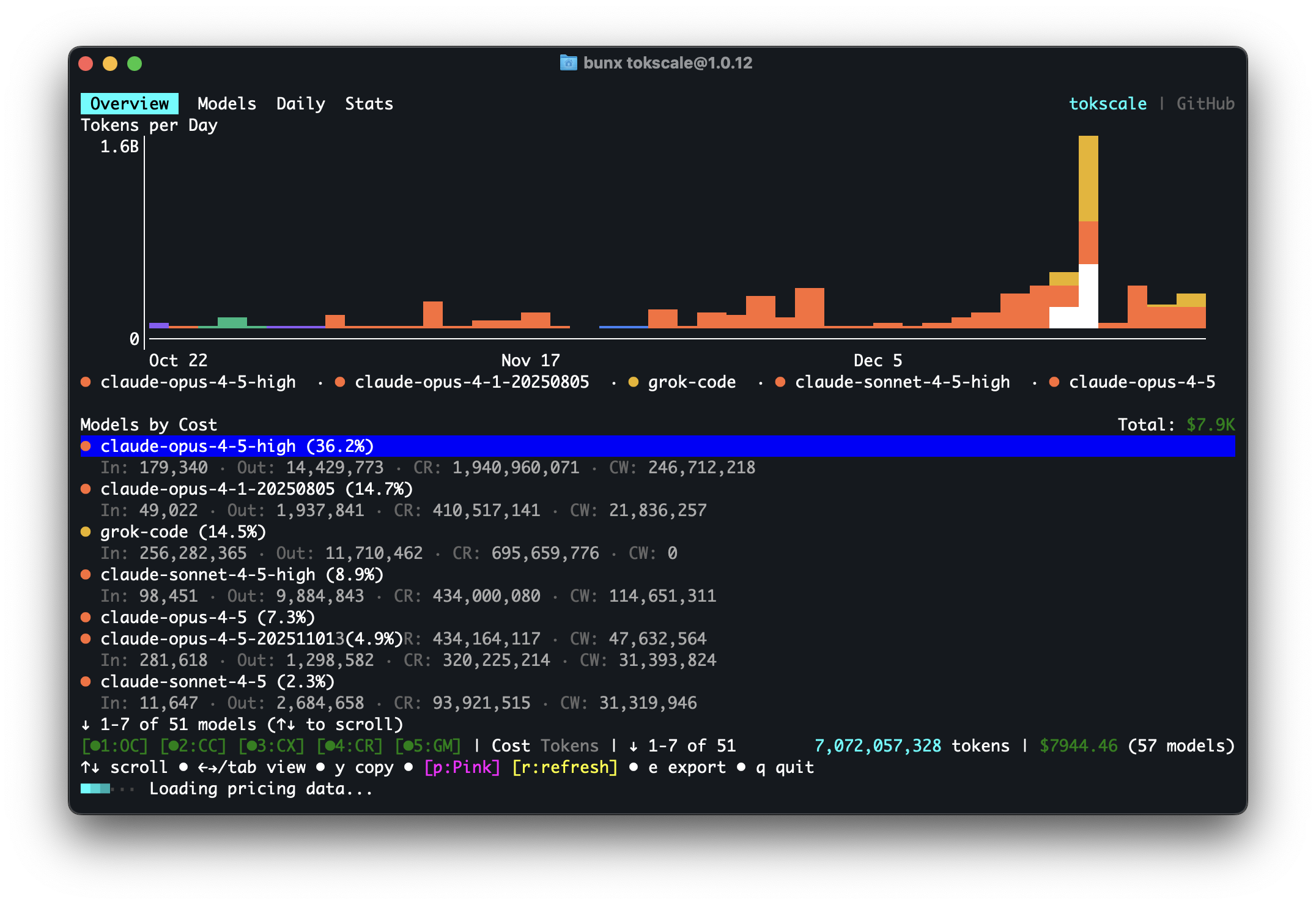

tokscale 是一款高性能的命令行工具,专为监控和分析各类 AI 编程助手的 Token 消耗与成本而设计。随着开发者频繁使用 OpenCode、Claude Code、Cursor、Kimi 等多种 AI 代理进行编码,往往难以直观掌握各模型的具体用量及相应费用,导致成本失控或优化无从下手。tokscale 正是为了解决这一痛点,它能自动读取本地不同工具的日志数据,提供统一的用量视图。

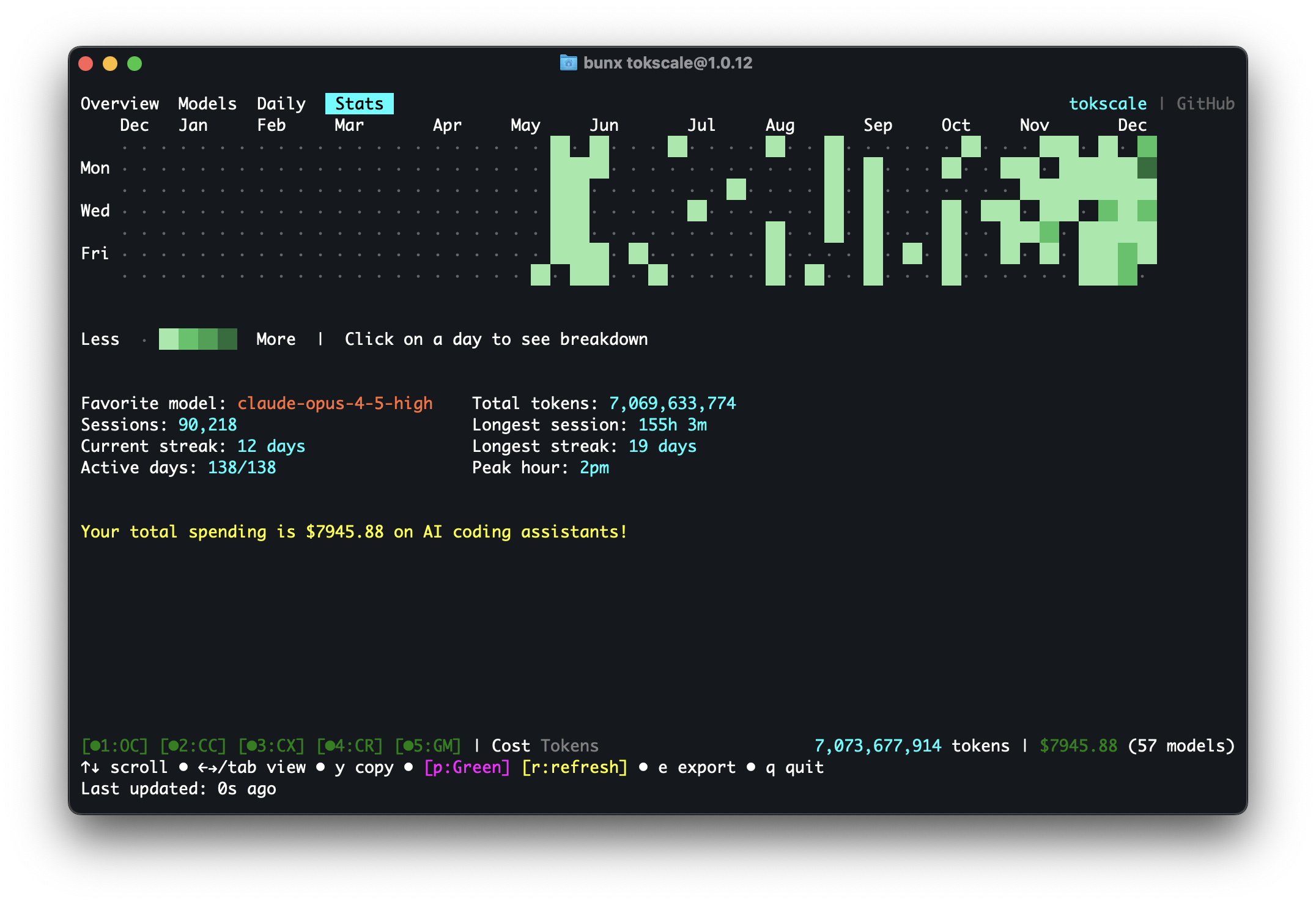

这款工具特别适合依赖 AI 辅助编程的开发者、技术团队负责人以及关注大模型应用成本的研究人员。通过 tokscale,用户不仅能查看详细的每日汇总和模型统计,还能体验基于 Rust 构建的流畅原生终端界面(TUI),支持跨平台运行。其独特亮点在于提供了可视化的 2D/3D 贡献图谱和全球排行榜,用户甚至可以将自己的使用数据提交至云端,生成个性化的年度总结报告。无论是为了精细控制项目预算,还是单纯想探索自己的 AI 协作习惯,tokscale 都能以轻量、专业的方式提供清晰的数据洞察,帮助用户更明智地使用 AI 资源。

使用场景

某全栈开发团队在日常工作中同时使用 Claude Code、Cursor 和 OpenCode 等多种 AI 编程助手进行快速迭代,亟需掌控整体 Token 消耗以优化成本。

没有 tokscale 时

- 数据分散难统计:各工具的 Token 记录散落在不同的本地数据库或日志文件中,手动汇总耗时且容易出错。

- 成本黑盒无感知:无法实时查看具体哪个模型或哪次会话消耗了大量 Token,往往等到月底收到高额账单才后知后觉。

- 缺乏可视化分析:只有枯燥的数字列表,难以直观判断每日用量趋势或识别异常的高峰时段。

- 团队协作无基准:成员间无法对比使用效率,缺乏全局排行榜来激励优化提示词或减少冗余调用。

使用 tokscale 后

- 一键聚合多源数据:tokscale 自动读取并统一展示来自 Claude Code、Cursor 等所有支持工具的用量数据,生成标准化报表。

- 实时监控与预警:通过原生 Rust TUI 界面实时刷新消耗详情,精准定位高成本模型和会话,立即调整使用策略。

- 直观图表辅助决策:利用 2D/3D 贡献图和每日摘要视图,清晰呈现用量波动规律,快速发现并解决异常消耗问题。

- 全球榜单驱动优化:提交数据至全球排行榜,团队可在匿名对比中了解自身效率水平,主动优化工作流以降低单位产出成本。

tokscale 将分散隐蔽的 Token 消耗转化为透明可视的数据资产,帮助开发者在享受 AI 提效红利的同时牢牢掌握成本主动权。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

一款高性能的命令行工具及可视化仪表盘,用于跟踪多个 AI 编码代理的 token 使用量和成本。

[!TIP]

v2 已发布——原生 Rust TUI、跨平台支持等更多功能。每周我都会推出新的开源项目,别错过下一个哦。

关注 GitHub 上的 @junhoyeo,了解更多项目。专注于 AI、基础设施以及相关领域的开发。 欢迎加入我们的 Discord 社区,与全球顶尖开发者一起交流互动。

🇺🇸 English | 🇰🇷 한국어 | 🇯🇵 日本語 | 🇨🇳 简体中文

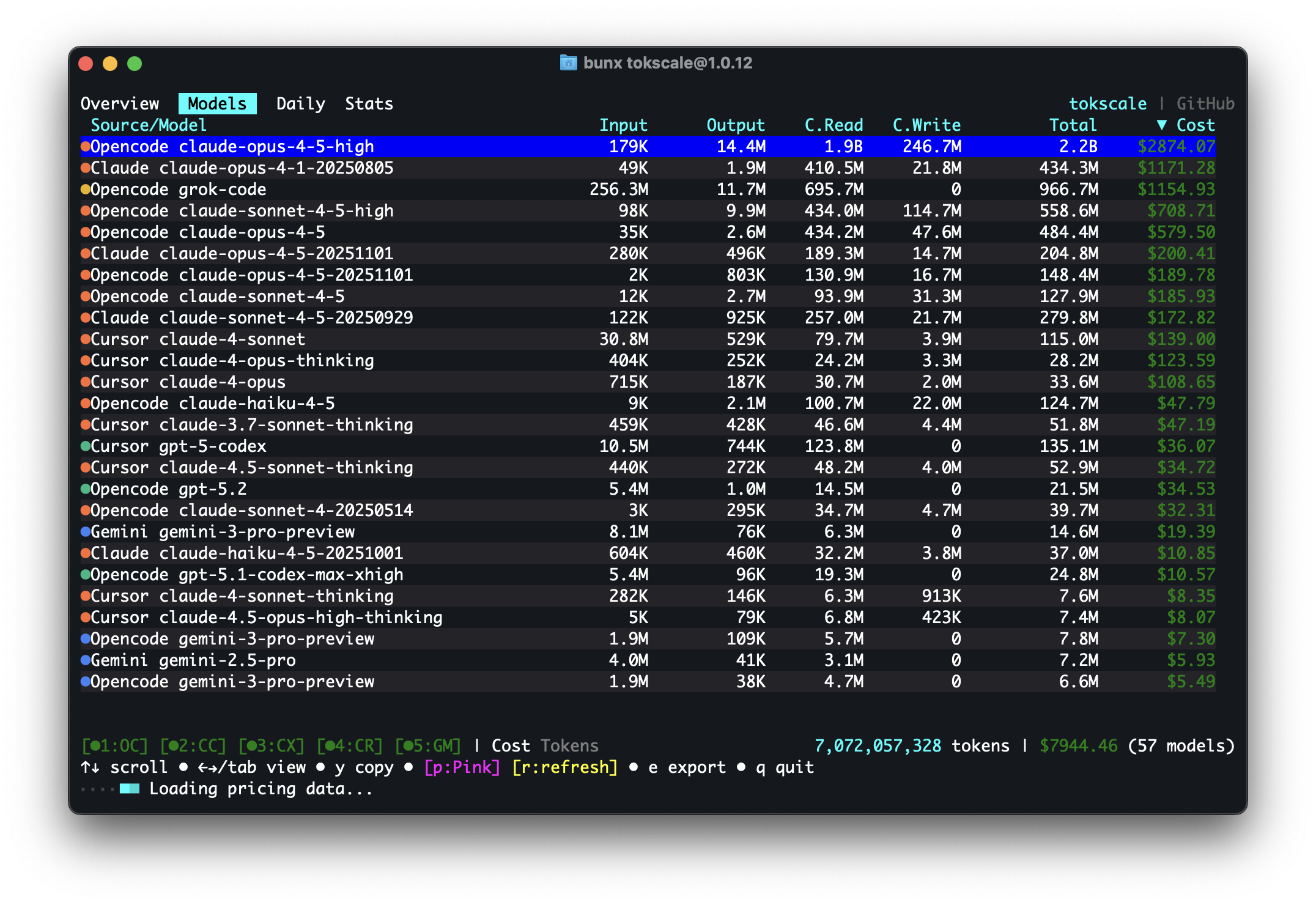

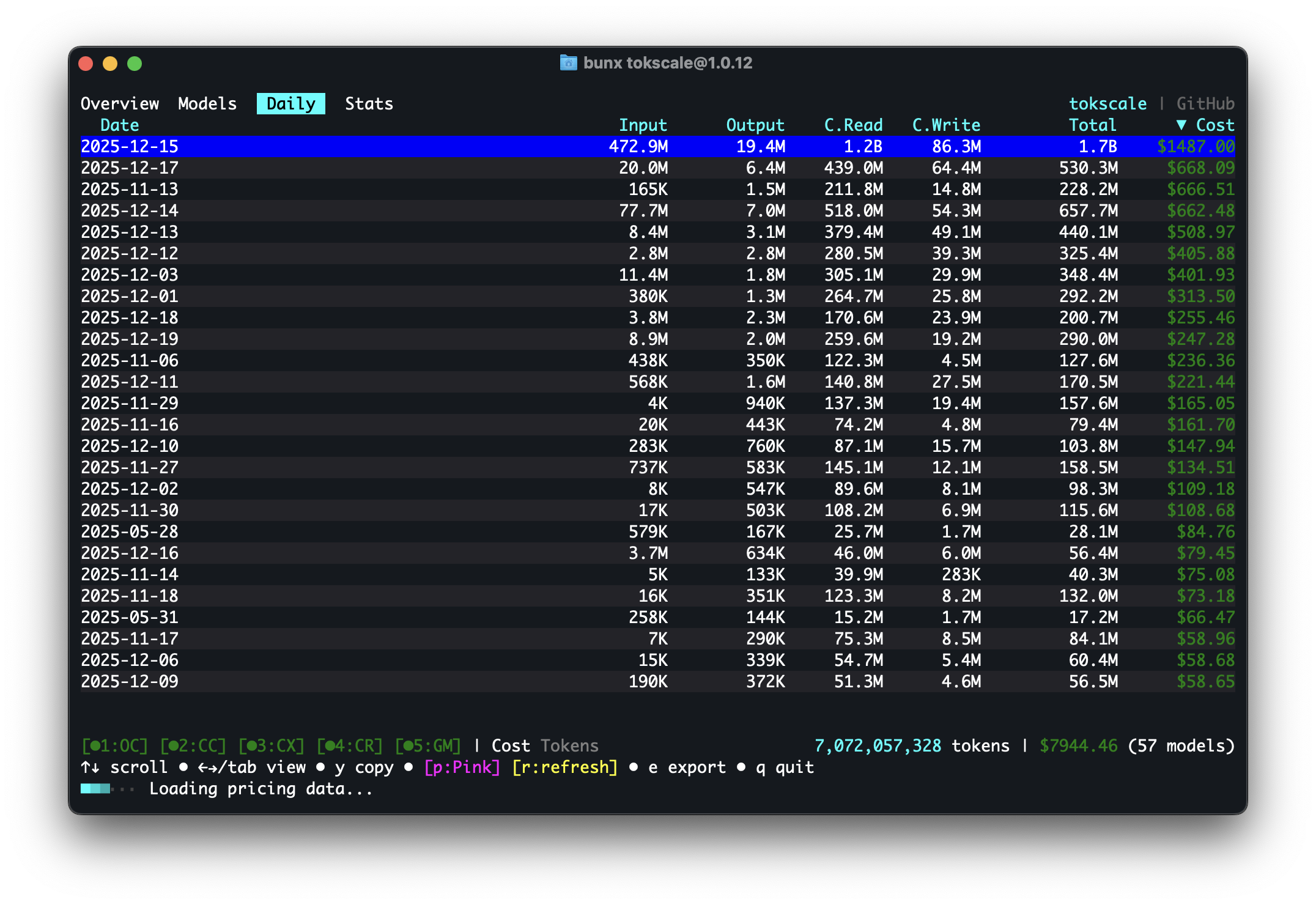

| 概览 | 模型 |

|---|---|

|

|

| 每日摘要 | 统计数据 |

|---|---|

|

|

| 前端(3D 贡献图) | Wrapped 2025 |

|---|---|

|

|

运行

bunx tokscale@latest submit,将你的使用数据提交到排行榜并创建公开个人资料!

概述

Tokscale 可帮助你监控和分析以下来源的 token 消耗情况:

| 标志 | 客户端 | 数据位置 | 支持情况 |

|---|---|---|---|

|

OpenCode | ~/.local/share/opencode/opencode.db (1.2+) 或/且 ~/.local/share/opencode/storage/message/ (旧版/未迁移) |

✅ 是 |

|

Claude Code | ~/.claude/projects/ |

✅ 是 |

|

OpenClaw | ~/.openclaw/agents/ (+ 旧版:.clawdbot、.moltbot、.moldbot) |

✅ 是 |

|

Codex CLI | ~/.codex/sessions/ |

✅ 是 |

|

Gemini CLI | ~/.gemini/tmp/*/chats/*.json |

✅ 是 |

|

Cursor IDE | 通过 ~/.config/tokscale/cursor-cache/ 进行 API 同步 |

✅ 是 |

|

Amp (AmpCode) | ~/.local/share/amp/threads/ |

✅ 是 |

|

Droid (Factory Droid) | ~/.factory/sessions/ |

✅ 是 |

|

Pi | ~/.pi/agent/sessions/ |

✅ 是 |

|

Kimi CLI | ~/.kimi/sessions/ |

✅ 是 |

|

Qwen CLI | ~/.qwen/projects/ |

✅ 是 |

|

Roo Code | ~/.config/Code/User/globalStorage/rooveterinaryinc.roo-cline/tasks/ (+ 服务器:~/.vscode-server/data/User/globalStorage/rooveterinaryinc.roo-cline/tasks/) |

✅ 是 |

|

Kilo | ~/.config/Code/User/globalStorage/kilocode.kilo-code/tasks/ (+ 服务器:~/.vscode-server/data/User/globalStorage/kilocode.kilo-code/tasks/) |

✅ 是 |

|

Mux | ~/.mux/sessions/ |

✅ 是 |

|

Kilo CLI | ~/.local/share/kilo/kilo.db |

✅ 是 |

|

Crush | $XDG_DATA_HOME/crush/projects.json (项目注册表;备用:~/.local/share/crush/projects.json) |

✅ 是 |

|

Synthetic | 通过 hf: 模型前缀或 synthetic 提供商从其他来源重新归因而来 (+ Octofriend:~/.local/share/octofriend/sqlite.db) |

✅ 是 |

使用 🚅 LiteLLM 的定价数据,获取实时定价计算,支持分层定价模型和缓存 token 折扣。

为什么叫“Tokscale”?

本项目灵感源自卡达谢夫量表(Kardashev scale),这是天体物理学家尼古拉·卡达谢夫提出的一种衡量文明技术发展水平的方法,其依据是该文明的能量消耗。I型文明能够利用其所在行星上的全部能量,II型文明则能捕获其恒星的全部能量输出,而III型文明则掌控整个星系的能量。

在人工智能辅助开发的时代,token就是新的能源。它们驱动我们的推理能力、提升生产力,并推动创意产出。正如卡达谢夫量表以宇宙尺度追踪能量消耗一样,Tokscale会根据你在 AI 增强开发领域的进步程度来衡量你的 token 消耗情况。无论你是普通用户,还是每天消耗数百万 tokens 的开发者,Tokscale 都能帮助你可视化自己的成长轨迹——从行星级开发者到银河系级别的代码架构师。

目录

功能

- 交互式 TUI 模式:由 Ratatui 提供支持的精美终端 UI(默认模式)

- 4 个交互式视图:概览、模型、每日、统计

- 键盘与鼠标导航

- GitHub 风格的贡献图,提供 9 种配色主题

- 实时过滤与排序

- 无闪烁渲染

- 多平台支持:跟踪 OpenCode、Claude Code、Codex CLI、Cursor IDE、Gemini CLI、Amp、Droid、OpenClaw、Pi、Kimi CLI、Qwen CLI、Roo Code、Kilo、Mux、Kilo CLI、Crush 和 Synthetic 等平台的使用情况。

- 实时定价:从 LiteLLM 获取当前价格,缓存有效期为 1 小时;自动回退至 OpenRouter,并为新发布的模型提供 Cursor 模型定价。

- 详细拆分:输入、输出、缓存读写以及推理 token 的追踪。

- 原生 Rust 核心:所有解析和聚合操作均由 Rust 完成,处理速度提升 10 倍。

- Web 可视化:交互式贡献图,支持 2D 和 3D 视图。

- 灵活筛选:可按平台、日期范围或年份进行筛选。

- 导出为 JSON:生成数据以便用于外部可视化工具。

- 社交平台:分享你的使用情况、参与排行榜竞争并查看公开资料。

安装

快速入门

# 直接使用 npx 运行

npx tokscale@latest

# 或者使用 bunx

bunx tokscale@latest

# 轻量模式(仅表格显示)

npx tokscale@latest --light

就这么简单!无需任何设置即可获得完整的交互式 TUI 体验。

包结构:“tokscale” 是一个别名包(类似于

swc),它会安装@tokscale/cli。两者都会安装相同的 CLI,并包含原生 Rust 核心 (@tokscale/core)。

前提条件

开发环境搭建

若需本地开发或从源码构建:

# 克隆仓库

git clone https://github.com/junhoyeo/tokscale.git

cd tokscale

# 安装 Bun(如果尚未安装)

curl -fsSL https://bun.sh/install | bash

# 安装依赖

bun install

# 以开发模式运行 CLI

bun run cli

注意:“bun run cli” 用于本地开发。通过

bunx tokscale安装后,直接运行即可。下方的使用部分展示了已安装的二进制命令。

构建原生模块

原生 Rust 模块是 CLI 正常运行的必要条件。它通过并行文件扫描和 SIMD JSON 解析,将处理速度提升约 10 倍:

# 构建原生核心(在仓库根目录下运行)

bun run build:core

注意:通过

bunx tokscale@latest安装时,预编译的原生二进制文件已包含在内。只有在本地开发时才需要从源码构建。

使用方法

基本命令

# 启动交互式 TUI(默认)

tokscale

# 启动特定标签页的 TUI

tokscale models # 模型标签页

tokscale monthly # 每日视图(显示每日明细)

# 使用旧版 CLI 表格输出

tokscale --light

tokscale models --light

# 显式启动 TUI

tokscale tui

# 导出贡献图数据为 JSON

tokscale graph --output data.json

# 输出数据为 JSON(用于脚本或自动化)

tokscale --json # 默认模型视图的 JSON 格式

tokscale models --json # 模型明细的 JSON 格式

tokscale monthly --json # 月度明细的 JSON 格式

tokscale models --json > report.json # 保存到文件

TUI 功能

交互式 TUI 模式提供以下功能:

- 4 个视图:概览(图表 + 排行前几的模型)、模型、每日、统计(贡献图)。

- 键盘导航:

1-4或←/→/Tab:切换视图。↑/↓:浏览列表。c/d/t:按成本/日期/token 数量排序。s:打开源选择对话框。g:打开分组选择对话框(按模型、客户端+模型、客户端+提供商+模型)。p:循环切换 9 种配色主题。r:刷新数据。e:导出为 JSON。q:退出。

- 鼠标支持:点击标签页、按钮和筛选器。

- 主题:绿色、万圣节、青蓝色、蓝色、粉色、紫色、橙色、单色、YlGnBu。

- 设置持久化:偏好设置会保存到

~/.config/tokscale/settings.json文件中(参见 配置)。

分组策略

在 TUI 中按 g 键,或在 --light/--json 模式下使用 --group-by 选项,可以控制模型行的聚合方式:

| 策略 | 标志 | TUI 默认值 | 效果 |

|---|---|---|---|

| 模型 | --group-by model |

✅ | 每个模型一行 — 合并所有客户端和提供商 |

| 客户端 + 模型 | --group-by client,model |

每个客户端-模型组合一行 | |

| 客户端 + 提供商 + 模型 | --group-by client,provider,model |

最细粒度 — 不进行合并 |

--group-by model(最整合)

| 客户端 | 提供商 | 模型 | 费用 |

|---|---|---|---|

| OpenCode、Claude、Amp | github-copilot、anthropic | claude-opus-4-5 | $2,424 |

| OpenCode、Claude | anthropic、github-copilot | claude-sonnet-4-5 | $1,332 |

--group-by client,model(CLI 默认)

| 客户端 | 提供商 | 模型 | 费用 |

|---|---|---|---|

| OpenCode | github-copilot、anthropic | claude-opus-4-5 | $1,368 |

| Claude | anthropic | claude-opus-4-5 | $970 |

--group-by client,provider,model(最细粒度)

| 客户端 | 提供商 | 模型 | 费用 |

|---|---|---|---|

| OpenCode | github-copilot | claude-opus-4-5 | $1,200 |

| OpenCode | anthropic | claude-opus-4-5 | $168 |

| Claude | anthropic | claude-opus-4-5 | $970 |

按平台筛选

# 仅显示 OpenCode 的使用情况

tokscale --opencode

# 仅显示 Claude Code 的使用情况

tokscale --claude

# 仅显示 Codex CLI 的使用情况

tokscale --codex

# 仅显示 Gemini CLI 的使用情况

tokscale --gemini

# 仅显示 Cursor IDE 的使用情况(需先执行 `tokscale cursor login`)

tokscale --cursor

# 仅显示 Amp 的使用情况

tokscale --amp

# 仅显示 Droid 的使用情况

tokscale --droid

# 仅显示 OpenClaw 的使用情况

tokscale --openclaw

# 仅显示 Pi 的使用情况

tokscale --pi

# 仅显示 Kimi CLI 的使用情况

tokscale --kimi

# 仅显示 Qwen CLI 的使用情况

tokscale --qwen

# 仅显示 Roo Code 的使用情况

tokscale --roocode

# 仅显示 Kilo 的使用情况

tokscale --kilocode

# 仅显示 Mux 的使用情况

tokscale --mux

# 仅显示 Kilo CLI 的使用情况

tokscale --kilo

# 仅显示 Crush 的使用情况

tokscale --crush

# 仅显示 Synthetic (synthetic.new) 的使用情况

tokscale --synthetic

# 组合筛选条件

tokscale --opencode --claude

日期筛选

日期筛选适用于所有生成报告的命令(tokscale、tokscale models、tokscale monthly、tokscale graph):

# 快速日期快捷键

tokscale --today # 仅今天

tokscale --week # 近 7 天

tokscale --month # 当前日历月

# 自定义日期范围(包含起始与结束日期,本地时区)

tokscale --since 2024-01-01 --until 2024-12-31

# 按年份筛选

tokscale --year 2024

# 结合其他选项

tokscale models --week --claude --json

tokscale monthly --month --benchmark

注意:日期筛选使用您的本地时区。

--since和--until均为包含性范围。

定价查询

查询任意模型的实时定价:

# 查询模型定价

tokscale pricing "claude-3-5-sonnet-20241022"

tokscale pricing "gpt-4o"

tokscale pricing "grok-code"

# 强制指定提供商来源

tokscale pricing "grok-code" --provider openrouter

tokscale pricing "claude-3-5-sonnet" --provider litellm

查询策略:

定价查询采用多步骤解析策略:

- 精确匹配 - 直接在 LiteLLM/OpenRouter 数据库中查找

- 别名解析 - 解析友好名称(如

big-pickle→glm-4.7) - 去除等级后缀 - 移除质量等级(

gpt-5.2-xhigh→gpt-5.2) - 版本标准化 - 处理版本格式(

claude-3-5-sonnet↔claude-3.5-sonnet) - 匹配提供商前缀 - 尝试常见前缀(

anthropic/、openai/等) - Cursor 模型定价 - 对尚未收录于 LiteLLM/OpenRouter 的模型硬编码定价(如

gpt-5.3-codex) - 模糊匹配 - 基于词边界对部分模型名称进行匹配

提供商优先级:

当存在多个匹配项时,原始模型开发者优先于转售商:

| 优先(原始) | 降级(转售商) |

|---|---|

xai/(Grok) |

azure_ai/ |

anthropic/(Claude) |

bedrock/ |

openai/(GPT) |

vertex_ai/ |

google/(Gemini) |

together_ai/ |

meta-llama/ |

fireworks_ai/ |

例如:grok-code 匹配 xai/grok-code-fast-1($0.20/$1.50),而非 azure_ai/grok-code-fast-1($3.50/$17.50)。

社交功能

# 登录 Tokscale(打开浏览器进行 GitHub 认证)

tokscale login

# 查看当前登录用户

tokscale whoami

# 提交使用数据至排行榜

tokscale submit

# 带筛选条件提交

tokscale submit --opencode --claude --since 2024-01-01

# 预览将要提交的内容(试运行)

tokscale submit --dry-run

# 注销

tokscale logout

Cursor IDE 命令

Cursor IDE 需要通过会话令牌单独认证(与社交平台登录不同):

# 登录 Cursor(需要从浏览器获取会话令牌)

# --name 是可选的;它只是帮助您稍后识别账户

tokscale cursor login --name work

# 检查 Cursor 认证状态及会话有效期

tokscale cursor status

# 列出已保存的 Cursor 账户

tokscale cursor accounts

# 切换活动账户(控制哪个账户同步到 cursor-cache/usage.csv)

tokscale cursor switch work

# 从特定账户注销(保留历史记录;不计入汇总)

tokscale cursor logout --name work

# 注销并删除该账户的缓存使用数据

tokscale cursor logout --name work --purge-cache

# 从所有 Cursor 账户注销(保留历史记录;不计入汇总)

tokscale cursor logout --all

# 退出所有账户并删除缓存的使用数据

tokscale cursor logout --all --purge-cache

默认情况下,tokscale 会聚合所有已保存的 Cursor 账户的使用情况(即所有的 cursor-cache/usage*.csv 文件)。

当你注销时,tokscale 会将你的缓存使用历史移动到 cursor-cache/archive/ 目录下,这样它就不会被聚合。如果你希望直接删除这些缓存的使用数据,可以使用 --purge-cache 参数。

凭据存储:Cursor 账户信息存储在 ~/.config/tokscale/cursor-credentials.json 中。使用数据则缓存在 ~/.config/tokscale/cursor-cache/ 目录下(当前活跃账户的数据存储在 usage.csv 中,其他账户的数据则分别存储在 usage.<account>.csv 文件中)。

获取 Cursor 会话令牌的方法:

- 在浏览器中打开 https://www.cursor.com/settings

- 打开开发者工具(按 F12 键)

- 选项 A - Network 标签页:在页面上执行任意操作,找到一个指向

cursor.com/api/*的请求,在请求头中查找Cookie字段,复制WorkosCursorSessionToken=后面的值。 - 选项 B - Application 标签页:进入 Application → Cookies →

https://www.cursor.com,找到名为WorkosCursorSessionToken的 Cookie,复制其值(不是 Cookie 名称)。

⚠️ 安全提示:请将你的会话令牌视为密码一样对待。切勿公开分享或将其提交到版本控制系统中。该令牌可让你完全访问你的 Cursor 账户。

示例输出(--light 版本)

配置

Tokscale 将设置存储在 ~/.config/tokscale/settings.json 文件中:

{

"colorPalette": "blue",

"includeUnusedModels": false

}

| 设置 | 类型 | 默认值 | 描述 |

|---|---|---|---|

colorPalette |

字符串 | "blue" |

TUI 颜色主题(green、halloween、teal、blue、pink、purple、orange、monochrome、ylgnbu) |

includeUnusedModels |

布尔值 | false |

在报告中显示零用量的模型 |

autoRefreshEnabled |

布尔值 | false |

在 TUI 中启用自动刷新 |

autoRefreshMs |

数字 | 60000 |

自动刷新间隔(30000-3600000 毫秒) |

nativeTimeoutMs |

数字 | 300000 |

原生子进程处理的最大时间(5000-3600000 毫秒) |

环境变量

环境变量会覆盖配置文件中的值。适用于 CI/CD 或一次性使用场景:

| 变量 | 默认值 | 描述 |

|---|---|---|

TOKSCALE_NATIVE_TIMEOUT_MS |

300000(5 分钟) |

覆盖 nativeTimeoutMs 配置 |

# 示例:为超大数据集增加超时时间

TOKSCALE_NATIVE_TIMEOUT_MS=600000 tokscale graph --output data.json

注意:若需持久化更改,建议在

~/.config/tokscale/settings.json中设置nativeTimeoutMs。环境变量更适合用于一次性覆盖或 CI/CD 场景。

无头模式

Tokscale 可以从 Codex CLI 的无头输出 中聚合 Token 使用情况,适用于自动化、CI/CD 流水线和批量处理。

什么是无头模式?

当你使用 JSON 输出标志运行 Codex CLI(例如 codex exec --json)时,它会将使用数据输出到标准输出,而不是存储在其常规会话目录中。无头模式允许你捕获并跟踪这些使用数据。

存储位置:~/.config/tokscale/headless/

在 macOS 上,如果未设置 TOKSCALE_HEADLESS_DIR,Tokscale 还会扫描 ~/Library/Application Support/tokscale/headless/ 目录。

Tokscale 会自动扫描以下目录结构:

~/.config/tokscale/headless/

└── codex/ # Codex CLI 的 JSONL 输出

环境变量:设置 TOKSCALE_HEADLESS_DIR 可自定义无头日志目录:

export TOKSCALE_HEADLESS_DIR="$HOME/my-custom-logs"

推荐(自动捕获):

| 工具 | 命令示例 |

|---|---|

| Codex CLI | tokscale headless codex exec -m gpt-5 "implement feature" |

手动重定向(可选):

| 工具 | 命令示例 |

|---|---|

| Codex CLI | codex exec --json "implement feature" > ~/.config/tokscale/headless/codex/ci-run.jsonl |

诊断信息:

# 显示扫描位置和无头计数

tokscale sources

tokscale sources --json

CI/CD 集成示例:

# 在你的 GitHub Actions 工作流中

- name: 运行 AI 自动化

run: |

mkdir -p ~/.config/tokscale/headless/codex

codex exec --json "review code changes" \

> ~/.config/tokscale/headless/codex/pr-${{ github.event.pull_request.number }}.jsonl

# 稍后,跟踪使用情况

- name: 报告 Token 使用情况

run: tokscale --json

注意:无头捕获仅支持 Codex CLI。如果你直接运行 Codex,请按照上述方法将标准输出重定向到无头目录。

前端可视化

前端提供了一种类似 GitHub 的贡献图可视化:

功能

- 2D 视图:经典的 GitHub 贡献日历

- 3D 视图:基于 Token 使用量的高度等距 3D 贡献图

- 多种配色方案:GitHub、GitLab、万圣节、冬季等

- 三重主题切换:浅色 / 深色 / 系统(跟随操作系统偏好)

- GitHub Primer 设计:采用 GitHub 官方颜色体系

- 交互式提示框:悬停可查看每日详细分解

- 每日分解面板:点击可查看各来源及各模型的详细信息

- 年份筛选:可在不同年份之间导航

- 来源筛选:可按平台筛选(OpenCode、Claude、Codex、Cursor、Gemini、Amp、Droid、OpenClaw、Pi、Kimi、Qwen、Roo Code、Kilo、Mux、Kilo CLI、Crush、Synthetic)

- 统计面板:总成本、Token 数量、活跃天数、连续天数

- FOUC 防止:在 React 水合之前应用主题(无闪烁现象)

运行前端

cd packages/frontend

bun install

bun run dev

打开 http://localhost:3000 即可访问社交平台。

社交平台

Tokscale 包含一个社交平台,你可以在其中分享自己的使用数据,并与其他开发者竞争。

功能

- 排行榜:查看跨平台使用最多 Token 的用户

- 用户个人资料:带有贡献图和统计数据的公开个人资料

- 周期筛选:可查看全部时间、本月或本周的统计数据

- GitHub 集成:使用 GitHub 账户登录

- 本地查看器:无需提交即可私下查看自己的数据

GitHub 个人资料嵌入小部件

你可以将你的公开 Tokscale 统计数据直接嵌入到你的 GitHub 个人主页 README 中:

[](https://tokscale.ai/u/<username>)

- 将

<username>替换为你的 GitHub 用户名 - 可选查询参数:

theme=light用于浅色主题sort=tokens(默认)或sort=cost用于控制排名依据compact=1用于使用紧凑布局 + 紧凑数字表示法(例如1.2M,$3.4K)

- 示例:

https://tokscale.ai/api/embed/<username>/svg?theme=light&sort=cost&compact=1

GitHub 个人资料徽章

你也可以使用 shields.io 风格的徽章来实现更紧凑的展示:

- 将

<username>替换为你的 GitHub 用户名 - 可选查询参数:

metric=tokens(默认)、metric=cost或metric=rankstyle=flat(默认)或style=flat-squaresort=tokens(默认)或sort=cost来控制排名依据compact=1使用紧凑数字表示法(例如1.2M、$3.4K)label=<text>覆盖左侧标签color=<hex>覆盖右侧颜色(例如color=ff5733)

- 示例:

https://tokscale.ai/api/badge/<username>/svg?metric=cost&compact=1https://tokscale.ai/api/badge/<username>/svg?metric=rank&sort=cost&style=flat-square

开始使用

- 登录 - 运行

tokscale login通过 GitHub 进行身份验证 - 提交 - 运行

tokscale submit上传你的使用数据 - 查看 - 访问网页平台查看你的个人资料和排行榜

数据验证

提交的数据会经过一级验证:

- 数学一致性(总计匹配,无负值)

- 无未来日期

- 必填字段齐全

- 重复检测

Wrapped 2025

生成一张精美的年度回顾图片,总结你使用 AI 编码助手的情况——灵感来自 Spotify Wrapped。

bunx tokscale@latest wrapped |

bunx tokscale@latest wrapped --clients |

bunx tokscale@latest wrapped --agents --disable-pinned |

|---|---|---|

|

|

|

命令

# 生成当前年的 Wrapped 图片

tokscale wrapped

# 生成特定年份的 Wrapped 图片

tokscale wrapped --year 2025

包含内容

生成的图片包括:

- 总 Token 数量 - 你全年的 Token 消耗总量

- 顶级模型 - 按成本排名的你最常用的 3 个 AI 模型

- 顶级客户端 - 你最常用的 3 个平台(OpenCode、Claude Code、Cursor 等)

- 消息数量 - 总共的 AI 交互次数

- 活跃天数 - 至少有一次 AI 交互的日子

- 成本 - 根据 LiteLLM 定价估算的总成本

- 连续活跃天数 - 你最长的连续活跃天数

- 贡献图 - 你全年活动的可视化热力图

生成的 PNG 已经优化,适合在社交媒体上分享。与社区分享你的编码之旅吧!

开发

快速设置:如果你只想快速开始,请参阅上方安装部分中的 开发设置。

先决条件

# Bun(必需)

bun --version

# Rust(用于原生模块)

rustc --version

cargo --version

如何运行

按照 开发设置 后,你可以:

# 构建原生模块(可选但推荐)

bun run build:core

# 在开发模式下运行(启动 TUI)

cd packages/cli && bun src/cli.ts

# 或者使用旧版 CLI 模式

cd packages/cli && bun src/cli.ts --light

高级开发

项目脚本

| 脚本 | 描述 |

|---|---|

bun run cli |

在开发模式下运行 CLI(Bun 的 TUI) |

bun run build:core |

构建原生 Rust 模块(发布版) |

bun run build:cli |

将 CLI TypeScript 编译到 dist/ 目录 |

bun run build |

同时构建核心和 CLI |

bun run dev:frontend |

运行前端开发服务器 |

包内专用脚本(在各包目录下执行):

packages/cli:bun run dev,bun run tuipackages/core:bun run build:debug,bun run test,bun run bench

注意:该项目使用 Bun 作为开发包管理器。

测试

# 测试原生模块(Rust)

cd packages/core

bun run test:rust # Cargo 测试

bun run test # Node.js 集成测试

bun run test:all # 两者都运行

原生模块开发

cd packages/core

# 以调试模式构建(编译更快)

bun run build:debug

# 以发布模式构建(优化版)

bun run build

# 运行 Rust 基准测试

bun run bench

图表命令选项

# 将图表数据导出到文件

tokscale graph --output usage-data.json

# 按日期筛选(所有快捷方式均适用)

tokscale graph --today

tokscale graph --week

tokscale graph --since 2024-01-01 --until 2024-12-31

tokscale graph --year 2024

# 按平台筛选

tokscale graph --opencode --claude

# 显示处理时间基准测试

tokscale graph --output data.json --benchmark

基准标志

显示处理时间以便进行性能分析:

tokscale --benchmark # 显示默认视图的处理时间

tokscale models --benchmark # 模型报告的基准测试

tokscale monthly --benchmark # 月度报告的基准测试

tokscale graph --benchmark # 图表生成的基准测试

为前端生成数据

# 导出数据用于可视化

tokscale graph --output packages/frontend/public/my-data.json

性能

原生 Rust 模块带来了显著的性能提升:

| 操作 | TypeScript | Rust 原生 | 加速比 |

|---|---|---|---|

| 文件发现 | ~500ms | ~50ms | 10x |

| JSON 解析 | ~800ms | ~100ms | 8x |

| 聚合 | ~200ms | ~25ms | 8x |

| 总计 | ~1.5s | ~175ms | ~8.5x |

基于约 1000 个会话文件和 10 万条消息的基准测试

内存优化

原生模块还通过以下方式减少了约 45% 的内存占用:

- 流式 JSON 解析(无需完整文件缓冲)

- 零拷贝字符串处理

- 使用 map-reduce 实现高效的并行聚合

运行基准测试

# 生成合成数据

cd packages/benchmarks && bun run generate

# 运行 Rust 基准测试

cd packages/core && bun run bench

支持的平台

原生模块目标平台

| 平台 | 架构 | 状态 |

|---|---|---|

| macOS | x86_64 | ✅ 支持 |

| macOS | aarch64(Apple Silicon) | ✅ 支持 |

| Linux | x86_64(glibc) | ✅ 支持 |

| Linux | aarch64(glibc) | ✅ 支持 |

| Linux | x86_64(musl) | ✅ 支持 |

| Linux | aarch64(musl) | ✅ 支持 |

| Windows | x86_64 | ✅ 支持 |

| Windows | aarch64 | ✅ 支持 |

Windows 支持

Tokscale 完全支持 Windows。TUI 和 CLI 的使用方式与 macOS/Linux 相同。

Windows 上的安装:

# 安装 Bun(PowerShell)

powershell -c "irm bun.sh/install.ps1 | iex"

# 运行 tokscale

bunx tokscale@latest

Windows 上的数据存储位置

AI 编码工具会将会话数据存储在跨平台的位置。大多数工具在所有平台上都使用相同的相对路径:

| 工具 | Unix 路径 | Windows 路径 | 来源 |

|---|---|---|---|

| OpenCode | ~/.local/share/opencode/ |

%USERPROFILE%\.local\share\opencode\ |

使用 xdg-basedir 实现跨平台一致性 (来源) |

| Claude Code | ~/.claude/ |

%USERPROFILE%\.claude\ |

所有平台使用相同路径 |

| OpenClaw | ~/.openclaw/ (+ 旧版: .clawdbot, .moltbot, .moldbot) |

%USERPROFILE%\.openclaw\ (+ 旧版路径) |

所有平台使用相同路径 |

| Codex CLI | ~/.codex/ |

%USERPROFILE%\.codex\ |

可通过 CODEX_HOME 环境变量配置 (来源) |

| Gemini CLI | ~/.gemini/ |

%USERPROFILE%\.gemini\ |

所有平台使用相同路径 |

| Amp | ~/.local/share/amp/ |

%USERPROFILE%\.local\share\amp\ |

类似 OpenCode,使用 xdg-basedir |

| Cursor | API 同步 | API 同步 | 数据通过 API 获取,缓存至 %USERPROFILE%\.config\tokscale\cursor-cache\ |

| Droid | ~/.factory/ |

%USERPROFILE%\.factory\ |

所有平台使用相同路径 |

| Pi | ~/.pi/ |

%USERPROFILE%\.pi\ |

所有平台使用相同路径 |

| Kimi CLI | ~/.kimi/ |

%USERPROFILE%\.kimi\ |

所有平台使用相同路径 |

| Qwen CLI | ~/.qwen/ |

%USERPROFILE%\.qwen\ |

所有平台使用相同路径 |

| Roo Code | ~/.config/Code/User/globalStorage/rooveterinaryinc.roo-cline/tasks/ |

%USERPROFILE%\.config\Code\User\globalStorage\rooveterinaryinc.roo-cline\tasks\ |

VS Code globalStorage 的任务日志 |

| Kilo | ~/.config/Code/User/globalStorage/kilocode.kilo-code/tasks/ |

%USERPROFILE%\.config\Code\User\globalStorage\kilocode.kilo-code\tasks\ |

VS Code globalStorage 的任务日志 |

| Mux | ~/.mux/sessions/ |

%USERPROFILE%\.mux\sessions\ |

所有平台使用相同路径 |

| Kilo CLI | ~/.local/share/kilo/ |

%USERPROFILE%\.local\share\kilo\ |

类似 OpenCode,使用 xdg-basedir |

| Crush | $XDG_DATA_HOME/crush/ (备用: ~/.local/share/crush/) |

%USERPROFILE%\.local\share\crush\ (或若设置了 %XDG_DATA_HOME%\crush\ 则使用该路径) |

使用 XDG 数据目录,并提供备用路径 |

| Synthetic | 从其他来源重新归因 | 从其他来源重新归因 | 检测 hf: 模型前缀 + synthetic 提供者 |

注意:在 Windows 上,

~会展开为%USERPROFILE%(例如C:\Users\YourName)。这些工具有意使用 Unix 风格的路径(如.local/share),即使在 Windows 上也是如此,以实现跨平台一致性,而不是使用 Windows 原生路径(如%APPDATA%)。

Windows 特定配置

Tokscale 将其配置存储在:

- 配置文件:

%USERPROFILE%\.config\tokscale\settings.json - 缓存:

%USERPROFILE%\.cache\tokscale\ - Cursor 凭证:

%USERPROFILE%\.config\tokscale\cursor-credentials.json

会话数据保留

默认情况下,一些 AI 编码助手会自动删除旧的会话文件。为了保留您的使用历史以便准确跟踪,您可以禁用清理功能或延长清理周期。

| 平台 | 默认设置 | 配置文件 | 禁用设置 | 来源 |

|---|---|---|---|---|

| Claude Code | ⚠️ 30 天 | ~/.claude/settings.json |

"cleanupPeriodDays": 9999999999 |

文档 |

| Gemini CLI | 已禁用 | ~/.gemini/settings.json |

"general.sessionRetention.enabled": false |

文档 |

| Codex CLI | 已禁用 | 无 | 无清理功能 | #6015 |

| OpenCode | 已禁用 | 无 | 无清理功能 | #4980 |

Claude Code

默认:30 天清理周期

在 ~/.claude/settings.json 中添加以下内容:

{

"cleanupPeriodDays": 9999999999

}

设置一个极大的值(例如

9999999999天 ≈ 2700 万年)可以有效禁用清理功能。

Gemini CLI

默认:已禁用清理(会话永久保存)

如果您启用了清理功能并希望将其禁用,请移除或在 ~/.gemini/settings.json 中将 enabled 设置为 false:

{

"general": {

"sessionRetention": {

"enabled": false

}

}

}

或者设置一个极长的保留期限:

{

"general": {

"sessionRetention": {

"enabled": true,

"maxAge": "9999999d"

}

}

}

Codex CLI

默认:无自动清理(会话永久保存)

Codex CLI 没有内置的会话清理功能。~/.codex/sessions/ 中的会话将无限期保留。

注意:目前有一个关于此功能的公开请求:#6015

OpenCode

默认:无自动清理(会话永久保存)

OpenCode 也没有内置的会话清理功能。~/.local/share/opencode/storage/ 中的会话将无限期保留。

注意:请参阅 #4980

数据来源

OpenCode

位置:~/.local/share/opencode/opencode.db(v1.2+)或 storage/message/{sessionId}/*.json(旧版)

OpenCode 1.2+ 将会话存储在 SQLite 数据库中。Tokscale 会优先从 SQLite 读取数据,如果遇到旧版本则回退到旧版 JSON 文件。

每条消息包含:

{

"id": "msg_xxx",

"role": "assistant",

"modelID": "claude-sonnet-4-20250514",

"providerID": "anthropic",

"tokens": {

"input": 1234,

"output": 567,

"reasoning": 0,

"cache": { "read": 890, "write": 123 }

},

"time": { "created": 1699999999999 }

}

Claude Code

位置:~/.claude/projects/{projectPath}/*.jsonl

JSONL 格式,包含助手消息及用量数据:

{"type": "assistant", "message": {"model": "claude-sonnet-4-20250514", "usage": {"input_tokens": 1234, "output_tokens": 567, "cache_read_input_tokens": 890}}, "timestamp": "2024-01-01T00:00:00Z"}

Codex CLI

位置:~/.codex/sessions/*.jsonl

基于事件的格式,包含 token_count 事件:

{"type": "event_msg", "payload": {"type": "token_count", "info": {"last_token_usage": {"input_tokens": 1234, "output_tokens": 567}}}}

``。

### Gemini CLI

位置:`~/.gemini/tmp/{projectHash}/chats/*.json`

会话文件包含消息数组:

```json

{

"sessionId": "xxx",

"messages": [

{"type": "gemini", "model": "gemini-2.5-pro", "tokens": {"input": 1234, "output": 567, "cached": 890, "thoughts": 123}}

]

}

Cursor IDE

位置:~/.config/tokscale/cursor-cache/(通过 Cursor API 同步)

Cursor 数据会使用您的会话令牌从 Cursor API 获取,并本地缓存。运行 tokscale cursor login 进行身份验证。有关设置说明,请参阅 Cursor IDE 命令。

OpenClaw

位置:~/.openclaw/agents/*/sessions/sessions.json(同时扫描旧路径:~/.clawdbot/、~/.moltbot/、~/.moldbot/)

指向 JSONL 会话文件的索引文件:

{

"agent:main:main": {

"sessionId": "uuid",

"sessionFile": "/path/to/session.jsonl"

}

}

包含模型变更事件和助手消息的会话 JSONL 格式:

{"type":"model_change","provider":"openai-codex","modelId":"gpt-5.2"}

{"type":"message","message":{"role":"assistant","usage":{"input":1660,"output":55,"cacheRead":108928,"cost":{"total":0.02}},"timestamp":1769753935279}}

Pi

位置:~/.pi/agent/sessions/<encoded-cwd>/*.jsonl

带有会话头和消息条目的 JSONL 格式:

{"type":"session","id":"pi_ses_001","timestamp":"2026-01-01T00:00:00.000Z","cwd":"/tmp"}

{"type":"message","id":"msg_001","timestamp":"2026-01-01T00:00:01.000Z","message":{"role":"assistant","model":"claude-3-5-sonnet","provider":"anthropic","usage":{"input":100,"output":50,"cacheRead":10,"cacheWrite":5,"totalTokens":165}}}

Kimi CLI

位置:~/.kimi/sessions/{GROUP_ID}/{SESSION_UUID}/wire.jsonl

带有 StatusUpdate 消息的 wire.jsonl 格式:

{"type": "metadata", "protocol_version": "1.3"}

{"timestamp": 1770983426.420942, "message": {"type": "StatusUpdate", "payload": {"token_usage": {"input_other": 1562, "output": 2463, "input_cache_read": 0, "input_cache_creation": 0}, "message_id": "chatcmpl-xxx"}}}

Qwen CLI

位置:~/.qwen/projects/{PROJECT_PATH}/chats/{CHAT_ID}.jsonl

格式:JSONL — 每行一个 JSON 对象,每个对象包含 type、model、timestamp、sessionId 和 usageMetadata 字段。

令牌字段(来自 usageMetadata):

promptTokenCount→ 输入令牌candidatesTokenCount→ 输出令牌thoughtsTokenCount→ 推理/思考令牌cachedContentTokenCount→ 缓存输入令牌

Roo Code

位置:

- 本地:

~/.config/Code/User/globalStorage/rooveterinaryinc.roo-cline/tasks/{TASK_ID}/ui_messages.json - 服务器(尽力而为):

~/.vscode-server/data/User/globalStorage/rooveterinaryinc.roo-cline/tasks/{TASK_ID}/ui_messages.json

每个任务目录还可能包含 api_conversation_history.json 文件,其中包含用于模型/代理元数据的 <environment_details> 块。

ui_messages.json 是一个 UI 事件数组。Tokscale 只统计:

type == "say"say == "api_req_started"

text 字段是包含令牌/成本元数据的 JSON:

{

"type": "say",

"say": "api_req_started",

"ts": "2026-02-18T12:00:00Z",

"text": "{\"cost\":0.12,\"tokensIn\":100,\"tokensOut\":50,\"cacheReads\":20,\"cacheWrites\":5,\"apiProtocol\":\"anthropic\"}"

}

Kilo

位置:

- 本地:

~/.config/Code/User/globalStorage/kilocode.kilo-code/tasks/{TASK_ID}/ui_messages.json - 服务器(尽力而为):

~/.vscode-server/data/User/globalStorage/kilocode.kilo-code/tasks/{TASK_ID}/ui_messages.json

Kilo 使用与 Roo Code 相同的任务日志结构。Tokscale 应用相同的规则:

- 只统计

ui_messages.json中的say/api_req_started事件 - 从

textJSON 中解析tokensIn、tokensOut、cacheReads、cacheWrites、cost和apiProtocol - 在可用时,从同级的

api_conversation_history.json中丰富模型/代理元数据

Mux

位置:

~/.mux/sessions/{WORKSPACE_ID}/session-usage.json

Mux 将每会话的累计令牌用量存储在 session-usage.json 文件中。每个文件包含一个 byModel 映射,其中按模型细分了以下用量:

input、cached(缓存读取)、cacheCreate(缓存写入)、output、reasoning- 模型名称采用

provider:model格式(例如anthropic:claude-opus-4-6),Tokscale 会去除提供商前缀以识别模型 - 子代理的用量会由 Mux 自动汇总到父会话中,因此不会出现重复计算

Kilo CLI

位置:~/.local/share/kilo/kilo.db

Kilo CLI 将会话数据存储在一个类似于 OpenCode 的 SQLite 数据库中。每条消息记录都包含按消息细分的令牌用量(输入、输出、缓存读写、推理),并注明模型和提供商。

Crush

位置:通过 $XDG_DATA_HOME/crush/projects.json 发现的项目级 SQLite 数据库(备用:~/.local/share/crush/projects.json)

Crush 将用量存储在每个项目的 SQLite 数据库(crush.db)中。Tokscale 只从根会话中导入会话级别的总成本,因为 Crush 不提供可靠的每条消息或每模型的令牌核算。记录显示为 model=session-total,且无令牌细分。

Synthetic (synthetic.new)

Synthetic 的用量是通过对现有代理会话文件进行后处理检测到的。当消息使用 hf: 模型 ID 或合成提供商(synthetic、glhf、octofriend)时,这些消息会被重新归因于 synthetic。

Tokscale 还会检查位于 ~/.local/share/octofriend/sqlite.db 的 Octofriend SQLite 数据库,并在可用时解析带有令牌信息的记录。

定价

Tokscale 会从 LiteLLM 的定价数据库 获取实时定价。

动态回退:对于 LiteLLM 中尚未收录的模型(例如最近发布的模型),Tokscale 会自动从 OpenRouter 的 endpoints API 获取定价。这确保您可以从模型的原始提供商处获得准确的定价(例如 Z.AI 对 glm-4.7 的定价),而无需等待 LiteLLM 更新。

Cursor 模型定价:对于尚未出现在 LiteLLM 或 OpenRouter 中的非常新发布的模型(例如 gpt-5.3-codex),Tokscale 会包含硬编码的定价,该定价来源于 Cursor 的模型文档。这些覆盖会在所有上游来源之后、模糊匹配之前被检查,因此一旦实际的上游定价可用,它们就会自动生效。

缓存:定价数据会以 1 小时 TTL 的形式缓存在磁盘上,以便快速启动:

- LiteLLM 缓存:

~/.cache/tokscale/pricing-litellm.json - OpenRouter 缓存:

~/.cache/tokscale/pricing-openrouter.json(缓存来自受支持提供商的模型的原始定价)

定价包括:

- 输入令牌

- 输出令牌

- 缓存读取令牌(折扣价)

- 缓存写入令牌

- 推理令牌(适用于 o1 等模型)

- 分级定价(超过 20 万令牌)

贡献

欢迎贡献!请按照以下步骤操作:

- 克隆仓库并创建分支

- 创建功能分支 (

git checkout -b feature/amazing-feature) - 进行更改

- 运行测试 (

cd packages/core && bun run test:all) - 提交更改 (

git commit -m '添加惊人功能') - 推送到分支 (

git push origin feature/amazing-feature) - 打开拉取请求

开发指南

- 遵循现有代码风格

- 为新功能添加测试

- 根据需要更新文档

- 保持提交内容专注且原子化

致谢

- 感谢 ccusage、viberank 和 Isometric Contributions 提供的灵感

- 感谢 Ratatui 提供的终端 UI 框架

- 感谢 Solid.js 提供的响应式渲染能力

- 感谢 LiteLLM 提供的定价数据

- 感谢 napi-rs 提供的 Rust/Node.js 绑定

- 感谢 github-contributions-canvas 提供的 2D 图表参考

许可证

MIT © Junho Yeo

如果你觉得这个项目很有趣,请考虑给它点个赞 ⭐,或者 在 GitHub 上关注我,一起加入这场旅程吧(目前已有 1,100 多位小伙伴同行)。我几乎全天候都在编程,并且定期发布令人惊叹的作品——你的支持绝不会白费。

版本历史

v2.0.172026/04/01v2.0.162026/03/31v2.0.152026/03/29v2.0.142026/03/25v2.0.132026/03/17v2.0.122026/03/15v2.0.112026/03/13v2.0.102026/03/11v2.0.92026/03/07v2.0.82026/03/06v2.0.72026/03/05v2.0.62026/03/05v2.0.52026/03/04v2.0.42026/03/02v2.0.32026/03/02v2.0.22026/02/26v2.0.12026/02/26v2.0.02026/02/26v1.4.32026/02/18v1.4.22026/02/18常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。