animeGAN

animeGAN 是一个基于 PyTorch 构建的轻量级开源项目,专注于利用生成对抗网络(GAN)自动绘制动漫风格的人脸图像。它主要解决了传统人工绘制动漫角色耗时费力的问题,通过算法从大量数据中学习特征,能够批量生成形态各异的虚拟角色面孔,并支持通过调整潜在代码实现图像间的平滑过渡与插值。

该项目非常适合对深度学习感兴趣的开发者、AI 研究人员以及希望探索生成式艺术的设计师使用。对于初学者而言,animeGAN 也是一个极佳的学习范例,作者详细记录了训练过程中的心得与技巧,如生成器与判别器的层级平衡、噪声输入的选择等实战经验。其技术亮点在于构建了一个包含约 14.3 万张高质量动漫人脸的数据集,并提供了从网络爬虫抓取到人脸检测裁剪的完整数据处理流程。此外,项目不仅开源了训练代码,还直接提供了预训练模型,用户只需简单命令即可复现结果或在 Jupyter Notebook 中互动体验,是入门 GAN 技术与动漫图像生成的有趣工具。

使用场景

某独立游戏开发者正在为一款视觉小说项目快速生成大量风格统一的二次元角色头像,以填充 NPC 阵容。

没有 animeGAN 时

- 美术成本高昂:手绘上百张不同表情和特征的角色脸需要数周时间,严重挤占核心玩法开发周期。

- 风格难以统一:若外包给多位画师或混合使用网络素材,导致角色画风割裂,破坏游戏整体沉浸感。

- 素材清洗繁琐:从 Danbooru 等网站爬取的原始图片包含大量背景、全身像或非人脸噪点,人工裁剪筛选效率极低。

- 创意迭代受限:想要尝试“潜在空间插值”来观察角色面部特征的平滑过渡效果,在传统工作流中几乎无法实现。

使用 animeGAN 后

- 批量自动生成:利用预训练的 DCGAN 模型,基于 14.3 万张数据集训练后,可一键生成数百张高质量随机动漫人脸,瞬间补齐 NPC 库。

- 风格高度一致:所有生成图像均源自同一模型分布,确保了从主角到路人角色的画风完美统一,无需后期调色修正。

- 自动化数据预处理:结合

python-animeface检测器,自动完成从原图下载、人脸定位到精准裁剪的全流程,彻底告别手动修图。 - 探索无限变体:通过操纵潜在代码(latent codes)进行图像插值,轻松创造出介于两个角色之间的新面孔,为角色设计提供无穷灵感。

animeGAN 将原本耗时数周的美术资产制作过程压缩至小时级,让小型团队也能以低成本拥有丰富且风格统一的二次元角色资源。

运行环境要求

- 未说明

未说明(基于 PyTorch DCGAN 实现,通常建议使用支持 CUDA 的 NVIDIA GPU 以加速训练,但 README 未明确指定型号或显存要求)

未说明

快速开始

AnimeGAN

一个简单的基于 PyTorch 的生成对抗网络实现,专注于动漫人脸绘制。

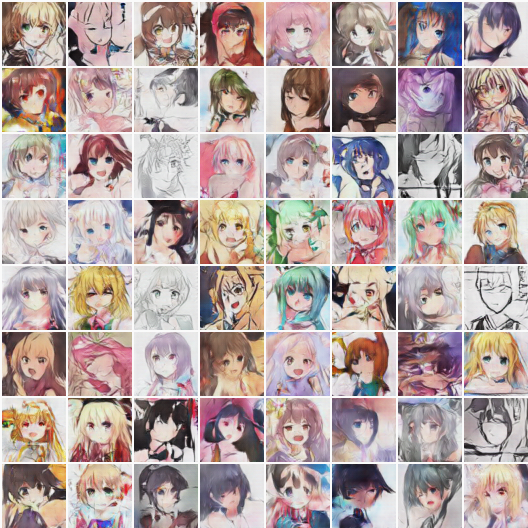

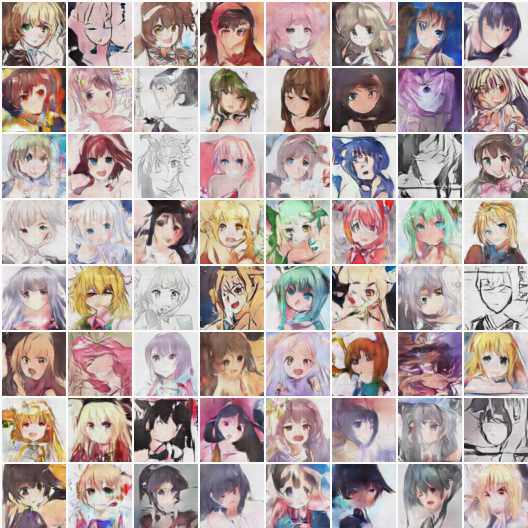

随机生成的图像

这些图像是由一个在 143,000 张动漫角色人脸数据上训练了 100 个 epoch 的 DCGAN 模型生成的。

图像插值

通过操纵潜在代码,可以实现从第一行到最后一行图像的过渡。

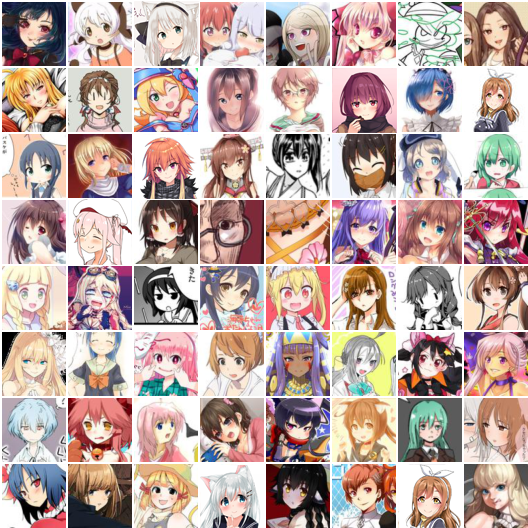

原始图像

这些图像并不干净,可以看到一些异常值,这会降低生成图像的质量。

使用方法

要运行实验,

$ python main.py --dataRoot path_to_dataset/

此仓库中也包含了 DCGAN 的预训练模型,可以在 Jupyter Notebook 中进行体验。

anime-faces 数据集

我们使用爬虫工具 gallery-dl 从 danbooru.donmai.us 收集了 126 个标签下的动漫风格图像。随后,这些图像通过动漫人脸检测器 python-animeface 进行处理。最终得到的数据集包含约 143,000 张动漫人脸。需要注意的是,某些标签在裁剪后可能已失去意义,例如,“uniform”标签下的裁剪人脸图像可能不再包含可见的制服部分。

如何从头构建该数据集?

先决条件:gallery-dl、python-animeface

下载动漫风格图像

# 下载“misaka_mikoto”标签下的 1000 张图像 gallery-dl --images 1000 "https://danbooru.donmai.us/posts?tags=misaka_mikoto" # 多进程方式下载 cat tags.txt | \ xargs -n 1 -P 12 -I 'tag' \ bash -c ' gallery-dl --images 1000 "https://danbooru.donmai.us/posts?tags=$tag" '从下载的图像中提取人脸

import animeface from PIL import Image im = Image.open('images/anime_image_misaka_mikoto.png') faces = animeface.detect(im) x,y,w,h = faces[0].face.pos im = im.crop((x,y,x+w,y+h)) im.show() # 显示

我已对原始数据集进行了清理,新版本的数据集包含 126 个标签下的 115,085 张图像。你可以从以下地址获取这些图像:

- GitHub: https://github.com/jayleicn/animeGAN/releases/tag/data

- 百度网盘: https://pan.baidu.com/s/1o8Nxllo

请仅用于非商业用途。

我学到的东西

- GAN 确实很难训练。

- DCGAN 通常效果不错,但简单地添加全连接层就会导致问题。

- 在我的实验中,生成器 G 的层数越多,生成的图像质量越好,也就是说,G 应该比判别器 D 更强大。

- 向判别器 D 的输入和标签中加入噪声有助于稳定训练过程。

- 使用不同的输入和生成分辨率(64x64 vs 96x96),在训练过程中似乎没有明显差异,生成的图像也非常相似。

- 将二值噪声作为生成器 G 的输入效果惊人,但生成的图像不如使用高斯噪声时的效果好。这一想法归功于 @cwhy:这里的“二值噪声”是指由伯努利分布 p=0.5 生成的 {-1,1} 序列。

以上内容并未经过仔细验证,如果你正在寻找通用的 GAN 技巧,可以参考 @soumith 的 ganhacks。

其他说明

- 本项目深受 chainer-DCGAN 和 IllustrationGAN 的启发,代码主要借鉴自 PyTorch DCGAN 示例,感谢作者们提供的清晰代码。

- 依赖库:pytorch、torchvision

- 这个项目对我来说只是一个学习 PyTorch 和 GAN 的玩具项目,最重要的是为了好玩!:) 欢迎任何反馈。

@jayleicn

版本历史

data2022/08/24常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。