voicebox

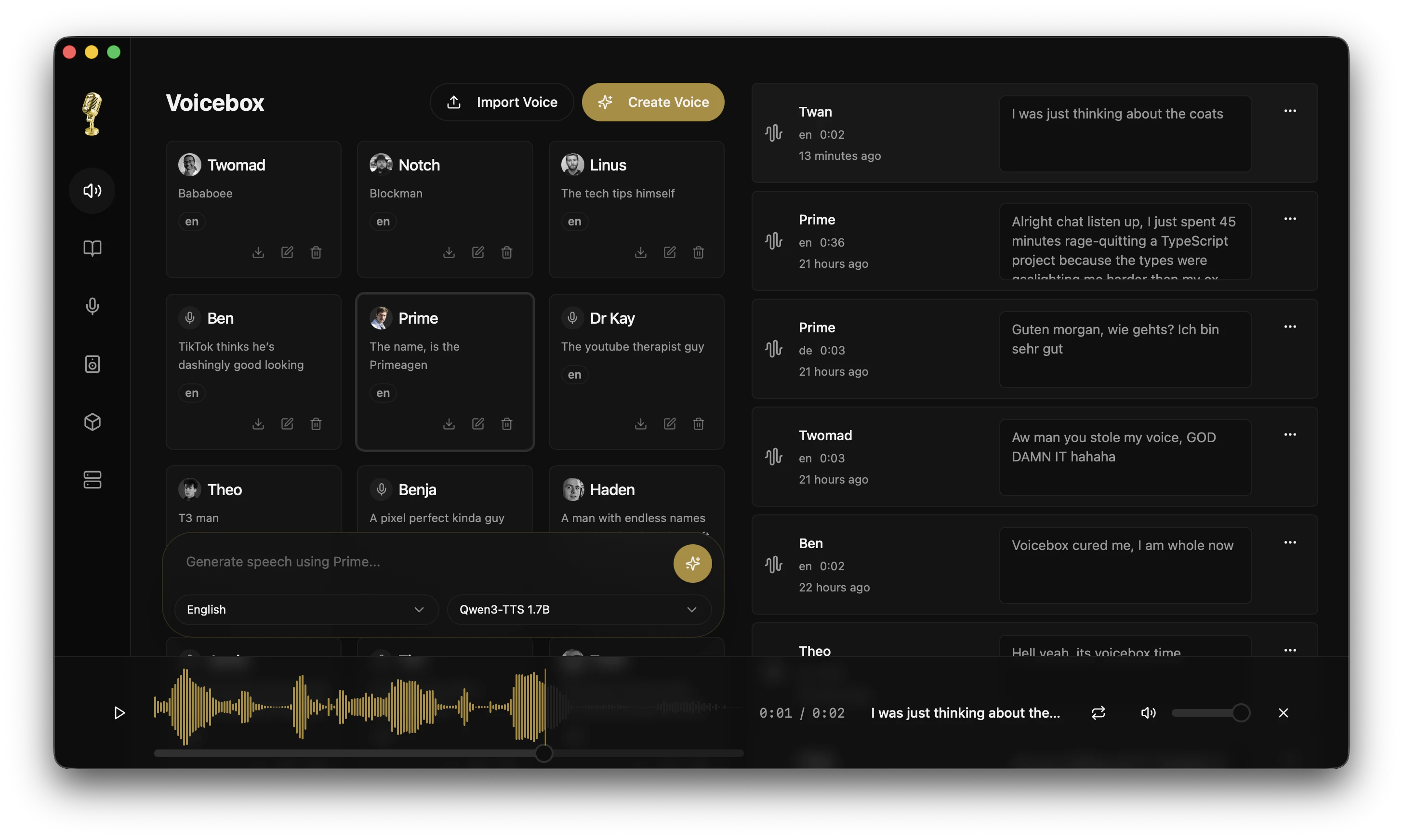

Voicebox 是一款本地优先的开源语音合成工作室,旨在让用户完全掌控自己的声音数据。它支持从几秒音频中克隆声音,并在本地生成高质量的多语言语音,同时提供丰富的后期处理效果。

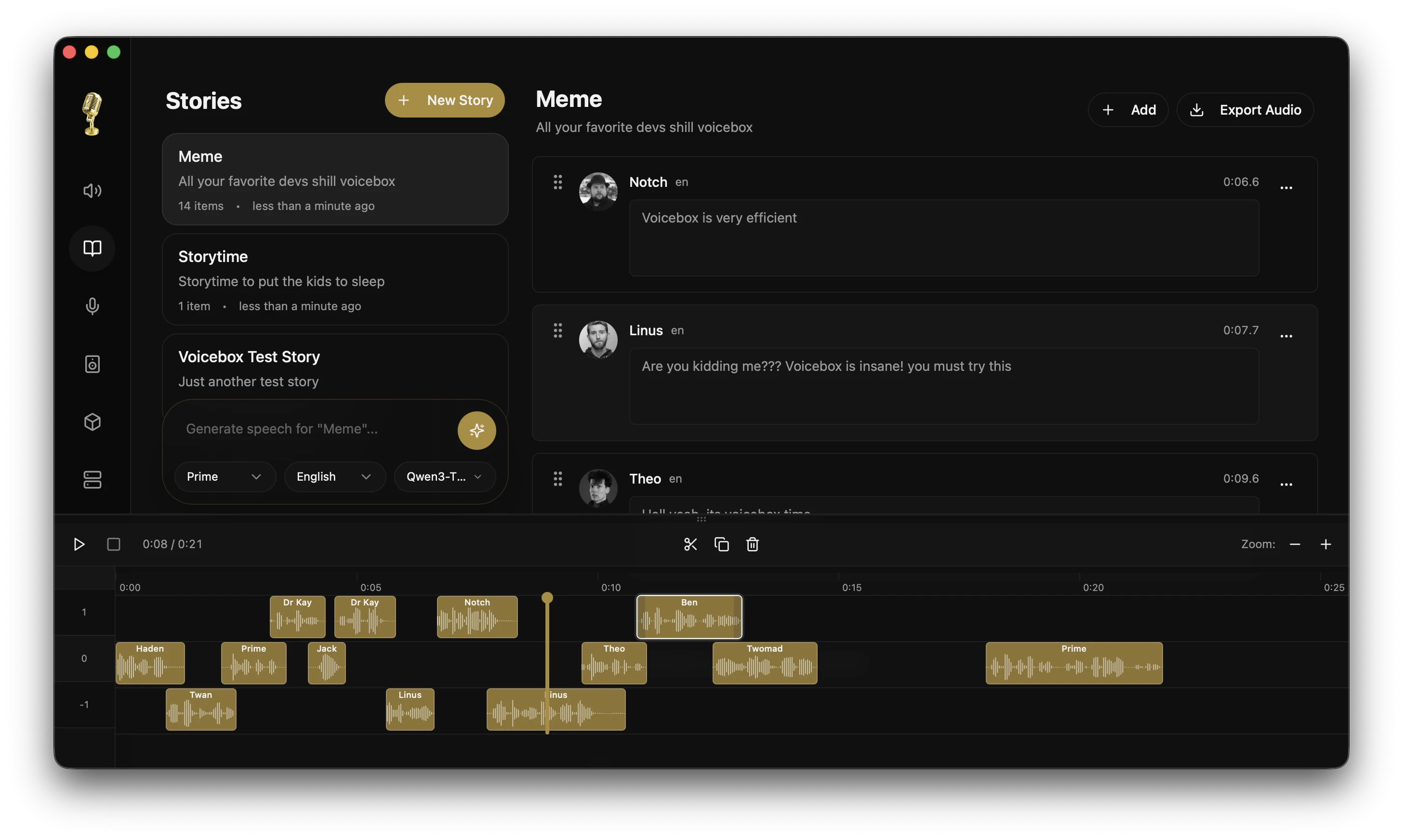

针对云端语音服务存在的隐私泄露风险和持续付费成本,Voicebox 提供了完美的替代方案。它内置了包括 Qwen3-TTS 在内的五种语音引擎,覆盖英语、日语等 23 种语言。其独特的故事编辑器允许用户通过时间轴编排多轨道对话,非常适合制作有声书、播客或游戏配音。对于开发者而言,它还开放了 REST API,便于将语音合成功能集成到自己的应用中。

技术上,Voicebox 基于 Rust 构建,采用 Tauri 框架实现原生性能,兼容 macOS、Windows、Linux 及 Docker 环境。无论是追求隐私安全的普通用户,还是需要定制化工具的开发者,Voicebox 都能提供灵活、免费且高效的本地化语音解决方案,让创意表达不再受限于网络和服务商。

使用场景

独立游戏开发者小李正在制作一款多结局叙事游戏,急需为五个不同性格的角色生成高质量对白,但面临预算和隐私的双重压力。

没有 voicebox 时

- 依赖云端 API 导致剧本和角色声音数据上传,存在核心创意泄露风险。

- 按字符计费模式昂贵,数百句剧情对话的费用远超独立开发者的预算。

- 通用语音缺乏情感变化,无法通过指令实现

[笑]、[叹气]等细腻表现。 - 多角色对话需分别生成再手动剪辑,音轨对齐困难且工作流繁琐耗时。

使用 voicebox 后

- 本地运行模型确保所有语音数据不出本机,彻底保障项目隐私安全无忧。

- 免费开源引擎支持脚本自动分块与无限长度生成,大幅降低制作成本压力。

- 调用 Chatterbox Turbo 引擎添加 paralinguistic 标签,精准控制角色情绪起伏。

- 内置故事编辑器可直接编排多轨道对话,一键渲染出完整的场景音效文件。

voicebox 让个人创作者能在零成本且隐私受保护的前提下,轻松实现电影级的多角色语音合成效果。

运行环境要求

- macOS

- Windows

- Linux

- 非必需,支持 CPU 运行

- 推荐 NVIDIA GPU (CUDA),LuxTTS 引擎需约 1GB 显存

- 支持 AMD ROCm、Apple Metal、Intel Arc、DirectML

未说明

快速开始

![]()

Voicebox

开源语音合成工作室。

克隆声音。生成语音。应用效果。构建语音驱动的应用程序。

所有功能均在您的本地机器上运行。

voicebox.sh • 文档 • 下载 • 功能 • API (应用程序编程接口)

点击图片上方以在 voicebox.sh 上观看演示视频

什么是 Voicebox?

Voicebox 是一个本地优先的语音克隆工作室 —— 它是 ElevenLabs 的免费开源替代品。只需几秒音频即可克隆声音,在 5 个 TTS (Text-to-Speech,文本转语音) 引擎中生成 23 种语言的语音,应用后期处理效果,并使用时间线编辑器编排多语音项目。

- 完全隐私 — 模型和语音数据保留在您的机器上

- 5 个 TTS 引擎 — Qwen3-TTS, LuxTTS, Chatterbox Multilingual, Chatterbox Turbo, 和 HumeAI TADA

- 23 种语言 — 从英语到阿拉伯语、日语、印地语、斯瓦希里语等

- 后期处理效果 — 音高移位、混响、延迟、合唱、压缩和滤波器

- 富有表现力的语音 — 通过 Chatterbox Turbo 使用副语言标签如

[laugh],[sigh],[gasp] - 无限长度 — 自动分块并带有交叉淡入,适用于脚本、文章和章节

- 故事编辑器 — 用于对话、播客和叙事的轨道时间线

- API 优先 — REST API 用于将语音合成集成到您的项目中

- 原生性能 — 基于 Tauri (Rust) 构建,而非 Electron

- 全平台运行 — macOS (MLX/Metal), Windows (CUDA), Linux, AMD ROCm, Intel Arc, Docker

下载

| 平台 | 下载 |

|---|---|

| macOS (Apple Silicon) | 下载 DMG |

| macOS (Intel) | 下载 DMG |

| Windows | 下载 MSI |

| Docker | docker compose up |

Linux — 预编译的二进制文件尚不可用。请参阅 voicebox.sh/linux-install 获取从源码构建的说明。

功能

多引擎语音克隆

五个具有不同优势的 TTS 引擎,可按次切换:

| 引擎 | 语言数 | 优势 |

|---|---|---|

| Qwen3-TTS (0.6B / 1.7B) | 10 | 高质量多语言克隆,语调指令(“慢慢说”,“耳语”) |

| LuxTTS | 英语 | 轻量级(约 1GB VRAM/显存),48kHz 输出,CPU 上 150 倍实时 (realtime) 速度 |

| Chatterbox Multilingual | 23 | 最广泛的语言覆盖 — 阿拉伯语、丹麦语、芬兰语、希腊语、希伯来语、印地语、马来语、挪威语、波兰语、斯瓦希里语、瑞典语、土耳其语等 |

| Chatterbox Turbo | 英语 | 快速 3.5 亿参数模型,支持副语言情感/声音标签 |

| TADA (1B / 3B) | 10 | HumeAI 语音语言模型 — 700 秒以上连贯音频,文本 - 声学双对齐 |

情感与副语言标签

在文本输入框中输入 / 即可插入模型会随语音合成的表达性标签(Chatterbox Turbo):

[laugh] [chuckle] [gasp] [cough] [sigh] [groan] [sniff] [shush] [clear throat]

后期处理效果

由 Spotify 的 pedalboard 库驱动的 8 种音频效果。生成后应用,实时预览,构建可重用的预设。

| 效果 | 描述 |

|---|---|

| Pitch Shift (音高移位) | 上下最多 12 个半音 |

| Reverb (混响) | 可配置房间大小、阻尼、干湿比混合 |

| Delay (延迟) | 可调节时间、反馈和混合的混响 |

| Chorus / Flanger (合唱 / 镶边) | 调制延迟以产生金属感或丰富质感 |

| Compressor (压缩器) | 动态范围压缩 |

| Gain (增益) | 音量调整(-40 至 +40 dB) |

| High-Pass Filter (高通滤波器) | 去除低频 |

| Low-Pass Filter (低通滤波器) | 去除高频 |

内置 4 种预设(机器人、广播、回声室、深嗓音),支持自定义预设。效果可作为默认值分配给每个配置文件。

无限生成长度

文本会自动在句子边界处分割,每个块独立生成,然后交叉淡入合并。适用于所有引擎。

- 可配置的自动分块限制(100–5,000 字符)

- 交叉淡入滑块(0–200ms)以实现平滑过渡

- 最大文本长度:50,000 字符

- 智能分割尊重缩写、中日韩 (CJK) 标点符号和

[tags]

生成版本

每次生成都支持多个版本,并带有溯源追踪功能:

- 原始 — 纯净的 TTS(文本转语音)输出,始终保留

- 效果版本 — 应用来自任何源版本的不同效果链

- Takes(变体) — 使用新种子重新生成以获得变体

- 来源追踪 — 每个版本都会记录其谱系

- 收藏 — 星标生成内容以便快速访问

异步生成队列

生成过程是非阻塞的。提交后立即可开始输入下一个。

- 串行执行队列可防止 GPU(图形处理器)争用

- 实时 SSE(服务器发送事件)状态流

- 失败的生成可以重试

- 崩溃产生的过时生成在启动时自动恢复

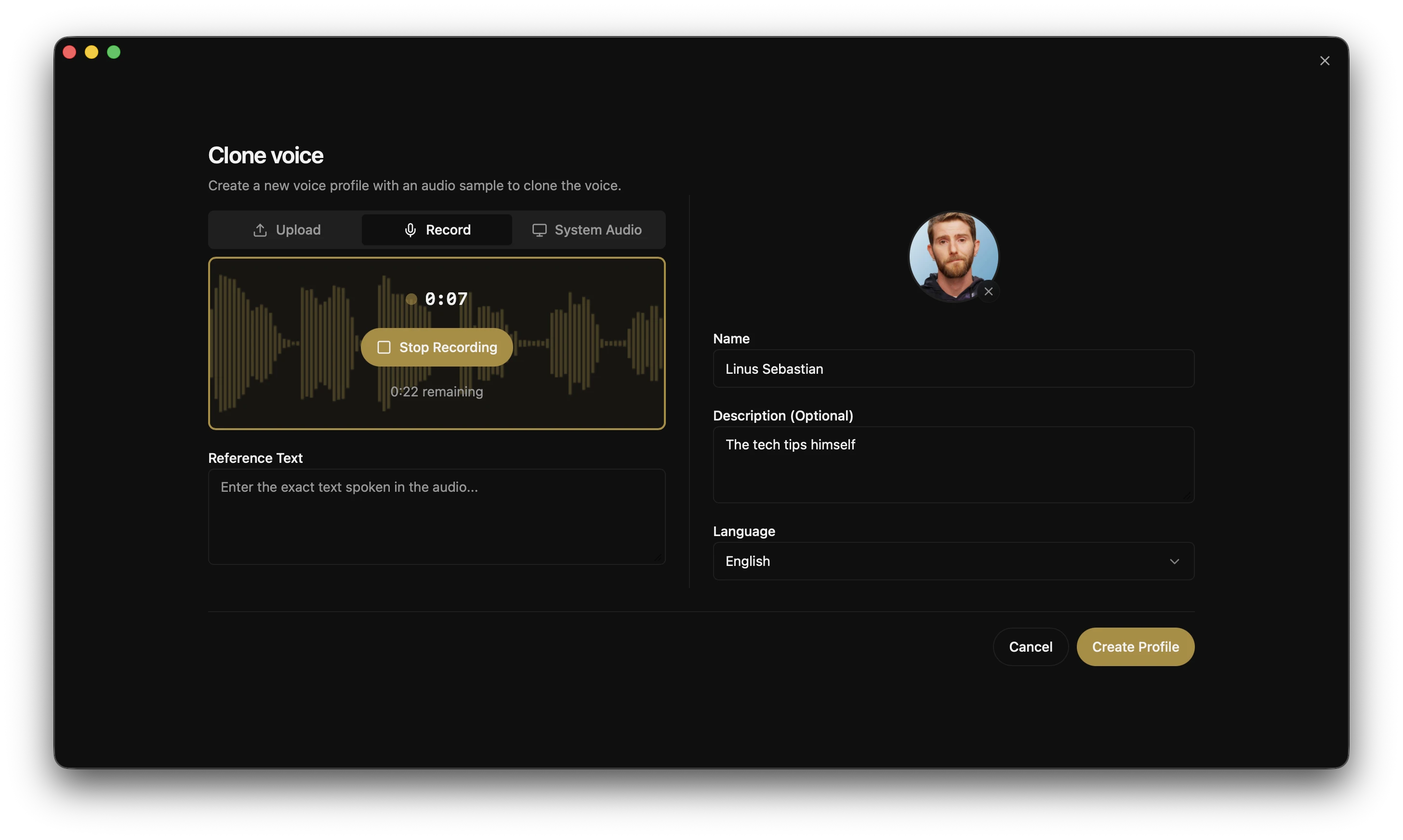

语音配置文件管理

- 从音频文件创建配置文件或在应用内直接录制

- 导入/导出配置文件以共享或备份

- 支持多样本以实现更高质量的克隆

- 每个配置文件的默认效果链

- 通过描述和语言标签进行组织

故事编辑器

用于对话、播客和叙事的多人声时间线编辑器。

- 支持拖放的多轨道编排

- 行内音频裁剪和分割

- 带同步播放头的自动回放

- 每个轨道剪辑的版本固定

录音与转录

- 应用内录制,带波形可视化

- 系统音频捕获(macOS 和 Windows)

- 由 Whisper(语音识别模型)(包括 Whisper Turbo)驱动的自动转录

- 以多种格式导出录音

模型管理

- 按模型卸载以释放 GPU(图形处理器)内存,无需删除下载内容

- 通过

VOICEBOX_MODELS_DIR设置自定义模型目录 - 带进度跟踪的模型文件夹迁移

- 下载取消/清除界面

GPU 支持

| 平台 | 后端 | 备注 |

|---|---|---|

| macOS (Apple 芯片) | MLX(Apple 机器学习框架)(Metal) | 通过神经引擎快 4-5 倍 |

| Windows / Linux (英伟达) | PyTorch(深度学习框架)(CUDA) | 应用内自动下载 CUDA 二进制文件 |

| Linux (超威半导体) | PyTorch(深度学习框架)(ROCm) | 自动配置 HSA_OVERRIDE_GFX_VERSION |

| Windows (任意 GPU) | DirectML | 通用 Windows GPU 支持 |

| Intel Arc | IPEX/XPU | Intel 独立 GPU 加速 |

| 任意 | CPU | 处处可用,只是较慢 |

API

Voicebox 提供完整的 REST API,以便将语音合成功能集成到您自己的应用中。

# Generate speech

curl -X POST http://localhost:17493/generate \

-H "Content-Type: application/json" \

-d '{"text": "Hello world", "profile_id": "abc123", "language": "en"}'

# List voice profiles

curl http://localhost:17493/profiles

# Create a profile

curl -X POST http://localhost:17493/profiles \

-H "Content-Type: application/json" \

-d '{"name": "My Voice", "language": "en"}'

用例: 游戏对话、播客制作、辅助工具、语音助手、内容自动化。

完整 API 文档位于 http://localhost:17493/docs。

技术栈

| 层级 | 技术 |

|---|---|

| 桌面应用 | Tauri(跨平台应用框架)(Rust) |

| 前端 | React, TypeScript, Tailwind CSS |

| 状态管理 | Zustand, React Query |

| 后端 | FastAPI(Python 框架) |

| TTS 引擎 | Qwen3-TTS, LuxTTS, Chatterbox, Chatterbox Turbo, TADA |

| 效果 | Pedalboard (Spotify) |

| 转录 | Whisper / Whisper Turbo (PyTorch 或 MLX) |

| 推理 | MLX (Apple 芯片) / PyTorch (CUDA/ROCm/XPU/CPU) |

| 数据库 | SQLite |

| 音频 | WaveSurfer.js, librosa |

路线图

| 功能 | 描述 |

|---|---|

| 实时流式传输 | 逐字流式传输生成的音频 |

| 语音设计 | 根据文本描述创建新声音 |

| 更多模型 | XTTS、Bark 及其他开源语音模型 |

| 插件架构 | 通过自定义模型和效果扩展 |

| 移动伴侣 | 用手机控制 Voicebox |

开发

详见 CONTRIBUTING.md 以获取详细的设置和贡献指南。

快速开始

git clone https://github.com/jamiepine/voicebox.git

cd voicebox

just setup # creates Python venv, installs all deps

just dev # starts backend + desktop app

安装 just:brew install just 或 cargo install just。运行 just --list 查看所有命令。

前置条件: Bun、Rust、Python 3.11+、Tauri 前置条件,以及 macOS 上的 Xcode。

本地构建

just build # Build CPU server binary + Tauri app

just build-local # (Windows) Build CPU + CUDA server binaries + Tauri app

添加新语音模型

多引擎架构使得添加新的 TTS(文本转语音)引擎变得简单。分步指南 涵盖完整流程:依赖研究、后端协议实现、前端集成和 PyInstaller 打包。

该指南针对 AI 编码代理进行了优化。一个 代理技能 可以接收模型名称并自主处理整个集成过程——您只需在本地测试构建结果。

项目结构

voicebox/

├── app/ # Shared React frontend

├── tauri/ # Desktop app (Tauri + Rust)

├── web/ # Web deployment

├── backend/ # Python FastAPI server

├── landing/ # Marketing website

└── scripts/ # Build & release scripts

贡献

欢迎贡献!详见 CONTRIBUTING.md 获取指南。

- Fork 仓库

- 创建功能分支

- 进行修改

- 提交 PR(拉取请求)

安全

发现安全漏洞?请负责任地报告。详见 SECURITY.md。

许可证

MIT 许可证 — 详见 LICENSE。

版本历史

v0.3.02026/03/17v0.2.32026/03/15v0.2.22026/03/15v0.2.12026/03/15v0.1.132026/02/23v0.1.122026/01/31v0.1.112026/01/30v0.1.102026/01/30v0.1.92026/01/30v0.1.82026/01/29v0.1.72026/01/29v0.1.62026/01/29v0.1.52026/01/28v0.1.42026/01/28v0.1.32026/01/27v0.1.22026/01/27v0.1.12026/01/27v0.1.02026/01/27常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。