StreamSpeech

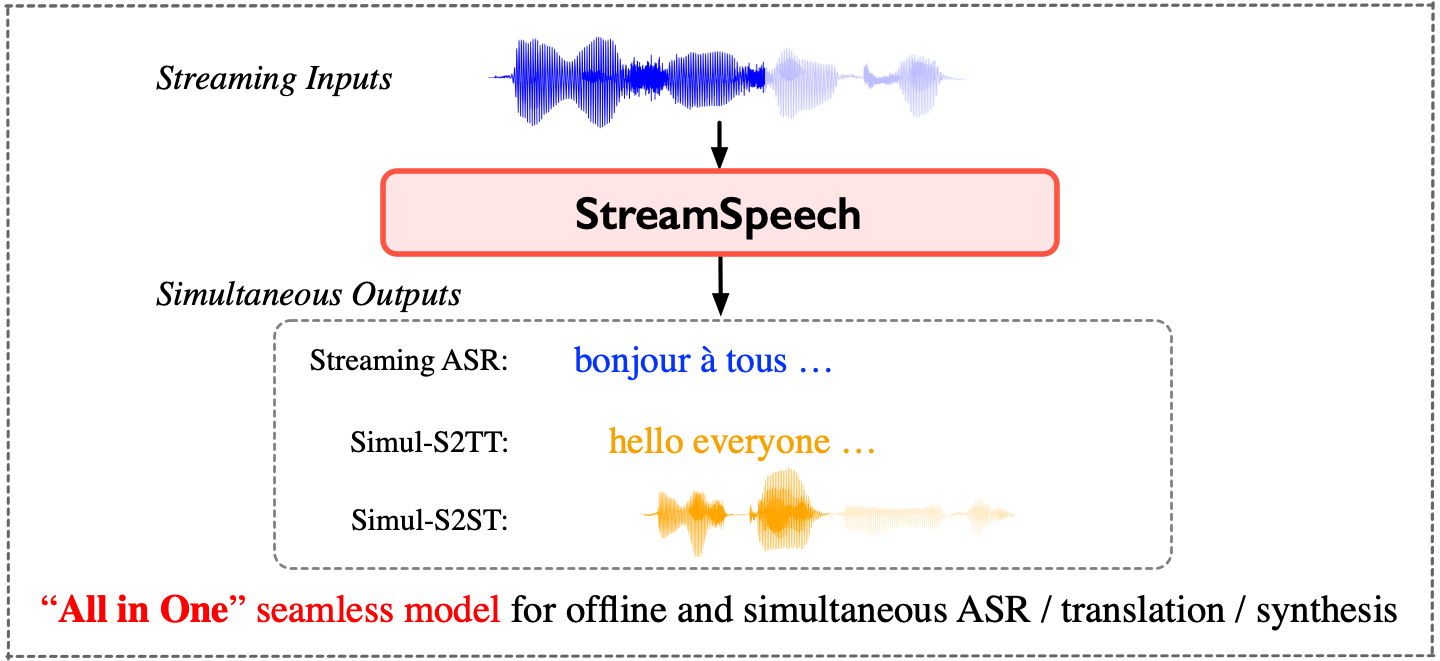

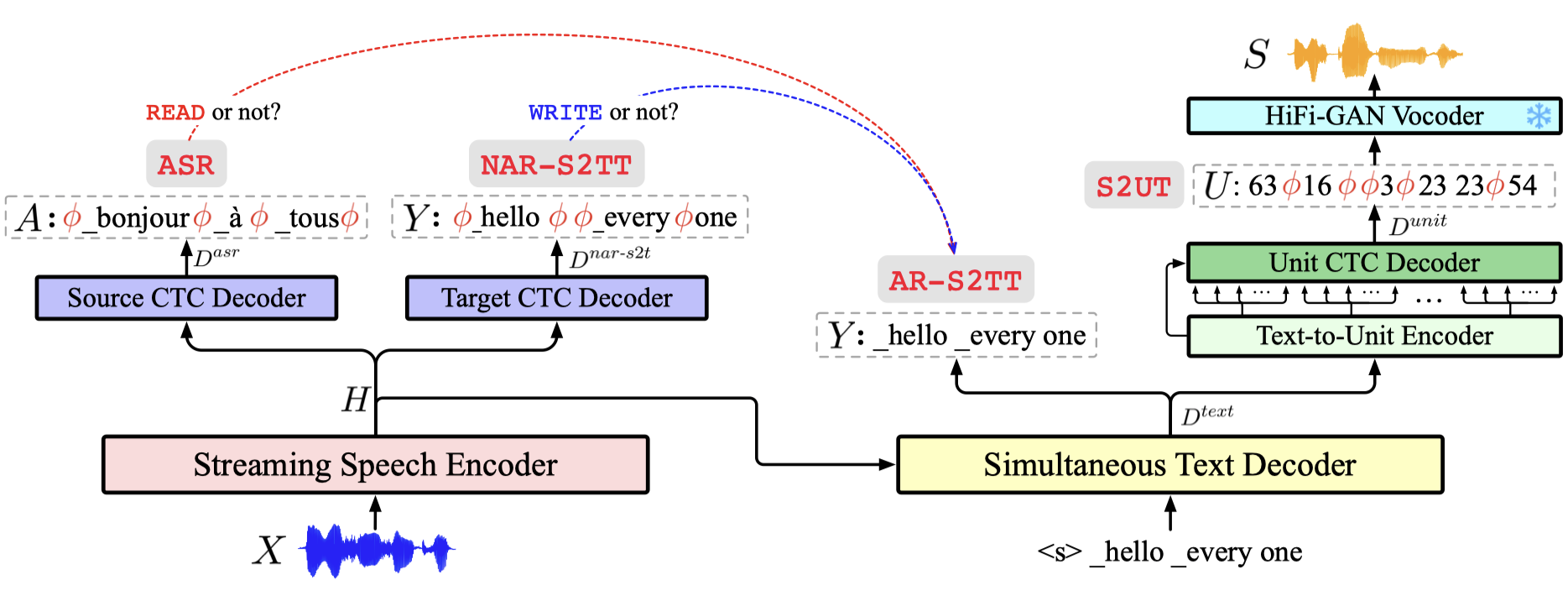

StreamSpeech 是一款集语音识别、翻译与合成于一体的全能型开源模型,旨在打破传统语音处理任务间的壁垒。它不仅能高质量完成离线的语音转文字、跨语言翻译及语音合成,更核心地解决了“同声传译”场景下的低延迟难题。通过独特的流式架构,StreamSpeech 能在用户说话的同时实时输出中间结果(如逐句识别文本或翻译内容),无需等待整段语音结束,从而提供流畅自然的即时沟通体验。

该工具的最大亮点在于"All in One"的设计理念:仅需一个统一模型,即可无缝切换并支持包括流式识别、同步翻译和实时语音生成在内的八种不同任务,且在离线与同步场景下均达到了业界领先的性能水平。这种多任务学习能力大幅降低了部署复杂度,避免了维护多个独立模型的繁琐。

StreamSpeech 非常适合人工智能研究人员探索多任务学习机制,也适合开发者构建需要低延迟交互的语音应用(如实时会议助手、跨国直播字幕系统等)。对于希望体验前沿语音技术的普通用户,其提供的本地 Web 演示也能直观展示同声传译的魅力。作为 ACL 2024 的研究成果,StreamSpeech 以开源形式共享代码与模型,为推动高效、实时的语音交互技术发展提供了有力支持。

使用场景

一位跨国医疗协调员正在通过语音通话,实时协助一位只说法语的患者与英语医生进行紧急病情沟通。

没有 StreamSpeech 时

- 系统架构臃肿:需要串联独立的语音识别、机器翻译和语音合成三个模型,导致部署复杂且维护成本极高。

- 沟通延迟严重:数据必须在不同模型间串行传递,患者说完后需等待数秒才能听到翻译结果,极易延误急救时机。

- 信息断层明显:在最终翻译完成前,协调员无法看到中间的识别文本,难以判断是否因口音或噪音导致识别错误。

- 资源消耗巨大:运行多个重型模型占用了大量显存,难以在边缘设备或低配服务器上流畅运行。

使用 StreamSpeech 后

- 一体化无缝流程:StreamSpeech 单个模型即可同时完成法语识别、英译及英语合成,大幅简化了技术栈并降低了部署难度。

- 超低延迟交互:支持流式处理,患者话音未落,医生端已开始播放翻译语音,实现了近乎面对面的自然对话体验。

- 中间结果可视:StreamSpeech 能实时输出中间的识别文本和翻译草稿,让协调员能即时监控质量并在歧义出现时人工干预。

- 高效资源利用:单一模型显著减少了显存占用和计算开销,使得在普通笔记本甚至移动端设备上部署成为可能。

StreamSpeech 通过“多合一”的流式架构,将原本割裂、高延迟的语音翻译链路重塑为实时、透明且高效的沟通桥梁。

运行环境要求

- Linux

需要 NVIDIA GPU (脚本中指定了 CUDA_VISIBLE_DEVICES),显存需求未说明,需支持 PyTorch 2.0.1 的 CUDA 版本

未说明

快速开始

StreamSpeech

用于ACL 2024论文“StreamSpeech: 基于多任务学习的同步语音到语音翻译”的代码。

🎧 请收听 StreamSpeech 的译文语音 🎧

💡亮点:

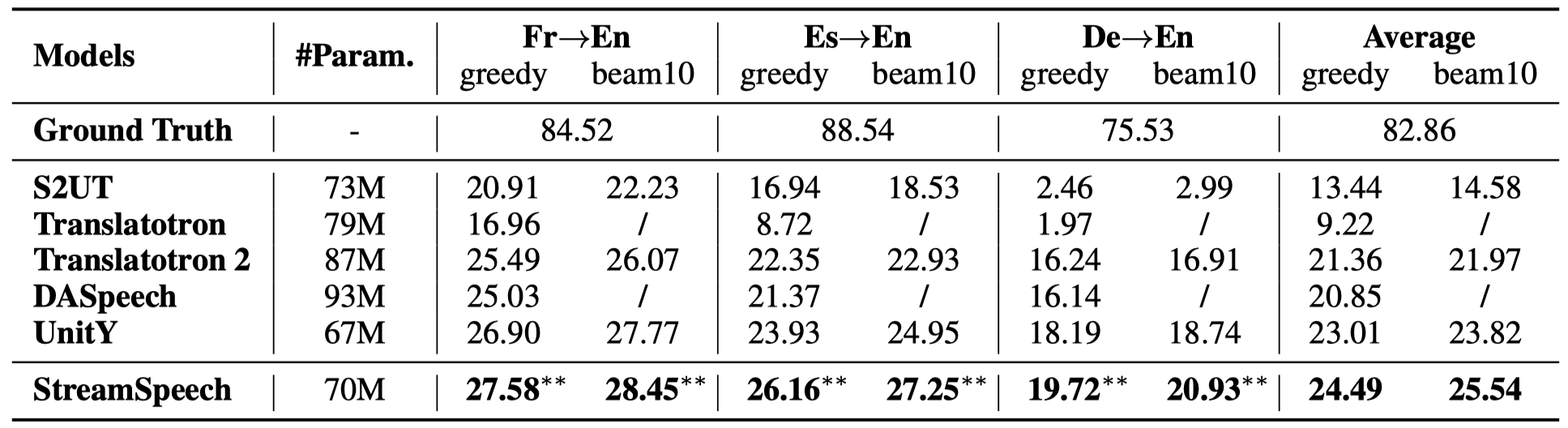

- StreamSpeech 在离线和同步语音到语音翻译任务上均达到 SOTA 性能。

- StreamSpeech 通过一个“一体化”无缝模型,同时实现 流式 ASR、同步语音到文本翻译 和 同步语音到语音翻译。

- 在同步翻译过程中,StreamSpeech 能够实时呈现中间结果(如 ASR 或翻译结果),从而提供更全面的低延迟沟通体验。

🔥新闻

[2025.06.17] 我们很高兴将 StreamSpeech 的“一体化”功能扩展到更广泛的多模态交互中,开发出 Stream-Omni。👉详情请参阅 论文、代码与演示、模型。

- Stream-Omni 是一款类似 GPT-4o 的语言-视觉-语音聊天机器人,能够同时支持文本、视觉和语音任意组合的交互。

- 在语音交互过程中,Stream-Omni 可以像 GPT-4o 的高级语音服务一样,同时生成中间文本结果(如 ASR 转录和模型响应)。

[2024.06.17] 添加了 Web GUI 演示,现在您可以在本地浏览器中体验 StreamSpeech。

⭐功能

支持 8 项任务

- 离线: 语音识别 (ASR)✅、语音到文本翻译 (S2TT)✅、语音到语音翻译 (S2ST)✅、语音合成 (TTS)✅

- 同步: 流式 ASR✅、同步 S2TT✅、同步 S2ST✅、实时 TTS✅,所有这些都由同一个模型完成,且可在任意延迟下运行。

GUI 演示

https://github.com/ictnlp/StreamSpeech/assets/34680227/4d9bdabf-af66-4320-ae7d-0f23e721cd71

通过一个无缝模型同时提供 ASR、翻译和合成结果

示例

语音输入: example/wavs/common_voice_fr_17301936.mp3

转录(真实值):jai donc lexpérience des années passées jen dirai un mot tout à lheure

翻译(真实值):i therefore have the experience of the passed years i'll say a few words about that later

| StreamSpeech | 同步 | 离线 |

|---|---|---|

| 语音识别 | jai donc expérience des années passé jen dirairai un mot tout à lheure | jai donc lexpérience des années passé jen dirairai un mot tout à lheure |

| 语音到文本翻译 | i therefore have an experience of last years i will tell a word later | so i have the experience in the past years i'll say a word later |

| 语音到语音翻译 | ||

| 文本到语音合成 (逐字增量合成语音) |

⚙要求

Python == 3.10, PyTorch == 2.0.1, 安装 fairseq 和 SimulEval

cd fairseq pip install --editable ./ --no-build-isolation cd SimulEval pip install --editable ./

🚀快速入门

1. 模型下载

(1) StreamSpeech 模型

| 语言 | UnitY | StreamSpeech(离线) | StreamSpeech(同传) |

|---|---|---|---|

| 法-英 | unity.fr-en.pt [Huggingface] [百度网盘] | streamspeech.offline.fr-en.pt [Huggingface] [百度网盘] | streamspeech.simultaneous.fr-en.pt [Huggingface] [百度网盘] |

| 西-英 | unity.es-en.pt [Huggingface] [百度网盘] | streamspeech.offline.es-en.pt [Huggingface] [百度网盘] | streamspeech.simultaneous.es-en.pt [Huggingface] [百度网盘] |

| 德-英 | unity.de-en.pt [Huggingface] [百度网盘] | streamspeech.offline.de-en.pt [Huggingface] [百度网盘] | streamspeech.simultaneous.de-en.pt [Huggingface] [百度网盘] |

(2) 基于Unit的HiFi-GAN声码器

| Unit配置 | Unit大小 | 声码器语言 | 数据集 | 模型 |

|---|---|---|---|---|

| mHuBERT, 第11层 | 1000 | 英语 | LJSpeech | 检查点, 配置文件 |

2. 准备数据与配置(仅用于测试/推理)

(1) 配置文件

将文件 configs/fr-en/config_gcmvn.yaml 和 configs/fr-en/config_mtl_asr_st_ctcst.yaml 中的 /data/zhangshaolei/StreamSpeech 替换为本地 StreamSpeech 仓库的路径。

(2) 测试数据

按照 SimulEval 格式准备测试数据。example/ 提供了一个示例:

- wav_list.txt:每行记录一个源语音文件的路径。

- target.txt:每行记录参考文本,例如目标翻译或源语音转录(用于计算指标)。

3. 使用 SimulEval 进行推理

运行这些脚本,即可对 StreamSpeech 进行流式 ASR、同传 S2TT 和同传 S2ST 推理。

--source-segment-size:设置分块大小(毫秒),以控制延迟。

同传语音到语音翻译

--output-asr-translation:是否在同传语音到语音翻译过程中输出中间的 ASR 结果和翻译文本。

export CUDA_VISIBLE_DEVICES=0

ROOT=/data/zhangshaolei/StreamSpeech # StreamSpeech 仓库路径

PRETRAIN_ROOT=/data/zhangshaolei/pretrain_models

VOCODER_CKPT=$PRETRAIN_ROOT/unit-based_HiFi-GAN_vocoder/mHuBERT.layer11.km1000.en/g_00500000 # 下载的基于Unit的HiFi-GAN声码器路径

VOCODER_CFG=$PRETRAIN_ROOT/unit-based_HiFi-GAN_vocoder/mHuBERT.layer11.km1000.en/config.json # 下载的基于Unit的HiFi-GAN声码器配置文件路径

LANG=fr

file=streamspeech.simultaneous.${LANG}-en.pt # 下载的StreamSpeech模型路径

output_dir=$ROOT/res/streamspeech.simultaneous.${LANG}-en/simul-s2st

chunk_size=320 #ms

PYTHONPATH=$ROOT/fairseq simuleval --data-bin ${ROOT}/configs/${LANG}-en \

--user-dir ${ROOT}/researches/ctc_unity --agent-dir ${ROOT}/agent \

--source example/wav_list.txt --target example/target.txt \

--model-path $file \

--config-yaml config_gcmvn.yaml --multitask-config-yaml config_mtl_asr_st_ctcst.yaml \

--agent $ROOT/agent/speech_to_speech.streamspeech.agent.py \

--vocoder $VOCODER_CKPT --vocoder-cfg $VOCODER_CFG --dur-prediction \

--output $output_dir/chunk_size=$chunk_size \

--source-segment-size $chunk_size \

--quality-metrics ASR_BLEU --target-speech-lang en --latency-metrics AL AP DAL StartOffset EndOffset LAAL ATD NumChunks DiscontinuitySum DiscontinuityAve DiscontinuityNum RTF \

--device gpu --computation-aware \

--output-asr-translation True

您应该会得到以下输出:

fairseq 插件已加载...

fairseq 插件已加载...

fairseq 插件已加载...

fairseq 插件已加载...

2024-06-06 09:45:46 | INFO | fairseq.tasks.speech_to_speech | 词典大小:1,004

导入代理...

移除权重归一化...

2024-06-06 09:45:50 | INFO | agent.tts.vocoder | 从 /data/zhangshaolei/pretrain_models/unit-based_HiFi-GAN_vocoder/mHuBERT.layer11.km1000.en/g_00500000 加载了 CodeHiFiGAN 检查点

2024-06-06 09:45:50 | INFO | simuleval.utils.agent | 系统将在 GPU 设备上运行。

2024-06-06 09:45:50 | INFO | simuleval.dataloader | 正在进行语音到语音的评估。

0%| | 0/2 [00:00<?, ?it/s]

流式 ASR:

流式 ASR:

流式 ASR: je

同时翻译: i would

流式 ASR: je voudrais

同时翻译: i would like to

流式 ASR: je voudrais soumettre

同时翻译: i would like to sub

流式 ASR: je voudrais soumettre cette

同时翻译: i would like to submit

流式 ASR: je voudrais soumettre cette idée

同时翻译: i would like to submit this

流式 ASR: je voudrais soumettre cette idée à la

同时翻译: i would like to submit this idea to

流式 ASR: je voudrais soumettre cette idée à la réflexion

同时翻译: i would like to submit this idea to the

流式 ASR: je voudrais soumettre cette idée à la réflexion de

同时翻译: i would like to submit this idea to the reflection

流式 ASR: je voudrais soumettre cette idée à la réflexion de lassemblée

同时翻译: i would like to submit this idea to the reflection of

流式 ASR: je voudrais soumettre cette idée à la réflexion de lassemblée nationale

同时翻译: i would like to submit this idea to the reflection of the

流式 ASR: je voudrais soumettre cette idée à la réflexion de lassemblée nationale

同时翻译: i would like to submit this idea to the reflection of the national assembly

50%|███████████████████████████████████████████████████████████████████████████████████ | 1/2 [00:04<00:04, 4.08s/it]

流式 ASR:

流式 ASR:

流式 ASR:

流式 ASR:

流式 ASR: jai donc

同时翻译: i therefore

流式 ASR: jai donc

流式 ASR: jai donc expérience des

同时翻译: i therefore have an experience

流式 ASR: jai donc expérience des années

流式 ASR: jai donc expérience des années passé

同时翻译: i therefore have an experience of last

流式 ASR: jai donc expérience des années passé jen

同时翻译: i therefore have an experience of last years

流式 ASR: jai donc expérience des années passé jen dirairai

同时翻译: i therefore have an experience of last years i will

流式 ASR: jai donc expérience des années passé jen dirairai un mot

同时翻译: i therefore have an experience of last years i will tell a

流式 ASR: jai donc expérience des années passé jen dirairai un mot tout à lheure

同时翻译: i therefore have an experience of last years i will tell a word

流式 ASR: jai donc expérience des années passé jen dirairai un mot tout à lheure

同时翻译: i therefore have an experience of last years i will tell a word later

100%|██████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████| 2/2 [00:06<00:00, 3.02s/it]

2024-06-06 09:45:56 | WARNING | simuleval.scorer.asr_bleu | Beta 功能:正在评估语音输出。需要 Faieseq。

2024-06-06 09:46:12 | INFO | fairseq.tasks.audio_finetuning | 使用字典路径:/data/zhangshaolei/.cache/ust_asr/en/dict.ltr.txt

转录预测结果:100%|████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████████| 2/2 [00:01<00:00, 1.63it/s]

2024-06-06 09:46:21 | INFO | simuleval.sentence_level_evaluator | 结果:

ASR_BLEU AL AL_CA AP AP_CA DAL DAL_CA StartOffset StartOffset_CA EndOffset EndOffset_CA LAAL LAAL_CA ATD ATD_CA NumChunks NumChunks_CA DiscontinuitySum DiscontinuitySum_CA DiscontinuityAve DiscontinuityAve_CA DiscontinuityNum DiscontinuityNum_CA RTF RTF_CA

15.448 1724.895 2913.508 0.425 0.776 1358.812 3137.55 1280.0 2213.906 1366.0 1366.0 1724.895 2913.508 1440.146 3389.374 9.5 9.5 110.0 110.0 55.0 55.0 1 1 1.326 1.326

日志和评估结果存储在 $output_dir/chunk_size=$chunk_size 中:

$output_dir/chunk_size=$chunk_size

├── wavs/

│ ├── 0_pred.wav # 生成的语音

│ ├── 1_pred.wav

│ ├── 0_pred.txt # ASR-BLEU 工具包的 ASR 转录文本

│ ├── 1_pred.txt

├── config.yaml

├── asr_transcripts.txt # ASR-BLEU 转录结果

├── metrics.tsv

├── scores.tsv

├── asr_cmd.bash

└── instances.log # Simul-S2ST 的日志

同时语音到文本翻译

export CUDA_VISIBLE_DEVICES=0

ROOT=/data/zhangshaolei/StreamSpeech # StreamSpeech 仓库路径

LANG=fr

file=streamspeech.simultaneous.${LANG}-en.pt # 下载的 StreamSpeech 模型路径

output_dir=$ROOT/res/streamspeech.simultaneous.${LANG}-en/simul-s2tt

chunk_size=320 #ms

PYTHONPATH=$ROOT/fairseq simuleval --data-bin ${ROOT}/configs/${LANG}-en \

--user-dir ${ROOT}/researches/ctc_unity --agent-dir ${ROOT}/agent \

--source example/wav_list.txt --target example/target.txt \

--model-path $file \

--config-yaml config_gcmvn.yaml --multitask-config-yaml config_mtl_asr_st_ctcst.yaml \

--agent $ROOT/agent/speech_to_text.s2tt.streamspeech.agent.py\

--output $output_dir/chunk_size=$chunk_size \

--source-segment-size $chunk_size \

--quality-metrics BLEU --latency-metrics AL AP DAL StartOffset EndOffset LAAL ATD NumChunks RTF \

--device gpu --computation-aware

流式 ASR

export CUDA_VISIBLE_DEVICES=0

ROOT=/data/zhangshaolei/StreamSpeech # StreamSpeech 仓库路径

LANG=fr

file=streamspeech.simultaneous.${LANG}-en.pt # 下载的 StreamSpeech 模型路径

output_dir=$ROOT/res/streamspeech.simultaneous.${LANG}-en/streaming-asr

chunk_size=320 #毫秒

PYTHONPATH=$ROOT/fairseq simuleval --data-bin ${ROOT}/configs/${LANG}-en \

--user-dir ${ROOT}/researches/ctc_unity --agent-dir ${ROOT}/agent \

--source example/wav_list.txt --target example/source.txt \

--model-path $file \

--config-yaml config_gcmvn.yaml --multitask-config-yaml config_mtl_asr_st_ctcst.yaml \

--agent $ROOT/agent/speech_to_text.asr.streamspeech.agent.py\

--output $output_dir/chunk_size=$chunk_size \

--source-segment-size $chunk_size \

--quality-metrics BLEU --latency-metrics AL AP DAL StartOffset EndOffset LAAL ATD NumChunks RTF \

--device gpu --computation-aware

🎈开发你自己的StreamSpeech

1. 数据预处理

- 按照

./preprocess_scripts中的说明处理 CVSS-C 数据。

2. 训练

[!注意] 你可以直接使用下载的StreamSpeech模型进行评估,而无需重新训练。

- 按照

researches/ctc_unity/train_scripts/train.simul-s2st.sh中的步骤,训练用于同时语音到语音翻译的StreamSpeech。 - 按照

researches/ctc_unity/train_scripts/train.offline-s2st.sh中的步骤,训练用于离线语音到语音翻译的StreamSpeech。 - 我们还提供了一些其他StreamSpeech变体和基线实现。

| 模型 | --user-dir | --arch | 描述 |

|---|---|---|---|

| Translatotron 2 | researches/translatotron |

s2spect2_conformer_modified |

Translatotron 2 |

| UnitY | researches/translatotron |

unity_conformer_modified |

UnitY |

| Uni-UnitY | researches/uni_unity |

uni_unity_conformer |

将UnitY中的所有编码器改为单向 |

| Chunk-UnitY | researches/chunk_unity |

chunk_unity_conformer |

将UnitY中的Conformer改为基于分块的Conformer |

| StreamSpeech | researches/ctc_unity |

streamspeech |

StreamSpeech |

| StreamSpeech (级联) | researches/ctc_unity |

streamspeech_cascade |

S2TT和TTS的级联StreamSpeech。TTS模块可以独立用于给定增量文本的实时TTS。 |

| HMT | researches/hmt |

hmt_transformer_iwslt_de_en |

HMT:强大的同时文本到文本翻译方法 |

| DiSeg | researches/diseg |

convtransformer_espnet_base_seg |

DiSeg:强大的同时语音到文本翻译方法 |

[!提示] 在

--user-dir目录下的train_scripts/和test_scripts/中,提供了每个模型的训练和测试脚本。 更多细节请参考UnitY、Translatotron 2、HMT和DiSeg的官方仓库。

3. 评估

(1) 离线评估

按照 pred.offline-s2st.sh 中的步骤,评估StreamSpeech在ASR、S2TT和S2ST方面的离线性能。

(2) 同时性评估

训练好的StreamSpeech模型可用于流式ASR、同时语音到文本翻译以及同时语音到语音翻译。我们为这三项任务提供了agent/:

agent/speech_to_speech.streamspeech.agent.py:同时语音到语音翻译agent/speech_to_text.s2tt.streamspeech.agent.py:同时语音到文本翻译agent/speech_to_text.asr.streamspeech.agent.py:流式ASR

按照 simuleval.simul-s2st.sh、simuleval.simul-s2tt.sh 和 simuleval.streaming-asr.sh 中的步骤,评估StreamSpeech。

4. 我们的成果

我们的项目页面(https://ictnlp.github.io/StreamSpeech-site/)提供了一些由StreamSpeech生成的翻译语音,请收听🎧。

(1) 离线语音到语音翻译 ( ASR-BLEU: 质量 )

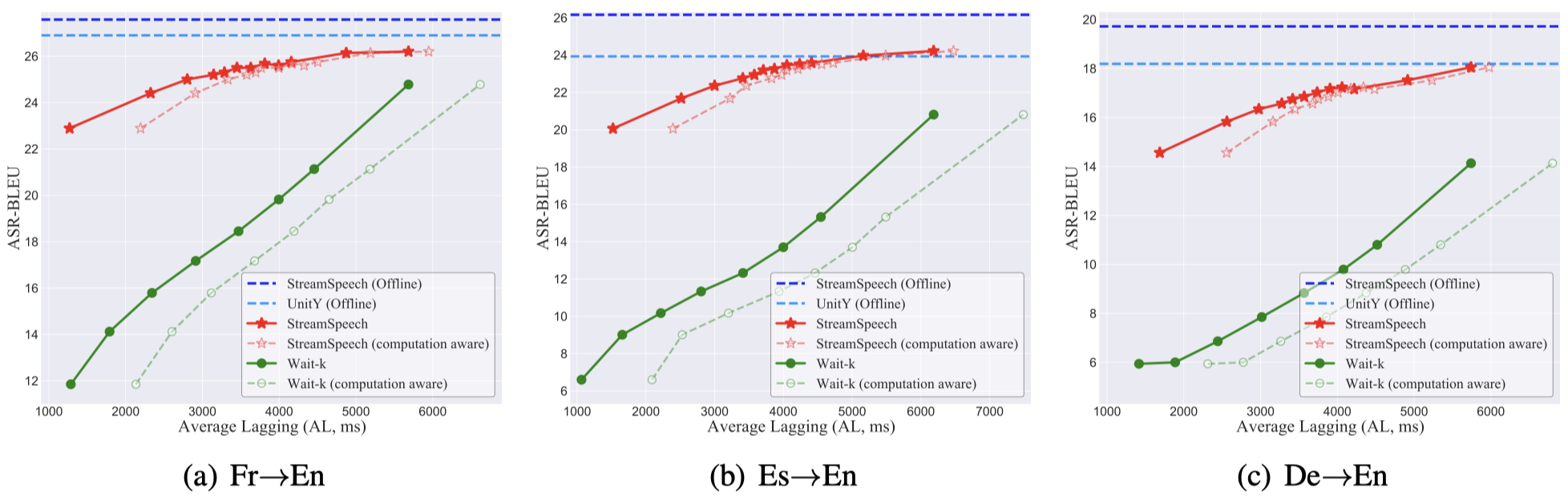

(2) 同时语音到语音翻译 ( AL: 延迟 | ASR-BLEU: 质量 )

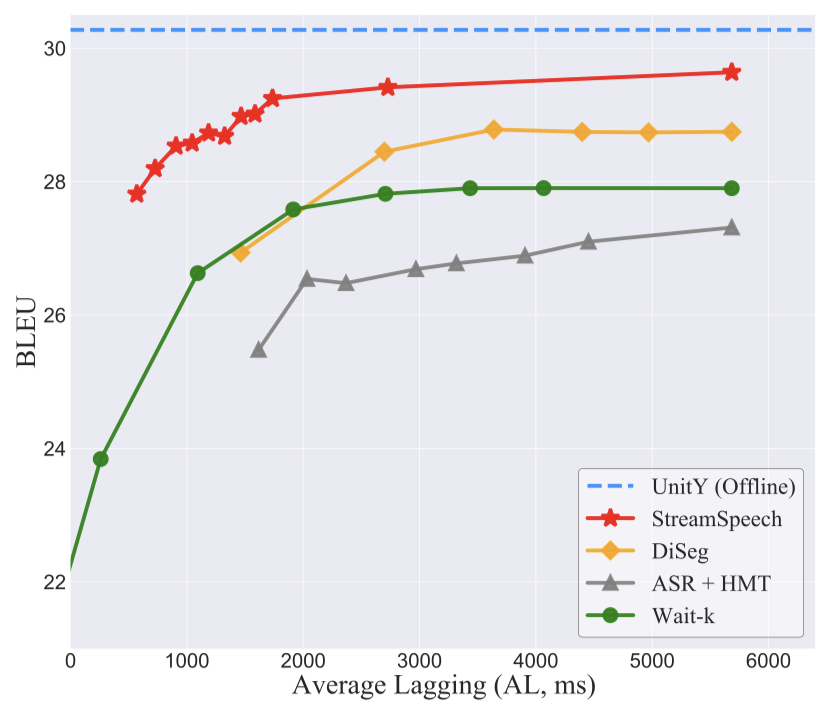

(3) 同时语音到文本翻译 ( AL: 延迟 | BLEU: 质量 )

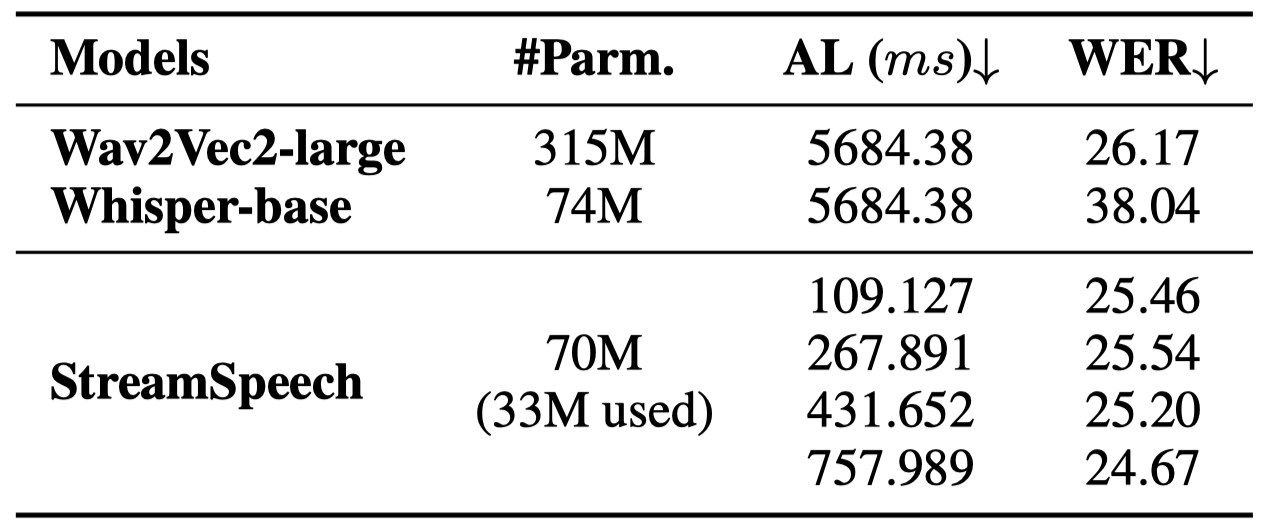

(4) 流式ASR ( AL: 延迟 | WER: 质量 )

🖋引用

如果您有任何问题,请随时提交issue或联系zhangshaolei20z@ict.ac.cn。

如果我们的工作对您有所帮助,请按以下方式引用:

@inproceedings{streamspeech,

title={StreamSpeech: Simultaneous Speech-to-Speech Translation with Multi-task Learning},

author={Shaolei Zhang and Qingkai Fang and Shoutao Guo and Zhengrui Ma and Min Zhang and Yang Feng},

year={2024},

booktitle = {Proceedings of the 62th Annual Meeting of the Association for Computational Linguistics (Long Papers)},

publisher = {Association for Computational Linguistics}

}

常见问题

相似工具推荐

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

funNLP

funNLP 是一个专为中文自然语言处理(NLP)打造的超级资源库,被誉为"NLP 民工的乐园”。它并非单一的软件工具,而是一个汇集了海量开源项目、数据集、预训练模型和实用代码的综合性平台。 面对中文 NLP 领域资源分散、入门门槛高以及特定场景数据匮乏的痛点,funNLP 提供了“一站式”解决方案。这里不仅涵盖了分词、命名实体识别、情感分析、文本摘要等基础任务的标准工具,还独特地收录了丰富的垂直领域资源,如法律、医疗、金融行业的专用词库与数据集,甚至包含古诗词生成、歌词创作等趣味应用。其核心亮点在于极高的全面性与实用性,从基础的字典词典到前沿的 BERT、GPT-2 模型代码,再到高质量的标注数据和竞赛方案,应有尽有。 无论是刚刚踏入 NLP 领域的学生、需要快速验证想法的算法工程师,还是从事人工智能研究的学者,都能在这里找到急需的“武器弹药”。对于开发者而言,它能大幅减少寻找数据和复现模型的时间;对于研究者,它提供了丰富的基准测试资源和前沿技术参考。funNLP 以开放共享的精神,极大地降低了中文自然语言处理的开发与研究成本,是中文 AI 社区不可或缺的宝藏仓库。

gpt4all

GPT4All 是一款让普通电脑也能轻松运行大型语言模型(LLM)的开源工具。它的核心目标是打破算力壁垒,让用户无需依赖昂贵的显卡(GPU)或云端 API,即可在普通的笔记本电脑和台式机上私密、离线地部署和使用大模型。 对于担心数据隐私、希望完全掌控本地数据的企业用户、研究人员以及技术爱好者来说,GPT4All 提供了理想的解决方案。它解决了传统大模型必须联网调用或需要高端硬件才能运行的痛点,让日常设备也能成为强大的 AI 助手。无论是希望构建本地知识库的开发者,还是单纯想体验私有化 AI 聊天的普通用户,都能从中受益。 技术上,GPT4All 基于高效的 `llama.cpp` 后端,支持多种主流模型架构(包括最新的 DeepSeek R1 蒸馏模型),并采用 GGUF 格式优化推理速度。它不仅提供界面友好的桌面客户端,支持 Windows、macOS 和 Linux 等多平台一键安装,还为开发者提供了便捷的 Python 库,可轻松集成到 LangChain 等生态中。通过简单的下载和配置,用户即可立即开始探索本地大模型的无限可能。