candle

Candle 是一款专为 Rust 语言打造的轻量级机器学习框架,由 Hugging Face 团队开发。它致力于在保持代码极简的同时,提供卓越的计算性能,并原生支持 CPU 与 GPU 加速。

对于希望在 Rust 生态中构建高效 AI 应用的开发者而言,Candle 解决了传统框架往往体积庞大、依赖复杂或难以与 Rust 类型安全特性深度融合的痛点。它无需庞大的运行时环境,即可轻松实现从基础的矩阵运算到复杂大模型推理的各种任务。

Candle 特别适合熟悉 Rust 的工程师、追求高性能部署的研究人员,以及希望将 AI 模型嵌入本地应用或 Web 端(通过 WebAssembly)的技术团队。其独特的技术亮点在于“极简主义”设计:去除了冗余抽象,让开发者能直接掌控底层计算细节。目前,Candle 已成功支持 LLaMA、Whisper、Yolo、Stable Diffusion 等众多主流模型的运行,甚至能在浏览器中流畅跑通复杂的图像分割与语音识别任务。如果你看重执行效率、二进制文件大小以及 Rust 带来的内存安全性,Candle 是一个值得尝试的现代化选择。

使用场景

一家专注于边缘计算的初创团队,正试图将大型语言模型(LLM)部署到资源受限的 IoT 网关设备上,以提供本地化的智能客服功能。

没有 candle 时

- 内存占用过高:依赖 Python 解释器及庞大的深度学习框架(如 PyTorch),导致在仅有 2GB 内存的设备上无法加载模型,频繁发生 OOM 崩溃。

- 启动延迟严重:冷启动时需要初始化复杂的运行时环境,用户发出请求后需等待数秒才能收到响应,体验极差。

- 部署流程繁琐:需要在目标设备上交叉编译安装 Python 依赖和 CUDA/cuDNN 库,环境配置极易出错,维护成本高昂。

- 类型安全隐患:动态语言特性使得内存管理和数据类型错误只能在运行时发现,增加了系统在生产环境中的不稳定性。

使用 candle 后

- 极致轻量运行:利用 Rust 的零成本抽象和无垃圾回收机制,candle 将模型推理的内存占用降低了 60%,成功在低配设备上流畅运行 LLaMA 等模型。

- 毫秒级响应:去除了沉重的解释器开销,结合 candle 对 GPU/CPU 的高效调度,首字生成时间从秒级缩短至毫秒级,实现实时交互。

- 单二进制交付:借助 Cargo 构建能力,整个应用被编译为独立的静态二进制文件,无需任何外部依赖即可直接部署到各类 Linux 边缘节点。

- 编译期安全保障:Rust 的强类型系统在编译阶段即可拦截维度不匹配或内存访问错误,显著提升了长期运行的可靠性。

candle 通过极简的 Rust 原生架构,打破了高性能 AI 模型在边缘设备部署的资源与效率瓶颈。

运行环境要求

- Linux

- macOS

- Windows

- 非必需

- 支持 NVIDIA GPU (需安装 CUDA,可选 cuDNN 加速)

- 支持 WebAssembly (浏览器运行)

- 具体显存取决于运行的模型大小

未说明 (取决于运行的模型大小)

快速开始

蜡烛

Candle 是一个面向 Rust 的极简机器学习框架,专注于性能(包括 GPU 支持)和易用性。请尝试我们的在线演示: whisper, LLaMA2, T5, yolo, Segment Anything。

开始使用

请确保已按照 安装 中的说明正确安装了 candle-core。

让我们看看如何运行一个简单的矩阵乘法。将以下内容写入你的 myapp/src/main.rs 文件:

use candle_core::{Device, Tensor};

fn main() -> Result<(), Box<dyn std::error::Error>> {

let device = Device::Cpu;

let a = Tensor::randn(0f32, 1., (2, 3), &device)?;

let b = Tensor::randn(0f32, 1., (3, 4), &device)?;

let c = a.matmul(&b)?;

println!("{c}");

Ok(())

}

运行 cargo run 应该会显示一个形状为 Tensor[[2, 4], f32] 的张量。

如果你已经安装了支持 CUDA 的 candle,只需将 device 定义为 GPU 即可:

- let device = Device::Cpu;

+ let device = Device::new_cuda(0)?;

有关更高级的示例,请参阅下一节。

查看我们的示例

这些在线演示完全在您的浏览器中运行:

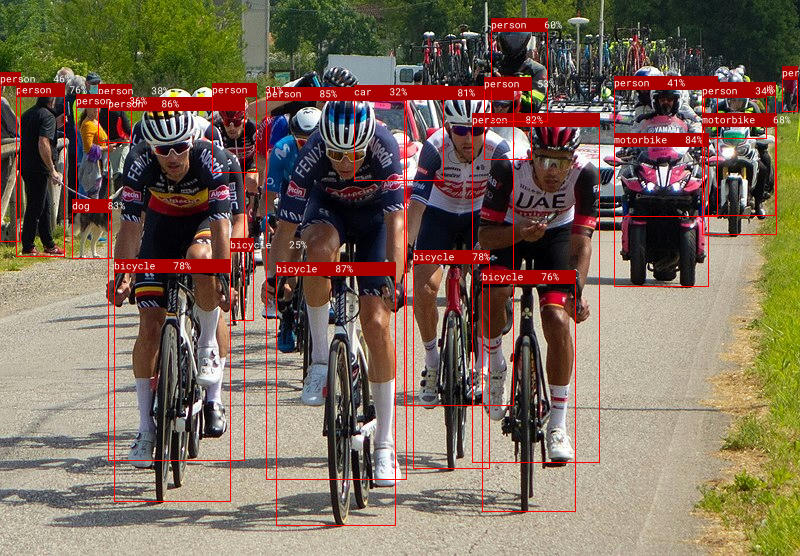

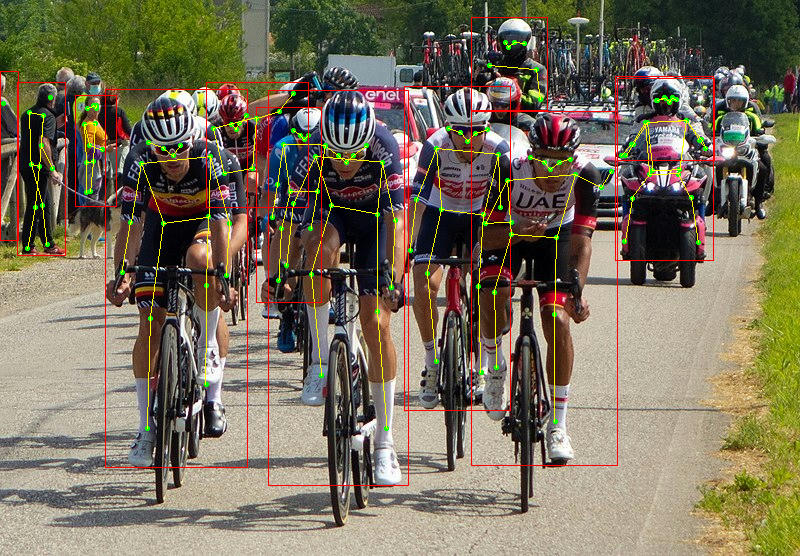

- yolo:姿态估计和目标识别。

- whisper:语音识别。

- LLaMA2:文本生成。

- T5:文本生成。

- Phi-1.5 和 Phi-2:文本生成。

- Segment Anything Model:图像分割。

- BLIP:图像描述。

我们还提供了一些基于命令行的示例,使用最先进的模型:

- LLaMA v1、v2 和 v3:通用 LLM,包括 SOLAR-10.7B 变体。

- Falcon:通用 LLM。

- Codegeex4:代码补全、代码解释器、网页搜索、函数调用、仓库级任务。

- GLM4:由 THUDM 发布的开放多语言多模态聊天 LLM。

- Gemma v1 和 v2:来自 Google Deepmind 的 2b 和 7b+/9b 通用 LLM。

- RecurrentGemma:Google 推出的基于 Griffin 架构的 2b 和 7b 模型,将注意力机制与 RNN 式状态相结合。

- Phi-1、Phi-1.5、Phi-2 和 Phi-3:1.3b、2.7b 和 3.8b 通用 LLM,性能可与 7b 模型媲美。

- StableLM-3B-4E1T:一个 3b 通用 LLM,在 1T 个英语和代码数据集上预训练而成。同时也支持 1.6b 的 StableLM-2,以及其代码变体。

- Mamba:仅用于推理的 Mamba 状态空间模型实现。

- Mistral7b-v0.1:一个 7b 通用 LLM,截至 2023 年 9 月 28 日,其性能优于所有公开可用的 13b 模型。

- Mixtral8x7b-v0.1:一种稀疏专家混合的 8x7b 通用 LLM,性能优于 Llama 2 的 70B 模型,且推理速度更快。

- StarCoder 和 StarCoder2:专门用于代码生成的 LLM。

- Qwen1.5:双语(英语/中文)LLM。

- RWKV v5 和 v6:一种具有 Transformer 级别 LLM 性能的 RNN。

- Replit-code-v1.5:一个 3.3b 专门用于代码补全的 LLM。

- Yi-6B / Yi-34B:两款双语(英语/中文)通用 LLM,分别拥有 6b 和 34b 参数。

- 量化 LLaMA:使用与 llama.cpp 相同的量化技术对 LLaMA 模型进行量化。

- 量化 Qwen3 MoE:支持 gguf 格式的 Qwen3 MoE 模型量化版本。

- Stable Diffusion:文本到图像生成模型,支持 1.5、2.1、SDXL 1.0 和 Turbo 版本。

- Wuerstchen:另一种文本到图像生成模型。

- segment-anything:带有提示的图像分割模型。

- SegFormer: 基于Transformer的语义分割模型。

- Whisper: 语音识别模型。

- EnCodec: 使用残差向量量化技术的高质量音频压缩模型。

- MetaVoice: 文本到语音的基础模型。

- Parler-TTS: 大型文本到语音模型。

- T5、Bert、JinaBert:适用于句子嵌入。

- DINOv2: 自监督训练的计算机视觉模型(可用于ImageNet分类、深度估计、分割)。

- VGG、RepVGG:计算机视觉模型。

- BLIP: 图像到文本模型,可用于为图像生成标题。

- CLIP: 多模态视觉与语言模型。

- TrOCR:Transformer OCR模型,具有专门用于手写和印刷体识别的子模型。

- Marian-MT:神经机器翻译模型,根据输入文本生成翻译后的文本。

- Moondream:小型计算机视觉模型,能够回答关于图像的实际问题。

可以通过类似以下命令运行这些模型:

cargo run --example quantized --release

若要使用CUDA,请在示例命令行中添加 --features cuda。如果已安装cuDNN,则可使用 --features cudnn 以获得更高的加速效果。

此外,还有针对Whisper和llama2.c的一些Wasm示例。你可以使用trunk构建它们,或在线试用:

Whisper、

llama2、

T5、

Phi-1.5和Phi-2、

Segment Anything Model。

对于LLaMA2,运行以下命令以获取权重文件并启动测试服务器:

cd candle-wasm-examples/llama2-c

wget https://huggingface.co/spaces/lmz/candle-llama2/resolve/main/model.bin

wget https://huggingface.co/spaces/lmz/candle-llama2/resolve/main/tokenizer.json

trunk serve --release --port 8081

然后访问 http://localhost:8081/。

有用的外部资源

candle-tutorial:一个非常详细的教程,展示如何将PyTorch模型转换为Candle。candle-lora:高效且易用的Candle LoRA实现。candle-lora为Candle中的许多模型提供了开箱即用的LoRA支持,相关示例可在这里找到。candle-video:基于Candle构建的Rust库,用于文本到视频生成(LTX-Video及相关模型),专注于快速、无需Python的推理。optimisers:一系列优化器,包括带有动量的SGD、AdaGrad、AdaDelta、AdaMax、NAdam、RAdam和RMSprop。candle-vllm:高效的本地大语言模型推理和服务平台,包含兼容OpenAI API的服务器。candle-ext:Candle的扩展库,提供目前Candle中尚未实现的PyTorch功能。candle-coursera-ml:Coursera《机器学习专项课程》中ML算法的实现。kalosm:Rust中的多模态元框架,用于对接本地预训练模型,支持可控生成、自定义采样器、内存中向量数据库、音频转录等功能。candle-sampling:Candle的采样技术。gpt-from-scratch-rs:Andrej Karpathy在YouTube上发布的“让我们构建GPT”教程的Rust移植版,展示了Candle API在玩具问题上的应用。candle-einops:纯Rust实现的Python einops库。atoma-infer:Rust库,用于大规模快速推理,利用FlashAttention2进行高效的注意力计算、PagedAttention进行高效的KV缓存管理,并支持多GPU。它兼容OpenAI API。llms-from-scratch-rs:Sebastian Raschka的《从零开始构建LLM》一书代码的全面Rust翻译。vllm.rs:基于Candle的极简Rust vLLM实现。

如果您有其他补充,请提交拉取请求。

特性

- 简单的语法,使用起来感觉就像 PyTorch 一样。

- 模型训练。

- 可以嵌入用户自定义的操作/内核,例如 flash-attention v2。

- 后端支持。

- 针对 x86 的优化 CPU 后端,可选 MKL 支持;针对 Mac 的 Accelerate 后端。

- CUDA 后端,可在 GPU 上高效运行,并通过 NCCL 实现多 GPU 分布式计算。

- WASM 支持,可以在浏览器中运行模型。

- 内置模型。

- 语言模型。

- LLaMA v1、v2 和 v3,以及 SOLAR-10.7B 等变体。

- Falcon。

- StarCoder、StarCoder2。

- Phi 1、1.5、2 和 3。

- Mamba、Minimal Mamba。

- Gemma v1 2b 和 7b+,v2 2b 和 9b。

- Mistral 7b v0.1。

- Mixtral 8x7b v0.1。

- StableLM-3B-4E1T、StableLM-2-1.6B、Stable-Code-3B。

- Replit-code-v1.5-3B。

- Bert。

- Yi-6B 和 Yi-34B。

- Qwen1.5、Qwen1.5 MoE、Qwen3 MoE。

- RWKV v5 和 v6。

- 量化语言模型。

- Llama 7b、13b、70b,以及聊天和代码版本。

- Mistral 7b 和 7b 指令版。

- Mixtral 8x7b。

- Zephyr 7b a 和 b(基于 Mistral-7b)。

- OpenChat 3.5(基于 Mistral-7b)。

- Qwen3 MoE(16B-A3B、32B-A3B)。

- 文本到文本。

- T5 及其变体:FlanT5、UL2、MADLAD400(翻译)、CoEdit(语法修正)。

- Marian MT(机器翻译)。

- 文本到图像。

- Stable Diffusion v1.5、v2.1、XL v1.0。

- Wurstchen v2。

- 图像到文本。

- BLIP。

- TrOCR。

- 音频。

- Whisper,多语言语音转文本。

- EnCodec,音频压缩模型。

- MetaVoice-1B,文本到语音模型。

- Parler-TTS,文本到语音模型。

- 计算机视觉模型。

- DINOv2、ConvMixer、EfficientNet、ResNet、ViT、VGG、RepVGG、ConvNeXT、 ConvNeXTv2、MobileOne、EfficientVit(MSRA)、MobileNetv4、Hiera、FastViT。

- YOLO-v3、YOLO-v8。

- Segment-Anything Model (SAM)。

- SegFormer。

- 语言模型。

- 文件格式:支持从 safetensors、npz、ggml 或 PyTorch 文件加载模型。

- 无服务器(在 CPU 上),小型且快速的部署。

- 支持使用 llama.cpp 的量化类型进行量化。

使用方法

速查表:

| 使用 PyTorch | 使用 Candle | |

|---|---|---|

| 创建 | torch.Tensor([[1, 2], [3, 4]]) |

Tensor::new(&[[1f32, 2.], [3., 4.]], &Device::Cpu)? |

| 创建 | torch.zeros((2, 2)) |

Tensor::zeros((2, 2), DType::F32, &Device::Cpu)? |

| 索引 | tensor[:, :4] |

tensor.i((.., ..4))? |

| 操作 | tensor.view((2, 2)) |

tensor.reshape((2, 2))? |

| 操作 | a.matmul(b) |

a.matmul(&b)? |

| 算术 | a + b |

&a + &b |

| 设备 | tensor.to(device="cuda") |

tensor.to_device(&Device::new_cuda(0)?)? |

| 数据类型 | tensor.to(dtype=torch.float16) |

tensor.to_dtype(&DType::F16)? |

| 保存 | torch.save({"A": A}, "model.bin") |

candle::safetensors::save(&HashMap::from([("A", A)]), "model.safetensors")? |

| 加载 | weights = torch.load("model.bin") |

candle::safetensors::load("model.safetensors", &device) |

结构

- candle-core:核心操作、设备以及

Tensor结构的定义。 - candle-nn:用于构建实际模型的工具。

- candle-examples:库在实际场景中的使用示例。

- candle-kernels:CUDA 自定义内核。

- candle-datasets:数据集和数据加载器。

- candle-transformers:与 Transformer 相关的工具。

- candle-flash-attn:Flash Attention v2 层。

- candle-onnx:ONNX 模型评估。

常见问题解答

为什么应该使用 Candle?

Candle 的核心目标是 实现无服务器推理。像 PyTorch 这样的完整机器学习框架体积庞大,导致在集群上创建实例的速度较慢。而 Candle 则允许部署轻量级的二进制文件。

其次,Candle 能够让你 将 Python 从生产工作负载中移除。Python 的开销会严重降低性能,而 GIL 更是出了名的麻烦来源。

最后,Rust 很酷!HF 生态系统中已经有很多 Rust crate,比如 safetensors 和 tokenizers。

其他 ML 框架

- dfdx 是一个功能强大的 crate,它将形状信息纳入类型系统中。这样可以避免很多因形状不匹配而导致的问题,编译器会在第一时间报错。不过,我们发现某些功能仍然需要 nightly 版本,而且对于非 Rust 专家来说,编写代码可能会有些困难。

我们正在利用并为其他核心 crate 提供支持,希望这两个 crate 能够互相受益。

burn 是一个通用的 crate,可以利用多种后端,从而让你根据工作负载选择最合适的引擎。

tch-rs 是 Rust 中对 torch 库的绑定。它非常灵活,但会将整个 torch 库引入运行时环境。

tch-rs的主要贡献者也参与了candle的开发。

常见错误

使用 mkl 功能编译时缺少符号。

如果你在使用 mkl 或 accelerate 功能编译二进制文件或测试时遇到一些缺失的符号,例如对于 mkl 你会看到:

= note: /usr/bin/ld: (....o): in function `blas::sgemm':

.../blas-0.22.0/src/lib.rs:1944: undefined reference to `sgemm_' collect2: error: ld returned 1 exit status

= note: some `extern` functions couldn't be found; some native libraries may need to be installed or have their path specified

= note: use the `-l` flag to specify native libraries to link

= note: use the `cargo:rustc-link-lib` directive to specify the native libraries to link with Cargo

或者对于 accelerate:

Undefined symbols for architecture arm64:

"_dgemm_", referenced from:

candle_core::accelerate::dgemm::h1b71a038552bcabe in libcandle_core...

"_sgemm_", referenced from:

candle_core::accelerate::sgemm::h2cf21c592cba3c47 in libcandle_core...

ld: symbol(s) not found for architecture arm64

这很可能是由于缺少启用 mkl 库所需的链接器标志。你可以尝试在你的二进制文件顶部添加以下内容以解决 mkl 的问题:

extern crate intel_mkl_src;

或者对于 accelerate:

extern crate accelerate_src;

无法运行 LLaMA 示例:访问源需要登录凭证

Error: request error: https://huggingface.co/meta-llama/Llama-2-7b-hf/resolve/main/tokenizer.json: status code 401

这很可能是因为你没有 LLaMA-v2 模型的权限。要解决这个问题,你需要在 huggingface-hub 上注册,接受 LLaMA-v2 模型条款,并设置你的认证令牌。更多详情请参阅 issue #350。

Docker 构建

在 Dockerfile 中构建 CUDA 内核时,nvidia-smi 无法用于自动检测计算能力。

你必须显式设置 CUDA_COMPUTE_CAP,例如:

FROM nvidia/cuda:12.9.0-devel-ubuntu22.04

# 安装 git 和 curl

RUN set -eux; \

apt-get update; \

apt-get install -y curl git ca-certificates;

# 安装 Rust

RUN curl --proto '=https' --tlsv1.2 -sSf https://sh.rustup.rs | sh -s -- -y

# 克隆 candle 仓库

RUN git clone https://github.com/huggingface/candle.git

# 设置构建的计算能力

ARG CUDA_COMPUTE_CAP=90

ENV CUDA_COMPUTE_CAP=${CUDA_COMPUTE_CAP}

# 使用显式计算能力进行构建

WORKDIR /app

COPY . .

RUN cargo build --release features cuda

使用 flash-attention 编译失败

/usr/include/c++/11/bits/std_function.h:530:146: error: parameter packs not expanded with ‘...’:

这是由 Cuda 编译器触发的 gcc-11 中的一个 bug。要修复这个问题,可以安装一个受支持的其他版本的 gcc,例如 gcc-10,并将编译器路径指定到 NVCC_CCBIN 环境变量中。

env NVCC_CCBIN=/usr/lib/gcc/x86_64-linux-gnu/10 cargo ...

在 Windows 上运行 rustdoc 或 mdbook 测试时出现链接错误

Couldn't compile the test.

---- .\candle-book\src\inference\hub.md - Using_the_hub::Using_in_a_real_model_ (line 50) stdout ----

error: linking with `link.exe` failed: exit code: 1181

//very long chain of linking

= note: LINK : fatal error LNK1181: cannot open input file 'windows.0.48.5.lib'

确保链接所有可能位于项目目标之外的原生库。例如,要运行 mdbook 测试,你应该执行以下命令:

mdbook test candle-book -L .\target\debug\deps\ `

-L native=$env:USERPROFILE\.cargo\registry\src\index.crates.io-6f17d22bba15001f\windows_x86_64_msvc-0.42.2\lib `

-L native=$env:USERPROFILE\.cargo\registry\src\index.crates.io-6f17d22bba15001f\windows_x86_64_msvc-0.48.5\lib

WSL 下模型加载时间极慢

这可能是由于模型从 /mnt/c 加载导致的,更多详细信息请参阅 stackoverflow。

跟踪错误

你可以设置 RUST_BACKTRACE=1,以便在 candle 报错时提供完整的调用栈信息。

CudaRC 错误

如果你在 Windows 上遇到类似 called Result::unwrap()on anErr value: LoadLibraryExW { source: Os { code: 126, kind: Uncategorized, message: "The specified module could not be found." } } 的错误,可以通过复制并重命名以下 3 个文件来解决(确保它们在系统路径中)。具体路径取决于你的 CUDA 版本。

c:\Windows\System32\nvcuda.dll -> cuda.dll

c:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4\bin\cublas64_12.dll -> cublas.dll

c:\Program Files\NVIDIA GPU Computing Toolkit\CUDA\v12.4\bin\curand64_10.dll -> curand.dll

常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。