face-nn

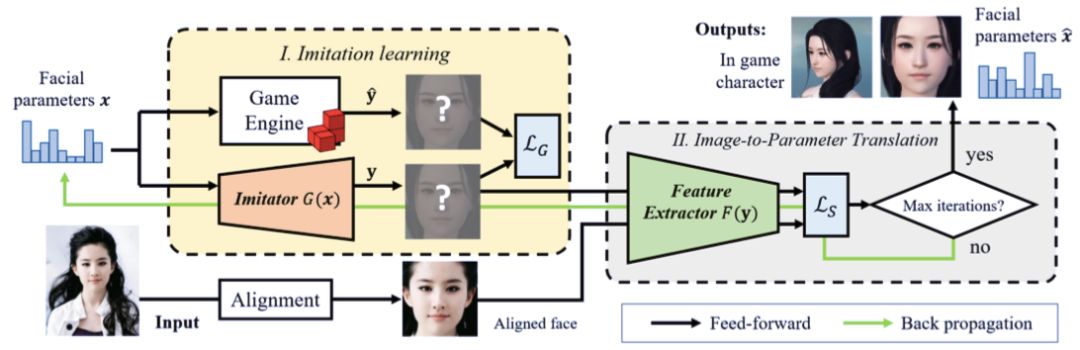

face-nn 是一个基于神经网络的“游戏捏脸”开源工具,能根据真实人脸照片自动生成对应的游戏角色面部参数。它解决了传统手动捏脸耗时费力、难以还原真人特征的问题,让玩家或设计师只需上传一张照片,就能快速获得高度相似的游戏角色脸型,并支持后续手动微调。

该工具适合游戏开发者、AI研究人员和数字内容创作者使用,尤其对希望将现实人物快速转化为游戏角色的项目非常实用。技术上,它结合了神经风格迁移、LightCNN 人脸识别与 BiSeNet 人脸分割模型,通过计算面部语义差异优化生成效果,最终输出可被 Unity 引擎直接读取的参数文件。

整个流程包含数据集生成、模型训练、推理与预览,支持断点续训和可视化评估。虽然配置稍复杂,但文档完整,适合具备基础 Python 和 Unity 使用经验的用户。项目复现了网易论文中的方法,是探索 AI 驱动角色创建的优秀实践案例。

使用场景

一位独立游戏开发者正在为新作《幻境旅人》设计角色创建系统,希望玩家能上传自拍生成专属游戏角色,但缺乏美术资源与算法能力手动实现高精度捏脸功能。

没有 face-nn 时

- 美术师需手动对照玩家照片逐项调整上百个面部参数(如颧骨高度、鼻梁弧度等),平均每个角色耗时2小时以上,效率极低。

- 生成角色与真人相似度依赖美术经验,常出现“形似神不似”问题,玩家反馈“不像我”导致留存率下降。

- 修改过程反复沟通成本高:玩家提出“眼睛再大一点”,美术需多次微调并截图确认,项目周期被迫拉长。

- 缺乏自动化流程,无法批量处理测试集或用户上传图,上线后服务器端无法动态响应捏脸请求。

- 面部细节(如法令纹、唇形厚度)难以精准还原,风格迁移仅靠滤镜,缺乏解剖学层面的结构匹配。

使用 face-nn 后

- 上传一张自拍,face-nn 自动提取68点人脸特征并输出Unity捏脸参数,10秒内生成高相似度3D角色,效率提升百倍。

- 基于LightCNN和BiSeNet的双重损失函数确保五官结构+纹理风格双重还原,玩家满意度调研中“像本人”评分从58%升至92%。

- 生成结果支持一键导出eval.bytes文件,美术可在Unity预览界面进行微调,修改记录自动同步,沟通成本降低80%。

- 支持批量推理模式,可对测试集千张图片并行生成参数,配合TensorBoard实时监控训练效果,快速迭代模型。

- 人脸分割模块精准分离额头、嘴唇、下巴等区域,Facial Content Loss让局部特征(如酒窝深浅)也能被神经网络学习并还原。

face-nn 将“拍照→游戏化身”的幻想变为可量产的技术现实,让每个玩家都能在虚拟世界遇见最真实的自己。

运行环境要求

未说明

未说明

快速开始

基于神经网络捏脸

依赖环境

1. Unity-2019.2.1f1

2. python-3.5

3. dlib-19.18

4. numpy-1.15.4

5. torch-1.1.0

6. opencv-contrib-python 3.4.0.12

7. tqdm-4.23.4

8. argparse-1.4.0

9. scipy-1.0.1

10. tensorboardX

论文

网易的研究者提出了一种游戏角色自动创建方法,利用 Face-to-Parameter(面部到参数)的转换快速创建游戏角色,用户还可以基于模型结果进一步手动调整,直到获得满意的角色形象。本项目依据论文中的描述实现。

Face-to-Parameter Translation for Game Character Auto-Creation

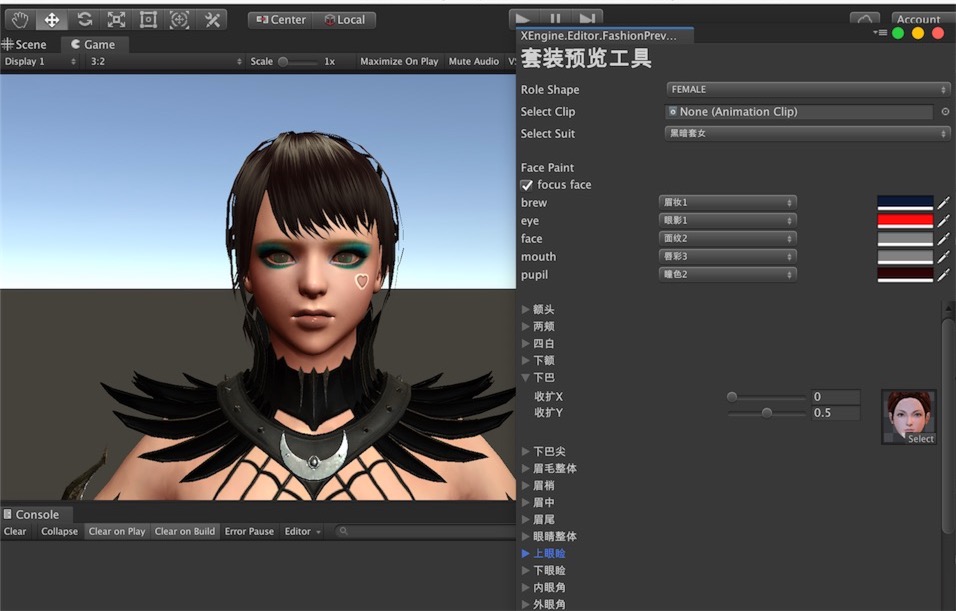

引擎预览

打开 Unity,点击菜单栏 Tools -> Preview,可通过此工具手动进行角色面部调整(“捏脸”)。当然,本项目主要通过神经网络自动生成面部参数 params。

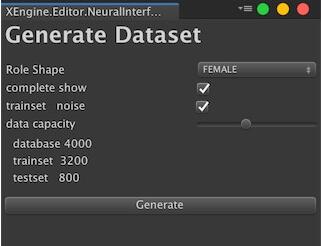

数据库生成

打开 Unity,点击菜单栏 Tools -> GenerateDatabase

点击 generate 按钮后,在 export 目录下将生成两个文件夹 trainset 和 testset,分别作为训练集和测试集。勾选 trainset noise 后,trainset 中随机生成的噪点比例约为 1/95。

引擎最多可随机生成 10000 张图片,其中 80% 用作训练集。同时在图片同目录下会生成二进制文件 db_description,记录捏脸相关参数,作为 imitator(模仿器)的输入参数。

生成图片分辨率为:512x512。与论文不同的是,本项目使用 Unity 引擎替代了论文中的 Justice 引擎。

脸部对齐 - Face alignment

对于输入图片,使用 dlib 工具进行脸部区域截取。

pip3 install dlib

或使用 conda 安装:

conda install -c menpo dlib

dlib 所需模型下载地址:

http://dlib.net/files/shape_predictor_68_face_landmarks.dat.bz2

http://dlib.net/files/dlib_face_recognition_resnet_model_v1.dat.bz2

LightCNN

light_cnn 出自 2016 CVPR 吴翔的论文《A Light CNN for Deep Face Representation with Noisy Labels》。LightCNN 的优势在于模型体积小且识别准确率高。论文中使用 LightCNN 生成 256 维特征向量,用于计算损失函数 L1(即 Discriminative Loss,判别损失),衡量引擎生成图像与 Imitator 生成图像之间的差异。

预训练模型下载链接:

Google Drive: LightCNN-29 v2

百度网盘: LightCNN-29 v2

人脸分割

论文中使用人脸分割技术提取局部面部特征,从而计算 Facial Content Loss(面部内容损失)。以下列出我在网上找到的相关人脸分割介绍及数据集。

介绍

图像解析与编辑[中国科学院信息工程研究所网络空间技术实验室PPT]: https://pan.baidu.com/s/1FYznfGG914pPaU5bs0-4dw

数据集

helen_small4seg

https://share.weiyun.com/5Q9ST03 密码:ndks4g

不同于论文中使用的 resnet50,本项目采用 BiSeNet 模型。

预训练模型: https://pan.baidu.com/s/1AEc7CJGirsdxOouD3boRBQ

下载后请存放至 face-parsing.PyTorch/res/cp 目录下。

最终效果如下图所示:

操作指南

训练 train

进入 git 下载目录,按以下命令即可开始训练。训练过程中每 100 步会生成 preview 预览图,实时查看训练效果;每 500 步保存一次当前模型,保存在 model 文件夹下。

cd /path/to/workdir

cd neural/

mkdir dat/

# 请将下载的 lightcnn、dlib 等模型拷贝至此目录

copy yours_download_model_path data/

python3 main.py \

--phase=train_imitator \

--batch_size=4 \

--learning_rate=0.01 \

--total_steps=30000 \

--prev_freq=100 \

--save_freq=500 \

--path_to_dataset="../export/trainset_female/"

# 开启 tensorboard 查看训练过程图表

tensorboard --logdir logs

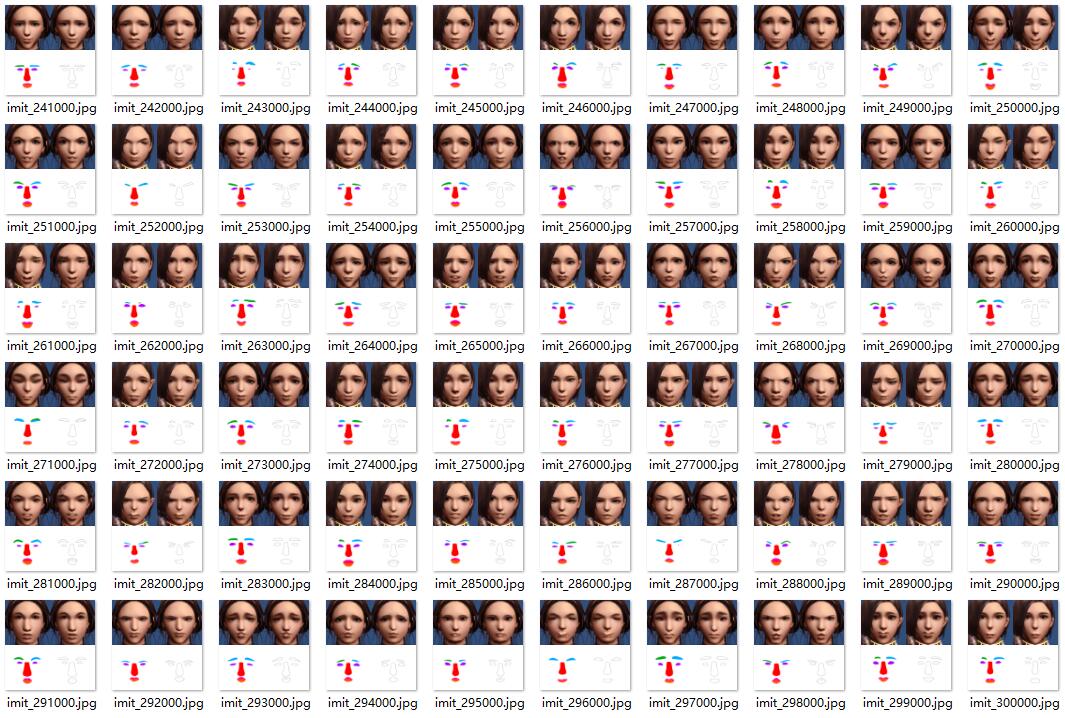

最终训练效果如下图:

(左上角为参考图,右上角为 imitator 生成图,左下角为生成图的人脸语义分割图,右下角为部位边缘图)

恢复训练 reinference

若因意外情况(如断电)中断训练,希望从之前保存的模型恢复训练,可先将 model 目录下的模型文件复制到 reinference 目录,然后执行以下命令:

python3 main.py \

--phase=inference_imitator \

--total_steps=30000 \

--path_to_dataset="../export/trainset_female/" \

--imitator_model="model_imitator_100000.pth"

imitator 预训练模型:

https://pan.baidu.com/s/1qDRPAzn3m9VxX2Z-oENBWQ

训练效果参考视频:

https://www.bilibili.com/video/av76020308/

效果预览 preview

生成捏脸参数二进制文件:

python3 main.py \

--phase=evaluate \

--total_eval_steps=1000 \

--imitator_model="model_imitator_100000.pth" \

--eval_image='../export/testset_female/db_0000_4.jpg'

运行脚本后,将在 output/eval 目录生成 eval.bytes 文件。随后打开 Unity,点击菜单栏 Tools -> SelectModel,即可在引擎中预览效果。

常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。

tesseract

Tesseract 是一款历史悠久且备受推崇的开源光学字符识别(OCR)引擎,最初由惠普实验室开发,后由 Google 维护,目前由全球社区共同贡献。它的核心功能是将图片中的文字转化为可编辑、可搜索的文本数据,有效解决了从扫描件、照片或 PDF 文档中提取文字信息的难题,是数字化归档和信息自动化的重要基础工具。 在技术层面,Tesseract 展现了强大的适应能力。从版本 4 开始,它引入了基于长短期记忆网络(LSTM)的神经网络 OCR 引擎,显著提升了行识别的准确率;同时,为了兼顾旧有需求,它依然支持传统的字符模式识别引擎。Tesseract 原生支持 UTF-8 编码,开箱即用即可识别超过 100 种语言,并兼容 PNG、JPEG、TIFF 等多种常见图像格式。输出方面,它灵活支持纯文本、hOCR、PDF、TSV 等多种格式,方便后续数据处理。 Tesseract 主要面向开发者、研究人员以及需要构建文档处理流程的企业用户。由于它本身是一个命令行工具和库(libtesseract),不包含图形用户界面(GUI),因此最适合具备一定编程能力的技术人员集成到自动化脚本或应用程序中