Awesome-LLM-Strawberry

Awesome-LLM-Strawberry 是一个专注于大语言模型推理能力的开源资源合集,核心围绕 OpenAI o1(代号 Strawberry)及各类前沿推理技术展开。它系统性地整理了相关的学术论文、技术博客、官方文档以及复现项目,旨在帮助从业者快速掌握从基础理论到最新架构突破的全貌。

面对大模型领域推理技术迭代极快、信息分散且难以追踪的痛点,Awesome-LLM-Strawberry 提供了持续更新的“一站式”导航。它不仅收录了 OpenAI 关于 o1、o3 系列的官方解读,还涵盖了 Google DeepMind、DeepSeek、月之暗面等机构在推理模型上的最新进展,甚至包括对 o1 架构的深度逆向工程分析和强化学习训练技巧探讨。

该资源库特别适合 AI 研究人员、算法工程师以及对大模型底层机制感兴趣的开发者使用。无论是希望复现 o1 推理能力的团队,还是想要了解“思维链”、“过程监督”等独特技术亮点的学者,都能从中找到高价值的参考依据。通过汇聚全球顶尖的智慧成果,Awesome-LLM-Strawberry 成为了探索下一代具备深度思考能力 AI 系统的重要窗口。

使用场景

某 AI 初创公司的算法团队正致力于复现 OpenAI o1 的推理能力,以构建垂直领域的复杂问题解决模型。

没有 Awesome-LLM-Strawberry 时

- 信息搜集效率低下:研究人员需手动在 arXiv、Twitter 和技术博客间穿梭,耗费数天才能拼凑出关于"o1 架构”或“强化学习验证(RLVR)”的零散资讯。

- 错过关键前沿动态:由于缺乏统一追踪源,团队容易遗漏如 DeepSeek-R1、Kimi k1 等竞品发布的最新推理技术细节,导致技术路线滞后。

- 理论复现门槛高:面对晦涩的论文和缺失的代码实现参考,工程师难以快速理解从“监督结果”转向“监督过程”的核心训练范式,试错成本极高。

- 资源分散难整合:官方文档、深度分析文章与开源项目分散各处,缺乏系统性整理,阻碍了团队对推理缩放定律(Inference Scaling Laws)的整体认知。

使用 Awesome-LLM-Strawberry 后

- 一站式获取前沿情报:团队直接通过该仓库即可获取涵盖 OpenAI o3、Gemini 2.0 Flash Thinking 及国内大模型的最新推理进展,将调研时间从数天压缩至数小时。

- 精准锁定核心技术路径:借助仓库中精选的"REINFORCE++ baseline"、"Online IcePop"等技术博客,工程师迅速掌握了稳定 MoE 路由与高效推理训练的关键方法。

- 加速模型复现进程:依托整理的 o1 逆向工程分析与 ARC-AGI 评测突破案例,团队快速构建了基于“过程监督”的实验框架,显著减少了盲目尝试。

- 构建系统化知识体系:从官方指南到社区深度解读,所有资源按逻辑分类,帮助团队成员快速对齐对推理机制的理解,提升了协作效率。

Awesome-LLM-Strawberry 将碎片化的推理技术情报转化为系统化的研发燃料,让团队在激烈的模型竞赛中抢占先机。

运行环境要求

未说明

未说明

快速开始

令人惊叹的LLM草莓(OpenAI o1)

这是一个关于OpenAI草莓(o1)及推理能力的研究论文与博客合集。

该仓库将持续更新,以追踪LLM推理领域的前沿进展。

OpenAI官方文档

新闻

- [OpenAI] 推出深度研究

- [OpenAI] o3预览版与o3 mini

- [OpenAI] 推出ChatGPT Pro

- [Google DeepMind] Gemini 2.0闪电思维

- [Ilya Sutskever] 具备推理能力的AI将更难预测

- [SemianAlysis] 规模法则——O1 Pro架构、推理训练基础设施、Orion以及Claude 3.5 Opus的“失败”

- [DeepSeek] DeepSeek-R1-Lite预览版现已上线:释放超强推理能力!

- [Moonshoot] 数学对标o1系列,搜索再次进化,Kimi 新推理模型与你一起拓展智能边界

- [Moonshoot] Kimi 发布视觉思考模型 k1,多项理科测试行业领先

- [InternLM] 强推理模型书生InternThinker开放体验:自主生成高智力密度数据、具备元动作思考能力

- [新智元] 万字独家爆光,首揭o1 pro架构!惊人反转,Claude 3.5 Opus没失败?

博客

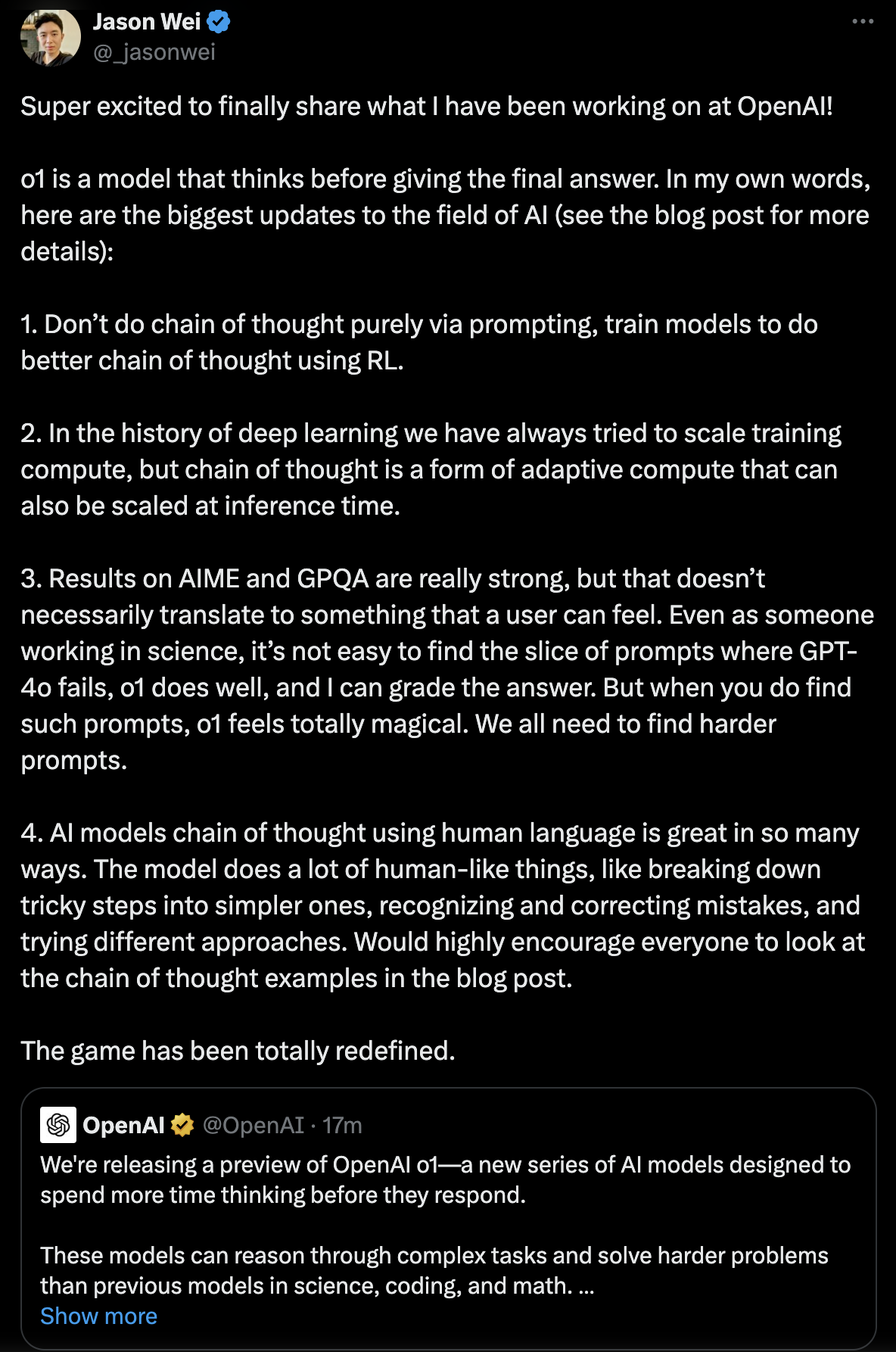

- [OpenAI] 学习如何用LLM进行推理

- [OpenAI] OpenAI o1-mini推动低成本高效推理

- [OpenAI] 用GPT-4找出GPT-4的错误

- [ARC-AGI] OpenAI o3在ARC-AGI-Pub上取得突破性高分

- [Anthropic] 构建高效智能体

- [hijkzzz] 无需路由器重放即可稳定MoE RL:在线IcePop解决方案

- [hijkzzz] 在RLVR中,REINFORCE++基准线就足够了

- [hijkzzz] 探索OpenAI O1模型的复现

- [Nathan Lambert] OpenAI的草莓、语言模型自我对话、推理规模法则以及更多推理成本

- [Nathan Lambert] 逆向工程OpenAI的o1

- [Andreas Stuhlmüller, jungofthewon] 监督过程,而非结果

- [Nouha Dziri] O1模型是否已经破解了人类的推理能力?

- [Rishabh Agarwal] 利用自动生成的数据改进LLM推理:强化学习与验证器

- [Wei Shen] RLHF中的泛化进展:奖励模型和PPO的影响洞察

- [Dominater069] Codeforces - 分析O1-Mini到底有多好

- [Tibor Blaho] 总结我们在与OpenAI o1团队AMA一小时中所学到的内容

演讲

- [Noam Brown] 关于AI规划力量的寓言:从扑克到外交

- [Noam Brown] OpenAI o1与如何教会LLM更好地进行推理

- [Hyung Won Chung] 不要教导,要激励

课程

- [DeepLearning.AI] 使用o1进行推理

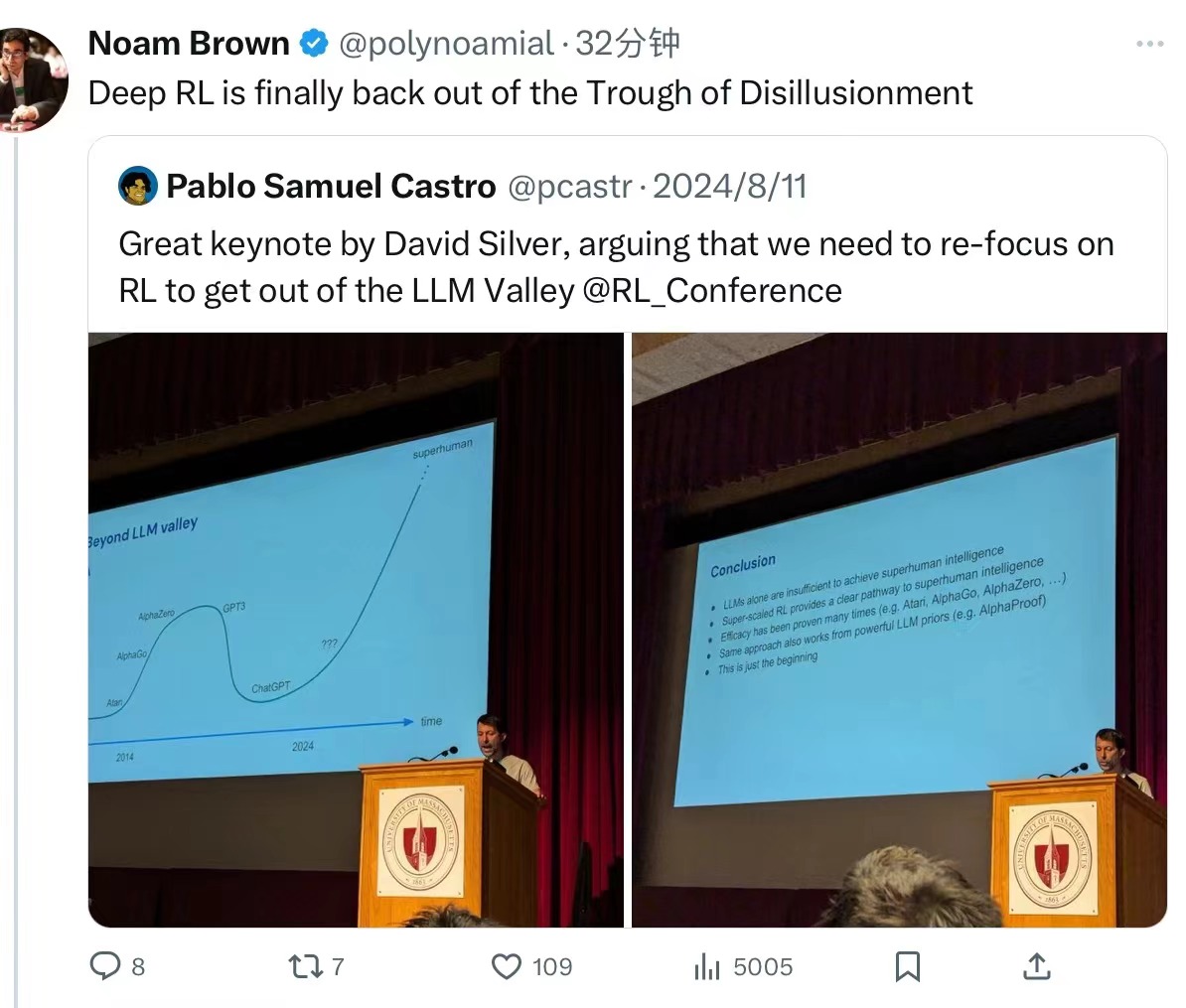

Noam Brown

Jason Wei

其他

开源项目

模型

- [阿里巴巴通义实验室] Qwen3

- [阿里巴巴通义实验室] QwQ

- [阿里巴巴通义实验室] QvQ

- [DeepSeek] DeepSeek R1

- [NVIDIA] Nemotron-Research-Reasoning-Qwen-1.5B

- [Skywork] Skywork R1V2

- [rLLM] DeepScaler

- [NovaSky] Sky-T1

- [GAIR-NLP] O1 复现之旅:战略进展报告

- [OpenO1 团队] 开源 O1

- [腾讯] DRT-o1

- [阿里巴巴] Marco-o1

- [香港中文大学深圳分校] HuatuoGPT-o1

代码库

- [OpenRLHF 团队] OpenRLHF

- [OpenRLHF 团队] REINFORCE++ | REINFORCE++ 基线 | 代码

- [NovaSky-AI] SkyRL

- [RUCAIBox] STILL:使用 LLM 进行慢思考

- [香港科技大学] 用于推理的简单强化学习

- 这是对 DeepSeek-R1-Zero 的复现,以及在小模型上用有限数据训练 DeepSeek-R1 的过程。

- [Ubiquant] Logic-RL:基于规则的强化学习释放 LLM 推理能力

- [StepFun] Open-Reasoner-Zero

- [TideDra] LMM-R1

- [ModalMinds] MM-EUREKA:通过大规模规则强化学习探索视觉顿悟时刻

- [R1-V 团队] R1-V

- [LLaMA-Factory 团队] EasyR1:高效、可扩展、多模态的 RL 训练框架

- [阿里巴巴] ROLL | 论文

- [Sea AI Lab] Dr. GRPO

- [伯克利人工智能研究组] TinyZero

- [Maitrix.org] LLM 推理器

论文

格式:

- [标题](论文链接) [链接]

- 作者1、作者2、作者3…

- 出版社

- 代码

- 实验环境和数据集

关于 o1 模型的技术报告

- INTELLECT-3:技术报告

- Prime Intellect 团队

- DeepSeek V3.2

- DeepSeek AI

- MiMo-V2 Flash

- 小米

- Nemotron 3 Nano:面向代理式推理的开放、高效的混合专家混合 Mamba-Transformer 模型

- NVIDIA

- Qwen3 技术报告

- 通义实验室

- 通过持续预训练扩展智能体

- 通义实验室

- WebResearcher:释放长时程智能体的无限推理能力

- 通义实验室

- 通过环境扩展迈向通用代理智能

- 通义实验室

- Magistral

- Mistral AI

- ERINE-4.5

- 百度

- LongCat Flash

- 美团

- GLM-4.5:代理式、推理与编程(ARC)基础模型

- 之普 AI

- Seed Thinking v1.5

- 字节跳动 Seed

- DeepSeek-V3 技术报告

- DeepSeek

- DeepSeek-R1:通过强化学习激励 LLM 的推理能力

- DeepSeek AI

- DeepSeek-Prover-V2:通过强化学习进行子目标分解以推进形式数学推理

- DeepSeek AI

- MiniMax-M1:利用闪电注意力高效扩展推理时计算能力

- MiniMax

- Kimi k2:开放的代理智能

- MoonShot

- Kimi k1.5:用 LLM 扩展强化学习

- MoonShot

- KIMI-VL 技术报告

- MoonShot

- Kimina-Prover 预览:迈向大型形式推理模型的强化学习

- MoonShot 和 Numina

- Llama-Nemotron:高效推理模型

- NVIDIA

- Skywork Open Reasoner 1 技术报告

- Skywork

2025年

- Nemotron-Cascade:面向通用推理模型的级联强化学习扩展

- 英伟达

- QwenLong-L1.5:长上下文推理与记忆的后训练配方

- 通义实验室团队

- DeepSeekMath-V2:迈向自我验证的数学推理

- DeepSeek-AI

- 利用大语言模型稳定强化学习:方法与实践

- 通义实验室团队

- 为大语言模型扩展强化学习计算资源的艺术

- Devvrit Khatri、Lovish Madaan、Rishabh Tiwari、Rachit Bansal、Sai Surya Duvvuri、Manzil Zaheer、Inderjit S. Dhillon、David Brandfonbrener、Rishabh Agarwal

- BroRL:通过拓宽探索范围实现强化学习规模化

- 刘健、刘明杰、卢希明、吴芳、扎伊德·哈尔乔伊、刁世哲、崔艺珍、帕夫洛·莫尔恰诺夫、杨俊、扬·考茨、董毅

- 为什么语言模型会出现幻觉

- OpenAI

- rStar2-Agent:代理式推理技术报告

- 尚宁、刘一飞、朱毅、张丽琳娜、徐伟江、关鑫宇、张步泽、董炳成、周旭东、张博文、辛颖、苗子明、李斯嘉、杨帆、杨茂

- 强化学习既非万能药,也非海市蜃楼:理解大语言模型的监督学习与强化学习微调

- 金航展、思诚、吴思凡、穆罕默德·哈姆达卡

- DuPO:通过双重偏好优化实现可靠的大语言模型自我验证

- 佘帅杰、鲍宇、陆宇、许陆、李涛、朱文浩、黄树坚、程善博、陆陆、王宇轩

- 多采样以减少思考:用于简洁推理的分组过滤策略优化

- 施里瓦斯塔瓦、阿瓦达拉、巴拉昌德兰、加格、贝赫尔、帕派伊利奥普洛斯

- ProRL V2——长期训练验证强化学习缩放定律

- 刘健、刘明杰、刁世哲、卢希明、董欣、帕夫洛·莫尔恰诺夫、崔艺珍、扬·考茨、董毅

- 第一部分:技巧还是陷阱?深入探讨用于大语言模型推理的强化学习

- 刘子赫、刘家顺、何燕城、王伟勋、刘嘉恒、潘玲、胡鑫宇、熊绍攀、黄巨、刘健、黄圣义、杨思然、王佳芒、苏文博、郑博

- 分组序列策略优化

- 郑楚杰、刘世轩、李明泽、陈雄辉、于博文、高昌、邓凯、刘玉琼、门锐、杨安、周京仁、林俊阳

- 你的高效强化学习框架正悄悄为你带来离策略强化学习训练

- 姚峰、刘立源、张定怀、董承宇、尚景波、高建峰

- Gemini 2.5 Pro 有望在2025年国际数学奥林匹克竞赛中夺冠

- 黄一辰、杨林福

- DeepSWE:通过强化学习规模化训练一个完全开源的最先进编码代理

- together.ai

- OctoThinker:中期激励推动强化学习规模化

- 王增志、周凡、李雪峰、刘鹏飞

- ProRL:长期强化学习拓展大型语言模型的推理边界

- 刘明杰、刁世哲、卢希明、刘健、董欣、崔艺珍、扬·考茨、董毅

- REINFORCE++:一种高效的RLHF算法,对提示和奖励模型均具有鲁棒性

- 刘健、刘杰森·克莱因、沈伟

- 代码:REINFORCE++-baseline

- 超越80/20法则:高熵少数标记驱动大语言模型推理的有效强化学习

- 通义实验室团队

- 负强化在大语言模型推理中的惊人效果

- 朱新宇、夏孟州、魏哲沛、陈伟林、陈丹琪、孟宇

- 借助生成图像进行思考

- 切恩·伊森、胡竹林、切恩·斯特菲、寇思琪、苏嘉迪、马彦、邓志杰、刘鹏飞

- 像素推理者:以好奇心驱动的强化学习激励像素空间推理

- 苏亚历克斯、王浩哲、任伟明、林方振、陈文虎

- DeepEyes:通过强化学习激励“用图像思考”

- 郑子威、杨迈克尔、洪杰克、赵晨晓、徐国海、杨乐、申超、于兴

- 让视觉拥有推理能力:通过模型融合理解感知与推理

- 陈诗琪、张静涵、朱彤瑶、刘伟、高思洋、熊淼、李曼玲、何俊贤

- QwenLong-L1:借助强化学习迈向长上下文大型推理模型

- 万凡奇、沈伟洲、廖圣义、施英成、李晨亮、杨子怡、张继、黄飞、周京仁、严明

- 代理强化学习缩放定律:具备自发代码执行能力的代理强化学习用于解数学题

- 麦新吉、徐浩天、W星、王伟农、张莹莹、张文强

- 代码:https://github.com/yyht/openrlhf_async_pipline

- 大语言模型推理的极简主义方法:从拒绝采样到Reinforce

- 熊伟、姚家睿、徐雨慧、庞博、王雷、萨霍伊院长、李俊楠、蒋楠、张同、熊才明、董汉泽

- 仅需一次训练样本即可实现大型语言模型的推理强化学习

- 王一平、杨青、曾志远、任利昂、刘卢卡斯、彭宝林、程浩、何学海、王宽、高建峰、陈伟珠、王书航、杜思明、沈业龙

- 能够思考的过程奖励模型

- 哈利法、阿加瓦尔、洛格斯瓦兰、金在谦、彭浩、李蒙泰、李洪洛克、王陆

- M1:迈向可扩展的测试时计算,采用Mamba推理模型

- 王俊雄、李文丁、帕利奥塔、里特尔、拉什、陶三

- 对语言模型推理进展的清醒审视:陷阱与可重复性的路径

- 霍赫莱纳特、巴特纳加尔、乌丹达劳、阿尔巴尼、普拉布、贝特格

- 通过强化学习实现简洁推理

- 法特米、拉菲、唐明杰、塔拉马杜普拉

- VAPO:高效且可靠的强化学习,适用于高级推理任务

- 余悦、袁玉凤、俞启英、左晓晨、朱若飞、徐文渊、陈家泽、王承义、范甜甜、杜正印、魏向鹏、刘高宏、刘俊才、刘玲君、林海斌、林志奇、马伯乐等

- 通用奖励模型的推理时间缩放

- 刘子俊、王佩仪、徐润欣、马士荣、阮冲、李鹏、刘洋、吴宇

- JudgeLRM:将大型推理模型作为裁判

- 陈诺、胡志远、邹清云、吴佳颖、王茜、胡布莱恩、何炳生

- DAPO:大规模开源的大语言模型强化学习系统

- 俞启英、张正、朱若飞、袁玉凤、左晓晨、余悦、范甜甜、刘高宏、刘玲君、刘欣、林海斌等

- 利用潜在推理扩展测试时计算:递归深度方法

- 盖平、麦克莱什、贾因、基尔亨鲍尔、辛格、巴托尔德森、凯尔库拉、巴特勒、戈德斯坦

- 通过元强化微调优化测试时计算

- 曲宇晓、杨马修、塞特卢尔、坦斯托尔、比钦、萨拉胡丁诺夫、库马尔

- R1-Searcher:通过强化学习激励大语言模型的搜索能力

- 宋华通、姜金浩、闵英倩、陈杰、陈志鹏、赵韦恩新、方雷、温继荣

- Visual-RFT:视觉强化微调

- 刘子宇、孙泽依、臧宇航、董晓依、曹宇航、段浩东、林大华、王佳琪

- 将视觉感知标记引入多模态大型语言模型

- 于润鹏、马新寅、王新超

- 不进行验证或强化学习而扩展测试时计算是次优的

- 塞特卢尔、拉贾拉曼、列维、库马尔

- 大语言模型可以轻松地从演示中学会推理:重要的是结构,而非内容!

- 李大成、曹世义、格里格斯、刘舒、莫湘溪、帕蒂尔、扎哈里亚、冈萨雷斯、斯托伊卡

- 揭秘大语言模型中的长链式思维推理

- 叶欧德、童宇轩、牛莫瑞、纽比格、岳翔

- LIMR:更少反而更多,适用于强化学习缩放

- 李雪峰、邹浩洋、刘鹏飞

- LIMO:更少反而更多,适用于推理

- 叶新怡、黄震、肖杨、切恩·伊森、夏世杰、刘鹏飞

- s1:简单的测试时缩放

- 缪尼霍夫、杨子彤、史伟佳、李香丽莎、费费·李、哈吉希尔齐、泽特洛伊默、梁珀西、坎德斯、桥本达津诺里

- SFT记住细节,RL则泛化:基础模型后训练的比较研究

- 楚天哲、翟月祥、杨纪韩、佟盛邦、谢赛宁、舒尔曼斯、黎光越、列维、马毅

- 通过强化学习和推理缩放推进语言模型推理

- 侯振宇、吕欣、陆锐、张佳杰、李宇江、姚子俊、李娟子、唐杰、董宇晓

- Satori:基于行动—思维链的强化学习,通过自回归搜索增强大语言模型的推理能力

- 沈茂浩、曾广涛、齐振廷、洪章伟、陈真芳、魏陆、沃内尔、达斯、考克斯、甘创

- 大型语言模型的蒸馏量化

- 李孙博文、周俊婷、敖超等

- rStar-Math:小型大语言模型可通过自我进化式深度思考掌握数学推理

- 关鑫宇、张丽琳娜、刘一飞、尚宁、孙友然、朱毅、杨帆、杨茂

- 进化更深层次的大语言模型思维

- 李匡辉、费舍尔、吴岳华、马伍德、巴鲁贾、舒尔曼斯、陈新云

- 在数学推理中开发过程奖励模型的经验教训

- 张振儒、郑楚杰、吴阳镇、张培臣、林润基、于博文、刘大亨、周京仁、林俊阳

- 迈向大语言模型中的系统2式推理:学习如何用元思维链思考

- 谢向薇、斯奈尔、甘地、阿尔巴拉克、辛格、布拉格登、冯杜、拉斐尔、莱尔、马汉、卡斯特里卡托、弗兰肯、哈伯、芬恩

- PRMBENCH:针对过程级奖励模型的细粒度且具有挑战性的基准测试

- 宋明阳、苏兆晨、曲晓叶、周嘉伟、程宇

- Virgo:关于复现o1类MLLM的初步探索

- 杜一凡、刘子康、李一凡、赵韦恩新、霍宇琪、王炳宁、陈伟鹏、刘郑、王中原、温继荣

- 在思考空间中想象:多模态思维可视化

- 李成祖、吴文山、张焕宇、夏燕、毛绍光、李东、武利奇、魏富

- LlamaV-o1:重新思考大语言模型中的逐步视觉推理

- 塔瓦卡尔、迪桑纳亚克、莫雷、索卡尔、希克尔、阿赫桑、李宇豪、祖姆里、拉胡德、安维尔、乔拉卡尔、拉普捷夫、沙赫、汗、汗

2024年

- 审慎对齐:推理使语言模型更安全

- OpenAI

- MLE-bench:在机器学习工程领域评估机器学习智能体

- Jun Shern Chan、Neil Chowdhury、Oliver Jaffe、James Aung、Dane Sherburn、Evan Mays、Giulio Starace、Kevin Liu、Leon Maksin、Tejal Patwardhan、Lilian Weng、Aleksander Mądry

- 从Medprompt到o1:医疗挑战问题及其他场景下的运行时策略探索

- Scott McKinney

- LLM批评者助力捕捉LLM中的缺陷

- Nat McAleese、Rai Michael Pokorny、Juan Felipe Ceron Uribe、Evgenia Nitishinskaya、Maja Trebacz、Jan Leike

- 通过强化学习将大型视觉—语言模型微调为决策智能体

- Yuexiang Zhai、Hao Bai、Zipeng Lin、Jiayi Pan、Shengbang Tong、Yifei Zhou、Alane Suhr、Saining Xie、Yann LeCun、Yi Ma、Sergey Levine

- ZoomEye:通过基于树的图像探索增强多模态LLM的人类式缩放能力

- Haozhan Shen、Kangjia Zhao、Tiancheng Zhao、Ruochen Xu、Zilun Zhang、Mingwei Zhu、Jianwei Yin

- 分而治之再合并:一种无需训练的框架,用于提升多模态大型语言模型的高分辨率图像感知能力

- Wenbin Wang、Liang Ding、Minyan Zeng、Xiabin Zhou、Li Shen、Yong Luo、Dacheng Tao

- 在LLM测试时以最优方式扩展计算资源,可能比单纯扩大模型参数更为有效

- Charlie Snell、Jaehoon Lee、Kelvin Xu、Aviral Kumar

- 针对语言模型解决问题时计算最优推理的实证分析

- Yangzhen Wu、Zhiqing Sun、Shanda Li、Sean Welleck、Yiming Yang

- 更小、更弱却更好:通过计算最优采样训练LLM推理模型

- Hritik Bansal、Arian Hosseini、Rishabh Agarwal、Vinh Q. Tran、Mehran Kazemi

- 大型语言猴子:利用重复采样扩展推理计算能力

- Bradley Brown、Jordan Juravsky、Ryan Ehrlich、Ronald Clark、Quoc V. Le、Christopher Ré、Azalia Mirhoseini

- 模仿、探索与自我改进:慢思考推理系统的复现报告

- Yingqian Min、Zhipeng Chen、Jinhao Jiang、Jie Chen、Jia Deng、Yiwen Hu、Yiru Tang、Jiapeng Wang、Xiaoxue Cheng、Huatong Song、Wayne Xin Zhao、Zheng Liu、Zhongyuan Wang、Ji-Rong Wen

- 通过强化学习训练语言模型进行自我修正

- Aviral Kumar、Vincent Zhuang、Rishabh Agarwal、Yi Su、John D Co-Reyes、Avi Singh、Kate Baumli、Shariq Iqbal、Colton Bishop、Rebecca Roelofs、Lei M Zhang、Kay McKinney、Disha Shrivastava、Cosmin Paduraru、George Tucker、Doina Precup、Feryal Behbahani、Aleksandra Faust

- 对于2+3=?这样的简单问题,请不要过度思考——关于o1类LLM的过度思考问题

- Xingyu Chen、Jiahao Xu、Tian Liang、Zhiwei He、Jianhui Pang、Dian Yu、Linfeng Song、Qiuzhi Liu、Mengfei Zhou、Zhuosheng Zhang、Rui Wang、Zhaopeng Tu、Haitao Mi、Dong Yu

- MEDEC:临床笔记中医学错误检测与纠正的基准测试

- Asma Ben Abacha、Wen-wai Yim、Yujuan Fu、Zhaoyi Sun、Meliha Yetisgen、Fei Xia、Thomas Lin

- Qwen2.5-Math技术报告:通过自我改进迈向数学专家模型

- An Yang、Beichen Zhang、Binyuan Hui、Bofei Gao、Bowen Yu、Chengpeng Li、Dayiheng Liu、Jianhong Tu、Jingren Zhou、Junyang Lin、Keming Lu、Mingfeng Xue、Runji Lin、Tianyu Liu、Xingzhang Ren、Zhenru Zhang

- RLHF能规模化吗?数据、模型和方法的影响探究

- Zhenyu Hou、Pengfan Du、Yilin Niu、Zhengxiao Du、Aohan Zeng、Xiao Liu、Minlie Huang、Hongning Wang、Jie Tang、Yuxiao Dong

- 搜索、验证与反馈:通过验证器工程迈向基础模型的下一代后训练范式

- Xinyan Guan、Yanjiang Liu、Xinyu Lu、Boxi Cao、Ben He、Xianpei Han、Le Sun、Jie Lou、Bowen Yu、Yaojie Lu、Hongyu Lin

- 搜索与学习的规模化:从强化学习视角复现o1的路线图

- Zhiyuan Zeng、Qinyuan Cheng、Zhangyue Yin、Bo Wang、Shimin Li、Yunhua Zhou、Qipeng Guo、Xuanjing Huang、Xipeng Qiu

- Quiet-STaR:语言模型可以教会自己先思考再说话

- Eric Zelikman、Georges Harik、Yijia Shao、Varuna Jayasiri、Nick Haber、Noah D. Goodman

- https://github.com/ezelikman/quiet-star

- 通过带有测试时和训练时监督的批评模型提升LLM推理能力

- Zhiheng Xi、Dingwen Yang、Jixuan Huang、Jiafu Tang、Guanyu Li、Yiwen Ding、Wei He、Boyang Hong、Shihan Do、Wenyu Zhan、Xiao Wang、Rui Zheng、Tao Ji、Xiaowei Shi、Yitao Zhai、Rongxiang Weng、Jingang Wang、Xunliang Cai、Tao Gui、Zuxuan Wu、Qi Zhang、Xipeng Qiu、Xuanjing Huang、Yu-Gang Jiang

- https://mathcritique.github.io/

- 关于为LLM推理设计有效的训练时RL奖励

- Jiaxuan Gao、Shusheng Xu、Wenjie Ye、Weilin Liu、Chuyi He、Wei Fu、Zhiyu Mei、Guangju Wang、Yi Wu

- 生成式验证器:将奖励建模视为下一个标记预测

- Lunjun Zhang、Arian Hosseini、Hritik Bansal、Mehran Kazemi、Aviral Kumar、Rishabh Agarwal

- 奖励进展:为LLM推理扩展自动化流程验证器

- Amrith Setlur、Chirag Nagpal、Adam Fisch、Xinyang Geng、Jacob Eisenstein、Rishabh Agarwal、Alekh Agarwal、Jonathan Berant、Aviral Kumar

- 通过自动化流程监督提升语言模型的数学推理能力

- Liangchen Luo、Yinxiao Liu、Rosanne Liu、Samrat Phatale、Harsh Lara、Yunxuan Li、Lei Shu、Yun Zhu、Lei Meng、Jiao Sun、Abhinav Rastogi

- Math-Shepherd:无需人工标注,逐步验证并强化LLM

- Peiyi Wang、Lei Li、Zhihong Shao、R.X. Xu、Damai Dai、Yifei Li、Deli Chen、Y.Wu、Zhifang Sui

- 自然语言规划提升LLM代码生成搜索能力

- Evan Wang、Federico Cassano、Catherine Wu、Yunfeng Bai、Will Song、Vaskar Nath、Ziwen Han、Sean Hendryx、Summer Yue、Hugh Zhang

- PROCESSBENCH:识别数学推理中的过程性错误

- Chujie Zheng、Zhenru Zhang、Beichen Zhang、Runji Lin、Keming Lu、Bowen Yu、Dayiheng Liu、Jingren Zhou、Junyang Lin

- AFlow:自动化代理式工作流生成

- Jiayi Zhang、Jinyu Xiang、Zhaoyang Yu、Fengwei Teng、Xionghui Chen、Jiaqi Chen、Mingchen Zhuge、Xin Cheng、Sirui Hong、Jinlin Wang、Bingnan Zheng、Bang Liu、Yuyu Luo、Chenglin Wu

- 可解释的对比蒙特卡洛树搜索推理

- Zitian Gao、Boye Niu、Xuzheng He、Haotian Xu、Hongzhang Liu、Aiwei Liu、Xuming Hu、Lijie Wen

- Agent Q:面向自主AI智能体的高级推理与学习

- Pranav Putta、Edmund Mills、Naman Garg、Sumeet Motwani、Chelsea Finn、Divyansh Garg、Rafael Rafailov

- 混合代理增强大型语言模型能力

- Junlin Wang、Jue Wang、Ben Athiwaratkun、Ce Zhang、James Zou

- 思维的不确定性:基于不确定性的规划提升大型语言模型的信息获取能力

- Zhiyuan Hu、Chumin Liu、Xidong Feng、Yilun Zhao、See-Kiong Ng、Anh Tuan Luu、Junxian He、Pang Wei Koh、Bryan Hooi

- 借助偏好树推进LLM通用型推理

- Lifan Yuan、Ganqu Cui、Hanbin Wang、Ning Ding、Xingyao Wang、Jia Deng、Boji Shan等

- 通过想象、搜索和批评实现LLM的自我改进

- Ye Tian、Baolin Peng、Linfeng Song、Lifeng Jin、Dian Yu、Haitao Mi和Dong Yu。

- AlphaMath几乎为零:无流程的流程监督

- Guoxin Chen、Minpeng Liao、Chengxi Li、Kai Fan。

- ReST-MCTS*:通过流程奖励引导的树搜索实现LLM自我训练

- Dan Zhang、Sining Zhoubian、Yisong Yue、Yuxiao Dong和Jie Tang。

- Mulberry:借助集体蒙特卡洛树搜索赋予MLLM类似o1的推理与反思能力

- Huanjin Yao、Jiaxing Huang、Wenhao Wu、Jingyi Zhang、Yibo Wang、Shunyu Liu、Yingjie Wang、Yuxin Song、Haocheng Feng、Li Shen、Dacheng Tao

- Insight-V:利用多模态大型语言模型探索长链视觉推理

- Yuhao Dong、Zuyan Liu、Hai-Long Sun、Jingkang Yang、Winston Hu、Yongming Rao、Ziwei Liu

- MindStar:在推理阶段增强预训练LLM的数学推理能力

- Jikun Kang、Xin Zhe Li、Xi Chen、Amirreza Kazemi、Qianyi Sun、Boxing Chen、Dong Li、Xu He、Quan He、Feng Wen、Jianye Hao、Jun Yao。

- 蒙特卡洛树搜索通过迭代偏好学习提升推理能力

- Yuxi Xie、Anirudh Goyal、Wenyue Zheng、Min-Yen Kan、Timothy P. Lillicrap、Kenji Kawaguchi、Michael Shieh。

- 何时树搜索对LLM规划有用?这取决于判别器

- Ziru Chen、Michael White、Raymond Mooney、Ali Payani、Yu Su、Huan Sun

- 思维链使Transformer能够解决本质上串行的问题

- Zhiyuan Li、Hong Liu、Denny Zhou、Tengyu Ma。

- 是否使用思维链?思维链主要有助于数学和符号推理

- Zayne Sprague、Fangcong Yin、Juan Diego Rodriguez、Dongwei Jiang、Manya Wadhwa、Prasann Singhal、Xinyu Zhao、Xi Ye、Kyle Mahowald、Greg Durrett

- 大型语言模型是否会潜在地进行多跳推理?

- Sohee Yang、Elena Gribovskaya、Nora Kassner、Mor Geva、Sebastian Riedel

- 无需提示的思维链推理

- Xuezhi Wang、Denny Zhou

- 相互推理使小型LLM成为更强大的问题解决者

- Zhenting Qi、Mingyuan Ma、Jiahang Xu、Li Lyna Zhang、Fan Yang、Mao Yang

- 偏好优化链:改进LLM中的思维链推理

- Xuan Zhang、Chao Du、Tianyu Pang、Qian Liu、Wei Gao、Min Lin

- ReFT:通过强化微调进行推理

- Trung Quoc Luong、Xinbo Zhang、Zhanming Jie、Peng Sun、Xiaoran Jin、Hang Li

- VinePPO:通过精细化信用分配释放LLM推理的RL潜力

- Amirhossein Kazemnejad、Milad Aghajohari、Eva Portelance、Alessandro Sordoni、Siva Reddy、Aaron Courville、Nicolas Le Roux

- 搜索流(SoS):学习如何在语言中进行搜索

- Kanishk Gandhi、Denise Lee、Gabriel Grand、Muxin Liu、Winson Cheng、Archit Sharma、Noah D. Goodman

- GSM-符号:理解大型语言模型数学推理的局限性

- Iman Mirzadeh、Keivan Alizadeh、Hooman Shahrokhi、Oncel Tuzel、Samy Bengio、Mehrdad Farajtabar

- OpenAI o1的评估:AGI的机遇与挑战

- Tianyang Zhong、Zhengliang Liu、Yi Pan、Yutong Zhang、Yifan Zhou、Shizhe Liang、Zihao Wu、Yanjun Lyu、Peng Shu、Xiaowei Yu、Chao Cao、Hanqi Jiang、Hanxu Chen、Yiwei Li、Junhao Chen等

- 评估LLM检测自身响应中错误的能力

- Ryo Kamoi、Sarkar Snigdha Sarathi Das、Renze Lou、Jihyun Janice Ahn、Yilun Zhao、Xiaoxin Lu、Nan Zhang、Yusen Zhang、Ranran Haoran Zhang、Sujeeth Reddy Vummanthala、Salika Dave、Shaobo Qin、Arman Cohan、Wenpeng Yin、Rui Zhang

- 关于OpenAI的o1模型的规划能力:可行性、最优性和泛化能力

- Kevin Wang、Junbo Li、Neel P. Bhatt、Yihan Xi、Qiang Liu、Ufuk Topcu、Zhangyang Wang

- 并非所有LLM推理者都生而平等

- Arian Hosseini、Alessandro Sordoni、Daniel Toyama、Aaron Courville、Rishabh Agarwal

- LLM仍然无法规划;LRM呢?对OpenAI的o1在PlanBench上的初步评估

- Karthik Valmeekam、Kaya Stechly、Subbarao Kambhampati

- OpenAI的o1模型推理模式比较研究

- Siwei Wu、Zhongyuan Peng、Xinrun Du、Tuney Zheng、Minghao Liu、Jialong Wu、Jiachen Ma、Yizhi Li、Jian Yang、Wangchunshu Zhou、Qunshu Lin、Junbo Zhao、Zhaoxiang Zhang、Wenhao Huang、Ge Zhang、Chenghua Lin、J.H. Liu

- 思考型LLM:结合思维生成的通用指令遵循

- Tianhao Wu、Janice Lan、Weizhe Yuan、Jiantao Jiao、Jason Weston、Sainbayar Sukhbaatar

- 通过陷阱问题探索大型语言模型在数学推理中的组合性不足

- Jun Zhao、Jingqi Tong、Yurong Mou、Ming Zhang、Qi Zhang、Xuanjing Huang

- V-STaR:为自学型推理者培训验证器

- Arian Hosseini、Xingdi Yuan、Nikolay Malkin、Aaron Courville、Alessandro Sordoni、Rishabh Agarwal

- CPL:关键计划步骤学习提升LLM在推理任务中的泛化能力

- Tianlong Wang、Junzhe Chen、Xuting Han、Jing Bai

- RLEF:通过强化学习将代码LLM扎根于执行反馈

- Tianhao Wu、Janice Lan、Weizhe Yuan、Jiantao Jiao、Jason Weston、Sainbayar Sukhbaatar

- Q*:通过审慎规划改进LLM的多步推理

- Chaojie Wang、Yanchen Deng、Zhiyi Lyu、Liang Zeng、Jujie He、Shuicheng Yan、Bo An

- 视觉思维链:借助全面的数据集和基准测试推进多模态语言模型的思维链推理

- Hao Shao、Shengju Qian、Han Xiao、Guanglu Song、Zhuofan Zong、Letian Wang、Yu Liu、Hongsheng Li

2023年

- 让我们逐步验证

- Hunter Lightman, Vineet Kosaraju, Yura Burda, Harri Edwards, Bowen Baker, Teddy Lee, Jan Leike, John Schulman, Ilya Sutskever, Karl Cobbe

- V*:引导式视觉搜索作为多模态大语言模型的核心机制

- 吴鹏浩, 谢赛宁

- 通过潜在变量推理训练思维链

- 杜潘, 马修·D·霍夫曼, 大卫·多汉, 肖尔托·道格拉斯, 段安赫, 亚伦·帕里西, 帕维尔·绍佐夫, 查尔斯·萨顿, 沙拉德·维克拉姆, 里夫·A·索罗斯

- 类似AlphaZero的树搜索可以指导大型语言模型的解码和训练

- 冯锡东, 万子宇, 文慕宁, 斯蒂芬·马库斯·麦卡利尔, 温颖, 张伟楠, 王军

- OVM:面向数学推理规划的结果监督价值模型

- 于飞, 高安宁哲, 王本友

- 利用语言模型进行推理就是使用世界模型进行规划

- 郝世博, 顾毅, 马浩迪, 洪家华·乔舒亚, 王振, 王哲·黛西, 胡志廷

- 别丢掉你的价值模型!用价值引导的蒙特卡洛树搜索解码生成更优文本

- 刘、贾成、安德鲁·科恩、拉马克特·帕苏努鲁、叶金·崔、汉娜内·哈吉希尔齐以及阿斯莉·切利基尔马兹。

- 使用语言模型进行可认证的推理

- 加布里埃尔·波西亚、卡尼什克·甘地、埃里克·泽利克曼、诺亚·D·古德曼

- 大型语言模型目前仍无法自我纠正推理

- 黄杰、陈欣云、斯瓦鲁普·米什拉、郑怀秀·史蒂文、余亚当斯·魏、宋欣莹、周登尼

2022年

- 思维链提示在大型语言模型中激发推理能力

- 杰森·韦伊、王雪芝、戴尔·舒尔曼斯、马尔滕·博斯马、布莱恩·伊希特、费伊·夏、埃德·奇、阮国、周登尼

- 自洽性提升语言模型中的思维链推理

- 王雪芝、杰森·韦伊、戴尔·舒尔曼斯、阮国、埃德·奇、沙兰·纳朗、阿坎克莎·乔德里、周登尼

- 用于辅助人类评估者的自我批判模型

- 威廉·桑德斯、凯瑟琳·叶、杰夫·吴、史蒂文·比尔斯、龙·欧扬、乔纳森·沃德、扬·莱克

- 基于程序克隆的思维链模仿

- 杨孟娇、戴尔·舒尔曼斯、皮特·阿贝尔、奥菲尔·纳楚姆

- STaR:以推理启动推理

- 埃里克·泽利克曼、吴宇怀、杰西·穆、诺亚·D·古德曼

- 利用过程与结果反馈解决数学应用题

- 乔纳森·乌萨托、内特·库什曼、拉马纳·库马尔、弗朗西斯·宋、诺亚·西格尔、丽莎·王、安东尼娅·克雷斯威尔、杰弗里·欧文、伊琳娜·希金斯

2021年

- 训练验证器解决数学应用题

- 卡尔·科布、维尼特·科萨拉朱、穆罕默德·巴瓦里安、马克·陈、何伟·俊、卢卡什·凯泽、马蒂亚斯·普拉珀特、杰里·特沃雷克、雅各布·希尔顿、赖一郎·中野、克里斯托弗·赫塞、约翰·舒尔曼

- 通过强化学习微调实现可扩展的在线规划

- 阿诺·菲金格、恒元·胡、布兰登·阿莫斯、斯图尔特·拉塞尔、诺姆·布朗

- 用棋类游戏扩展规模法则

- 安迪·L·琼斯

- 展示你的工作:语言模型的中间计算草稿纸

- 马克斯韦尔·奈、安德斯·约翰·安德烈森、盖伊·古尔-阿里、亨里克·米哈列夫斯基、雅各布·奥斯汀、大卫·比伯、大卫·多汉、艾托尔·莱夫科维奇、马尔滕·博斯马、大卫·卢安、查尔斯·萨顿、奥古斯都·奥德纳

2021年之前

- 通过合作式部分可观测博弈中的搜索改进策略

- 亚当·莱勒、恒元·胡、雅各布·福斯特、诺姆·布朗

- 用于自动定理证明的生成式语言建模

- 斯塔尼斯拉夫·波卢、伊利亚·苏茨克维尔

- 通过通用强化学习算法的自我对弈掌握国际象棋和将棋

- 大卫·西尔弗、托马斯·休伯特、朱利安·施里特维瑟、伊万尼斯·安东格鲁、马修·莱、阿瑟·格兹、马克·兰克托特、洛朗·西弗、达尔尚·库马拉恩、托雷·格雷佩尔、蒂莫西·利利克拉普、卡伦·西蒙尼扬、德米斯·哈萨比斯。

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。