openai-proxy

openai-proxy 是一款基于 Go 语言开发的轻量级 HTTP 代理工具,旨在帮助用户更灵活地调用 OpenAI API。它主要解决了因网络环境限制导致无法直接访问 api.openai.com 的痛点,同时也支持将请求无缝切换至 Azure OpenAI 或其他全球任意域名服务。

这款工具特别适合开发者、研究人员以及需要部署 AI 应用的技术团队使用。无论是希望在本地快速调试,还是需要将服务部署到腾讯云函数、AWS Lambda 或自有云服务器上,openai-proxy 都能提供稳定的中转支持。其核心亮点在于极高的灵活性:不仅支持通过简单的域名替换快速接入,还允许通过请求头动态指定目标宿主,实现“一个入口代理全网”。此外,虽然部分云函数环境对流式传输有限制,但 openai-proxy 原生支持 Stream 流式响应,只需部署在海外服务器即可完美复现实时对话效果。对于希望自建可控 API 通道或学习反向代理原理的用户来说,这是一个开源免费且易于扩展的理想选择。

使用场景

某国内初创团队正在开发一款集成 ChatGPT 能力的智能客服系统,急需稳定调用 OpenAI API 以支撑核心业务。

没有 openai-proxy 时

- 服务器直连

api.openai.com频繁超时或连接重置,导致客服响应中断,用户体验极差。 - 为了解决网络问题,开发人员不得不在每台服务器上配置复杂的 VPN 或代理软件,运维成本高昂且难以管理。

- 无法利用腾讯云函数等 Serverless 架构降低成本,因为云函数环境难以部署和维护全局代理工具。

- 若需切换至 Azure OpenAI 或其他全球服务,必须修改大量底层代码中的请求域名,重构风险大。

使用 openai-proxy 后

- 只需将代码中的请求域名改为

proxy.geekai.co或自建的代理地址,即可在国内服务器稳定调用接口,零延迟中断。 - 无需在业务服务器安装任何代理软件,直接部署 openai-proxy 到云函数或海外单机,实现集中式流量转发,运维极简。

- 轻松适配 Serverless 架构,利用按量付费的云函数承载高并发请求,大幅降低基础设施成本。

- 通过设置

X-Target-Host请求头或启动参数,无需改动业务代码即可灵活切换 OpenAI、Azure 或其他任意全球 API 端点。

openai-proxy 通过轻量级的协议转发,彻底屏蔽了网络环境差异,让开发者能像访问本地服务一样稳定、灵活地调用全球 AI 能力。

运行环境要求

- Linux

- macOS

- Windows

无 GPU 需求

未说明

快速开始

GO-OPENAI-PROXY

基于 Go 实现的 OpenAI API HTTP 代理

想要快速体验,将 OpenAI API 调用域名从默认的

api.openai.com调整为proxy.geekai.co即可。你可以在这里预览演示效果:演示应用。

切换到 Azure OpenAI

默认在 9000 端口代理 OpenAI API,要想切换到 Azure OpenAI API,可以在 scf_bootstrap 的启动命令中添加域名参数来指定你的 Azure OpenAI API Endpoint:

./main -domain=your-azure-openai-endpoint

如果 9000 端口被占用,可以通过 -post=9001 指定其他端口。

代理任意全球域名

这个工具最早是为 OpenAI 代理而生,但实际上现在已经可以支持通过一个入口代理任意域名,只需要在发起发起代理请求的时候通过 X-Target-Host 设置你想要代理的域名(不带 http(s):// 前缀)即可,优先级是请求头>命令行参数>默认值:

req.Header.Set("x-target-host", "api.open.ai")

编译打包

你可以修改源代码调整代理逻辑,然后编译打包进行部署:

./build.sh

此命令需要本地安装go开发环境,如果不想本地安装 go 环境进行编译打包,可以直接下载根据最新源代码编译打包好的 main.zip:Releases

部署测试

支持部署到腾讯/阿里云函数、AWS lambda 函数以及任意云服务器,以下以腾讯云函数为例进行演示。

然后在腾讯云云函数代码管理界面上传打包好 zip 包即可完成部署:

你可以通过腾讯云云函数提供的测试工具进行测试,也可以本地通过 curl/postman 进行测试,使用的时候只需要将 api.openai.com 替换成代理域名 proxy.geekai.co 即可:

你可以选择自己搭建,也可以直接使用我提供的代理域名 proxy.geekai.co,反正是免费的。关于代理背后的原理,可以看我在极客书房发布的这篇教程:国内无法调用 OpenAI 接口的解决办法。

本地调试走VPN的话可以设置环境变量 ENV=local,然后直连 api.openai.com:

// 本地测试通过代理请求 OpenAI 接口

if os.Getenv("ENV") == "local" {

proxyURL, _ := url.Parse("http://127.0.0.1:10809")

client.Transport = &http.Transport{

Proxy: http.ProxyURL(proxyURL),

TLSClientConfig: &tls.Config{InsecureSkipVerify: true},

}

}

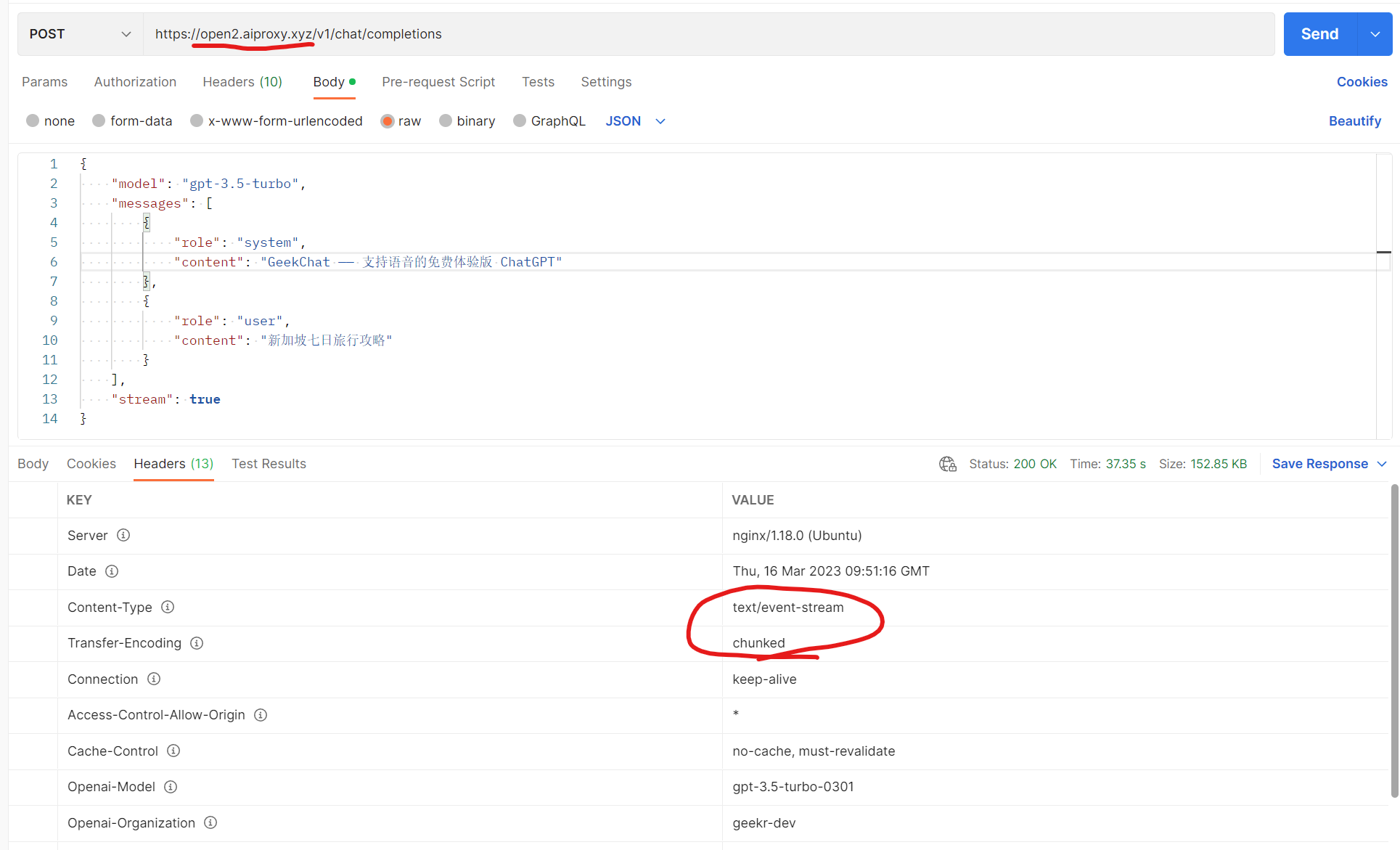

流式响应支持

这个源代码本身是支持 stream 流式响应代理的,但目前很多云函数并不支持分块流式传输。所以,如果你需要实现流式响应,可以把编译后的二进制文件 main 丢到任意海外云服务器运行,这样就变成支持流式响应的 OpenAI HTTP 代理了,如果你不想折腾,可以使用我这边提供的 proxy.geekai.co 作为代理进行测试:

如果你是通过 Nginx 这种反向代理对外提供服务,记得通过如下配置项将默认缓冲和缓存关掉才会生效:

proxy_buffering off;

proxy_cache off;

版本历史

v1.1.12023/09/22v1.1.02023/09/22v1.0.02023/09/14常见问题

相似工具推荐

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

OpenHands

OpenHands 是一个专注于 AI 驱动开发的开源平台,旨在让智能体(Agent)像人类开发者一样理解、编写和调试代码。它解决了传统编程中重复性劳动多、环境配置复杂以及人机协作效率低等痛点,通过自动化流程显著提升开发速度。 无论是希望提升编码效率的软件工程师、探索智能体技术的研究人员,还是需要快速原型验证的技术团队,都能从中受益。OpenHands 提供了灵活多样的使用方式:既可以通过命令行(CLI)或本地图形界面在个人电脑上轻松上手,体验类似 Devin 的流畅交互;也能利用其强大的 Python SDK 自定义智能体逻辑,甚至在云端大规模部署上千个智能体并行工作。 其核心技术亮点在于模块化的软件智能体 SDK,这不仅构成了平台的引擎,还支持高度可组合的开发模式。此外,OpenHands 在 SWE-bench 基准测试中取得了 77.6% 的优异成绩,证明了其解决真实世界软件工程问题的能力。平台还具备完善的企业级功能,支持与 Slack、Jira 等工具集成,并提供细粒度的权限管理,适合从个人开发者到大型企业的各类用户场景。

gpt4free

gpt4free 是一个由社区驱动的开源项目,旨在聚合多种可访问的大型语言模型(LLM)和媒体生成接口,让用户能更灵活、便捷地使用前沿 AI 能力。它解决了直接调用各类模型时面临的接口分散、门槛高或成本昂贵等痛点,通过统一的标准将不同提供商的资源整合在一起。 无论是希望快速集成 AI 功能的开发者、需要多模型对比测试的研究人员,还是想免费体验最新技术的普通用户,都能从中受益。gpt4free 提供了丰富的使用方式:既包含易于上手的 Python 和 JavaScript 客户端库,也支持部署本地图形界面(GUI),更提供了兼容 OpenAI 标准的 REST API,方便无缝替换现有应用后端。 其技术亮点在于强大的多提供商支持架构,能够动态调度包括 Opus、Gemini、DeepSeek 等多种主流模型资源,并支持 Docker 一键部署及本地推理。项目秉持社区优先原则,在降低使用门槛的同时,也为贡献者提供了扩展新接口的便利框架,是探索和利用多样化 AI 资源的实用工具。

gstack

gstack 是 Y Combinator CEO Garry Tan 亲自开源的一套 AI 工程化配置,旨在将 Claude Code 升级为你的虚拟工程团队。面对单人开发难以兼顾产品战略、架构设计、代码审查及质量测试的挑战,gstack 提供了一套标准化解决方案,帮助开发者实现堪比二十人团队的高效产出。 这套配置特别适合希望提升交付效率的创始人、技术负责人,以及初次尝试 Claude Code 的开发者。gstack 的核心亮点在于内置了 15 个具有明确职责的 AI 角色工具,涵盖 CEO、设计师、工程经理、QA 等职能。用户只需通过简单的斜杠命令(如 `/review` 进行代码审查、`/qa` 执行测试、`/plan-ceo-review` 规划功能),即可自动化处理从需求分析到部署上线的全链路任务。 所有操作基于 Markdown 和斜杠命令,无需复杂配置,完全免费且遵循 MIT 协议。gstack 不仅是一套工具集,更是一种现代化的软件工厂实践,让单人开发者也能拥有严谨的工程流程。

meilisearch

Meilisearch 是一个开源的极速搜索服务,专为现代应用和网站打造,开箱即用。它能帮助开发者快速集成高质量的搜索功能,无需复杂的配置或额外的数据预处理。传统搜索方案往往需要大量调优才能实现准确结果,而 Meilisearch 内置了拼写容错、同义词识别、即时响应等实用特性,并支持 AI 驱动的混合搜索(结合关键词与语义理解),显著提升用户查找信息的体验。 Meilisearch 特别适合 Web 开发者、产品团队或初创公司使用,尤其适用于需要快速上线搜索功能的场景,如电商网站、内容平台或 SaaS 应用。它提供简洁的 RESTful API 和多种语言 SDK,部署简单,资源占用低,本地开发或生产环境均可轻松运行。对于希望在不依赖大型云服务的前提下,为用户提供流畅、智能搜索体验的团队来说,Meilisearch 是一个高效且友好的选择。

awesome-claude-skills

awesome-claude-skills 是一个精心整理的开源资源库,旨在帮助用户挖掘和扩展 Claude AI 的潜力。它不仅仅是一份列表,更提供了实用的“技能(Skills)”模块,让 Claude 从单纯的文本生成助手,进化为能执行复杂工作流的智能代理。 许多用户在使用 AI 时,常受限于其无法直接操作外部软件或处理特定格式文件的痛点。awesome-claude-skills 通过预设的工作流解决了这一问题:它不仅能教会 Claude 专业地处理 Word、PDF 等文档,进行代码开发与数据分析,还能借助 Composio 插件连接 Slack、邮箱及数百种常用应用,实现发送邮件、创建任务等自动化操作。这使得重复性任务变得标准化且可复用,极大提升了工作效率。 无论是希望优化日常办公流程的普通用户、需要处理复杂文档的研究人员,还是寻求将 AI 深度集成到开发管线中的开发者,都能从中找到适合的解决方案。其独特的技术亮点在于“技能”的可定制性与强大的应用连接能力,让用户无需编写复杂代码,即可通过简单的配置让 Claude 具备跨平台执行真实任务的能力。如果你希望让 Claude