cc-switch

cc-switch 是一款专为命令行 AI 编程助手打造的跨平台桌面管理工具。它旨在解决开发者在同时使用 Claude Code、Codex、Gemini CLI、OpenCode 及 OpenClaw 等多个工具时,面临的环境配置繁琐、版本切换困难以及管理分散等痛点。通过提供统一的图形化界面,cc-switch 让用户能够轻松安装、更新和在不同 AI 模型工具间一键切换,无需再手动处理复杂的终端命令或配置文件。

这款工具特别适合频繁使用各类 CLI 版 AI 编码助手的软件开发者、技术研究人员及极客用户。无论是需要快速对比不同模型能力的工程师,还是希望简化工作流的重度用户,都能从中获益。其独特的技术亮点在于基于 Tauri 2 框架构建,不仅实现了 Windows、macOS 和 Linux 的全平台支持,还确保了应用轻量、启动迅速且系统资源占用极低。cc-switch 将分散的命令行工具整合为“一站式”管理中心,显著提升了 AI 辅助开发的工作效率与体验,让技术人员能更专注于代码创作本身。

使用场景

资深全栈开发者李明正在同时维护三个不同技术栈的项目,需要频繁切换使用 Claude Code 进行重构、Codex 处理遗留逻辑以及 Gemini CLI 生成测试用例。

没有 cc-switch 时

- 环境配置繁琐:每次切换模型都要手动修改终端环境变量(如

ANTHROPIC_API_KEY或GEMINI_API_KEY),极易出错且打断心流。 - 多终端混乱:为了并行任务,不得不打开多个终端窗口分别运行不同 CLI 工具,屏幕空间拥挤,上下文难以管理。

- 版本更新滞后:需要单独关注每个 CLI 工具的 GitHub 发布页,手动下载二进制文件并替换,维护成本极高。

- 配置分散难管:各个模型的配置文件散落在系统不同目录下,缺乏统一视图,调整参数时如同“大海捞针”。

使用 cc-switch 后

- 一键无缝切换:通过 cc-switch 的图形界面点击即可瞬间激活目标模型,自动注入对应密钥,无需任何手动命令操作。

- 统一调度中心:在一个轻量级窗口内集中管理所有 CLI 工具的状态,支持快速启动和停止,桌面整洁有序。

- 自动平滑升级:cc-switch 内置版本检测与更新功能,一键即可完成所有集成工具的升级,始终保持在最新稳定版。

- 全局配置可视:提供统一的配置面板,可直观查看和编辑各模型的参数设置,极大提升了调试与优化效率。

cc-switch 将原本碎片化、高摩擦的多模型工作流整合为流畅的一站式体验,让开发者能真正专注于代码本身而非工具调度。

运行环境要求

- Windows

- macOS

- Linux

未说明

未说明

快速开始

CC Switch

集成 Claude Code、Codex、Gemini CLI、OpenCode 和 OpenClaw 的一站式管理工具

❤️赞助商

点击收起

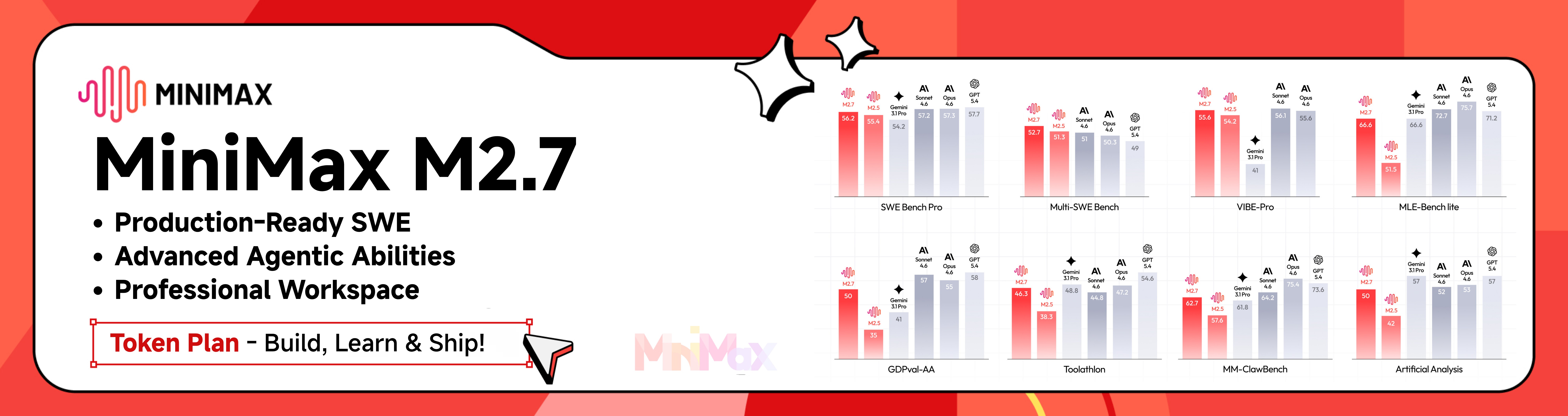

MiniMax-M2.7 是一款面向自主进化与实际生产力的新一代大型语言模型。与传统模型不同,M2.7 通过代理团队、动态工具使用和强化学习循环积极参与自身的优化迭代。它在软件工程领域表现出色(SWE-Pro 测试得分为 56.22%,VIBE-Pro 得分为 55.6%,Terminal Bench 2 得分为 57.0%),同时在复杂办公流程中也表现卓越,在 GDPval-AA 测试中以 1495 ELO 排名领先。M2.7 在 Word、Excel 和 PowerPoint 中实现了高保真编辑,并且在 40 多项复杂技能上的执行准确率高达 97%,为构建 AI 原生的工作流和组织树立了全新标准。

点击 即可享受 MiniMax Token Plan 的专属 12% 折扣!

|

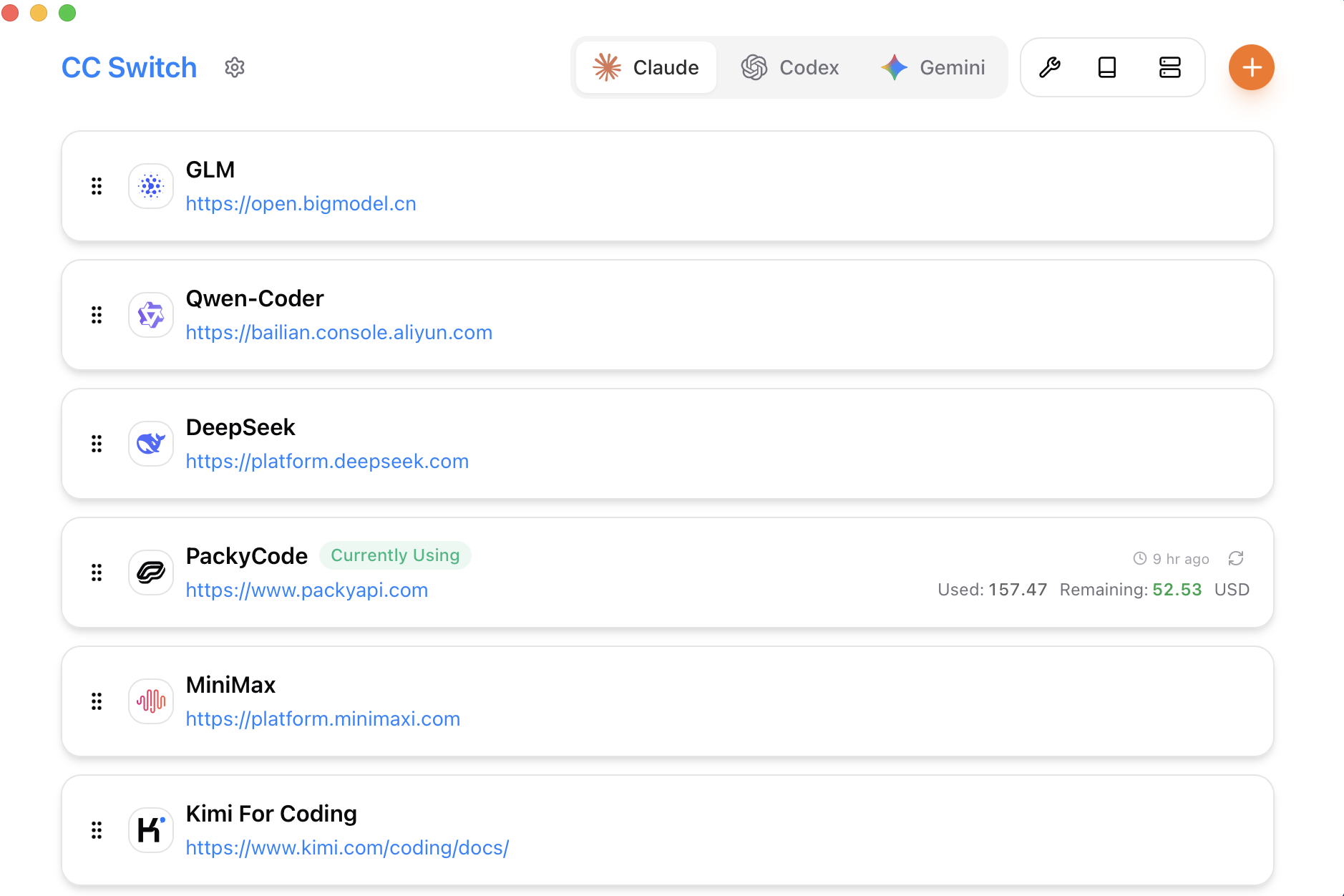

感谢 PackyCode 对本项目的赞助!PackyCode 是一家可靠高效的 API 中继服务提供商,支持 Claude Code、Codex、Gemini 等多种模型的中继服务。针对我们的用户,PackyCode 特别推出了优惠活动:通过 此链接 注册,并在首次充值时输入“cc-switch”优惠码,即可享受 10% 的折扣。 |

|

感谢 SiliconFlow 对本项目的赞助!SiliconFlow 是一个高性能的 AI 基础设施与模型 API 平台,能够在一个地方快速、稳定地访问语言、语音、图像和视频模型。凭借按需付费的计费模式、广泛的多模态模型支持、高速推理能力以及企业级稳定性,SiliconFlow 帮助开发者和团队更高效地构建与扩展 AI 应用。通过 此链接 注册并完成实名认证,即可获得 ¥20 的奖励积分,可用于平台上的各类模型。此外,SiliconFlow 现已兼容 OpenClaw,用户可以绑定 SiliconFlow API 密钥,免费调用主流 AI 模型。 |

|

感谢 AIGoCode 对本项目的赞助!AIGoCode 是一个集成了 Claude Code、Codex 以及最新 Gemini 模型的一站式平台,为您提供稳定、高效且极具性价比的 AI 编程服务。该平台提供灵活的订阅方案,无账号被封风险,无需 VPN 即可直接访问,响应速度极快。AIGoCode 为 CC Switch 用户准备了特别福利:通过 此链接 注册,在首次充值时将额外赠送 10% 的奖励积分! |

|

感谢 AICodeMirror 对本项目的赞助!AICodeMirror 提供官方授权的高稳定性中继服务,覆盖 Claude Code、Codex 和 Gemini CLI,具备企业级并发处理能力、快速开票以及全天候专属技术支持。 Claude Code、Codex 和 Gemini 的官方渠道价格分别仅为原价的 38%、2% 和 9%,并且充值还可享受额外折扣!AICodeMirror 为 CC Switch 用户准备了特别福利:通过 此链接 注册,首次充值立享 20% 折扣;企业客户最高可享受 25% 的优惠! |

|

感谢 Cubence 对本项目的赞助!Cubence 是一家可靠高效的 API 中继服务提供商,支持 Claude Code、Codex、Gemini 等多种模型的中继服务,并提供灵活的计费方式,包括按量付费和包月套餐。针对 CC Switch 用户,Cubence 特别推出优惠活动:通过 此链接 注册,并在充值时输入“CCSWITCH”优惠码,每次充值均可享受 10% 的折扣。 |

|

感谢 DMXAPI 对本项目的赞助!DMXAPI 为 200 多家企业提供全球大型模型 API 服务。只需一个 API 密钥,即可访问所有全球主流模型。其特色包括:即时开票、无限并发、起步价低至 0.15 美元,以及 24/7 全天候技术支持。GPT、Claude、Gemini 均可享受 32% 的折扣,国内模型则有 20%-50% 的优惠,Claude Code 的独家模型更是低至原价的 66%!立即注册 |

为什么选择 CC Switch?

现代基于 AI 的编码工作流依赖于 Claude Code、Codex、Gemini CLI、OpenCode 和 OpenClaw 等 CLI 工具,但每款工具都有各自的配置格式。切换 API 提供商时,往往需要手动编辑 JSON、TOML 或 .env 文件,而且目前并没有一种统一的方式来跨多个工具管理 MCP 和 Skills。

CC Switch 提供了一款桌面应用,帮助你一站式管理这五款 CLI 工具。无需再手动编辑配置文件,你可以通过直观的界面一键导入提供商、即时切换,并享受 50 多种内置提供商预设、统一的 MCP 和 Skills 管理,以及系统托盘快速切换等功能。所有数据都存储在可靠的 SQLite 数据库中,采用原子写入机制,有效防止配置损坏。

- 一款应用,五款 CLI 工具 — 从单一界面管理 Claude Code、Codex、Gemini CLI、OpenCode 和 OpenClaw

- 告别手动编辑 — 50 多种提供商预设,包括 AWS Bedrock、NVIDIA NIM 和社区中继;只需选择并切换

- 统一的 MCP 和 Skills 管理 — 一个面板即可跨四款应用管理 MCP 服务器和 Skills,并实现双向同步

- 系统托盘快速切换 — 无需打开完整应用,直接从托盘菜单即可即时切换提供商

- 云同步 — 通过 Dropbox、OneDrive、iCloud 或 WebDAV 服务器,在不同设备间同步提供商数据

- 跨平台支持 — 原生桌面应用,适用于 Windows、macOS 和 Linux,基于 Tauri 2 构建

- 内置实用工具 — 包括首次启动登录确认、签名绕过、插件扩展同步等多种实用功能

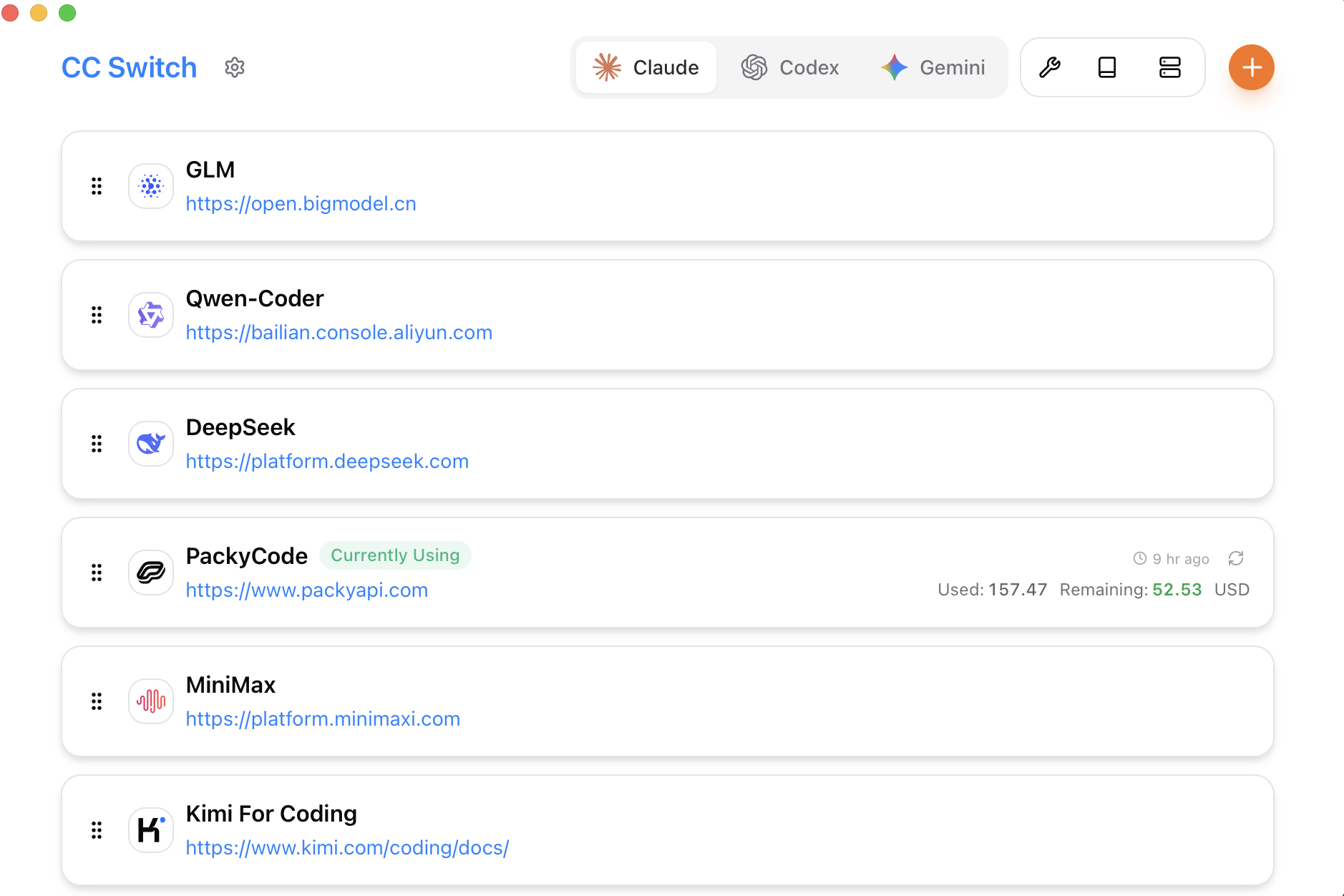

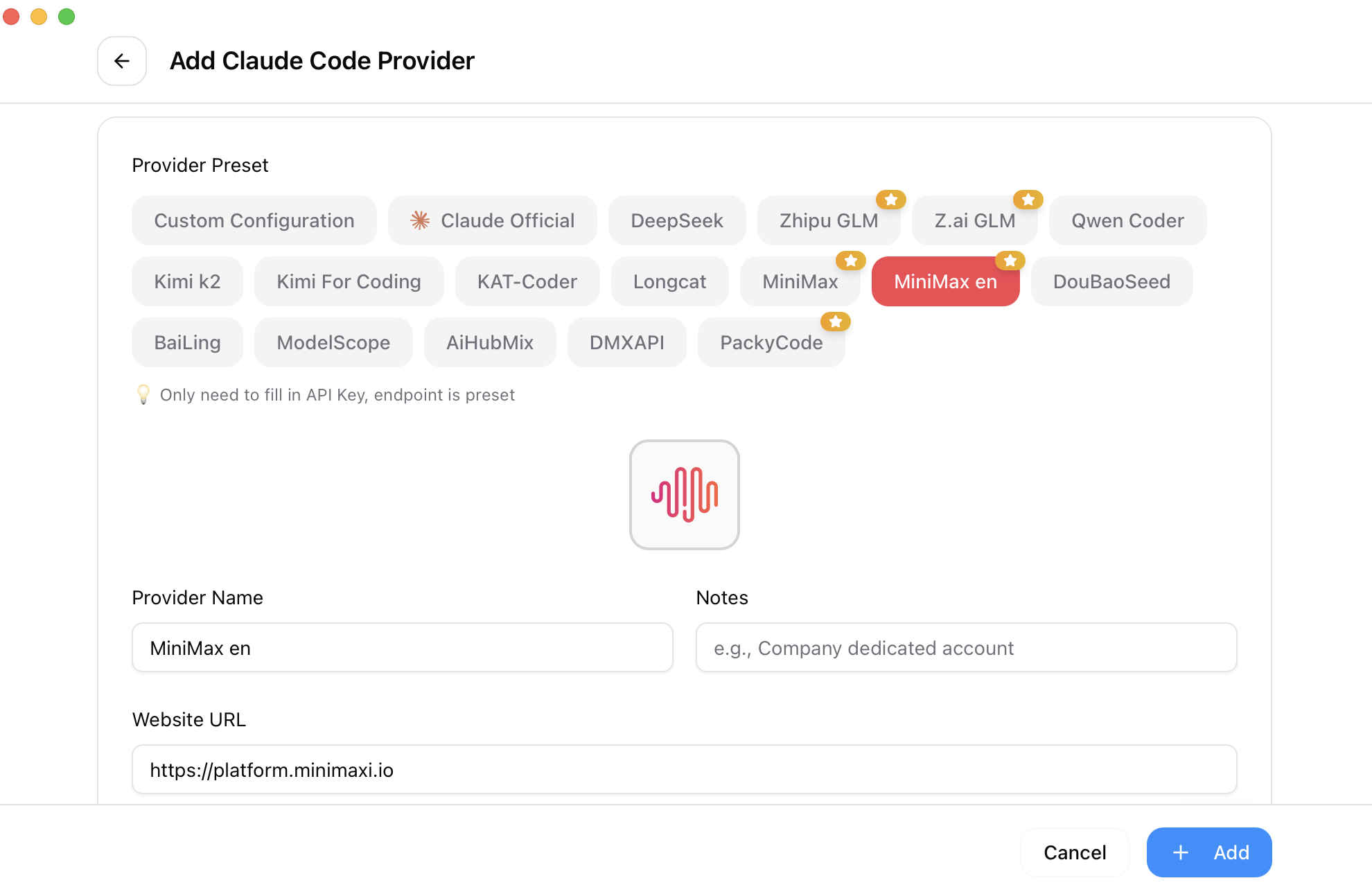

截图

| 主界面 | 添加提供商 |

|---|---|

|

|

功能特性

提供商管理

- 5 款 CLI 工具,50 多种预设 — Claude Code、Codex、Gemini CLI、OpenCode、OpenClaw;复制你的密钥,一键导入

- 通用提供商 — 一份配置可同步至多个应用(OpenCode、OpenClaw)

- 一键切换、系统托盘快速访问、拖放排序、导入导出

代理与故障转移

- 本地代理与热切换 — 格式转换、自动故障转移、断路器、提供商健康监测和请求修复

- 应用级接管 — 可独立代理 Claude、Codex 或 Gemini,甚至针对单个提供商进行代理

MCP、提示词与 Skills

- 统一的 MCP 面板 — 跨 4 款应用管理 MCP 服务器,支持双向同步和 Deep Link 导入

- 提示词 — Markdown 编辑器,支持跨应用同步(CLAUDE.md / AGENTS.md / GEMINI.md)和回填保护

- Skills — 一键从 GitHub 仓库或 ZIP 文件安装,自定义仓库管理,支持符号链接和文件复制

使用情况与成本跟踪

- 使用情况仪表盘 — 通过趋势图、详细请求日志和自定义模型定价,跟踪支出、请求数量和令牌使用情况

会话管理器与工作区

- 浏览、搜索和恢复所有应用中的对话历史

- 工作区编辑器(OpenClaw)— 使用 Markdown 预览编辑代理文件(AGENTS.md、SOUL.md 等)

系统与平台

- 云同步 — 自定义配置目录(Dropbox、OneDrive、iCloud、NAS)及 WebDAV 服务器同步

- Deep Link (

ccswitch://) — 通过 URL 导入提供商、MCP 服务器、提示词和 Skills - 黑色/白色/系统主题、自动启动、自动更新、原子写入、自动备份、多语言支持(zh/en/ja)

常见问题解答

CC Switch 支持哪些 AI CLI 工具?

CC Switch 支持五款工具:Claude Code、Codex、Gemini CLI、OpenCode 和 OpenClaw。每款工具都配有专门的提供商预设和配置管理功能。

切换提供商后,我需要重启终端吗?

对于大多数工具来说,是的——你需要重启终端或对应的 CLI 工具才能使更改生效。例外的是 Claude Code,它目前支持在不重启的情况下热切换提供商数据。

切换提供商后,我的插件配置消失了——这是怎么回事?

CC Switch 提供“共享配置片段”功能,用于在不同提供商之间传递公共数据(除了 API 密钥和端点之外)。请前往“编辑提供商”→“共享配置面板”→点击“从当前提供商提取”,以保存所有公共数据。创建新提供商时,请确保勾选“写入共享配置”(默认已启用),这样插件数据就会包含在新提供商中。你首次启动应用时导入的默认提供商中,会保留所有配置项。

macOS 安装

CC Switch 的 macOS 版本已通过 Apple 的代码签名和公证认证。你可以直接下载并安装,无需额外步骤。我们建议使用 .dmg 安装程序。

为什么无法删除当前正在使用的提供商?

CC Switch 遵循“最小侵入性”设计原则——即使你卸载了应用,你的 CLI 工具仍能正常运行。系统始终会保留一个有效的配置,因为删除所有配置会导致相应的 CLI 工具无法使用。如果你很少使用某款 CLI 工具,可以在设置中将其隐藏。如需切换回官方登录方式,请参阅下一个问题。

如何切换回官方登录方式?

从预设列表中添加一个官方提供商。切换到该提供商后,执行登出/登录流程,之后你就可以在官方提供商和第三方提供商之间自由切换。Codex 支持在不同的官方提供商之间切换,因此可以轻松在多个 Plus 或 Team 账户之间切换。

我的数据存储在哪里?

- 数据库:

~/.cc-switch/cc-switch.db(SQLite — 提供商、MCP、提示词、Skills) - 本地设置:

~/.cc-switch/settings.json(设备级 UI 配置) - 备份:

~/.cc-switch/backups/(自动轮换,保留最近 10 个备份) - Skills:

~/.cc-switch/skills/(默认软链接到相应应用) - Skill 备份:

~/.cc-switch/skill-backups/(卸载前自动创建,保留最近 20 个备份)

文档

有关各项功能的详细指南,请参阅 用户手册 — 涵盖提供商管理、MCP/提示词/Skills、代理与故障转移等内容。

快速入门

基本使用

- 添加提供商:点击“添加提供商”→选择预设或创建自定义配置

- 切换提供商:

- 主界面:选择提供商→点击“启用”

- 系统托盘:直接点击提供商名称(即时生效)

- 生效:重启终端或相应的 CLI 工具以应用更改(Claude Code 无需重启)

- 恢复官方设置:添加“官方登录”预设,重启 CLI 工具,然后按照其登录/OAuth 流程操作

MCP、提示词、技能与会话

- MCP:点击“MCP”按钮→通过模板或自定义配置添加服务器→按应用开启同步

- 提示词:点击“提示词”→使用 Markdown 编辑器创建预设→激活后同步到实时文件

- 技能:点击“技能”→浏览 GitHub 仓库→一键安装至所有应用

- 会话:点击“会话”→跨所有应用浏览、搜索并恢复对话历史

注意:首次启动时,您可以手动导入现有的 CLI 工具配置作为默认提供商。

下载与安装

系统要求

- Windows:Windows 10 及以上版本

- macOS:macOS 12(Monterey)及以上版本

- Linux:Ubuntu 22.04+ / Debian 11+ / Fedora 34+ 及其他主流发行版

Windows 用户

从 Releases 页面下载最新的 CC-Switch-v{version}-Windows.msi 安装程序或 CC-Switch-v{version}-Windows-Portable.zip 便携版。

macOS 用户

方法 1:通过 Homebrew 安装(推荐)

brew tap farion1231/ccswitch

brew install --cask cc-switch

更新:

brew upgrade --cask cc-switch

方法 2:手动下载

从 Releases 页面下载 CC-Switch-v{version}-macOS.dmg(推荐)或 .zip 文件。

注意:macOS 版 CC Switch 经过 Apple 代码签名和公证,您可以直接安装并打开。

Arch Linux 用户

通过 paru 安装(推荐)

paru -S cc-switch-bin

Linux 用户

从 Releases 页面下载最新的 Linux 版本:

CC-Switch-v{version}-Linux.deb(Debian/Ubuntu)CC-Switch-v{version}-Linux.rpm(Fedora/RHEL/openSUSE)CC-Switch-v{version}-Linux.AppImage(通用)

Flatpak:未包含在官方发布中。您可以自行基于

.deb构建——具体步骤请参阅flatpak/README.md。

架构概述

设计原则

┌─────────────────────────────────────────────────────────────┐

│ 前端 (React + TS) │

│ ┌─────────────┐ ┌──────────────┐ ┌──────────────────┐ │

│ │ 组件 │ │ 钩子 │ │ TanStack Query │ │

│ │ (UI) │──│ (业务逻辑) │──│ (缓存/同步) │ │

│ └─────────────┘ └──────────────┘ └──────────────────┘ │

└────────────────────────┬────────────────────────────────────┘

│ Tauri IPC

┌────────────────────────▼────────────────────────────────────┐

│ 后端 (Tauri + Rust) │

│ ┌─────────────┐ ┌──────────────┐ ┌──────────────────┐ │

│ │ 命令 │ │ 服务 │ │ 模型/配置 │ │

│ │ (API 层) │──│ (业务层) │──│ (数据) │ │

│ └─────────────┘ └──────────────┘ └──────────────────┘ │

└─────────────────────────────────────────────────────────────┘

核心设计模式

- SSOT(单一数据源):所有数据存储在

~/.cc-switch/cc-switch.db(SQLite) - 双层存储:SQLite 用于可同步数据,JSON 用于设备级设置

- 双向同步:切换时写入实时文件,编辑活动提供商时从实时文件回填

- 原子写入:临时文件 + 重命名模式防止配置损坏

- 并发安全:互斥锁保护的数据库连接避免竞态条件

- 分层架构:清晰分离(命令 → 服务 → DAO → 数据库)

关键组件

- ProviderService:提供商的增删改查、切换、回填及排序

- McpService:MCP 服务器管理、导入导出及实时文件同步

- ProxyService:本地代理模式,支持热切换和格式转换

- SessionManager:跨所有支持的应用浏览对话历史

- ConfigService:配置的导入导出及备份轮转

- SpeedtestService:API 端点延迟测量

开发指南

环境要求

- Node.js 18+

- pnpm 8+

- Rust 1.85+

- Tauri CLI 2.8+

开发命令

# 安装依赖

pnpm install

# 开发模式(热重载)

pnpm dev

# 类型检查

pnpm typecheck

# 格式化代码

pnpm format

# 检查代码格式

pnpm format:check

# 运行前端单元测试

pnpm test:unit

# 推荐在开发时使用监听模式运行测试

pnpm test:unit:watch

# 构建应用

pnpm build

# 构建调试版本

pnpm tauri build --debug

Rust 后端开发

cd src-tauri

# 格式化 Rust 代码

cargo fmt

# 运行 clippy 检查

cargo clippy

# 运行后端测试

cargo test

# 运行特定测试

cargo test test_name

# 使用 test-hooks 功能运行测试

cargo test --features test-hooks

测试指南

前端测试:

- 使用 vitest 作为测试框架

- 使用 MSW(Mock Service Worker) 模拟 Tauri API 调用

- 使用 @testing-library/react 进行组件测试

运行测试:

# 运行所有测试

pnpm test:unit

# 监听模式(自动重新运行)

pnpm test:unit:watch

# 带有覆盖率报告

pnpm test:unit --coverage

技术栈

前端: React 18 · TypeScript · Vite · TailwindCSS 3.4 · TanStack Query v5 · react-i18next · react-hook-form · zod · shadcn/ui · @dnd-kit

后端: Tauri 2.8 · Rust · serde · tokio · thiserror · tauri-plugin-updater/process/dialog/store/log

测试: vitest · MSW · @testing-library/react

项目结构

├── src/ # 前端(React + TypeScript)

│ ├── components/

│ │ ├── providers/ # Provider 管理

│ │ ├── mcp/ # MCP 面板

│ │ ├── prompts/ # Prompts 管理

│ │ ├── skills/ # Skills 管理

│ │ ├── sessions/ # 会话管理器

│ │ ├── proxy/ # 代理模式面板

│ │ ├── openclaw/ # OpenClaw 配置面板

│ │ ├── settings/ # 设置(终端/备份/关于)

│ │ ├── deeplink/ # 深度链接导入

│ │ ├── env/ # 环境变量管理

│ │ ├── universal/ # 跨应用配置

│ │ ├── usage/ # 使用统计

│ │ └── ui/ # shadcn/ui 组件库

│ ├── hooks/ # 自定义 Hook(业务逻辑)

│ ├── lib/

│ │ ├── api/ # Tauri API 封装(类型安全)

│ │ └── query/ # TanStack Query 配置

│ ├── locales/ # 多语言翻译(zh/en/ja)

│ ├── config/ # 预设(providers/mcp)

│ └── types/ # TypeScript 类型定义

├── src-tauri/ # 后端(Rust)

│ └── src/

│ ├── commands/ # Tauri 命令层(按领域划分)

│ ├── services/ # 业务逻辑层

│ ├── database/ # SQLite DAO 层

│ ├── proxy/ # 代理模块

│ ├── session_manager/ # 会话管理

│ ├── deeplink/ # 深度链接处理

│ └── mcp/ # MCP 同步模块

├── tests/ # 前端测试

└── assets/ # 截图及合作伙伴资源

参与贡献

欢迎提出问题和建议!

在提交 PR 之前,请确保:

- 通过类型检查:

pnpm typecheck - 通过格式检查:

pnpm format:check - 通过单元测试:

pnpm test:unit

对于新功能,请先开一个议题进行讨论,再提交 PR。不符合项目定位的功能 PR 可能会被关闭。

星标历史

许可证

MIT © Jason Young

版本历史

v3.12.32026/03/24v3.12.22026/03/12v3.12.12026/03/11v3.12.02026/03/09v3.11.12026/02/28v3.11.02026/02/26v3.10.32026/01/31v3.10.22026/01/24v3.10.12026/01/23v3.10.02026/01/22v3.9.12026/01/09v3.9.02026/01/08v3.9.0-32025/12/30v3.8.32025/12/24v3.9.0-22025/12/20v3.9.0-12025/12/18v3.8.22025/12/01v3.8.12025/12/01v3.8.02025/11/28v3.7.12025/11/22相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

OpenHands

OpenHands 是一个专注于 AI 驱动开发的开源平台,旨在让智能体(Agent)像人类开发者一样理解、编写和调试代码。它解决了传统编程中重复性劳动多、环境配置复杂以及人机协作效率低等痛点,通过自动化流程显著提升开发速度。 无论是希望提升编码效率的软件工程师、探索智能体技术的研究人员,还是需要快速原型验证的技术团队,都能从中受益。OpenHands 提供了灵活多样的使用方式:既可以通过命令行(CLI)或本地图形界面在个人电脑上轻松上手,体验类似 Devin 的流畅交互;也能利用其强大的 Python SDK 自定义智能体逻辑,甚至在云端大规模部署上千个智能体并行工作。 其核心技术亮点在于模块化的软件智能体 SDK,这不仅构成了平台的引擎,还支持高度可组合的开发模式。此外,OpenHands 在 SWE-bench 基准测试中取得了 77.6% 的优异成绩,证明了其解决真实世界软件工程问题的能力。平台还具备完善的企业级功能,支持与 Slack、Jira 等工具集成,并提供细粒度的权限管理,适合从个人开发者到大型企业的各类用户场景。