natively-cluely-ai-assistant

Natively 是一款免费开源的 AI 面试搭档与会议助手,专为技术面试和线上会议场景设计。它提供实时语音转文字、本地运行的检索增强生成(RAG)功能,并支持用户自带密钥(BYOK),所有数据处理均在本地完成,无需联网上传,有效避免隐私泄露风险。相比 Cluely、Final Round AI、Interview Coder 等同类商业工具,Natively 不收取订阅费用,也从未发生过数据泄露事件。

这款工具特别适合准备技术面试的开发者使用,无论是 LeetCode 刷题、系统设计讨论,还是实时编码环节,都能提供隐形辅助——例如屏幕叠加提示、实时解题建议等,且具备“隐身模式”,不易被监考系统察觉。由于完全开源并支持本地模型运行,研究人员也可基于其架构进行二次开发或定制。

Natively 的核心亮点在于将高级 AI 功能与隐私保护结合:无需依赖云端服务,用户完全掌控自己的数据和模型,同时保持与主流商业产品相似的操作体验。目前支持 macOS 和 Windows 平台。

使用场景

一位正在准备Meta后端工程师岗位终面的应届生,需要在45分钟内完成一道系统设计题和一道LeetCode Hard编码题,同时还要应对面试官的实时追问。

没有 natively-cluely-ai-assistant 时

- 面试中遇到不熟悉的分布式缓存设计问题,只能凭记忆硬答,逻辑混乱且遗漏关键点。

- 编码环节卡在边界条件处理上,没有即时辅助,浪费大量时间调试却无法通过全部测试用例。

- 使用在线AI工具担心被录屏或网络请求暴露,不敢启用任何外部帮助,全程高度紧张。

- 依赖付费工具如Final Round AI,每月支出近百元,且需上传面试内容到第三方服务器,存在隐私泄露风险。

- 面试结束后无法回溯具体问答细节,复盘效率低,难以针对性提升。

使用 natively-cluely-ai-assistant 后

- 开启“隐身模式”后,AI在本地实时分析面试问题,通过屏幕角落轻量提示系统设计的关键组件(如一致性哈希、LRU淘汰策略),回答更有条理。

- 编码时自动调用本地RAG检索相似LeetCode题解,在不切换窗口的情况下提供精准代码片段建议,快速修复逻辑漏洞。

- 所有数据仅在本机处理,自带BYOK(自带密钥)支持,彻底规避监考软件检测和数据外泄风险,心理负担大幅减轻。

- 完全免费开源,无需订阅,本地运行不依赖云端服务,即使网络不稳定也能稳定辅助。

- 面试结束后自动生成带时间戳的转录与AI交互日志,便于逐帧复盘技术盲点和表达问题。

natively-cluely-ai-assistant 让开发者在真实面试压力下获得安全、私密且零成本的智能协同,真正把注意力聚焦在解决问题本身。

运行环境要求

- macOS

- Windows

未说明

未说明

快速开始

Natively — 免费、开源的 AI 面试副驾驶(Copilot)与会议助手

Cluely、Final Round AI、LockedIn AI 和 Interview Coder 的最佳免费替代方案。

与 Cluely 相同的 UI,更多功能,价格 $0,开源,无数据泄露风险。

竞品每月收费 $20–$149,将你的数据存储在他们的服务器上,其中一家已导致 83,000 名用户数据泄露。 Natively 完全免费,在本地运行,从未发生过数据泄露。你的密钥、你的模型、你的机器。

需要 macOS 12+(Apple Silicon 与 Intel)或 Windows 10/11

🔥 49.4k 次浏览 · 💸 $0 vs 竞品 $149/月 · ⚡ 延迟 <500ms · 🛡️ 0 次数据泄露

免费、开源的 Cluely 克隆版

Natively 最初是对 Cluely 界面的像素级复刻,随后不断进化。如果你用过 Cluely,你已经知道如何使用 Natively。相同的屏幕叠加层(overlay)、相同的工作流、相同的快捷键。不同的是:它免费、开源、本地运行、支持任意大语言模型(LLM),且从未泄露过任何用户数据。

正在寻找 免费的 Cluely 替代品?一个 开源的 Cluely 克隆版?你找对了。

免费 AI 编程面试助手 — 在 LeetCode、HackerRank 与 CoderPad 上不可被检测

Natively 可作为标准在线测评中的 免费、不可检测的 AI 编程面试助手。它会捕获你的屏幕,分析题目,并通过一个隐形的叠加层实时提供提示、解答和解释 —— 完全不会干扰你的编码环境。

已在以下平台验证不可被检测:

- LeetCode(包括 LeetCode 竞赛)

- HackerRank

- CoderPad

- Codility

- HackerEarth

- Karat

- 任何基于浏览器的编码环境

工作原理:

- 使用快捷键一键截图题目

- Natively 通过 OCR 识别题目内容,并将其发送至你选择的 AI(GPT、Claude、Gemini 或本地 Ollama)

- 回复显示在隐形叠加层中 —— 绝不会出现在屏幕共享画面中

⚠️ 重要提示: Natively 并非用于绕过 Pearson VUE、ProctorU 或 Respondus Lockdown Browser 等专用监考软件 —— 这些软件在操作系统层面运行,属于完全不同的类别。对于没有专用监考软件的标准在线编程测评,Natively 的隐身模式无法被检测到。

选择面试 AI 前你应该知道的 3 件事

- Cluely 在 2025 年年中发生数据泄露事件,导致 83,000 名用户的个人信息、访谈文字记录和截图被曝光 —— Natively 将所有数据本地存储,仅包含有限的基础遥测(telemetry),且从未发生过任何数据泄露。

- Final Round AI 每月收费 149 美元,其任务栏图标会被监考软件识别 —— Natively 免费、开源,并拥有经过实战检验的不可检测隐身模式(stealth mode)。

- LockedIn AI 每月收费 55–70 美元,并强制用户使用其云端大语言模型(LLM),不提供本地运行选项 —— Natively 允许你使用任意模型(GPT、Claude、Gemini、Llama),或通过 Ollama 完全离线运行。

⭐ 给本项目点个 Star —— 这很重要

每一个 Star 都能让 Natively 在 GitHub 搜索结果中排名更高,帮助开发者和求职者发现这个免费、注重隐私的替代方案,而不是每月花 149 美元购买那些将你的数据存储在他人服务器上的工具。

演示

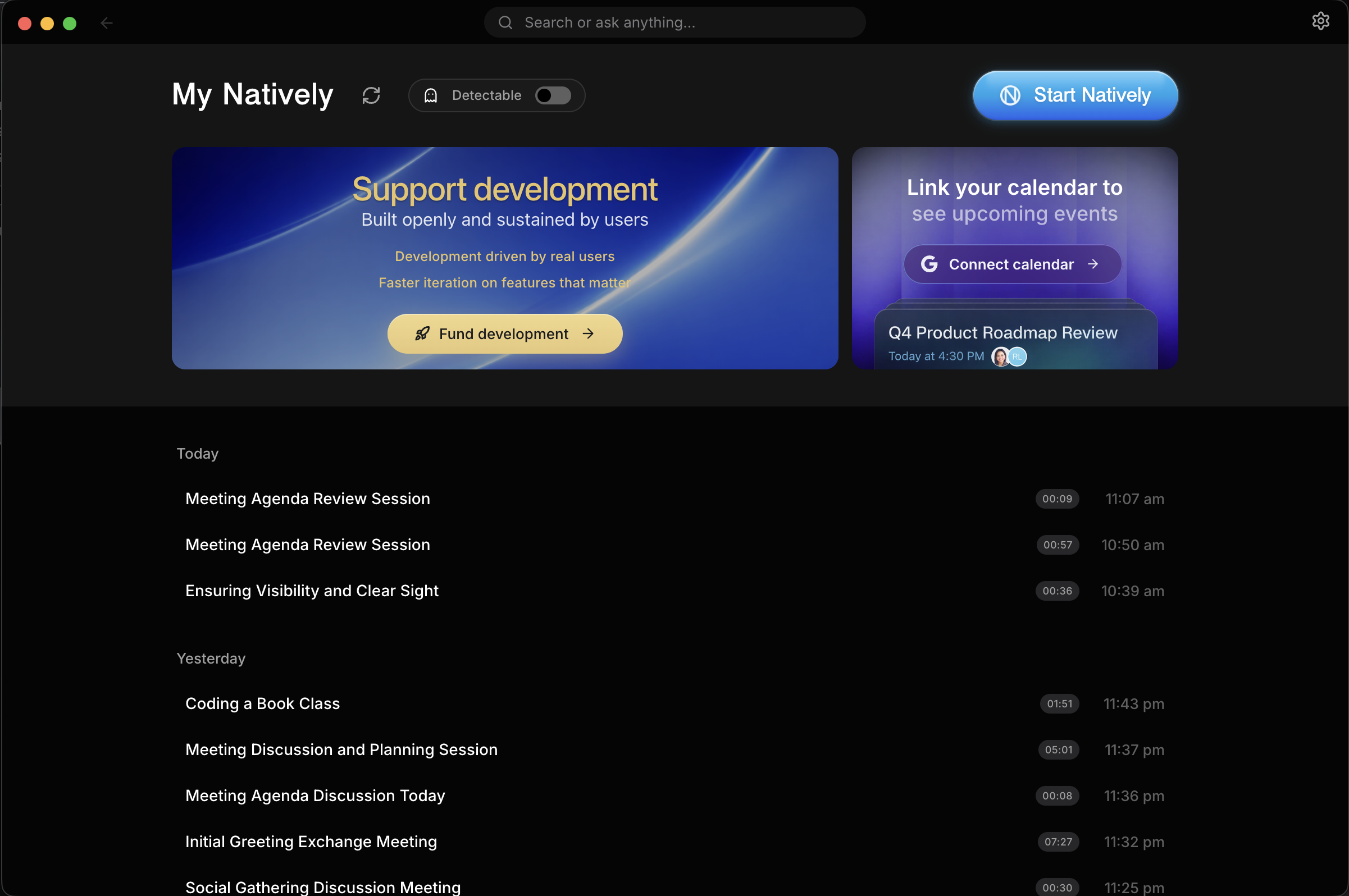

此演示展示了 一个完整的实时会议场景:

- 会议进行时的实时转录

- 跨多个发言者的滚动上下文感知(rolling context awareness)

- 对共享幻灯片的截图分析

- 即时生成下一步该说的话

- 后续问题与简洁回答

- 所有功能均实时运行,无需录制或后期处理

完整对比:Natively vs Cluely vs Final Round AI vs LockedIn AI vs Interview Coder

| 功能 | Natively | Cluely | Pluely | LockedIn AI | Final Round AI |

|---|---|---|---|---|---|

| 价格 | ✅ 免费(BYOK) | ⚠️ 20 美元/月 | ✅ 免费 | ❌ 55–70 美元/月 | ❌ 149 美元/月 |

| 开源 | ✅ AGPL-3.0 | ❌ | ✅ | ❌ | ❌ |

| 本地数据 / 隐私保护 | ✅ 是 | ❌ 云端服务器 | ✅ 是 | ❌ 云端服务器 | ❌ 云端服务器 |

| 支持任意 LLM(BYOK) | ✅ 是 | ❌ 厂商锁定 | ⚠️ 有限 | ❌ 厂商锁定 | ❌ 厂商锁定 |

| 本地 AI(Ollama) | ✅ 是 | ❌ | ❌ | ❌ | ❌ |

| 实时性(<500ms) | ✅ 是 | ⚠️ 延迟 5–90 秒 | ✅ 是 | ✅ ~116ms | ⚠️ 最慢 |

| 双音频通道 | ✅ 系统 + 麦克风 | ❌ 单一流 | ❌ | ❌ | ❌ |

| 本地 RAG 记忆 | ✅ SQLite + sqlite-vec | ❌ | ❌ | ❌ | ❌ |

| 会议历史 | ✅ 完整仪表盘 | ⚠️ 有限 | ❌ | ❌ | ⚠️ 有限 |

| 截图 OCR | ✅ 是 | ⚠️ 有限 | ❌ | ✅ 是 | ⚠️ 有限 |

| 隐身模式 | ✅ 不可检测 | ❌ | ❌ | ❌ | ❌ 监考软件可见 |

| 进程伪装 | ✅ 终端、设置等 | ❌ | ❌ | ❌ | ❌ |

| 简历与上下文支持 | ✅ 专业级 | ❌ | ❌ | ✅ 是 | ✅ 是 |

| 数据泄露历史 | ✅ 无 | ❌ 83,000 用户泄露 | ✅ 无 | ✅ 无 | ✅ 无 |

图例说明:✅ 完全支持 · ⚠️ 部分或有限支持 · ❌ 不支持

为什么 Natively 更胜一筹

对比 Cluely —— 泄露了 83,000 名用户数据

Natively 的界面设计有意保持熟悉感 —— 如果你用过 Cluely,几乎无需学习成本。

Cluely 在 2025 年年中的数据泄露事件中,暴露了 83,000 名用户的个人信息、完整面试文字记录和截图。你在面试中说的每一句话都被存储在其服务器上,随后遭到泄露。而他们竟为此每月收取 20 美元。

Natively 没有后端、没有服务器,仅包含基础遥测(仅用于 GA4 安装追踪,不收集任何用户数据)。你的文字记录、API 密钥和截图永远不会离开你的设备。整个代码库以 AGPL-3.0 开源协议发布,可公开审计。零泄露、零数据收集 —— 对于一款监听你面试内容的工具来说,这是唯一可接受的标准。

对比 LockedIn AI —— 每月 70 美元的云端锁定

LockedIn AI 是同类工具中最贵的,每月收费 55–70 美元。它强制你使用单一云端大语言模型(LLM),不提供本地推理选项。每一条文字记录和回复都会经过其服务器。

Natively 支持所有主流模型(Gemini、GPT、Claude、Groq),只需自带密钥(BYOK),并通过 Ollama 提供 100% 离线模式。你只需为你实际使用的 API Token 付费,或者完全免费地在本地运行 Llama 3。无需订阅,也无厂商锁定。

对比 Final Round AI —— 每月 149 美元且会被监考软件识别

Final Round AI 是最昂贵的选择,每月 149 美元,主要针对面试前准备和模拟面试,但在实时延迟方面却是同类中最慢的。关键问题是,其任务栏图标会被监考软件识别,在受监控的面试中极易被发现。

Natively 利用基于 Rust 的原生音频捕获技术和零拷贝 ABI 传输(Zero-Copy ABI Transfers),实现端到端延迟低于 500ms。其不可检测的隐身模式可从 Dock 中隐藏、伪装进程名称,并在所有窗口间同步状态 —— 经过五个主要版本的实战检验和强化。

对比 Pluely —— 轻量但功能有限

Pluely 是一个不错的轻量级替代品(约 10MB,基于 Tauri),并支持 Linux,而 Natively 目前尚未提供 Linux 支持。这一点值得肯定。

但 Pluely 仅是一个基础覆盖层(overlay)。它没有本地 RAG、没有会议历史、不支持双音频通道,也没有仪表盘。Natively 是一套完整的智能系统:通过本地向量搜索记住你过去的会议,分离系统音频与麦克风输入,并提供完整的管理仪表盘,支持导出为 Markdown、JSON 和纯文本格式。

vs Interview Coder — 更强大,完全免费

Interview Coder 是一款专注于编程面试辅助的付费工具。而 Natively 不仅原生支持 Interview Coder 的所有功能,还提供更多能力,并且完全免费:

| Natively | Interview Coder | |

|---|---|---|

| 价格 | ✅ 免费(BYOK) | ❌ 付费 |

| 开源 | ✅ | ❌ |

| 支持 LeetCode / HackerRank | ✅ | ✅ |

| 截图 + OCR 分析 | ✅ | ✅ |

| 实时叠加层(overlay) | ✅ | ✅ |

| 本地 AI / 离线模式 | ✅ Ollama | ❌ |

| 行为面试支持 | ✅ | ❌ |

| 系统设计支持 | ✅ | ❌ |

| 会议历史 & RAG(检索增强生成) | ✅ | ❌ |

| 任意大语言模型(BYOK) | ✅ | ❌ 锁定 |

| 数据本地存储 | ✅ | ❌ 云端 |

Natively 覆盖完整的面试流程——不仅限于编程环节。

vs Parakeet AI — 带记忆与历史 vs 无状态叠加层

Parakeet AI 提供基础的实时会议辅助,但没有持久化记忆、会议历史记录,也不支持本地向量搜索。Natively 通过本地 RAG 记住你过去的会议内容,允许你跨所有历史记录提问,并提供完整的仪表盘来管理、导出和搜索所有内容。

我们尚未完善之处

- 暂不支持 Linux —— 我们正在积极寻找维护者,帮助将 Natively 移植到 Linux 平台

- API 密钥设置开销 —— 你需要自行提供 API 密钥(或安装 Ollama),相比一体化的云端工具,初始设置略显繁琐

- 无内置模拟面试模式 —— Final Round AI 提供专门的模拟面试练习;Natively 则专注于实时辅助

为什么选择 Natively?

当其他工具只是简单的 API 封装时,Natively 是一个完整的、原生构建的智能系统,专为高风险会议和面试场景设计。

- 原生音频捕获(<500ms):基于 Rust 构建,采用零拷贝 ABI 传输,绕过通用 Web 音频限制,实现超低延迟。

- 双通道智能处理:分别为系统音频(对方所说内容)和麦克风输入(你口述内容)建立独立处理管道,确保精准转录,不受环境噪音干扰。

- 久经考验的隐身模式:完全无法被检测。隐藏于 Dock 栏、禁用弹窗,并在屏幕共享时伪装进程。

- 滚动上下文(Rolling Context):我们不仅做转录,还会维护对话的“记忆窗口”,以提供更智能的回答。

- 本地 RAG 记忆:使用 SQLite 向量搜索在本地嵌入你的会议记录,让你可以提问:“上周 John 对 API 说了什么?”

- 丰富仪表盘:提供完整 UI 界面,用于管理、搜索和导出历史记录——不只是一个浮动窗口。

- 完全离线可用:不信任云端?你可以使用本地 Ollama 模型 100% 离线运行 Natively,并仅启用有限的基础遥测功能。

Natively Pro

虽然 Natively 永远免费且开源,我们也同时提供专为高级用户和求职者设计的 Pro 版本。购买 Pro 许可证不仅能让你在求职市场中占据优势,还能直接支持 Natively 开源核心的持续开发!

免费版 vs Pro 版功能对比

| 功能 | Natively 免费版 | Natively Pro 版 |

|---|---|---|

| 自带密钥模型(BYOK Models) | ✅ | ✅ |

| 本地 AI 支持(Ollama) | ✅ | ✅ |

| 实时语音转文字(<500ms) | ✅ | ✅ |

| 实时上下文助手 | ✅ | ✅ |

| 截图与幻灯片 OCR 分析 | ✅ | ✅ |

| 不可检测 & 隐身模式 | ✅ | ✅ |

| 会议仪表盘 & 离线 RAG 历史 | ✅ | ✅ |

| 职位描述(JD)与简历上下文感知 | ❌ | ✅ |

| 自动公司调研与资料包生成 | ❌ | ✅ |

| 实时薪资与 Offer 谈判副驾驶 | ❌ | ✅ |

| 优先功能访问与技术支持 | ❌ | ✅ |

v2.0.8 新增功能

v2.0.8 版本在隐形路由(stealth routing)、鼠标穿透模式(Mouse Passthrough Mode)、多模态 Groq 支持等方面实现了重大改进,并修复了关键性 Bug,确保工作流无缝顺畅。

- 多模态 Groq 支持:将

meta-llama/llama-4-scout-17b-16e-instruct集成到生态系统中,实现高速截图分析能力,并将最大生成 token 数提升至 8192。 - 鼠标穿透模式:将后端 Electron 的鼠标事件管理与全局快捷键管理器和 React 渲染界面之间的状态完全同步。

- 即时隐形启动 & 窗口不透明度保护罩:重构应用逻辑,使其在启动时立即应用缓存的

isUndetectable状态,并引入不透明度保护罩,彻底消除显示受保护 UI 元素时出现的单帧屏幕闪烁问题。 - 模型阵容与轮换引擎:默认架构模型已更新为最新一代的

gpt-5.4-chat、gemini-3.1和claude-sonnet-4-6,同时强化了三层故障转移机制。 - 永久隐藏与可见性缺陷:修复了一个关键的 IPC 路由 Bug:动态隐藏会话 UI 时,

Cmd+B取消隐藏命令被错误地路由到后台 Launcher,导致用户陷入“界面不可见”的陷阱。 - SQLite-Vec 数据损坏问题:修复了一个因严格维度约束(

float[1536])导致的静默数据损坏 Bug,确保 100% 生成的嵌入(embeddings)都能被保留并可检索。 - Groq 多媒体丢弃问题:解决了“前门(Front Door)”路由 Bug:图像附件完全绕过了 Groq 引擎,触发了虚假的 LLM 连接错误。

- 关键竞态条件与线程安全:消除了 LLM 故障转移循环期间危险的全局状态突变,并修复了

SettingsManager早期初始化导致的致命崩溃。 - 内存与资源泄漏:强化了原生音频监听器的销毁逻辑,防止僵尸回调;同时清理了不透明度保护罩和伪装计时器中悬空的浮动超时 ID。

- 原生模块加载器管道(跨平台稳定性):集成了自定义 NAPI-RS 绝对二进制加载器(

nativeModuleLoader.ts),完全绕过 Windows Git Bash 上因 POSIX 符号链接导致的require失败问题,并进行了多项增强,例如修正硬编码的natively.icns依赖。

目录

- 免费的 Cluely 克隆版

- 选择面试 AI 前需知的 3 件事

- 演示

- 完整对比

- 为何 Natively 胜出

- 为何选择 Natively?

- Natively Pro

- v2.0.8 新增功能

- 隐私与安全

- 安装指南(开发者与贡献者)

- AI 提供商

- 核心功能

- 会议智能仪表盘

- 路线图

- 使用场景

- 技术细节

- 已知限制

- 负责任的使用

- 贡献指南

- 许可证

- 常见问题

- Natively 替代的竞品

- Star 历史

Natively 是什么?

Natively 是一款面向实时场景的桌面 AI 助手:

- 会议

- 面试

- 演示

- 课堂

- 专业对话

它提供:

- 实时回答

- 持续对话上下文

- 截图与文档理解

- 实时语音转文字(speech-to-text)

- 即时建议下一句话该说什么

全程保持隐形、快速、以隐私为先。

隐私与安全(核心设计原则)

- 100% 开源(AGPL-3.0 许可证)

- 自带密钥(Bring Your Own Keys, BYOK)

- 本地 AI 选项(Ollama)

- 所有数据本地存储

- 极简遥测(仅基础 GA4 计数)

- 不追踪用户数据

- 无隐藏上传

您明确控制:

- 哪些功能在本地运行

- 哪些功能使用云端 AI

- 启用哪些提供商

安装指南(开发者与贡献者)

[!NOTE] macOS 用户(支持 Apple Silicon 与 Intel Mac):

“来自未识别开发者”:若出现此提示,请右键点击应用 > 选择 打开 > 点击 打开。

“应用程序已损坏”:若出现此提示,请根据您的下载方式在终端中运行以下命令:

对于 .zip 下载:

xattr -cr /Applications/Natively.app对于 .dmg 下载:

- 打开终端并运行:

xattr -cr ~/Downloads/Natively-2.0.2-arm64.dmg # 或您具体的文件名- 安装 natively.dmg

- 打开终端并运行:

xattr -cr /Applications/Natively.app

先决条件

- Node.js(推荐 v20+)

- Git

- Rust(用于原生音频捕获)

AI 凭据与语音提供商

Natively 完全免费,只需您自己的密钥即可使用。

可连接任意语音提供商和任意大语言模型(LLM)。无订阅、无加价、无隐藏费用。所有密钥均本地存储。

无限免费转录(Whisper、Google、Deepgram)

- Soniox(API Key) - 超快、高精度的流式语音转文字(STT)

- Google Cloud Speech-to-Text(服务账号)

- Groq(API Key)

- OpenAI Whisper(API Key)

- Deepgram(API Key)

- ElevenLabs(API Key)

- Azure 语音服务(API Key + 区域)

- IBM Watson(API Key + 区域)

AI 引擎支持(自带密钥,Bring Your Own Key)

原生连接 任意 主流大模型或本地推理引擎。

| 提供商(Provider) | 最佳适用场景 |

|---|---|

| Gemini 3.1 系列 | 推荐:超大上下文窗口(200 万 tokens)且成本低廉。 |

| OpenAI (GPT-5.4 & o3) | 高阶推理能力。 |

| Anthropic (Claude 4.6) | 编程与复杂精细任务。 |

| Groq (Llama 3.3/Scout 4) | 极致速度(近乎即时响应)与截图分析。 |

| Ollama / LocalAI | 100% 离线 & 隐私(无需 API 密钥)。 |

| OpenAI 兼容接口 | 连接 任意 自定义端点(如 vLLM、LM Studio 等)。 |

注意:你只需配置 一个 语音识别(Speech-to-Text)提供商即可开始使用。我们推荐 Google STT、Groq 或 Deepgram 以获得最快的实时性能。

使用 Google Speech-to-Text(可选)

你的凭证:

- 永远不会离开你的设备

- 不会被记录、代理或远程存储

- 仅由本地应用程序使用

你需要准备:

- Google Cloud 账号

- 已启用计费功能

- 已启用 Speech-to-Text API

- 服务账号(Service Account)的 JSON 密钥文件

设置步骤概要:

- 创建或选择一个 Google Cloud 项目

- 启用 Speech-to-Text API

- 创建一个服务账号

- 分配角色:

roles/speech.client - 生成并下载 JSON 密钥文件

- 在应用设置中指定该 JSON 文件路径

开发环境搭建

克隆仓库

git clone https://github.com/evinjohnn/natively-cluely-ai-assistant.git

cd natively-cluely-ai-assistant

安装依赖

npm install

构建原生音频模块(Rust)

npm run build:native

环境变量

创建 .env 文件:

# 云 AI

GEMINI_API_KEY=your_key

GROQ_API_KEY=your_key

OPENAI_API_KEY=your_key

CLAUDE_API_KEY=your_key

GOOGLE_APPLICATION_CREDENTIALS=/absolute/path/to/service-account.json

# 语音提供商(可选 - 仅需一个)

DEEPGRAM_API_KEY=your_key

ELEVENLABS_API_KEY=your_key

AZURE_SPEECH_KEY=your_key

AZURE_SPEECH_REGION=eastus

IBM_WATSON_API_KEY=your_key

IBM_WATSON_REGION=us-south

# 本地 AI(Ollama)

USE_OLLAMA=true

OLLAMA_MODEL=llama3.2

OLLAMA_URL=http://localhost:11434

# 默认模型配置

DEFAULT_MODEL=gemini-3.1-flash-lite-preview

运行(开发模式)

npm start

构建(生产模式)

npm run dist

此命令依次执行:Vite 构建 → TypeScript 编译 → 原生模块构建 → electron-builder 打包

AI 提供商支持

- 自定义端点(BYO Endpoint):粘贴任意 cURL 命令即可使用 OpenRouter、DeepSeek 或私有端点。

- Ollama(本地):零配置自动检测本地模型(如 Llama 3、Mistral、Gemma)。

- 动态模型选择:首选模型(OpenAI、Anthropic、Google)现在会在整个应用中自动显示。

- Google Gemini:对 Gemini 3.1 系列提供一流支持。

- OpenAI:支持 GPT-5.4 和 o3 系列,并优化了系统提示(system prompts)。

- Anthropic:支持 Claude 4.6 系列,并修正了 max_tokens 参数。

- Groq:使用 Llama 3.3 实现超快文本推理,并通过 Llama 4 Scout 实现截图分析。

核心功能

隐形桌面助手

- 始终置顶的半透明覆盖层

- 快捷键即时隐藏/显示

- 支持所有应用程序

实时面试副驾 & 编程辅助

- 实时语音转文字(延迟 <500ms)

- 快速响应模式:使用 Groq Llama 3.3 实现超快文本回复

- 多语言支持:可选择多种回复语言,并为语音识别匹配特定口音和方言

- 反聊天机器人 / 拟人化系统:通过精炼的系统提示和负面约束,确保回复简洁、自然,与真实候选人无异(无机械式开场白或说教)

- 基于上下文的记忆(RAG)用于过往会议

- 在问题提出时即时回答

- 临时/最终转录桥接:在录音过程中手动完成转录并桥接临时结果,提高准确性

- 智能回顾与摘要

即时屏幕 & 幻灯片分析(OCR)—— AI 编程面试助手

- 支持 LeetCode、HackerRank、CoderPad、Codility、HackerEarth 及任何基于浏览器的编程环境

- 一键快捷键捕获编程题目 —— 立即获得完整解答、解释及复杂度分析

- 隐形覆盖层不会出现在屏幕共享或录制画面中

- 支持多张截图处理多部分题目

- 若主视觉模型失败,智能回退至 Groq Llama 4 Scout

高级个人资料智能

- 职位描述 & 简历上下文:原生理解你的背景和应聘职位,提供高度定制化、上下文感知的回答

- 公司调研:即时获取你面试公司的深度情报与档案

- 谈判辅助:在薪资与录用谈判中提供实时策略指导

上下文操作

- 我该怎么回答?

- 缩短回复

- 回顾对话

- 建议后续问题

- 手动或语音触发提示

双通道音频智能

原生理解“听会议”和“与 AI 对话”是两项不同任务,并分别处理:

- 系统音频(会议声音):直接从操作系统捕获高保真音频(macOS 和 Windows 均完全支持),能清晰“听到”同事发言,不受房间环境噪音干扰。

- 采样率自动检测:动态检测并同步真实硬件采样率(例如自动处理 48kHz 音频接口或外接麦克风,避免失真或降采样伪影)。

- 两级静音处理:结合自适应 RMS 阈值与 WebRTC 机器学习语音活动检测(VAD),有效过滤打字声和风扇噪音。

- 麦克风输入(你的声音):专用于你的语音指令和口述输入。可即时切换,向 Natively 提出私密问题而无需关闭会议软件的麦克风。

Spotlight 搜索与自定义

- 全局激活快捷键(

Cmd+K/Ctrl+K) - 自定义按键绑定:可自定义全局快捷键,便于控制

- 即时答案覆盖层

- 即将开始的会议准备状态

本地 RAG(检索增强生成)与长期记忆

- 完全离线 RAG:所有向量嵌入(vector embeddings)和检索均在本地完成(SQLite +

sqlite-vec)。 - 语义搜索:创新的“智能范围(Smart Scope)”可自动判断你是在询问当前会议还是过去的某次会议。

- 滑动窗口 RAG:50 个 token 的语义重叠,防止在分块边界处丢失上下文。

- 纪元摘要(Epoch Summarization):采用更智能的转录文本内存管理机制,替代硬性截断——不再丢失会议早期的上下文。

- 全局知识:可跨所有过往会议提问(例如:“上个月我们对 API 做了什么决定?”)。

- 自动索引:会议内容会在后台自动分块、嵌入并建立索引。

高级隐私与隐蔽性

- 不可检测模式(Undetectable Mode):一键从 Dock/任务栏隐藏,并通过视觉锁定的选择器防止状态不一致。

- 跨窗口状态同步:在设置、启动器和叠加窗口之间实现实时状态同步。

- 进程伪装(Masquerading):可立即将应用伪装成终端、系统设置、活动监视器或其他无害工具,在屏幕共享时彻底规避被发现。

- 安全加固:退出应用时会从内存中清除 API 密钥,且凭据管理器会在释放密钥前覆盖关键数据。

- API 速率限制:采用令牌桶算法(突发/补充机制),避免在免费套餐提供商处触发 429 错误。

- 纯本地处理:所有数据均保留在你的设备上。

会议智能仪表盘

原生集成强大且以本地优先的会议管理系统,用于回顾、搜索和管理你的全部对话历史。

- 会议存档:访问每场过往会议的完整转录文本,支持按关键词或日期搜索。

- 智能导出:一键将转录文本和 AI 摘要导出为 Markdown、JSON 或纯文本——非常适合粘贴到 Notion、Obsidian 或 Slack 中。

- 使用统计:实时追踪你的 token 使用量和 API 成本,清晰掌握在 Gemini、OpenAI 或 Claude 上的具体花费。

- 音频分离:分别控制 系统音频(对方所说内容)和 麦克风(你口述的内容)。

- 会话管理:重命名、整理或删除过往会话,保持工作区整洁。

路线图

timeline

title Natively 产品路线图

section 短期(1-3 个月)

系统设计 : 可视化 MVP

用户角色 : 基础系统(3-5 个角色)

Token : 集成概念验证

section 中期(3-6 个月)

用户角色 : 完整库

系统设计 : 高级图表类型

Token : 社区功能

平台 : 移动应用开发

section 长期(6+ 个月)

协作 : 协同功能

生态系统 : 插件生态

平台 : 多语言支持

使用场景

学术与学习

- 实时辅助:在课堂上即时获取复杂知识点的解释。

- 翻译:在国际课程中实现即时语言翻译。

- 问题求解:立即获得编程或数学问题的帮助。

专业会议

- 面试支持:提供上下文感知的提示,助你应对技术问题。

- 销售与客户通话:实时澄清技术规格或之前讨论的要点。

- 会议摘要:自动提取行动项和核心决策。

开发与技术工作

- 代码洞察:解释屏幕上你不熟悉的代码块或逻辑。

- 调试:针对日志或终端错误提供上下文感知的协助。

- 架构设计:提供系统设计和集成模式的指导。

架构概览

Natively 在本地处理音频、屏幕上下文和用户输入,维护一个滚动上下文窗口,并仅将所需的提示数据发送至所选的 AI 提供商(本地或云端)。

除非用户明确启用,否则不会存储或传输原始音频、截图或转录文本。

技术细节

技术栈

- React, Vite, TypeScript, TailwindCSS

- Electron

- Rust(通过

napi::Buffer实现零拷贝 ABI 传输的原生音频处理——支持持续音频捕获,避免 V8 垃圾回收压力,相比典型 Electron 应用显著降低延迟和 CPU 占用) - SQLite(使用

sqlite-vec的本地存储)

支持的模型

- Gemini 3.1 系列

- OpenAI(GPT-5.4, o3 系列)

- Claude(4.6 系列)

- Ollama(Llama, Mistral, CodeLlama)

- Groq(Llama 3.3 用于文本,Llama 4 Scout 用于 OCR)

系统要求

- 最低配置:4GB RAM

- 推荐配置:8GB+ RAM

- 最佳体验:16GB+ RAM(用于本地 AI)

负责任的使用

Natively 旨在用于:

- 学习

- 提升生产力

- 辅助无障碍使用

- 专业协助

用户需自行遵守:

- 工作场所政策

- 学术规范

- 当地法律法规

本项目不鼓励任何滥用或欺骗行为。

已知限制

- Linux 支持有限,正在积极招募维护者

- 初始设置需用户自行提供 API 密钥或安装 Ollama

- 无内置模拟面试模式(聚焦于实时、现场辅助)

贡献指南

欢迎贡献!请参阅我们的 CONTRIBUTING.md 获取完整的入门指南。

- Bug 修复

- 功能改进

- 文档撰写

- UI/UX 优化

- 新的 AI 集成

高质量的 Pull Request 将被审核并合并。

维护者

| 维护者 | 职责 | 支持 |

|---|---|---|

| @evinjohnn | macOS 构建 |  |

| @razllivan | Windows 构建 |  |

许可证

本项目依据 GNU Affero 通用公共许可证 v3.0(AGPL-3.0)授权。

如果您通过网络运行或修改此软件,则必须在相同许可证下提供完整的源代码。

本仓库包含该项目的开源核心部分。

官方版本中提供的某些功能属于商业版 Premium Edition,不包含在此仓库中。

注意: 本项目接受赞助、广告或合作——非常适合 AI、生产力工具或开发者工具领域的公司。

如果 Natively 帮助您在会议、面试或演讲中取得成功,请为本仓库点个 Star!

常见问题(FAQ)

Natively 真的是免费的吗?

是的。Natively 是一个开源项目。您只需自带 API 密钥(如 Gemini、OpenAI、Anthropic 等)按实际使用付费,或者通过连接本地 Ollama 实例实现 100% 免费 使用。

Natively 是否支持 Zoom、Teams 和 Google Meet?

是的。Natively 使用基于 Rust 的系统音频捕获技术,可在任何桌面应用程序中通用工作,包括 Zoom、Microsoft Teams、Google Meet、Slack 和 Discord。

我的数据安全吗?

Natively 遵循 隐私优先设计(Privacy-by-Design) 原则。所有转录文本、向量嵌入(本地 RAG)和密钥均存储在您的本地设备上。我们没有后端服务器,仅收集有限的基本遥测数据(不含用户数据)。

我能用它参加技术面试吗?

Natively 是适用于任何专业场景的强大助手。但用户需自行遵守所在公司的政策及面试准则。

如何使用本地模型?

只需安装 Ollama,运行一个模型(例如 ollama run llama3),Natively 将自动检测到它。在 AI 提供商设置中启用 “Ollama” 即可切换至离线模式。

Natively 与 Cluely 相比如何?

Cluely 是一款每月 20 美元的云端工具,所有数据都存储在其服务器上。2025 年年中,Cluely 发生了一起数据泄露事件,导致 83,000 名用户的个人信息、对话记录和截图被曝光。而 Natively 是免费且开源的,所有数据均本地存储。它支持任意大语言模型(LLM,Large Language Model),不仅限于单一供应商,并通过 Ollama 提供本地 AI 能力,还具备经过实战检验的隐身模式。由于 Natively 没有服务器,因此从未发生过数据泄露。

隐身模式真的无法被检测到吗?

是的。Natively 会从程序坞(Dock)中隐藏自身,将进程名称伪装成无害的系统工具(如 Terminal、Activity Monitor、System Settings),并在所有窗口间同步状态。该功能已在五个主要版本中不断强化,并在 Zoom、Teams 和 Google Meet 中测试过屏幕共享检测。

Natively 能在 LeetCode 和 HackerRank 上使用吗?

可以。Natively 的截图 + OCR 功能可捕获任何可见的编程题目,并通过不可见的叠加层返回完整解答。它适用于 LeetCode、HackerRank、CoderPad、Codility、HackerEarth、Karat 以及任何基于浏览器的编程环境。

在编程面试中会被检测到吗?

对于标准在线测评(如 LeetCode、HackerRank、CoderPad 等),Natively 不会被检测到——它以伪装的系统进程运行,且叠加层不会出现在屏幕录制或屏幕共享中。但它 并非 用于绕过 Pearson VUE、ProctorU 或 Respondus Lockdown Browser 等操作系统级的专业监考软件。

Natively 是 Interview Coder 的免费替代品吗?

是的。Natively 能完成 Interview Coder 所做的所有事情——截图 OCR、实时编程辅助、不可见叠加层——并额外提供行为面试支持、系统设计帮助、本地 RAG 记忆以及支持任意 LLM 的自带密钥(BYOK, Bring Your Own Key)功能。而且全部免费。

Natively 可替代的工具

Natively 是以下工具的免费开源替代方案:

| 工具 | Natively 替代的功能 |

|---|---|

| Cluely | 实时 AI 会议副驾 —— 无需每月 20 美元费用或数据泄露风险 |

| Final Round AI | 实时 AI 面试副驾 —— 无需每月 149 美元费用或监考可见的任务栏图标 |

| LockedIn AI | 实时面试助手 —— 无需云绑定或每月 70 美元 |

| Interview Coder | AI 编程面试助手 —— 不仅限于编程环节,还包含完整的会议上下文 |

| Parakeet AI | 实时会议助手 —— 支持本地 RAG 记忆和完整历史记录仪表盘 |

| Metaview | 自动会议纪要 —— 开源且本地存储 |

| Otter.ai | 转录与会议摘要 —— 无需云存储 |

| Fireflies.ai | 会议录音与 AI 记录员 —— 完全本地存储 |

| Teal | 求职与面试助手 —— 完全本地化且免费 |

ai-assistant · meeting-notes · interview-helper · cluely-alternative · cluely · lockhead-ai · lockheed-ai · parakeet-ai · interview-coder · final-round-ai · metaview-alternative · otter-ai-alternative · fireflies-alternative · local-ai · ollama · electron · privacy-first · open-source · real-time-transcription · interview-copilot · ai-meeting-assistant · moltbot

支持 Natively

围绕 Natively 的社区在 Pump.fun 上创建了一个代币以支持该项目。

创作者奖励有助于覆盖 AI/API 费用 和持续开发成本。

Star History(Star 历史)

版本历史

v2.2.02026/04/042.1.02026/03/31v2.1.0-beta.22026/04/01v2.1.0-beta.12026/03/31v2.0.92026/03/28v2.0.82026/03/24v2.0.72026/03/23v2.0.62026/03/17v2.0.52026/03/15v2.0.42026/03/14v2.0.32026/03/13v2.0.22026/03/11v2.0.12026/03/06v2.02026/03/02v1.1.82026/02/23v1.1.72026/02/20v1.1.62026/02/14v1.1.52026/02/13v1.1.32026/02/09v1.1.22026/02/08常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。