Baichuan-7B

Baichuan-7B 是由百川智能推出的开源大语言模型,参数规模为 70 亿,专为中英文双语场景设计。它在约 1.2 万亿 tokens 的语料上训练而成,支持长达 4096 的上下文窗口,适合处理需要长文本理解的任务。在多个中文权威评测(如 C-Eval、高考题、AGIEval)中,Baichuan-7B 在同尺寸模型中表现领先,尤其在中文理解和推理能力上优势明显。

它主要解决的是中小团队或个人开发者难以获取高性能、可商用中文大模型的问题。相比闭源商业模型,Baichuan-7B 允许自由下载、研究和商用部署,降低了技术门槛。适合 AI 研究人员、NLP 工程师、初创公司开发者使用,可用于构建对话系统、内容生成、教育辅助等应用。

技术亮点包括:基于标准 Transformer 架构优化,兼顾效率与效果;训练数据覆盖广泛领域,强化中文语义理解;支持 Hugging Face 和 ModelScope 双平台快速调用。虽然官方已推出更强的 Baichuan 2 系列,但 Baichuan-7B 仍是一个轻量高效、适合本地部署和教学研究的优质选择。

使用场景

某在线教育平台的产品经理正在为高中生开发一款“AI智能题库助手”,用于自动解析高考真题、生成讲解和推荐相似题,以提升学生自学效率。

没有 Baichuan-7B 时

- 平台依赖通用英文大模型(如 LLaMA-7B),对中文语境理解差,经常误读文言文或政治题干中的隐含逻辑。

- 高考题型复杂,模型在单选题上的准确率仅约27%,导致生成的解析错误频出,需人工逐题校对,成本高昂。

- 无法根据学科特点(如理科重推理、文科重语义)动态调整回答策略,学生体验割裂。

- 模型上下文窗口短,处理长题干或多段材料题时频繁截断,丢失关键信息。

- 缺乏中英双语支持,遇到英语阅读题或双语对照内容时直接失效。

使用 Baichuan-7B 后

- Baichuan-7B 在 C-Eval 和 Gaokao 中文评测中表现领先,高考单选题准确率跃升至36.24%,大幅减少人工干预需求。

- 内置中英双语能力与4096长度上下文窗口,可完整处理英语阅读理解+中文解析的混合题型,支持跨语言题干分析。

- 针对STEM、人文等不同学科优化过训练数据,在解析物理公式推导或历史事件因果时更贴合教学逻辑。

- 支持5-shot提示学习,只需提供少量示例即可让模型模仿教师口吻生成结构化讲解,风格统一、易懂。

- 开源商用许可允许平台自由部署和微调,可针对各省考纲定制模型分支,实现区域化精准辅导。

Baichuan-7B 让教育科技团队用极低成本获得接近人类教师水平的中文题解生成能力,真正实现“千人千面”的智能辅学体验。

运行环境要求

未说明

未说明

快速开始

Baichuan-7B

🤗 Hugging Face • 🤖 ModelScope • 💬 微信

更新信息

- [2023.09.06] 我们发布了新一代开源模型 Baichuan 2,包含 7B、13B 尺寸 🔥🔥🔥

介绍

Baichuan-7B 是由百川智能开发的一个开源可商用的大规模预训练语言模型(Large Language Model, LLM)。基于 Transformer 结构,在大约 1.2 万亿 tokens 上训练的 70 亿参数模型,支持中英双语,上下文窗口长度为 4096。在标准的中文和英文 benchmark(C-Eval/MMLU)上均取得同尺寸最好的效果。

公开benchmark榜单

中文评测

C-Eval

C-Eval 数据集是一个全面的中文基础模型评测数据集,涵盖了 52 个学科和四个难度的级别。我们使用该数据集的 dev 集作为 few-shot 的来源,在 test 集上进行了 5-shot 测试。通过执行执行下面的命令:

cd evaluation

python evaluate_zh.py --model_name_or_path 'your/model/path'

结果

| Model 5-shot | Average | Avg(Hard) | STEM | Social Sciences | Humanities | Others |

|---|---|---|---|---|---|---|

| GPT-4 | 68.7 | 54.9 | 67.1 | 77.6 | 64.5 | 67.8 |

| ChatGPT | 54.4 | 41.4 | 52.9 | 61.8 | 50.9 | 53.6 |

| Claude-v1.3 | 54.2 | 39.0 | 51.9 | 61.7 | 52.1 | 53.7 |

| Claude-instant-v1.0 | 45.9 | 35.5 | 43.1 | 53.8 | 44.2 | 45.4 |

| BLOOMZ-7B | 35.7 | 25.8 | 31.3 | 43.5 | 36.6 | 35.6 |

| ChatGLM-6B | 34.5 | 23.1 | 30.4 | 39.6 | 37.4 | 34.5 |

| Ziya-LLaMA-13B-pretrain | 30.2 | 22.7 | 27.7 | 34.4 | 32.0 | 28.9 |

| moss-moon-003-base (16B) | 27.4 | 24.5 | 27.0 | 29.1 | 27.2 | 26.9 |

| LLaMA-7B-hf | 27.1 | 25.9 | 27.1 | 26.8 | 27.9 | 26.3 |

| Falcon-7B | 25.8 | 24.3 | 25.8 | 26.0 | 25.8 | 25.6 |

| TigerBot-7B-base | 25.7 | 27.0 | 27.3 | 24.7 | 23.4 | 26.1 |

| Aquila-7B* | 25.5 | 25.2 | 25.6 | 24.6 | 25.2 | 26.6 |

| Open-LLaMA-v2-pretrain (7B) | 24.0 | 22.5 | 23.1 | 25.3 | 25.2 | 23.2 |

| BLOOM-7B | 22.8 | 20.2 | 21.8 | 23.3 | 23.9 | 23.3 |

| Baichuan-7B | 42.8 | 31.5 | 38.2 | 52.0 | 46.2 | 39.3 |

Gaokao

Gaokao 是一个以中国高考题作为评测大语言模型能力的数据集,用以评估模型的语言能力和逻辑推理能力。

我们只保留了其中的单项选择题,随机划分后对所有模型进行统一 5-shot 测试。

结果

以下是测试的结果。

| Model | Average |

|---|---|

| BLOOMZ-7B | 28.72 |

| LLaMA-7B | 27.81 |

| BLOOM-7B | 26.96 |

| TigerBot-7B-base | 25.94 |

| Falcon-7B | 23.98 |

| Ziya-LLaMA-13B-pretrain | 23.17 |

| ChatGLM-6B | 21.41 |

| Open-LLaMA-v2-pretrain | 21.41 |

| Aquila-7B* | 24.39 |

| Baichuan-7B | 36.24 |

AGIEval

AGIEval 旨在评估模型的认知和解决问题相关的任务中的一般能力。

我们只保留了其中的四选一单项选择题,随机划分后对所有模型进行了统一 5-shot 测试。

结果

| Model | Average |

|---|---|

| BLOOMZ-7B | 30.27 |

| LLaMA-7B | 28.17 |

| Ziya-LLaMA-13B-pretrain | 27.64 |

| Falcon-7B | 27.18 |

| BLOOM-7B | 26.55 |

| Aquila-7B* | 25.58 |

| TigerBot-7B-base | 25.19 |

| ChatGLM-6B | 23.49 |

| Open-LLaMA-v2-pretrain | 23.49 |

| Baichuan-7B | 34.44 |

*其中 Aquila 模型来源于智源官方网站(https://model.baai.ac.cn/model-detail/100098) 仅做参考

英文榜单

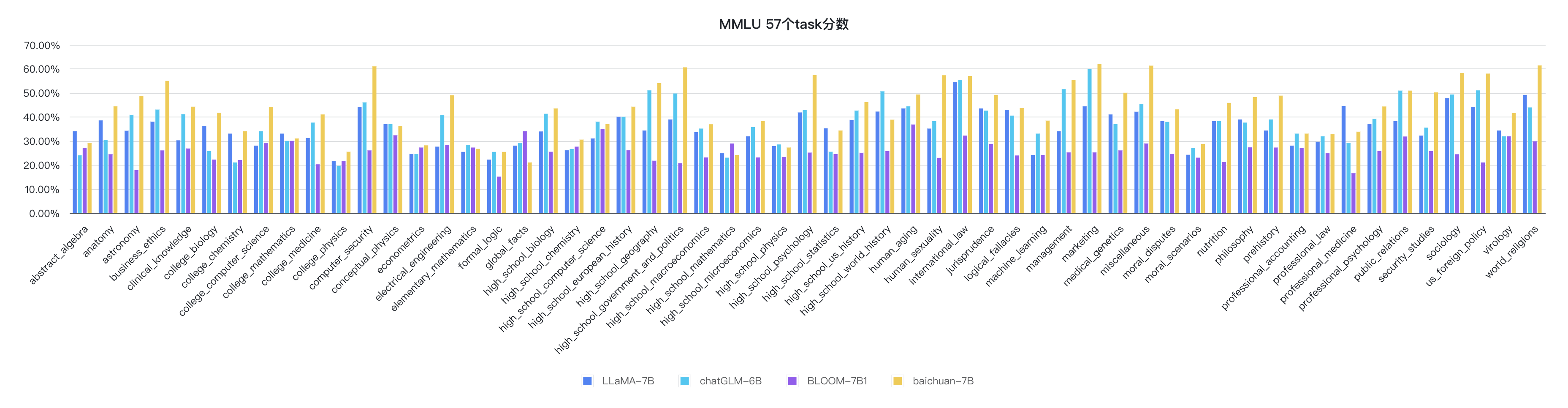

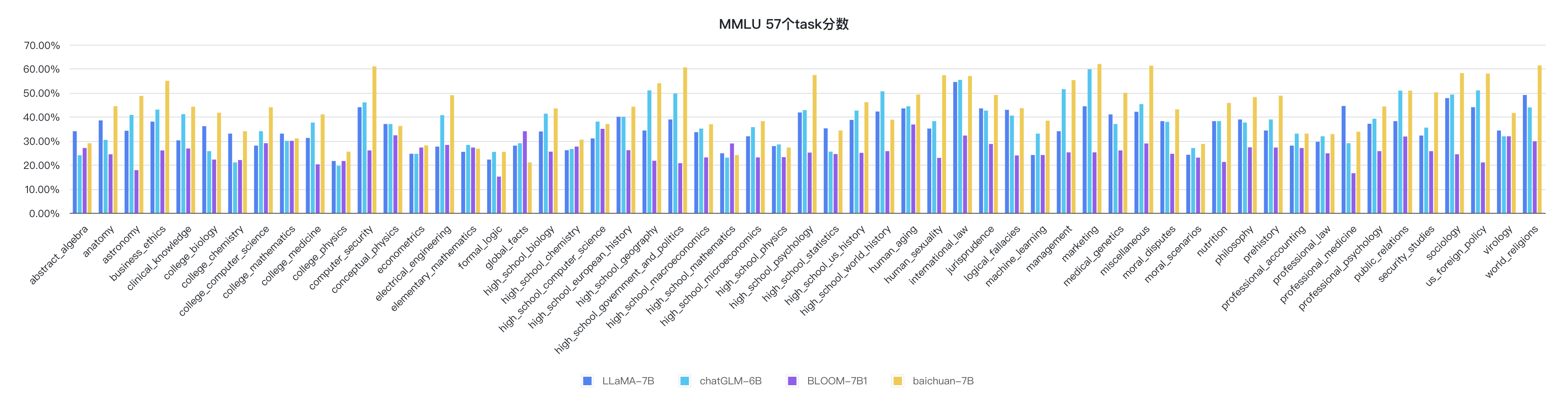

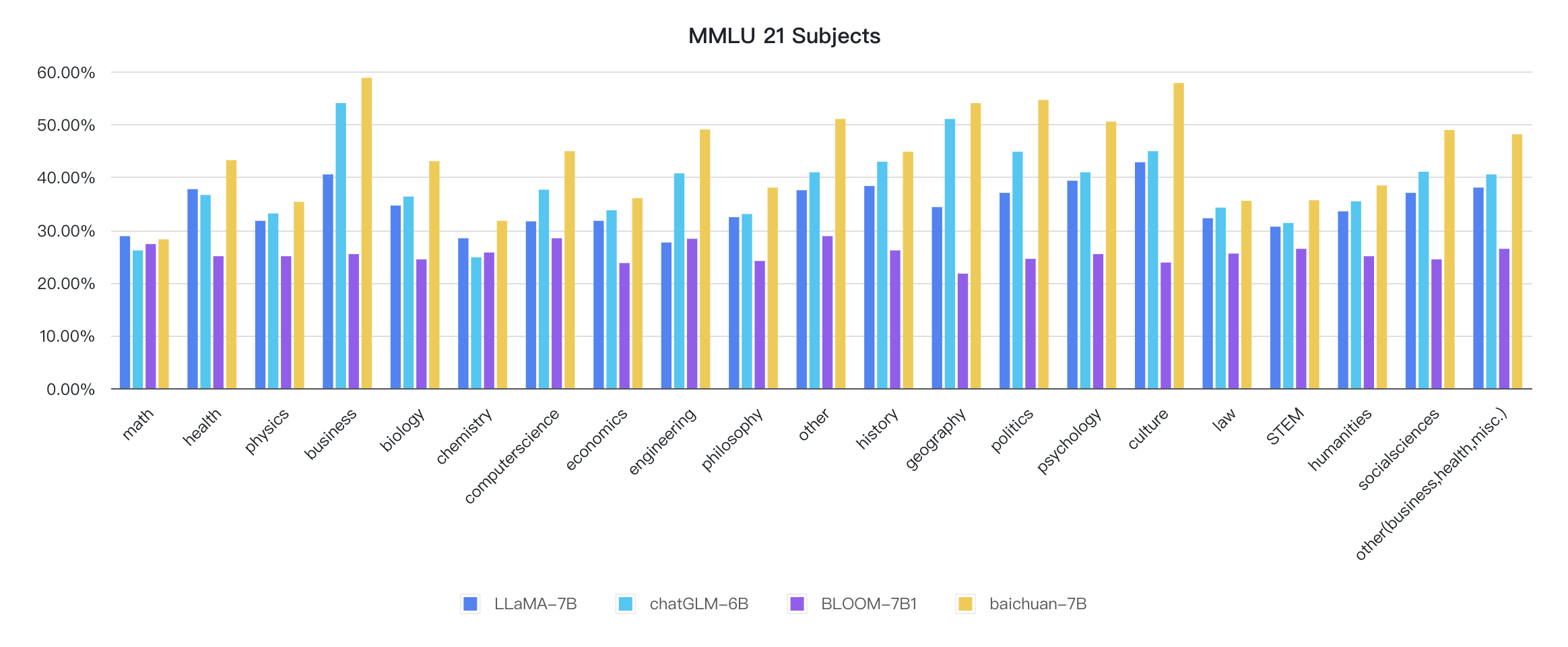

除了中文之外,Baichuan-7B也测试了模型在英文上的效果,MMLU 是包含 57 个多选任务的英文评测数据集,涵盖了初等数学、美国历史、计算机科学、法律等,难度覆盖高中水平到专家水平,是目前主流的LLM评测数据集。我们采用了开源 的评测方案,最终 5-shot 结果如下所示:

结果

| Model | Humanities | Social Sciences | STEM | Other | Average |

|---|---|---|---|---|---|

| ChatGLM-6B0 | 35.4 | 41.0 | 31.3 | 40.5 | 36.9 |

| BLOOMZ-7B0 | 31.3 | 42.1 | 34.4 | 39.0 | 36.1 |

| mpt-7B1 | - | - | - | - | 35.6 |

| LLaMA-7B2 | 34.0 | 38.3 | 30.5 | 38.1 | 35.1 |

| Falcon-7B1 | - | - | - | - | 35.0 |

| moss-moon-003-sft (16B)0 | 30.5 | 33.8 | 29.3 | 34.4 | 31.9 |

| BLOOM-7B0 | 25.0 | 24.4 | 26.5 | 26.4 | 25.5 |

| moss-moon-003-base (16B)0 | 24.2 | 22.8 | 22.4 | 24.4 | 23.6 |

| Baichuan-7B0 | 38.4 | 48.9 | 35.6 | 48.1 | 42.3 |

0: 重新复现

1: https://huggingface.co/spaces/HuggingFaceH4/open_llm_leaderboard

2: https://paperswithcode.com/sota/multi-task-language-understanding-on-mmlu

复现方法

git clone https://github.com/hendrycks/test

cd test

wget https://people.eecs.berkeley.edu/~hendrycks/data.tar

tar xf data.tar

mkdir results

cp ../evaluate_mmlu.py .

python evaluate_mmlu.py -m /path/to/Baichuan-7B

其中在 MMLU 上57个任务的具体细指标如下图:

其中各个学科的指标如下图:

推理方法

推理代码已在官方 Huggingface 库中提供:

from transformers import AutoModelForCausalLM, AutoTokenizer

tokenizer = AutoTokenizer.from_pretrained("baichuan-inc/Baichuan-7B", trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained("baichuan-inc/Baichuan-7B", device_map="auto", trust_remote_code=True)

inputs = tokenizer('登鹳雀楼->王之涣\n夜雨寄北->', return_tensors='pt')

inputs = inputs.to('cuda:0')

pred = model.generate(**inputs, max_new_tokens=64,repetition_penalty=1.1)

print(tokenizer.decode(pred.cpu()[0], skip_special_tokens=True))

数据

- 原始数据包括开源的中英文数据、自行抓取的中文互联网数据,以及部分高质量知识性数据。

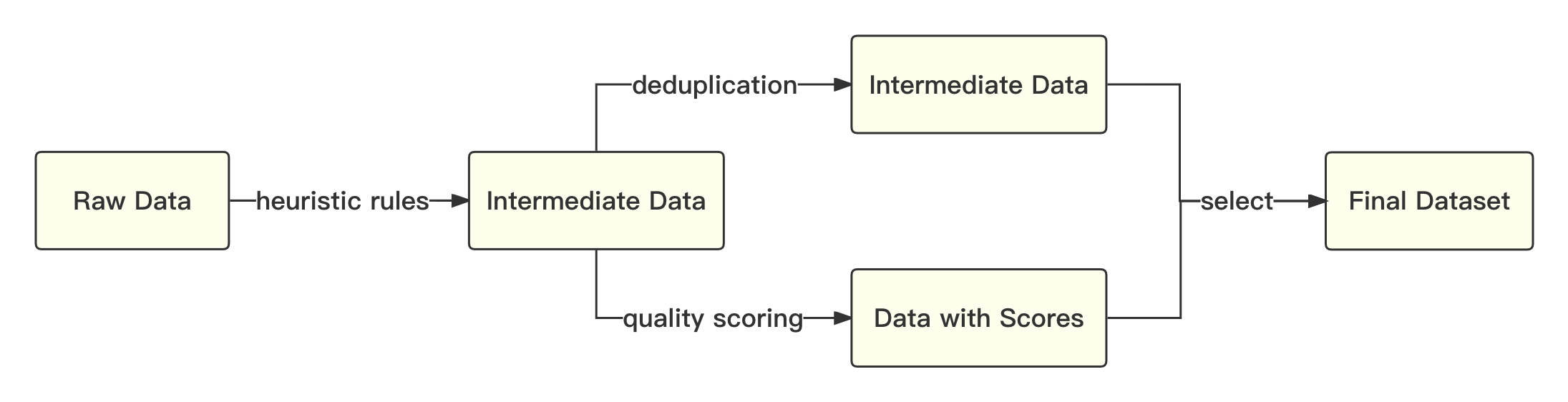

- 参考相关数据工作,频率和质量是数据处理环节重点考虑的两个维度。我们基于启发式规则和质量模型打分,对原始数据集进行篇章级和句子级的过滤。在全量数据上,利用局部敏感哈希(Locality-Sensitive Hashing, LSH)方法,在篇章和句子粒度上进行去重。

整体流程如下所示:

- 经过多轮调整和测试,最终确认了一个在下游任务上表现最优的中英文数据配比。

- 我们采用了一种基于自动学习的数据权重策略,对不同类别的数据进行动态配比。

分词

我们参考学术界方案,使用 SentencePiece 中的 Byte-Pair Encoding (BPE, 字节对编码) 作为分词算法,并进行了以下优化:

- 当前多数开源模型主要针对英文优化,导致对中文语料压缩效率较低。我们使用 2000 万条以中英为主的多语言语料训练分词模型,显著提升了中文的压缩率。

- 针对数学领域,我们参考了 LLaMA 和 Galactica 的方案,将每个数字位单独拆分,避免数字表达不一致的问题,这对提升数学能力有重要帮助。

- 对于罕见字词(如特殊符号等),支持 UTF-8 字符的字节级编码,从而实现对未知字词的全覆盖。

- 我们分析了不同分词器对语料的压缩率,如下表所示。可见我们的分词器明显优于 LLaMA、Falcon 等开源模型;与其他中文分词器相比,在压缩率相当的情况下,训练和推理效率更高。

| Model | Baichuan-7B | LLaMA | Falcon | mpt-7B | ChatGLM | moss-moon-003 |

|---|---|---|---|---|---|---|

| Compress Rate | 0.737 | 1.312 | 1.049 | 1.206 | 0.631 | 0.659 |

| Vocab Size | 64,000 | 32,000 | 65,024 | 50,254 | 130,344 | 106,029 |

模型结构

整体模型基于标准的 Transformer 结构,我们采用了与 LLaMA 相同的模型设计:

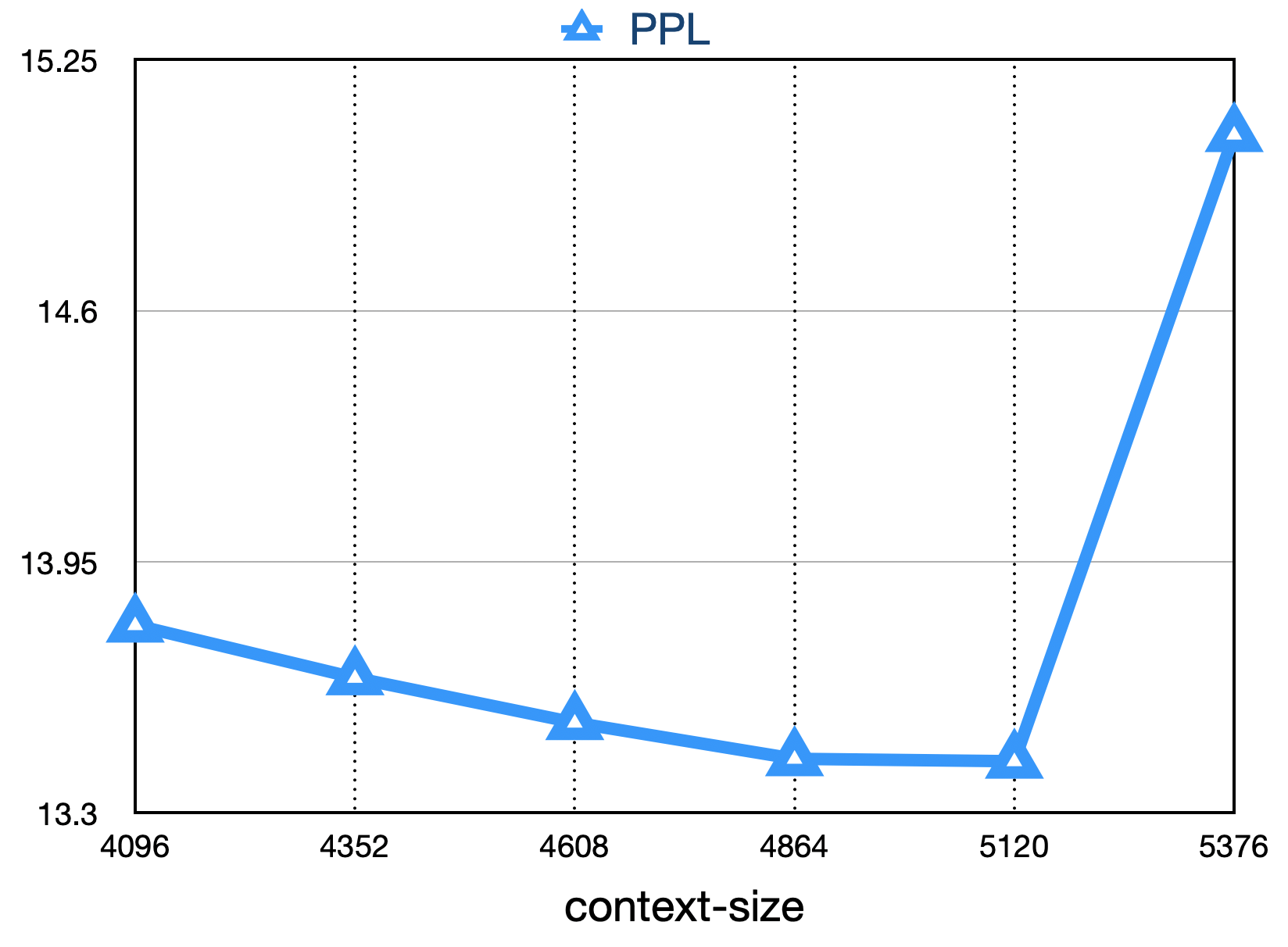

- 位置编码:rotary-embedding 是当前主流模型广泛采用的位置编码方案,具有更好的外推性能。虽然训练过程中最大长度为 4096,但在实际测试中,模型可良好扩展至 5000 tokens 以上,如下图所示:

- 激活层:SwiGLU,Feedforward 层维度扩大为隐含层大小的 8/3 倍,即 11,008。

- Layer-Normalization:采用 RMSNorm 的 Pre-Normalization 结构。

训练稳定性和吞吐

我们在原 LLaMA 框架基础上进行了多项修改,以提升训练吞吐,具体包括:

- 算子优化技术:采用更高效算子,如 Flash-Attention、NVIDIA apex 的 RMSNorm 等。

- 算子切分技术:将部分计算算子进行切分,降低内存峰值占用。

- 混合精度技术:在不损失模型精度的前提下加速计算过程。

- 训练容灾技术:训练平台与框架联合优化,通过 IaaS + PaaS 实现分钟级故障定位与任务恢复。

- 通信优化技术,具体包括:

- 采用拓扑感知的集合通信算法,避免网络拥塞,提高通信效率。

- 根据 GPU 卡数自适应设置 bucket size,提高带宽利用率。

- 根据模型和集群环境,调优通信原语触发时机,实现计算与通信重叠。

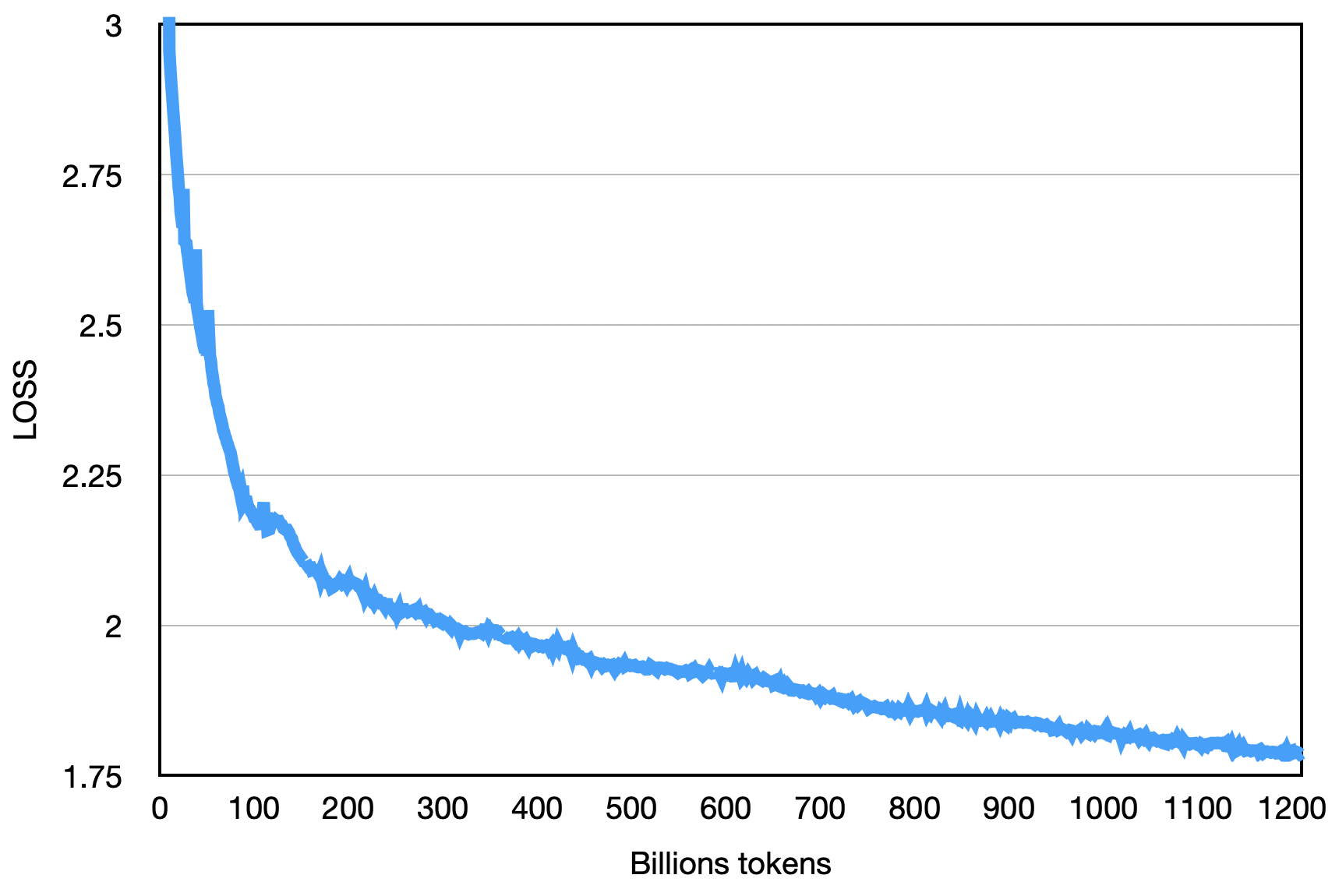

基于上述优化技术,我们在千卡 A800 显卡集群上实现了 7B 模型 182 TFLOPS 的吞吐,GPU 峰值算力利用率达 58.3%。

最终 loss 曲线如下图所示:

训练方法

安装依赖

pip install -r requirements.txt

准备数据

用户需将训练语料按总 rank 数的倍数均匀切分为多个 UTF-8 文本文件,放置于语料目录(默认为 data_dir)下。各 rank 进程将读取不同文件,全部加载到内存后开始训练。以上为简化示范流程,建议用户在正式训练任务中根据需求调整数据生产逻辑。

下载 tokenizer 模型

下载 tokenizer 模型文件 tokenizer.model,并放置于项目根目录下。

配置 DeepSpeed

本示例代码采用 DeepSpeed 框架进行训练。用户需根据集群情况修改 config/hostfile;若为多机多卡环境,需配置 ssh 中各节点的 IP 地址。详情请参见 DeepSpeed 官方文档。

执行训练

scripts/train.sh

协议

本仓库源码遵循开源许可协议 Apache 2.0。

Baichuan-7B 支持商用用途。如您计划将 Baichuan-7B 模型或其衍生品用于商业目的,请通过以下方式联系许可方进行登记并申请书面授权:联系邮箱:opensource@baichuan-inc.com,具体许可协议详见《Baichuan-7B 模型许可协议》。

第三方资源

- LLaMA Efficient Tuning 支持 Baichuan-7B 使用 Qlora 进行 Finetune,支持 RLHF 与 WebDemo。使用经过 sft 微调的模型见 hiyouga/baichuan-7b-sft。

- fireballoon/baichuan-vicuna-chinese-7b 使用 ShareGPT、ShareGPT-ZH、COT & COT-ZH、Leetcode、dummy 等中英文混合数据微调后的模型,训练代码参考 FastChat。

- fireballoon/baichuan-vicuna-7b 使用 ShareGPT、COT 和 Leetcode 等数据混合微调后的模型,训练代码参考 FastChat。

- Efficient-Tuning-LLMs 支持 Baichuan-7B 使用 Qlora 进行 Finetune 和 4bit 推理。

- fastllm fastllm 是纯 C++ 实现、无第三方依赖的大模型库,支持 Baichuan-7B 在手机端运行。

- TheBloke/baichuan-7B-GPTQ 对 Baichuan-7B 进行 GPTQ 4bit 量化版本。

Star History

常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。