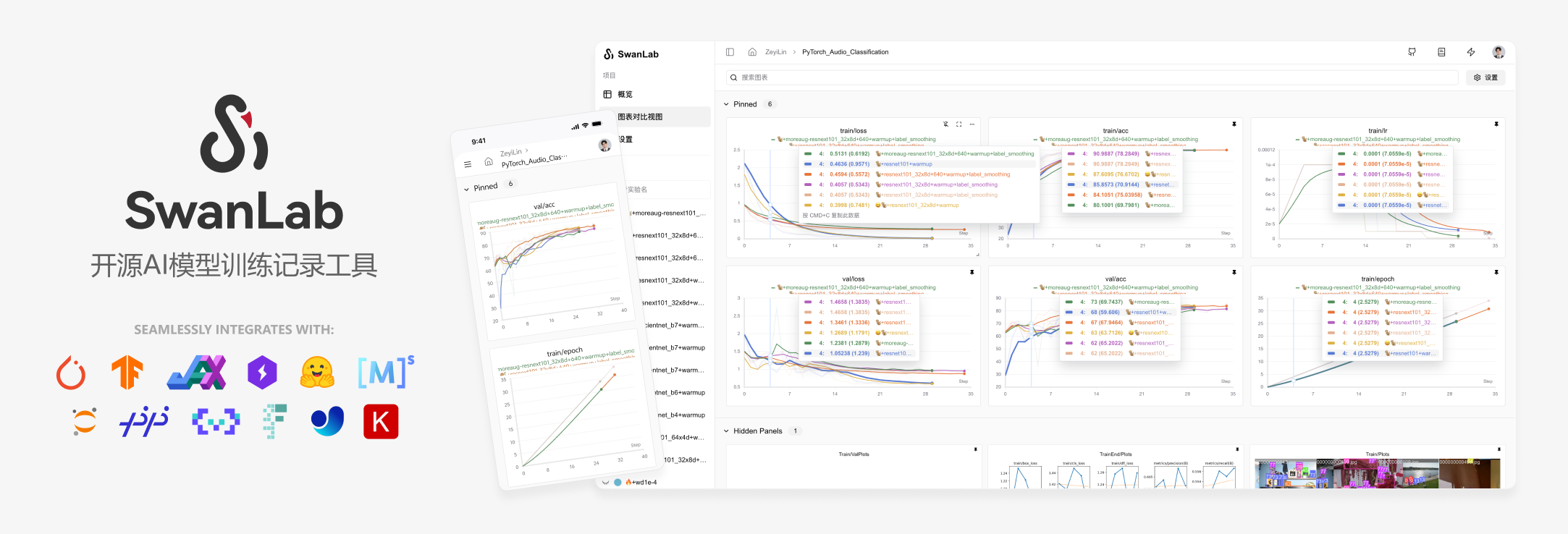

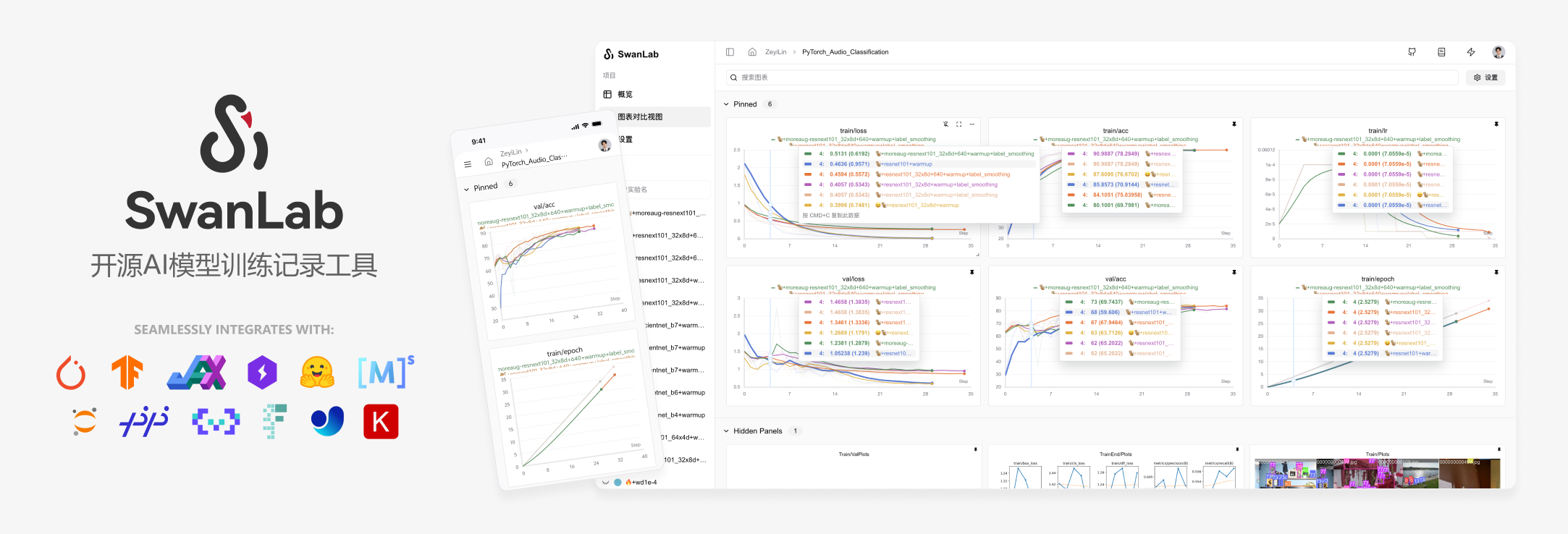

SwanLab

SwanLab 是一款专为 AI 训练设计的开源实验跟踪与可视化平台,旨在帮助开发者和研究人员更高效地管理模型训练过程。在深度学习研究中,面对海量的超参数组合和复杂的训练指标,传统记录方式往往导致数据分散、难以对比复现。SwanLab 通过简洁的代码集成,自动捕获并可视化关键训练指标、系统硬件状态及超参数配置,让实验过程透明化、数据结构化,从而加速模型迭代与问题排查。

这款工具特别适合 AI 算法工程师、科研人员以及需要协同工作的机器学习团队使用。无论是个人开发者进行小规模实验,还是大型团队协作处理分布式训练任务,SwanLab 都能提供流畅的体验。它支持云端 SaaS 服务与私有化部署两种模式,兼顾了使用的便捷性与数据的安全性。

在技术亮点方面,SwanLab 展现了极强的兼容性与性能优化能力。它不仅无缝集成 PyTorch、Transformers、Ultralytics、LLaMA Factory 等 50 多个主流 AI 框架,还针对大规模图表渲染推出了“闪电看板(LightningBoard)”,确保在海量数据下依然保持流畅交互。此外,SwanLab 支持 AMD ROCm 等多种硬件监控,提供实验置顶、Baseline 对比分析、多进程并行记录等实用功能,并允许将图表嵌入 Notion 或飞书文档,极大地提升了实验分析与团队沟通的效率。凭借现代化的界面设计与低侵入式的接入方式,SwanLab 成为提升 AI 研发效能的得力助手。

使用场景

某AI初创团队正在基于LLaMA Factory框架微调垂直领域的大语言模型,需要同时调整学习率、Batch Size和LoRA秩等多个超参数,以寻找最优收敛效果。

没有 SwanLab 时

- 数据记录混乱:团队成员各自在本地保存TensorBoard日志或CSV文件,实验元数据(如Git commit、硬件环境)依赖手动备注,极易出现记录遗漏或版本混淆。

- 对比分析低效:想要比较不同超参数组合的效果,需手动打开多个日志文件或在本地启动多个TensorBoard实例,无法直观地在同一坐标系下对比Loss曲线和评估指标。

- 资源监控缺失:训练过程中GPU显存溢出(OOM)或利用率波动时,缺乏实时的硬件监控数据,难以判断是模型架构问题还是资源分配不当,排查故障耗时极长。

- 协作沟通成本高:每日站会中,成员需截图发送训练进度,管理者无法实时掌握整体实验进展,难以快速识别并终止表现不佳的实验以节省算力。

使用 SwanLab 后

- 自动化实验追踪:通过几行代码集成LLaMA Factory,SwanLab自动记录超参数、代码版本及系统环境,所有实验数据统一云端/自托管存储,确保数据可追溯且零手动维护成本。

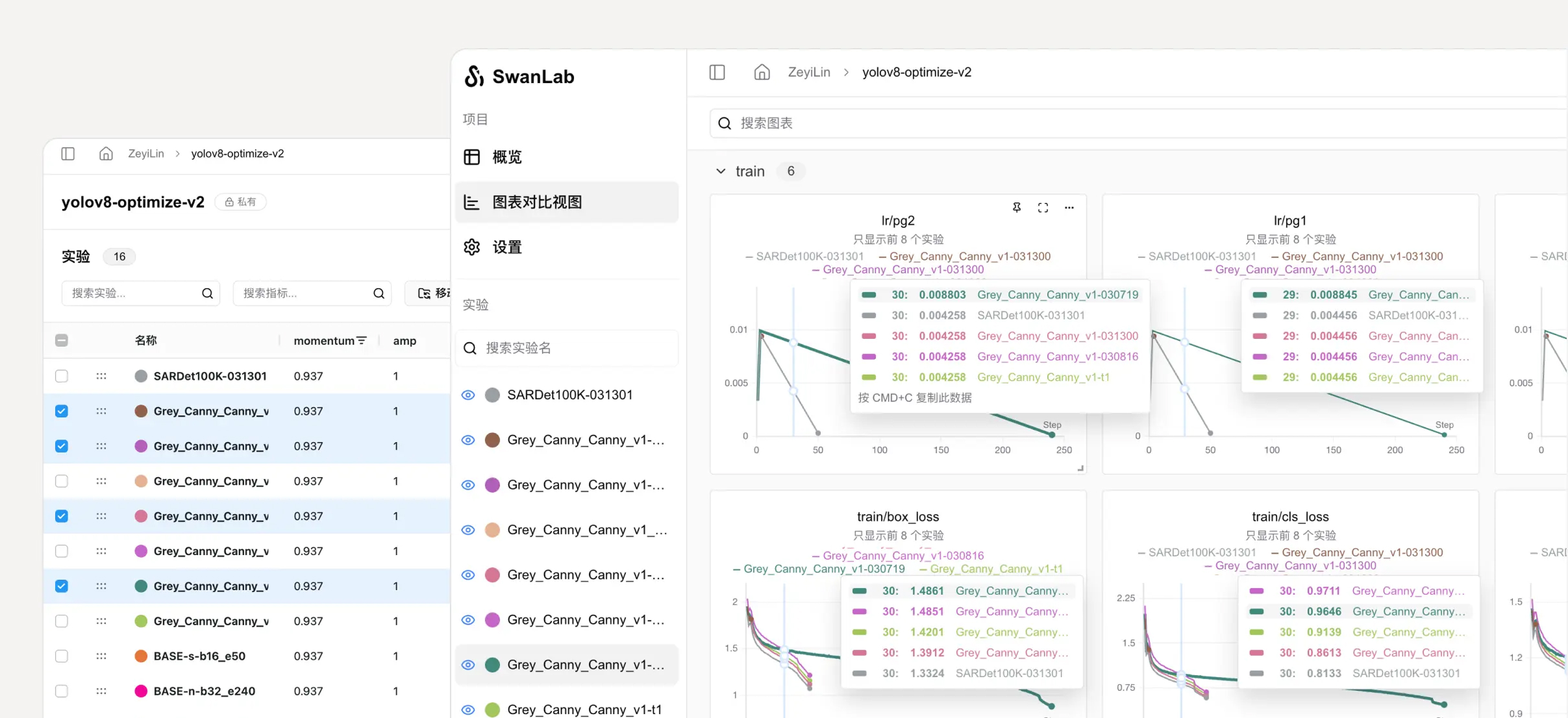

- 可视化多维对比:利用“实验分组”和“Baseline对比”功能,一键将多次实验的Loss、Accuracy曲线叠加显示,并自动计算差异百分比,迅速锁定最佳参数组合。

- 实时硬件洞察:内置GPU/CPU监控面板实时展示显存占用与温度变化,结合异常报警,帮助开发者在OOM发生前及时调整Batch Size,显著提升调试效率。

- 高效团队协作:通过分享链接,团队成员和管理者可随时查看实时训练看板,支持将图表嵌入飞书/Notion文档,实现实验进度的透明化管理与即时决策。

SwanLab 将原本碎片化、黑盒化的训练过程转化为结构化、可视化的数据资产,显著缩短了从实验迭代到模型落地的周期。

运行环境要求

- Linux

- macOS

- Windows

- 非必需

- 若启用硬件监控,支持 NVIDIA GPU, AMD ROCm, Huawei Ascend NPU, Cambricon MLU, Kunlunxin XPU, Haiguang DCU, MetaX GPU, Moore Threads GPU, Iluvatar GPU

- 具体显存和CUDA版本未说明,取决于所运行的AI模型框架

未说明

快速开始

一个专业、现代化设计的AI训练分析平台

面向模型训练团队,与50+主流框架集成,与你的实验代码轻松结合

🔥SwanLab 在线版 · 📃 文档 · 报告问题 · 建议反馈 · 更新日志 · 基线社区

👋 加入我们的微信群

目录

🌟 最近更新

- 2026.03.25:📊 实验置顶上线,一键将最好的实验固定在到最好找的位置;Baseline对比功能上线,支持将实验们和baseline对比并显示差异百分比,加速找到最佳参数组合;

https://github.com/user-attachments/assets/964380e0-feb2-480d-b1ca-eba1be239ebb

2026.03.19:📊 新增实验复制功能,支持将创建实验副本到不同项目、团队下;parallel模式上线,支持在不同进程同时记录指标到同一实验下;实验ID现在可以自定义了;

2026.02.06: 🔥 swanlab.Api已正式上线,提供更强大的、面向对象式的开放API接口,文档;ECharts.Table支持CSV下载;现在支持将图表一键置于分组首位了;

2026.01.28:⚡️ LightningBoard V2上线,进一步提升仪表盘性能;

2026.01.16:⚡️ LightningBoard(闪电看板)V1 现已上线,专为超大图表数量级场景打造;新增图表嵌入链接,现在可以把你的图表嵌入到在线文档当中(如Notion、飞书云文档等);

2026.01.02:🥳 新增对AMD ROCm与天数智芯Iluvatar GPU的硬件监控支持;SDK增加心跳包特性,实现更稳健的端云连接;

2025.12.15:🎉 SwanLab Kubernetes版 现已发布!部署文档;NVIDIA NeMo RL 框架已集成SwanLab,文档;

2025.12.01:🕰 新增折线图详细信息展示,鼠标悬浮在折线图上时,单击Shift将开启详细模式,支持显示当前log点的时间;📊 图表分组支持MIN/MAX区域范围显示;

2025.11.17:📊 全局图表配置增加X轴数据源选择、悬停模式功能,增加图表分析体验;增加

SWANLAB_WEBHOOK功能;文档

完整更新日志

2025.11.06:🔪 实验分组上线,支持对大批量实验进行分组管理;工作区页面升级,支持快捷在多个组织下切换;大幅优化了折线图的渲染性能;swanlab.init上线

group与job_type参数;2025.10.15:📊折线图配置支持X轴数据源选择;侧边栏支持显示表格视图中Pin的列,增强实验数据对齐能力;

2025.09.22:📊全新UI上线;表格视图支持全局排序和筛选;数据层面统一表格视图与图表视图;

2025.09.12:🔢支持创建标量图,灵活显示实验指标的统计值;组织管理页面大升级,提供更强大的权限控制与项目管理能力;

2025.08.19:🤔更强大的图表渲染性能与低侵入式加载动画,让研究者更聚焦于实验分析本身;集成优秀的MLX-LM、SpecForge框架,提供更多场景的训练体验;

2025.08.06:👥训练轻协作上线,支持邀请项目协作者,分享项目链接与二维码;工作区支持列表视图,支持显示项目Tags;

2025.07.29:🚀侧边栏支持实验筛选、排序;📊表格视图上线列控制面板,能够方便地实现列的隐藏与显示;🔐多API Key管理上线,让你的数据更安全;swanlab sync提高了对日志文件完整性的兼容,适配训练崩溃等场景;新图表-PR曲线、ROC曲线、混淆矩阵上线,文档;

2025.07.17:📊更强大的折线图配置,支持灵活配置线型、颜色、粗细、网格、图例位置等;📹支持swanlab.Video数据类型,支持记录与可视化GIF格式文件;全局图表仪表盘支持配置Y轴与最大显示实验数;

2025.07.10:📚更强大的文本视图,支持Markdown渲染与方向键切换,可由

swanlab.echarts.table与swanlab.Text创建,Demo2025.07.06:🚄支持resume断点续训;新插件文件记录器;集成ray框架,文档;集成ROLL框架,感谢@PanAndy,文档

2025.06.27:📊支持小折线图局部放大;支持配置单个折线图平滑;大幅改进了图像图表放大后的交互效果;

2025.06.20:🤗集成accelerate框架,PR,文档,增强分布式训练中的实验记录体验;

2025.06.18:🐜集成AREAL框架,感谢@xichengpro,PR,文档;🖱支持鼠标Hover到侧边栏实验时,高亮相应曲线;支持跨组对比折线图;支持设置实验名裁剪规则;

2025.06.11:📊支持 swanlab.echarts.table 数据类型,支持纯文本图表展示;支持对分组进行拉伸交互,以增大同时显示的图表数量;表格视图增加 指标最大/最小值 选项;

2025.06.08:♻️支持在本地存储完整的实验日志文件,通过 swanlab sync 上传本地日志文件到云端/私有化部署端;硬件监控支持海光DCU;

2025.06.01:🏸支持图表自由拖拽;支持ECharts自定义图表,增加包括柱状图、饼状图、直方图在内的20+图表类型;硬件监控支持沐曦GPU;集成 PaddleNLP 框架;

2025.05.25:日志支持记录标准错误流,PyTorch Lightning等框架的打印信息可以被更好地记录;硬件监控支持摩尔线程;新增运行命令记录安全防护功能,API Key将被自动隐藏;

2025.05.14:支持实验Tag;支持折线图Log Scale;支持分组拖拽;大幅度优化了大量指标上传的体验;增加

swanlab.OpenApi开放接口;2025.05.09:支持折线图创建;配置图表功能增加数据源选择功能,支持单张图表显示不同的指标;支持生成训练项目GitHub徽章;

2025.04.23:支持折线图编辑,支持自由配置图表的X、Y轴数据范围和标题样式;图表搜索支持正则表达式;支持昆仑芯XPU的硬件检测与监控;

2025.04.11:支持折线图局部区域选取;支持全局选择仪表盘折线图的step范围;支持一键隐藏全部图表;

2025.04.08:支持swanlab.Molecule数据类型,支持记录与可视化生物化学分子数据;支持保存表格视图中的排序、筛选、列顺序变化状态;

2025.04.07:我们与 EvalScope 完成了联合集成,现在你可以在EvalScope中使用SwanLab来评估大模型性能;

2025.03.30:支持swanlab.Settings方法,支持更精细化的实验行为控制;支持寒武纪MLU硬件监控;支持 Slack通知、Discord通知;

2025.03.21:🎉🤗HuggingFace Transformers已正式集成SwanLab(>=4.50.0版本),#36433;新增 Object3D图表 ,支持记录与可视化三维点云,文档;硬件监控支持了 GPU显存(MB)、磁盘利用率、网络上下行 的记录;

2025年3月12日:🎉🎉SwanLab私有化部署版现已发布!!🔗部署文档;SwanLab已支持插件扩展,如邮件通知、飞书通知

2025年3月9日:支持实验侧边栏拉宽;新增外显Git代码按钮;新增sync_mlflow功能,支持与MLflow框架同步实验跟踪;

2025年3月6日:我们与DiffSynth Studio完成了联合集成,现在你可以在DiffSynth Studio中使用SwanLab来跟踪和可视化扩散模型文生图/视频实验,使用指引;

2025年3月4日:新增MLFlow转换功能,支持将MLFlow实验转换为SwanLab实验,使用指引;

2025年3月1日:新增移动实验功能,现在可以将实验移动到不同组织的不同项目下了;

2025年2月24日:我们与EasyR1完成了联合集成,现在你可以在EasyR1中使用SwanLab来跟踪和可视化多模态大模型强化学习实验,使用指引

2025年2月18日:我们与Swift完成了联合集成,现在你可以在Swift的CLI/WebUI中使用SwanLab来跟踪和可视化大模型微调实验,使用指引。

2025年2月16日:新增图表移动分组、创建分组功能。

2025年2月9日:我们与veRL完成了联合集成,现在你可以在veRL中使用SwanLab来跟踪和可视化大模型强化学习实验,使用指引。

2025年2月5日:

swanlab.log支持嵌套字典#812,适配Jax框架特性;支持name与notes参数;2025年1月22日:新增

sync_tensorboardX与sync_tensorboard_torch功能,支持与此两种TensorBoard框架同步实验跟踪;2025年1月17日:新增

sync_wandb功能,文档,支持与Weights & Biases实验跟踪同步;大幅改进了日志渲染性能2025年1月11日:云端版大幅优化了项目表格的性能,并支持拖拽、排序、筛选等交互

2025年1月1日:新增折线图持久化平滑、折线图拖拽式改变大小,优化图表浏览体验

2024年12月22日:我们与LLaMA Factory完成了联合集成,现在你可以在LLaMA Factory中使用SwanLab来跟踪和可视化大模型微调实验,使用指引。

2024年12月15日:**硬件监控(0.4.0)**功能上线,支持CPU、NPU(Ascend)、GPU(Nvidia)的系统级信息记录与监控。

2024年11月26日:环境选项卡-硬件部分支持识别华为昇腾NPU与鲲鹏CPU;云厂商部分支持识别青云基石智算。

👋🏻什么是SwanLab

SwanLab是一款AI训练分析与指标观测平台,面向模型训练团队,提供训练可视化、自动日志记录、超参数记录、实验对比、多人协同等功能,帮助团队快速发现训练问题,加速模型迭代。

在SwanLab上,研究者能基于直观的可视化图表发现训练问题,对比多个实验找到研究灵感,并通过在线网页的分享与基于组织的多人协同训练,打破团队沟通的壁垒,提高组织训练效率。

https://github.com/user-attachments/assets/7965fec4-c8b0-4956-803d-dbf177b44f54

以下是其核心特性列表:

1. 📊 实验指标与超参数跟踪: 极简的代码嵌入您的机器学习pipeline,跟踪记录训练关键指标

☁️ 支持云端使用(类似Weights & Biases),随时随地查看训练进展。手机看实验的方法

📝 支持超参数记录、指标总结、表格分析

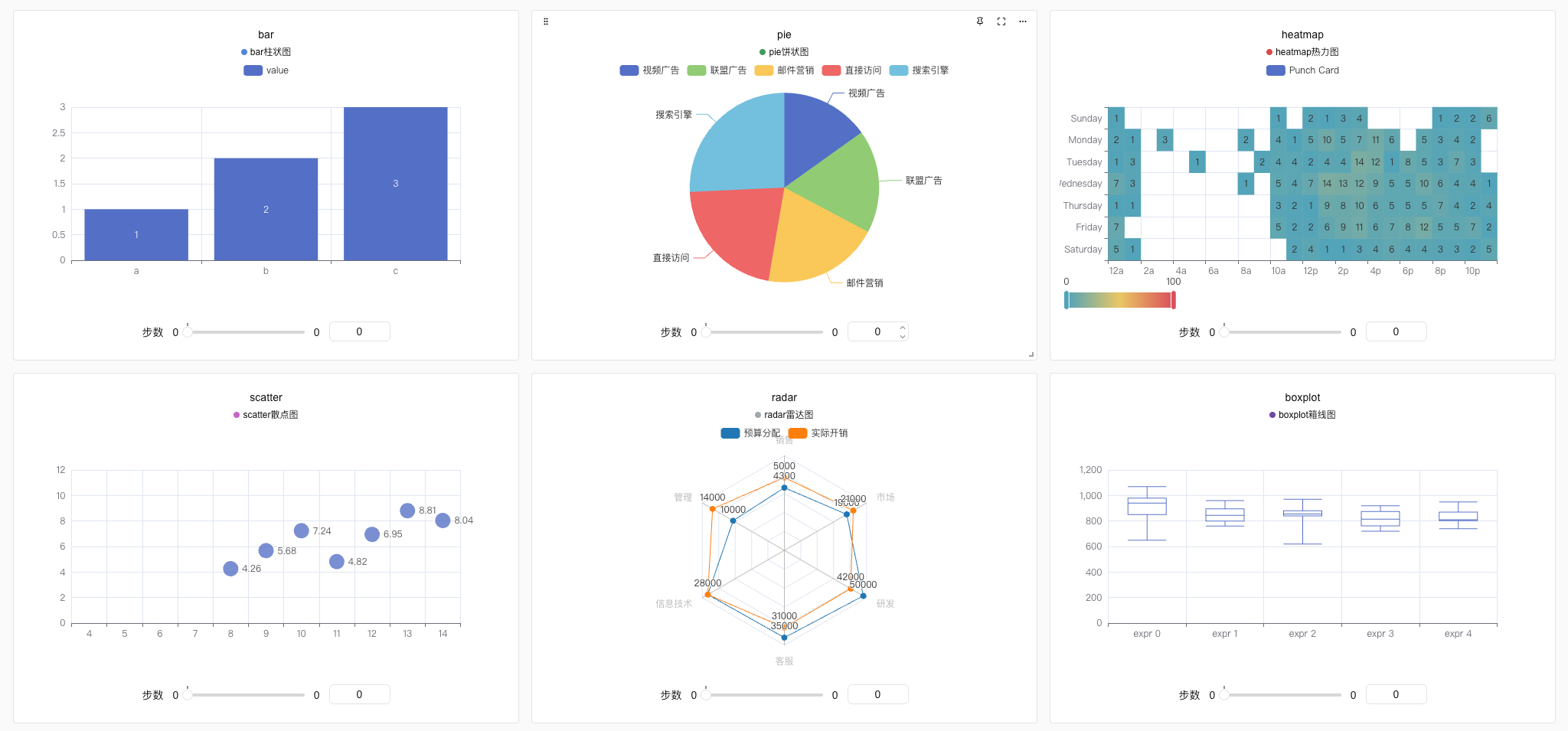

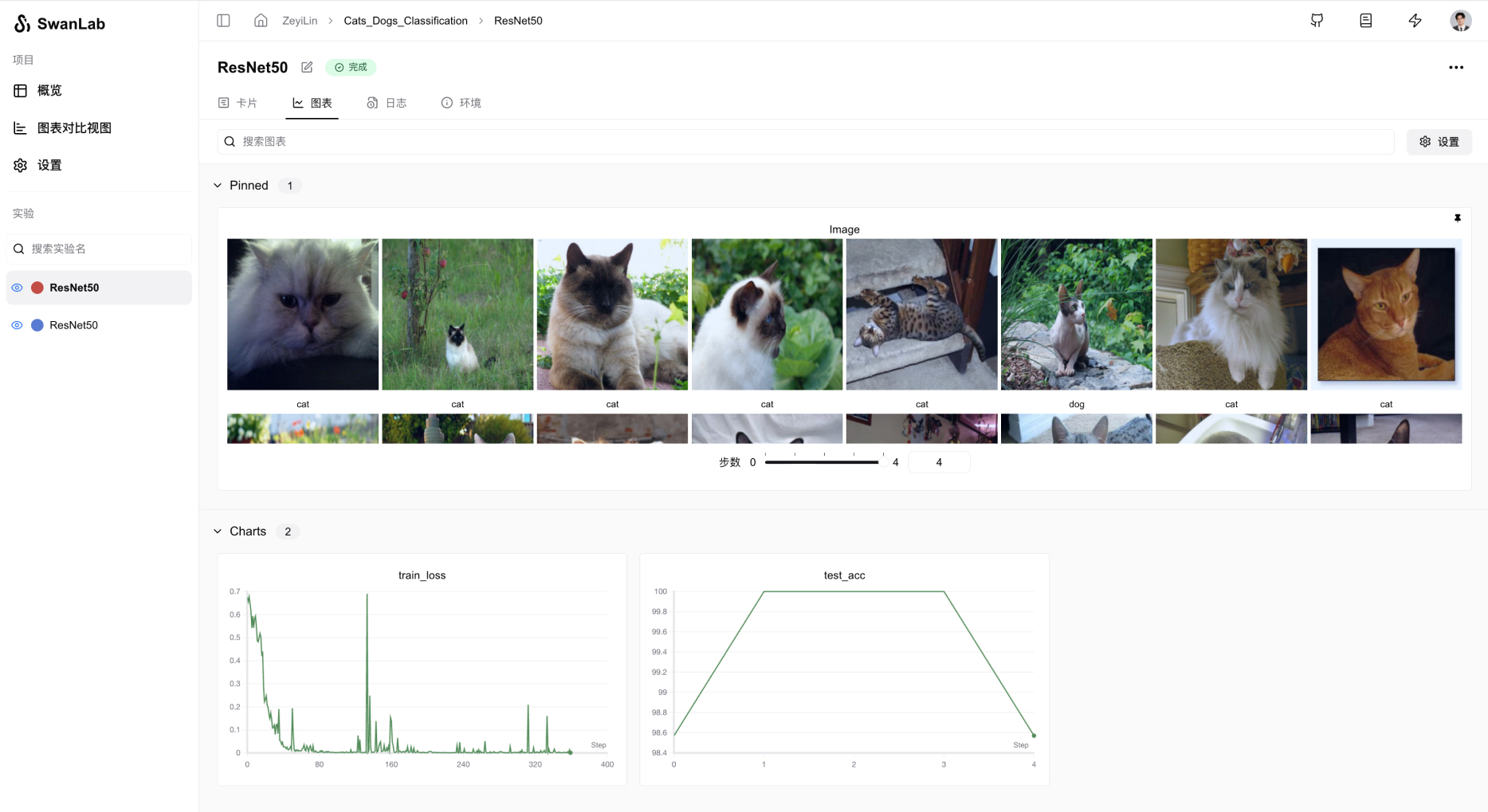

🌸 可视化训练过程: 通过UI界面对实验跟踪数据进行可视化,可以让训练师直观地看到实验每一步的结果,分析指标走势,判断哪些变化导致了模型效果的提升,从而整体性地提升模型迭代效率。

支持的元数据类型:标量指标、图像、音频、文本、视频、3D点云、生物化学分子、Echarts自定义图表...

- 支持的图表类型:折线图、媒体图(图像、音频、文本、视频)、3D点云、生物化学分子、柱状图、散点图、箱线图、热力图、饼状图、雷达图、自定义图表...

- LLM生成内容可视化组件:为大语言模型训练场景打造的文本内容可视化图表,支持Markdown渲染

后台自动记录:日志logging、硬件环境、Git仓库、Python环境、Python库列表、项目运行目录

断点续训记录:支持在训练完成/中断后,补充新的指标数据到同个实验中

2. ⚡️ 全面的框架集成: PyTorch、🤗HuggingFace Transformers、PyTorch Lightning、🦙LLaMA Factory、MMDetection、Ultralytics、PaddleDetetion、LightGBM、XGBoost、Keras、Tensorboard、Weights&Biases、OpenAI、Swift、XTuner、Stable Baseline3、Hydra在内的**30+**框架

3. 💻 硬件监控: 支持实时记录与监控CPU、NPU(昇腾Ascend)、GPU(英伟达Nvidia)、AMD(AMD ROCm)、MLU(寒武纪Cambricon)、XLU(昆仑芯Kunlunxin)、DCU(海光DCU)、MetaX GPU(沐曦XPU)、Moore Threads GPU(摩尔线程)、Iluvatar GPU(天数智芯)、内存的系统级硬件指标

4. 📦 实验管理: 通过专为训练场景设计的集中式仪表板,通过整体视图速览全局,快速管理多个项目与实验

5. 🆚 比较结果: 通过在线表格与对比图表比较不同实验的超参数和结果,挖掘迭代灵感

6. 👥 在线协作: 您可以与团队进行协作式训练,支持将实验实时同步在一个项目下,您可以在线查看团队的训练记录,基于结果发表看法与建议

7. ✉️ 分享结果: 复制和发送持久的URL来共享每个实验,方便地发送给伙伴,或嵌入到在线笔记中

8. 💻 支持自托管: 支持离线环境使用,自托管的社区版同样可以查看仪表盘与管理实验,使用攻略

9. 🔌 插件拓展: 支持通过插件拓展SwanLab的使用场景,比如飞书通知、Slack通知、CSV记录器等

[!IMPORTANT]

收藏项目,你将从GitHub上无延迟地接收所有发布通知~ ⭐️

📃 在线演示

来看看SwanLab的在线演示:

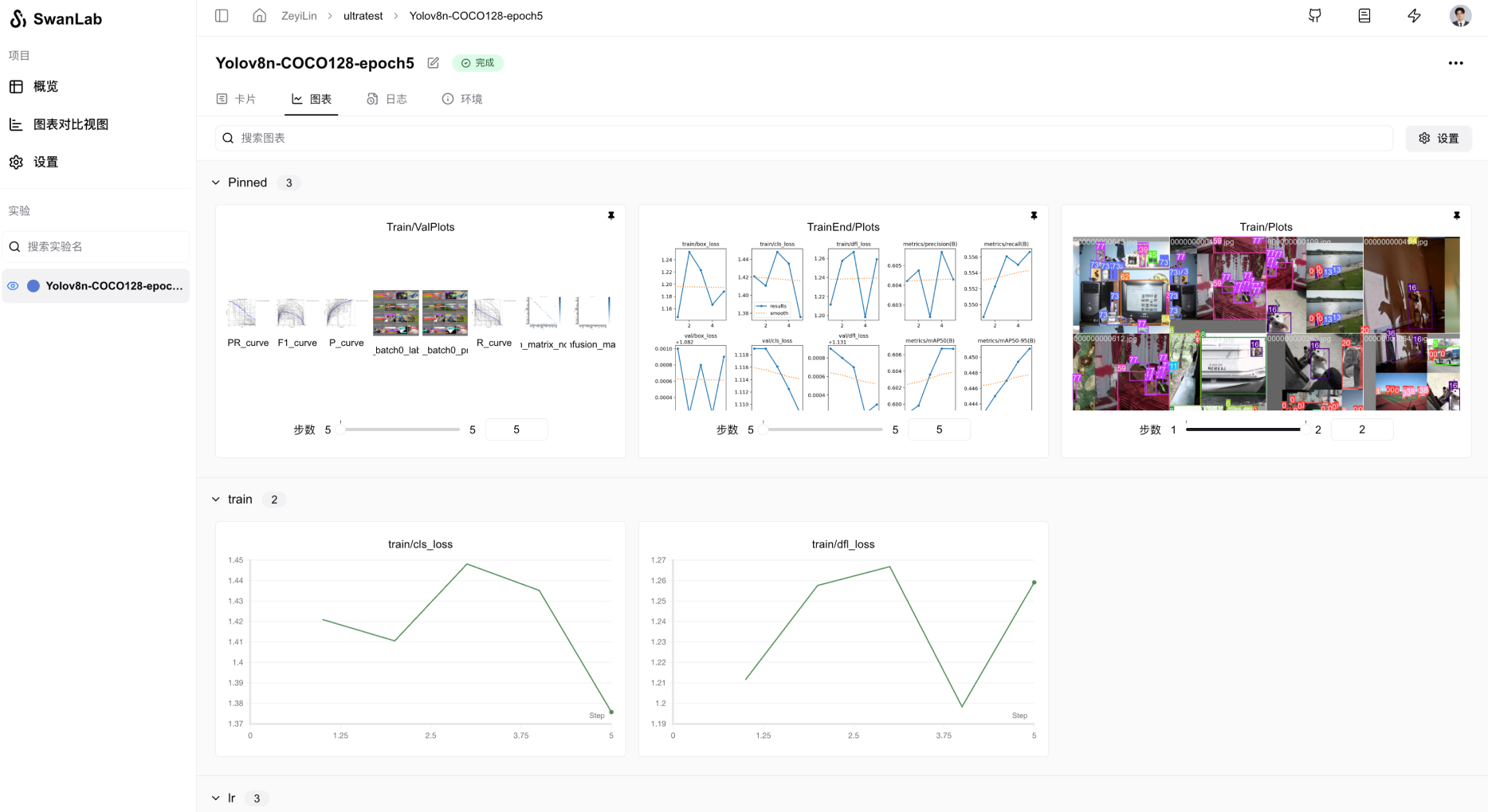

| ResNet50猫狗分类 | Yolov8-COCO128目标检测 |

|---|---|

|

|

| 跟踪一个简单的ResNet50模型在猫狗数据集上训练的图像分类任务。 | 使用Yolov8在COCO128数据集上进行目标检测任务,跟踪训练超参数和指标。 |

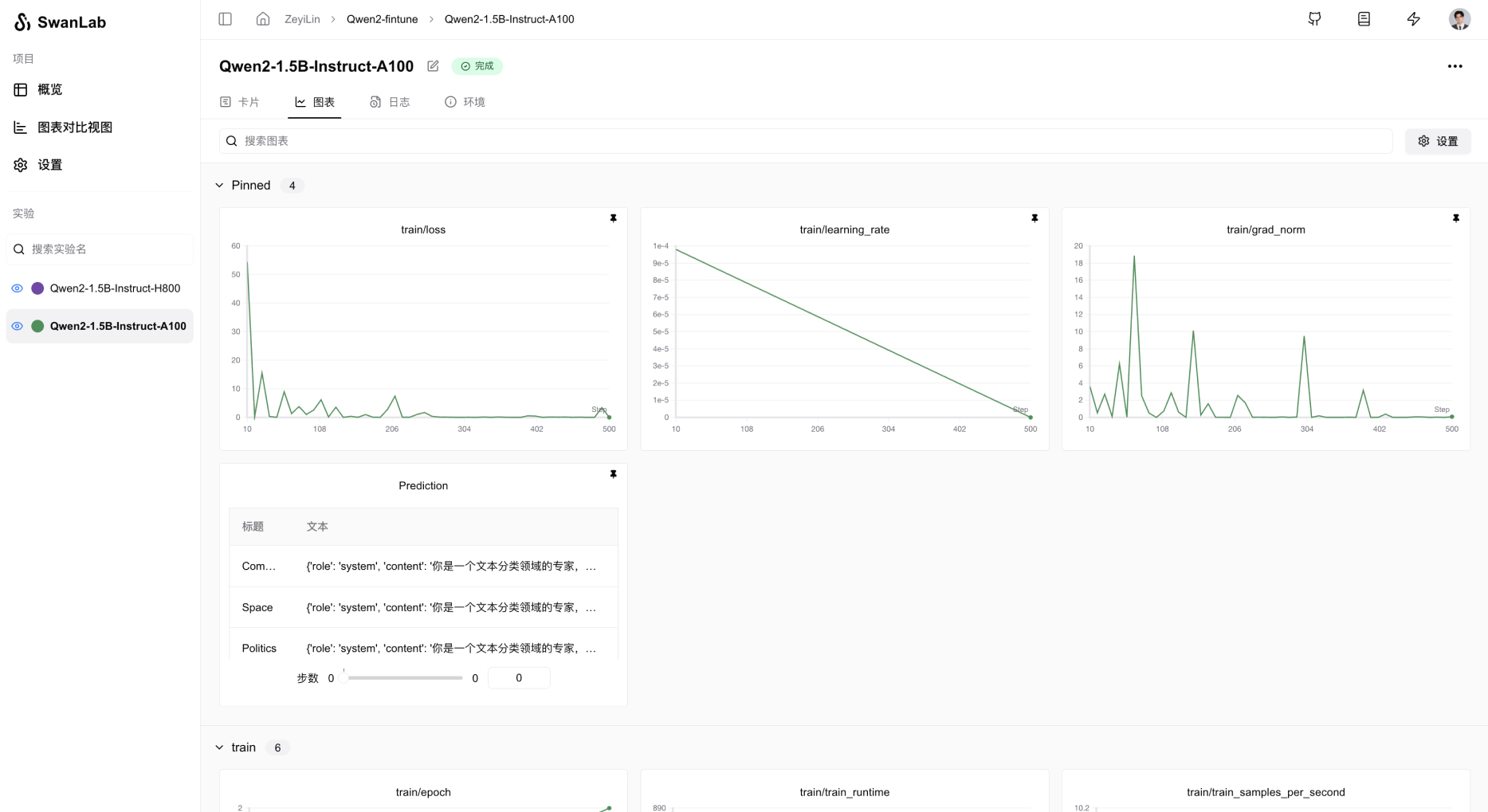

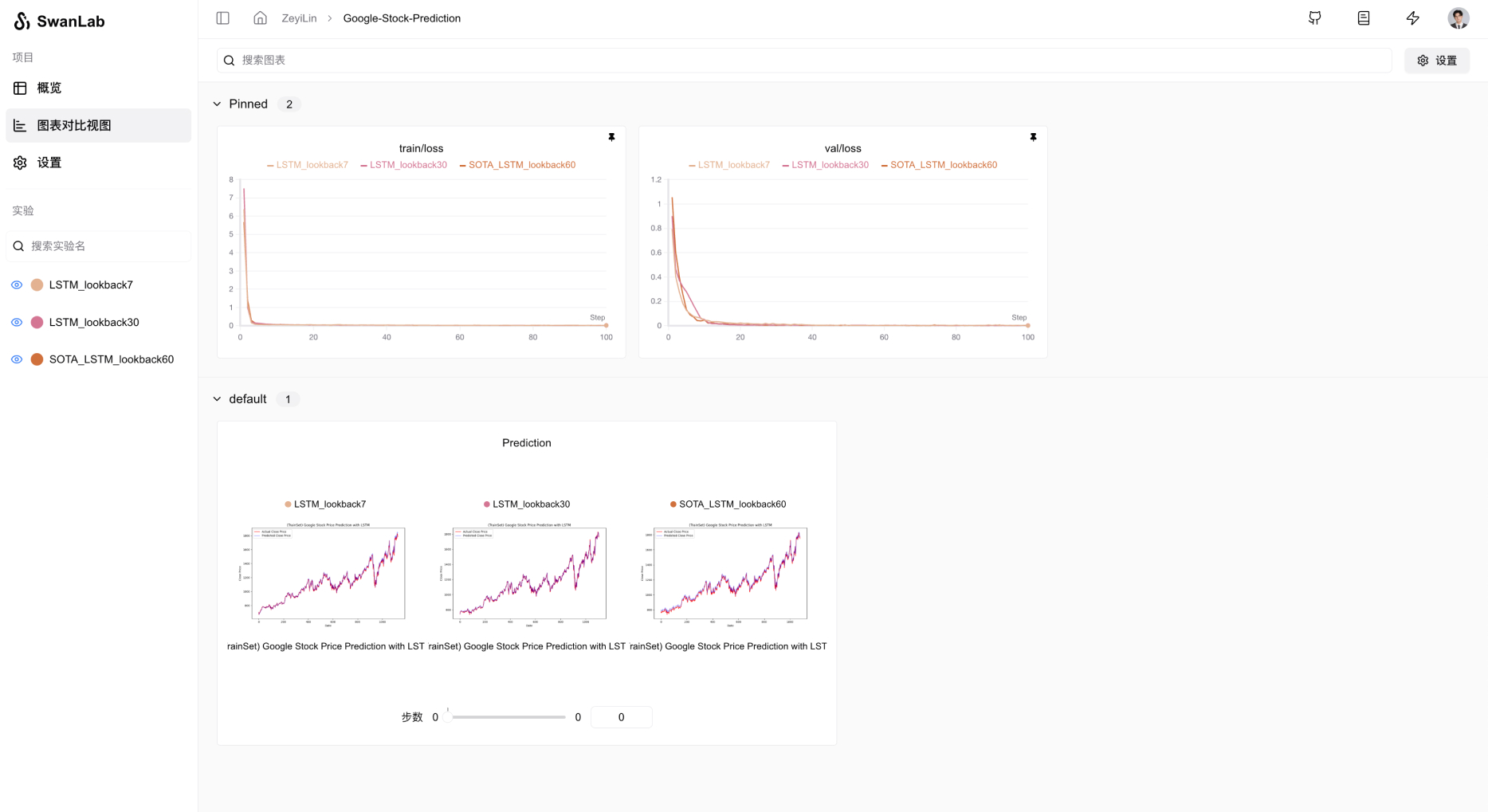

| Qwen2指令微调 | LSTM谷歌股票预测 |

|---|---|

|

|

| 跟踪Qwen2大语言模型的指令微调训练,完成简单的指令遵循。 | 使用简单的LSTM模型在谷歌股价数据集上训练,实现对未来股价的预测。 |

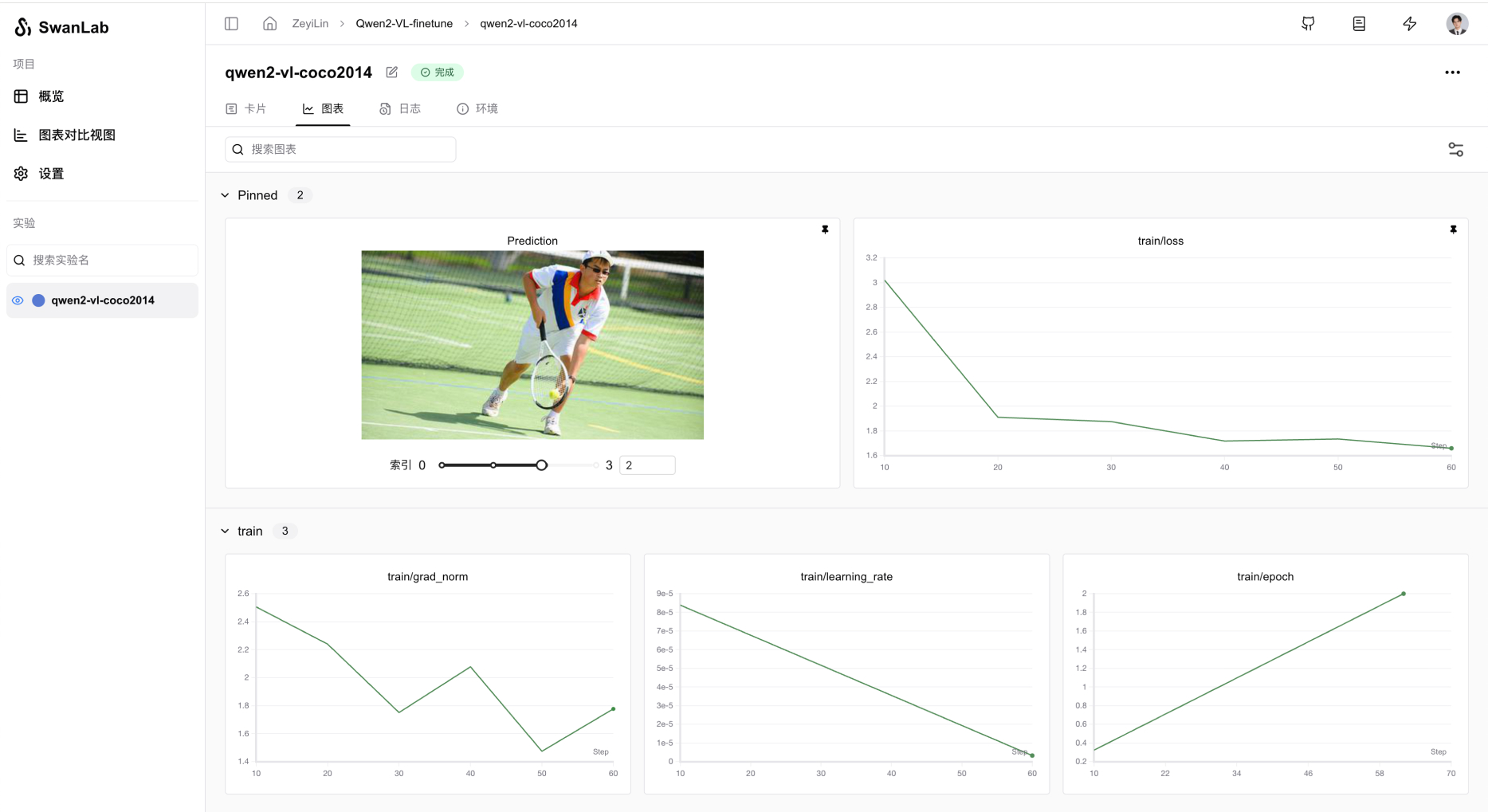

| ResNeXt101音频分类 | Qwen2-VLCOCO数据集微调 |

|---|---|

|

|

| 从ResNet到ResNeXt在音频分类任务上的渐进式实验过程 | 基于Qwen2-VL多模态大模型,在COCO2014数据集上进行Lora微调。 |

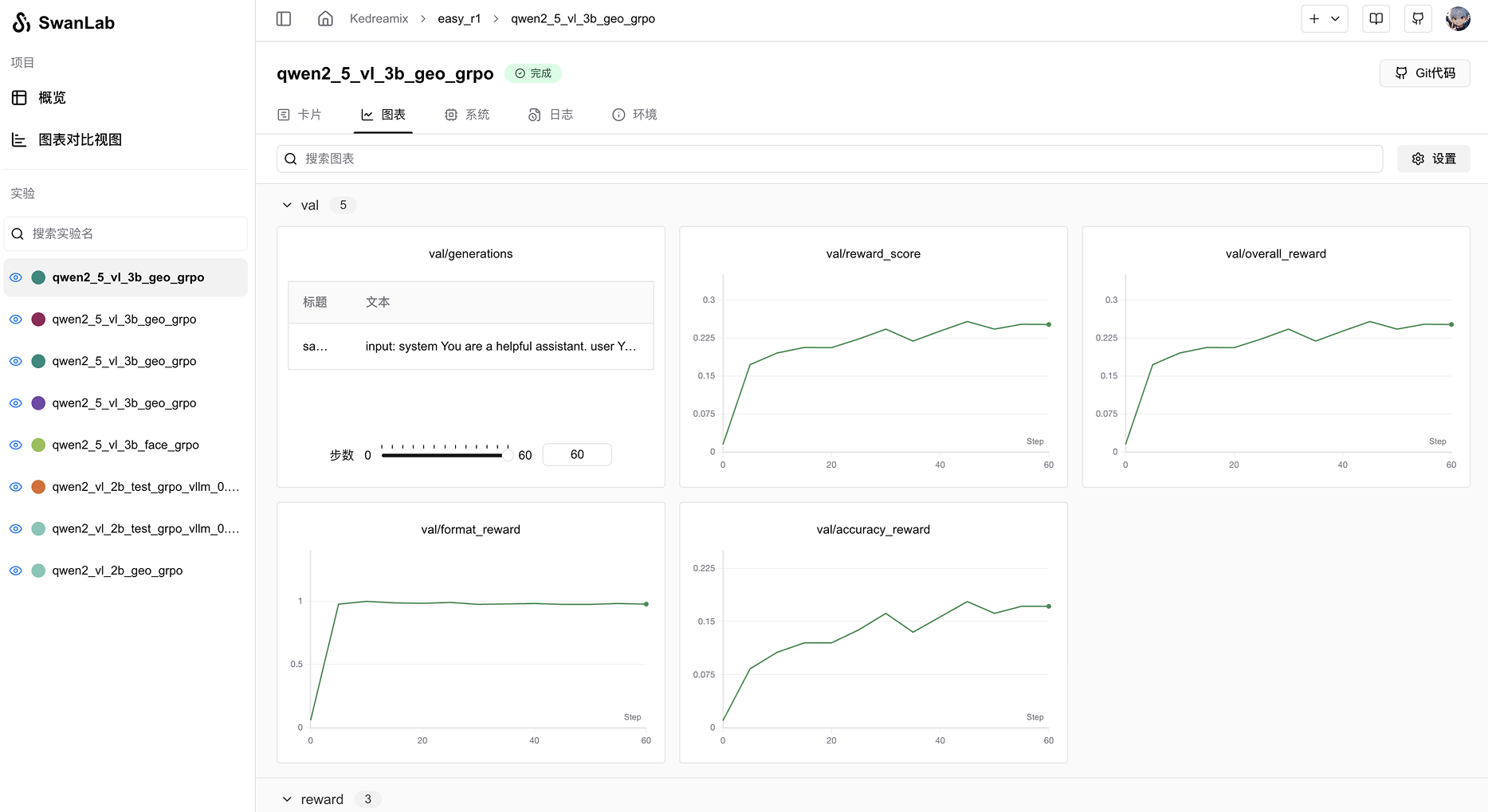

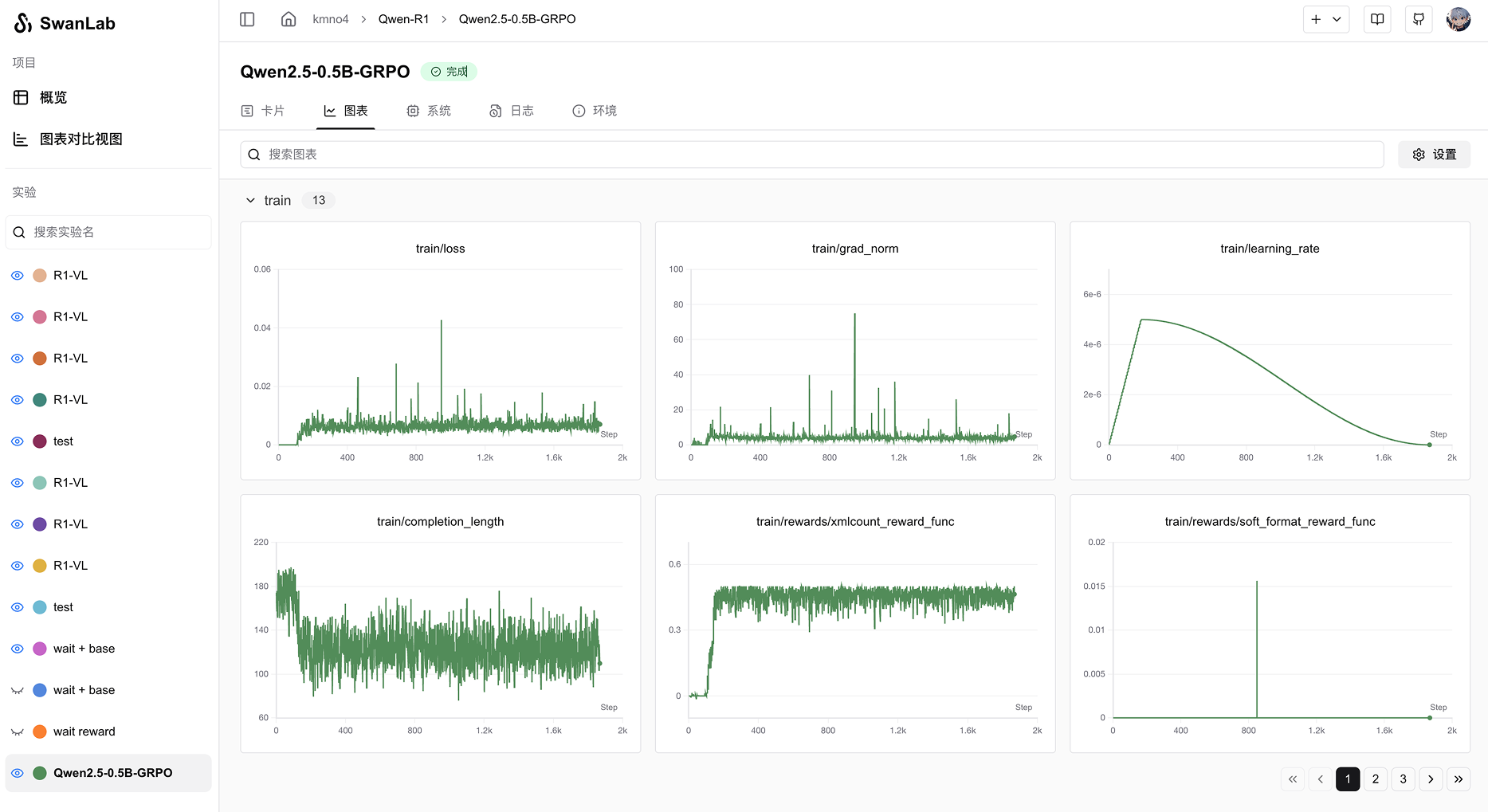

| EasyR1多模态LLM RL训练 | Qwen2.5-0.5BGRPO训练 |

|---|---|

|

|

| 使用EasyR1框架进行多模态LLM RL训练 | 基于Qwen2.5-0.5B模型在GSM8k数据集上进行GRPO训练 |

🏁 快速开始

1.安装

pip install swanlab

源码安装

如果你想体验最新的特性,可以使用源码安装。

# 方式一

git clone https://github.com/SwanHubX/SwanLab.git

pip install -e .

# 方式二

pip install git+https://github.com/SwanHubX/SwanLab.git

2.登录并获取API Key

swanlab login

出现提示时,输入您的API Key,按下回车,完成登陆。

3.将SwanLab与你的代码集成

import swanlab

# 初始化一个新的swanlab实验

swanlab.init(

project="my-first-ml",

config={'learning-rate': 0.003},

)

# 记录指标

for i in range(10):

swanlab.log({"loss": i, "acc": i})

大功告成!前往SwanLab查看你的第一个SwanLab实验。

💻 自托管

自托管社区版支持离线查看 SwanLab 仪表盘。

详细部署文档见:

🔥 实战案例

使用SwanLab的优秀教程开源项目:

- happy-llm:从零开始的大语言模型原理与实践教程

- self-llm:《开源大模型食用指南》针对中国宝宝量身打造的基于Linux环境快速微调(全参数/Lora)、部署国内外开源大模型(LLM)/多模态大模型(MLLM)教程

- Minimind:🚀🚀 「大模型」2小时完全从0训练26M的小参数GPT!

- unlock-deepseek:DeepSeek 系列工作解读、扩展和复现

- Qwen3-SmVL: 将SmolVLM2的视觉头与Qwen3-0.6B模型进行了拼接微调

- OPPO/Agent_Foundation_Models: 通过多Agent蒸馏和Agent RL的端到端Agent基础模型。

- Tree-GRPO: [ICLR 2026] 树搜索在LLM Agent RL中的应用

使用SwanLab的优秀论文:

- MolAct: An Agentic RL Framework for Molecular Editing and Property Optimization

- CQLLM: A Framework for Generating CodeQL Security Vulnerability Detection Code Based on Large Language Model

- Animation Needs Attention: A Holistic Approach to Slides Animation Comprehension with Visual-Language Models

- Efficient Model Fine-Tuning with LoRA for Biomedical Named Entity Recognition

- SpectrumWorld: Artificial Intelligence Foundation for Spectroscopy

- CodeBoost: Boosting Code LLMs by Squeezing Knowledge from Code Snippets with RL

- A Joint Classification Method for Traditional Chinese Medicine Diseases and Syndromes Based on BertChinese-RCNNATTN

- A Gradient-Norm-Aware Optimizer for Symmetry-Preserving and Stable Deep Learning

- TrafficBM: A Dual-Modality Pre-Training Framework for Network Traffic Classification

- Using Human Cumulative Prospect Theory to Understand Large Language Models Decision-Making

教程文章:

- MNIST手写体识别

- FashionMNIST服装分类

- Cifar10图像分类

- Resnet猫狗分类

- Yolo目标检测

- UNet医学影像分割

- 音频分类

- DQN强化学习-推车倒立摆

- LSTM Google股票预测

- BERT文本分类

- Stable Diffusion文生图微调

- LLM预训练

- GLM4指令微调

- Qwen下游任务训练

- NER命名实体识别

- Qwen3医学模型微调

- Qwen2-VL多模态大模型微调实战

- GRPO大模型强化学习

- Qwen3-SmVL-0.6B多模态模型训练

- LeRobot 具身智能入门

- GLM-4.5-Air-LoRA 及 SwanLab 可视化记录

- RAG怎么做?SwanLab文档助手方案开源了

🌟如果你有想收录的教程,欢迎提交PR!

🎮 硬件记录

SwanLab会对AI训练过程中所使用的硬件信息和资源使用情况进行记录,下面是支持情况表格:

| 硬件 | 信息记录 | 资源监控 | 脚本 |

|---|---|---|---|

| 英伟达GPU | ✅ | ✅ | nvidia.py |

| AMD ROCm | ✅ | ✅ | amd.py |

| 昇腾NPU | ✅ | ✅ | ascend.py |

| 苹果SOC | ✅ | ✅ | apple.py |

| 寒武纪MLU | ✅ | ✅ | cambricon.py |

| 昆仑芯XPU | ✅ | ✅ | kunlunxin.py |

| 摩尔线程GPU | ✅ | ✅ | moorethreads.py |

| 沐曦GPU | ✅ | ✅ | metax.py |

| 天数智芯GPU | ✅ | ✅ | iluvatar.py |

| 海光DCU | ✅ | ✅ | hygon.py |

| CPU | ✅ | ✅ | cpu.py |

| 内存 | ✅ | ✅ | memory.py |

| 硬盘 | ✅ | ✅ | disk.py |

| 网络 | ✅ | ✅ | network.py |

如果你希望记录其他硬件,欢迎提交Issue与PR!

🚗 框架集成

将你最喜欢的框架与 SwanLab 结合使用!

下面是我们已集成的框架列表,欢迎提交 Issue 来反馈你想要集成的框架。

基础框架

LLM训练框架

- HuggingFace Transformers

- LLaMA Factory

- MS-Swift

- Unsloth

- MLX-LM

- Torchtune

- PaddleNLP

- Sentence Transformers

- XTuner

- OpenMind

LLM强化学习框架

机器人框架

文生图/视频训练框架

深度学习框架

计算机视觉

机器学习框架

评估框架

传统强化学习框架

其他框架:

- Tensorboard

- Weights&Biases

- MLFlow

- HuggingFace Accelerate

- Ray

- Hydra

- Omegaconf

- OpenAI

- ZhipuAI

- SpecForge

🔌 插件与API

欢迎通过插件来拓展SwanLab的功能,增强你的实验管理体验!

开放接口:

🆚 与熟悉的工具的比较

Tensorboard vs SwanLab

☁️ 支持在线使用: 通过 SwanLab 可以方便地将训练实验在云端在线同步与保存,便于远程查看训练进展、管理历史项目、分享实验链接、发送实时消息通知、多端看实验等。而 Tensorboard 是一个离线的实验跟踪工具。

👥 多人协作: 在进行多人、跨团队的机器学习协作时,通过 SwanLab 可以轻松管理多人的训练项目、分享实验链接、跨空间交流讨论。而 Tensorboard 主要为个人设计,难以进行多人协作和分享实验。

💻 持久、集中的仪表板: 无论你在何处训练模型,无论是在本地计算机上、在实验室集群还是在公有云的 GPU 实例中,你的结果都会记录到同一个集中式仪表板中。而使用 TensorBoard 需要花费时间从不同的机器复制和管理 TFEvent 文件。

💪 更强大的表格: 通过 SwanLab 表格可以查看、搜索、过滤来自不同实验的结果,可以轻松查看数千个模型版本并找到适合不同任务的最佳性能模型。 TensorBoard 不适用于大型项目。

Weights and Biases vs SwanLab

Weights and Biases 是一个必须联网使用的闭源 MLOps 平台

SwanLab 不仅支持联网使用,也支持开源、免费、自托管的版本

👥 社区

周边仓库

- self-hosted:私有化部署脚本仓库

- SwanLab-Docs:官方文档仓库

- SwanLab-Dashboard:离线看板仓库,存放了由

swanlab watch打开的轻量离线看板的web代码

社区与支持

- GitHub Issues:使用 SwanLab 时遇到的错误和问题

- 电子邮件支持:反馈关于使用 SwanLab 的问题

- 微信交流群:交流使用 SwanLab 的问题、分享最新的 AI 技术

SwanLab README 徽章

如果你喜欢在工作中使用 SwanLab,请将 SwanLab 徽章添加到你的 README 中:

[](your experiment url)

[](your experiment url)

更多设计素材:assets

在论文中引用 SwanLab

如果您发现 SwanLab 对您的研究之旅有帮助,请考虑以下列格式引用:

@software{Zeyilin_SwanLab_2023,

author = {Zeyi Lin, Shaohong Chen, Kang Li, Qiushan Jiang, Zirui Cai, Kaifang Ji and {The SwanLab team}},

doi = {10.5281/zenodo.11100550},

license = {Apache-2.0},

title = {{SwanLab}},

url = {https://github.com/swanhubx/swanlab},

year = {2023}

}

为 SwanLab 做出贡献

考虑为 SwanLab 做出贡献吗?首先,请花点时间阅读 贡献指南。

同时,我们非常欢迎通过社交媒体、活动和会议的分享来支持 SwanLab,衷心感谢!

Contributors

📃 协议

本仓库遵循 Apache 2.0 License 开源协议

Star History

版本历史

v0.7.142026/04/03v0.7.132026/03/19v0.7.122026/03/19v0.7.112026/03/08v0.7.102026/03/04v0.7.92026/03/03v0.7.82026/02/06v0.7.72026/02/04v0.7.62026/01/02v0.7.52025/12/19v0.7.42025/12/14v0.7.32025/12/05v0.7.22025/11/17v0.7.12025/11/07v0.7.02025/11/06v0.6.132025/10/24v0.6.122025/10/17v0.6.112025/10/09v0.6.102025/09/12v0.6.92025/09/09常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。