awesome-instruction-learning

Awesome Instruction Learning 是一个精心整理的开源资源清单,汇集了指令微调与指令遵循领域的重要论文与数据集,目前已收录近200篇前沿研究。它帮助研究人员和开发者快速掌握这一快速发展的方向,避免在海量文献中盲目搜索。随着大模型对“听懂指令”能力的要求越来越高,这个项目系统梳理了从指令生成、数据构建到模型训练的关键工作,为理解如何让AI更准确地执行人类指令提供了清晰路径。项目定期更新,内容按时间倒序排列,便于追踪最新进展,并附有作者团队的综合综述论文作为入门指南。适合AI研究人员、算法工程师、自然语言处理方向的学生,以及希望深入理解大模型训练机制的技术爱好者使用。其独特价值在于将分散的成果集中归档,并保持高活跃度的社区贡献机制,是该领域不可或缺的“导航地图”。

使用场景

某AI初创公司的算法工程师李明,正在为公司新开发的客服对话系统寻找高效指令微调(Instruction Tuning)的数据集和前沿论文,以提升模型对复杂用户意图的理解能力。

没有 awesome-instruction-learning 时

- 花费超过一周时间在Google Scholar和arXiv中手动搜索相关论文,结果杂乱,大量重复或过时的研究混杂其中。

- 找到的几个数据集(如FLAN、T0)缺乏清晰的使用说明和适用场景对比,难以判断哪个更适合客服对话任务。

- 团队内部对“指令微调”与“提示工程”的区别存在分歧,缺乏权威综述作为技术共识依据。

- 试图复现一篇2022年的论文时,发现其开源数据链接已失效,而网上没有替代资源。

- 项目进度严重滞后,因无法快速定位核心文献,导致模型迭代周期从预期的3天延长至近2周。

使用 awesome-instruction-learning 后

- 仅用10分钟就通过分类目录定位到《Instruction Tuning with GPT-4》《Alpaca》《OpenChatKit》等5篇最相关的最新论文,全部附带PDF和代码链接。

- 直接下载了经过整理的12个高质量指令数据集,每个都标注了任务类型(如问答、多轮对话、指令遵循),并附有作者推荐的适用场景。

- 参考其2023年最新综述论文(arXiv:2303.10475),团队迅速统一了技术路线,明确了以“指令微调+人类反馈”为核心优化方向。

- 发现一篇2021年的关键论文虽已下线,但仓库中提供了其数据集的镜像存档和替代方案,避免了重复劳动。

- 模型迭代周期缩短至48小时内完成,准确率提升19%,客户满意度显著上升。

awesome-instruction-learning 让算法团队从“信息搜救”回归到真正有价值的模型创新,大幅降低技术探索门槛。

运行环境要求

未说明

未说明

快速开始

令人惊叹的指令学习

🔥🔥🔥 一份关于指令调优与遵循的超赞阅读清单,包含论文和数据集。

👉 探索我们最新的调查更新!欢迎深入了解并发现我们的改进成果 👀 🤗 : 最新调查

❤️ 贡献

本仓库目前由Renze Lou @宾州州立大学和Kai Zhang @俄亥俄州立大学维护。我们非常感谢任何贡献 ❤️.

- 使用以下Markdown格式。

**论文标题。** *作者1、作者2和作者3。* <ins>会议/期刊/预印本</ins> 年份。[[pdf](链接)]; [[其他资源](链接)]。

如果一篇预印本论文有多个版本,请使用最早提交的年份。

按年份降序排列展示论文(最新的排在最前面)。

🥳 引用

觉得这个仓库对你有帮助吗?😊😊😊

请考虑引用我们的论文。👇👇👇

@article{lou2023instruction,

title={关于指令遵循的全面调查},

author={Lou, Renze 和 Zhang, Kai 和 Yin, Wenpeng},

journal={arXiv预印本 arXiv:2303.10475},

year={2023}

}

🔍 目录

1. 💁🏽♀️ 简介

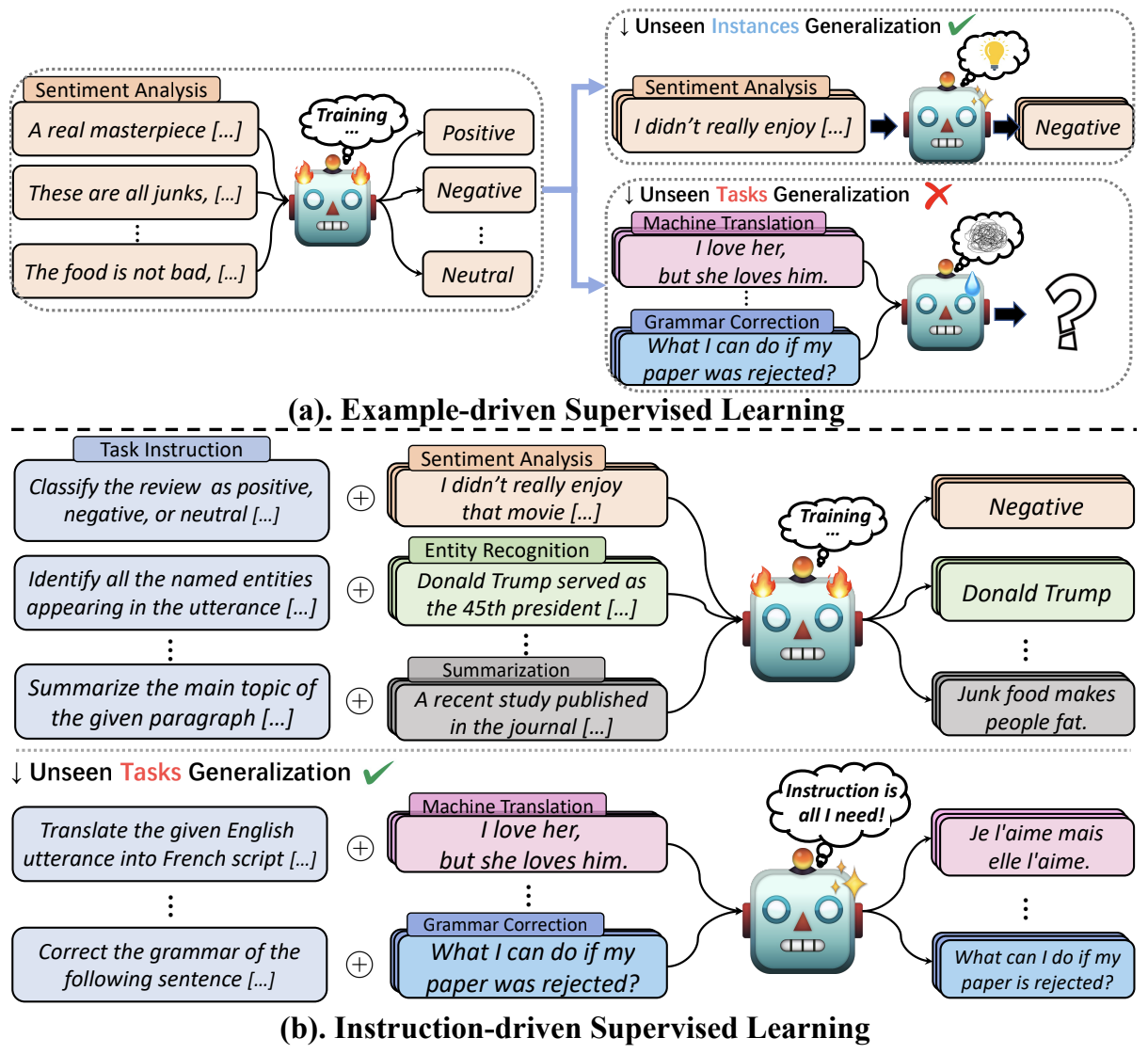

为什么选择指令驱动学习而非示例驱动学习?

- 👉 经济实惠。 对于传统的示例驱动监督学习,每个下游任务通常需要大量标注好的示例 💰。而指令学习中,每个下游任务可能只需要一条指令和少量示例 🤩。

- 👉 一个模型,所有任务。 理想的AI系统应能快速理解并处理各种新任务 💫。

- 👉 一个充满前景的研究方向。 传统示例驱动监督学习通过标注实例来表示任务语义,即通过观察大量示例训练模型以恢复原始任务含义。那么,为什么不直接使用已经蕴含关键任务语义的指令呢?

2. 🎓 调查与教程

我们使用标签

指令遵循的全面调查。 Renze Lou、Kai Zhang 和 Wenpeng Yin. 预印本 2023年。[pdf];[论文列表]。

从任务指令中学习。 Wenpeng Yin、Qinyuan Ye、Pengfei Liu、Xiang Ren 和 Hinrich Schütze. EMNLP教程 2023年。[pdf]。

自然语言推理:一项调查。 Fei Yu、Hongbo Zhang 和 Benyou Wang. 预印本 2023年。[pdf];[论文列表]。

预训练、提示与预测:自然语言处理中提示方法的系统性调查。 Pengfei Liu、Weizhe Yuan、Jinlan Fu、Zhengbao Jiang、Hiroaki Hayashi 和 Graham Neubig. ACM计算调查 2023年。[pdf];[网站]。

上下文学习调查。 Qingxiu Dong、Lei Li、Damai Dai、Ce Zheng、Zhiyong Wu、Baobao Chang、Xu Sun、Jingjing Xu、Lei Li 和 Zhifang Sui. 预印本 2022年。[pdf]。

迈向大语言模型中的推理:一项调查。 Jie Huang 和 Kevin Chen-Chuan Chang. 预印本 2022年。[pdf];[论文列表]。

利用语言模型提示进行推理:一项调查。 Shuofei Qiao、Yixin Ou、Ningyu Zhang、Xiang Chen、Yunzhi Yao、Shumin Deng、Chuanqi Tan、Fei Huang 和 Huajun Chen. 预印本 2022年。[pdf];[论文列表]。

3. 📚 语料库

高质量的数据集是成功指令微调的关键因素。因此,我们将“语料库”部分放在这里,以强调其重要性。

我们精心设计了下表,使其易于查阅并保持更新。希望它能为未来的指令微调研究贡献力量。🤗

*(部分行内容来自Longpre等人,感谢他们的卓越工作❤️。)

| Name | Release | Data/Code | Scale | Language | Annotator | |

| #Tasks | #Ins. (K) | |||||

| UnifiedQA | 05/2020 | Link | 46 | 750 |  |

✍ Human |

| CrossFit | 04/2021 | Link | 159 | 71,000 |  |

✍ Human |

| Natural Inst. v1 | 04/2021 | Link | 61 | 620 |  |

✍ Human |

| Flan 2021 | 09/2021 | Link | 62 | 4,400 |  |

✍ Human |

| P3 | 10/2021 | Link | 62 | 12,000 |  |

✍ Human |

| MetaICL | 10/2021 | Link | 142 | 3,500 |  |

✍ Human |

| ExMix | 11/2021 | Link | 107 | 500 |  |

✍ Human |

| 04/2022 | Link | 1,613 | 5,000 |  |

✍ Human | |

| GLM | 10/2022 | Link | 77 | 12,000 |  |

✍ Human |

| Flan 2022 | 10/2022 | Link | 1,836 | 15,000 |  |

✍ Human |

| xP3 | 11/2022 | Link | 71 | 81,000 |  |

✍ Human |

| Unnatural Inst. | 12/2022 | Link | 117 | 64 |  |

🤖 InstructGPT002

|

| Self-Instruct | 12/2022 | Link | / | 82 |  |

🤖 GPT-3

|

| OPT-IML | 12/2022 | / | 2,207 | 18,000 |  |

✍ Human |

| Alpaca | 03/2023 | Link | / | 52 |  |

🤖 InstructGPT003

|

| Baize | 04/2023 | Link | / | 100 |

|

🤖 ChatGPT |

| Koala | 04/2023 | / | / | / |

|

✍ Human 🤖 ChatGPT |

| GPT4All | 04/2023 | Link | / | 808 |

|

✍ Human 🤖 ChatGPT |

| Alpaca-gpt4 | 04/2023 | Link | / | 113 |  |

🤖 GPT-4

|

| Vicuna | 04/2023 | / | / | 76 |

|

✍ Human 🤖 ChatGPT |

| Dolly | 04/2023 | Link | / | 15 |  |

✍ Human |

| Oasst | 04/2023 | Link | / | 84 |

|

✍ Human |

| LongForm | 04/2023 | Link | / | 27 |

|

✍ Human 🤖 InstructGPT003

|

| Symbolic-Instruct | 04/2023 | Link | / | 796 |  |

✍ Human Synthetic Examples |

| LaMini | 04/2023 | Link | / | 2,580 |

|

🤖 ChatGPT |

| WizardLM | 04/2023 | Link | / | 196 |

|

🤖 ChatGPT |

| COEDIT | 05/2023 | Link | / | 82 |

|

✍ Human |

| UltraChat | 05/2023 | Link | / | 1,500 |

|

🤖 ChatGPT |

| CoT Collection | 05/2023 | Link | 1,060 | 1,880 |

🤖 Codex |

|

| Dynosaur | 05/2023 | Link | 5,740 | 801 |

|

🤖 ChatGPT |

| MUFFIN | 10/2023 | Link | / | 68 |

🤖 ChatGPT 🤖 GPT-4 ✍ Human |

|

| Dynamics-of-Instruction | 10/2023 | Link | / | 40 |

✍ Human |

|

| CoachLM | 11/2023 | Link | / | 2 |

✍ Human |

|

| DEITA | 12/2023 | Link | / | 10 |

🤖 ChatGPT |

|

| WaveCoder | 12/2023 | Link | 4 code-related tasks | 20 |

🤖 ChatGPT 🤖 GPT-4 |

|

| Conifer | 04/2024 | Link | / | 13 |

🤖 GPT-4 |

|

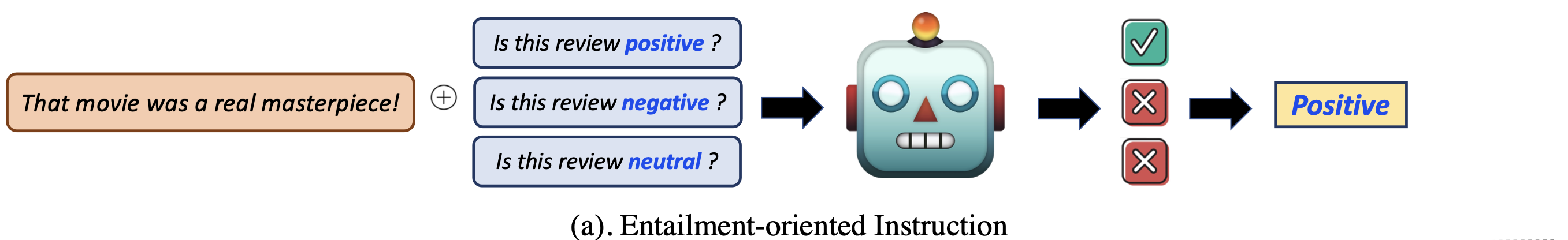

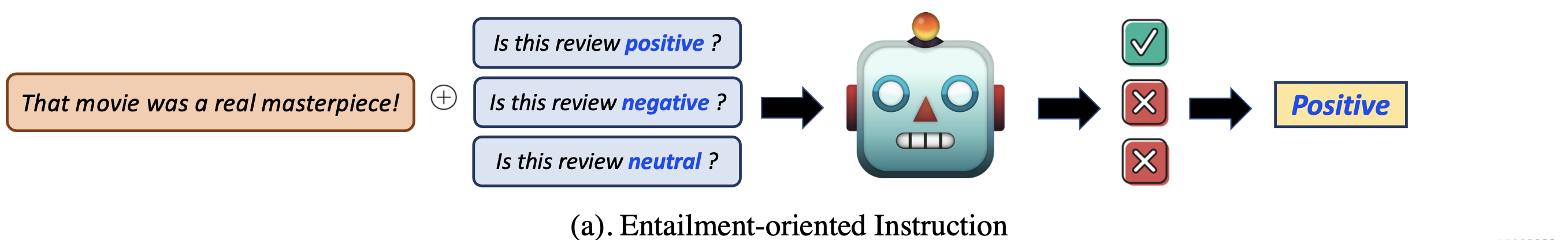

基于蕴含的指令将任务输入视为前提,并将任务输出构建成假设。它将传统的分类问题统一到文本蕴含的范式中。

用于零样本泛化的通用判别器。 Haike Xu, Zongyu Lin, Jing Zhou, Yanan Zheng 和 Zhilin Yang. ACL 2023年。[pdf];[代码]。

ConEntail:基于蕴含的框架,用于带监督对比预训练的通用零样本和少样本分类。 Ranran Haoran Zhang, Aysa Xuemo Fan 和 Rui Zhang. EACL 2023年。[pdf];[代码]。

OpenStance:真实世界中的零样本立场检测。 Hanzi Xu, Slobodan Vucetic 和 Wenpeng Yin. CoNLL 2022年。[pdf];[代码]。

利用自然语言推理的间接监督进行超细粒度实体类型标注。 Bangzheng Li, Wenpeng Yin 和 Muhao Chen. TACL 2022年。[pdf];[代码]。

用于事件论元抽取的文本蕴含:零样本和少样本多源学习。 Oscar Sainz, Itziar Gonzalez-Dios, Oier Lopez de Lacalle, Bonan Min 和 Eneko Agirre. NAACL发现 2022年。[pdf];[代码]。

标签词汇化与蕴含用于有效的零样本和少样本关系抽取。 Oscar Sainz, Oier Lopez de Lacalle, Gorka Labaka, Ander Barrena 和 Eneko Agirre. EMNLP 2021年。[pdf];[代码]。

通过数据集和提示词集合的元微调适应语言模型进行零样本学习。 Ruiqi Zhong, Kristy Lee, Zheng Zhang 和 Dan Klein. EMNLP发现 2021年。[pdf];[代码]。

多轮新增类别的增量少样本文本分类:公式、数据集和系统。 Congying Xia, Wenpeng Yin, Yihao Feng 和 Philip Yu. NAACL 2021年。[pdf];[代码]。

ExpBERT:利用自然语言解释进行表示工程。 Shikhar Murty, Pang Wei Koh 和 Percy Liang. ACL 2020年。[pdf];[代码]。

零样本文本分类基准测试:数据集、评估与蕴含方法。 Wenpeng Yin, Jamaal Hay, Dan Roth . EMNLP 2019年。[pdf];[网站]。

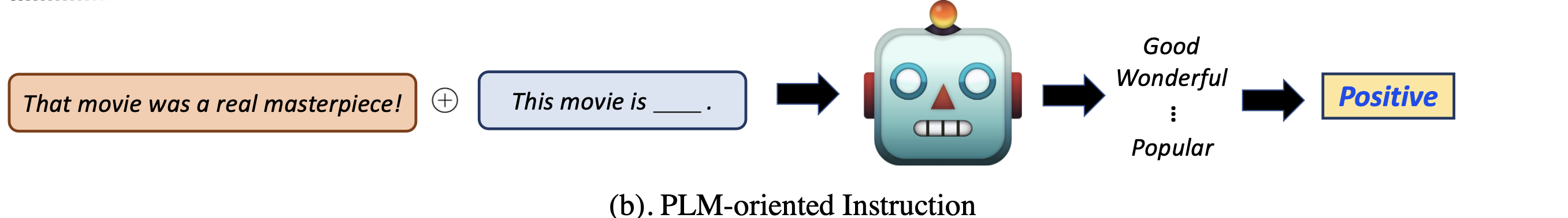

4.2 面向PLM的指令

面向PLM的指令(即提示词)旨在构建一种填空式输入,以引导预训练语言模型(PLM)生成相应回答。在此,我们展示了若干具有代表性的面向PLM的指令学习研究。更多相关工作,请参阅此仓库和这篇综述。

上下文学习如何助力提示词调优? Simeng Sun, Yang Liu, Dan Iter, Chenguang Zhu 和 Mohit Iyyer. 预印本 2023年。[pdf]。

通过困惑度估计揭秘语言模型中的提示词。 Hila Gonen, Srini Iyer, Terra Blevins, Noah A. Smith 和 Luke Zettlemoyer. 预印本 2022年。[pdf]。

RLPrompt:利用强化学习优化离散文本提示词。 Mingkai Deng, Jianyu Wang, Cheng-Ping Hsieh 等. EMNLP 2022年。[pdf];[代码]。

PPT:用于少样本学习的预训练提示词调优。 Yuxian Gu, Xu Han, Zhiyuan Liu 和 Minlie Huang. ACL 2022年。[pdf];[代码]。

P-Tuning v2:提示词调优在规模与任务上均可媲美微调。 Xiao Liu, Kaixuan Ji, Yicheng Fu, Weng Lam Tam, Zhengxiao Du, Zhilin Yang 和 Jie Tang. ACL 2022年。[pdf];[代码]。

KnowPrompt:基于协同优化的知识感知提示词调优用于关系抽取。 Xiang Chen, Ningyu Zhang, Xin Xie 等. WWW 2022年。[pdf];[代码]。

GPT也懂! Xiao Liu, Yanan Zheng, Zhengxiao Du, Ming Ding, Yujie Qian, Zhilin Yang 和 Jie Tang. 预印本 2021年。[pdf];[代码]。

利用自然语言指令进行少样本文本生成。 Timo Schick 和 Hinrich Schütze. EMNLP 2021年。[pdf];[代码]。

不仅仅是规模重要:小型语言模型也是少样本学习者。 Timo Schick 和 Hinrich Schütze. NAACL 2021年。[pdf];[代码]。

学习如何提问:用软提示词混合体查询语言模型。 Guanghui Qin 和 Jason Eisner. NAACL 2021年。[pdf];[代码]。

前缀调优:为生成优化连续提示词。 Xiang Lisa Li 和 Percy Liang. ACL 2021年。[pdf];[代码]。

让预训练语言模型成为更优秀的少样本学习者。 Tianyu Gao, Adam Fisch 和 Danqi Chen. ACL 2021年。[pdf];[代码]。

基于模板的命名实体识别使用BART。 Leyang Cui, Yu Wu, Jian Liu, Sen Yang 和 Yue Zhang. ACL发现 2021年。[pdf];[代码]。

利用填空式问题进行少样本文本分类与自然语言推理。 Timo Schick 和 Hinrich Schütze. EACL 2021年。[pdf];[代码]。

语言模型是无监督多任务学习者。 Alec Radford, Jeffrey Wu, Rewon Child, David Luan, Dario Amodei 和 Ilya Sutskever. 预印本 2019年。[pdf]。

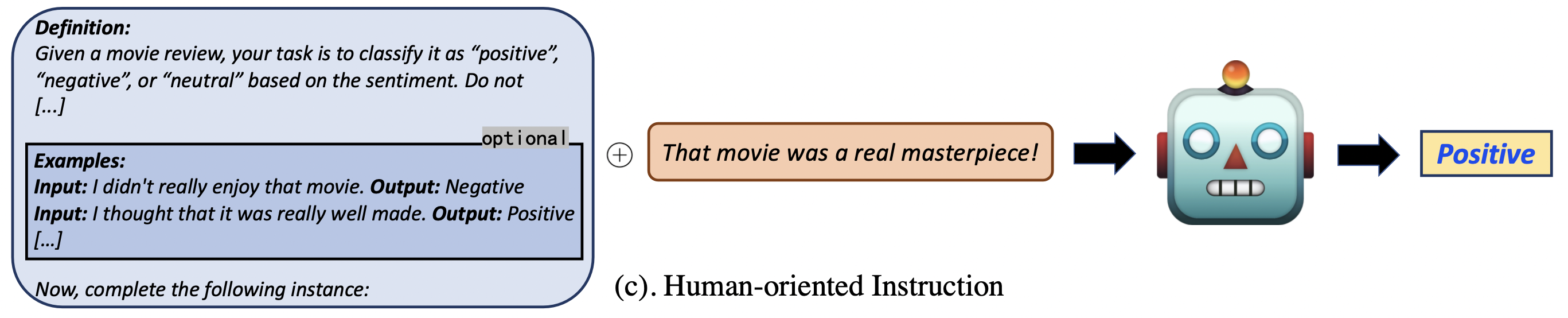

4.3 以人为本的指令

以人为本的指令最初旨在帮助人类理解任务并标注数据,例如Amazon MTurk的说明,它提供了关于任务的充分信息(例如详细的定义)。

对齐指令任务解锁了大型语言模型作为零样本关系抽取器。 张凯、贝尔纳尔·希门尼斯·古铁雷斯、苏宇。 ACL发现 2023年。[pdf]; [代码]。

符号微调提升了语言模型的上下文学习能力。 杰瑞·魏、乐厚、安德鲁·兰皮嫩、向宁陈等。 预印本 2023年。[pdf]。

小型模型是大型语言模型的宝贵插件。 徐灿文、徐一冲、王舒航、刘洋、朱晨光、朱利安·麦考利。 预印本 2023年。[pdf]; [代码]。

额外一条指令值得多少数据样本? 拉夫塞哈吉·辛格·普里、斯瓦鲁普·米什拉、米希尔·帕尔马尔、奇塔·巴拉尔。 EACL发现 2023年。[pdf]; [代码]。

InstructABSA:面向方面情感分析的指令学习。 凯文·斯卡里亚、希曼舒·古普塔、索拉布·阿琼·萨旺特、斯瓦鲁普·米什拉、奇塔·巴拉尔。 预印本 2023年。[pdf]; [代码]。

HINT:用于高效零样本泛化的超网络指令微调。 哈米什·伊维森、阿克希塔·巴吉亚、王益忠、哈娜内·哈吉希日齐、马修·彼得斯。 预印本 2022年。[pdf]。

通过元学习提升基于指令的自然语言生成。 布达迪蒂亚·德布、郭庆郑、艾哈迈德·哈桑·阿瓦达拉。 预印本 2022年。[pdf]。

GrIPS:无梯度、基于编辑的指令搜索,用于提示大型语言模型。 阿尔基·普拉萨德、彼得·哈塞、向周、莫希特·班萨尔。 预印本 2022年。[pdf]; [代码]。

ConTinTin:从任务指令中进行持续学习。 尹文鹏、李佳、熊才明。 ACL 2022年。[pdf]。

InstructDial:通过指令微调提升对话中的零样本与少样本泛化能力。 普拉卡尔·古普塔、凯茜·焦、易婷·叶、希基卜·梅赫里、马克西恩·埃斯肯纳齐、杰弗里·P·比格姆。 EMNLP 2022年。[pdf]; [代码]。

图灵测试:语言模型能理解指令吗? 阿维娅·埃夫拉特、奥默·列维。 预印本 2020年。[pdf]。

5. 📊 分析

5.1 规模

研究发现,模型规模和任务规模对于基于指令的微调至关重要。一般来说,更大的模型规模有助于提升泛化能力,任务规模同样如此。不过,也有一些研究提出了不同观点(例如,Jang 等人 和 Wang 等人)。

Flan数据集:为高效指令微调设计数据与方法。 谢恩·朗普雷、乐厚、涂武等。 预印本 2023年。[pdf];[代码];[语料库]。

OPT-IML:从泛化视角出发,扩展语言模型指令元学习。 斯里尼瓦桑·艾耶尔、西维克托利亚·林、拉马坎特·帕苏努鲁等。 预印本 2022年。[pdf]。

利用无标签数据学习指令,实现零样本跨任务泛化。 于贤顾、裴可、夏燕朱、黄敏莉。 EMNLP 2022年。[pdf];[代码]。

大型语言模型的涌现能力。 杰森·魏、易泰、里希·博马萨尼、科林·拉菲尔等。 TMLR 2022年。[pdf]。

多任务提示训练实现零样本任务泛化。 维克托·桑、阿尔伯特·韦布森、科林·拉菲尔等。 ICLR 2022年。[pdf];[检查点];[语料库]。

Zemi:从多个任务中学习零样本半参数语言模型。 王振海龙、潘晓曼、余典、余东、陈建树、季恒。 预印本 2022年。[pdf];[代码]。

ZeroPrompt:将基于提示的预训练扩展至1000个任务,提升零样本泛化能力。 徐瀚伟、陈宇俊、杜玉伦、邵楠、王阳刚、李海宇、杨志林。 预印本 2022年。[pdf]。

规模的力量:用于参数高效提示微调的规模效应。 布莱恩·莱斯特、拉米·阿尔-尔福、诺亚·康斯坦特。 EMNLP 2021年。[pdf];[代码]。

5.2 可解释性

我们展示了聚焦于指令学习的可解释性和可靠性的相关工作,即阐释指令在何时以及为何能够发挥作用。

上下文学习“学到”了什么:解耦任务识别与任务学习。 Jane Pan、Tianyu Gao、Howard Chen 和 Danqi Chen。 ACL发现 2023年。[pdf]; [代码]。

REV:自由文本推理的信息论评估。 Hanjie Chen、Faeze Brahman、Xiang Ren 等。 ACL 2023年。[pdf]; [代码]。

大规模可解释性:识别Alpaca中的因果机制。 Zhengxuan Wu、Atticus Geiger、Christopher Potts 和 Noah D. Goodman。 预印本 2023年。[pdf]; [代码]。

大型语言模型本质上是主题模型:解释并寻找上下文学习的良好示范。 Xinyi Wang、Wanrong Zhu、Michael Saxon、Mark Steyvers 和 William Yang Wang。 预印本 2023年。[pdf]; [代码]。

上下文学习的可学习性。 Noam Wies、Yoav Levine 和 Amnon Shashua。 预印本 2023年。[pdf]。

为什么需要逐步思考?推理源于经验的局部性。 Ben Prystawski 和 Noah D. Goodman。 预印本 2023年。[pdf]。

更大的语言模型以不同的方式进行上下文学习。 Jerry Wei、Jason Wei、Yi Tay 等。 预印本 2023年。[pdf]。

上下文学习背后是什么学习算法?基于线性模型的探究。 Ekin Akyürek、Dale Schuurmans、Jacob Andreas、Tengyu Ma 和 Denny Zhou。 ICLR 2023年。[pdf]; [代码]。

语言模型能否从上下文中的解释中学习? Andrew K. Lampinen、Ishita Dasgupta、Stephanie C. Y. Chan 等。 EMNLP发现 2022年。[pdf]。

重新思考示范的作用:是什么让上下文学习奏效? Sewon Min、Xinxi Lyu、Ari Holtzman、Mikel Artetxe、Mike Lewis、Hannaneh Hajishirzi 和 Luke Zettlemoyer。 EMNLP 2022年。[pdf]; [代码]。

提示的偏差:连续提示离散化解释的奇特案例。 Daniel Khashabi、Xinxi Lyu、Sewon Min 等。 NAACL 2022年。[pdf]; [代码]。

基于提示的模型真的理解其提示的含义吗? Albert Webson 和 Ellie Pavlick。 NAACL 2022年。[pdf]; [代码]。

将指令提示重构成GPTk的语言。 Swaroop Mishra、Daniel Khashabi、Chitta Baral、Yejin Choi 和 Hannaneh Hajishirzi。 ACL发现 2022年。[pdf]; [代码]。

对GPT-3来说,什么样的上下文示例是好的? Jiachang Liu、Dinghan Shen、Yizhe Zhang、Bill Dolan、Lawrence Carin 和 Weizhu Chen。 ACL研讨会 2022年。[pdf]; [代码]。

奇妙排序的提示及其查找方法:克服少样本提示顺序敏感性。 Yao Lu、Max Bartolo、Alastair Moore、Sebastian Riedel 和 Pontus Stenetorp。 ACL 2022年。[pdf]。

使用前校准:提升语言模型的少样本性能。 Zihao Zhao、Eric Wallace、Shi Feng、Dan Klein 和 Sameer Singh。 ICML 2021年。[pdf]; [代码]。

5.3 鲁棒性与安全性

通过虚拟提示注入对指令微调的大型语言模型进行后门攻击。 Jun Yan、Vikas Yadav、Shiyang Li 等。 NeurIPS研讨会 2023年。[pdf]。

评估指令微调语言模型的零样本鲁棒性。 Jiuding Sun、Chantal Shaib 和 Byron C. Wallace。 预印本 2023年。[pdf]。

在指令微调过程中毒害语言模型。 Alexander Wan、Eric Wallace、Sheng Shen 和 Dan Klein。 ICML 2023年。[pdf]; [代码]。

针对ChatGPT的多步骤越狱隐私攻击。 Haoran Li、Dadi Guo、Wei Fan、Mingshi Xu、Jie Huang、Fanpu Meng 和 Yangqiu Song。 预印本 2023年。[pdf]。

远超你的要求:应用集成大型语言模型新型提示注入威胁的全面分析。 Kai Greshake、Sahar Abdelnabi、Shailesh Mishra、Christoph Endres、Thorsten Holz 和 Mario Fritz。 预印本 2023年。[pdf]; [代码]。

从任务指令中学习的鲁棒性。 Jiasheng Gu、Hanzi Xu、Liangyu Nie 和 Wenpeng Yin。 预印本 2022年。[pdf]。

从任务描述中学习。 Orion Weller、Nicholas Lourie、Matt Gardner 和 Matthew E. Peters。 EMNLP 2020年。[pdf]; [代码]; [语料库]。

5.4 评估

别再用老式的自动指标来评估你的指令微调系统了;试试更先进的方法,全面地进行评估吧!

气候变化中的骆驼:利用Tulu 2增强语言模型适应性。 哈米什·伊维森、王一忠、瓦伦蒂娜·皮亚特金等 预印本 2023年。[pdf];[模型与数据]

骆驼能走多远?探索开放资源上的指令微调现状。 王一忠、哈米什·伊维森、普拉迪普·达西吉等 NeurIPS 数据集与基准 2023年。[pdf];[代码]

通过调整动词形式进行指令遵循评估。 李世阳、严俊、王海、唐峥、任翔、维杰·斯里尼瓦桑、金红霞 预印本 2023年。[pdf]

INSTRUCTEVAL:迈向对指令微调大型语言模型的全面评估。 谢伟健、洪鹏飞、冰立东、波里亚·索贾尼亚 预印本 2023年。[pdf];[代码];[排行榜]

5.5 否定

否定表达,如“不要”和“避免做”,是模型难以正确理解和遵循的。

大型语言模型真的能理解提示吗?否定提示的案例研究。 乔尔·张、成贤叶、徐敏俊 ICML研讨会 2023年。[pdf]

通过不理解来理解:语言模型中否定的建模。 阿里安·侯赛尼、西瓦·雷迪、季米特里·巴赫达瑙等 NAACL 2021年。[pdf];[代码]

5.6 复杂性

论文正聚焦于提升指令的复杂性以增强模型能力。在指令数据中加入更多复杂的数据,模型的表现就能更加出色。

Wizardlm:赋能大型语言模型遵循复杂指令。 徐灿、孙庆峰、郑凯、耿秀波、赵璞、冯嘉展、陶崇阳、蒋大鑫 预印本 2023年。[pdf];[代码]

Orca:从GPT-4复杂解释轨迹中逐步学习。 穆克吉、苏巴布拉塔、米特拉、加内什、阿加瓦尔、萨哈吉、帕兰吉、哈米德、阿瓦达拉 预印本 2023年。[pdf]

复杂性与对齐之间内在关系的初步研究。 赵英秀、于博文、胡彬源、于海阳、黄飞、李永斌、张宁林 预印本 2023年。[pdf];[代码]

5.7 其他论文

- 别怪标注员:偏差早已始于标注指令。 米希尔·帕尔马尔、斯瓦鲁普·米什拉、莫尔·盖瓦、奇塔·巴拉尔 EACL 2023年。[pdf];[代码]

- 指令微调模型是快速学习者。 希曼舒·古普塔、索拉布·阿琼·萨旺特、斯瓦鲁普·米什拉等 预印本 2023年。[pdf];[代码]

- 少样本参数高效微调比上下文学习更好也更便宜。 刘浩坤、德里克·谭、穆罕默德·穆基斯、杰伊·莫赫塔、黄腾浩、莫希特·班萨尔、科林·拉菲尔 NeurIPS 2022年。[pdf];[代码]

- NLP相关众包HIT调查:哪些有效,哪些无效。 杰西卡·许云、杰弗里·比格姆、马克辛·埃斯克纳齐 预印本 2021年。[pdf]

6. 🤖 应用

6.1 人机交互

指令在各种人机交互(HCI)任务中都有应用,例如虚拟助手、聊天机器人等。

帮我写首诗:指令微调作为协作诗歌创作的载体。 图欣·查克拉巴蒂、维沙克·帕德马库马尔和何何。 EMNLP 2022。[pdf];[代码]。

帮我思考:一种面向非专家的简单提示策略,用于借助模型生成定制内容。 斯瓦鲁普·米什拉和埃尔纳兹·努里。 预印本 2022。[pdf]。

EditEval:基于指令的文本改进基准测试。 简·德维迪-尤、蒂莫·希克、郑宝江等。 预印本 2022。[pdf];[代码];[网站]。

向人类和机器传达自然程序。 萨姆·阿夸维瓦、叶文·普、玛尔塔·克里文等。 NeurIPS研讨会 2022。[pdf];[代码]。

基于GUI的自然语言指令与演示的交互式任务学习。 托比·贾俊·李、汤姆·米切尔和布拉德·迈尔斯。 ACL演示 2020。[pdf];[代码];[视频]。

为数据高效神经指令跟随预学习环境表示。 大卫·加迪和丹·克莱因。 ACL 2019。[pdf]。

VirtualHome:通过程序模拟家庭活动。 哈维尔·普伊格、凯文·拉、马尔科·博本等。 CVPR 2018。[pdf];[网站]。

与机器人进行自然语言交流。 约纳坦·比斯克、德尼兹·尤雷特和丹尼尔·马尔库。 NAACL 2016。[pdf];[网站]。

联合学习解析与感知:将自然语言与物理世界连接起来。 贾扬特·克里希纳穆提和托马斯·科拉尔。 TACL 2013。[pdf];[代码]。

弱监督学习语义解析器,将指令映射到动作。 约阿夫·阿茨基和卢克·泽特勒莫耶。 TACL 2013。[pdf]。

无监督PCFG诱导,用于高度模糊监督下的具身语言学习。 金周贤和雷蒙德·穆尼。 EMNLP 2012。[pdf]。

语言与感知的联合模型,用于具身属性学习。 辛西娅·马图塞克、尼古拉斯·菲茨杰拉德、卢克·泽特勒莫耶、李峰波和迪特·福克斯。 ICML 2012。[pdf]。

学习解读自然语言指令。 莫妮卡·巴贝什-弗罗马恩、詹姆斯·麦克格拉申、若元高和等。 ACL研讨会 2012。[pdf]。

快速在线词典学习,用于具身语言获取。 大卫·陈。 ACL 2012。[pdf]。

在蒙特卡洛框架下通过阅读手册学会取胜。 S.R.K. 布拉纳万、大卫·西尔弗和雷吉娜·巴尔齐莱。 ACL 2011。[pdf];[网站]。

从自然指令中学习。 丹·戈德瓦瑟和丹·罗斯。 IJCAI 2011。[pdf]。

从观察中学习解读自然语言导航指令。 大卫·L·陈和雷蒙德·J·穆尼。 AAAI 2011。[pdf]。

用概率图模型逼近符号接地问题。 斯特凡妮·泰利克斯、托马斯·科拉尔、史蒂文·迪克森等。 AAAI 2011。[pdf]。

从世界的反应中驱动语义解析。 詹姆斯·克拉克、丹·戈德瓦瑟、明伟昌和丹·罗斯。 CoNLL 2010。[pdf]。

学习遵循导航指示。 亚当·沃格尔和丹尼尔·朱拉夫斯基。 ACL 2010。[pdf]。

字里行间阅读:学习将高层指令映射到命令。 S.R.K. 布拉纳万、卢克·泽特勒莫耶和雷吉娜·巴尔齐莱。 ACL 2010。[pdf];[网站]。

阅读以学习:从语义摘要中构造特征。 雅各布·艾森斯坦、詹姆斯·克拉克、丹·戈德瓦瑟和丹·罗斯。 EMNLP 2009。[pdf];[网站]。

在较少监督下学习语义对应关系。 珀西·梁、迈克尔·乔丹和丹·克莱因。 ACL 2009。[pdf]。

强化学习,将指令映射到动作。 S.R.K. 布拉纳万、哈瑞·陈、卢克·泽特勒莫耶和雷吉娜·巴尔齐莱。 ACL 2009。[pdf];[网站]。

学习体育解说:具身语言获取的测试。 大卫·L·陈和雷蒙德·J·穆尼。 ICML 2008。[pdf]。

用自然语言建议引导强化学习者:RoboCup足球赛的初步结果。 格雷戈里·库尔曼、彼得·斯通、雷蒙德·穆尼和朱德·沙夫利克。 AAAI研讨会 2004。[pdf];[网站]。

6.2 数据与特征增强

一些指令(例如标签说明)也可用于自动标注(即数据增强),或用于丰富特征。

一个嵌入器,适用于任何任务:基于指令微调的文本嵌入。 苏洪锦、史伟嘉、笠井纯吾等。 预印本 2022年。[pdf];[网站]。

提示一致性用于零样本任务泛化。 周春婷、何俊贤、马学哲、泰勒·伯格-柯克帕特里克、格雷厄姆·纽比格。 EMNLP发现 2022年。[pdf];[代码]。

用组合式解释教授机器理解能力。 叶钦源、黄晓、伊丽莎白·博舍、任翔。 EMNLP发现 2020年。[pdf];[代码]。

通过神经执行树从解释中学习。 王子琪、秦宇佳、周文轩、闫军、叶钦源、莱昂纳多·内维斯、刘志远、任翔。 ICLR 2020年。[pdf];[网站]。

用自然语言解释训练分类器。 布拉登·汉考克、帕罗玛·瓦尔玛、斯蒂芬妮·王、马丁·布林格曼、珀西·梁、克里斯托弗·雷。 ACL 2018年。[pdf];[代码]。

从自然语言量化中进行分类器的零样本学习。 沙尚克·斯里瓦斯塔瓦、伊戈尔·拉布托夫、汤姆·米切尔。 ACL 2018年。[pdf]。

从自然语言解释中联合概念学习与语义解析。 沙尚克·斯里瓦斯塔瓦、伊戈尔·拉布托夫、汤姆·米切尔。 EMNLP 2017年。[pdf]。

6.3 通用语言模型

通用语言模型也是指令学习最具吸引力的应用之一,例如ChatGPT,它能很好地契合人类价值观。

人工通用智能的火花:GPT-4的早期实验。 塞巴斯蒂安·布贝克、瓦伦·钱德拉塞卡兰、罗嫩·埃尔丹等。 预印本 2023年。[pdf]。

事后智慧让语言模型成为更好的指令遵循者。 张天俊、刘芳晨、黄俊杰、皮特·阿贝勒、约瑟夫·E·冈萨雷斯。 预印本 2023年。[pdf];[代码]。

在预训练中添加指令:控制语言模型毒性的有效方法。 施瑞迈·普拉布莫耶、莫斯塔法·帕特瓦里、穆罕默德·肖耶比、布莱恩·卡坦扎罗。 预印本 2023年。[pdf]。

利用人类反馈训练语言模型以遵循指令。 龙欧阳、杰弗里·吴、徐江等。 NeurIPS 2022年。[pdf]。

6.4 其他论文

MultiInstruct:通过指令微调提升多模态零样本学习。 徐志扬、沈颖、黄立夫。 预印本 2022年。[pdf]。

UnifiedABSA:基于多任务指令微调的统一ABSA框架。 王增志、夏瑞、于建飞。 预印本 2022年。[pdf]。

面向少样本对话状态追踪的上下文学习。 胡宇石、李家萱、谢天宝、余涛、诺亚·A·史密斯、玛丽·奥斯滕多夫。 EMNLP发现 2022年。[pdf];[代码]。

使用多语言语言模型进行少样本学习。 林曦薇、托多尔·米哈伊洛夫、米凯尔·阿尔特克塞、等。 EMNLP 2022年。[pdf];[代码]。

UnifiedSKG:用文本到文本语言模型统一并多任务处理结构化知识接地。 谢天宝、吴陈亨利、石鹏、等。 EMNLP 2022年。[pdf];[代码];[网站]。

In-BoXBART:将指令引入生物医学多任务学习。 帕尔马尔·米希尔、米什拉·斯瓦鲁普、普罗希特·米拉莉、罗曼·曼、穆拉德·M·哈桑、巴拉尔·奇塔。 NAACL发现 2022年。[pdf];[代码]。

7. 📖 扩展阅读

我们还分享了一些其他很棒的论文,它们可能会为未来的研究提供灵感。

7.1 指令归纳

猜猜指令!翻转学习让语言模型成为更强的零样本学习者。 叶圣贤、金道勇、张乔恩、申仲宝、徐敏俊。 预印本 2022年。[pdf];[代码]。

指令归纳:从少量示例到自然语言任务描述。 奥尔·霍诺维奇、乌里·沙哈姆、塞缪尔·R·鲍曼、奥梅尔·列维。 预印本 2022年。[pdf];[代码]。

学习分解和组织复杂任务。 张毅、苏贾伊·库马尔·焦哈尔、尤莉娅·基塞列娃、赖恩·怀特、丹·罗斯。 NAACL 2021年。[pdf];[语料库]。

用于子事件序列预测的类比过程结构归纳。 张宏明、陈慕浩、王浩宇、宋阳秋、丹·罗斯。 EMNLP 2020年。[pdf];[代码]。

7.2 与ChatGPT相关的论文

如今,ChatGPT在自然语言处理领域可谓一颗耀眼的明星🌟。由于目前尚无关于ChatGPT的官方论文,我们分享一些前沿研究,这些工作能为深入理解ChatGPT提供宝贵见解。

何时需要为ChatGPT使用思维链提示? 陈九海、陈立昌、黄恒和周天一。 预印本 2023年。[pdf]。

ChatGPT中的毒性:分析人格设定的语言模型。 阿米特·德什潘德、维什瓦克·穆拉哈里、坦迈·拉杰普罗希特、阿什温·卡利亚恩和卡蒂克·纳拉西曼。 预印本 2023年。[pdf]。

ChatGPT是通用自然语言处理任务求解器吗? 秦成伟、阿斯顿·张、张卓升、陈嘉奥、安永田和杨迪。 预印本 2023年。[pdf]。

ChatGPT距离人类专家有多近?对比语料库、评估与检测。 郭碧阳、张欣、王子元等。 预印本 2023年。[pdf];[语料库]。

ChatGPT:样样精通,却样样不精。 扬·科孔、伊戈尔·奇切基、奥利维尔·卡什察等。 预印本 2023年。[pdf]。

7.3 人类反馈 vs. 模型反馈

通过合成反馈对大型语言模型进行对齐。 金圣东、裴相焕、申佳敏、姜素英、郭东贤、柳康敏和徐敏俊。 预印本 2023年。[pdf]。

LIMA:对齐的少即是多。 周冲婷、刘鹏飞、徐璞鑫、艾耶尔·斯里尼等。 预印本 2023年。[pdf]。

从零开始以最少人类监督驱动的语言模型自我对齐原则。 孙志清、沈益康、周钦红等。 预印本 2023年。[pdf];[代码]。

用人类偏好预训练语言模型。 托马斯·科尔巴克、史凯健、陈安琪等。 预印本 2023年。[pdf]。

宪法AI:来自AI反馈的无害性。 白云涛、索拉夫·卡达瓦特、桑迪潘·昆杜等。 预印本 2022年。[pdf];[语料库]。

用人类反馈的强化学习训练有益且无害的助手。 白云涛、安迪·琼斯、卡马尔·恩杜塞等。 预印本 2022年。[pdf];[语料库]。

7.4 可扩展的监督与对齐

衡量大型语言模型可扩展监督的进展。 塞缪尔·R·鲍曼、玄智允、伊森·佩雷斯等。 预印本 2022年。[pdf]。

让AI与共享的人类价值观对齐。 丹·亨德里克斯、科林·伯恩斯、史蒂文·巴萨特、安德鲁·克里奇、杰瑞·李、道恩·宋和雅各布·斯坦哈特。 ICLR 2021年。[pdf]。

7.5 其他论文

穿越灰色地带:语言模型中过度自信与不确定性的表达。 周凯琳、丹·朱拉夫斯基和桥本辰典。 预印本 2023年。[pdf]。

大型语言模型中道德自我修正的能力。 迪普·冈古利、阿曼达·阿斯克尔、尼古拉斯·谢弗等。 预印本 2023年。[pdf]。

大型语言模型很容易被无关上下文分散注意力。 弗雷达·石、陈心韵、卡尼什卡·米斯拉、内森·斯凯尔斯、大卫·多汉、埃德·奇、纳塔内尔·舍尔利和邓尼·周。 预印本 2023年。[pdf];[语料库]。

语言模型(大部分)知道自己知道什么。 索拉夫·卡达瓦特、汤姆·科纳利、阿曼达·阿斯克尔等。 预印本 2022年。[pdf]。

⭐ 星标历史

相似工具推荐

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。

OpenHands

OpenHands 是一个专注于 AI 驱动开发的开源平台,旨在让智能体(Agent)像人类开发者一样理解、编写和调试代码。它解决了传统编程中重复性劳动多、环境配置复杂以及人机协作效率低等痛点,通过自动化流程显著提升开发速度。 无论是希望提升编码效率的软件工程师、探索智能体技术的研究人员,还是需要快速原型验证的技术团队,都能从中受益。OpenHands 提供了灵活多样的使用方式:既可以通过命令行(CLI)或本地图形界面在个人电脑上轻松上手,体验类似 Devin 的流畅交互;也能利用其强大的 Python SDK 自定义智能体逻辑,甚至在云端大规模部署上千个智能体并行工作。 其核心技术亮点在于模块化的软件智能体 SDK,这不仅构成了平台的引擎,还支持高度可组合的开发模式。此外,OpenHands 在 SWE-bench 基准测试中取得了 77.6% 的优异成绩,证明了其解决真实世界软件工程问题的能力。平台还具备完善的企业级功能,支持与 Slack、Jira 等工具集成,并提供细粒度的权限管理,适合从个人开发者到大型企业的各类用户场景。