dr-claw

Dr. Claw 是一款面向研究人员和开发者的 AI 研究助手,旨在帮助用户高效完成从创意构思到实验执行、论文撰写和成果发布的全流程研究工作。它提供了一个集成化的研究平台,让用户无需在多个工具之间切换,即可完成整个研究过程。

Dr. Claw 解决了传统研究过程中流程繁琐、效率低下以及协作困难的问题。通过自动化任务执行、智能生成研究计划和多代理协作等功能,它显著提升了研究工作的效率与质量。

这款工具特别适合研究人员、学术开发者以及需要频繁进行数据分析和论文写作的用户使用。无论是进行初步的创意生成,还是复杂的实验设计与结果分析,Dr. Claw 都能提供强有力的支持。

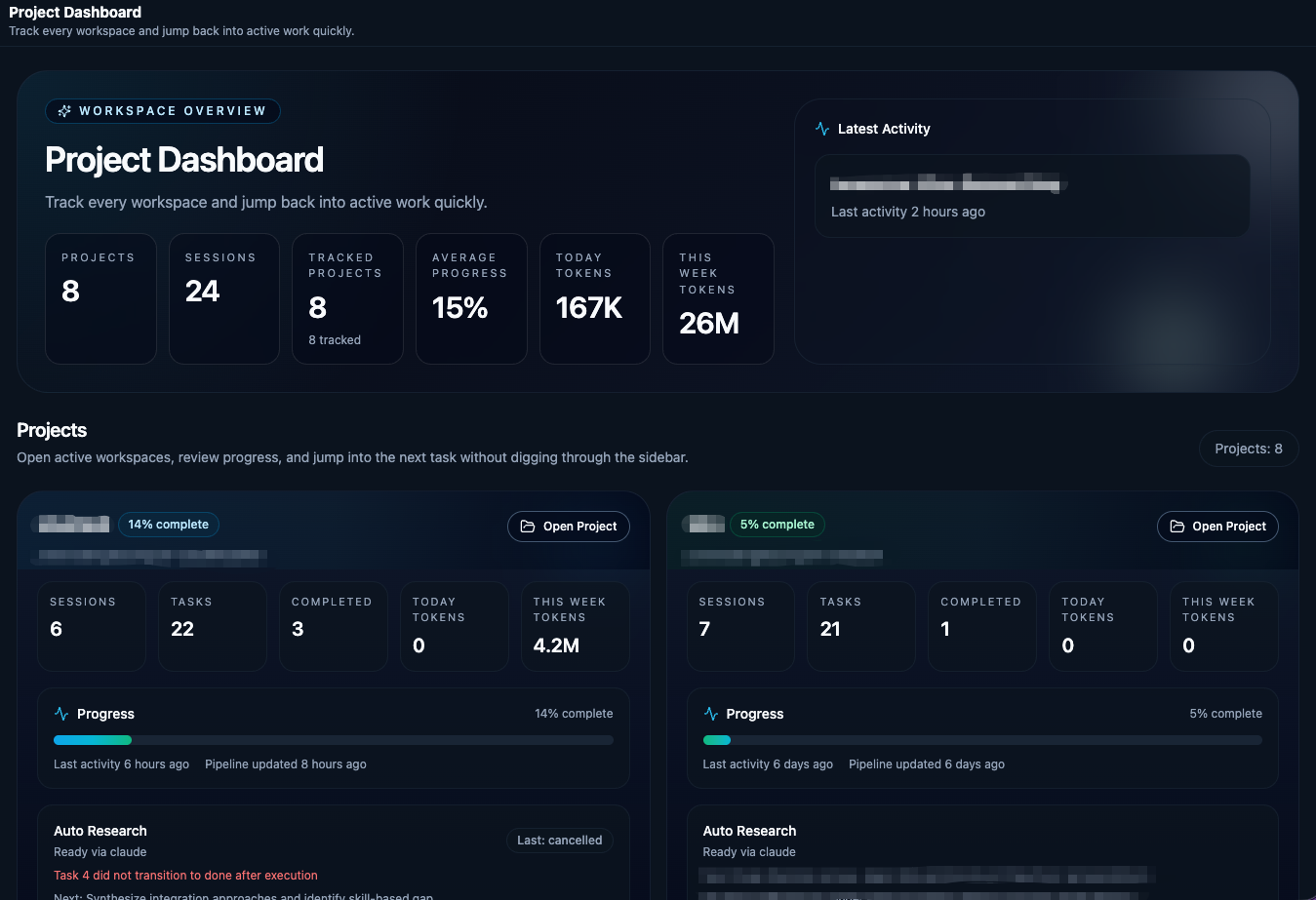

其独特的亮点包括结构化的研究实验室界面、一键启动自动研究流程、100 多种研究技能库,以及基于聊天驱动的任务规划功能。此外,它还支持多种 AI 引擎的无缝切换,满足不同场景下的需求。

使用场景

某高校人工智能实验室的研究团队正在开展一项关于自然语言处理(NLP)模型优化的课题,需要从文献调研、实验设计、代码实现到论文撰写完成全流程研究工作。

没有 dr-claw 时

- 团队成员需要手动搜索和整理大量学术论文,耗时且容易遗漏关键信息。

- 实验流程需反复调整参数并记录结果,缺乏系统化的任务管理工具,导致进度混乱。

- 编写代码和调试过程中遇到问题,需要频繁切换多个平台进行查询和测试,效率低下。

- 论文撰写阶段依赖人工排版与格式校对,耗费大量时间且易出错。

- 多人协作时,任务分配不明确,沟通成本高,难以统一研究方向。

使用 dr-claw 后

- 通过内置的“Research Lab”功能,自动抓取并整理相关领域的最新论文,生成结构化摘要和参考文献列表,节省了大量文献调研时间。

- 利用“Auto Research”一键启动任务流,从实验设计到结果分析全程自动化执行,并实时跟踪进度,确保研究过程高效有序。

- “Chat-Driven Pipeline”支持在聊天界面中描述研究目标,AI助手自动生成任务清单和代码框架,显著提升了开发效率。

- 内置的“100+ Research Skills”库可自动完成论文初稿撰写、公式排版及格式检查,大幅减少人工校对工作量。

- 多人协作时,dr-claw 提供统一的任务分配和进度追踪界面,便于团队成员协同推进项目。

核心价值:dr-claw 将复杂的研究流程智能化、一体化,让研究人员专注于创新本身,而非重复性劳动。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

Dr. Claw:您的AI研究助手

全栈式研究工作空间。

目录

概述

Dr. Claw是一款通用型AI研究助手,旨在帮助研究人员和开发者在不同领域开展端到端项目。从构思初始想法到执行实验并准备可发表的成果,Dr. Claw将整个工作流程整合在一个平台上,让团队能够专注于研究质量和迭代速度。

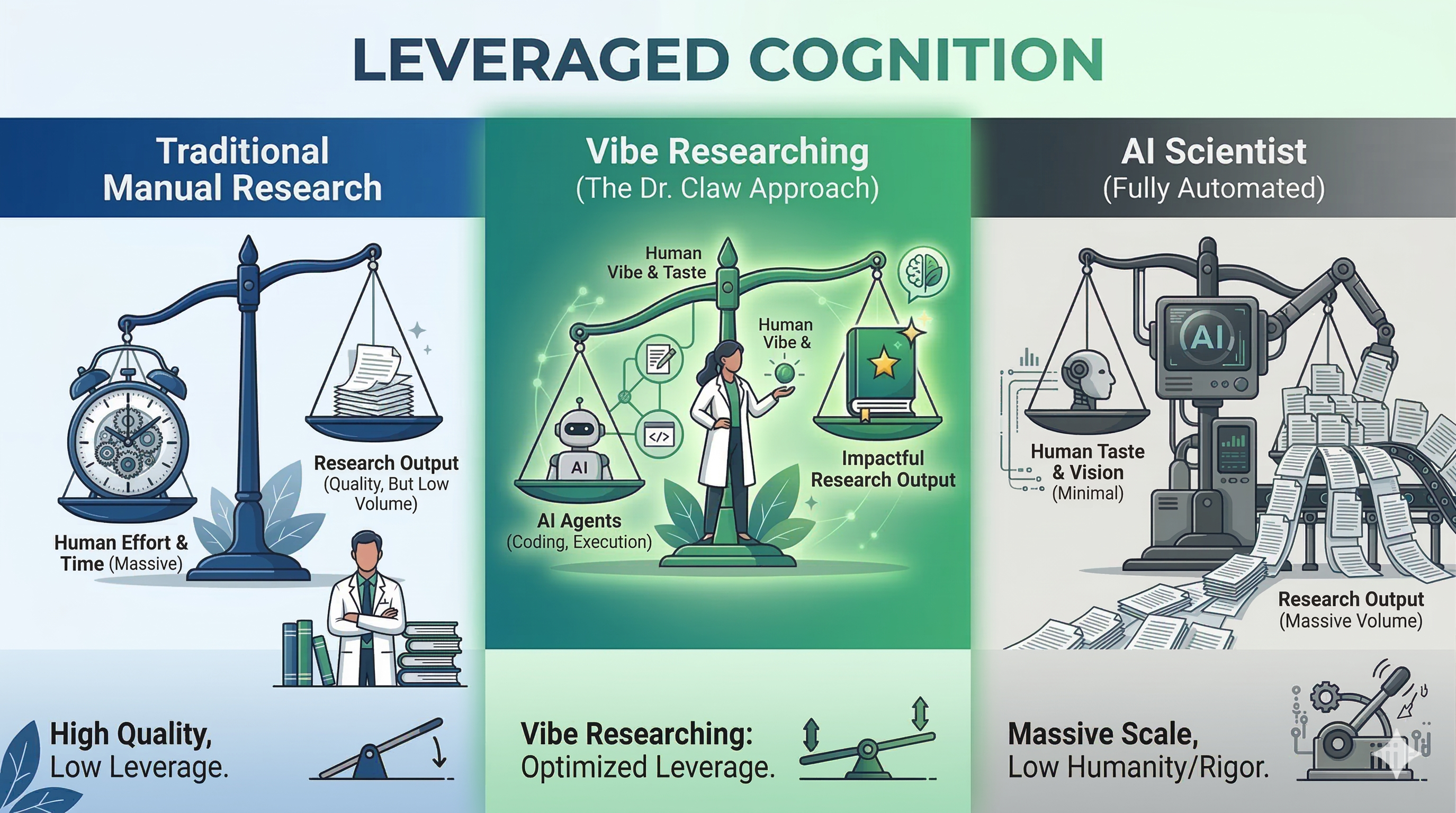

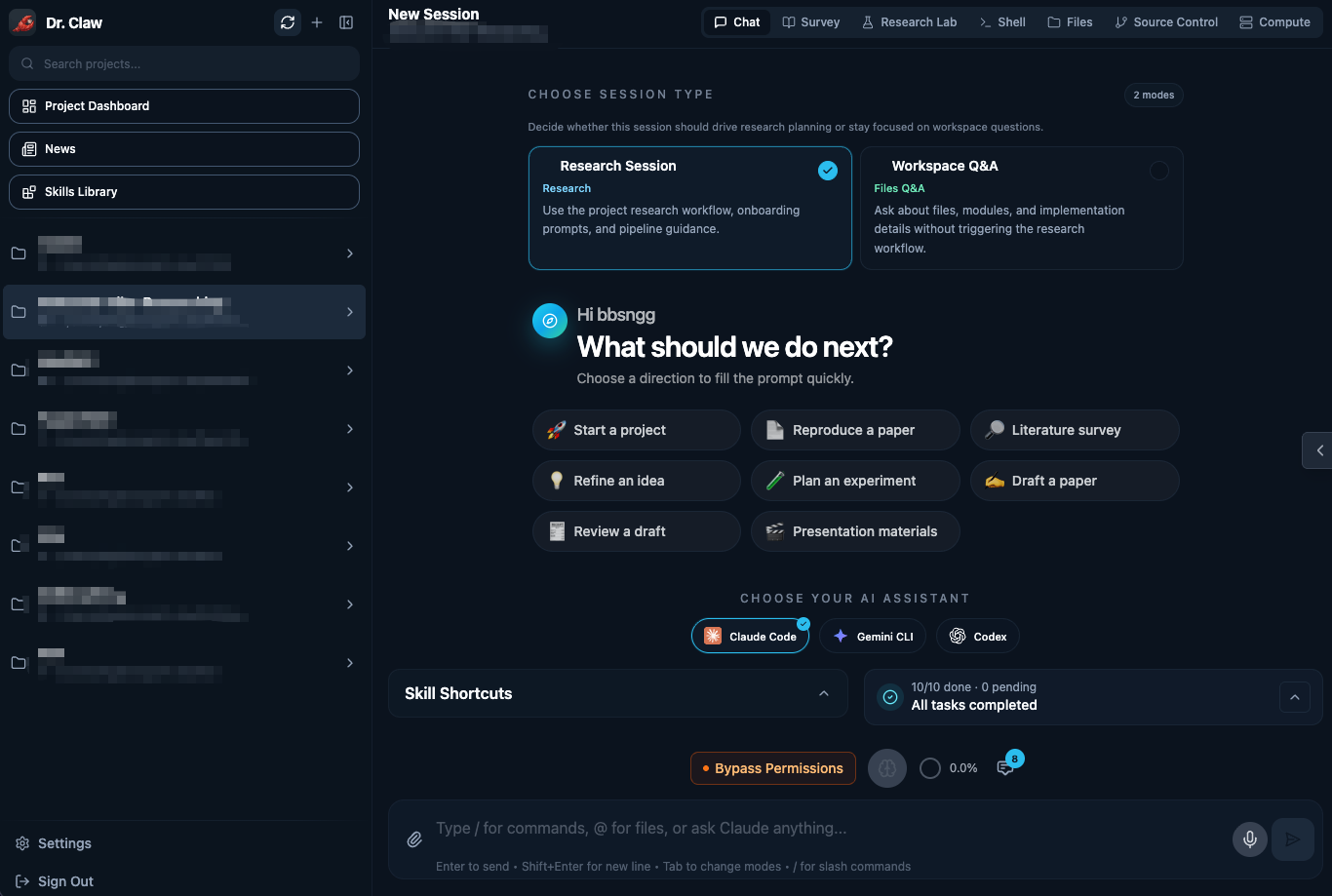

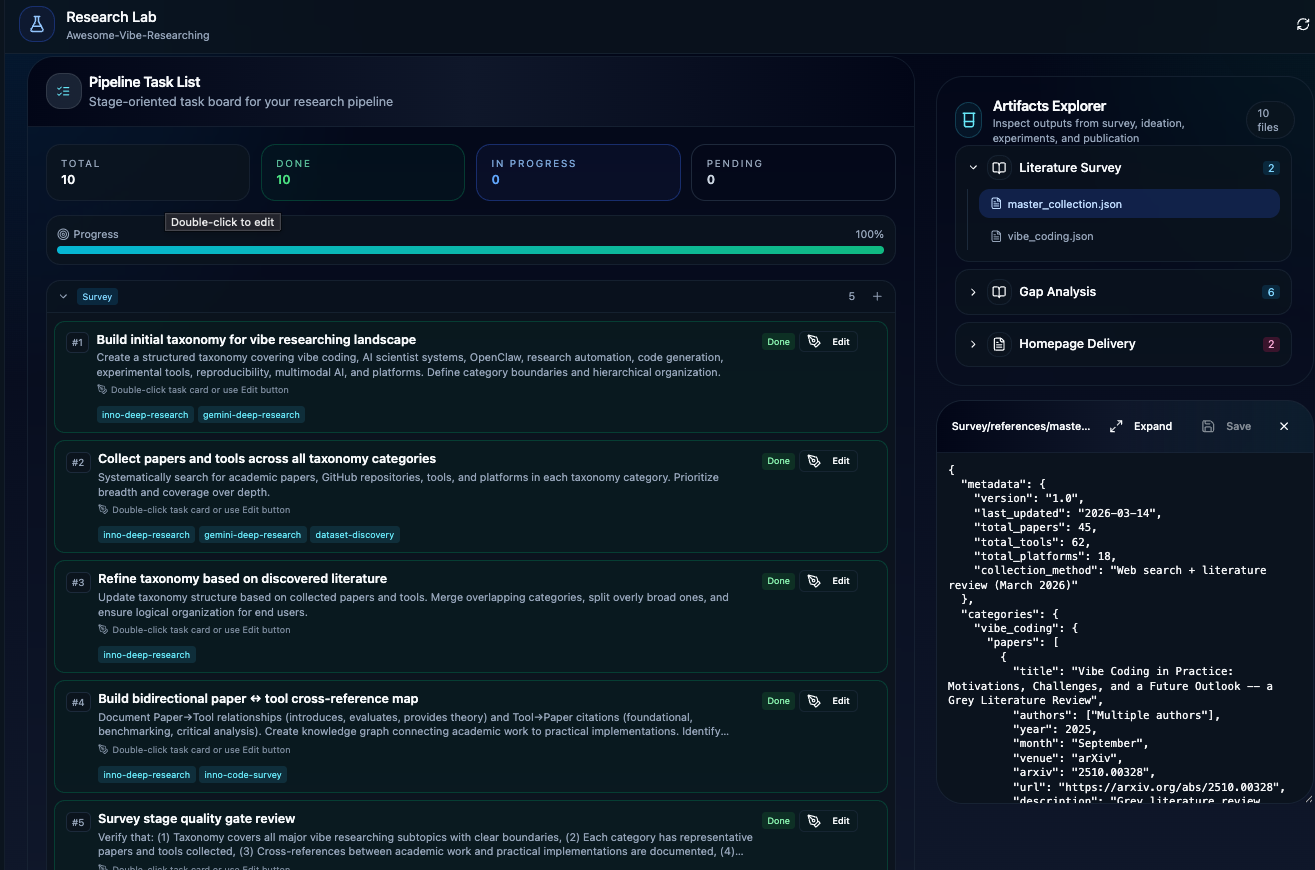

产品截图

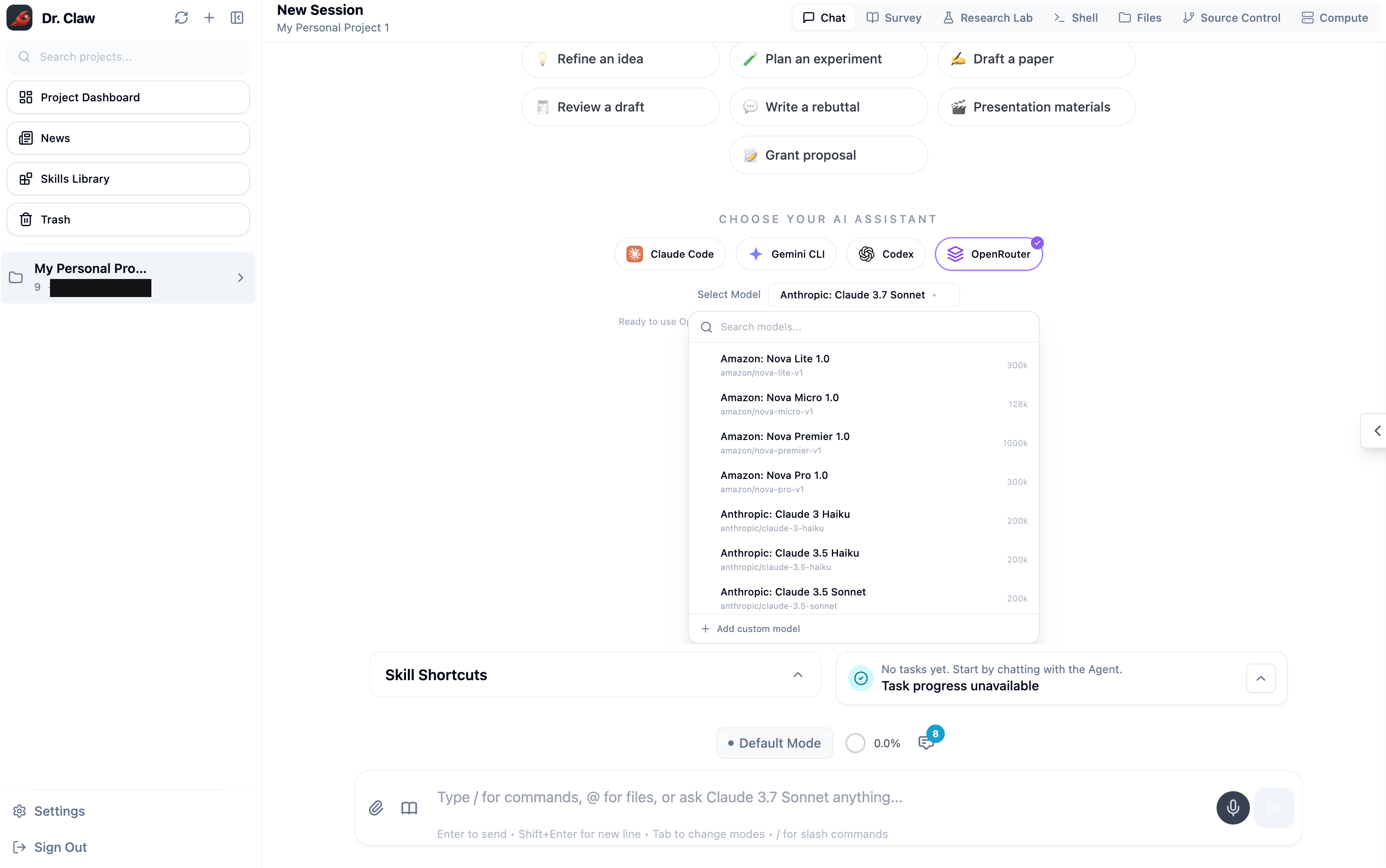

理念:杠杆认知

人工操作太慢,完全自动化的AI又过于泛化。Vibe Researching才是新的前沿。 Dr. Claw通过“代理执行”将您的“研究品味”转化为超大规模的成果——让您跑得更快、想得更大,同时依然坚守科学严谨性。

亮点

- 🔬 研究实验室 — 结构化的仪表盘,支持端到端研究:定义研究简报、生成任务流水线、跟踪从调研→构思→实验→发表→推广的全流程进度,并可一键查看源论文、以LaTeX数学格式呈现的研究思路以及缓存产物——所有信息一目了然

- ⚡ 自动研究 — 可直接从项目仪表盘一键启动连续任务执行,实时打开生成的会话,并在运行结束后收到邮件通知

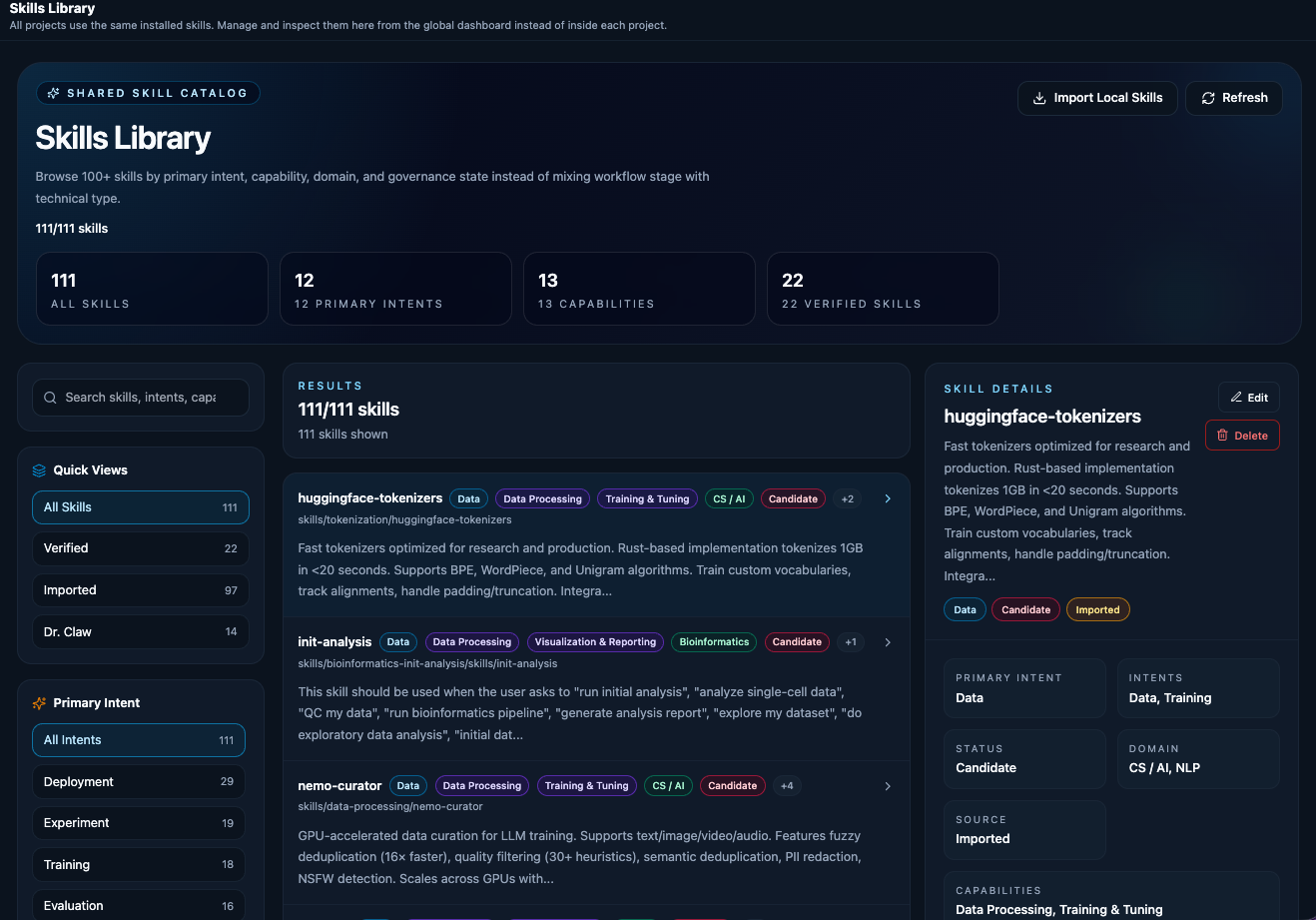

- 📚 100+项研究技能 — 精选的技能库涵盖创意生成、代码调研、实验开发与分析、论文撰写、审稿回复及成果交付——由智能代理自动发现并作为任务级辅助应用

- 🗂️ 聊天驱动的流水线 — 在聊天中描述您的研究想法;代理会利用“inno-pipeline-planner”技能交互式生成结构化的研究简报和任务清单——无需手动模板

- 🤖 多代理后端 — 可无缝切换Claude Code、Gemini CLI、Codex和OpenRouter作为执行引擎

流水线产出

| 成果 | 位置 | 描述 | |

|---|---|---|---|

| 📚 | 调研报告 | Survey/reports/ |

带有arXiv、Semantic Scholar及网络来源引用的文献综述 |

| 💡 | 研究想法 | Ideation/ideas/ |

带有多角色评估分数的头脑风暴成果 |

| 🔬 | 实验代码 | Experiment/core_code/ |

从计划到实现再到评估的循环 |

| 📊 | 分析结果 | Experiment/analysis/ |

统计分析、表格及可发表的图表 |

| 📝 | 论文草稿 | Publication/paper/ |

学术手稿(IEEE/ACM格式),包含引用和LaTeX数学 |

| 🎞️ | 演示文稿 | Promotion/slides/ |

幻灯片演示、TTS旁白音频及演示视频 |

请参阅docs/pipeline-outputs.md了解完整的成果列表及项目目录结构。

更多功能

- 💬 交互式聊天+终端 — 可与代理聊天或直接进入完整终端——与研究上下文并排显示

- 📁 文件与Git浏览器 — 支持语法高亮的文件浏览、实时编辑、暂存更改、提交及切换分支,全程无需离开UI

- 📱 响应式设计与PWA支持 — 适配桌面、平板及移动端布局,配备底部标签栏、滑动手势及添加到主屏幕支持

- 🔄 会话管理 — 支持恢复对话、管理多个会话,并跨项目追踪完整历史记录

功能图集

展开截图

项目仪表盘 — 从项目概览开始,查看状态并启动端到端自动化。

技能库 — 浏览可用于构思、实验及撰写的可复用研究技能。

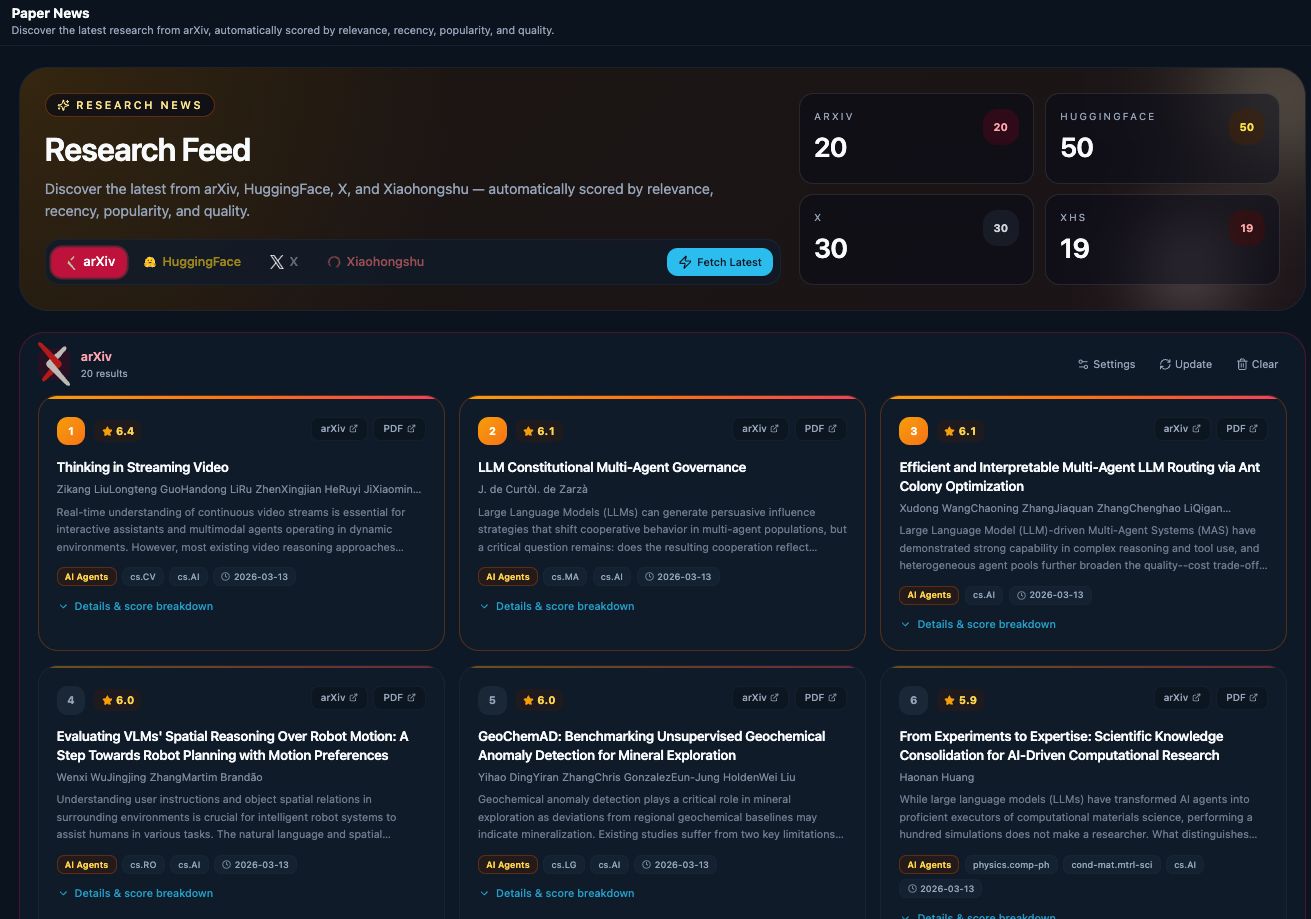

新闻仪表盘 — 在不离开工作区的情况下关注研究相关动态。

快速入门

先决条件

- Node.js v20及以上版本(推荐使用v22 LTS,详见

.nvmrc) - 至少安装并配置以下CLI工具之一:

- 部分系统需要原生构建工具来处理

node-pty和better-sqlite3等依赖。如果npm install失败,请参阅常见问题。

Cursor代理支持正在开发中,即将上线。

安装

- 克隆仓库:

git clone https://github.com/OpenLAIR/dr-claw.git

cd dr-claw

- 安装依赖:

npm install

- 配置环境:

cp .env.example .env

# 编辑 .env 文件,根据需要设置端口等参数

如果需要自定义端口、认证或工作空间设置,请参阅 docs/configuration.md。

- 启动应用:

# 开发模式(带热重载)

npm run dev

然后通过浏览器访问 http://localhost:5173 创建您的账户。

- 使用应用

与 Dr. Claw 的交互方式有两种:前端 UI 流程和纯终端模式。UI 提供更丰富的可视化体验,但可能会偶尔出现 bug;而终端模式则更加稳定、轻量。

方案 A:前端 UI

在浏览器中打开 http://localhost:5173(或您在 .env 中配置的端口)。

方案 B:纯终端模式

打开一个第二个终端(第一个终端保持运行 npm run dev),并安装 drclaw CLI 工具包:

pip install -e ./agent-harness

然后使用您在设置过程中创建的凭据登录:

drclaw auth login --username YOUR_USERNAME --password YOUR_PASSWORD

至少安装一个代理 CLI(如果您尚未安装):

| 代理 | 安装 | 认证 |

|---|---|---|

| Claude Code | npm install -g @anthropic-ai/claude-code |

claude → 按照 OAuth 提示操作 |

| Gemini CLI | npm install -g @google/gemini-cli |

gemini → Google 登录,或 export GOOGLE_API_KEY=... |

| Codex CLI | npm install -g @openai/codex |

codex login,或 export OPENAI_API_KEY=... |

| OpenRouter | 无需 CLI | export OPENROUTER_API_KEY=sk-or-...(请在 openrouter.ai/keys 获取密钥) |

OpenRouter 允许您通过一个 API 密钥使用任何模型(GPT-5、Claude、Gemini、DeepSeek、Llama、Mistral、Qwen 等)。您可以在 UI 中选择模型,或在

.env中设置OPENROUTER_MODEL。

进入您想要工作的项目目录,并启动任意一个代理:

cd /path/to/your/project

claude # 或:gemini | codex

dr-claw/skills/ 中的技能会在项目创建时自动符号链接到每个项目的 .claude/skills/ 目录,因此代理无需额外配置即可发现这些技能。您也可以在会话中手动引用任意技能:

> 阅读 .claude/skills/inno-experiment-analysis/SKILL.md 并按照其指示分析我的结果。

方案 C:OpenRouter 终端聊天

若希望以轻量级的纯终端模式使用任意 OpenRouter 模型,可使用内置的 dr-claw chat 命令。无需浏览器或 UI——只需进行一次具备完整工具调用能力的交互式代理会话(文件 I/O、Shell、grep、glob、网络搜索/获取)。

# 确保已设置 OPENROUTER_API_KEY(或直接传入 --key 参数)

export OPENROUTER_API_KEY=sk-or-...

# 启动与任意模型的聊天会话

node server/cli.js chat --model moonshotai/kimi-k2.5

您也可以直接在命令行中传入 API 密钥:

node server/cli.js chat --model anthropic/claude-sonnet-4 --key sk-or-your-key

| 标志 | 描述 |

|---|---|

--model <slug> |

OpenRouter 模型标识符(例如 moonshotai/kimi-k2.5、anthropic/claude-sonnet-4、deepseek/deepseek-r1) |

--key <key> |

OpenRouter API 密钥(默认为 OPENROUTER_API_KEY 环境变量) |

您可以在 openrouter.ai/models 查看所有可用模型。

如果后续代理的网络搜索无法正常工作,请参阅下方的【网络搜索故障排除】。

OpenClaw 集成

本节专为首次将 OpenClaw 与 Dr. Claw 集成的新用户编写。我们的目标并非面面俱到,而是帮助您快速完成一次可靠的首次集成:

- OpenClaw 能够查看现有的 Dr. Claw 项目;

- OpenClaw 能够找到等待用户输入的会话;

- OpenClaw 能够回复到选定的会话,使 Dr. Claw 继续运行;

- OpenClaw 能够总结项目/组合进展,并推荐下一步的重点方向。

清晰的思维模型是:

- Dr. Claw:拥有真实的项目、会话、流水线、产出物以及执行过程;

drclawCLI:通过稳定的本地控制界面暴露这些状态,主要以drclaw命令呈现;- OpenClaw:作为面向用户的秘书,可通过移动端、聊天或语音提供服务。

新用户的最快路径

如果您只想走最短的成功路径,只需完成以下五步:

- 启动 Dr. Claw;

- 安装

drclawCLI; - 授予 OpenClaw 本地 Shell /

exec访问权限; - 安装提供的 OpenClaw 技能;

- 确保

chat waiting和digest portfolio能够端到端正常运行。

一旦这两条命令能够正常工作,OpenClaw 就已经可以像一个可用的研究秘书一样发挥作用。

步骤 0:确认先决条件

在集成之前,请确保:

- 您已经能够在本地运行 Dr. Claw;

- 您已经拥有至少一个项目,或者可以在

~/vibelab/...下创建一个; - 您已经配置了至少一个执行后端,如 Claude Code、Gemini CLI 或 Codex;

- 您的 OpenClaw 实例被允许运行本地工具。

如果以上条件尚未满足,请先让 Dr. Claw 本身正常运行。

步骤 1:启动并验证 Dr. Claw 服务器

从仓库根目录开始:

npm install

npm run dev

在另一个终端中:

drclaw --json auth status

drclaw server status

优先使用 auth status 作为可达性检查。如果返回 JSON,则说明服务器已可访问。

drclaw server status 只会报告由 drclaw server on 启动的守护进程。如果您是手动通过 npm run dev 启动的应用程序,即使 http://localhost:3001 正常运行,它也可能显示 STOPPED。

如果您希望 Dr. Claw 自动管理后台进程:

drclaw server on

步骤 2:安装并验证 drclaw CLI

从仓库根目录开始:

pip install -e ./agent-harness

然后进行验证:

drclaw --help

drclaw --json auth status

drclaw --json projects list

理想的顺序是:

drclaw --json auth status应返回 JSON,表明服务器已可访问;drclaw --json projects list只有在登录后或已有保存的令牌时才会生效。

如果 projects list 返回 Not logged in,请先进行认证:

drclaw auth login --username <username> --password <password>

第3步:赋予OpenClaw本地CLI执行能力

关键的集成并不在于构建一个深度的API桥接。关键在于OpenClaw能够直接在本地执行drclaw ...命令。

至少,OpenClaw应当能够运行如下命令:

drclaw --json chat waiting

drclaw --json digest portfolio

drclaw --json chat reply --project <project> --session <session-id> -m "<message>"

drclaw --json workflow continue --project <project> --session <session-id> -m "<instruction>"

推荐的做法:

- 为OpenClaw启用本地

exec/shell功能 - 尽量采用直接的本地CLI调用

- 避免一开始就搭建额外的代理层

这一层越薄,调试就越容易,可靠性也越高。

第4步:通过一条命令完成OpenClaw的链接

运行:

drclaw install --server-url http://localhost:3001

这将自动完成以下操作:

- 将Dr. Claw技能复制到

~/.openclaw/workspace/skills/drclaw - 安装OpenClaw用于序列化本地轮次交互的辅助脚本

- 保存Dr. Claw服务器URL,以便后续CLI或OpenClaw使用

- 记住本地

drclaw可执行文件的路径

如果在设置过程中还想保存默认的推送通道:

drclaw install --server-url http://localhost:3001 --push-channel feishu:<chat_id>

兼容性形式仍然可用:

drclaw openclaw install --server-url http://localhost:3001

第5步:先让两个核心命令正常工作

对于新用户,不要一开始就尝试所有功能。先从这两个命令入手:

- 查找哪些会话正在等待用户输入

drclaw --json chat waiting

- 获取投资组合层面的进展与建议

drclaw --json digest portfolio

如果OpenClaw能够调用这两个命令,并将结果汇总后反馈给用户,那么你的最小可行集成就已经成功了。

第6步:添加回复循环

接下来常见的用户操作是:查看有等待的会话,然后让OpenClaw为其作答。

固定的流程是:

- 查找等待中的会话:

drclaw --json chat waiting

让用户选择项目和会话

发送回复:

drclaw --json chat reply --project <project> --session <session-id> -m "<message>"

- 立即再次检查是否仍处于等待状态:

drclaw --json chat waiting --project <project>

如果用户希望继续讨论同一个项目/会话,则切换为:

drclaw --json chat project --project <project> --session <session-id> -m "<instruction>"

这是进行多轮、基于项目的讨论时更优的模式。

第7步:推荐的固定操作模式

推荐的OpenClaw使用流程:

- 用户提问:目前有哪些事项需要我关注?

drclaw --json digest portfolio

- 用户提问:哪些会话正在等我?

drclaw --json chat waiting

- 用户提问:这个项目的最新状态如何?

drclaw --json projects latest <project>

drclaw --json projects progress <project>

- 用户说:回复这个会话并推动其继续进展

drclaw --json chat reply --project <project> --session <session-id> -m "<message>"

- 用户说:我刚有个新想法,创建一个项目并帮我把它落地

drclaw --json projects idea /absolute/path/to/project --name "<display-name>" --idea "<idea text>"

第8步:优先采用序列化的本地轮次

当OpenClaw反复运行openclaw agent --local时,应使用序列化封装器来避免会话锁定冲突:

agent-harness/skills/dr-claw/scripts/openclaw_drclaw_turn.sh

示例:

openclaw_drclaw_turn.sh --json -m "使用你的exec工具运行`drclaw --json digest portfolio`。仅返回原始stdout。"

实际上:当OpenClaw在本地调用Dr. Claw时,稳定的串行轮次比冒险的并行轮次更可靠。

第9步:如何判断集成是否成功

新用户可以认为集成已完成,只要满足以下四个条件:

- OpenClaw能够列出Dr. Claw的项目

- OpenClaw能够识别出等待中的会话

- OpenClaw能够成功向选定的会话发送一条回复

- OpenClaw能够生成一份包含建议的“digest portfolio”式总结

到那时,OpenClaw就不再只是一个聊天界面,而真正成为了Dr. Claw的移动秘书。

第10步:最终用户可以怎么说

设置完成后,用户应该能够自然地与OpenClaw对话:

- “帮我看看有哪些Dr. Claw项目正在等我回复。”

- “把这个项目的最新消息和当前进展给我总结一下。”

- “回复这个会话:继续选项B,完成后告诉我结果。”

- “总结一下最近各项目的实验进展,并推荐我今天该重点关注什么。”

- “我刚有个新想法,帮我创建一个Dr. Claw项目,和我一起讨论、打磨,然后开始制定执行计划。”

我们的目标不是取代Dr. Claw,而是让Dr. Claw通过OpenClaw变得可调用、可汇报、可引导、可远程管理。

配置

Dr. Claw从.env文件中读取本地配置。对大多数用户来说,唯一需要做的就是将.env.example复制到.env,但以下这些配置是你最早可能需要调整的:

PORT:后端服务器端口VITE_PORT:前端开发服务器端口HOST:前端和后端的绑定地址JWT_SECRET:在将Dr. Claw暴露到本地以外之前必需WORKSPACES_ROOT:新建项目工作空间的默认根目录

完整的环境参考及部署说明,请参阅docs/configuration.md。

自动研究的邮件通知在应用内通过设置→邮件进行配置。v1版本支持Claude Code、Codex、Gemini和OpenRouter引擎进行无人值守的任务执行,且中断的运行会自动恢复,不会一直卡在“运行中”状态。

OpenRouter

OpenRouter被集成为一级提供商,让你只需一个API密钥就能访问数百种模型(GPT-5、Claude、Gemini、DeepSeek、Llama、Mistral、Qwen、Kimi等)。

设置

- 在openrouter.ai/keys获取一个API密钥。

- 通过三种方式之一设置密钥:

- 环境变量:

export OPENROUTER_API_KEY=sk-or-... .env文件:在项目.env中添加OPENROUTER_API_KEY=sk-or-...- UI:进入设置→OpenRouter,粘贴你的密钥

- 环境变量:

在UI中使用OpenRouter

- 打开一个项目,进入聊天。

- 在选择你的AI助手下,点击OpenRouter。

- 在下拉菜单中搜索模型(会从OpenRouter获取完整列表),或输入自定义模型的slug。

- 开始聊天——该代理具备与Claude、Gemini和Codex相同的工具调用能力(文件读写、shell、grep、glob、网络搜索/抓取、待办事项)。

OpenRouter也在项目仪表板的自动研究中可用——选择它作为提供商,并挑选任意模型。

在终端中使用 OpenRouter

无需浏览器。dr-claw chat CLI 为您提供一个完全自主的终端会话:

# 基本用法

node server/cli.js chat --model moonshotai/kimi-k2.5

# 使用显式 API 密钥

node server/cli.js chat --model deepseek/deepseek-r1 --key sk-or-your-key

该 CLI 支持与 UI 相同的工具(文件 I/O、Shell、grep、glob、网页搜索、网页抓取、待办事项)。输入您的消息,代理将自动执行多步骤的研究任务。

默认模型

在 .env 文件中设置 OPENROUTER_MODEL,以更改未指定模型时使用的默认模型:

OPENROUTER_MODEL=moonshotai/kimi-k2.5

如果未设置,则默认为 anthropic/claude-sonnet-4。

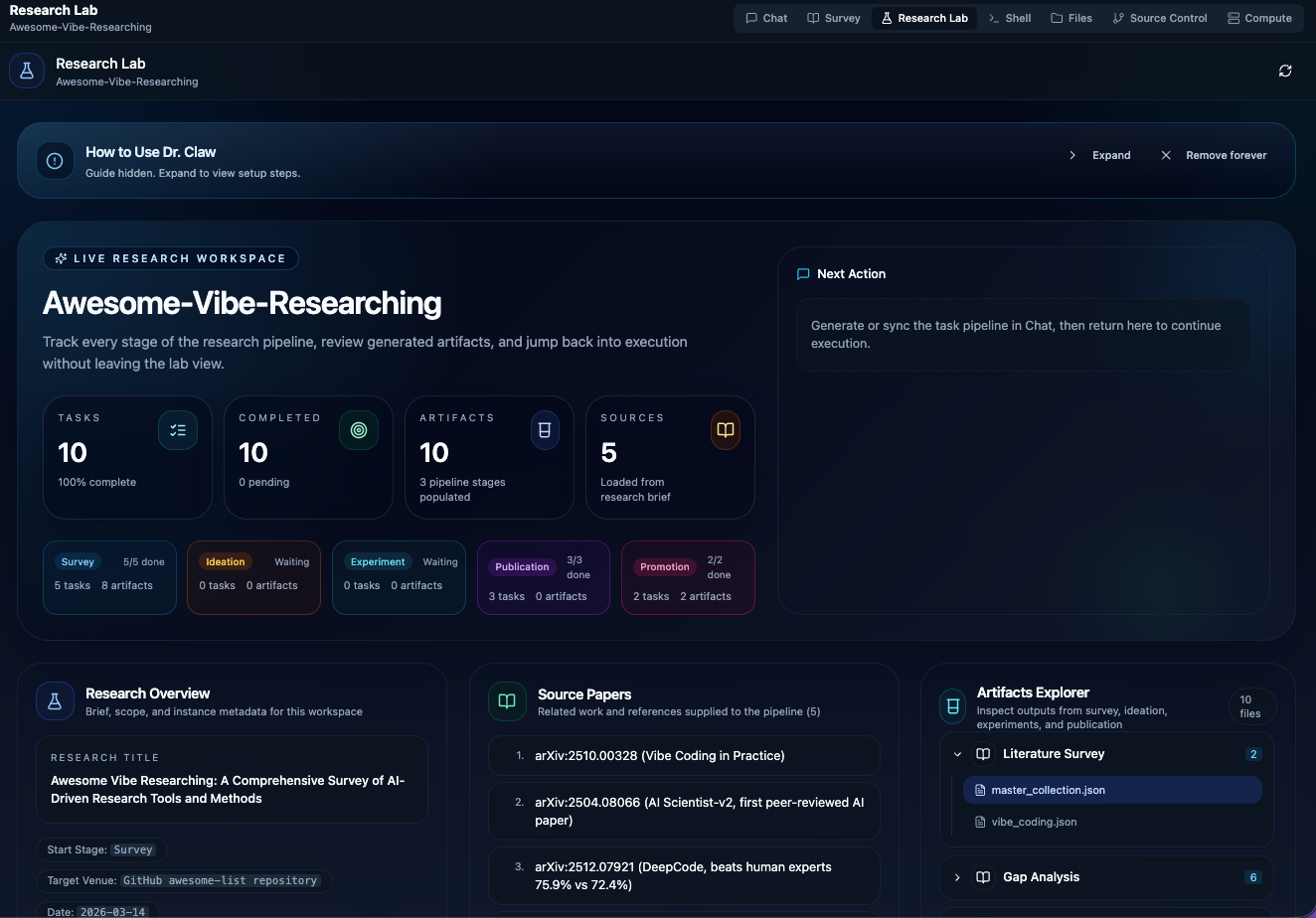

研究实验室 — 快速示例

Dr. Claw 的核心功能是 研究实验室。

研究实验室截图

典型流程如下:

- 在 设置 中配置一个支持的代理。

- 如果需要完成邮件通知,可在 设置 → 邮件 中配置通知设置。

- 在 聊天 中描述您的研究想法。

- 让代理生成

.pipeline/docs/research_brief.json和.pipeline/tasks/tasks.json。 - 在 研究实验室 中查看流水线,并手动将任务发回 聊天,或在项目仪表板上点击 自动研究 以按顺序运行这些任务。

有关完整的分步操作,请参阅下方的 使用指南。

使用指南

启动 Dr. Claw 后,打开浏览器并按照以下步骤操作。

步骤 1 — 创建或打开项目

首次打开 Dr. Claw 时,您将看到 项目 侧边栏。您有两种选择:

- 打开现有项目 — Dr. Claw 会自动发现从 Claude Code、Codex 和 Gemini 注册的项目及关联的会话。

- 创建新项目 — 点击 “+” 按钮,选择您电脑上的一个目录,Dr. Claw 将设置工作空间:包括

.claude/、.agents/、.gemini/等代理文件夹,标准工作空间元数据,关联的skills/目录,预设的研究目录(调查/参考文献、调查/报告、构思/创意、构思/参考文献、实验/代码参考、实验/数据集、实验/核心代码、实验/分析、出版/论文、推广/主页、推广/幻灯片、推广/音频、推广/视频),以及项目根目录下的 instance.json 文件,其中包含这些目录的绝对路径。光标代理支持即将推出。

默认项目存储路径: 新项目默认存储在

~/dr-claw下。您可以在 设置 → 外观 → 默认项目路径 中更改此设置,或设置WORKSPACES_ROOT环境变量。该设置会持久化在~/.claude/project-config.json中。

步骤 2 — 通过聊天生成您的研究流水线

创建或打开项目后,Dr. Claw 默认会打开 聊天。如果尚未存在研究流水线,会出现一个引导横幅,其中包含 在聊天中使用 按钮,用于注入一个入门提示。

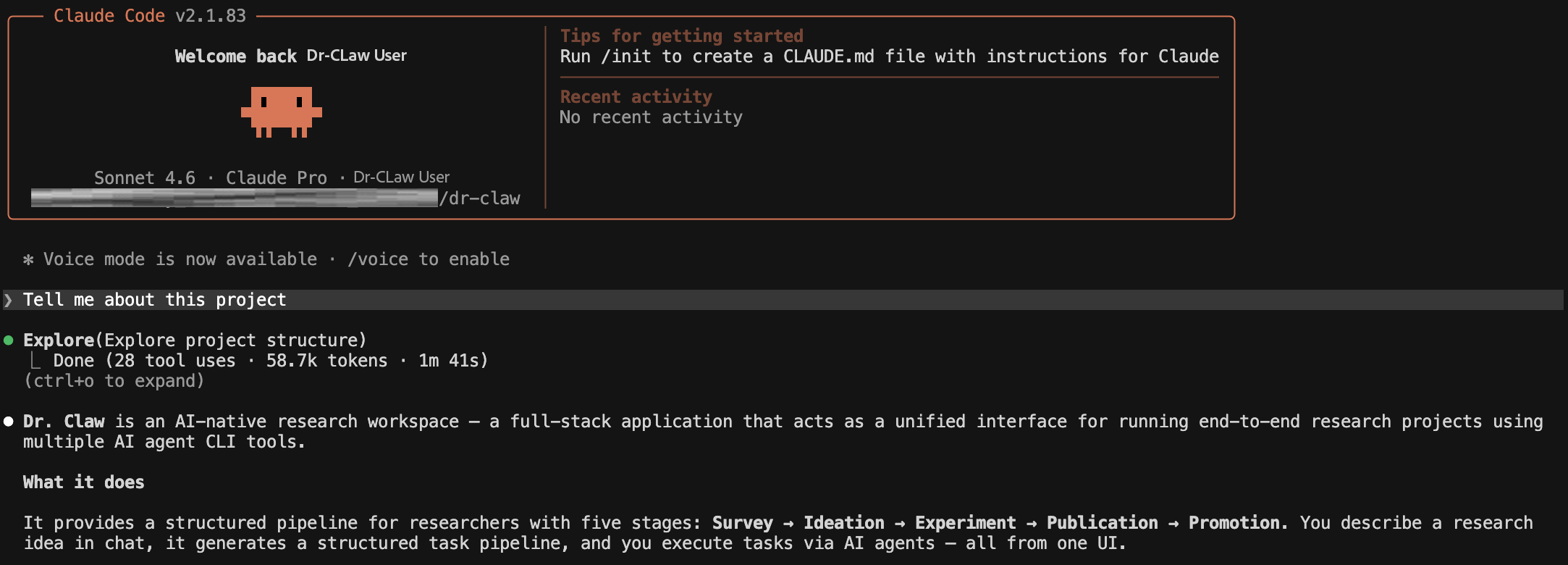

聊天截图

描述您的研究想法——即使是粗略的想法也没关系。代理会使用 inno-pipeline-planner 技能提出澄清问题,然后生成:

.pipeline/docs/research_brief.json(您的结构化研究简报).pipeline/tasks/tasks.json(任务流水线)

步骤 3 — 在研究实验室中查看并执行任务

切换到 研究实验室,查看生成的任务、进度指标和成果。然后执行任务:

任务执行截图

- 从 CLI 选择器 中选择一个 CLI 后端(Claude Code、Gemini CLI 或 Codex)。

- 在 研究实验室 中,点击待处理任务上的 前往聊天 或 在聊天中使用。

- 代理执行任务并将结果写回项目。

可选 — 从项目仪表板运行自动研究

如果您希望 Dr. Claw 为您端到端地执行生成的任务列表,可以使用 自动研究:

- 打开 设置 → 邮件,配置

通知邮箱、发件人邮箱和重发 API 密钥。 - 确保您的项目已包含

.pipeline/docs/research_brief.json和.pipeline/tasks/tasks.json。 - 打开 项目仪表板,并在项目卡片上点击 自动研究。

- 使用 打开会话 跳转到为此次运行创建的实时 Claude 会话。

- 当所有任务完成后,Dr. Claw 会发送一封完成邮件。如果会话中断,过时的运行会自动恢复,以便能够干净地取消,而不会一直卡在“运行中”状态。

步骤 4 — 解决网页搜索问题

如果代理无法搜索网页,很可能是当前的权限设置过于严格。同时请检查进程是否仍处于运行时网络锁定状态。

- 检查运行时网络锁定:

echo "${CODEX_SANDBOX_NETWORK_DISABLED:-0}"

如果输出为 1,即使已开放设置权限,网络请求仍可能被阻止。请在部署或启动层(shell 配置文件、systemd、Docker、PM2)中移除或覆盖此变量,然后重启 Dr. Claw。

- 打开 设置(侧边栏中的齿轮图标)。

- 进入 权限,然后选择您当前的代理:

- Claude Code:

- 在 允许的工具 中启用

WebSearch和WebFetch。 - 确保它们未出现在 阻止的工具 中。

- 如需减少确认次数,可选择 跳过权限提示。

- 在 允许的工具 中启用

- Gemini CLI:

- 选择合适的 权限模式。

- 在需要访问网页时,在 允许的工具 中允许

google_web_search和web_fetch。 - 确保它们未出现在 阻止的工具 中。

- Codex:

- 在 权限模式 中,当需要访问网页时切换到 绕过权限。

- 返回 聊天,开始新消息,并重新尝试您的网页搜索提示。

Codex 权限模式说明:

- 默认 / 接受编辑:沙箱执行;网络仍可能受会话策略限制。

- 绕过权限:

sandboxMode=danger-full-access,具有完全的磁盘和网络访问权限。

安全提示:

- 仅在可信的项目/环境中使用宽松设置。

- 完成网页搜索任务后,应切换回更安全的设置。

步骤 5 — 解决“工作空间信任”或首次运行错误

每个代理在您的项目目录中执行代码之前,可能都需要进行一次信任确认。如果 Chat 卡顿或弹出信任提示,请切换到 Dr. Claw 内的 Shell 选项卡,并在那里批准该提示。

步骤:

- 切换到 Dr. Claw 的 Shell 选项卡。

- 在 Shell 中批准显示的信任/身份验证提示。

- 返回 Chat 并重新发送您的消息。

默认情况下,Dr. Claw 已启用信任流程,因此您通常无需手动运行额外的信任命令。

信任决策会按目录持久化——每个项目只需执行一次即可。

Shell 选项卡无法使用? 如果 Shell 选项卡显示“错误:posix_spawnp 失败”,请参阅 docs/faq.md 获取修复方法,然后重试。

您可以随时切换选项卡:

| 选项卡 | 功能 |

|---|---|

| Chat | 从这里开始。用于描述您的研究想法、生成流水线并使用选定的代理运行任务。 |

| Survey | 查看当前项目的论文、文献图谱、笔记以及调研阶段的任务。 |

| Research Lab | 在一处查看研究简报、任务列表、进展及生成的成果。 |

| Skills | 浏览已安装的技能、检查其内容并导入额外的本地技能。 |

| Compute | 在一处管理计算资源并运行实验工作负载。 |

| Shell | 当需要直接访问 CLI、处理信任提示或执行手动命令时,使用内置终端。 |

| Files | 浏览、打开、创建、重命名并编辑项目文件,支持语法高亮。 |

| Git | 在不离开应用的情况下查看差异、暂存更改、提交并切换分支。 |

研究技能

Dr. Claw 现在将生成的 流水线任务列表 作为执行流程。

该项目在 skills/ 目录下包含 100 多项技能,以支持研究任务(想法探索、代码调研、实验开发/分析、写作、评审与交付)。

这些技能由代理发现,并可在整个工作流中作为任务级辅助加以应用。

其他详细信息

移动端、架构与安全注意事项

移动端与平板

Dr. Claw 完全响应式设计。在移动设备上:

- 底部标签栏,便于用拇指操作导航

- 滑动手势和触控优化的控件

- 添加到主屏幕,可将其用作 PWA(渐进式 Web 应用)

架构

系统概览

┌─────────────────┐ ┌─────────────────┐ ┌─────────────────┐

│ 前端 │ │ 后端 │ │ 代理 │

│ (React/Vite) │◄──►│ (Express/WS) │◄──►│ 集成 │

│ │ │ │ │ │

└─────────────────┘ └─────────────────┘ └─────────────────┘

后端(Node.js + Express)

- Express 服务器 - 提供 RESTful API 并支持静态文件服务

- WebSocket 服务器 - 用于聊天和项目刷新的通信

- 代理集成(Claude Code、Gemini CLI、Codex、OpenRouter) - 进程启动、流式传输及会话管理

- 文件系统 API - 暴露项目文件浏览器

前端(React + Vite)

- React 18 - 使用 Hooks 的现代组件架构

- CodeMirror - 支持语法高亮的高级代码编辑器

安全与工具配置

🔒 重要提示:代理权限可根据不同提供商进行配置。在启用广泛的文件、Shell 或 Web 访问权限之前,请先查看 设置 → 权限。

启用工具

为安全地使用 Web 和工具密集型工作流:

- 打开设置 - 点击侧边栏中的齿轮图标

- 选择代理 - Claude Code、Gemini CLI 或 Codex

- 有选择地启用 - 仅开启您所需的工具或权限模式

- 应用设置 - 您的偏好将被本地保存

推荐做法:先从最安全的权限模式入手,确保能够完成任务,随后再根据需要逐步放宽设置。

贡献

显示详情

我们欢迎贡献!请遵循以下指南:

入门

- Fork 仓库

- Clone 您的 Fork:

git clone <your-fork-url> - 安装 依赖:

npm install - 创建 功能分支:

git checkout -b feature/amazing-feature

开发流程

- 进行修改,遵循现有代码风格

- 全面测试 - 确保所有功能正常运行

- 运行质量检查:

npm run typecheck && npm run build - 提交,使用符合 Conventional Commits 规范的描述性提交信息

- 推送 至您的分支:

git push origin feature/amazing-feature - 提交 Pull Request,需包含:

- 清晰的变更说明

- UI 变更的截图

- 如适用,测试结果

可贡献的内容

- Bug 修复 - 帮助我们提升稳定性

- 新功能 - 增强功能(请先在 Issue 中讨论)

- 文档 - 改善指南和 API 文档

- UI/UX 改进 - 提升用户体验

- 性能优化 - 让它运行得更快

如需设置帮助与故障排除,请参阅 FAQ。

兼容性与弃用

Dr. Claw 曾名为 VibeLab。对于从 VibeLab 迁移的用户,我们在过渡阶段提供兼容层:

- CLI 别名:

vibelab命令仍作为drclaw的别名被支持,但会发出弃用警告。 - Python 包:

agent-harness中的VibeLab类已被弃用,请改用DrClaw类。 - 会话文件:CLI 现已默认使用

~/.drclaw_session.json,但如果检测到~/.vibelab_session.json,则会自动检查并迁移。 - 环境变量:优先使用

DRCLAW_URL和DRCLAW_TOKEN,但VIBELAB_URL和VIBELAB_TOKEN仍作为备用方案被支持。

时间表:我们计划在 Version 2.0(预计 2026 年第三季度)中移除对旧版 vibelab 的支持。请尽快更新您的脚本和集成。

许可证

本仓库包含合并作品。

源自 Claude Code UI 的上游部分仍受 GNU 通用公共许可证 v3.0(GPL-3.0)约束,而 Dr. Claw 贡献者所做的原始修改与新增内容则依据 GNU Affero 通用公共许可证 v3.0(AGPL-3.0)授权。

完整许可文本及适用范围详情,请参阅 LICENSE 和 NOTICE。

引用

如果您在研究中发现 Dr. Claw 有用,请引用:

@misc{song2026drclaw,

author = {Dingjie Song and Hanrong Zhang and Dawei Liu and Yixin Liu and Zongxia Li and Zhengqing Yuan and Siqi Zhang and Lichao Sun},

title = {Dr. Claw:从创意到论文的人工智能研究工作空间},

year = {2026},

organization = {GitHub},

url = {https://github.com/OpenLAIR/dr-claw},

homepage = {https://openlair.github.io/dr-claw},

}

致谢

感谢构建

- Claude Code — Anthropic 官方 CLI

- Gemini CLI — Google 的 Gemini 命令行代理

- Codex — OpenAI Codex

- React — 用户界面库

- Vite — 高速构建工具与开发服务器

- Tailwind CSS — 以实用优先的 CSS 框架

- CodeMirror — 高级代码编辑器

同时感谢

- Claude Code UI — Dr. Claw 以此为基础。详情请参阅 NOTICE。

- AI Researcher (HKUDS) — 研究工作流与代理式研究的灵感来源。

- Vibe-Scholar — AI 原生研究工作空间方向的灵感来源。

- autoresearch — 自主研究编排与端到端执行的灵感来源。

支持与社区

关注最新动态

- 为本仓库加星标以示支持

- 关注更新与新版本发布

- 关注项目公告以获取最新消息

版本历史

v1.1.22026/04/05v1.1.12026/03/30v1.1.02026/03/27v1.0.02026/03/17v0.1.52026/03/09v2026.3.42026/03/04常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。