Book-Mathematical-Foundation-of-Reinforcement-Learning

《强化学习的数学基础》是一本专为希望深入理解强化学习核心原理的读者打造的新书。它不只罗列算法步骤,更致力于从数学视角解释“为什么这样设计”以及“为何有效”,帮助读者透过现象看本质。

针对现有资料往往重应用轻推导、或数学门槛过高导致难以入门的痛点,本书精心控制了数学深度,采用循序渐进的结构,将复杂的算法核心思想与干扰细节剥离。全书基于直观的网格世界任务展开大量实例演示,并创新性地使用灰色框标记可选读的深层数学内容,让不同背景的读者都能按需阅读,兼顾了严谨性与易读性。

这本书非常适合高年级本科生、研究生、科研人员及从业者使用。即使你没有强化学习背景,只要具备概率论和线性代数基础,就能顺利上手;而对于已有经验的开发者,它也能提供全新的理论视角以深化认知。此外,作者还配套了浏览量超 200 万的中英文讲座视频,结合书本学习能获得更佳效果。作为西湖大学赵世钰教授多年教学讲义的结晶,它是通往强化学习理论殿堂的一座友好桥梁。

使用场景

某高校研究生在准备强化学习课题时,试图深入理解算法背后的数学原理,却因现有资料过于碎片化或晦涩难懂而陷入瓶颈。

没有 Book-Mathematical-Foundation-of-Reinforcement-Learning 时

- 只能零散地阅读各类论文和博客,知其然不知其所以然,无法理解算法设计的原始动机。

- 面对复杂的数学推导往往望而生畏,缺乏循序渐进的引导,难以把握公式背后的直观含义。

- 缺少统一的示例环境(如网格世界),在不同算法间切换时难以建立连贯的知识体系。

- 自学过程中容易迷失方向,无法区分核心思想与干扰性的技术细节,导致学习效率低下。

使用 Book-Mathematical-Foundation-of-Reinforcement-Learning 后

- 通过书中“数学友好”的讲解,不仅掌握了算法流程,更深刻理解了其设计初衷及有效性证明。

- 借助精心控制的数学深度和可选读的灰色框内容,能够根据自身基础灵活调整学习节奏,轻松攻克难点。

- 全书基于统一的网格世界任务展开 illustrative examples,使抽象概念具象化,快速建立起算法间的逻辑联系。

- 书籍将核心思想与复杂细节剥离,帮助学习者直击本质,配合章节间严密的逻辑递进,构建了完整的知识大厦。

Book-Mathematical-Foundation-of-Reinforcement-Learning 成功架起了从基础数学理论到强化学习核心算法的桥梁,让深度学习不再是黑盒探索。

运行环境要求

未说明

未说明

快速开始

关于我的幻灯片的 LaTeX 源代码

如果您是教授,正在准备课程,并希望使用我幻灯片中的任何内容,请随时通过电子邮件与我联系。我可以将源代码分享给您。这些幻灯片是使用 LaTeX/Beamer 制作的。

关于读者反馈和讨论区的问题,请注意,由于我事务繁忙,回复可能会有较大延迟。感谢您的理解。

为什么需要一本新的强化学习书籍?

本书旨在为强化学习的基本概念、基础问题和经典算法提供一种既具有数学性又易于理解的介绍。本书的一些重要特点如下:

本书从数学的角度介绍强化学习。希望通过阅读本书,读者不仅能了解算法的具体步骤,还能理解其设计初衷以及为何能够有效工作。

数学深度被精心控制在适当的水平,并且以经过仔细设计的方式呈现,确保全书易于阅读。读者可以根据自己的兴趣选择性地阅读灰色背景框中的内容。

书中提供了大量示例,帮助读者更好地理解相关主题。所有示例均基于网格世界任务,这一任务简单易懂,有助于阐释概念和算法。

在介绍算法时,本书力求将核心思想与可能分散注意力的复杂细节区分开来,从而使读者更容易抓住算法的核心要点。

全书内容组织连贯,每一章都建立在前一章的基础上,并为后续章节奠定必要的基础。

目录

本书涵盖的主题如图所示。全书共十章,可分为两大部分:第一部分介绍基础工具,第二部分则聚焦于算法。这十章内容紧密相关,通常建议先学习前面的章节,再继续后面的章节。

读者对象

本书适合对强化学习感兴趣的高年级本科生、研究生、研究人员及从业者。本书无需读者具备强化学习的基础知识,因为会从最基础的概念开始讲解。如果读者已经有一定的强化学习背景,相信本书也能帮助他们更深入地理解某些主题,或提供不同的视角。

不过,本书要求读者具备一定的概率论和线性代数知识。书中附录也简要介绍了所需的数学基础知识。

关于作者

您可以在我的个人主页 https://www.shiyuzhao.net(GoogleSite)以及我的研究组网站 https://shiyuzhao.westlake.edu.cn 上找到我的相关信息。

自2019年起,我一直教授一门研究生级别的强化学习课程。在教学的同时,我也一直在编写这本书,作为学生的课堂讲义。

我衷心希望本书能帮助读者顺利进入激动人心的强化学习领域。

引用格式

@book{zhao2025RLBook,

title={Mathematical Foundations of Reinforcement Learning},

author={S. Zhao},

year={2025},

publisher={Springer Press}

}

讲座视频

这些讲座视频在互联网上已获得210万+次观看,并得到了非常好的反馈!结合本书与我的讲座视频,相信您能更好地学习相关内容。

- 中文讲座视频: 您可以访问 Bilibili 频道 或 YouTube 频道。

- 英文讲座视频: 英文讲座视频已上传至 YouTube:点击此处

- 30分钟掌握强化学习概览

- L1:基本概念(P1—状态、动作、策略等)

- L1:基本概念(P2—奖励、回报、马尔可夫决策过程)

- L2:贝尔曼方程(P1—动机性示例)

- L2:贝尔曼方程(P2—状态价值)

- L2:贝尔曼方程(P3—贝尔曼方程推导)

- L2:贝尔曼方程(P4—矩阵-向量形式及解法)

- L2:贝尔曼方程(P5—动作价值)

- L3:贝尔曼最优性方程(P1—动机性示例)

- L3:贝尔曼最优性方程(P2—最优策略)

- L3:贝尔曼最优性方程(P3—关于BOE的更多内容)

- L3:贝尔曼最优性方程(P4—有趣性质)

- L4:值迭代与策略迭代(P1—值迭代)

- L4:值迭代与策略迭代(P2—策略迭代)

- L4:值迭代与策略迭代(P3—截断策略迭代)

- L5:蒙特卡洛学习(P1—动机性示例)

- L5:蒙特卡洛学习(P2—MC基础介绍)

- L5:蒙特卡洛学习(P3—MC基础示例)

- L5:蒙特卡洛学习(P4—探索式起点)

- L5:蒙特卡洛学习(P5—ε-贪心策略介绍)

- L5:蒙特卡洛学习(P6—ε-贪心策略示例)

- L6:随机逼近与SGD(P1—动机性示例)

- L6:随机逼近与SGD(P2—RM算法介绍)

- L6:随机逼近与SGD(P3—RM算法收敛性)

- L6:随机逼近与SGD(P4—SGD算法介绍)

- L6:随机逼近与SGD(P5—SGD算法示例)

- L6:随机逼近与SGD(P6—SGD算法性质)

- L6:随机逼近与SGD(P7—SGD算法比较)

- L7:时序差分学习(P1—动机性示例)

- L7:时序差分学习(P2—TD算法介绍)

- L7:时序差分学习(P3—TD算法收敛性)

- L7:时序差分学习(P4—Sarsa)

- L7:时序差分学习(P5—期望Sarsa与n步Sarsa)

- L7:时序差分学习(P6—Q-learning介绍)

- L7:时序差分学习(P7—Q-learning伪代码)

- L7:时序差分学习(P8—统一视角与总结)

- L8:值函数近似(P1—动机性示例—曲线拟合)

- L8:值函数近似(P2—目标函数)

- L8:值函数近似(P3—优化算法)

- L8:值函数近似(P4—示例分析)

- L8:值函数近似(P5—Sarsa和Q-learning)

- L8:值函数近似(P6—DQN的基本思想)

- L8:值函数近似(P7—DQN的经验回放)

- L8:值函数近似(P8—DQN的实现与示例)

- L9:策略梯度方法(P1—基本思想)

- L9:策略梯度方法(P2—指标1—平均值)

- L9:策略梯度方法(P3—指标2—平均奖励)

- L9:策略梯度方法(P4—指标的梯度)

- L9:策略梯度方法(P5—基于梯度的算法及REINFORCE)

- L10:演员-评论家方法(P1—最简单的演员-评论家)

- L10:演员-评论家方法(P2—优势演员-评论家)

- L10:演员-评论家方法(P3—重要性采样及离策略演员-评论家)

- L10:演员-评论家方法(P4—确定性演员-评论家)

- L10:演员-评论家方法(P5—总结与告别!)

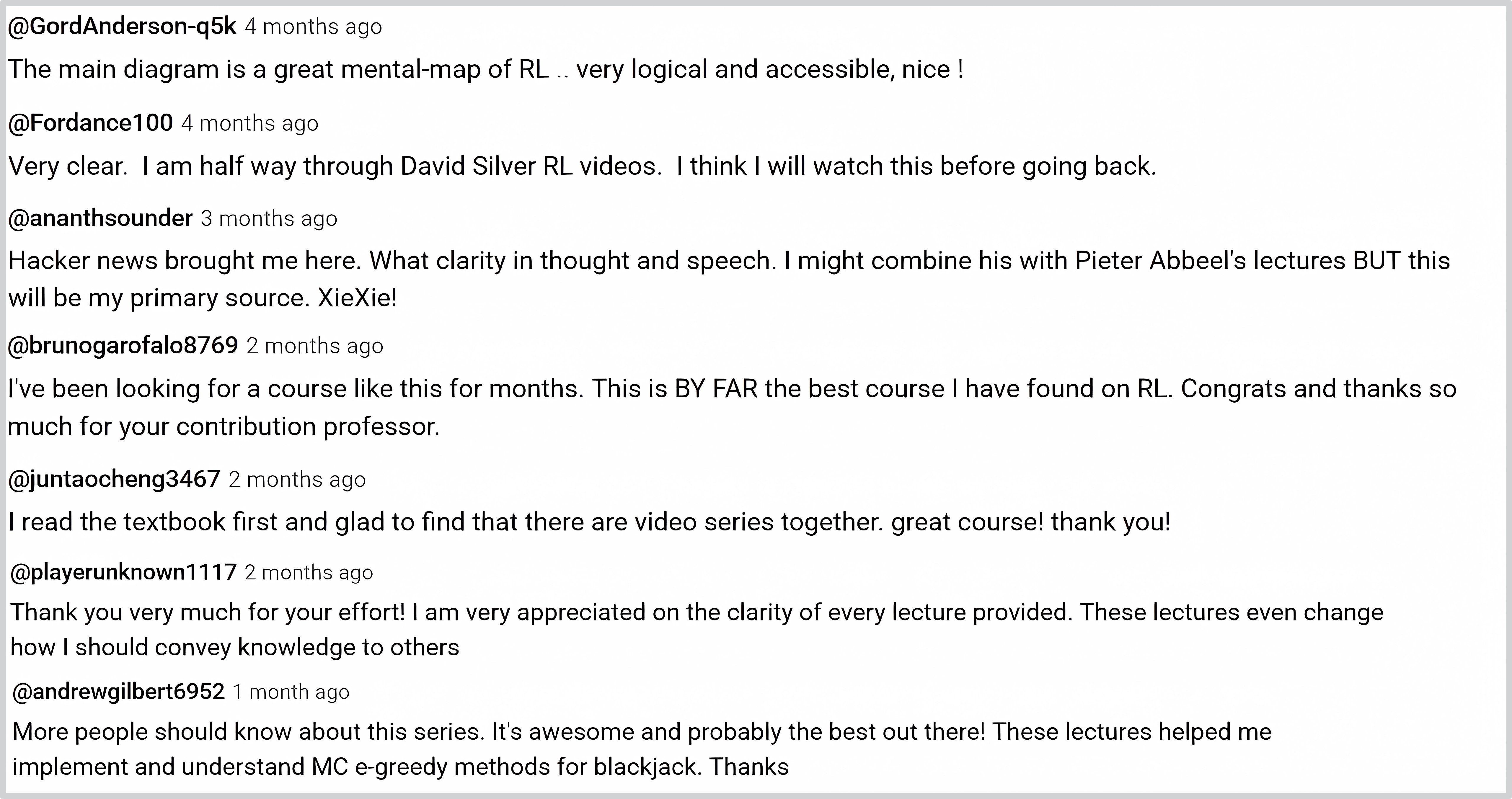

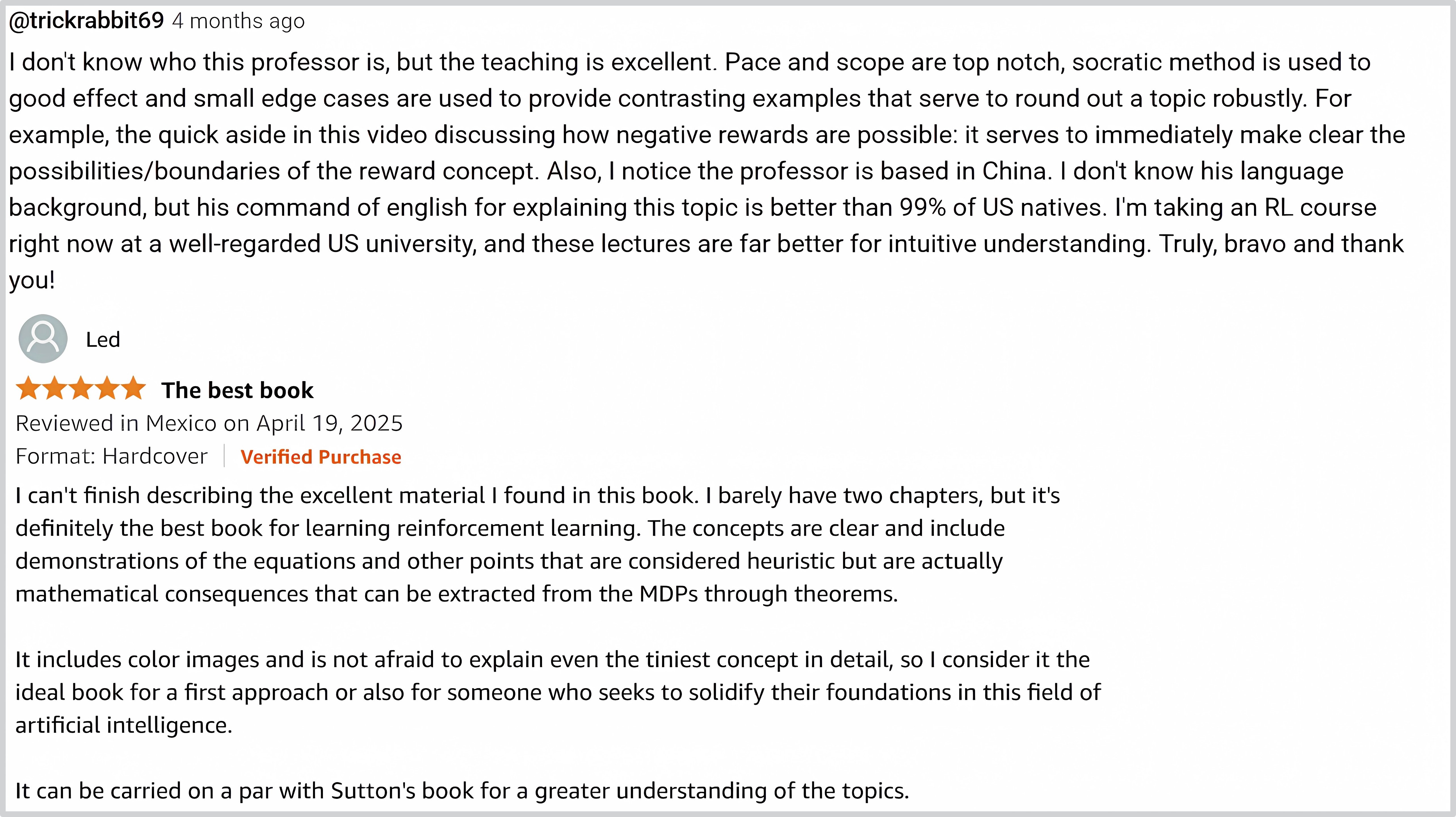

来自YouTube和亚马逊的一些评论:

第三方代码和资料

许多热心的读者向我寄来了他们在学习本书时编写的源代码或笔记。如果你基于本课程创建了任何相关资料,欢迎发邮件给我。我很乐意在此分享这些链接,希望能对其他读者有所帮助。需要强调的是,我对这些代码并未进行验证。如有任何疑问,可以直接联系开发者。

代码

Python:

https://github.com/Ronchy2000/Multi-agent-RL/tree/master/RL_Learning-main(2025年10月,由Lu Rongqi提供)

https://github.com/zhoubay/Code-for-Mathematical-Foundations-of-Reinforcement-Learning(2025年3月,由ZHOU Xibin提供)

https://github.com/SupermanCaozh/The_Coding_Foundation_in_Reinforcement_Learning(由CAO Zehong提供,2024年8月)

https://github.com/ziwenhahaha/Code-of-RL-Beginning,作者RLGamer(2024年3月)

https://github.com/jwk1rose/RL_Learning,作者JI Wenkang(2024年2月)

Matlab:

- https://github.com/EveryDayIsaSong/MATLAB-Code-for-Mathematical-Foundation-of-Reinforcement-Learning(由MAO Yucheng提供,2026年1月)

R:

C++:

学习笔记

英文:

- https://lyk-love.cn/tags/reinforcement-learning/ 由加州大学戴维斯分校的一位研究生整理

中文:

https://github.com/Peanut-Study/Reinforcement-Learning-Study-Note/tree/main(2026年1月)

https://blog.csdn.net/v20000727/article/details/136870879?spm=1001.2014.3001.5502

此外,互联网上还有许多其他读者整理的学习笔记,我无法一一列出。如果你发现好的资料,欢迎推荐给我。

基于我课程制作的哔哩哔哩视频

更新历史

(2025年7月) 小幅更新:修正错别字

距离本书上次更新已近一年。在此期间,细心的读者又发现了约10处错别字,并及时告知了我。对此我深表感谢。为避免后续读者产生困惑,我已经将这些错别字逐一修正,并更新了GitHub上的PDF文件。对于印刷版的Springer出版社版本,我也准备了一份勘误表,如果您阅读的是纸质书,可根据需要查阅该表。

最后,我要衷心感谢各位读者的宝贵贡献。自本书发布以来,我们收到了大量关注与反馈,这使得书中的内容得以迅速完善。虽然我认为大部分错别字现已得到修正,但若您仍发现任何需要更正之处,请随时与我联系。

(2025年6月) 1万+ 颗星!

(2024年12月) 4000+ 颗星 -> (2025年2月) 5000+ 颗星 -> (2025年3月) 7000+ 颗星! -> (2025年4月) 8000+ 颗星! -> (2025年5月) 9000+ 颗星!

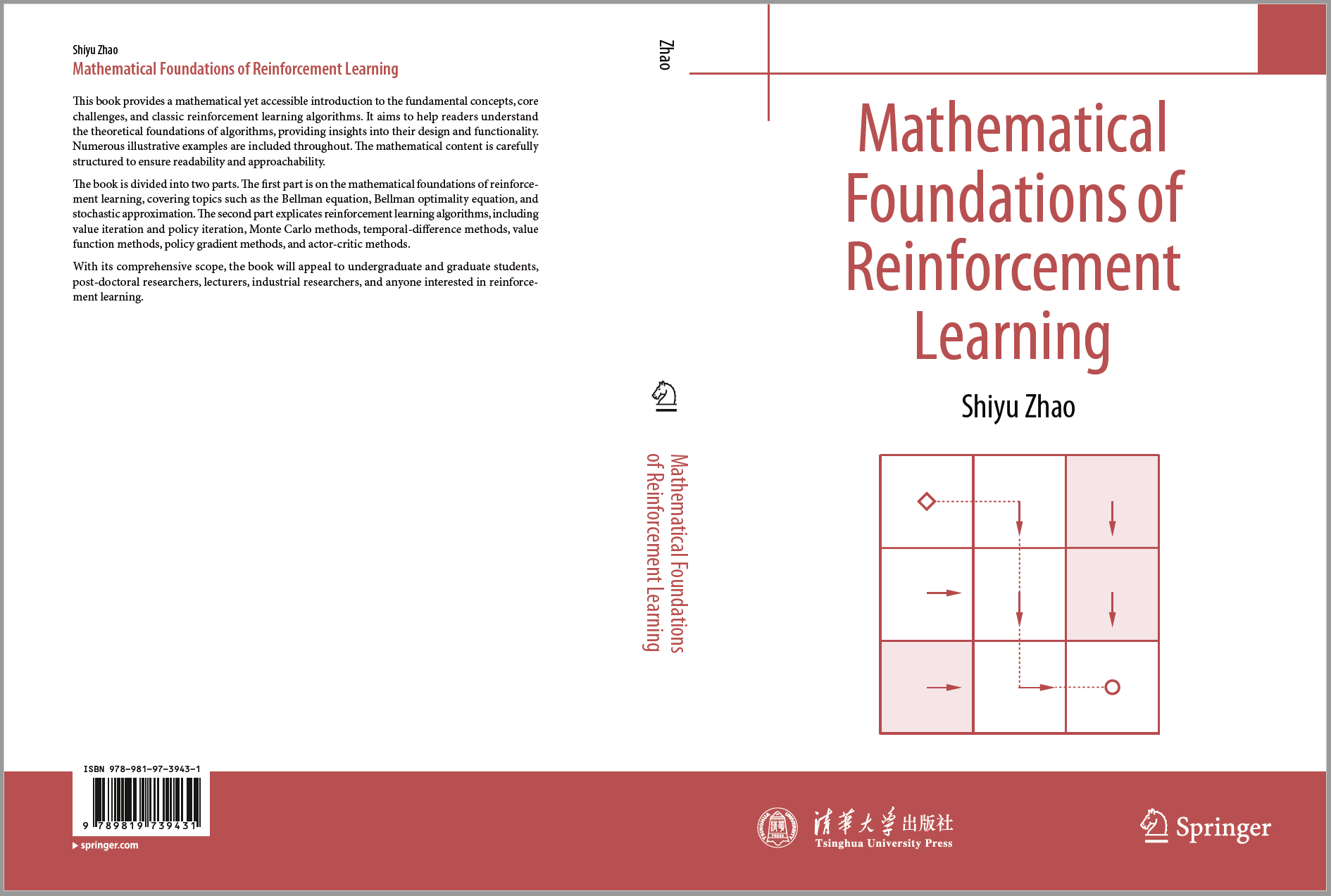

(2024年10月) 书籍封面

书籍封面设计已完成。本书将于明年年初由Springer正式出版,此前已由清华大学出版社出版过。

(2024年9月) Springer印刷前的小幅更新

我对一些读者几乎难以察觉的细微之处进行了修订。这应是Springer印刷前的最终版本。

(2024年8月) 3000颗星及更多代码

本书目前已获得3000多颗星,这对我来说是一项巨大的成就。感谢所有人的支持,希望本书确实对大家有所帮助。

此外,我还收到了热心读者提供的更多代码实现。例如,这个GitHub页面提供了书中几乎所有示例的Python实现。一方面,看到这种情况让我非常高兴;另一方面,我也有些担心我的线下课程学生可能会直接使用这些代码完成作业:-)。总的来说,我很欣慰,因为这表明本书和公开课程确实对读者有帮助;否则,他们不会费心自己编写代码:-)

(2024年6月) 印刷前的小幅更新

这是本书的第四稿,预计将是正式出版前的最后一版。具体来说,在校对书稿时,我发现了一些非常细微的问题,加上热心读者反馈的一些问题,都在这一版中得到了修正。

(2024年4月) 格网世界环境的代码

我们在书中添加了格网世界环境的代码。感兴趣的读者可以在这个环境中开发并测试自己的算法。同时提供了Python和MATLAB两种版本。

需要注意的是,我们并未提供书中涉及的所有算法代码。这是因为这些算法本身就是线下教学中的作业,学生们需要利用提供的环境自行开发算法。不过,目前已有第三方实现了部分算法,感兴趣的同学可以查看本书主页上的相关链接。

在此特别感谢我的博士生米一泽和李佳楠,他们同时也是我线下课程的助教,为代码的编写做出了重要贡献。

如果您在使用代码时发现任何问题或错误,欢迎随时向我们反馈。

(2024年3月) 2000颗星

本书目前已获得2000颗星。我也收到了许多读者对本书的积极评价。很高兴这本书能够对大家有所帮助。

(2024年3月) 小幅更新

本书第三稿现已上线。

与第二稿相比,第三稿主要改进了部分错别字。在此,我要感谢那些向我反馈意见的读者们。

(2023年9月) 1000+ 颗星

本书获得了1000多颗星!感谢大家!

(2023年8月) 大幅更新——第二版

本书第二稿现已上线!!

与一年前发布的第一稿相比,第二稿在多个方面都有所改进。例如,我们重新绘制了大部分图表,对部分内容进行了重新组织以使其更加清晰,修正了一些错别字,并新增了第一版中未包含的第10章。

我在2022年8月首次将本书初稿发布在网上。至今,我已收到来自全球各地读者的宝贵反馈。对此,我深表感激。

(2022年11月) 将联合出版

本书将由Springer Nature和清华大学出版社联合出版。预计将于2023年下半年印刷发行。

我曾收到一些读者对本书的意见和建议。非常感谢大家的支持与厚爱。目前我仍在收集反馈,计划在未来几个月内进一步修改书稿。您的反馈将使本书更好地服务于更多读者!

(2022年10月) 讲义与视频

讲义幻灯片已上传至“讲义幻灯片”文件夹。

中文版讲座视频已上线。请访问我们的Bilibili频道 https://space.bilibili.com/2044042934 或YouTube频道 https://www.youtube.com/channel/UCztGtS5YYiNv8x3pj9hLVgg/playlists。

(2022年8月) 初稿

本书初稿现已上线。

相似工具推荐

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。

awesome-machine-learning

awesome-machine-learning 是一份精心整理的机器学习资源清单,汇集了全球优秀的机器学习框架、库和软件工具。面对机器学习领域技术迭代快、资源分散且难以甄选的痛点,这份清单按编程语言(如 Python、C++、Go 等)和应用场景(如计算机视觉、自然语言处理、深度学习等)进行了系统化分类,帮助使用者快速定位高质量项目。 它特别适合开发者、数据科学家及研究人员使用。无论是初学者寻找入门库,还是资深工程师对比不同语言的技术选型,都能从中获得极具价值的参考。此外,清单还延伸提供了免费书籍、在线课程、行业会议、技术博客及线下聚会等丰富资源,构建了从学习到实践的全链路支持体系。 其独特亮点在于严格的维护标准:明确标记已停止维护或长期未更新的项目,确保推荐内容的时效性与可靠性。作为机器学习领域的“导航图”,awesome-machine-learning 以开源协作的方式持续更新,旨在降低技术探索门槛,让每一位从业者都能高效地站在巨人的肩膀上创新。

scikit-learn

scikit-learn 是一个基于 Python 构建的开源机器学习库,依托于 SciPy、NumPy 等科学计算生态,旨在让机器学习变得简单高效。它提供了一套统一且简洁的接口,涵盖了从数据预处理、特征工程到模型训练、评估及选择的全流程工具,内置了包括线性回归、支持向量机、随机森林、聚类等在内的丰富经典算法。 对于希望快速验证想法或构建原型的数据科学家、研究人员以及 Python 开发者而言,scikit-learn 是不可或缺的基础设施。它有效解决了机器学习入门门槛高、算法实现复杂以及不同模型间调用方式不统一的痛点,让用户无需重复造轮子,只需几行代码即可调用成熟的算法解决分类、回归、聚类等实际问题。 其核心技术亮点在于高度一致的 API 设计风格,所有估算器(Estimator)均遵循相同的调用逻辑,极大地降低了学习成本并提升了代码的可读性与可维护性。此外,它还提供了强大的模型选择与评估工具,如交叉验证和网格搜索,帮助用户系统地优化模型性能。作为一个由全球志愿者共同维护的成熟项目,scikit-learn 以其稳定性、详尽的文档和活跃的社区支持,成为连接理论学习与工业级应用的最

keras

Keras 是一个专为人类设计的深度学习框架,旨在让构建和训练神经网络变得简单直观。它解决了开发者在不同深度学习后端之间切换困难、模型开发效率低以及难以兼顾调试便捷性与运行性能的痛点。 无论是刚入门的学生、专注算法的研究人员,还是需要快速落地产品的工程师,都能通过 Keras 轻松上手。它支持计算机视觉、自然语言处理、音频分析及时间序列预测等多种任务。 Keras 3 的核心亮点在于其独特的“多后端”架构。用户只需编写一套代码,即可灵活选择 TensorFlow、JAX、PyTorch 或 OpenVINO 作为底层运行引擎。这一特性不仅保留了 Keras 一贯的高层易用性,还允许开发者根据需求自由选择:利用 JAX 或 PyTorch 的即时执行模式进行高效调试,或切换至速度最快的后端以获得最高 350% 的性能提升。此外,Keras 具备强大的扩展能力,能无缝从本地笔记本电脑扩展至大规模 GPU 或 TPU 集群,是连接原型开发与生产部署的理想桥梁。