LTX-Desktop

LTX-Desktop 是一款开源桌面应用,旨在让用户直接在本地电脑上利用 LTX 模型生成高质量视频。它有效解决了视频创作中对隐私保护、离线运行以及降低云端依赖的需求,同时为硬件受限的用户提供了灵活的云端 API 备选方案。

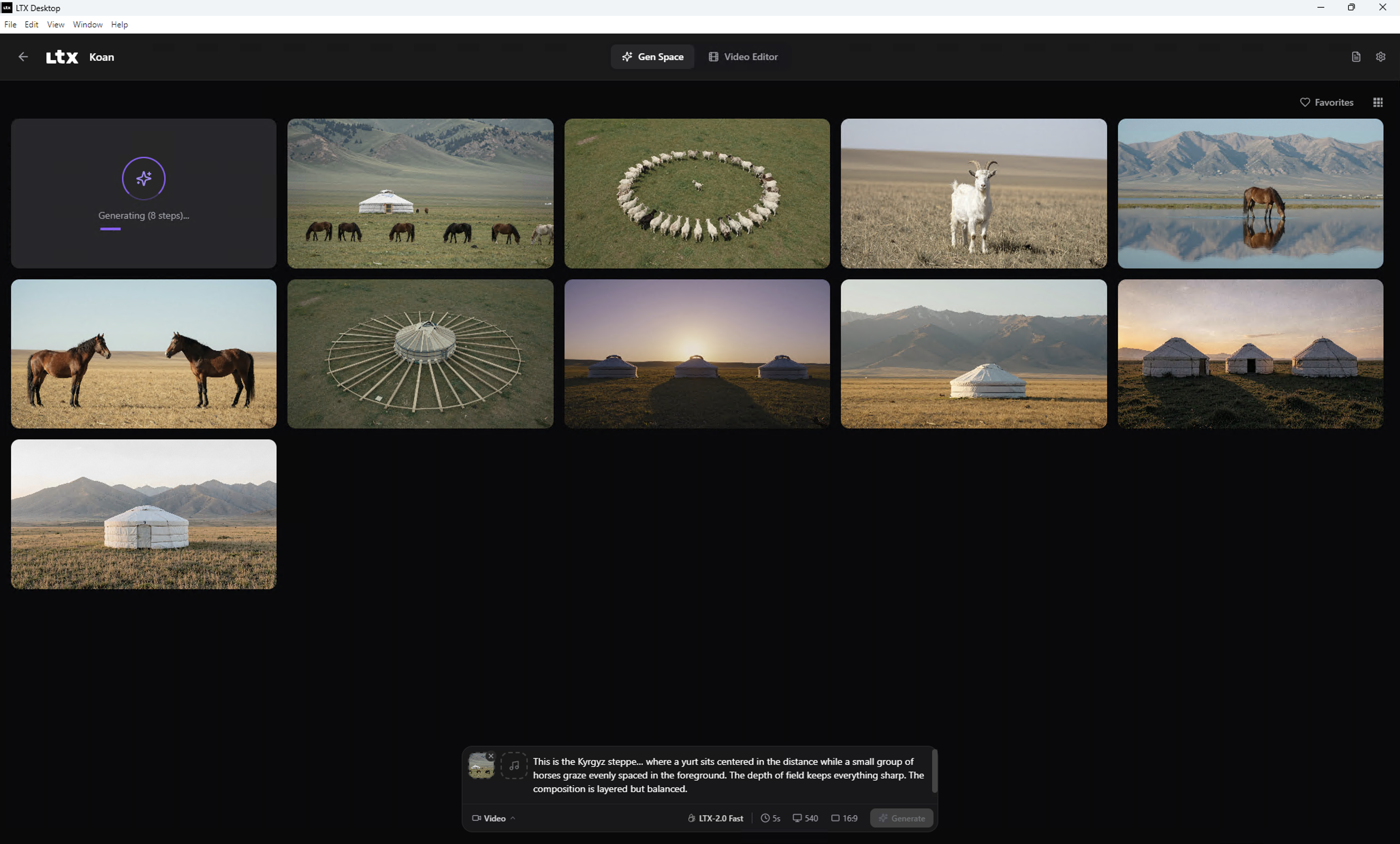

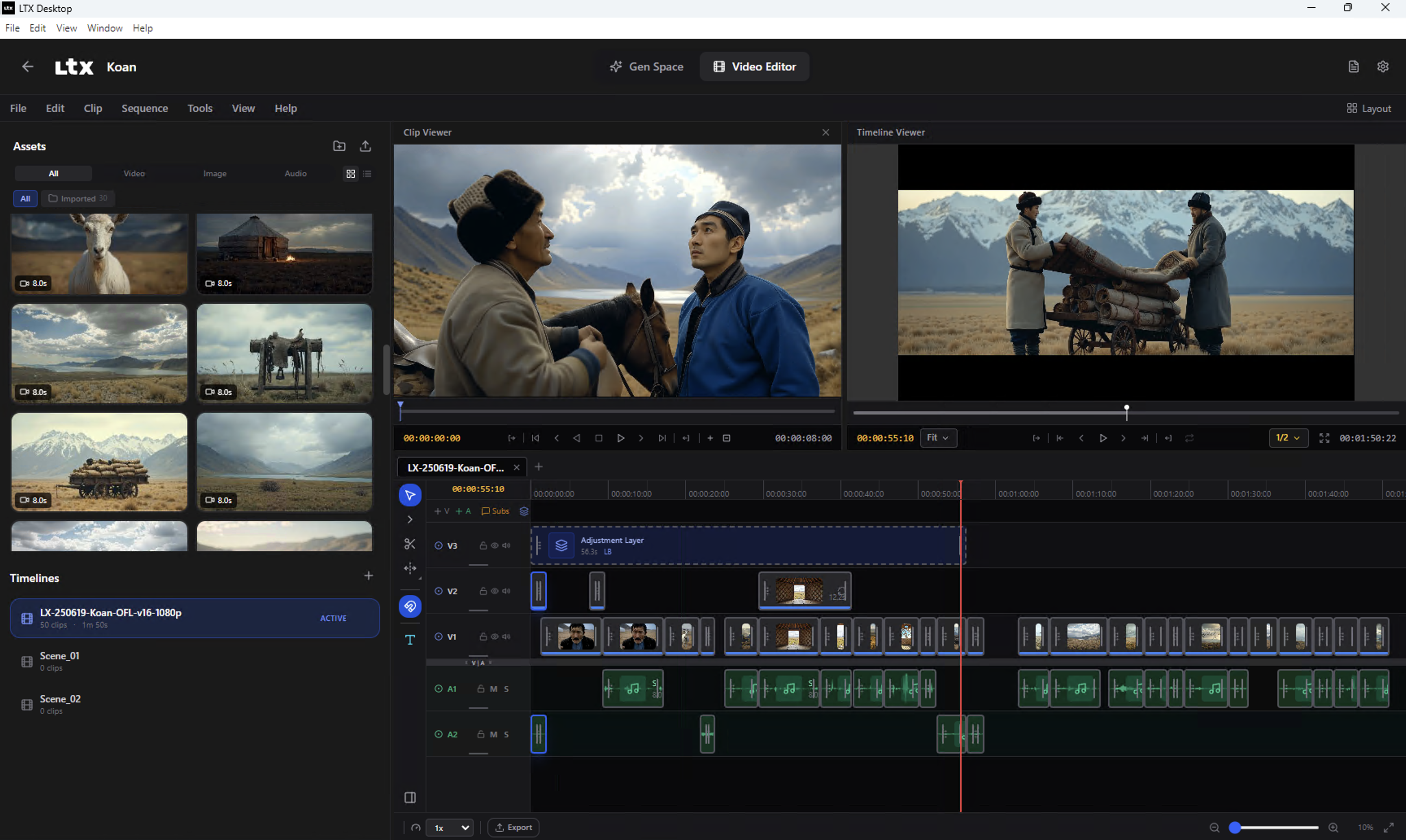

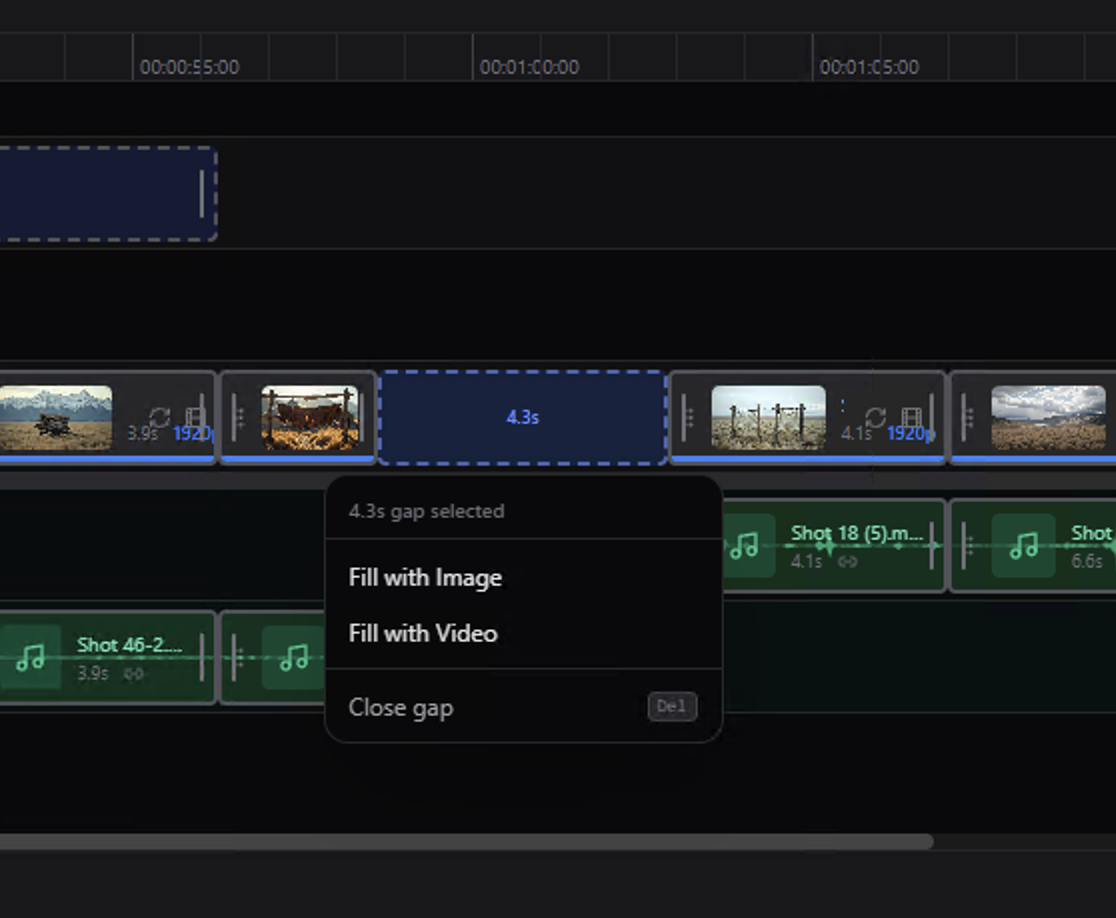

这款软件非常适合视频设计师、内容创作者以及希望探索本地 AI 视频生成的技术爱好者使用。其核心亮点在于“混合运行模式”:在配备 16GB 以上显存的 NVIDIA 显卡(Windows/Linux)上,它能完全本地化运行,下载模型权重后无需联网即可创作;而对于 macOS 用户或显存不足的设备,则可通过 API 模式调用云端算力。此外,LTX-Desktop 不仅支持文生视频、图生视频和音频驱动视频,还内置了直观的时间轴编辑器,允许用户对生成结果进行二次编辑和片段重绘(Retake)。值得一提的是,其文本编码功能可免费通过云端 API 加速,既节省了本地内存资源,又提升了推理速度,让复杂的视频工作流变得更加流畅可控。

使用场景

一位独立游戏开发者需要为即将上线的科幻短片快速生成高质量的过场动画,但受限于本地硬件条件和复杂的技术栈。

没有 LTX-Desktop 时

- 硬件门槛极高:由于使用的是 macOS 或显存不足 16GB 的 Windows 电脑,完全无法在本地运行大模型,只能依赖昂贵的云端算力或放弃尝试。

- 工作流割裂严重:需要在命令行工具、Python 脚本和后期软件之间反复切换,缺乏统一的界面来管理从“文生视频”到“视频重绘(Retake)”的全流程。

- 调试成本高昂:每次调整提示词或参数都需要重新配置环境并等待漫长的加载过程,难以进行快速的创意迭代。

- 资源管理混乱:模型权重、中间文件和最终输出散落在不同目录,缺乏可视化的时间轴编辑器来直观地填补片段间隙或整理项目。

使用 LTX-Desktop 后

- 跨平台无缝接入:利用其 API 模式,开发者无需升级硬件即可在 Mac 或低配电脑上直接调用 LTX 模型,仅需一个免费 API Key 即可开启文本编码加速。

- 一体化创作界面:内置的视频编辑器界面将生成、重绘和时间轴编辑整合在同一窗口,支持直观的“间隙填充”功能,让创作像剪辑一样流畅。

- 即时反馈与迭代:通过图形化操作实时调整参数并预览结果,大幅缩短了从创意构思到看到成片的等待时间,显著提升了试错效率。

- 项目化管理:自动归类存储模型与产出文件,支持保存完整的视频编辑项目,让多镜头短片的统筹管理变得井井有条。

LTX-Desktop 通过降低硬件壁垒并提供集成化的编辑工作流,让普通创作者也能在本地轻松实现专业级的 AI 视频生成与精细化控制。

运行环境要求

- Windows

- Linux

- macOS

- 本地生成模式必需:NVIDIA GPU (支持 CUDA),显存 ≥16GB (推荐更大)

- API 模式 (macOS 或低配硬件):无需本地 GPU,但需联网

最低 16GB,推荐 32GB+

快速开始

LTX 桌面版

LTX 桌面版是一款开源桌面应用,用于使用 LTX 模型生成视频——在支持的 Windows/Linux NVIDIA 显卡上本地运行,并为不支持的硬件和 macOS 提供 API 模式。

状态:测试版。 可能会有破坏性变更。 前端架构正在积极重构中;目前可能会拒绝大型 UI PR(请参阅

CONTRIBUTING.md)。

功能

- 文本到视频生成

- 图像到视频生成

- 音频到视频生成

- 视频编辑生成(重拍)

- 视频编辑界面

- 视频编辑项目

本地模式与 API 模式

| 平台 / 硬件 | 生成模式 | 备注 |

|---|---|---|

| Windows + 具有 ≥16GB VRAM 的 CUDA GPU | 本地生成 | 在本地下载模型权重 |

| Windows(无 CUDA、VRAM 小于 16GB 或 VRAM 不明) | 仅 API | 需要 LTX API 密钥 |

| Linux + 具有 ≥16GB VRAM 的 CUDA GPU | 本地生成 | 在本地下载模型权重 |

| Linux(无 CUDA、VRAM 小于 16GB 或 VRAM 不明) | 仅 API | 需要 LTX API 密钥 |

| macOS(Apple Silicon 构建) | 仅 API | 需要 LTX API 密钥 |

在仅 API 模式下,可用的分辨率/时长可能受限于 API 支持的范围。

系统要求

Windows(本地生成)

- Windows 10/11(x64)

- 支持 CUDA 的 NVIDIA GPU,且具有 ≥16GB VRAM(越大越好)

- 16GB 以上内存(推荐 32GB)

- 160GB 以上可用磁盘空间(用于模型权重、Python 环境和输出文件)

Linux(本地生成)

- Ubuntu 22.04+ 或类似发行版(x64 或 arm64)

- 支持 CUDA 的 NVIDIA GPU,且具有 ≥16GB VRAM(越大越好)

- 已安装 NVIDIA 驱动程序(PyTorch 自带 CUDA 运行时)

- 16GB 以上内存(推荐 32GB)

- 足够的可用磁盘空间用于存储模型权重和输出文件

macOS(仅 API)

- Apple Silicon(arm64)

- macOS 13+(Ventura)

- 稳定的互联网连接

安装

- 从 GitHub Releases 下载最新安装程序:Releases

- 安装并启动 LTX 桌面版

- 完成首次运行设置

首次运行与数据位置

LTX 桌面版将应用数据(设置、模型、日志)存储在以下路径:

- Windows:

%LOCALAPPDATA%\LTXDesktop\ - macOS:

~/Library/Application Support/LTXDesktop/ - Linux:

$XDG_DATA_HOME/LTXDesktop/(默认:~/.local/share/LTXDesktop/)

模型权重会下载到 models/ 子文件夹中(该文件夹可能较大,下载时间较长)。

首次启动时,系统可能会提示您查看并接受模型许可条款(许可文本从 Hugging Face 获取;需要联网)。

文本编码:要生成视频,您必须配置文本编码:

- LTX API 密钥(云端文本编码)——通过 API 进行文本编码是完全免费的,且强烈推荐,以加快推理速度并节省内存。您可以在 LTX 控制台 生成一个免费的 API 密钥。了解更多。

- 本地文本编码器(额外下载;可在支持的 Windows 硬件上实现完全本地化操作)——如果您不想生成 API 密钥,也可以通过设置菜单进行本地文本编码。

API 密钥、费用与隐私

LTX API 密钥

LTX API 用于:

- 云端文本编码和提示增强——免费;强烈建议使用文本编码以加快推理速度并节省内存。

- 基于 API 的视频生成(在 macOS 和不支持的 Windows 硬件上必需)——收费。

- 重拍——收费。

在仅 API 模式下需要 LTX API 密钥,但在 Windows/Linux 本地模式下,如果您启用本地文本编码器,则可选。

您可以在 LTX 控制台 生成一个免费的 API 密钥。文本编码是免费的;视频生成的 API 使用则需付费。了解更多。

当您使用基于 API 的功能时,提示和媒体输入会被发送到 API 服务。您的 API 密钥会本地存储在您的应用数据文件夹中——请将其视为机密信息。

fal API 密钥(可选)

用于在 API 模式下进行 Z Image Turbo 文本到图像生成。启用后,图像生成请求会被发送到 fal.ai。

您可以在 fal 仪表板 创建 API 密钥。

Gemini API 密钥(可选)

用于 AI 提示建议。启用后,提示上下文和帧可能会被发送到 Google Gemini。

架构

LTX 桌面版分为三个主要层:

- 渲染器(

frontend/): TypeScript + React 界面。- 通过 HTTP 调用本地后端,地址为

http://localhost:8000。 - 通过预加载桥接(

window.electronAPI)与 Electron 通信。

- 通过 HTTP 调用本地后端,地址为

- Electron(

electron/): TypeScript 主进程 + 预加载脚本。- 负责应用生命周期和操作系统集成(文件对话框、通过 ffmpeg 进行原生导出、启动和管理 Python 后端)。

- 安全性:渲染器被沙箱化(

contextIsolation: true,nodeIntegration: false)。

- 后端(

backend/): Python + FastAPI 本地服务器。- 协调生成、模型下载和 GPU 执行。

- 仅在使用基于 API 的功能时才会调用外部 API。

graph TD

UI["渲染器 (React + TS)"] -->|HTTP: localhost:8000| BE["后端 (FastAPI + Python)"]

UI -->|IPC via preload: window.electronAPI| EL["Electron 主进程 (TS)"]

EL --> OS["操作系统集成 (文件、对话框、ffmpeg、进程管理)"]

BE --> GPU["本地模型 + GPU(支持时)"]

BE --> EXT["外部 API(仅用于基于 API 的功能)"]

EL --> DATA["应用数据文件夹(设置/模型/日志)"]

BE --> DATA

开发(快速入门)

先决条件:

- Node.js

uv(Python 包管理器)- Python 3.12+

- Git

设置:

pnpm setup:dev

运行:

pnpm dev

调试:

pnpm dev:debug

dev:debug 会启用检查器启动 Electron,并使用 debugpy 启动 Python 后端。

类型检查:

pnpm typecheck

后端测试:

pnpm backend:test

构建安装程序:

- 请参阅

INSTALLER.md

遥测

LTX 桌面版会收集最少的匿名使用分析数据(应用版本、平台和随机安装 ID),以帮助确定开发优先级。不会收集任何个人信息或生成内容。遥测默认开启,可在 设置 > 常规 > 匿名遥测 中关闭。详情请参阅 TELEMETRY.md。

文档

INSTALLER.md— 构建安装程序TELEMETRY.md— 遥测与隐私backend/architecture.md— 后端架构

贡献

请参阅 CONTRIBUTING.md。

许可证

Apache-2.0 — 请参阅 LICENSE.txt。

第三方通知(包括模型许可/条款):NOTICES.md。

模型权重是单独下载的,可能受其他许可/条款的约束。

版本历史

v1.0.42026/04/03v1.0.32026/04/02v1.0.22026/03/12v1.0.12026/03/05v1.0.02026/03/05常见问题

相似工具推荐

Deep-Live-Cam

Deep-Live-Cam 是一款专注于实时换脸与视频生成的开源工具,用户仅需一张静态照片,即可通过“一键操作”实现摄像头画面的即时变脸或制作深度伪造视频。它有效解决了传统换脸技术流程繁琐、对硬件配置要求极高以及难以实时预览的痛点,让高质量的数字内容创作变得触手可及。 这款工具不仅适合开发者和技术研究人员探索算法边界,更因其极简的操作逻辑(仅需三步:选脸、选摄像头、启动),广泛适用于普通用户、内容创作者、设计师及直播主播。无论是为了动画角色定制、服装展示模特替换,还是制作趣味短视频和直播互动,Deep-Live-Cam 都能提供流畅的支持。 其核心技术亮点在于强大的实时处理能力,支持口型遮罩(Mouth Mask)以保留使用者原始的嘴部动作,确保表情自然精准;同时具备“人脸映射”功能,可同时对画面中的多个主体应用不同面孔。此外,项目内置了严格的内容安全过滤机制,自动拦截涉及裸露、暴力等不当素材,并倡导用户在获得授权及明确标注的前提下合规使用,体现了技术发展与伦理责任的平衡。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

MoneyPrinterTurbo

MoneyPrinterTurbo 是一款利用 AI 大模型技术,帮助用户一键生成高清短视频的开源工具。只需输入一个视频主题或关键词,它就能全自动完成从文案创作、素材匹配、字幕合成到背景音乐搭配的全过程,最终输出完整的竖屏或横屏短视频。 这款工具主要解决了传统视频制作流程繁琐、门槛高以及素材版权复杂等痛点。无论是需要快速产出内容的自媒体创作者,还是希望尝试视频生成的普通用户,无需具备专业的剪辑技能或昂贵的硬件配置(普通电脑即可运行),都能轻松上手。同时,其清晰的 MVC 架构和对多种主流大模型(如 DeepSeek、Moonshot、通义千问等)的广泛支持,也使其成为开发者进行二次开发或技术研究的理想底座。 MoneyPrinterTurbo 的独特亮点在于其高度的灵活性与本地化友好性。它不仅支持中英文双语及多种语音合成,允许用户精细调整字幕样式和画面比例,还特别优化了国内网络环境下的模型接入方案,让用户无需依赖 VPN 即可使用高性能国产大模型。此外,工具提供批量生成模式,可一次性产出多个版本供用户择优,极大地提升了内容创作的效率与质量。

oh-my-openagent

oh-my-openagent(简称 omo)是一款强大的开源智能体编排框架,前身名为 oh-my-opencode。它致力于打破单一模型供应商的生态壁垒,解决开发者在构建 AI 应用时面临的“厂商锁定”难题。不同于仅依赖特定模型的封闭方案,omo 倡导开放市场理念,支持灵活调度多种主流大模型:利用 Claude、Kimi 或 GLM 进行任务编排,调用 GPT 处理复杂推理,借助 Minimax 提升响应速度,或发挥 Gemini 的创意优势。 这款工具特别适合希望摆脱平台限制、追求极致性能与成本平衡的开发者及研究人员使用。通过统一接口,用户可以轻松组合不同模型的长处,构建更高效、更具适应性的智能体系统。其独特的技术亮点在于“全模型兼容”架构,让用户不再受制于某一家公司的策略变动或定价调整,真正实现对前沿模型资源的自由驾驭。无论是构建自动化编码助手,还是开发多步骤任务处理流程,oh-my-openagent 都能提供灵活且稳健的基础设施支持,助力用户在快速演进的 AI 生态中保持技术主动权。

tabby

Tabby 是一款可私有化部署的开源 AI 编程助手,旨在为开发团队提供 GitHub Copilot 的安全替代方案。它核心解决了代码辅助过程中的数据隐私顾虑与云端依赖问题,让企业能够在完全掌控数据的前提下享受智能代码补全、聊天问答及上下文理解带来的效率提升。 这款工具特别适合注重代码安全的企业开发团队、希望本地化运行大模型的科研机构,以及拥有消费级显卡的个人开发者。Tabby 的最大亮点在于其“开箱即用”的自包含架构,无需配置复杂的数据库或依赖云服务即可快速启动。同时,它对硬件十分友好,支持在普通的消费级 GPU 上流畅运行,大幅降低了部署门槛。此外,Tabby 提供了标准的 OpenAPI 接口,能轻松集成到现有的云 IDE 或内部开发流程中,并支持通过 REST API 接入自定义文档以增强知识上下文。从代码自动补全到基于 Git 仓库的智能问答,Tabby 致力于成为开发者身边懂业务、守安全的智能伙伴。

onlook

Onlook 是一款专为设计师打造的开源 AI 优先设计工具,被誉为“设计师版的 Cursor”。它旨在打破设计与开发之间的壁垒,让用户能够以可视化的方式直接构建、样式化和编辑 React 应用。通过 Onlook,用户无需深入编写复杂代码,即可在类似 Figma 的直观界面中完成网页原型的搭建与调整,并实时预览最终效果。 这款工具主要解决了传统工作流中设计稿到代码转换效率低、沟通成本高的问题。以往,设计师使用 Figma 等工具完成设计后,需要开发人员手动将其转化为代码,过程繁琐且容易出错。Onlook 允许用户直接在浏览器 DOM 中进行可视化编辑,底层自动生成基于 Next.js 和 TailwindCSS 的高质量代码,实现了“所见即所得”的开发体验。它不仅支持从文本或图像快速生成应用,还具备分支管理、资源管理及一键部署等功能,极大地简化了从创意到成品的流程。 Onlook 特别适合前端开发者、UI/UX 设计师以及希望快速验证产品创意的独立开发者使用。对于设计师而言,它降低了参与前端开发的门槛;对于开发者来说,它提供了一个高效的视觉化调试和原型构建环境。其核心技术亮点在于