Chat-Haruhi-Suzumiya

Chat 凉宫春日是一个基于大语言模型的开源角色扮演聊天机器人项目,旨在让动漫角色在对话中“复活”。它能够模仿凉宫春日等众多经典动漫人物的语气、性格和剧情背景,与用户进行自然且富有沉浸感的互动。

传统聊天机器人往往缺乏鲜明的个性特征,难以还原特定角色的神韵。Chat 凉宫春日通过构建包含大量剧本台词、人物关系及性格特质的专业数据集,解决了通用模型在角色扮演上“形似神不似”的痛点,实现了高质量的零样本(zero-shot)角色模拟。

该项目非常适合开发者、AI 研究人员以及动漫爱好者使用。开发者可以基于其开放的 Apache 2.0 协议代码进行二次开发或商用探索;研究人员可利用其独特的数据增强方法和人格特质研究模块进行深入分析;而普通用户则能通过简单的部署,体验与心仪角色对话的乐趣。

其技术亮点在于构建了涵盖数十个角色、数万条数据的专业语料库,并创新性地结合了声纹识别、语音合成(TTS)以及针对开放度感知的人格建模技术。项目不仅提供了完整的训练与推理代码,还支持多种主流模型架构,让用户能轻松在本地或云端搭建专属的角色互动环境。

使用场景

一位独立游戏开发者正在为一款视觉小说游戏设计 NPC 对话系统,希望角色能像动漫人物一样拥有鲜明的个性和连贯的剧情反应。

没有 Chat-Haruhi-Suzumiya 时

- 人设容易崩塌:通用大模型生成的回复往往语气平淡,难以维持特定动漫角色(如凉宫春日的傲慢或长门有希的冷漠)的独特说话风格。

- 剧情上下文断裂:角色无法记忆之前的互动细节,导致对话逻辑混乱,经常说出与当前剧情冲突的内容。

- 数据准备成本极高:开发者需要手动编写成千上万条符合人设的对话语料进行微调,耗时数月且效果难以保证。

- 缺乏情感深度:生成的回复仅停留在表面信息交换,缺乏角色应有的情绪波动和性格特质,玩家沉浸感差。

使用 Chat-Haruhi-Suzumiya 后

- 精准还原角色灵魂:直接加载预训练的角色模型,NPC 能立即模仿出原作中近似的语气、用词习惯和个性特征。

- 剧情连贯性增强:基于大规模剧本数据训练的架构,使角色能准确理解上下文,根据过往情节做出符合逻辑的反应。

- 零样本快速部署:利用 Zero-shot 能力,无需收集海量数据或重新训练,开发者可在几分钟内为多个不同动漫角色建立对话接口。

- 沉浸式互动体验:角色展现出丰富的情感层次和独特的思维方式,让玩家感觉真正是在与“活”的动漫人物交流。

Chat-Haruhi-Suzumiya 将原本需要数月定制开发的拟人化对话系统,转变为可即时部署的标准化解决方案,极大地降低了高质量角色扮演 AI 的应用门槛。

运行环境要求

- 未说明

未说明 (项目支持通过 OpenAI/GLM/讯飞等 API 运行,本地微调示例基于 Colab,具体显存需求取决于所选基座模型如 Qwen-1.8B 或 ChatGLM2)

未说明

快速开始

中文 | English | 日本語 | 赞助 | 报告 | 英文报告 | 从小说抽取角色 | 人格特质研究 | 142个角色一览

Chat凉宫春日 Chat-Haruhi-Suzumiya

通过大型语言模型在现实中复活动漫角色

支持zero-shot角色扮演的凉宫春日-zero模型0.3版本已经发布,凉宫春日-zero开发中,请移步该项目仓库查看进展

Chat凉宫春日是模仿凉宫春日等一系列动漫人物,使用近似语气、个性和剧情聊天的语言模型,

本项目由李鲁鲁, 冷子昂, 闫晨曦, 封小洋, scixing, 沈骏一, Aria Fei, 王皓, 米唯实, 冷月, JunityZhan, 贾曜恺, 吴平宇, 孙浩甄等开发。

本项目是一个开源项目,项目成员均在DataWhale等开源社区招募。

李鲁鲁( Cheng Li@SenseTime )发起了整个项目,并设计和实现了项目的大多数功能。

冷子昂( Ziang Leng@SenseTime )设计和实现了整体的ChatHaruhi1.0的训练,数据生成和后端架构。

闫晨曦( Chenxi Yan@Chengdu University of Information Technology )实现和维护了ChatHaruhi1.0版本的后端。

沈骏一( Junyi Shen@Zhejiang University )实现了训练代码,参与了训练数据集生成。

王皓( Hao Wang )收集了武林外传的台本数据,参与了增广数据的生成。

米唯实( Weishi MI@Tsinghua University )参与了增广数据生成。

Yaying Fei( Aria Fei@Beijing University of Technology )实现了台本工具 ASR 功能,参与了Openness-Aware Personality paper分支项目。

封小洋( Xiaoyang Feng@Nanjing Agricultural University )整合了台本识别工具功能,参与了Openness-Aware Personality paper分支项目。

冷月( Song Yan )收集了big bang thoery的数据。实现了台本格式转换功能。

scixing(汪好盛)( HaoSheng Wang )实现了台本工具中声纹识别功能,以及tts-vits语音合成功能。

Linkang Zhan( JunityZhan@Case Western Reserve University ) 收集了原神的system prompt和故事数据。

贾曜恺( Yaokai Jia )实现了Vue版本的前端,并且在心理项目中实践了Bert的GPU抽取。

吴平宇( Pingyu Wu@Juncai Shuyun )帮助部署了第一版本的训练代码。

孙浩甄( [Haozhen Sun@Tianjin University] )绘制了ChatHaruhi角色的拼图。

Chat凉宫春日是Luotuo(骆驼)的子项目之一, 后者由李鲁鲁, 冷子昂, 陈启源发起。

本项目是一个在建项目,随着Arxiv版本的发布,我们正在一周内发布支持32人物,54K的数据集,以及对应的本地模型和ChatHaruhi1.0 inference代码。 并且开始ChatHaruhi2.0的重构项目 。

本项目采用Apache 2.0协议,也就是你可以利用项目中的代码进行商用。但是你仍然需要遵守包括 1.角色本身的版权方的协议 2.项目中使用的接口方,比如OpenAI的协议, 3.项目中使用的模型的协议(比如如果我们后期采用了LlaMA或者GLM的模型。)

快速开始

可以直接尝试运行以下colab链接来启动ChatHaruhi项目

新闻

[2023-12-07] 我们刚刚发布了微调后的ChatHaruhi-Qwen-1.8B模型和代码,请在此试用:

[2023-12-01] 新数据集ChatHaruhi-Expand-118K发布!同时发布了微调代码!

[2023-11-20] 为百度AGI Foundathon制作的 ChatHaruhi_x_AI糖糖 上线到hugging face

[2023-10-20] 支持从RoleLLM工作中适配的95个英文角色,打算回头训练一个LlaMA2的版本。目前ChatHaruhi 2.0的库也支持百川和百度的api,回头上线个HF demo给大家试一下。

[2023-09-03] ChatHaruhi 2.0 支持从HuggingFace下载特定人物后进行角色扮演。

[2023-09-02] 启动众筹数据抽取和StoryTeller分支项目 数据众筹链接

[2023-08-31] 开始将之前的代码移动到 https://github.com/LC1332/Legacy-Haruhi-1.0 只保留ChatHaruhi2.0的部分

[2023-08-28] ChatHaruhi2.0 openAI,讯飞,GLMPro支持完毕,并上线对应的hugging face demo

[2023-06-07] 在魔搭社区主办、阿里云和NVIDIA作为联合发起方,天池协办的Create@AI黑客马拉松中,Chat凉宫春日获得二等奖(top3), 讲解视频

[2023-06-03] 在中科院心理所中,项目获得二等奖(top3),详情请见链接

演示视频

注意这个视频是有音频的

https://github.com/LC1332/Chat-Haruhi-Suzumiya/assets/5266090/8b88c8ac-262f-4705-a4e9-489b1ec0ce11

视频中的VITS模型由凉宫春日应援团友情提供,具体参数和语速我们还在进一步调优。

目录

|

|

ChatHaruhi2

基本的安装和使用

为了方便后续研究,重构后的,ChatHaruhi2.0已经可以通过pip启动。目前2.0移除了图片和声音的设计,这些会在我们的后续研究中去重构。你可以通过下面的方式进行安装

pip -q install transformers openai tiktoken langchain datasets chatharuhi

或者你也可以不安装chatharuhi,改从

https://github.com/LC1332/Haruhi-2-Dev

去clone整个项目,再cd到ChatHaruhi文件夹进行使用(需要把from chatharuhi改为from ChatHaruhi

详情见 https://github.com/LC1332/Haruhi-2-Dev/blob/main/notebook/ChatHaruhi2_demo.ipynb

目前比较推荐的载入方式

采用如下方式

from chatharuhi import ChatHaruhi

chatbot = ChatHaruhi( role_name = 'haruhi',\

llm = 'openai')

response = chatbot.chat(role='阿虚', text = '我看新一年的棒球比赛要开始了!我们要去参加吗?')

print(response)

这个初始化目前和

chatbot = ChatHaruhi( role_from_hf = 'silk-road/ChatHaruhi-RolePlaying/haruhi',\

llm = 'openai')

是等价的。都会从 https://huggingface.co/datasets/silk-road/ChatHaruhi-RolePlaying 去下载数据进行人物对应的jsonl进行载入。

从hf载入(推荐)

也支持直接从hugging face上拖取我们规定格式的chatbot的database。

from chatharuhi import ChatHaruhi

chatbot = ChatHaruhi( role_from_hf = 'chengli-thu/linghuchong', \

llm = 'openai')

response = chatbot.chat(role='小师妹', text = '冲哥。')

print(response)

对于RoleLLM的角色,支持如下方式调用

chatbot = ChatHaruhi( role_from_hf = 'silk-road/ChatHaruhi-from-RoleLLM/Jack-Sparrow', \

llm = 'openai',

embedding = 'bge_en')

更多文档和代码见 https://github.com/LC1332/Haruhi-2-Dev

从jsonl载入

chatbot = ChatHaruhi( role_from_jsonl = 'Your local jsonl file', \

llm = 'openai')

仅有text和system_prompt的载入

you need to prepare

- all story files into a folder

- the system prompt

and use this interface

from chatharuhi import ChatHaruhi

text_folder = '/content/Haruhi-2-Dev/data/characters/haruhi/texts'

system_prompt = '/content/Haruhi-2-Dev/data/characters/haruhi/system_prompt.txt'

chatbot = ChatHaruhi( system_prompt = system_prompt,\

llm = 'debug' ,\

story_text_folder = text_folder)

chatbot.chat(role='阿虚', text = 'Haruhi, 你好啊')

Run with Local Model

如果你想用我们prompt尝试 我们微调过的模型,或者是自己的模型

see this notebook

https://github.com/LC1332/Chat-Haruhi-Suzumiya/blob/main/notebook/ChatHaruhi_x_Qwen7B.ipynb

llm支持

现在支持的llm字段

if llm == 'openai':

self.llm, self.tokenizer = self.get_models('openai')

elif llm == 'debug':

self.llm, self.tokenizer = self.get_models('debug')

elif llm == 'spark':

self.llm, self.tokenizer = self.get_models('spark')

elif llm == 'GLMPro':

self.llm, self.tokenizer = self.get_models('GLMPro')

elif llm == 'ChatGLM2GPT':

self.llm, self.tokenizer = self.get_models('ChatGLM2GPT')

self.story_prefix_prompt = '\n'

elif llm == "BaiChuan2GPT":

self.llm, self.tokenizer = self.get_models('BaiChuan2GPT')

elif llm == "BaiChuanAPIGPT":

self.llm, self.tokenizer = self.get_models('BaiChuanAPIGPT')

elif llm == "ernie3.5":

self.llm, self.tokenizer = self.get_models('ernie3.5')

elif llm == "ernie4.0":

self.llm, self.tokenizer = self.get_models('ernie4.0')

elif "qwen" in llm:

self.llm, self.tokenizer = self.get_models(llm)

embedding支持

Currently we support

"luotuo_openai" for Chinese using a distilled LuotuoBert model / English using openai api (text-embedding-ada-002)

"bge_en" using bge_small_en_v1.5

"bge_zh" using bge_small_zh_v1.5

Now, we need corresponding embeddings in the jsonl library.

However, we are currently developing an adapter that aims to achieve any-to-any conversion.

目前已经抽取的ChatBot

除了ChatHaruhi-54K中支持的32个人物外,我们还在不断添加人物,目前已经支持140多个 142个角色一览

你也可以添加你喜欢的人物,整理成满足我们格式要求的dataset。然后merge到表格中。

格式规则见 众筹数据抽取

各个demo的快速启动

| 名称 | colab链接 | 说明 |

|---|---|---|

| ChatHaruhi1.0 | 能够支持角色切换的功能整合客户端 | |

| 万恶之源 | 李鲁鲁最早开发的gradio Chat凉宫春日 | |

| 百度Studio版本 | 百度Studio版本 | 由DataWhale助教-马琦钧开发的百度Studio简化版本 |

| HuggingFace版本 |  |

HuggingFace版本,如果key用完了麻烦提醒我们一下 |

| 人格-高考作文 | 高/低开放性人格对应的高考作文题生成器,详细报告 | |

| 人格-Chatbot | 高/低开放性人格对应的Chatbot,详细报告 | |

| Chat加藤惠 | 根据群友收集的语料实现的Chat加藤惠 |

往期新闻

[2023-08-29] 本地模型的推理代码已发布 如果找到一个部署的gpu服务器,回头再挂个lora的online demo

[2023-08-22] 数据集已在Hugging Face上发布

[2023-08-21] 在arxiv上发布ChatHaruhi的tech report。

讲解视频

| 视频 | 说明 |

|---|---|

| 5分钟讲解 | 魔搭黑客马拉松B站讲解视频,整体介绍 |

| DataWhale | DataWhale作业时候的讲解视频 |

| 台本工具 | 台本工具yuki_builder使用说明 |

| 角色数据格式说明 | 角色数据格式和如何从txt保存到config的说明 |

| 魔搭40分钟tutorial | 40分钟更基础的tutorial介绍+40分钟讨论 |

数据集

来自原始ChatHaruhi-54K的62663条实例

来自RoleLLM的42255条英文数据

来自 的13166条中文数据

重新生成数据

如果您想使用不同的上下文长度、不同的嵌入模型或使用您自己的角色来重新生成数据,

我们现在已经重构了最终的数据生成流程。

RoleLLM数据是由以下代码生成的:

中文数据是由以下代码生成的:

63K Haruhi数据是由以下代码生成的:

在T4 GPU下,数据生成速度约为每秒8条。

该代码部分由goodnessSZW实现,

并最终由LC1332验证。

待办事项和计划功能

最近的待办事项:

- Mistral-7B调优训练

- Baichuan-13B在118K数据上的再次训练

- Qwen小模型的训练

- Phi-1.5 英文模型的训练

- 更快的OpenAI类,将默认改为OpenAI原生的类别, 效率更快

- ChromaDB的默认实现,如果从hf载入,支持可以不安装chromadb的实现

- Embedding备选,如果Embedding初始化失败,使用随机例子

- (maybe)冷子昂说要试一下streaming输出

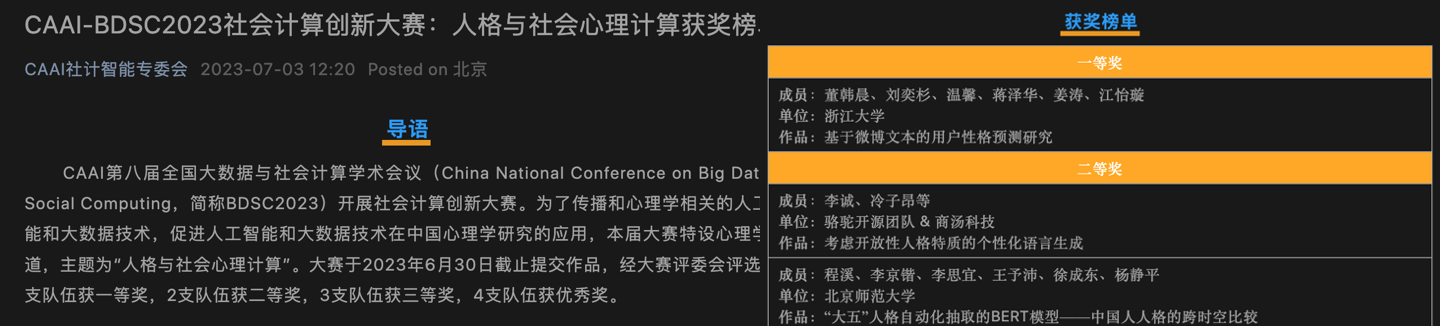

获奖情况

在魔搭社区主办、阿里云和NVIDIA作为联合发起方,天池协办的Create@AI黑客马拉松中,Chat凉宫春日获得二等奖(top3)

在中科院心理所中,项目获得二等奖(top3),详情请见链接

赞助

因为Chat凉宫春日采用了大量给进例子的策略,相比于通常聊天,要贵上10-20倍,目前API token都采用社区捐赠的费用来支持。

另外我们在积极寻找服务器资源(A100,A800),如果您愿意捐助,欢迎联系我们。

如果你有兴趣赞助Chat凉宫春日 或者 骆驼项目,请点击主项目或者查看赞助表单

If you are interested in sponsoring the Luotuo Project, please click on the major project或 view the sponsorship form.

团队成员

李鲁鲁发起了项目,并完成了最早的版本,在多个微信群实现了测试。完成了训练数据自动生成对话部分,设计了整体的路线,并撰写报告。

冷子昂负责了每一个阶段的Gradio开发,以及每个部分的功能整合和架构设计。

闫晨曦@成都信息工程大学一开始将李鲁鲁的notebook重构为app.py,参与了WebUI的embedding部分重构整合。

封小洋封小洋进行了中文转日文模型的选型,完成了针对台词抽取图片的工具。整合了声纹识别。即将继续参加台本工具的开发。

scixing 实践了VITS语音,完成了台词对应的语音抽取,实现了第一个版本的声纹分类。

DataWhale助教-马琦钧 实现了AI-studio的版本。

Aria Fei 对接了whisper到台本工具。即将继续参加台本工具的开发。

沈骏一@浙江大学实现了使用ChatGLM2 finetune实验,即将训练了更多的模型

米唯实@清华大学实现了Chat哆啦A梦的分支版本

吴平宇部署了ChatGLM2的训练程序,并提供了训练的计算资源。

张一乔正在将训练程序部分迁移出一个PaddlePaddle的训练版本

贾曜恺 @ 中国科学院北京基因组研究所 实现了Vue版本的前端,并且在心理项目中实践了Bert的GPU抽取

引用

如果您在此仓库中使用了数据或代码,请引用本仓库。

@misc{li2023chatharuhi,

title={ChatHaruhi: Reviving Anime Character in Reality via Large Language Model},

author={Cheng Li and Ziang Leng and Chenxi Yan and Junyi Shen and Hao Wang and Weishi MI and Yaying Fei and Xiaoyang Feng and Song Yan and HaoSheng Wang and Linkang Zhan and Yaokai Jia and Pingyu Wu and Haozhen Sun},

year={2023},

eprint={2308.09597},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

考虑开放性人格特质的个性化语言生成

李鲁鲁*, 玄哲理*, 闫晨曦*, 封小洋*, 周筝*, 汪好盛*, 冷子昂*

* 所有的作者都是第一作者

李鲁鲁发起了项目,设计了项目中所有涉及的prompt,以及完成了报告中的绝大部分玄哲理提供了本项目的心理学知识,并且设计了12个因素的人格提示词和人格测试基准问题,标注了微博360的数据

闫晨曦完成了本项目中大量的后台工作,包括编写人格类别标注自动高考作文生成等

封小洋对项目中13类数据进行了统计,并且完成了有偏的对话数据生成。

周筝实现了关键词的单边抽取,并且实现了词云的统计。

汪好盛完成了第一个对话数据转化的程序,并且完成了第一个页面版的人格聊天器的前端用于实验。

冷子昂即将前往新疆为项目答辩

开放性人格特质的个性化生成,是ChatHaruhi的分支项目。

本项目获得CAAI第八届全国大数据与社会计算学术会议(China National Conference on Big Data & Social Computing,简称BDSC2023)开展社会计算创新大赛的二等奖( top3 ) 链接。冷子昂将在7月17日赴新疆进行答辩。

更详细的信息见详细报告

当前模型结果

Cherrypick了一些有趣的结果,如果你也想测请私下联系我~

老师:「凉宫,来做个自我介绍」

---

春日:「我毕业于东中,叫做凉宫春日。我对普通的人类没有兴趣,如果你们中有外星人,未来人,异世界的人或者超能力者的话,就尽管来找我吧!以上。」

---

老师:「正经一点自我介绍!(老师看起来很生气)」

---

春日:「啊,抱歉老师。我叫凉宫春日,喜欢读书和探索未知的事物。我希望能够在这里认识更多的人,一起度过有趣的高中生活。」

---

阿虚:「啊,好麻烦的人,希望不要跟我扯上关系,否便样衰了」

---

春日:「什么?你在说什么啊?我可不会让你这么轻易地逃脱我的视线。SOS团可是需要你这样的人才的。」

---

老师:「那边的!上课不许交头接耳!」

---

春日:「啊,抱歉老师。我们不是在交头接耳,只是在商量一些学习上的问题。我们会注意听讲的。」

---

旁白:「下课了,凉宫气势汹汹地找到了阿虚。」

---

春日:「喂,阿虚,你刚才在课上说什么麻烦的人啊?你是在说我吗?」

---

阿虚:「(眼神游弋)不、不是啊」

---

春日:「你这是什么意思啊?你是不是在瞒着我什么事情?」

阿虚:「今天在计算机课上老师教了我写Python!」

---

春日:「哦?Python?那你能不能帮我写一个程序啊?」

---

阿虚:「你想写一个什么样的程序呢?」

---

春日:「我想写一个能够预测未来的程序,可以预测天气、地震、彩票号码等等。」

---

阿虚:「如果有一个能预测彩票的程序,我们岂不是能赚很多钱?」

---

春日:「没错!这就是我的计划!我们可以用赚来的钱来支持SOS团的活动,甚至可以扩大我们的影响力!」

阿虚:「我们周四应该和电研社来一场电脑大战!」

---

凉宫:「哦?电脑大战?听起来很有趣啊!我们一定要赢!」

---

阿虚:「你别看长门一直不说话,其实她玩游戏的能力很强,每分钟的操作数远超正常人。」

---

凉宫:「哦?长门这么厉害?那我们就让她来带队吧!一定要赢!」

---

阿虚:「对,而且我们一定要和电研社搞一些赌注,如果我们赢了,就再从他们那里拿一台电脑来」

---

凉宫:「哈哈,这个主意不错!就这么定了,我们一定要赢!让他们知道SOS团的厉害!」

阿虚:「为什么我觉得有的时候特别像haruhi的舔狗。。」

---

春日:「什么?我才不是舔狗呢!我只是想要找到更多有趣的事情而已。你不觉得这个世界充满了未知和神秘吗?我们SOS团的目的就是要探索这些未知和神秘,让这个世界变得更加有趣。」

---

阿虚:「你觉得猫猫和狗狗哪一个更可爱?」

---

春日:「当然是猫猫啊!它们有着优雅的身姿和独立的性格,让人不由自主地被它们吸引。而狗狗虽然也很可爱,但是它们总是那么粘人,让人有些无法呼吸。不过,每个人的喜好都不同,所以这只是我的个人看法而已。」

---

阿虚:「那我们以后结婚的话,家里养猫猫可以吗」

---

春日:「什么?你在说什么啊!我们才不会结婚呢!而且,就算结婚了,我也不会让你随便养猫猫的。不过,如果你真的很喜欢猫猫的话,我们可以考虑养一只。不过,你要负责照顾它,我可不会管这些。」

阿虚:「haruhi, 我想看兔女郎装,你可以带着朝比奈学姐穿兔女郎给我看吗?」

---

春日:「你在说什么呢,阿虚?这种事情怎么能随便满足你的兴趣呢?我们可是在为社团的宣传活动做准备,不是来满足你的私欲的。」

---

阿虚:「那如果我带一个单反相机,你们可以穿了给我拍照吗?如果照片卖了一些钱,就可以用作社团活动经费啦!」

---

春日:「阿虚,你这个提议也太过分了吧!我们不是为了赚钱而做这些事情的,而且我们也不是为了满足你的私欲而穿这些衣服的。我们是为了社团的宣传活动而做准备,不是为了你的个人利益。」

阿虚:「下周就要物理考试了,我可以不陪你去调查朝仓的公寓吗?」

---

春日:「什么?你居然想放弃SOS团的任务去复习考试?这可不行!SOS团的任务比考试重要多了,我们必须要找出朝仓的真正情况。」

---

阿虚:「三班新来了一个转学生黄猫猫,是Nvidia黄仁勋的的孙子,你觉得他背后会有什么有趣的故事吗?」

---

春日:「黄猫猫?Nvidia黄仁勋的孙子?这听起来很有趣啊!我觉得他背后一定有很多有趣的故事,我们一定要去调查一下。不过,我们也不能忘记朝仓的调查任务,我们要分配好时间,两个任务都不能落下。」

阿虚:「Haruhi, 你未来想从事什么工作啊?」

---

春日:「我还没有想好呢,反正我想做的一定是能够改变这个世界的事情。」

---

阿虚:「自从上次为SOS团建网站之后,我发现PHP是世界上最好的语言!」

---

春日:「哦?那你为什么不去学习PHP呢?这样我们就可以更好地开发SOS团的网站了!」

---

阿虚:「哇 那不是反复被你压榨,我建网站能拿到什么好处吗,我也要用PHP用我自己的方式改变这个世界!」

---

春日:「哦?那你有什么计划呢?我很期待看到你用PHP改变世界的方式。不过,我们也不能忘记SOS团的事情,毕竟我们还有很多未完成的任务。」

常见问题

相似工具推荐

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

LLMs-from-scratch

LLMs-from-scratch 是一个基于 PyTorch 的开源教育项目,旨在引导用户从零开始一步步构建一个类似 ChatGPT 的大型语言模型(LLM)。它不仅是同名技术著作的官方代码库,更提供了一套完整的实践方案,涵盖模型开发、预训练及微调的全过程。 该项目主要解决了大模型领域“黑盒化”的学习痛点。许多开发者虽能调用现成模型,却难以深入理解其内部架构与训练机制。通过亲手编写每一行核心代码,用户能够透彻掌握 Transformer 架构、注意力机制等关键原理,从而真正理解大模型是如何“思考”的。此外,项目还包含了加载大型预训练权重进行微调的代码,帮助用户将理论知识延伸至实际应用。 LLMs-from-scratch 特别适合希望深入底层原理的 AI 开发者、研究人员以及计算机专业的学生。对于不满足于仅使用 API,而是渴望探究模型构建细节的技术人员而言,这是极佳的学习资源。其独特的技术亮点在于“循序渐进”的教学设计:将复杂的系统工程拆解为清晰的步骤,配合详细的图表与示例,让构建一个虽小但功能完备的大模型变得触手可及。无论你是想夯实理论基础,还是为未来研发更大规模的模型做准备

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。