RoFormer_pytorch

RoFormer_pytorch 是基于 PyTorch 框架实现的 RoFormer 及 RoFormer-V2 模型开源库。它成功将苏神提出的先进中文预训练模型迁移至 PyTorch 生态,解决了用户无法直接在 PyTorch 环境中使用原版 PaddlePaddle 实现的问题。

在技术层面,RoFormer_pytorch 采用了旋转位置编码(RoPE)机制,显著增强了模型对长文本的理解能力。根据 CLUE 评测数据,其在多个中文分类任务中的表现优于传统 BERT 和 RoBERTa 模型,尤其在 WSC 和 CSL 等推理任务上优势明显。此外,项目还集成了 RoFormerForCausalLM 以支持生成式任务,并修复了微调时 token_type_id 处理的细节 bug,确保与官方行为一致。

无论是需要复现论文效果的研究人员,还是希望在生产环境中部署高性能中文模型的开发者,都能从中受益。代码结构清晰,支持一键安装,为中文 NLP 领域的模型探索与落地提供了便捷且强大的基础设施。

使用场景

某金融科技公司的算法团队正在开发智能工单分类系统,核心需求是解决中文语境下复杂的语义歧义与指代关系识别问题。

没有 RoFormer_pytorch 时

- 采用传统 BERT 模型处理中文长文本时,固定位置编码难以捕捉深层语法结构,导致关键上下文信息严重遗漏。

- 在涉及指代消解等复杂逻辑任务上,模型表现平平,误判率较高,直接影响客服工单的自动派单效率与用户体验。

- 环境依赖繁琐,若需使用苏神优化的 V2 版本,往往面临代码兼容性差、权重加载困难以及缺乏官方支持的问题。

使用 RoFormer_pytorch 后

- 利用旋转位置嵌入机制,显著增强了对长序列上下文的动态理解能力,有效解决了因位置信息丢失导致的语义偏差。

- 基于 CLUE 榜单验证的高性能数据,在 WSC 和 CSL 等中文特有任务上准确率大幅提升,大幅降低了业务场景中的误分类风险。

- 原生 PyTorch 实现开箱即用,支持 V2 版本一键安装与微调,无需反复调试底层代码即可快速完成模型部署与迭代。

核心价值:RoFormer_pytorch 凭借更优的中文语义建模能力,帮助团队以更低算力成本实现了高精度的业务落地。

运行环境要求

- 未说明

非必需(支持 CPU),实验环境 RTX 3090

未说明

快速开始

PyTorch RoFormer & RoFormer-V2

RoFormer 模型和 RoFormer-V2 模型

更新

- 2022/05/18

添加 paddle 版本 RoFormerV2 在分类任务上的训练结果。

- 2022/05/11

感谢苏神提醒,添加了一个注释,其中 RoFormerV2*表示未经多任务学习的 RoFormerV2 模型。

- 2022/05/01

添加 clue 分类任务 的代码和 dev 集结果,代码在 examples/clue 文件夹,缺少啥依赖安装啥,比如需要这个 pip install -U accelerate。

- 2022/04/30

有个细节需要注意一下,苏神在微调时无论输入是 text 还是 text pair 类型时,token_type_id 都置为了 0。

如果想要使用与苏神保持一致,那么可以在 tokenizer 时候设置 return_token_type_ids=False,这样模型会在内部处理。

否则对于 text pair 类型时,会返回与 0,1 两种类型的 token_type_id

- 2022/04/02

(1)修改 RoFormerForCausalLM,支持 roformer-sim 并提供相关的例子,请见 examples/test_sim.py。

(2)修改 apply_rotary 实现方式,看起来更简单。

def apply_rotary(x, sinusoidal_pos=None):

if sinusoidal_pos is None:

return x

sin, cos = sinusoidal_pos

# x.shape [batch, seq_len, 2]

x1, x2 = x[..., 0::2], x[..., 1::2]

# [cos_nθ, -sin_nθ] [x1]

# [sin_nθ, cos_nθ] [x2]

# => [x1 * cos_nθ - x2 * sin_nθ, x1 * sin_nθ + x2 * cos_nθ]

# 苏神的 rotary,使用了下面的计算方法。

# return torch.stack([x1 * cos - x2 * sin, x1 * sin + x2 * cos], dim=-1).flatten(-2, -1)

# 考虑到矩阵乘法 torch.einsum("bhmd,bhnd->bhmn", q, k),因此可以直接在最后一个维度拼接(无需奇偶交错)

return torch.cat([x1 * cos - x2 * sin, x1 * sin + x2 * cos], dim=-1)

- 2022/03/21 添加

roformer-v2的权重,注:必须使用本仓库的代码,不能使用 transformers 仓库的代码!!!

安装

# v2 版本

pip install roformer>=0.4.3

# v1 版本 (代码已经加入到 huggingface 仓库,请使用新版本的 transformers)

pip install -U transformers

评测对比

CLUE-dev 榜单分类任务结果,base+large 版本。

| iflytek | tnews | afqmc | cmnli | ocnli | wsc | csl | avg | |

|---|---|---|---|---|---|---|---|---|

| BERT | 60.06 | 56.80 | 72.41 | 79.56 | 73.93 | 78.62 | 83.93 | 72.19 |

| RoBERTa | 60.64 | 58.06 | 74.05 | 81.24 | 76.00 | 87.50 | 84.50 | 74.57 |

| RoFormer | 60.91 | 57.54 | 73.52 | 80.92 | 76.07 | 86.84 | 84.63 | 74.35 |

| RoFormerV2* | 60.87 | 56.54 | 72.75 | 80.34 | 75.36 | 80.92 | 84.67 | 73.06 |

| GAU-α | 61.41 | 57.76 | 74.17 | 81.82 | 75.86 | 79.93 | 85.67 | 73.8 |

| RoFormer-pytorch(本仓库代码) | 60.60 | 57.51 | 74.44 | 80.79 | 75.67 | 86.84 | 84.77 | 74.37 |

| RoFormerV2-pytorch(本仓库代码) | 62.87 | 59.03 | 76.20 | 80.85 | 79.73 | 87.82 | 91.87 | 76.91 |

| GAU-α-pytorch(Adafactor) | 61.18 | 57.52 | 73.42 | 80.91 | 75.69 | 80.59 | 85.5 | 73.54 |

| GAU-α-pytorch(AdamW wd0.01 warmup0.1) | 60.68 | 57.95 | 73.08 | 81.02 | 75.36 | 81.25 | 83.93 | 73.32 |

| RoFormerV2-large-pytorch(本仓库代码) | 61.75 | 59.21 | 76.14 | 82.35 | 81.73 | 91.45 | 91.5 | 77.73 |

| Chinesebert-large-pytorch | 61.25 | 58.67 | 74.70 | 82.65 | 79.63 | 87.83 | 84.97 | 75.67 |

| RoFormerV2-base-paddle | 63.76 | 59.53 | 77.06 | 81.58 | 81.56 | 87.83 | 86.73 | 76.87 |

| RoFormerV2-large-paddle | 64.02 | 60.08 | 77.92 | 82.87 | 83.9 | 92.43 | 86.87 | 78.30 |

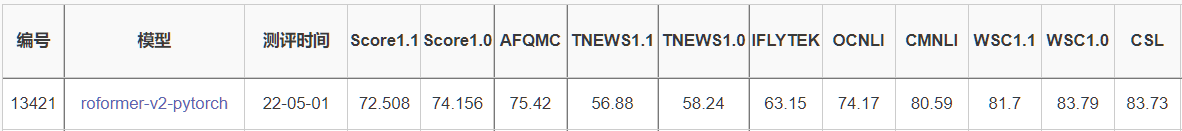

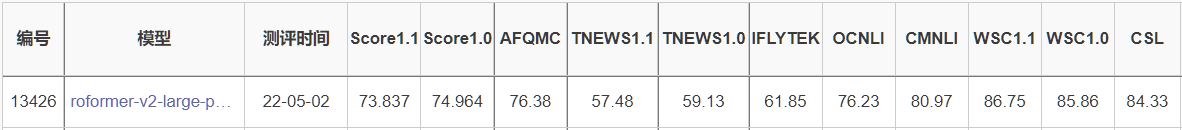

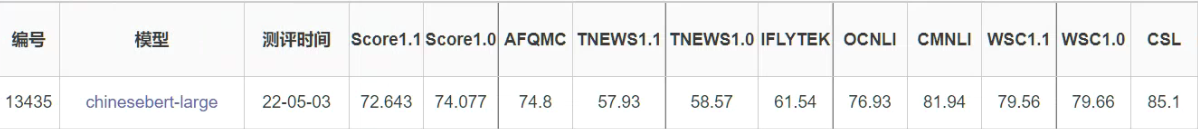

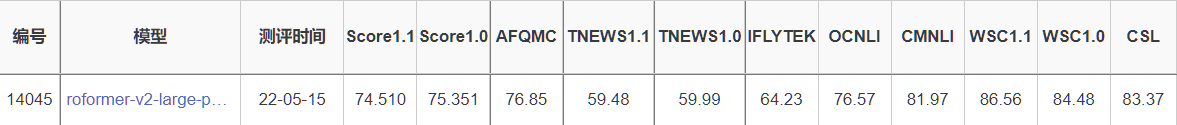

CLUE-1.0-test 榜单分类任务结果,base+large 版本。

| iflytek | tnews | afqmc | cmnli | ocnli | wsc | csl | avg | |

|---|---|---|---|---|---|---|---|---|

| RoFormer-pytorch(本仓库代码) | 59.54 | 57.34 | 74.46 | 80.23 | 73.67 | 80.69 | 84.57 | 72.93 |

| RoFormerV2-pytorch(本仓库代码) | 63.15 | 58.24 | 75.42 | 80.59 | 74.17 | 83.79 | 83.73 | 74.16 |

| GAU-α-pytorch(Adafactor) | 61.38 | 57.08 | 74.05 | 80.37 | 73.53 | 74.83 | 85.6 | 72.41 |

| GAU-α-pytorch(AdamW wd0.01 warmup0.1) | 60.54 | 57.67 | 72.44 | 80.32 | 72.97 | 76.55 | 84.13 | 72.09 |

| RoFormerV2-large-pytorch(本仓库代码) | 61.85 | 59.13 | 76.38 | 80.97 | 76.23 | 85.86 | 84.33 | 74.96 |

| Chinesebert-large-pytorch | 61.54 | 58.57 | 74.8 | 81.94 | 76.93 | 79.66 | 85.1 | 74.08 |

| RoFormerV2-large-paddle | 64.23 | 59.99 | 76.85 | 81.97 | 76.57 | 84.48 | 83.37 | 75.35 |

注:

- 其中 RoFormerV2*表示的是未进行多任务学习的 RoFormerV2 模型,该模型苏神并未开源,感谢苏神的提醒。

- 其中不带有 pytorch 后缀结果都是从 GAU-alpha 仓库复制过来的。

- 其中带有 pytorch 后缀的结果都是自己训练得出的。

- 苏神代码中拿了 cls 标签后直接进行了分类,而本仓库使用了如下的分类头,多了 2 个 dropout,1 个 dense,1 个 relu 激活。

- paddle 版本的代码进行了 grid search!

class RoFormerClassificationHead(nn.Module):

def __init__(self, config):

super().__init__()

self.dense = nn.Linear(config.hidden_size, config.hidden_size)

self.dropout = nn.Dropout(config.hidden_dropout_prob)

self.out_proj = nn.Linear(config.hidden_size, config.num_labels)

self.config = config

def forward(self, features, **kwargs):

x = features[:, 0, :] # take <s> token (equiv. to [CLS])

x = self.dropout(x)

x = self.dense(x)

x = ACT2FN[self.config.hidden_act](x) # 这里是 relu

x = self.dropout(x)

x = self.out_proj(x)

return x

提示:

- 实验环境RTX 3090

排行榜截图

Roformer-sim 测试例子

import torch

import numpy as np

from roformer import RoFormerForCausalLM, RoFormerConfig

from transformers import BertTokenizer

device = torch.device('cuda:0' if torch.cuda.is_available() else 'cpu')

# 可选以下几个。

# junnyu/roformer_chinese_sim_char_small, junnyu/roformer_chinese_sim_char_base

# junnyu/roformer_chinese_sim_char_ft_small, roformer_chinese_sim_char_ft_base

pretrained_model = "junnyu/roformer_chinese_sim_char_base"

tokenizer = BertTokenizer.from_pretrained(pretrained_model)

config = RoFormerConfig.from_pretrained(pretrained_model)

config.is_decoder = True

config.eos_token_id = tokenizer.sep_token_id

config.pooler_activation = "linear"

model = RoFormerForCausalLM.from_pretrained(pretrained_model, config=config)

model.to(device)

model.eval()

def gen_synonyms(text, n=100, k=20):

''''含义:产生 sent 的 n 个相似句,然后返回最相似的 k 个。

做法:用 seq2seq 生成,并用 encoder 算相似度并排序。

'''

# 寻找所有相似的句子

r = []

inputs1 = tokenizer(text, return_tensors="pt")

for _ in range(n):

inputs1.to(device)

output = tokenizer.batch_decode(model.generate(**inputs1, top_p=0.95, do_sample=True, max_length=128), skip_special_tokens=True)[0].replace(" ","").replace(text, "") # 去除空格,去除原始 text 文本。

r.append(output)

# 对相似的句子进行排序

r = [i for i in set(r) if i != text and len(i) > 0]

r = [text] + r

inputs2 = tokenizer(r, padding=True, return_tensors="pt")

with torch.no_grad():

inputs2.to(device)

outputs = model(**inputs2)

Z = outputs.pooler_output.cpu().numpy()

Z /= (Z**2).sum(axis=1, keepdims=True)**0.5

argsort = np.dot(Z[1:], -Z[0]).argsort()

return [r[i + 1] for i in argsort[:k]]

out = gen_synonyms("广州和深圳哪个好?")

print(out)

['深圳和广州哪个好?',

'广州和深圳哪个好',

'深圳和广州哪个好',

'深圳和广州哪个比较好。',

'深圳和广州哪个最好?',

'深圳和广州哪个比较好',

'广州和深圳那个比较好',

'深圳和广州哪个更好?',

'深圳与广州哪个好',

'深圳和广州,哪个比较好',

'广州与深圳比较哪个好',

'深圳和广州哪里比较好',

'深圳还是广州比较好?',

'广州和深圳哪个地方好一些?',

'广州好还是深圳好?',

'广州好还是深圳好呢?',

'广州与深圳哪个地方好点?',

'深圳好还是广州好',

'广州好还是深圳好',

'广州和深圳哪个城市好?']

## 模型权重对照表

### 中文模型 roformer-v2

| huggingface.co | bert4keras |

| ---------------------------------- | ------------------------------------------------ |

| [roformer_v2_chinese_char_small](https://huggingface.co/junnyu/roformer_v2_chinese_char_small) | [chinese_roformer-v2-char_L-6_H-384_A-6.zip](https://pan.baidu.com/s/1huUrC9P60Afggo8AfiUcmA) (下载码:ttn4) |

| [roformer_v2_chinese_char_base](https://huggingface.co/junnyu/roformer_v2_chinese_char_base) | [chinese_roformer-v2-char_L-12_H-768_A-12.zip](https://pan.baidu.com/s/1qcnN4LVKVe0-mnHlkN3-6Q) (下载码:pfoh) |

| [roformer_v2_chinese_char_large](https://huggingface.co/junnyu/roformer_v2_chinese_char_large) | [chinese_roformer-v2-char_L-24_H-1024_A-16.zip](https://pan.baidu.com/s/1QiJWSZrGxn8vek-8myvL6w) (下载码:npfv) |

### 中文模型 roformer-v1

| huggingface.co | bert4keras |

| ---------------------------------- | ------------------------------------------------ |

| [roformer_chinese_base](https://huggingface.co/junnyu/roformer_chinese_base) | [chinese_roformer_L-12_H-768_A-12.zip](https://pan.baidu.com/s/1fiss862YsGCwf2HvU_Jm-g) (下载码:xy9x) |

| [roformer_chinese_small](https://huggingface.co/junnyu/roformer_chinese_small) | [chinese_roformer_L-6_H-384_A-6.zip](https://pan.baidu.com/s/1iIXgZHHCgrYGXVRRSSCVPg) (下载码:gy97) |

| [roformer_chinese_char_base](https://huggingface.co/junnyu/roformer_chinese_char_base) | [chinese_roformer-char_L-12_H-768_A-12.zip](https://pan.baidu.com/s/1Q1pq8F4Fsl6bTipUAkqeDQ) (下载码:bt94) |

| [roformer_chinese_char_small](https://huggingface.co/junnyu/roformer_chinese_char_small) | [chinese_roformer-char_L-6_H-384_A-6.zip](https://pan.baidu.com/s/1cc281-M0Rsjlwws5phqzbQ) (下载码:a44c) |

| [roformer_chinese_sim_char_base](https://huggingface.co/junnyu/roformer_chinese_sim_char_base) | [chinese_roformer-sim-char_L-12_H-768_A-12.zip](https://pan.baidu.com/s/1f1FB288nv1a6jYjsNCordg) (下载码:2cgz) |

| [roformer_chinese_sim_char_small](https://huggingface.co/junnyu/roformer_chinese_sim_char_small) | [chinese_roformer-sim-char_L-6_H-384_A-6.zip](https://pan.baidu.com/s/1r0eJ7shGwQ0RzV9BTFFW4g) (下载码:h68q) |

| [roformer_chinese_sim_char_ft_base](https://huggingface.co/junnyu/roformer_chinese_sim_char_ft_base) | [chinese_roformer-sim-char-ft_L-12_H-768_A-12.zip](https://pan.baidu.com/s/1Igh3tSvSu_ahDZmGaOlVoA) (下载码:w15n) |

| [roformer_chinese_sim_char_ft_small](https://huggingface.co/junnyu/roformer_chinese_sim_char_ft_small) | [chinese_roformer-sim-char-ft_L-6_H-384_A-6.zip](https://pan.baidu.com/s/1G36x7YQF1b6nzW0OzyJS_Q) (下载码:gty5) |

### 英文模型(使用 ELECTRA (一种预训练模型架构) 的训练方法在 OpenWebText (开源网络文本数据集) 上训练的 Small (小型) 模型(Rotary Value (旋转位置编码值) = True))

| huggingface.co |

| ---------------------------------- |

|[roformer_small_generator](https://huggingface.co/junnyu/roformer_small_generator)|

|[roformer_small_discriminator](https://huggingface.co/junnyu/roformer_small_discriminator)|

## RoFormer-v2 掩码语言模型 (Masked Language Model, MLM) 测试

```python

import torch

import tensorflow as tf

from transformers import BertTokenizer

from roformer import RoFormerForMaskedLM, TFRoFormerForMaskedLM

text = "今天[MASK]很好,我[MASK]去公园玩。"

tokenizer = BertTokenizer.from_pretrained("junnyu/roformer_v2_chinese_char_base")

pt_model = RoFormerForMaskedLM.from_pretrained("junnyu/roformer_v2_chinese_char_base")

tf_model = TFRoFormerForMaskedLM.from_pretrained(

"junnyu/roformer_v2_chinese_char_base", from_pt=True

)

pt_inputs = tokenizer(text, return_tensors="pt")

tf_inputs = tokenizer(text, return_tensors="tf")

# pytorch

with torch.no_grad():

pt_outputs = pt_model(**pt_inputs).logits[0]

pt_outputs_sentence = "pytorch: "

for i, id in enumerate(tokenizer.encode(text)):

if id == tokenizer.mask_token_id:

tokens = tokenizer.convert_ids_to_tokens(pt_outputs[i].topk(k=5)[1])

pt_outputs_sentence += "[" + "||".join(tokens) + "]"

else:

pt_outputs_sentence += "".join(

tokenizer.convert_ids_to_tokens([id], skip_special_tokens=True)

)

print(pt_outputs_sentence)

# tf

tf_outputs = tf_model(**tf_inputs, training=False).logits[0]

tf_outputs_sentence = "tf: "

for i, id in enumerate(tokenizer.encode(text)):

if id == tokenizer.mask_token_id:

tokens = tokenizer.convert_ids_to_tokens(tf.math.top_k(tf_outputs[i], k=5)[1])

tf_outputs_sentence += "[" + "||".join(tokens) + "]"

else:

tf_outputs_sentence += "".join(

tokenizer.convert_ids_to_tokens([id], skip_special_tokens=True)

)

print(tf_outputs_sentence)

# small

# pytorch: 今天 [的 ||,||是||很||也] 很好,我 [要 ||会||是||想||在] 去公园玩。

# tf: 今天 [的 ||,||是||很||也] 很好,我 [要 ||会||是||想||在] 去公园玩。

# base

# pytorch: 今天 [我 ||天||晴||园||玩] 很好,我 [想 ||要||会||就||带] 去公园玩。

# tf: 今天 [我 ||天||晴||园||玩] 很好,我 [想 ||要||会||就||带] 去公园玩。

# large

# pytorch: 今天 [天 ||气||我||空||阳] 很好,我 [又 ||想||会||就||爱] 去公园玩。

# tf: 今天 [天 ||气||我||空||阳] 很好,我 [又 ||想||会||就||爱] 去公园玩。

RoFormer-v1 掩码语言模型 (Masked Language Model, MLM) 测试

import torch

import tensorflow as tf

from transformers import RoFormerForMaskedLM, RoFormerTokenizer, TFRoFormerForMaskedLM

text = "今天[MASK]很好,我[MASK]去公园玩。"

tokenizer = RoFormerTokenizer.from_pretrained("junnyu/roformer_chinese_base")

pt_model = RoFormerForMaskedLM.from_pretrained("junnyu/roformer_chinese_base")

tf_model = TFRoFormerForMaskedLM.from_pretrained(

"junnyu/roformer_chinese_base", from_pt=True

)

pt_inputs = tokenizer(text, return_tensors="pt")

tf_inputs = tokenizer(text, return_tensors="tf")

# pytorch

with torch.no_grad():

pt_outputs = pt_model(**pt_inputs).logits[0]

pt_outputs_sentence = "pytorch: "

for i, id in enumerate(tokenizer.encode(text)):

if id == tokenizer.mask_token_id:

tokens = tokenizer.convert_ids_to_tokens(pt_outputs[i].topk(k=5)[1])

pt_outputs_sentence += "[" + "||".join(tokens) + "]"

else:

pt_outputs_sentence += "".join(

tokenizer.convert_ids_to_tokens([id], skip_special_tokens=True)

)

print(pt_outputs_sentence)

tf

tf_outputs = tf_model(**tf_inputs, training=False).logits[0] tf_outputs_sentence = "tf: " for i, id in enumerate(tokenizer.encode(text)): if id == tokenizer.mask_token_id: tokens = tokenizer.convert_ids_to_tokens(tf.math.top_k(tf_outputs[i], k=5)[1]) tf_outputs_sentence += "[" + "||".join(tokens) + "]" else: tf_outputs_sentence += "".join( tokenizer.convert_ids_to_tokens([id], skip_special_tokens=True) ) print(tf_outputs_sentence)

pytorch: 今天 [天气||天||心情||阳光||空气] 很好,我 [想||要||打算||准备||喜欢] 去公园玩。

tf: 今天 [天气||天||心情||阳光||空气] 很好,我 [想||要||打算||准备||喜欢] 去公园玩。

## 手动权重转换

```bash

python convert_roformer_original_tf_checkpoint_to_pytorch.py \

--tf_checkpoint_path=xxxxxx/chinese_roformer_L-12_H-768_A-12/bert_model.ckpt \

--bert_config_file=pretrained_models/chinese_roformer_base/config.json \

--pytorch_dump_path=pretrained_models/chinese_roformer_base/pytorch_model.bin

tf 与 pytorch 精度对齐

small 版本

bert4keras vs pytorch

mean diff : tensor(5.9108e-07)

max diff : tensor(5.7220e-06)

bert4keras vs tf2.0

mean diff : tensor(4.5976e-07)

max diff : tensor(3.5763e-06)

base 版本

python compare_model.py

bert4keras vs pytorch

mean diff : tensor(4.3340e-07)

max diff : tensor(5.7220e-06)

bert4keras vs tf2.0

mean diff : tensor(3.4319e-07)

max diff : tensor(5.2452e-06)

参考

https://github.com/pengming617/bert_classification

https://github.com/bojone/bert4keras

https://github.com/ZhuiyiTechnology/roformer

https://github.com/lonePatient/NeZha_Chinese_PyTorch

https://github.com/lonePatient/TorchBlocks

https://github.com/huggingface/transformers

引用

Bibtex:

@misc{su2021roformer,

title={RoFormer: Enhanced Transformer with Rotary Position Embedding},

author={Jianlin Su and Yu Lu and Shengfeng Pan and Bo Wen and Yunfeng Liu},

year={2021},

eprint={2104.09864},

archivePrefix={arXiv},

primaryClass={cs.CL}

}

@techreport{roformerv2,

title={RoFormerV2: A Faster and Better RoFormer - ZhuiyiAI},

author={Jianlin Su, Shengfeng Pan, Bo Wen, Yunfeng Liu},

year={2022},

url="https://github.com/ZhuiyiTechnology/roformer-v2",

}

版本历史

v0.4.12022/04/02v0.4.02022/03/21v0.3.12021/12/15v0.3.02021/12/03v0.2.22021/09/14v0.1.02021/07/050.0.82021/05/270.0.62021/05/18v0.0.42021/05/09常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。