Bindu

Bindu 是一款旨在将任意 AI 智能体快速转化为生产级微服务的开源工具。它如同为智能体赋予了“身份证”与“通信协议”,让原本孤立的 AI 模型能够具备独立的数字身份(DID),并支持相互通信、状态监控以及加密支付功能。

在开发过程中,开发者常面临智能体难以标准化部署、跨框架协作困难以及缺乏统一身份认证等挑战。Bindu 通过简单的 bindufy() 调用,即可让基于 Agno、LangChain、OpenAI SDK 甚至原生 TypeScript 编写的智能体瞬间获得企业级服务能力,无需重写代码或构建复杂的基础设施。

这款工具主要面向 AI 应用开发者、后端工程师及希望构建多智能体协作系统的研究人员。无论是个人开发者还是技术团队,都能利用它轻松实现智能体的互操作性与商业化闭环。

Bindu 的技术亮点在于其基于开放协议构建,原生支持 A2A(代理对代理)通信、AP2 身份验证以及 X402 加密支付标准。它兼容 Python、TypeScript 和 Kotlin 等多种语言,真正实现了“一次编写,处处互联”,让智能体像向日葵一样独立生长又能协同作战,共同构建高效的智能体互联网。

使用场景

一家初创团队正在构建一个跨平台的“智能旅行规划系统”,需要让负责机票查询、酒店比价和当地向导的三个独立 AI 代理实时协作并自动完成支付结算。

没有 Bindu 时

- 集成成本高昂:开发者必须为每个代理手动编写 REST API 封装代码,并自行处理不同框架(如 LangChain 与原生 Python)间的通信协议转换。

- 身份信任缺失:代理间缺乏统一的去中心化身份(DID),难以验证调用方合法性,容易遭受恶意请求或数据篡改。

- 支付流程断裂:涉及费用结算时,需额外接入第三方支付网关并编写复杂的对账逻辑,无法在代理交互中直接完成原子化支付。

- 运维监控黑盒:缺乏标准化的可观测性接口,当多代理协作出错时,难以追踪具体是哪个环节导致了任务失败。

使用 Bindu 后

- 一键微服务化:只需在现有代码中调用

bindufy()函数,即可将任意框架开发的代理瞬间转化为具备标准 A2A 协议的生产级微服务,无需重写架构。 - 内置可信身份:Bindu 自动为每个代理分配 DID 身份并处理 OAuth2 认证,确保只有授权的代理才能加入协作网络,保障交互安全。

- 原生支付支持:基于 X402 协议,代理可在对话过程中直接发起和接收加密货币支付,实现了“协商即结算”的闭环体验。

- 全链路可观测:平台自带标准化监控层,团队可以清晰看到每个代理的状态、消息流向及性能指标,快速定位并修复协作瓶颈。

Bindu 通过提供统一的身份、通信与支付层,让开发者能像组装乐高积木一样,零基础设施成本地构建可互操作、可信赖的 AI 代理集群。

运行环境要求

- Linux

- macOS

- Windows

未说明

未说明

快速开始

面向AI智能体的身份、通信与支付层

🇬🇧 英文 • 🇩🇪 德语 • 🇪🇸 西班牙语 • 🇫🇷 法语 • 🇮🇳 印地语 • 🇮🇳 孟加拉语 • 🇨🇳 中文 • 🇳🇱 荷兰语 • 🇮🇳 泰米尔语

“正如向阳的向日葵一样,智能体会以群体协作的方式共同工作——每个个体都是独立的,但它们合在一起却能创造出更伟大的事物。”

只需一行命令即可部署你的智能体

curl -fsSL https://getbindu.com/install-bindu.sh | bashBindu(读作:宾杜)可以将任何AI智能体转化为生产级微服务。无论你使用哪种框架构建智能体——Agno、LangChain、OpenAI SDK,甚至是纯TypeScript——只需调用bindufy()函数,就能获得一个具备DID身份、A2A协议、OAuth2认证和加密支付功能的服务。无需编写基础设施代码,也无需重写现有代码。

支持Python、TypeScript和Kotlin。基于开放协议构建:A2A、AP2和X402。

🌟 注册你的智能体 • 🌻 文档 • 💬 Discord社区

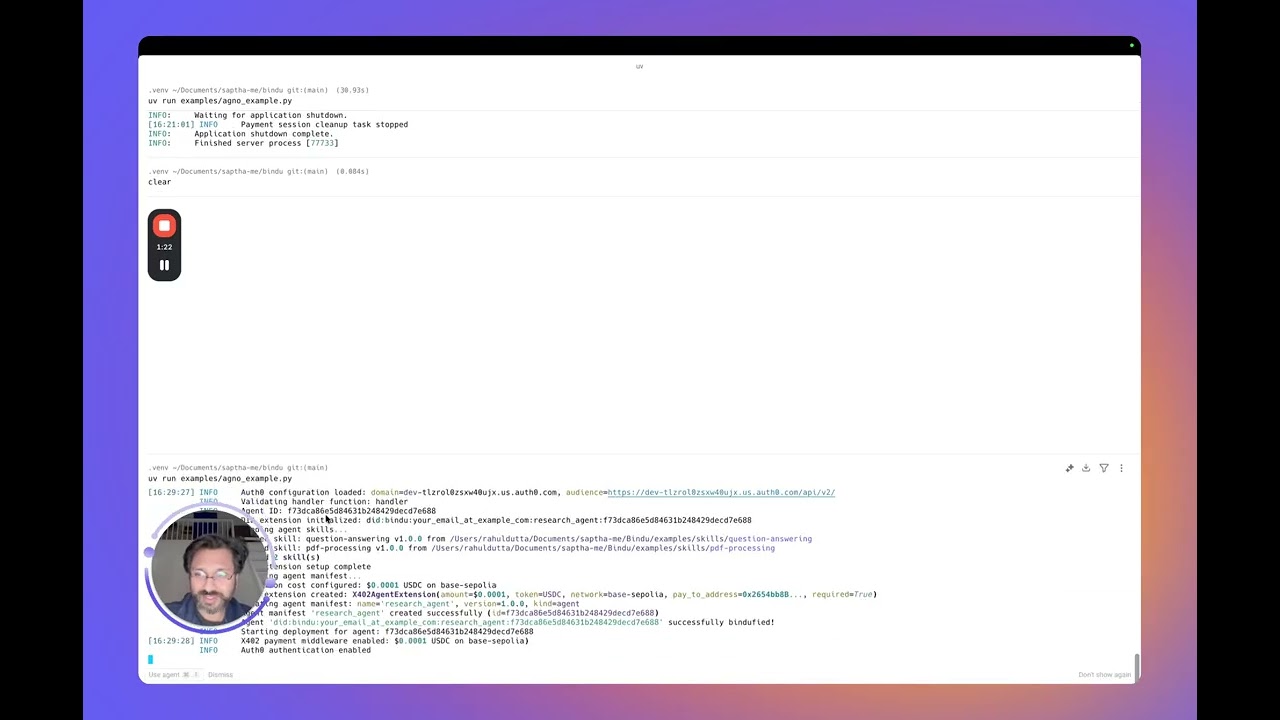

🎥 观看Bindu的实际应用

📋 先决条件

在安装Bindu之前,请确保你已具备以下条件:

- Python 3.12或更高版本 - 在此下载

- UV包管理器 - 安装指南

- API密钥要求:请在环境变量中设置

OPENROUTER_API_KEY、OPENAI_API_KEY或MINIMAX_API_KEY。免费的OpenRouter模型可供测试使用。MiniMax AI提供M2.7模型,具有100万上下文窗口。

验证你的配置

# 检查Python版本

uv run python --version # 应显示3.12或更高版本

# 检查UV是否安装成功

uv --version

📦 安装

用户注意(Git与GitHub Desktop)

在某些Windows系统上,即使已经安装了Git,由于PATH配置问题,在命令提示符中仍可能无法识别Git。

如果遇到此问题,你可以使用GitHub Desktop作为替代方案:

- 从https://desktop.github.com/安装GitHub Desktop。

- 使用你的GitHub账号登录。

- 使用仓库URL克隆仓库: https://github.com/getbindu/Bindu.git

GitHub Desktop允许你无需使用命令行即可完成克隆、分支管理、提交更改和打开拉取请求的操作。

# 安装Bindu

uv add bindu

# 开发模式(若参与Bindu的开发)

# 创建并激活虚拟环境

uv venv --python 3.12.9

source .venv/bin/activate # macOS/Linux

# .venv\Scripts\activate # Windows

uv sync --dev

常见安装问题(点击展开)

| 问题 | 解决方法 |

|---|---|

uv: command not found |

安装UV后重启终端。在Windows上,请使用PowerShell |

Python版本不支持 |

从python.org安装Python 3.12+ |

| 虚拟环境无法激活(Windows) | 使用PowerShell并运行.venv\Scripts\activate |

需要Microsoft Visual C++ |

下载Visual C++ Build Tools |

ModuleNotFoundError |

激活虚拟环境并运行uv sync --dev |

🚀 快速入门

方案1:手动设置

创建你的智能体脚本my_agent.py:

import os

from bindu.penguin.bindufy import bindufy

from agno.agent import Agent

from agno.tools.duckduckgo import DuckDuckGoTools

from agno.models.openai import OpenAIChat

# 定义你的智能体

agent = Agent(

instructions="你是一名研究助理,负责查找并总结信息。",

model=OpenAIChat(id="gpt-4o"),

tools=[DuckDuckGoTools()],

)

# 配置

config = {

"author": "your.email@example.com",

"name": "research_agent",

"description": "一名研究助理智能体",

"deployment": {

"url": os.getenv("BINDU_DEPLOYMENT_URL", "http://localhost:3773"),

"expose": True,

},

"skills": ["skills/question-answering", "skills/pdf-processing"]

}

# 处理函数

def handler(messages: list[dict[str, str]]):

"""处理消息并返回智能体响应。

参数:

messages: 包含对话历史的消息字典列表

返回:

智能体的响应结果

"""

result = agent.run(input=messages)

return result

# 绑定它

bindufy(配置, 处理函数)

# 使用隧道将你的代理暴露到互联网

# bindufy(配置, 处理函数, launch=True)

你的代理现在已经在 deployment.url 中配置的 URL 上线了。

无需更改代码即可设置自定义端口:

# Linux/macOS

export BINDU_PORT=4000

# Windows PowerShell

$env:BINDU_PORT="4000"

当设置了 BINDU_PORT 时,现有使用 http://localhost:3773 的示例会自动被覆盖。

选项 2:TypeScript 代理

同样的模式,不同的语言。创建 index.ts:

import { bindufy } from "@bindu/sdk";

import OpenAI from "openai";

const openai = new OpenAI();

bindufy({

author: "your.email@example.com",

name: "research_agent",

description: "一个研究助理代理",

deployment: { url: "http://localhost:3773", expose: true },

skills: ["skills/question-answering"],

}, async (messages) => {

const response = await openai.chat.completions.create({

model: "gpt-4o",

messages: messages.map(m => ({

role: m.role as "user" | "assistant" | "system",

content: m.content,

})),

});

return response.choices[0].message.content || "";

});

运行它:

npm install @bindu/sdk openai

npx tsx index.ts

SDK 会在后台自动启动 Bindu 核心。你的代理将在 http://localhost:3773 上线——相同的 A2A 协议、相同的 DID,一切都一样。

请参阅 examples/typescript-openai-agent/ 获取完整的可运行示例及设置说明。

选项 3:零配置本地代理

无需设置 Postgres、Redis 或任何云服务即可试用 Bindu。完全在本地运行,使用内存存储和调度器。

python examples/beginner_zero_config_agent.py

选项 4:极简回声代理(测试)

查看极简示例(点击展开)

最小可行的代理:

import os

from bindu.penguin.bindufy import bindufy

def handler(messages):

return [{"role": "assistant", "content": messages[-1]["content"]}]

config = {

"author": "your.email@example.com",

"name": "echo_agent",

"description": "一个用于快速测试的基本回声代理。",

"deployment": {

"url": os.getenv("BINDU_DEPLOYMENT_URL", "http://localhost:3773"),

"expose": True,

},

"skills": []

}

bindufy(config, handler)

# 使用隧道将你的代理暴露到互联网

# bindufy(config, handler, launch=True)

运行代理:

# 启动代理

python examples/echo_agent.py

使用 curl 测试代理(点击展开)

输入:

curl --location 'http://localhost:3773/' \

--header 'Content-Type: application/json' \

--data '{

"jsonrpc": "2.0",

"method": "message/send",

"params": {

"message": {

"role": "user",

"parts": [

{

"kind": "text",

"text": "Quote"

}

],

"kind": "message",

"messageId": "550e8400-e29b-41d4-a716-446655440038",

"contextId": "550e8400-e29b-41d4-a716-446655440038",

"taskId": "550e8400-e29b-41d4-a716-446655440300"

},

"configuration": {

"acceptedOutputModes": [

"application/json"

]

}

},

"id": "550e8400-e29b-41d4-a716-446655440024'

输出:

{

"jsonrpc": "2.0",

"id": "550e8400-e29b-41d4-a716-446655440024",

"result": {

"id": "550e8400-e29b-41d4-a716-446655440301",

"context_id": "550e8400-e29b-41d4-a716-446655440038",

"kind": "task",

"status": {

"state": "submitted",

"timestamp": "2025-12-16T17:10:32.116980+00:00"

},

"history": [

{

"message_id": "550e8400-e29b-41d4-a716-446655440038",

"context_id": "550e8400-e29b-41d4-a716-446655440038",

"task_id": "550e8400-e29b-41d4-a716-446655440301",

"kind": "message",

"parts": [

{

"kind": "text",

"text": "Quote"

}

],

"role": "user"

}

]

}

}

检查任务状态

curl --location 'http://localhost:3773/' \

--header 'Content-Type: application/json' \

--data '{

"jsonrpc": "2.0",

"method": "tasks/get",

"params": {

"taskId": "550e8400-e29b-41d4-a716-446655440301"

},

"id": "550e8400-e29b-41d4-a716-446655440025'

输出:

{

"jsonrpc": "2.0",

"id": "550e8400-e29b-41d4-a716-446655440025",

"result": {

"id": "550e8400-e29b-41d4-a716-446655440301",

"context_id": "550e8400-e29b-41d4-a716-446655440038",

"kind": "task",

"status": {

"state": "completed",

"timestamp": "2025-12-16T17:10:32.122360+00:00"

},

"history": [

{

"message_id": "550e8400-e29b-41d4-a716-446655440038",

"context_id": "550e8400-e29b-41d4-a716-446655440038",

"task_id": "550e8400-e29b-41d4-a716-446655440301",

"kind": "message",

"parts": [

{

"kind": "text",

"text": "Quote"

}

],

"role": "user"

},

{

"role": "assistant",

"parts": [

{

"kind": "text",

"text": "Quote"

}

],

"kind": "message",

"message_id": "2f2c1a8e-68fa-4bb7-91c2-eac223e6650b",

"task_id": "550e8400-e29b-41d4-a716-446655440301",

"context_id": "550e8400-e29b-41d4-a716-446655440038"

}

],

"artifacts": [

{

"artifact_id": "22ac0080-804e-4ff6-b01c-77e6b5aea7e8",

"name": "result",

"parts": [

{

"kind": "text",

"text": "Quote",

"metadata": {

"did.message.signature": "5opJuKrBDW4woezujm88FzTqRDWAB62qD3wxKz96Bt2izfuzsneo3zY7yqHnV77cq3BDKepdcro2puiGTVAB52qf" # pragma: allowlist secret

}

}

]

}

]

}

}

🚀 核心功能

| 功能 | 描述 | 文档 |

|---|---|---|

| 🔐 身份验证 | 使用 Ory Hydra OAuth2 实现安全的 API 访问(开发阶段可选) | 指南 → |

| 💰 支付集成 (X402) | 在执行受保护方法之前,接受 Base 区块链上的 USDC 支付 | 指南 → |

| 💾 PostgreSQL 存储 | 用于生产部署的持久化存储(可选 - 默认使用 InMemoryStorage) | 指南 → |

| 📋 Redis 调度器 | 用于多工作进程部署的分布式任务调度(可选 - 默认使用 InMemoryScheduler) | 指南 → |

| 🎯 技能系统 | 可重用的能力,代理可以宣传并执行这些能力以实现智能任务路由 | 指南 → |

| 🤝 代理协商 | 基于能力的代理选择机制,用于智能编排 | 指南 → |

| 🌐 隧道技术 | 将本地代理暴露到互联网进行测试(仅限本地开发,不适用于生产环境) | 指南 → |

| 📬 推送通知 | 实时 Webhook 通知,用于任务更新,无需轮询 | 指南 → |

| 📊 可观测性与监控 | 使用 OpenTelemetry 和 Sentry 跟踪性能并调试问题 | 指南 → |

| 🔄 重试机制 | 具有指数退避的自动重试功能,使代理更具弹性 | 指南 → |

| 🔑 去中心化标识符 (DIDs) | 用于可验证、安全的代理交互和支付集成的加密身份 | 指南 → |

| 🏥 健康检查与指标 | 使用内置端点监控代理的健康状况和性能 | 指南 → |

| 🌍 语言无关 (gRPC) | 通过 gRPC 适配器,将用 TypeScript、Kotlin、Rust 或任何其他语言编写的代理绑定到 Bindu | 指南 → |

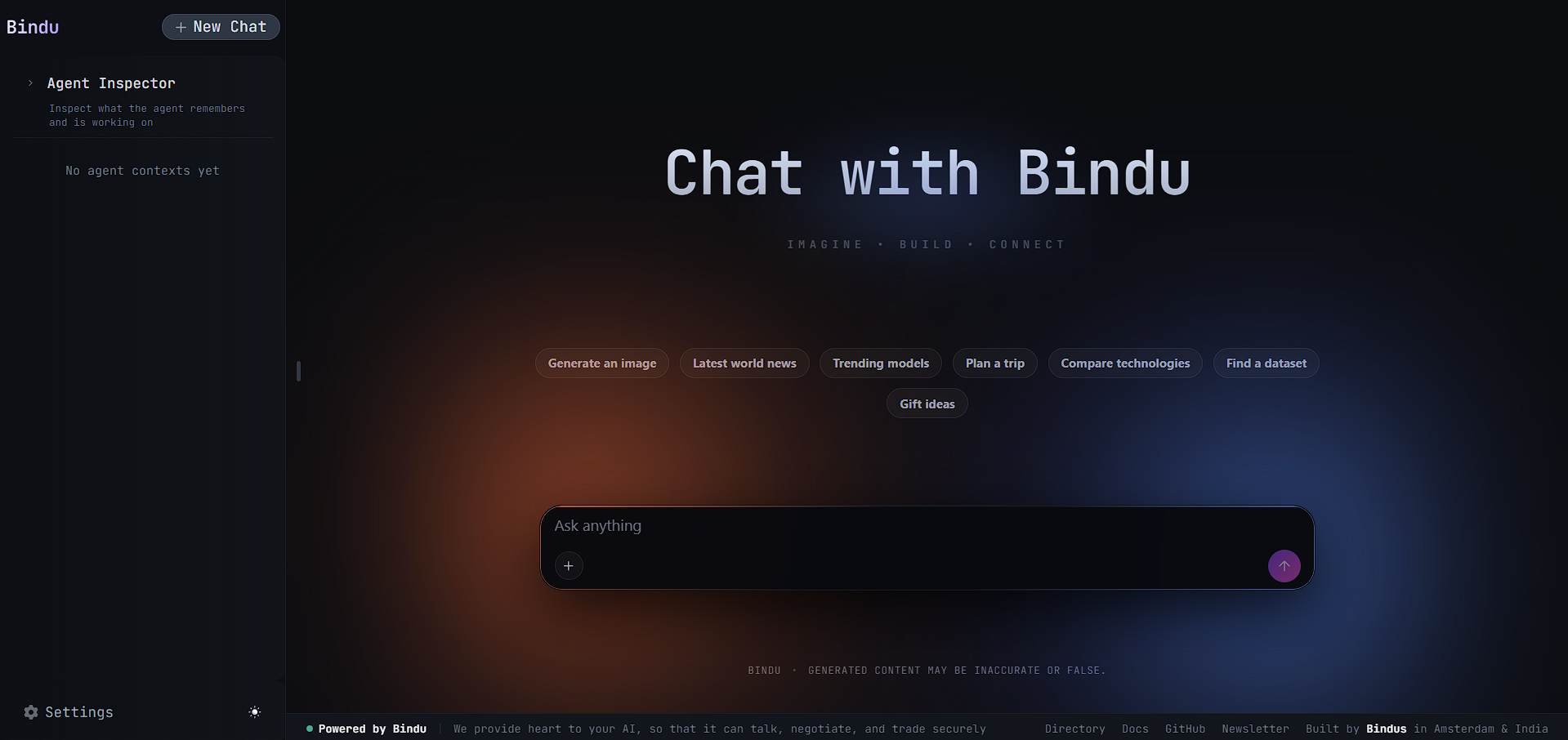

🎨 聊天界面

Bindu 包含一个美观的聊天界面,地址为 http://localhost:5173。导航到 frontend 文件夹并运行 npm run dev 即可启动服务器。

🌐 GetBindu.com

GetBindu.com 是一个公开的 Bindu 代理注册中心——可供更广泛的代理生态系统发现和访问。注册您的代理,使其可供其他代理和编排者使用。

🛠️ 支持的代理框架

Bindu 是 框架无关的,并已在以下框架上进行了测试:

Python:

- AG2(原 AutoGen)

- Agno

- CrewAI

- LangChain

- LlamaIndex

- FastAgent

TypeScript:

- OpenAI SDK

- LangChain.js

Kotlin:

- OpenAI Kotlin SDK

Bindu 通过 gRPC 实现语言无关性——请参阅 docs/grpc/ 了解其工作原理以及如何添加新语言。

兼容的 LLM 提供商:

- OpenRouter — 通过单个 API 访问 100 多种模型

- OpenAI — GPT-4o、GPT-5 等

- MiniMax AI — M2.7(1M 上下文)、M2.5、M2.5-highspeed(204K 上下文)可通过与 OpenAI 兼容的 API 使用

希望与您最喜欢的框架集成吗?请在 Discord 上告诉我们!

🧪 测试

Bindu 的测试覆盖率保持在 70% 以上(目标:80% 以上):

# 单元测试(快速,在提交前运行)

uv run pytest tests/unit/ -v

# E2E gRPC 集成测试(真实服务器,完整往返)

uv run pytest tests/integration/grpc/ -v -m e2e

# 所有测试及覆盖率

uv run pytest -n auto --cov=bindu --cov-report=term-missing

uv run coverage report --skip-covered --fail-under=70

CI 会在每次 PR 提交时自动运行——包括单元测试、E2E gRPC 测试以及 TypeScript SDK 构建验证。详情请参阅 .github/workflows/ci.yml。

🔧 故障排除

常见问题

| 问题 | 解决方案 |

|---|---|

未找到 Python 3.12 |

安装 Python 3.12 或更高版本,并将其添加到 PATH 中,或使用 pyenv |

bindu: 命令未找到 |

激活虚拟环境:source .venv/bin/activate |

端口 3773 已被占用 |

设置 BINDU_PORT=4000,或通过 BINDU_DEPLOYMENT_URL=http://localhost:4000 覆盖 URL |

| pre-commit 失败 | 运行 pre-commit run --all-files |

| 测试失败 | 安装开发依赖:uv sync --dev |

权限拒绝(macOS) |

运行 xattr -cr . 清除扩展属性 |

重置环境:

rm -rf .venv

uv venv --python 3.12.9

uv sync --dev

Windows PowerShell:

Set-ExecutionPolicy RemoteSigned -Scope CurrentUser

🤝 贡献

我们欢迎您的贡献!加入我们的 Discord。选择最适合您贡献的频道。

git clone https://github.com/getbindu/Bindu.git

cd Bindu

uv venv --python 3.12.9

source .venv/bin/activate

uv sync --dev

pre-commit run --all-files

📖 贡献指南

📜 许可证

Bindu 是开源项目,采用 Apache License 2.0 许可证。

💬 社区

我们非常感谢大家的贡献!无论您是修复 bug、改进文档,还是构建演示——您的贡献让 Bindu 更加出色。

- 💬 加入 Discord 以获取讨论和支持

- ⭐ 如果您觉得这个项目有用,请 给仓库点赞!

👥 积极的版主

我们敬业的版主致力于维护一个友好且高效的社区:

Raahul Dutta |

Paras Chamoli |

Chandan |

想成为版主吗?请在 Discord 上联系我们!

🙏 致谢

感谢以下项目:

🌌 愿景

一瞥夜空

}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}}

{{ + + + @ {{

}} | * o + . }}

{{ -O- o . . + {{

}} | _,.-----.,_ o | }}

{{ + * .-'. .'-. -O- {{

}} * .'.-' .---. `'.'. | * }}

{{ . /_.-' / \ .'-.\. {{

}} ' -=*< |-._.- | @ | '-._| >*=- . + }}

{{ -- )-- \`-. \ / .-'/ }}

}} * + `.'. '---' .'.' + o }}

{{ . '-._ _.-' . }}

}} | `~~~~~~~` - --===D @ }}

{{ o -O- * . * + {{

}} | + . + }}

{{ jgs . @ o * {{

}} o * o . }}

{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{{

每一个符号都代表一个智能体——智慧的火花。那个小点就是 Bindu,它是“智能体互联网”中的起点。

NightSky 连接(进行中)

NightSky 能够支持智能体群集运作。每个 Bindu 都是一个标记点,用 A2A、AP2 和 X402 的通用语言来标注智能体。这些智能体可以部署在任何地方——笔记本电脑、云端或集群——但它们使用相同的协议进行通信,从设计上就彼此信任,并作为一个统一的分布式心智协同工作。

🗺️ 路线图

- gRPC 传输 + 语言无关 SDKs(TypeScript、Kotlin)

- 将测试覆盖率提升至 80%(进行中)

- 完整支持 AP2

- DSPy 集成(进行中)

- Rust SDK

- 支持 MLTS

- 与其他促进者一起支持 X402

我们将使这一智能体生态系统更加完善,而我们也确实需要您的帮助。

🎓 研讨会

- [AI Native 实战:智能体交响曲](https://www.meetup.com/ai-native-Amsterdam && India/events/311066899/) - 幻灯片

⭐ 星标历史

由来自阿姆斯特丹和印度的团队用心打造

快乐的 Bindu!🌻🚀✨

从创意到“智能体互联网”,仅需两分钟。

属于你的智能体,属于你的框架,通用的协议。

⭐ 在 GitHub 上为我们加星 • 💬 加入 Discord • 🌻 阅读文档

“我们相信向日葵理论——共同挺立,为‘智能体互联网’带来希望与光明。”

版本历史

v2026.12.52026/03/192026.9.42026/02/252026.9.2.22026/02/232026.9.2.12026/02/222026.9.22026/02/222026.8.7.22026/02/212026.8.7.12026/02/212026.8.52026/02/192026.7.32026/02/102026.6.62026/02/062026.3.52026/01/222026.3.32026/01/19v2026.3.32026/01/19v2026.3.22026/01/18v2026.1.192026/01/18v2026.1.202026/01/18v0.3.152025/10/23常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。