VAR

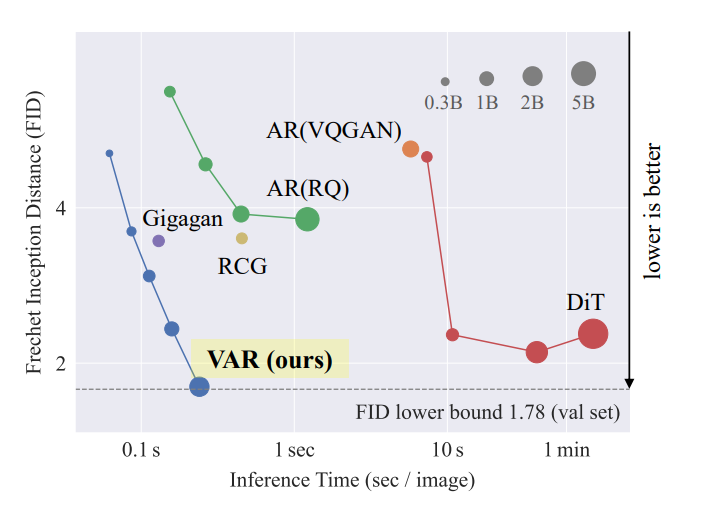

VAR 是一款荣获 NeurIPS 2024 最佳论文奖的视觉自回归建模工具,旨在通过“下一尺度预测”机制实现高质量的图像生成。它打破了以往扩散模型(Diffusion)在图像生成领域的统治地位,证明了类似 GPT 的自回归架构在视觉任务中同样具备卓越性能,甚至能超越扩散模型。

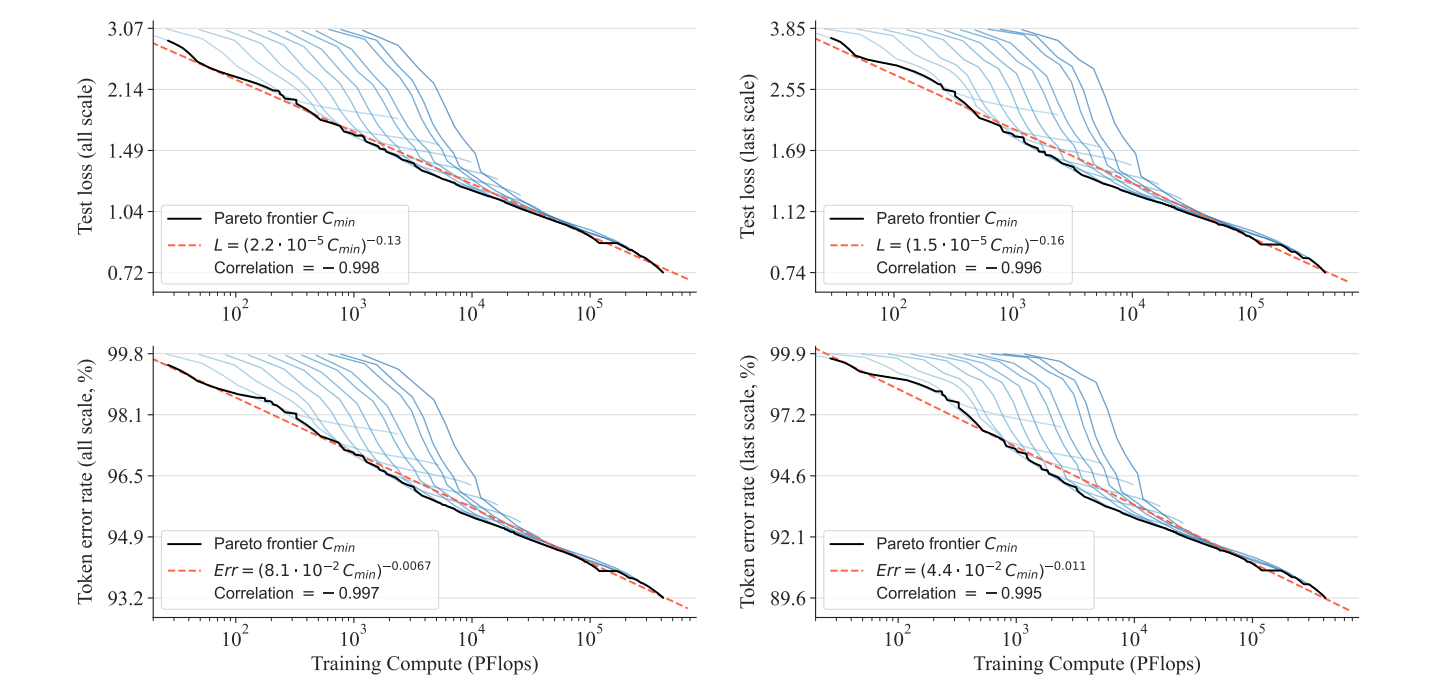

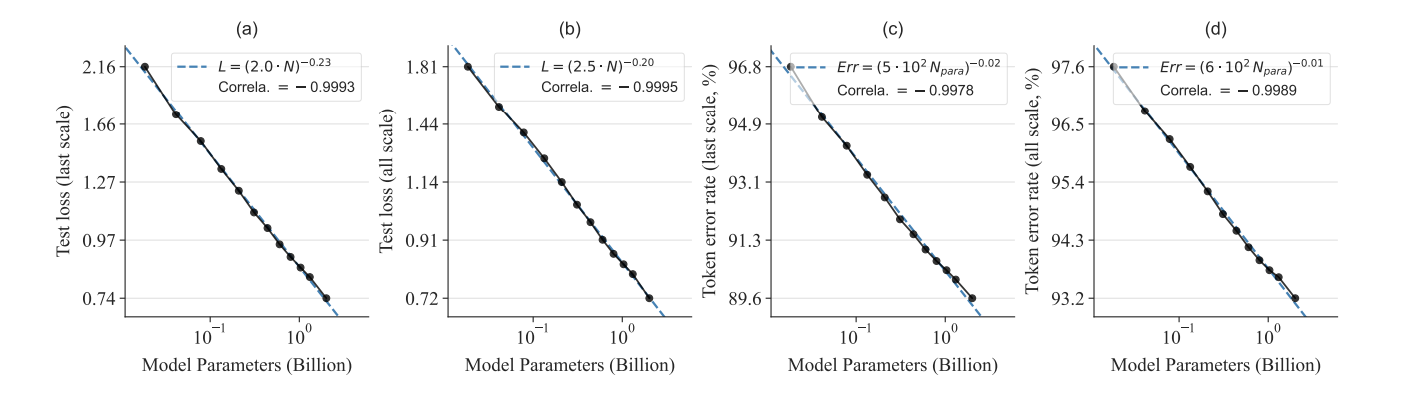

VAR 主要解决了传统自回归方法在图像生成上扩展性不足、质量难以匹敌扩散模型的痛点。通过引入创新的尺度预测策略,VAR 不仅实现了状态最先进的生成效果,还展现出了清晰的“缩放定律”,即随着模型规模增大,生成质量稳步提升。其代码库设计极度简洁且用户友好,大幅降低了复现和研究顶尖视觉生成技术的门槛。

这款工具非常适合人工智能研究人员、开发者以及对前沿生成式 AI 感兴趣的技术爱好者。研究人员可利用它探索视觉大模型的缩放规律;开发者能基于其简洁的架构快速构建或优化自己的图像生成应用;而技术爱好者则可以通过官方提供的演示平台,直观体验从文本到图像的生成过程。VAR 的出现标志着视觉生成领域迈向了新的里程碑,为后续多模态大模型的发展提供了强有力的基座。

使用场景

某电商平台的算法团队正致力于为海量商品目录自动生成高分辨率、细节丰富的展示图,以替代昂贵且低效的人工摄影流程。

没有 VAR 时

- 生成质量瓶颈:依赖传统的扩散模型(Diffusion),在处理复杂纹理(如织物细节、金属光泽)时容易模糊,难以达到商业级印刷标准。

- 推理速度缓慢:扩散模型需要数十甚至上百步的去噪迭代才能输出一张图,导致批量生成数万张商品图时耗时极长,算力成本高昂。

- 扩展性受限:想要提升分辨率或增加训练数据规模时,模型性能往往遭遇瓶颈,无法像语言模型那样通过简单扩大规模来显著增强效果。

- 架构复杂难调:现有方案代码库庞大且依赖繁琐的调度器配置,开发人员调试新策略或复现前沿论文成果的难度极大。

使用 VAR 后

- 画质显著跃升:利用 VAR 的“下一尺度预测”机制,生成的图像在 ImageNet 基准上超越扩散模型,商品材质纹理清晰锐利,直接满足高清广告需求。

- 生成效率倍增:采用类似 GPT 的自回归生成方式,大幅减少了推理步数,将单图生成时间缩短数倍,快速完成大规模商品图库的构建。

- 享受缩放红利:验证了视觉生成的缩放定律,团队只需增加模型参数量和训练数据,即可线性获得更强大的生成能力,无需重新设计架构。

- 开发极简高效:VAR 提供了超简洁的代码实现,工程师能快速部署并基于此框架定制垂直领域的微调模型,大幅降低研发门槛。

VAR 通过引入自回归范式打破了扩散模型的质量与效率天花板,让高质量视觉内容的规模化生产变得像文本生成一样简单可控。

运行环境要求

- Linux

- 必需 NVIDIA GPU

- 训练需多卡环境(示例命令使用 8 卡),支持 Flash Attention 和 xformers 加速

- 推理显存需求视模型大小而定(最大模型 2.3B 参数),建议 16GB+ 显存

未说明(建议 32GB+ 以处理大型模型和 ImageNet 数据集)

快速开始

VAR:一种新的视觉生成方法将GPT类模型推向超越扩散模型的新高度🚀,并观察到规模定律📈

NeurIPS 2024最佳论文

新闻

- 2025年11月: 我们发布了基于VAR和Infinity的文生视频模型InfinityStar,请查看Infinity⭐️。

- 2025年11月: 🎉 InfinityStar被接受为NeurIPS 2025口头报告。

- 2025年4月: 🎉 Infinity被接受为CVPR 2025口头报告。

- 2024年12月: 🏆 VAR荣获NeurIPS 2024最佳论文奖。

- 2024年12月: 🔥 我们发布了基于VAR的文生图研究,请查看Infinity。

- 2024年9月: VAR被接受为NeurIPS 2024口头报告。

- 2024年4月: 视觉自回归建模发布。

🕹️ 试用并玩转VAR!

我们提供一个demo网站,供您体验VAR模型并交互式生成图片。尽情享受视觉自回归建模的乐趣吧!

我们提供一个demo网站,供您体验VAR文生图并交互式生成图片。尽情享受视觉自回归建模的乐趣吧!

我们还提供了demo_sample.ipynb,供您了解VAR的更多技术细节。

最新进展?

🔥 引入VAR:自回归视觉生成的新范式✨:

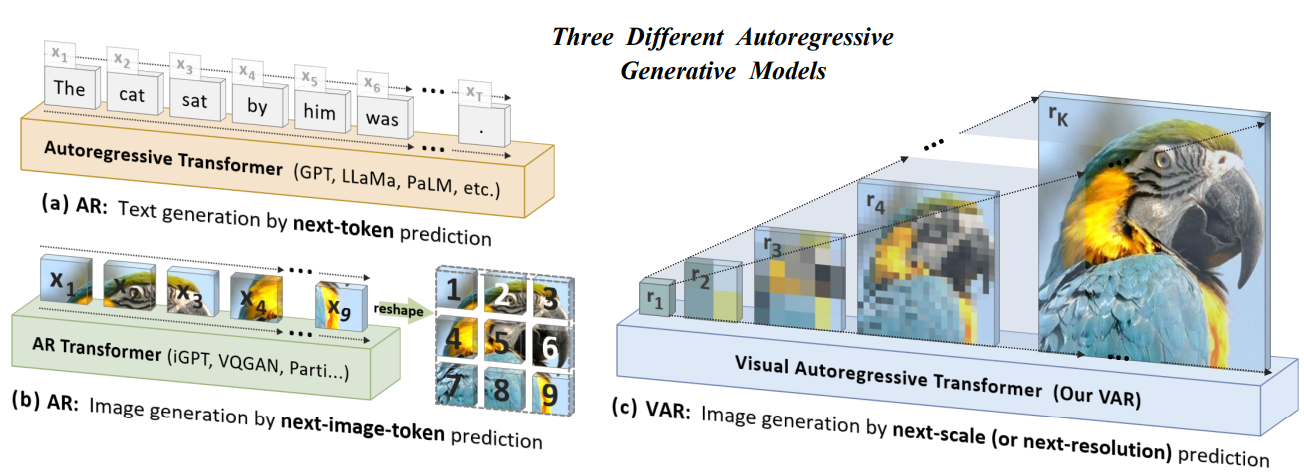

视觉自回归建模(VAR)将图像上的自回归学习重新定义为从粗到细的“下一尺度预测”或“下一分辨率预测”,这与标准的光栅扫描“下一 token 预测”截然不同。

🔥 首次,GPT类自回归模型超越扩散模型🚀:

🔥 在VAR变换器中发现幂律规模定律📈:

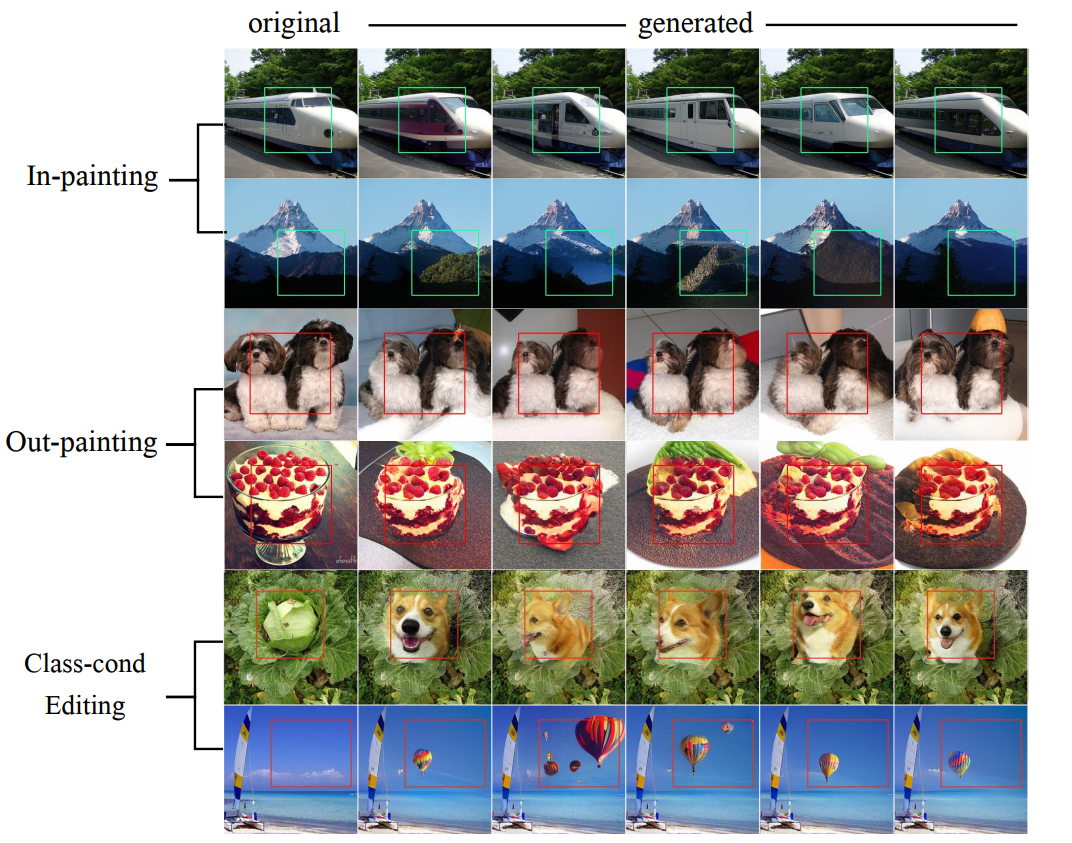

🔥 零样本泛化能力🛠️:

如需深入了解我们的分析、讨论和评估,请参阅我们的论文。

VAR动物园

我们提供了VAR模型供您试用,这些模型可在

| 模型 | 分辨率 | FID | 相对成本 | 参数量 | Hugging Face权重🤗 |

|---|---|---|---|---|---|

| VAR-d16 | 256 | 3.55 | 0.4 | 310M | var_d16.pth |

| VAR-d20 | 256 | 2.95 | 0.5 | 600M | var_d20.pth |

| VAR-d24 | 256 | 2.33 | 0.6 | 1.0B | var_d24.pth |

| VAR-d30 | 256 | 1.97 | 1 | 2.0B | var_d30.pth |

| VAR-d30-re | 256 | 1.80 | 1 | 2.0B | var_d30.pth |

| VAR-d36 | 512 | 2.63 | - | 2.3B | var_d36.pth |

您可以通过demo_sample.ipynb中的代码加载这些模型来生成图片。请注意:您需要先下载vae_ch160v4096z32.pth。

安装

安装

torch>=2.0.0。通过

pip3 install -r requirements.txt安装其他 pip 包。准备 ImageNet 数据集

假设 ImageNet 数据集位于 `/path/to/imagenet`,其目录结构应如下所示:

/path/to/imagenet/: train/: n01440764: many_images.JPEG ... n01443537: many_images.JPEG ... val/: n01440764: ILSVRC2012_val_00000293.JPEG ... n01443537: ILSVRC2012_val_00000236.JPEG ...注意:训练脚本需要传递参数

--data_path=/path/to/imagenet。(可选)安装并编译

flash-attn和xformers以加速注意力计算。如果已安装,我们的代码会自动使用它们。详情请参阅 models/basic_var.py#L15-L30。

训练脚本

要在 ImageNet 256x256 或 512x512 数据集上训练 VAR-{d16, d20, d24, d30, d36-s},可以运行以下命令:

# d16, 256x256

torchrun --nproc_per_node=8 --nnodes=... --node_rank=... --master_addr=... --master_port=... train.py \

--depth=16 --bs=768 --ep=200 --fp16=1 --alng=1e-3 --wpe=0.1

# d20, 256x256

torchrun --nproc_per_node=8 --nnodes=... --node_rank=... --master_addr=... --master_port=... train.py \

--depth=20 --bs=768 --ep=250 --fp16=1 --alng=1e-3 --wpe=0.1

# d24, 256x256

torchrun --nproc_per_node=8 --nnodes=... --node_rank=... --master_addr=... --master_port=... train.py \

--depth=24 --bs=768 --ep=350 --tblr=8e-5 --fp16=1 --alng=1e-4 --wpe=0.01

# d30, 256x256

torchrun --nproc_per_node=8 --nnodes=... --node_rank=... --master_addr=... --master_port=... train.py \

--depth=30 --bs=1024 --ep=350 --tblr=8e-5 --fp16=1 --alng=1e-5 --wpe=0.01 --twde=0.08

# d36-s, 512x512 (-s 表示 saln=1,共享 AdaLN)

torchrun --nproc_per_node=8 --nnodes=... --node_rank=... --master_addr=... --master_port=... train.py \

--depth=36 --saln=1 --pn=512 --bs=768 --ep=350 --tblr=8e-5 --fp16=1 --alng=5e-6 --wpe=0.01 --twde=0.08

系统将创建一个名为 local_output 的文件夹,用于保存检查点和日志。您可以通过查看 local_output/log.txt 和 local_output/stdout.txt 中的日志,或使用 tensorboard --logdir=local_output/ 来监控训练过程。

如果实验中断,只需重新运行该命令,训练将自动从上次的检查点继续进行,即从 local_output/ckpt*.pth 文件中恢复(详见 utils/misc.py#L344-L357)。

采样与零样本推理

对于 FID 评估,使用 var.autoregressive_infer_cfg(..., cfg=1.5, top_p=0.96, top_k=900, more_smooth=False) 生成 50,000 张图像(每类 50 张),并将其保存为 PNG 格式的文件(而非 JPEG),存放在一个文件夹中。然后使用 utils/misc.py#L344 中的 create_npz_from_sample_folder(sample_folder) 将这些图像打包成 .npz 文件。

接着,使用 OpenAI 的 FID 评估工具包以及参考真值 .npz 文件——256x256 或 512x512,来评估 FID、IS、精确度和召回率。

请注意,这里使用了相对较小的 cfg=1.5 参数,以在图像质量和多样性之间取得平衡。您可以将其调整为 cfg=5.0,或者使用 autoregressive_infer_cfg(..., more_smooth=True) 进行采样,以获得更好的视觉质量。采样脚本稍后会提供。

第三方使用与研究

在这一段中,我们将交叉链接使用 VAR 并报告结果的第三方仓库或研究。您可以通过提交 issue 告知我们

(请注意,请在您的新仓库中报告准确率数值,并提供训练好的模型,以便他人更好地理解正确性和模型行为)

| 时间 | 研究 | 链接 |

|---|---|---|

| [5/12/2025] | [ICML 2025]通过分数最大化实现连续视觉自回归生成 | https://github.com/shaochenze/EAR |

| [5/8/2025] | 用于模型无关联邦MRI重建的生成性自回归Transformer | https://github.com/icon-lab/FedGAT |

| [4/7/2025] | FastVAR:基于缓存标记剪枝的线性视觉自回归建模 | https://github.com/csguoh/FastVAR |

| [4/3/2025] | VARGPT-v1.1:通过迭代指令微调和强化学习改进视觉自回归大型统一模型 | https://github.com/VARGPT-family/VARGPT-v1.1 |

| [3/31/2025] | 使用视觉自回归模型进行无训练文本引导图像编辑 | https://github.com/wyf0912/AREdit |

| [3/17/2025] | 下一代自回归模型是零样本单张图像对象视图合成器 | https://github.com/Shiran-Yuan/ArchonView |

| [3/14/2025] | Safe-VAR:用于文本到图像生成式水印的安全视觉自回归模型 | https://arxiv.org/abs/2503.11324 |

| [3/3/2025] | [ICML 2025]直接判别优化:你的基于似然的视觉生成模型其实是一个GAN判别器 | https://research.nvidia.com/labs/dir/ddo/ |

| [2/28/2025] | 通过下一代掩码预测进行自回归医学图像分割 | https://arxiv.org/abs/2502.20784 |

| [2/27/2025] | FlexVAR:无需残差预测的灵活视觉自回归建模 | https://github.com/jiaosiyu1999/FlexVAR |

| [2/17/2025] | MARS:用于3D形状细节化的网格自回归模型 | https://arxiv.org/abs/2502.11390 |

| [1/31/2025] | [ICML 2025]用于图像超分辨率的视觉自回归建模 | https://github.com/quyp2000/VARSR |

| [1/21/2025] | VARGPT:在视觉自回归多模态大型语言模型中实现统一的理解与生成 | https://github.com/VARGPT-family/VARGPT |

| [1/26/2025] | [ICML 2025]无指导的视觉生成 | https://github.com/thu-ml/GFT |

| [12/30/2024] | 向多模态智能迈进的下一个标记预测 | https://github.com/LMM101/Awesome-Multimodal-Next-Token-Prediction |

| [12/30/2024] | Varformer:为图像修复适配VAR的生成先验 | https://arxiv.org/abs/2412.21063 |

| [12/22/2024] | [ICLR 2025]蒸馏解码1:利用流匹配对图像自回归模型进行一步采样 | https://github.com/imagination-research/distilled-decoding |

| [12/19/2024] | FlowAR:尺度级自回归图像生成与流匹配相结合 | https://github.com/OliverRensu/FlowAR |

| [12/13/2024] | 512字节内的3D表示:变分标记器是自回归3D生成的关键 | https://github.com/sparse-mvs-2/VAT |

| [12/9/2024] | CARP:通过粗细结合的自回归预测进行视觉运动策略学习 | https://carp-robot.github.io/ |

| [12/5/2024] | [CVPR 2025]Infinity ∞:为高分辨率图像合成扩展位级自回归建模 | https://github.com/FoundationVision/Infinity |

| [12/5/2024] | [CVPR 2025]Switti:为文本到图像合成设计尺度级Transformer | https://github.com/yandex-research/switti |

| [12/4/2024] | [CVPR 2025]TokenFlow🚀:用于多模态理解和生成的统一图像标记器 | https://github.com/ByteFlow-AI/TokenFlow |

| [12/3/2024] | XQ-GAN🚀:一个用于自回归生成的开源图像标记框架 | https://github.com/lxa9867/ImageFolder |

| [11/28/2024] | [CVPR 2025]CoDe:协作解码使视觉自回归建模更高效 | https://github.com/czg1225/CoDe |

| [11/28/2024] | [CVPR 2025]可扩展的自回归单目深度估计 | https://arxiv.org/abs/2411.11361 |

| [11/27/2024] | [CVPR 2025]SAR3D:通过多尺度3D VQVAE实现自回归3D物体生成与理解 | https://github.com/cyw-3d/SAR3D |

| [11/26/2024] | LiteVAR:通过高效的注意力机制和量化压缩视觉自回归建模 | https://arxiv.org/abs/2411.17178 |

| [11/15/2024] | M-VAR:解耦的尺度级自回归建模用于高质量图像生成 | https://github.com/OliverRensu/MVAR |

| [10/14/2024] | [ICLR 2025]HART:使用混合自回归Transformer实现高效视觉生成 | https://github.com/mit-han-lab/hart |

| [10/12/2024] | [ICLR 2025口头报告]通过条件对比对齐,迈向无指导的AR视觉生成 | https://github.com/thu-ml/CCA |

| [10/3/2024] | [ICLR 2025]ImageFolder🚀:利用折叠标记进行自回归图像生成 | https://github.com/lxa9867/ImageFolder |

| [07/25/2024] | ControlVAR:探索可控的视觉自回归建模 | https://github.com/lxa9867/ControlVAR |

| [07/3/2024] | VAR-CLIP:基于视觉自回归建模的文本到图像生成器 | https://github.com/daixiangzi/VAR-CLIP |

| [06/16/2024] | STAR:通过自回归表示实现尺度级文本到图像生成 | https://arxiv.org/abs/2406.10797 |

许可证

本项目采用 MIT 许可证授权——详情请参阅 LICENSE 文件。

引用

如果我们的工作对您的研究有所帮助,欢迎您为我们点个赞 ⭐ 或按以下格式引用我们:

@Article{VAR,

title={视觉自回归建模:通过下一尺度预测实现可扩展的图像生成},

author={田凯宇、蒋毅、袁泽寰、彭冰悦、王立伟},

year={2024},

eprint={2404.02905},

archivePrefix={arXiv},

primaryClass={cs.CV}

}

@misc{Infinity,

title={Infinity:面向高分辨率图像合成的位级自回归建模扩展},

author={韩健、刘金来、蒋毅、闫斌、张宇奇、袁泽寰、彭冰悦、刘晓兵},

year={2024},

eprint={2412.04431},

archivePrefix={arXiv},

primaryClass={cs.CV},

url={https://arxiv.org/abs/2412.04431},

}

常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

-32B1B4?logo=data%3Aimage%2Fsvg%2Bxml%3Bbase64%2CPHN2ZyB3aWR0aD0iNjA2IiBoZWlnaHQ9IjYwNiIgeG1sbnM9Imh0dHA6Ly93d3cudzMub3JnLzIwMDAvc3ZnIiB4bWxuczp4bGluaz0iaHR0cDovL3d3dy53My5vcmcvMTk5OS94bGluayIgb3ZlcmZsb3c9ImhpZGRlbiI%2BPGRlZnM%2BPGNsaXBQYXRoIGlkPSJjbGlwMCI%2BPHJlY3QgeD0iLTEiIHk9Ii0xIiB3aWR0aD0iNjA2IiBoZWlnaHQ9IjYwNiIvPjwvY2xpcFBhdGg%2BPC9kZWZzPjxnIGNsaXAtcGF0aD0idXJsKCNjbGlwMCkiIHRyYW5zZm9ybT0idHJhbnNsYXRlKDEgMSkiPjxyZWN0IHg9IjUyOSIgeT0iNjYiIHdpZHRoPSI1NiIgaGVpZ2h0PSI0NzMiIGZpbGw9IiM0NEYyRjYiLz48cmVjdCB4PSIxOSIgeT0iNjYiIHdpZHRoPSI1NyIgaGVpZ2h0PSI0NzMiIGZpbGw9IiM0NEYyRjYiLz48cmVjdCB4PSIyNzQiIHk9IjE1MSIgd2lkdGg9IjU3IiBoZWlnaHQ9IjMwMiIgZmlsbD0iIzQ0RjJGNiIvPjxyZWN0IHg9IjEwNCIgeT0iMTUxIiB3aWR0aD0iNTciIGhlaWdodD0iMzAyIiBmaWxsPSIjNDRGMkY2Ii8%2BPHJlY3QgeD0iNDQ0IiB5PSIxNTEiIHdpZHRoPSI1NyIgaGVpZ2h0PSIzMDIiIGZpbGw9IiM0NEYyRjYiLz48cmVjdCB4PSIzNTkiIHk9IjE3MCIgd2lkdGg9IjU6IiBoZWlnaHQ9IjI2NCIgZmlsbD0iIzQ0RjJGNiIvPjxyZWN0IHg9IjE4OCIgeT0iMTcwIiB3aWR0aD0iNTciIGhlaWdodD0iMjY0IiBmaWxsPSIjNDRGMkY2Ii8%2BPHJlY3QgeD0iNzYiIHk9IjY6IiB3aWR0aD0iNDciIGhlaWdodD0iNTciIGZpbGw9IiM0NEYyRjYiLz48cmVjdCB4PSI0ODIiIHk9IjY6IiB3aWR0aD0iNDciIGhlaWdodD0iNTciIGZpbGw9IiM0NEYyRjYiLz48cmVjdCB4PSI3YiIHk9IjQ4MiIgd2lkdGg9IjQ7IiBoZWlnaHQ9IjU3IiBmaWxsPSIjNDRGMkY2Ii8%2BPC9nPjwvc3ZnPg%3D%3D)