production-grade-agentic-system

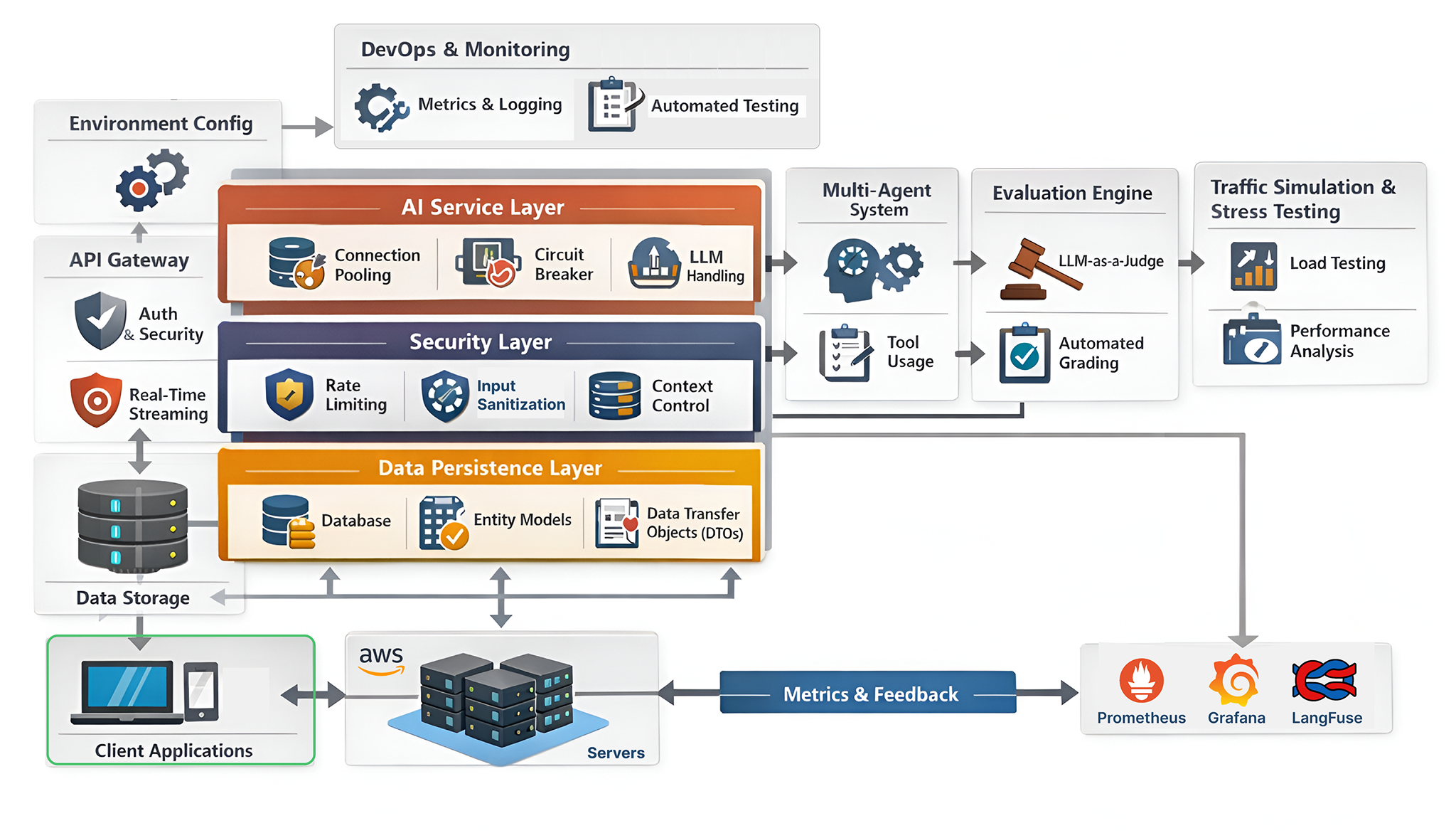

production-grade-agentic-system 是一个专为构建企业级智能体(Agentic AI)系统设计的开源架构框架。它不仅仅是一个简单的代码示例,而是提供了一套包含七大核心层的完整解决方案,旨在帮助开发者将实验性的 AI 智能体转化为稳定、安全且可扩展的生产环境应用。

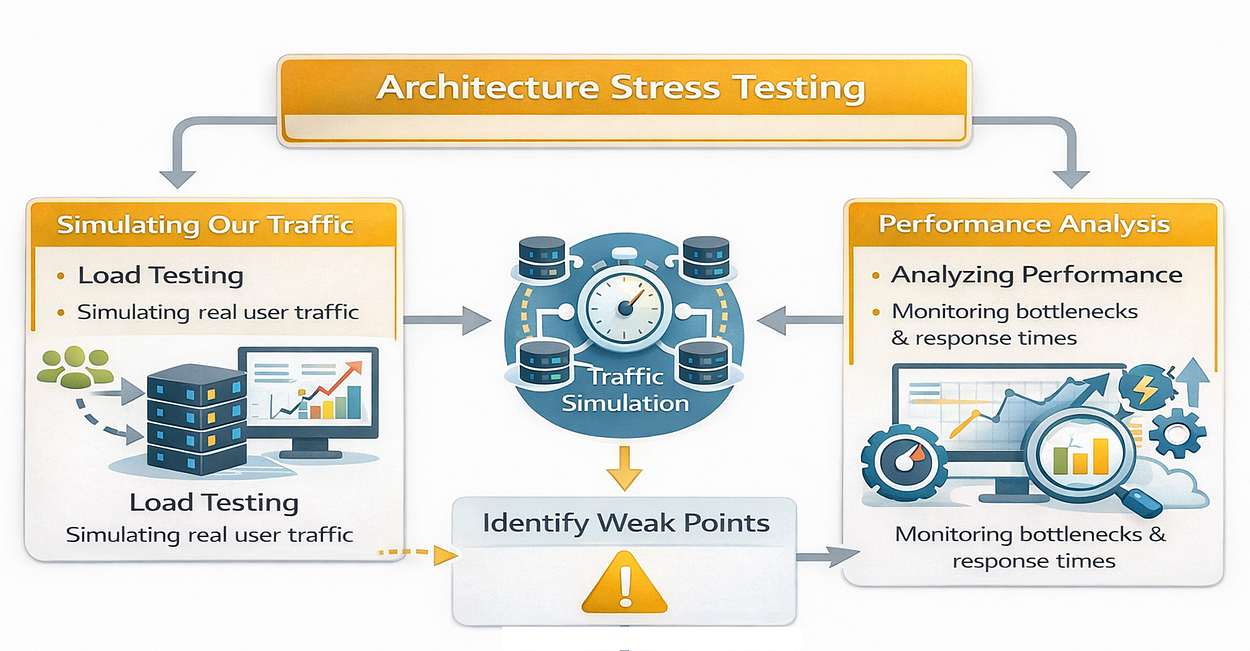

在实际开发中,许多团队面临智能体行为不可控、系统缺乏容错机制以及难以监控性能等挑战。该项目通过模块化架构解决了这些痛点,涵盖了从数据持久化、安全防御(如速率限制和输入清洗)、服务层弹性处理(如熔断机制和连接池),到多智能体协作、API 网关集成及可观测性测试的全链路需求。其独特的技术亮点在于引入了"LLM-as-a-Judge"自动化评估框架和架构压力测试方案,确保系统在真实负载下的可靠性与推理准确性。

这套工具非常适合正在构建复杂多智能体系统的后端工程师、AI 架构师以及希望将 AI 能力落地到自有基础设施的技术团队。如果你需要一套经过验证的蓝图来规避生产环境中的常见陷阱,并自信地向客户交付高可用的 AI 服务,production-grade-agentic-system 提供了清晰的实施路径和坚实的代码基础。

使用场景

某金融科技公司正在构建一个面向高净值客户的智能投顾系统,需要多个 AI 代理协同处理市场分析、风险评估和交易执行等复杂任务。

没有 production-grade-agentic-system 时

- 系统脆弱易崩:缺乏熔断机制和 LLM 不可用处理逻辑,一旦模型服务波动,整个投顾流程直接中断,导致客户交易失败。

- 安全隐患突出:缺少统一的速率限制和输入清洗层,恶意用户可通过高频请求耗尽资源或注入有害指令,危及资金安全。

- 状态记忆混乱:多轮对话中缺乏结构化长期记忆管理,代理经常“遗忘”客户之前的风险偏好,给出自相矛盾的投资建议。

- 黑盒难以运维:没有内置的可观测性指标和自动化评估框架,团队无法量化代理的推理准确性,故障排查全靠猜。

- 代码维护噩梦:单体架构导致业务逻辑耦合严重,每次新增一个分析工具都要重构大量代码,上线周期长达数周。

使用 production-grade-agentic-system 后

- 高可用保障:通过服务层的连接池与电路断路器设计,即使底层模型短暂抖动,系统也能自动降级或重试,确保交易链路 99.9% 在线。

- 纵深防御体系:安全层内置的速率限制与上下文 sanitization 检查,有效拦截了异常流量和注入攻击,守住合规底线。

- 记忆一致性强:利用数据持久化层和长期记忆集成,代理能精准回溯客户历史画像,跨多轮对话保持策略连贯性。

- 全链路可观测:借助评估框架和中间件测试,团队能实时监控代理行为指标,快速定位推理偏差并自动打分优化。

- 模块化敏捷开发:基于分层架构将工具调用、提示词和路由解耦,新策略模块可独立开发测试,上线时间缩短至几天。

production-grade-agentic-system 通过七层核心架构,将原本脆弱的实验性 Demo 转化为安全、可靠且可规模化的企业级智能投顾平台。

运行环境要求

- 未说明

未说明

未说明

快速开始

生产级智能体AI系统

现代的智能体AI系统,无论是在开发、预发布还是生产环境中运行,都不是由单一服务构建而成,而是由一组定义明确的架构层组成。每一层负责特定的关注点,例如智能体编排、内存管理、安全控制、可扩展性以及故障处理。一个生产级的智能体系统通常会将这些层组合起来,以确保在真实的工作负载下,智能体能够保持可靠、可观测性和安全性。

生产级智能体系统(由Fareed Khan创作)

生产级智能体系统(由Fareed Khan创作)

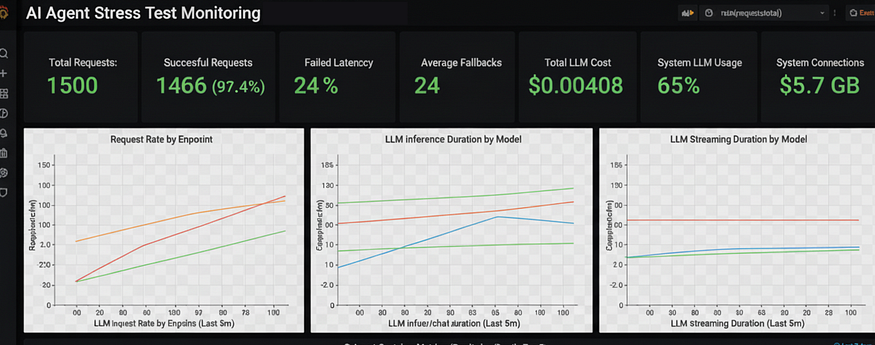

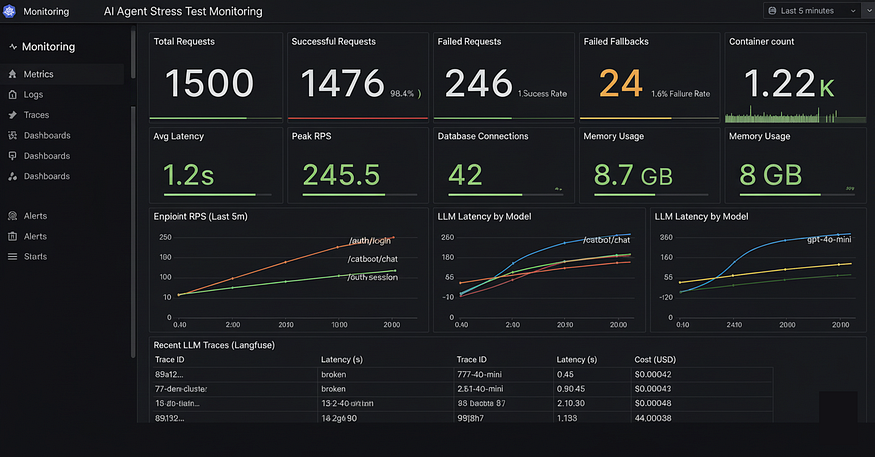

在智能体系统中,有两个关键方面需要持续监控。

- 第一是智能体行为,包括推理准确性、工具使用正确性、记忆一致性、安全边界以及跨多轮和多智能体的上下文管理。

- 第二是系统可靠性和性能,涵盖延迟、可用性、吞吐量、成本效益、故障恢复以及整个架构中的依赖健康状况。

这两者对于大规模可靠地运行多智能体系统都至关重要。

在本篇博客中,我们将构建部署生产就绪智能体系统所需的所有核心架构层,以便团队能够自信地在自己的基础设施中或为客户部署AI智能体。

你可以通过以下命令克隆代码库:

git clone https://github.com/FareedKhan-dev/production-grade-agentic-system

cd production-grade-agentic-system

目录

创建模块化代码库

通常,Python项目一开始规模较小,但随着发展会逐渐变得混乱。在构建生产级系统时,开发者一般会采用模块化架构方法。

这意味着将应用程序的不同组件分离到不同的模块中。这样做可以更轻松地维护、测试和更新各个部分,而不会影响整个系统。

让我们为我们的AI系统创建一个结构化的目录布局:

├── app/ # 主应用源代码

│ ├── api/ # API路由处理器

│ │ └── v1/ # 版本化API(v1端点)

│ ├── core/ # 核心应用配置与逻辑

│ │ ├── langgraph/ # AI智能体/LangGraph逻辑

│ │ │ └── tools/ # 智能体工具(搜索、行动等)

│ │ └── prompts/ # AI系统与智能体提示词

│ ├── models/ # 数据库模型(SQLModel)

│ ├── schemas/ # 数据验证模式(Pydantic)

│ ├── services/ # 业务逻辑层

│ └── utils/ # 共享辅助工具

├── evals/ # AI评估框架

│ └── metrics/ # 评估指标与标准

│ └── prompts/ # LLM作为评判者的提示词定义

├── grafana/ # Grafana可观测性配置

│ └── dashboards/ # Grafana仪表盘

│ └── json/ # 仪表盘JSON定义

├── prometheus/ # Prometheus监控配置

├── scripts/ # DevOps与本地自动化脚本

│ └── rules/ # 项目规则用于Cursor

└── .github/ # GitHub配置

└── workflows/ # GitHub Actions CI/CD工作流

这种目录结构乍一看可能有些复杂,但我们遵循的是许多智能体系统甚至纯软件工程中通用的最佳实践模式。 每个文件夹都有其特定用途:

app/:包含主应用程序代码,包括API路由、核心逻辑、数据库模型和实用函数。evals/:存放用于评估AI性能的评估框架,使用各种指标和提示词。grafana/和prometheus/:存储监控和可观测性工具的配置文件。

你可以看到许多组件都有自己的子文件夹(如langgraph/和tools/),以进一步分离关注点。我们将在接下来的章节中逐步构建这些模块,并理解每个部分的重要性。

管理依赖关系

构建生产级AI系统的第一步是制定依赖管理策略。通常,小型项目会从简单的requirements.txt文件开始,而对于更复杂的项目,则需要使用pyproject.toml,因为它支持更高级的功能,比如依赖解析、版本管理和构建系统规范。

让我们为项目创建一个pyproject.toml文件,并开始添加依赖项和其他配置。

# ==========================

# 项目元数据

# ==========================

# 根据 PEP 621 定义的 Python 项目基本信息

[project]

name = "我的智能体AI系统" # 发布/包名称

version = "0.1.0" # 当前项目版本(建议使用语义版本控制)

description = "将其部署为 SASS" # 在包索引上显示的简短描述

readme = "README.md" # 用于长描述的 README 文件

requires-python = ">=3.13" # 支持的最低 Python 版本

第一部分定义了项目的元数据,如名称、版本、描述和 Python 版本要求。这些信息在将包发布到 PyPI 等包索引时非常有用。

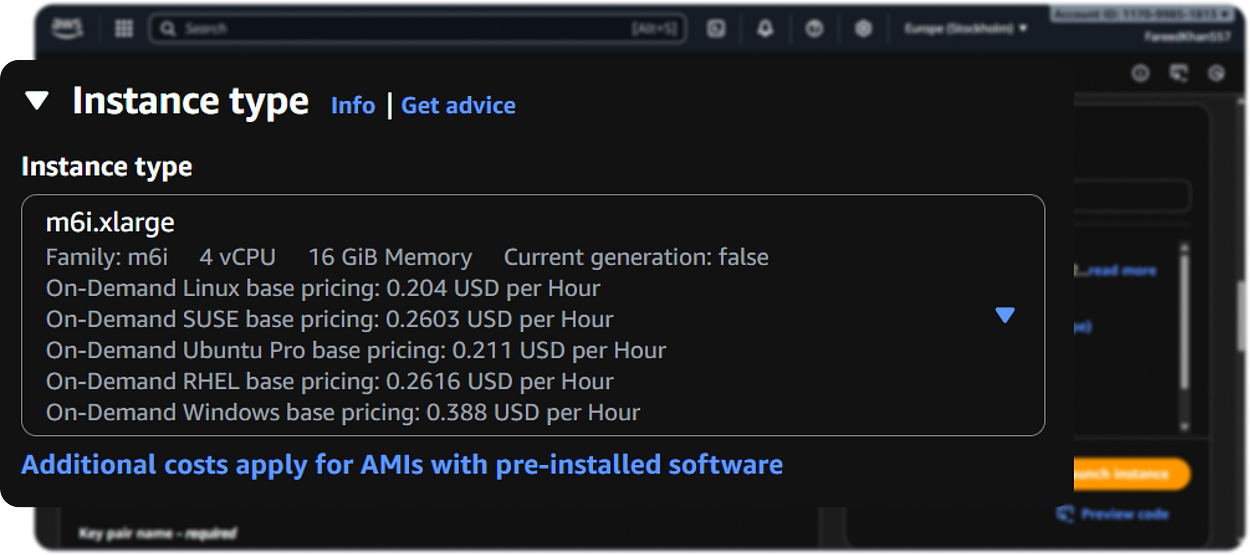

接下来是核心依赖部分,我们列出了项目所依赖的所有库。

由于我们要构建一个智能体 AI 系统(面向最多 1 万名活跃用户),我们需要一系列用于 Web 框架、数据库、认证、AI 编排、可观测性等方面的库。

# ==========================

# 核心运行时依赖

# ==========================

# 这些包会在安装您的项目时一并安装

# 它们定义了应用程序的核心功能

dependencies = [

# --- Web 框架及服务器 ---

"fastapi>=0.121.0", # 高性能异步 Web 框架

"uvicorn>=0.34.0", # 用于运行 FastAPI 的 ASGI 服务器

"asgiref>=3.8.1", # ASGI 工具(同步/异步桥接)

"uvloop>=0.22.1", # 提升 asyncio 事件循环速度

# --- LangChain / LangGraph 生态系统 ---

"langchain>=1.0.5", # 高层次的 LLM 编排框架

"langchain-core>=1.0.4", # LangChain 的核心抽象

"langchain-openai>=1.0.2", # LangChain 的 OpenAI 集成

"langchain-community>=0.4.1", # 社区维护的 LangChain 工具

"langgraph>=1.0.2", # 基于图的智能体/状态工作流

"langgraph-checkpoint-postgres>=3.0.1",# 基于 PostgreSQL 的 LangGraph 检查点

# --- 可观测性与追踪 ---

"langfuse==3.9.1", # LLM 追踪、监控和评估

"structlog>=25.2.0", # 结构化日志记录

# --- 认证与安全 ---

"passlib[bcrypt]>=1.7.4", # 密码哈希工具

"bcrypt>=4.3.0", # 低层 bcrypt 哈希

"python-jose[cryptography]>=3.4.0", # JWT 处理与加密

"email-validator>=2.2.0", # 认证流程中的邮箱验证

# --- 数据库与持久化 ---

"psycopg2-binary>=2.9.10", # PostgreSQL 驱动

"sqlmodel>=0.0.24", # SQLAlchemy + Pydantic ORM

"supabase>=2.15.0", # Supabase 客户端 SDK

# --- 配置与环境 ---

"pydantic[email]>=2.11.1", # 支持邮箱的数据验证

"pydantic-settings>=2.8.1", # 通过环境变量管理配置

"python-dotenv>=1.1.0", # 从 .env 文件加载环境变量

# --- API 工具 ---

"python-multipart>=0.0.20", # 多部分表单数据支持(文件上传)

"slowapi>=0.1.9", # FastAPI 的速率限制

# --- 指标与监控 ---

"prometheus-client>=0.19.0", # Prometheus 指标导出器

"starlette-prometheus>=0.7.0",# Starlette/FastAPI 的 Prometheus 中间件

# --- 搜索与外部工具 ---

"duckduckgo-search>=3.9.0", # DuckDuckGo 搜索集成

"ddgs>=9.6.0", # DuckDuckGo 搜索客户端(替代方案)

# --- 可靠性与实用工具 ---

"tenacity>=9.1.2", # 不稳定操作的重试逻辑

"tqdm>=4.67.1", # 进度条

"colorama>=0.4.6", # 彩色终端输出

# --- 内存 / 智能体工具 ---

"mem0ai>=1.0.0", # AI 内存管理库

]

您可能已经注意到(这在几乎所有情况下都非常重要),我们为每个依赖项指定了具体版本(使用 >= 运算符)。这在生产系统中至关重要,可以避免出现“依赖地狱”——即不同库需要同一软件包的不兼容版本。

接下来是开发依赖部分。在构建或开发阶段,很可能会有许多开发者同时在同一代码库上工作。为了确保代码质量和一致性,我们需要一组开发工具,如 linter、格式化工具和类型检查器。

# ==========================

# 可选依赖

# ==========================

# 可以通过以下命令安装的额外依赖集:

# pip install .[dev]

[project.optional-dependencies]

dev = [

"black", # 代码格式化工具

"isort", # 导入排序工具

"flake8", # Lint 工具

"ruff", # 快速 Python Linter(Flake8 的现代替代品)

"djlint==1.36.4", # HTML 和模板的 Linter/格式化工具

]

然后我们定义了测试相关的依赖组。这允许我们将相关依赖按逻辑分组在一起。例如,所有与测试相关的库都可以归入 test 组。

# ==========================

# 依赖组(PEP 735 样式)

# ==========================

# 依赖的逻辑分组,常用于现代工具链

[dependency-groups]

test = [

"httpx>=0.28.1", # 用于测试 API 的异步 HTTP 客户端

"pytest>=8.3.5", # 测试框架

],

# ==========================

# Pytest 配置

# ==========================

[tool.pytest.ini_options]

markers = [

"slow: 将测试标记为慢速(可通过 '-m \"not slow\"' 排除)",

],

python_files = [

"test_*.py",

"*_test.py",

"tests.py",

],

# ==========================

# Black(代码格式化工具)

# ==========================

[tool.black]

line-length = 119 # 最大行长度

exclude = "venv|migrations" # 要跳过的文件/目录

# ==========================

# Flake8(Lint 工具)

# ==========================

[tool.flake8]

docstring-convention = "all" # 强制执行文档字符串规范

ignore = [

"D107", "D212", "E501", "W503", "W605", "D203", "D100",

],

exclude = "venv|migrations"

max-line-length = 119

# ==========================

# Radon(圈复杂度分析工具)

# ==========================

# 允许的最大圈复杂度

radon-max-cc = 10

# ==========================

# isort(导入排序工具)

# ==========================

[tool.isort]

profile = "black" # 与 Black 兼容

multi_line_output = "VERTICAL_HANGING_INDENT"

force_grid_wrap = 2

line_length = 119

skip = ["migrations", "venv"]

# ==========================

# Pylint 配置

# ==========================

[tool.pylint."messages control"]

disable = [

"line-too-long",

"trailing-whitespace",

"missing-function-docstring",

"consider-using-f-string",

"import-error",

"too-few-public-methods",

"redefined-outer-name",

]

[tool.pylint.master]

ignore = "migrations"

# ==========================

# Ruff (Fast Linter)

# ==========================

[tool.ruff]

line-length = 119

exclude = ["migrations", "*.ipynb", "venv"]

[tool.ruff.lint]

# Per-file ignores

[tool.ruff.lint.per-file-ignores]

"__init__.py" = ["E402"] # 允许在 __init__.py 中不将导入语句放在文件顶部

让我们逐一理解剩余的配置……

依赖组:它允许我们创建依赖项的逻辑分组。例如,我们可以有一个test组,包含测试所需的库等。Pytest 配置:通过它,我们可以自定义 pytest 在项目中发现和运行测试的方式。Black:它帮助我们在整个代码库中保持一致的代码格式。Flake8:它是一个 lint 工具,用于检查代码风格违规和潜在错误。Radon:它帮助我们监控代码的圈复杂度(即代码的复杂性),以保持代码的可维护性。isort:它会自动对 Python 文件中的导入语句进行排序,以保持其整洁有序。

我们还定义了一些额外的 linter 和配置,如 Pylint 和 Ruff,它们可以帮助我们捕获潜在的问题。以下依赖项完全是可选的,但我强烈建议在生产系统中使用它们,因为随着未来代码库的增长,如果没有这些工具,代码可能会变得难以管理。

设置环境配置

现在我们将设置最常见的配置,在开发人员的语言中,这被称为设置管理。

通常在小型项目中,开发者会使用一个简单的 .env 文件来存储环境变量。但更规范的做法是将其命名为 .env.example 并提交到版本控制系统中。

# 不同环境的配置

.env.[development|staging|production] # 例如 .env.development

你可能会问,为什么不直接使用 .env 呢?

这是因为这样可以同时维护不同环境的独立、隔离配置(比如在开发环境中启用调试模式,而在生产环境中禁用调试模式),而无需不断编辑单个文件来切换上下文。

因此,让我们创建一个 .env.example 文件,并添加所有必要的环境变量及其占位符值。

# ==================================================

# 应用程序设置

# ==================================================

APP_ENV=development # 应用程序环境(development | staging | production)

PROJECT_NAME="Project Name" # 人类可读的项目名称

VERSION=1.0.0 # 应用程序版本

DEBUG=true # 启用调试模式(生产环境中应关闭)

与之前类似,第一部分定义了基本的应用程序设置,如环境、项目名称、版本和调试模式。

接下来是 API 设置,我们在这里定义 API 版本控制的基础路径。

# ==================================================

# API 设置

# ==================================================

API_V1_STR=/api/v1 # API 版本控制的基础路径前缀

# ==================================================

# CORS(跨域资源共享)设置

# ==================================================

# 允许的前端来源列表,用逗号分隔

ALLOWED_ORIGINS="http://localhost:3000,http://localhost:8000"

# ==================================================

# Langfuse 可观测性设置

# ==================================================

# 用于 LLM 跟踪、监控和分析

LANGFUSE_PUBLIC_KEY="your-langfuse-public-key" # Langfuse 公钥

LANGFUSE_SECRET_KEY="your-langfuse-secret-key" # Langfuse 秘钥

LANGFUSE_HOST=https://cloud.langfuse.com # Langfuse 云服务地址

API_V1_STR 让我们能够轻松地为 API 端点进行版本控制,这也是许多公共 API 的标准做法,尤其是像 OpenAI、Cohere 等 AI 模型提供商所采用的。

接下来是 CORS 设置,这对 Web 应用程序非常重要,因为它可以控制哪些前端域名可以访问我们的后端 API(从而实现与 AI 代理的集成)。

我们还将使用行业标准的 Langfuse 来实现 LLM 交互的可观测性和监控功能。因此,我们需要设置必要的 API 密钥和主机 URL。

# ==================================================

# LLM(大型语言模型)设置

# ==================================================

OPENAI_API_KEY="your-llm-api-key" # LLM 提供商的 API 密钥(例如 OpenAI)

DEFAULT_LLM_MODEL=gpt-4o-mini # 默认用于聊天/完成任务的模型

DEFAULT_LLM_TEMPERATURE=0.2 # 控制随机性(0.0 = 确定性,1.0 = 创造性)

# ==================================================

# JWT(认证)设置

# ==================================================

JWT_SECRET_KEY="your-jwt-secret-key" # 用于签名 JWT 令牌的密钥

JWT_ALGORITHM=HS256 # JWT 签名算法

JWT_ACCESS_TOKEN_EXPIRE_DAYS=30 # 令牌有效期(以天为单位)

# ==================================================

# 数据库(PostgreSQL)设置

# ==================================================

POSTGRES_HOST=db # 数据库主机(Docker 服务名称或主机名)

POSTGRES_DB=mydb # 数据库名称

POSTGRES_USER=myuser # 数据库用户名

POSTGRES_PORT=5432 # 数据库端口

POSTGRES_PASSWORD=mypassword # 数据库密码

# 连接池设置

POSTGRES_POOL_SIZE=5 # 基础持久连接数

POSTGRES_MAX_OVERFLOW=10 # 允许的最大超额连接数

我们将使用 OpenAI 作为主要的 LLM 供应商,因此需要设置 API 密钥、默认模型和温度参数。

接着是 JWT 设置,它在身份验证和会话管理中起着重要作用。我们需要设置用于签名令牌的密钥、编码/解码算法以及令牌的有效期。

对于数据库,我们使用的是 PostgreSQL,这是一种工业级的关系型数据库。通常,当你的智能体系统规模扩大时,你需要合理的连接池设置,以避免过多的连接导致数据库过载。这里我们设置了基础连接池大小为 5,并允许最多 10 个超额连接。

# ==================================================

# 速率限制设置(SlowAPI)

# ==================================================

# 应用于所有路由的默认限制

RATE_LIMIT_DEFAULT="1000 per day,200 per hour"

# 终端点特定限制

RATE_LIMIT_CHAT="100 次/分钟" # 聊天终端点

RATE_LIMIT_CHAT_STREAM="100 次/分钟" # 流式聊天终端点

RATE_LIMIT_MESSAGES="200 次/分钟" # 消息创建终端点

RATE_LIMIT_LOGIN="100 次/分钟" # 登录/认证终端点

# ==================================================

# 日志设置

# ==================================================

LOG_LEVEL=DEBUG # 日志详细程度(DEBUG、INFO、WARNING、ERROR)

LOG_FORMAT=console # 日志输出格式(console | json)

最后,我们有速率限制和日志记录设置,以确保我们的 API 不被滥用,并且具备适当的日志记录功能,便于调试和监控。

现在,我们已经制定了依赖管理和配置管理策略,接下来就可以开始构建 AI 系统的核心逻辑了。第一步是将这些配置应用到我们的应用程序代码中。

我们需要创建一个 app/core/config.py 文件,使用 Pydantic 的配置管理功能来加载这些环境变量。

首先,我们导入必要的模块:

# 导入用于配置管理的必要模块

import json # 用于处理 JSON 数据

import os # 用于与操作系统交互

from enum import Enum # 用于创建枚举类型

from pathlib import Path # 用于处理文件路径

from typing import ( # 用于类型注解

Any, # 表示任意类型

Dict, # 表示字典类型

List, # 表示列表类型

Optional, # 表示可选值

Union, # 表示联合类型

)

from dotenv import load_dotenv # 用于从 .env 文件中加载环境变量

这些是进行文件操作、类型注解以及从 .env.example 文件中加载环境变量所需的基本导入。

接下来,我们需要使用枚举定义环境类型。

# 定义环境类型

class Environment(str, Enum):

"""应用环境类型。

定义了应用可能运行的环境:开发、预发布、生产及测试。

"""

DEVELOPMENT = "development"

STAGING = "staging"

PRODUCTION = "production"

TEST = "test"

通常,每个项目都会包含多个环境,例如开发、预发布、生产及测试环境,它们各自服务于不同的目的。

定义完环境类型后,我们需要一个函数来根据环境变量确定当前环境。

# 确定环境

def get_environment() -> Environment:

"""获取当前环境。

返回:

Environment: 当前环境(开发、预发布、生产或测试)

"""

match os.getenv("APP_ENV", "development").lower():

case "production" | "prod":

return Environment.PRODUCTION

case "staging" | "stage":

return Environment.STAGING

case "test":

return Environment.TEST

case _:

return Environment.DEVELOPMENT

我们可以使用 APP_ENV 环境变量来判断当前所处的环境。如果未设置,则默认为开发环境。

最后,我们需要根据当前环境加载相应的 .env 文件。

# 根据环境加载对应的 .env 文件

def load_env_file():

"""加载环境特定的 .env 文件"""

env = get_environment()

print(f"正在加载环境:{env}")

base_dir = os.path.dirname(os.path.dirname(os.path.dirname(__file__)))

# 按优先级定义环境文件

env_files = [

os.path.join(base_dir, f".env.{env.value}.local"),

os.path.join(base_dir, f".env.{env.value}"),

os.path.join(base_dir, ".env.local"),

os.path.join(base_dir, ".env"),

]

# 加载第一个存在的环境文件

for env_file in env_files:

if os.path.isfile(env_file):

load_dotenv(dotenv_path=env_file)

print(f"已从 {env_file} 加载环境")

return env_file

# 如果未找到环境文件,则回退到默认设置

return None

我们需要在应用启动时立即调用此函数,以加载环境变量。

# 调用函数加载 .env 文件

ENV_FILE = load_env_file()

在许多情况下,我们会有列表或字典类型的环境变量。因此,我们需要一些工具函数来正确解析这些值。

# 从环境变量中解析列表值

def parse_list_from_env(env_key, default=None):

"""从环境变量中解析逗号分隔的列表"""

value = os.getenv(env_key)

if not value:

return default or []

# 去掉可能存在的引号

value = value.strip("\"'")

# 处理单个值的情况

if "," not in value:

return [value]

# 拆分逗号分隔的值

return [item.strip() for item in value.split(",") if item.strip()]

# 从带有前缀的环境变量中解析字典列表

def parse_dict_of_lists_from_env(prefix, default_dict=None):

"""从具有公共前缀的环境变量中解析字典列表。"""

result = default_dict or {}

# 查找所有带有给定前缀的环境变量

for key, value in os.environ.items():

if key.startswith(prefix):

endpoint = key[len(prefix) :].lower() # 提取端点名称

# 解析该端点的值

if value:

value = value.strip("\"'")

if "," in value:

result[endpoint] = [item.strip() for item in value.split(",") if item.strip()]

else:

result[endpoint] = [value]

return result

我们正在从环境变量中解析逗号分隔的列表和字典列表,以便在代码中更方便地使用它们。

现在我们可以定义我们的主 Settings 类,它将保存应用程序的所有配置值。它会从环境变量中读取,并在必要时应用默认值。

class Settings:

"""

集中式应用程序配置。

从环境变量加载并应用默认值。

"""

def __init__(self):

# 设置当前环境

self.ENVIRONMENT = get_environment()

# ==========================

# 应用程序基础

# ==========================

self.PROJECT_NAME = os.getenv("PROJECT_NAME", "FastAPI LangGraph Agent")

self.VERSION = os.getenv("VERSION", "1.0.0")

self.API_V1_STR = os.getenv("API_V1_STR", "/api/v1")

self.DEBUG = os.getenv("DEBUG", "false").lower() in ("true", "1", "t", "yes")

# 使用我们的辅助函数解析 CORS 来源

self.ALLOWED_ORIGINS = parse_list_from_env("ALLOWED_ORIGINS", ["*"])

# ==========================

# LLM & LangGraph

# ==========================

self.OPENAI_API_KEY = os.getenv("OPENAI_API_KEY", "")

self.DEFAULT_LLM_MODEL = os.getenv("DEFAULT_LLM_MODEL", "gpt-4o-mini")

self.DEFAULT_LLM_TEMPERATURE = float(os.getenv("DEFAULT_LLM_TEMPERATURE", "0.2"))

# 代理特定设置

self.MAX_TOKENS = int(os.getenv("MAX_TOKENS", "2000"))

self.MAX_LLM_CALL_RETRIES = int(os.getenv("MAX_LLM_CALL_RETRIES", "3"))

# ==========================

# 可观测性(Langfuse)

# ==========================

self.LANGFUSE_PUBLIC_KEY = os.getenv("LANGFUSE_PUBLIC_KEY", "")

self.LANGFUSE_SECRET_KEY = os.getenv("LANGFUSE_SECRET_KEY", "")

self.LANGFUSE_HOST = os.getenv("LANGFUSE_HOST", "https://cloud.langfuse.com")

# ==========================

# 数据库(PostgreSQL)

# ==========================

self.POSTGRES_HOST = os.getenv("POSTGRES_HOST", "localhost")

self.POSTGRES_PORT = int(os.getenv("POSTGRES_PORT", "5432"))

self.POSTGRES_DB = os.getenv("POSTGRES_DB", "postgres")

self.POSTGRES_USER = os.getenv("POSTGRES_USER", "postgres")

self.POSTGRES_PASSWORD = os.getenv("POSTGRES_PASSWORD", "postgres")

# 连接池设置对高并发代理至关重要

self.POSTGRES_POOL_SIZE = int(os.getenv("POSTGRES_POOL_SIZE", "20"))

self.POSTGRES_MAX_OVERFLOW = int(os.getenv("POSTGRES_MAX_OVERFLOW", "10"))

# LangGraph 持久化表

self.CHECKPOINT_TABLES = ["checkpoint_blobs", "checkpoint_writes", "checkpoints"]

# ==========================

# 安全(JWT)

# ==========================

self.JWT_SECRET_KEY = os.getenv("JWT_SECRET_KEY", "unsafe-secret-for-dev")

self.JWT_ALGORITHM = os.getenv("JWT_ALGORITHM", "HS256")

self.JWT_ACCESS_TOKEN_EXPIRE_DAYS = int(os.getenv("JWT_ACCESS_TOKEN_EXPIRE_DAYS", "30"))

# ==========================

# 速率限制

# ==========================

self.RATE_LIMIT_DEFAULT = parse_list_from_env("RATE_LIMIT_DEFAULT", ["200 per day", "50 per hour"])

# 定义端点特定的限制

self.RATE_LIMIT_ENDPOINTS = {

"chat": parse_list_from_env("RATE_LIMIT_CHAT", ["30 per minute"]),

"chat_stream": parse_list_from_env("RATE_LIMIT_CHAT_STREAM", ["20 per minute"]),

"auth": parse_list_from_env("RATE_LIMIT_LOGIN", ["20 per minute"]),

"root": parse_list_from_env("RATE_LIMIT_ROOT", ["10 per minute"]),

"health": parse_list_from_env("RATE_LIMIT_HEALTH", ["20 per minute"]),

}

# 根据环境应用逻辑来覆盖设置

self.apply_environment_settings()

def apply_environment_settings(self):

"""

根据当前活动环境应用严格的覆盖设置。

这样可以确保即使 .env 文件配置错误,生产环境仍然是安全的。

"""

if self.ENVIRONMENT == Environment.DEVELOPMENT:

self.DEBUG = True

self.LOG_LEVEL = "DEBUG"

self.LOG_FORMAT = "console"

# 放宽本地开发的速率限制

self.RATE_LIMIT_DEFAULT = ["1000 per day", "200 per hour"]

elif self.ENVIRONMENT == Environment.PRODUCTION:

self.DEBUG = False

self.LOG_LEVEL = "WARNING"

self.LOG_FORMAT = "json"

# 生产环境中更严格的限制

self.RATE_LIMIT_DEFAULT = ["200 per day", "50 per hour"]

在我们的 Settings 类中,我们从环境变量中读取各种配置值,并在必要时应用合理的默认值。我们还有一个 apply_environment_settings 方法,可以根据我们是在开发模式还是生产模式来调整某些设置。

你还可以看到 checkpoint_tables,它定义了 LangGraph 在 PostgreSQL 中持久化所需的表。

最后,我们初始化了一个全局 settings 对象,可以在整个应用程序中导入和使用。

# 初始化全局设置对象

settings = Settings()

到目前为止,我们已经为我们的生产级 AI 系统创建了依赖管理和设置管理策略。

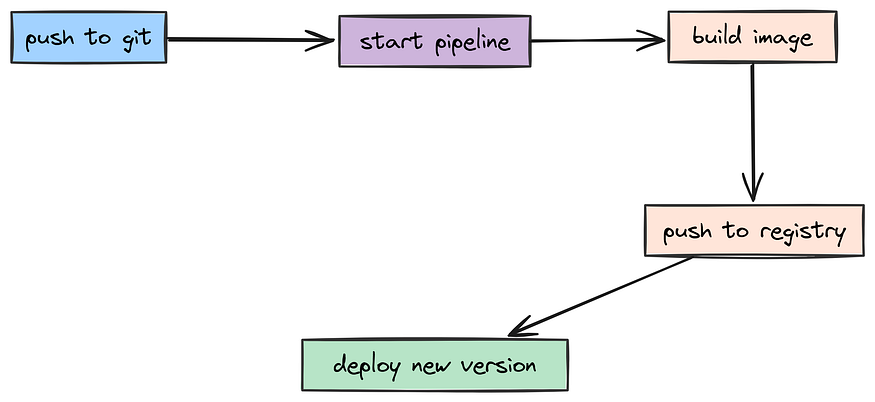

容器化策略

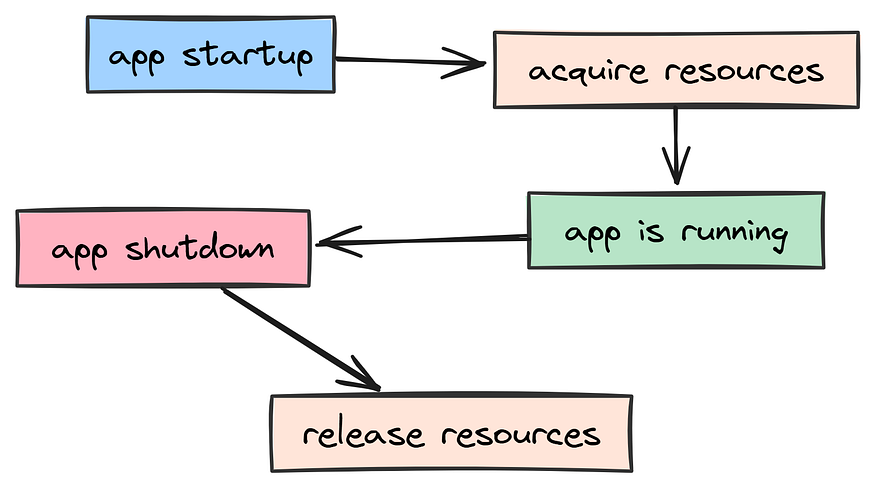

现在我们需要创建一个 docker-compose.yml 文件,它将定义我们的应用程序运行所需的所有服务。

我们之所以使用容器化技术,是因为在生产级系统中,数据库、监控工具和 API 等组件并不是孤立运行的,它们需要相互通信,而 Docker Compose 是编排多容器 Docker 应用的标准方式。

首先,我们需要定义数据库服务。由于我们正在构建一个需要 长期记忆 的 AI 代理,标准的 PostgreSQL 数据库是不够的。我们需要向量相似度搜索功能。

version: '3.8'

# ==================================================

# Docker Compose 配置

# ==================================================

# 该文件定义了在本地或单节点环境中运行应用程序所需的所有服务。

services:

# ==================================================

# PostgreSQL + pgvector 数据库

# ==================================================

db:

image: pgvector/pgvector:pg16 # 启用了 pgvector 扩展的 PostgreSQL 16

environment:

- POSTGRES_DB=${POSTGRES_DB} # 数据库名称

- POSTGRES_USER=${POSTGRES_USER} # 数据库用户

- POSTGRES_PASSWORD=${POSTGRES_PASSWORD} # 数据库密码

ports:

- "5432:5432" # 将 PostgreSQL 暴露给宿主机(仅用于开发)

volumes:

- postgres-data:/var/lib/postgresql/data # 持久化数据库存储

healthcheck:

test: ["CMD-SHELL", "pg_isready -U ${POSTGRES_USER} -d ${POSTGRES_DB}"]

interval: 10s

timeout: 5s

retries: 5

restart: always

networks:

- monitoring

我们明确使用 pgvector/pgvector:pg16 镜像,而不是标准的 postgres 镜像。这样可以开箱即用地获得向量扩展功能,而这些功能是 mem0ai 和 LangGraph 检查点机制所必需的。

我们还配置了健康检查,这在部署中非常重要,因为我们的 API 服务需要等待数据库完全准备好接受连接后才能启动。

接下来,我们定义主应用服务。这是运行 FastAPI 代码的地方。

# ==================================================

# FastAPI 应用程序服务

# ==================================================

app:

build:

context: . # 从项目根目录构建镜像

args:

APP_ENV: ${APP_ENV:-development} # 构建时的环境变量

ports:

- "8000:8000" # 暴露 FastAPI 服务

volumes:

- ./app:/app/app # 热重载应用代码

- ./logs:/app/logs # 持久化应用日志

env_file:

- .env.${APP_ENV:-development} # 加载特定环境的变量

environment:

- APP_ENV=${APP_ENV:-development}

- JWT_SECRET_KEY=${JWT_SECRET_KEY:-supersecretkeythatshouldbechangedforproduction}

depends_on:

db:

condition: service_healthy # 等待数据库就绪

healthcheck:

test: ["CMD", "curl", "-f", "http://localhost:8000/health"]

interval: 30s

timeout: 10s

retries: 3

start_period: 10s

restart: on-failure

networks:

- monitoring

请注意这里的 volumes 部分。我们将本地的 ./app 文件夹映射到容器的 /app 目录。这实现了热重载功能。

如果你在编辑器中修改了一行 Python 代码,容器会立即检测到并重启服务器。这是一种常见的做法,在不牺牲 Docker 隔离性的前提下,提供了极佳的开发体验。

然而,在生产环境中,如果没有可观ability 工具,系统就如同盲人一般。开发团队需要了解他们的 API 是否响应缓慢,或者错误是否激增。为此,我们使用 Prometheus + Grafana 堆栈。

# ==================================================

# Prometheus(指标收集)

# ==================================================

prometheus:

image: prom/prometheus:latest

ports:

- "9090:9090" # Prometheus UI

volumes:

- ./prometheus/prometheus.yml:/etc/prometheus/prometheus.yml

command:

- '--config.file=/etc/prometheus/prometheus.yml'

networks:

- monitoring

restart: always

Prometheus 是“采集器”,它每隔几秒钟就会从我们的 FastAPI 应用程序中抓取指标(如请求延迟或错误率)。我们挂载了一个配置文件,以便精确地告诉它在哪里查找我们的应用数据。

然后我们添加了 Grafana,它是“可视化工具”。

# ==================================================

# Grafana(指标可视化)

# ==================================================

grafana:

image: grafana/grafana:latest

ports:

- "3000:3000" # Grafana UI

volumes:

- grafana-storage:/var/lib/grafana

- ./grafana/dashboards:/etc/grafana/provisioning/dashboards

- ./grafana/dashboards/dashboards.yml:/etc/grafana/provisioning/dashboards/dashboards.yml

environment:

- GF_SECURITY_ADMIN_PASSWORD=admin

- GF_USERS_ALLOW_SIGN_UP=false

networks:

- monitoring

restart: always

Grafana 会将 Prometheus 收集的原始数据转化为精美的图表。通过挂载 ./grafana/dashboards 卷,我们可以以代码形式预置仪表板。这意味着当你启动容器时,你的仪表板已经准备就绪,无需手动设置。

最后,第三个重要环节是监控容器本身的健康状况(CPU 使用率、内存泄漏等)。为此,我们使用 cAdvisor。它是由 Google 开发的一款轻量级监控代理,能够实时提供容器资源使用和性能方面的洞察。

# ==================================================

# cAdvisor(容器指标)

# ==================================================

cadvisor:

image: gcr.io/cadvisor/cadvisor:latest

ports:

- "8080:8080" # cAdvisor UI

volumes:

- /:/rootfs:ro

- /var/run:/var/run:rw

- /sys:/sys:ro

- /var/lib/docker/:/var/lib/docker:ro

networks:

- monitoring

restart: always

# ==================================================

# 网络与卷

# ==================================================

networks:

monitoring:

driver: bridge # 所有服务共享的网络

volumes:

grafana-storage: # 持久化 Grafana 仪表板及数据

postgres-data: # 持久化 PostgreSQL 数据

最后,我们定义了一个共享的 monitoring 网络,使所有服务能够安全地相互通信,并命名了卷,以确保即使重启容器,我们的数据库和仪表板配置也能持久保存。

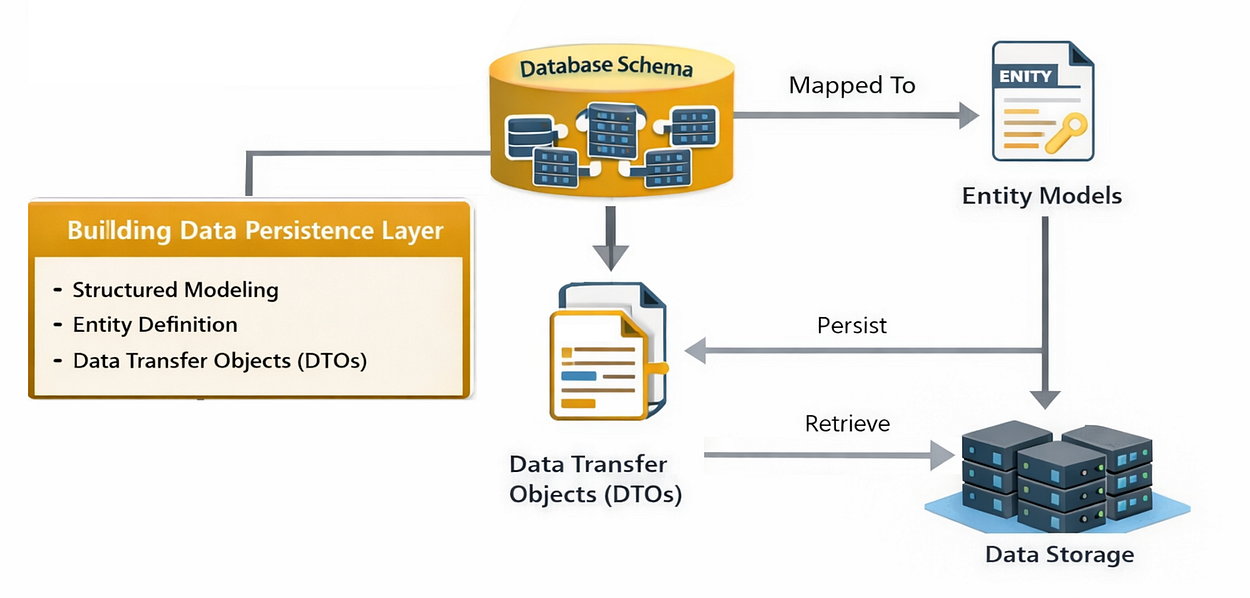

构建数据持久化层

我们已经有了一个正在运行的数据库,但它目前是空的。AI 系统高度依赖结构化数据。我们不会只是将 JSON 对象扔进 NoSQL 存储中,而是需要在用户、聊天会话以及 AI 状态之间建立严格的关联关系。

数据持久化层(由 Fareed Khan 创作)

数据持久化层(由 Fareed Khan 创作)

为了处理这个问题,我们将使用 SQLModel。它是一个结合了 SQLAlchemy(用于数据库交互)和 Pydantic(用于数据验证)的库。

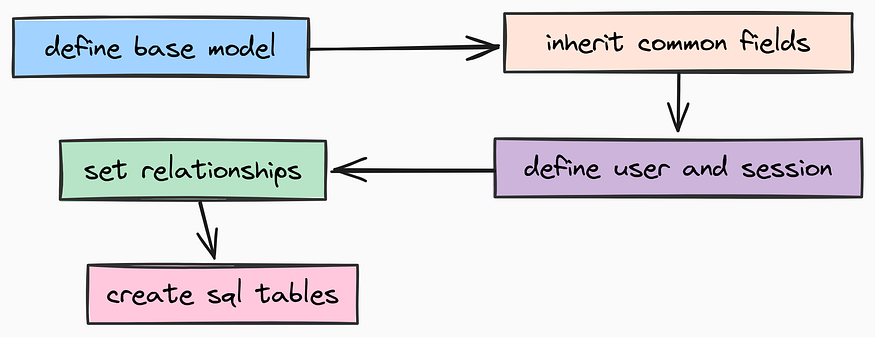

结构化建模

SQLModel 也是目前 Python 中最现代的 ORM 之一。让我们开始定义我们的数据模型吧。

在软件工程中,“不要重复自己”(DRY)是一个核心原则。由于我们数据库中的几乎每一张表都需要一个时间戳来记录记录的创建时间,因此我们不应该将这一逻辑复制粘贴到每个文件中。相反,我们可以创建一个 BaseModel。

结构化建模(由 Fareed Khan 创作)

结构化建模(由 Fareed Khan 创作)

为此,创建 app/models/base.py 文件,用于存放我们的抽象基类:

from datetime import datetime, UTC

from typing import List, Optional

from sqlmodel import Field, SQLModel, Relationship

# ==================================================

# 基础数据库模型

# ==================================================

class BaseModel(SQLModel):

"""

抽象基类,为所有表添加通用字段。

使用抽象类可以确保整个模式的一致性。

"""

# 生产环境中始终使用 UTC 时间,以避免时区问题

created_at: datetime = Field(default_factory=lambda: datetime.now(UTC))

这个类非常简单。它为任何继承自它的模型添加了一个 created_at 时间戳。

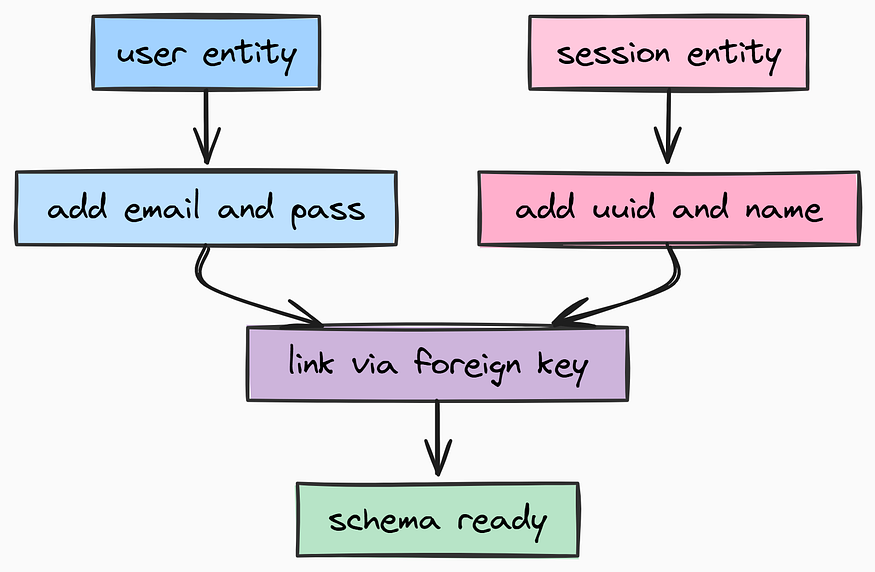

现在我们可以构建我们的核心实体。对于任何面向用户的系统来说,最基本的需求就是 身份验证。我们需要一个良好的用户模型来安全地处理凭据。

实体定义

类似于基于 API 的 AI 模型提供商处理用户数据的方式,我们将创建一个包含电子邮件和哈希密码字段的 User 模型。

实体定义(由 Fareed Khan 创作)

实体定义(由 Fareed Khan 创作)

创建 app/models/user.py 文件来定义用户模型:

from typing import TYPE_CHECKING, List

import bcrypt

from sqlmodel import Field, Relationship

from app.models.base import BaseModel

# 防止类型提示中的循环导入

if TYPE_CHECKING:

from app.models.session import Session

# ==================================================

# 用户模型

# ==================================================

class User(BaseModel, table=True):

"""

表示系统中的注册用户。

"""

# 主键

id: int = Field(default=None, primary_key=True)

# 电子邮件必须唯一,并且建立索引以便在登录时快速查找

email: str = Field(unique=True, index=True)

# 绝对不能存储明文密码。我们存储的是 Bcrypt 哈希值。

hashed_password: str

# 关系:一个用户可以有多个聊天会话

sessions: List["Session"] = Relationship(back_populates="user")

def verify_password(self, password: str) -> bool:

"""

将原始密码与存储的哈希值进行比对。

"""

return bcrypt.checkpw(password.encode("utf-8"), self.hashed_password.encode("utf-8"))

@staticmethod

def hash_password(password: str) -> str:

"""

为新密码生成安全的 Bcrypt 哈希和盐。

"""

salt = bcrypt.gensalt()

return bcrypt.hashpw(password.encode("utf-8"), salt).decode("utf-8")

我们将密码哈希逻辑直接嵌入到了模型中。这是 封装 的一种实现——处理用户数据的逻辑与用户数据本身紧密相关,从而防止应用程序其他地方出现安全漏洞。

接下来,我们需要组织我们的 AI 交互。用户并不是只有一个巨大的、无休止的对话,而是有多个独立的 会话(或“聊天”)。为此,我们需要创建 app/models/session.py。

from typing import TYPE_CHECKING, List

from sqlmodel import Field, Relationship

from app.models.base import BaseModel

if TYPE_CHECKING:

from app.models.user import User

# ==================================================

# 会话模型

# ==================================================

class Session(BaseModel, table=True):

"""

表示一次特定的聊天对话或线程。

这将 AI 的记忆与特定的上下文联系起来。

"""

# 我们使用字符串 ID(UUID)作为会话标识符,以使其难以猜测

id: str = Field(primary_key=True)

# 外键:将该会话与特定用户关联

user_id: int = Field(foreign_key="user.id")

# 聊天的可选友好名称(例如:“食谱创意”)

name: str = Field(default="")

# 与用户之间的关系

user: "User" = Relationship(back_populates="sessions")

这创建了一个 Session 模型,通过外键与 User 模型相连。每个会话代表了 AI 的一个独立对话上下文。

数据传输对象(DTOs)

最后,我们需要一个用于 LangGraph 持久化 的模型。LangGraph 是有状态的,如果服务器重启,我们不希望 AI 忘记它正在进行的步骤。

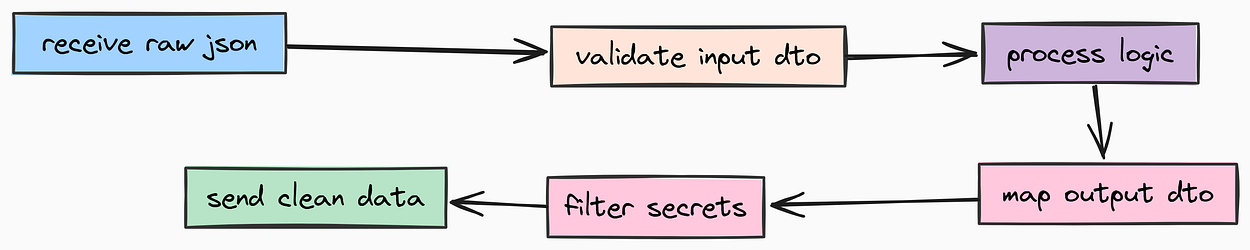

DTOs(由 Fareed Khan 创作)

DTOs(由 Fareed Khan 创作)

我们需要一个 Thread 模型,作为这些检查点的锚点。创建 app/models/thread.py。

from datetime import UTC, datetime

from sqlmodel import Field, SQLModel

# ==================================================

# 线程模型(LangGraph 状态)

# ==================================================

class Thread(SQLModel, table=True):

"""

作为 LangGraph 检查点的轻量级锚点。

实际的状态 blob 由 AsyncPostgresSaver 存储,

但我们需要这张表来验证线程的存在。

"""

id: str = Field(primary_key=True)

created_at: datetime = Field(default_factory=lambda: datetime.now(UTC))

为了保持应用程序其余部分的导入整洁,我们将这些模型聚合到一个统一的入口点中,并将其放在 app/models/database.py 中。

"""

数据库模型导出。

这允许简单的导入,例如:`from app.models.database import User, Thread`

"""

from app.models.thread import Thread

# 显式定义导出的内容

__all__ = ["Thread"]

现在我们已经有了数据库结构,接下来需要解决 数据传输 的问题。

初学者在开发 API 时常见的错误之一,就是直接将数据库模型暴露给用户。这样做既危险(会泄露内部字段,如 hashed_password),又不够灵活。在生产系统中,我们使用 模式(通常称为 DTOs - 数据传输对象)。

这些模式定义了你的 API 与外部世界之间的“契约”。

让我们为 身份验证 定义模式。在这里我们需要严格的验证:密码必须符合复杂度要求,电子邮件必须是有效的格式。为此,我们需要一个单独的身份验证模式文件,因此我们应该创建 app/schemas/auth.py。

import re

from datetime import datetime

from pydantic import BaseModel, EmailStr, Field, SecretStr, field_validator

# ==================================================

# 认证模式

# ==================================================

class UserCreate(BaseModel):

"""

用户注册输入的模式。

"""

email: EmailStr = Field(..., description="用户的电子邮件地址")

# SecretStr 防止密码在错误堆栈中被记录

password: SecretStr = Field(..., description="用户的密码", min_length=8, max_length=64)

@field_validator("password")

@classmethod

def validate_password(cls, v: SecretStr) -> SecretStr:

"""

强制执行强密码策略。

"""

password = v.get_secret_value()

if len(password) < 8:

raise ValueError("密码必须至少为8个字符长")

if not re.search(r"[A-Z]", password):

raise ValueError("密码必须包含至少一个大写字母")

if not re.search(r"[0-9]", password):

raise ValueError("密码必须包含至少一个数字")

if not re.search(r'[!@#$%^&*(),.?":{}|<>]', password):

raise ValueError("密码必须包含至少一个特殊字符")

return v

class Token(BaseModel):

"""

JWT 访问令牌响应的模式。

"""

access_token: str = Field(..., description="JWT 访问令牌")

token_type: str = Field(default="bearer", description="令牌类型")

expires_at: datetime = Field(..., description="令牌过期时间戳")

class UserResponse(BaseModel):

"""

公开用户资料模式(可安全返回给前端)。

注意这里我们排除了密码。

"""

id: int

email: str

token: Token

接下来,我们在 app/schemas/chat.py 中定义 聊天界面 的模式。这用于处理用户输入的消息以及来自 AI 的流式响应。

import re

from typing import List, Literal

from pydantic import BaseModel, Field, field_validator

# ==================================================

# 聊天模式

# ==================================================

class Message(BaseModel):

"""

表示对话历史中的单条消息。

"""

role: Literal["user", "assistant", "system"] = Field(..., description="发送消息的人")

content: str = Field(..., description="消息内容", min_length=1, max_length=3000)

@field_validator("content")

@classmethod

def validate_content(cls, v: str) -> str:

"""

消息内容的净化:防止基本的 XSS 或注入攻击。

"""

if re.search(r"<script.*?>.*?</script>", v, re.IGNORECASE | re.DOTALL):

raise ValueError("内容包含潜在有害的脚本标签")

return v

class ChatRequest(BaseModel):

"""

发送到 /chat 端点的有效载荷。

"""

messages: List[Message] = Field(..., min_length=1)

class ChatResponse(BaseModel):

"""

/chat 端点的标准响应。

"""

messages: List[Message]

class StreamResponse(BaseModel):

"""

服务器发送事件 (SSE) 流式传输的分块格式。

"""

content: str = Field(default="")

done: bool = Field(default=False)

最后,我们需要一个 LangGraph 状态 的模式。LangGraph 通过在节点(代理、工具、记忆)之间传递状态对象来工作。我们需要明确地定义该状态的具体结构。让我们创建 app/schemas/graph.py:

from typing import Annotated

from langgraph.graph.message import add_messages

from pydantic import BaseModel, Field

# ==================================================

# LangGraph 状态模式

# ==================================================

class GraphState(BaseModel):

"""

在图节点之间传递的中心状态对象。

"""

# 'add_messages' 是一个归约函数。它告诉 LangGraph:

# “当有新消息进来时,将其追加到列表中,而不是覆盖原有内容。”

messages: Annotated[list, add_messages] = Field(

default_factory=list,

description="对话历史"

)

# 从长期记忆(mem0ai)中检索到的上下文

long_term_memory: str = Field(

default="",

description="从向量存储中提取的相关上下文"

)

随着我们的 模型(数据库层)和 模式(API 层)被严格定义,我们已经为应用程序构建了一个类型安全的基础。现在我们可以确信,不良数据不会破坏我们的数据库,敏感数据也不会泄露给用户。

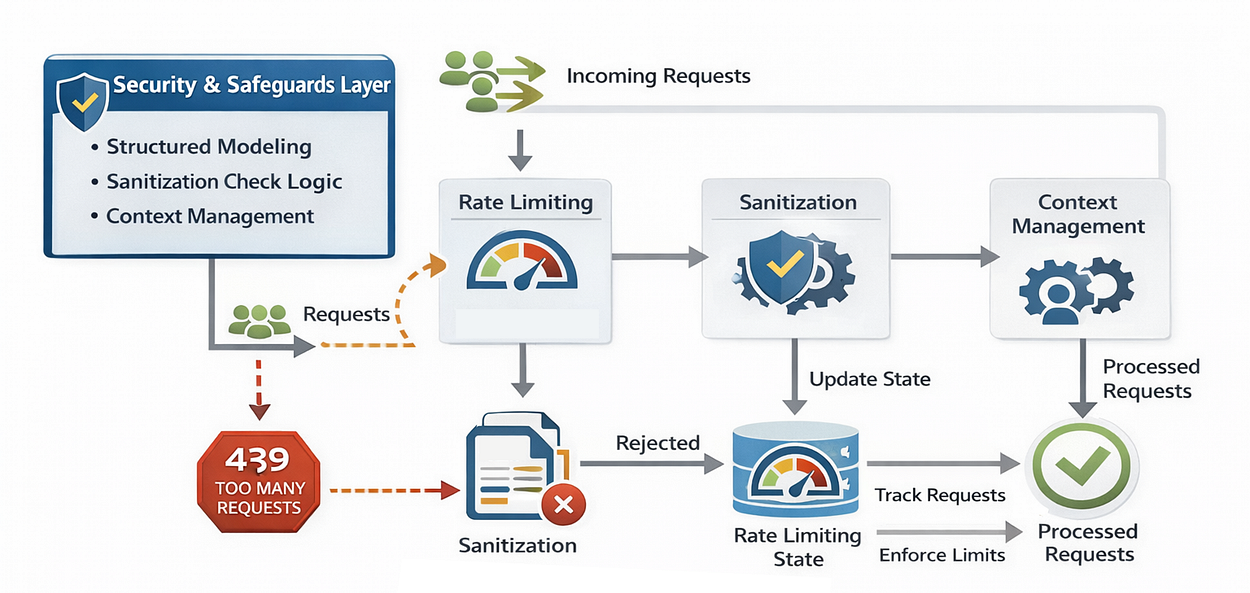

安全与防护层

在生产环境中,你不能信任用户输入,也不能允许对你的资源进行无限制的访问。

你也可能在许多 API 提供商那里看到,比如 together.ai,它们会限制每分钟的请求次数以防止滥用。这有助于保护你的基础设施并控制成本。

安全层(由 Fareed Khan 创作)

安全层(由 Fareed Khan 创作)

如果你在没有防护措施的情况下部署一个 AI 代理,将会发生两件事情:

- 滥用: 机器人会不断冲击你的 API,导致你的 OpenAI 账单激增。

- 安全漏洞: 恶意用户会尝试进行注入攻击。

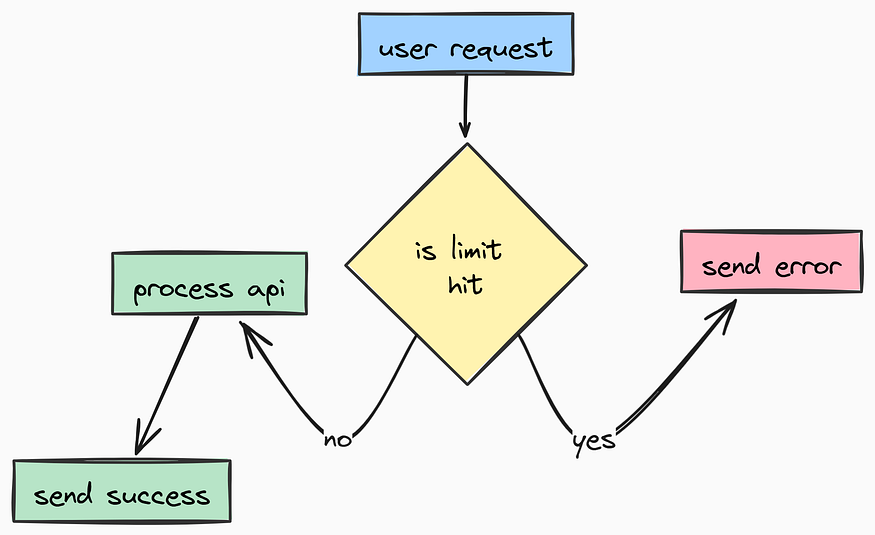

速率限制功能

在编写业务逻辑之前,我们需要实现 速率限制 和 净化工具。

速率限制测试(由 Fareed Khan 创作)

速率限制测试(由 Fareed Khan 创作)

首先,让我们来看速率限制。我们将使用 SlowAPI,这是一个可以轻松与 FastAPI 集成的库。我们需要定义 如何 识别一个唯一用户(通常通过 IP 地址),并应用我们在前面设置中定义的默认限制。让我们为此创建一个 app/core/limiter.py 文件:

from slowapi import Limiter

from slowapi.util import get_remote_address

from app.core.config import settings

# ==================================================

# 速率限制配置

# ==================================================

# 我们使用远程地址(IP)作为密钥来初始化限速器。

# 你可能需要调整 `key_func` 来查看 X-Forwarded-For 头部。

limiter = Limiter(

key_func=get_remote_address,

default_limits=settings.RATE_LIMIT_DEFAULT

)

这样,我们以后就可以用 @limiter.limit(...) 装饰任何特定的 API 路由,从而实现精细的控制。

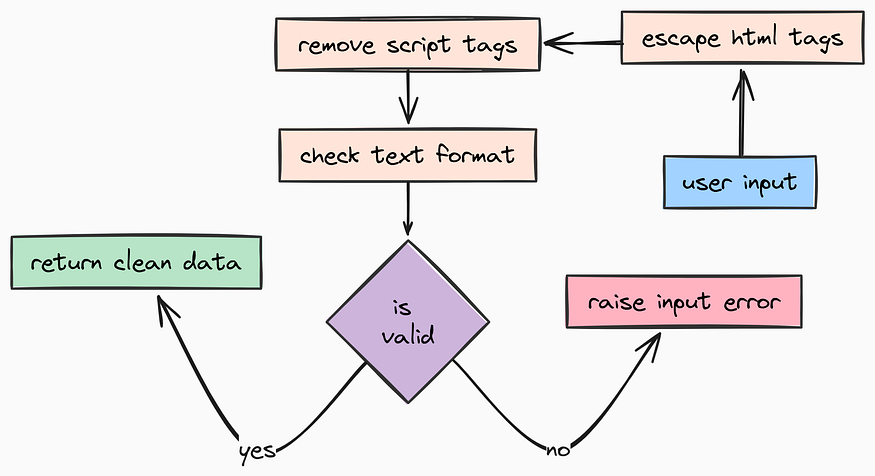

净化检查逻辑

接下来,我们需要 净化。尽管现代前端框架已经处理了许多 XSS(跨站脚本攻击)防护,但后端 API 绝不应该盲目信任传入的字符串。

净化检查(由 Fareed Khan 创作)

净化检查(由 Fareed Khan 创作)

我们需要一个实用函数来净化字符串。我们将为此创建一个 app/utils/sanitization.py 文件:

import html

import re

from typing import Any, Dict, List

# ==================================================

# 输入 sanitization 工具

# ==================================================

def sanitize_string(value: str) -> str:

"""

对字符串进行 sanitization,以防止 XSS 和其他注入攻击。

"""

if not isinstance(value, str):

value = str(value)

# 1. HTML 转义:将 <script> 转换为 <script>

value = html.escape(value)

# 2. 强制清理:如果 script 标签漏过,则将其完全移除

# (这是纵深防御措施)

value = re.sub(r"<script.*?>.*?</script>", "", value, flags=re.DOTALL)

# 3. 移除空字节:防止低级别的二进制漏洞利用尝试

value = value.replace("\0", "")

return value

def sanitize_email(email: str) -> str:

"""

对电子邮件地址格式进行 sanitization 和验证。

"""

# 基本清理

email = sanitize_string(email)

# 使用正则表达式验证标准的电子邮件格式

if not re.match(r"^[a-zA-Z0-9._%+-]+@[a-zA-Z0-9.-]+\.[a-zA-Z]{2,}$", email):

raise ValueError("无效的电子邮件格式")

return email.lower()

我们之前已经定义了令牌的 Schema,但现在我们需要实际用于 Mint(创建)和 Verify(验证)它们的逻辑。

为此,我们将使用 JSON Web Tokens (JWT)。这些令牌是无状态的,这意味着我们不需要每次用户访问端点时都查询数据库来检查他们是否已登录,只需验证其加密签名即可。因此,让我们创建 app/utils/auth.py 文件。

import re

from datetime import UTC, datetime, timedelta

from typing import Optional

from jose import JWTError, jwt

from app.core.config import settings

from app.schemas.auth import Token

from app.utils.sanitization import sanitize_string

from app.core.logging import logger

# ==================================================

# JWT 认证工具

# ==================================================

def create_access_token(subject: str, expires_delta: Optional[timedelta] = None) -> Token:

"""

创建一个新的 JWT 访问令牌。

Args:

subject: 唯一标识符(用户 ID 或会话 ID)

expires_delta: 可选的自定义过期时间

"""

if expires_delta:

expire = datetime.now(UTC) + expires_delta

else:

expire = datetime.now(UTC) + timedelta(days=settings.JWT_ACCESS_TOKEN_EXPIRE_DAYS)

# 负载数据会被编码到令牌中

to_encode = {

"sub": subject, # 主题(标准声明)

"exp": expire, # 过期时间(标准声明)

"iat": datetime.now(UTC), # 签发时间(标准声明)

# JTI(JWT ID):此特定令牌实例的唯一标识符。

# 如果以后需要,可用于将令牌列入黑名单。

"jti": sanitize_string(f"{subject}-{datetime.now(UTC).timestamp()}"),

}

encoded_jwt = jwt.encode(to_encode, settings.JWT_SECRET_KEY, algorithm=settings.JWT_ALGORITHM)

return Token(access_token=encoded_jwt, expires_at=expire)

def verify_token(token: str) -> Optional[str]:

"""

解码并验证 JWT 令牌。如果有效,则返回主题(用户 ID)。

"""

try:

payload = jwt.decode(token, settings.JWT_SECRET_KEY, algorithms=[settings.JWT_ALGORITHM])

subject: str = payload.get("sub")

if subject is None:

return None

return subject

except JWTError as e:

# 如果签名无效或令牌已过期,jose 会抛出 JWTError

return None

现在我们已经有了认证和 sanitization 工具,接下来可以专注于为 LLM 上下文窗口准备消息。

上下文管理

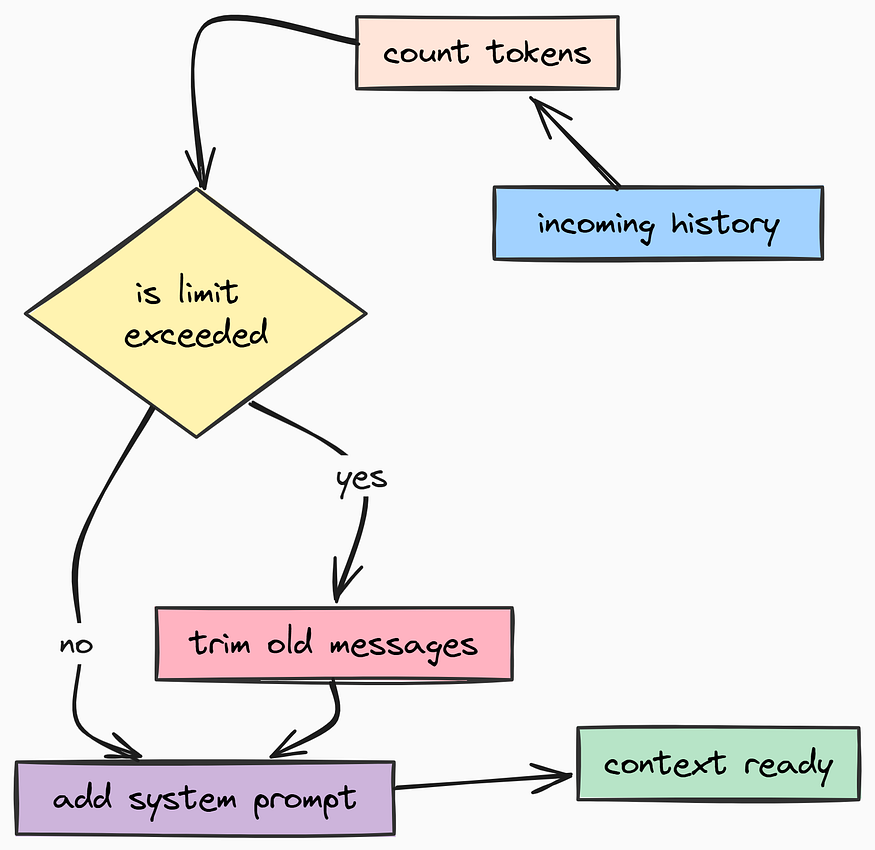

扩展 AI 应用程序最困难的部分之一就是 上下文窗口管理。如果你一直将消息追加到聊天记录中,最终会达到模型的 token 限制(或者你的钱包也会见底)。

在生产系统中,必须知道如何智能地“修剪”消息。

上下文管理(由 Fareed Khan 创作)

上下文管理(由 Fareed Khan 创作)

我们还需要处理较新模型输出格式的特殊性。例如,某些推理模型会将 Thought Blocks 与实际文本分开返回。为此,我们需要创建 app/utilss/graph.py 文件。

from langchain_core.language_models.chat_models import BaseChatModel

from langchain_core.messages import BaseMessage

from langchain_core.messages import trim_messages as _trim_messages

from app.core.config import settings

from app.schemas.chat import Message

# ==================================================

# LangGraph / LLM 工具

# ==================================================

def dump_messages(messages: list[Message]) -> list[dict]:

"""

将 Pydantic Message 模型转换为 OpenAI/LangChain 所期望的字典格式。

"""

return [message.model_dump() for message in messages]

def prepare_messages(messages: list[Message], llm: BaseChatModel, system_prompt: str) -> list[Message]:

"""

为 LLM 的上下文窗口准备消息历史记录。

重要提示:此函数可防止 token 溢出错误。

它会保留系统提示加上最近的、总 token 数不超过 'settings.MAX_TOKENS' 的消息。

"""

try:

# 基于 token 数量的智能修剪

trimmed_messages = _trim_messages(

dump_messages(messages),

strategy="last", # 保留最近的消息

token_counter=llm, # 使用特定模型的分词器

max_tokens=settings.MAX_TOKENS,

start_on="human", # 确保历史不会以悬空的 AI 回答开头

include_system=False, # 我们稍后手动添加系统提示

allow_partial=False,

)

except Exception as e:

# 如果 token 计数失败,则回退到原始消息(虽然罕见,但安全第一)

trimmed_messages = messages

# 始终在最前面添加系统提示,以确保代理行为的一致性

return [Message(role="system", content=system_prompt)] + trimmed_messages

def process_llm_response(response: BaseMessage) -> BaseMessage:

"""

对高级模型(如 GPT-5 预览版或 Claude)的响应进行标准化处理。

有些模型会将“推理”块与内容分开返回。本函数将其合并为一个单一的字符串。

"""

if isinstance(response.content, list):

text_parts = []

for block in response.content:

# 提取纯文本

if isinstance(block, dict) and block.get("type") == "text":

text_parts.append(block["text"])

# 如果需要,我们可以在这里记录推理块,但不会将其返回给 UI

elif isinstance(block, str):

text_parts.append(block)

response.content = "".join(text_parts)

return response

通过添加 prepare_messages 函数,我们确保即使用户进行了包含 500 条消息的对话,应用程序也不会崩溃。系统会自动遗忘最旧的上下文,为新消息腾出空间,从而有效控制成本并避免错误。

在配置好依赖项、设置、模型、数据结构、安全性以及工具类之后,我们需要构建 服务层,它负责实现应用的核心业务逻辑。

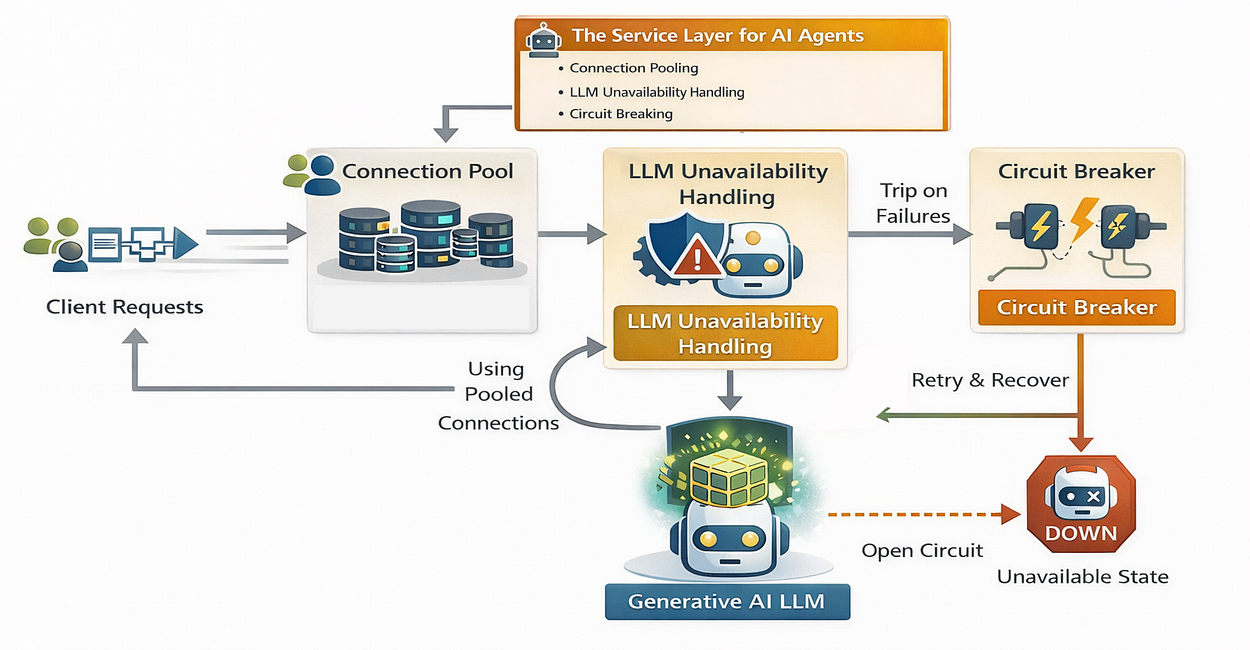

面向 AI 代理的服务层

在一个架构良好的应用中,API 路由(控制器)应当保持简洁。它们不应包含复杂的业务逻辑或直接的数据库查询。相反,这些工作应交由服务层来完成,这样可以使代码更易于测试、复用和维护。

服务层(由 Fareed Khan 创作)

服务层(由 Fareed Khan 创作)

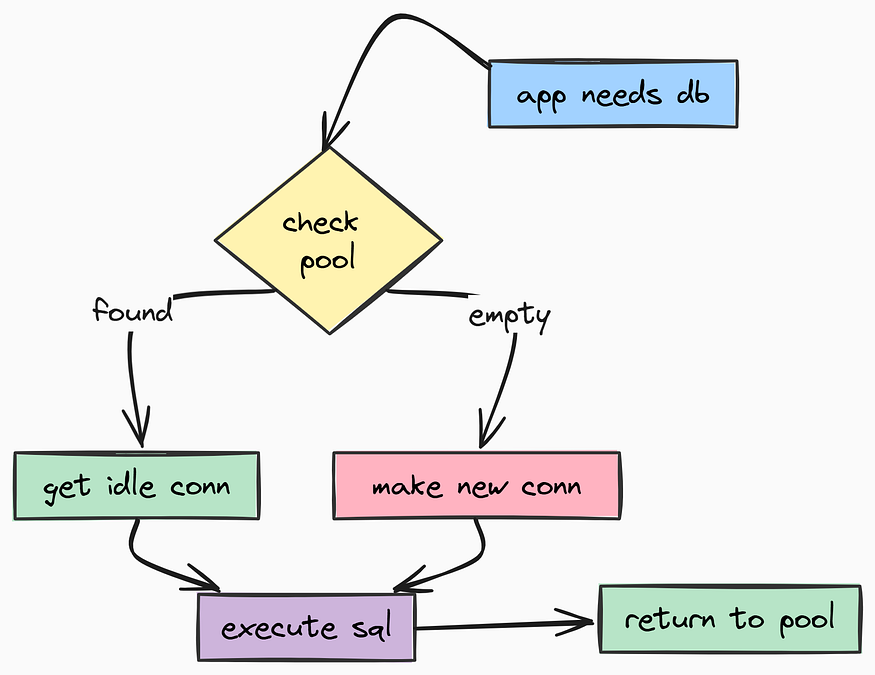

在脚本中连接数据库相对容易,但在高并发的 API 中为数千名用户提供服务则要困难得多。如果每次请求都打开一个新的数据库连接,那么在负载过重时数据库很可能会崩溃。

连接池

为了解决这个问题,我们将使用 连接池 技术。通过维持一个预先建立好的连接池,我们可以最大限度地减少每次连接时的握手开销。

连接池(由 Fareed Khan 创作)

连接池(由 Fareed Khan 创作)

让我们创建 app/services/database.py 文件来实现这一功能:

from typing import List, Optional

from fastapi import HTTPException

from sqlalchemy.exc import SQLAlchemyError

from sqlalchemy.pool import QueuePool

from sqlmodel import Session, SQLModel, create_engine, select

from app.core.config import Environment, settings

from app.core.logging import logger

from app.models.session import Session as ChatSession

from app.models.user import User

# ==================================================

# 数据库服务

# ==================================================

class DatabaseService:

"""

单例服务,负责处理所有数据库交互。

管理连接池并提供整洁的 CRUD 接口。

"""

def __init__(self):

"""

使用稳健的连接池设置初始化引擎。

"""

try:

# 从配置中构建连接 URL

connection_url = (

f"postgresql://{settings.POSTGRES_USER}:{settings.POSTGRES_PASSWORD}"

f"@{settings.POSTGRES_HOST}:{settings.POSTGRES_PORT}/{settings.POSTGRES_DB}"

)

# 配置 QueuePool 对于生产环境至关重要。

# pool_size:永久保持打开的连接数。

# max_overflow:在流量高峰时允许的最大临时连接数。

self.engine = create_engine(

connection_url,

pool_pre_ping=True, # 在使用连接前检查其是否可用

poolclass=QueuePool,

pool_size=settings.POSTGRES_POOL_SIZE,

max_overflow=settings.POSTGRES_MAX_OVERFLOW,

pool_timeout=30, # 如果30秒内无法获取连接则失败

pool_recycle=1800, # 每30分钟回收一次连接以防止套接字失效

)

# 如果表不存在,则创建它们(代码优先迁移)

SQLModel.metadata.create_all(self.engine)

logger.info("database_initialized", pool_size=settings.POSTGRES_POOL_SIZE)

except SQLAlchemyError as e:

logger.error("database_initialization_failed", error=str(e))

# 在开发环境中,我们可能希望直接崩溃。而在生产环境中,或许可以尝试重试。

if settings.ENVIRONMENT != Environment.PRODUCTION:

raise

# --------------------------------------------------

# 用户管理

# --------------------------------------------------

async def create_user(self, email: str, password_hash: str) -> User:

"""创建具有哈希密码的新用户"""

with Session(self.engine) as session:

user = User(email=email, hashed_password=password_hash)

session.add(user)

session.commit()

session.refresh(user)

return user

async def get_user_by_email(self, email: str) -> Optional[User]:

"""根据邮箱获取用户信息,用于登录流程"""

with Session(self.engine) as session:

statement = select(User).where(User.email == email)

return session.exec(statement).first()

# --------------------------------------------------

# 会话管理

# --------------------------------------------------

async def create_session(self, session_id: str, user_id: int, name: str = "") -> ChatSession:

"""创建与用户关联的新聊天会话"""

with Session(self.engine) as session:

chat_session = ChatSession(id=session_id, user_id=user_id, name=name)

session.add(chat_session)

session.commit()

session.refresh(chat_session)

return chat_session

async def get_user_sessions(self, user_id: int) -> List[ChatSession]:

"""列出特定用户的全部聊天记录"""

with Session(self.engine) as session:

statement = select(ChatSession).where(ChatSession.user_id == user_id).order_by(ChatSession.created_at)

return session.exec(statement).all()

# 创建一个全局单例实例

database_service = DatabaseService()

在这里,pool_pre_ping=True 非常重要。数据库有时会在后台静默关闭空闲连接。如果没有这个标志,你的 API 在一段安静期后第一次请求时就会抛出“Broken Pipe”错误。启用它后,SQLAlchemy 会在将连接交给你之前先检查其健康状况。

我们还将 pool_recycle 设置为 30 分钟。一些云提供商(如 AWS RDS)会在连接空闲一段时间后自动关闭连接。通过定期回收连接,可以避免此类问题。

其余部分则是非常简单的 CRUD 方法,用于创建和获取用户及聊天会话。

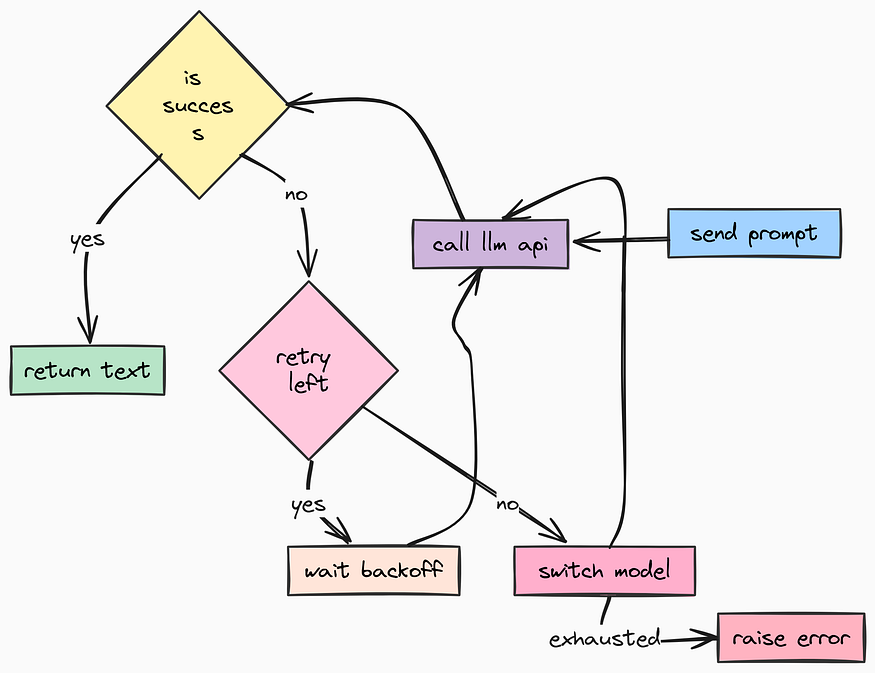

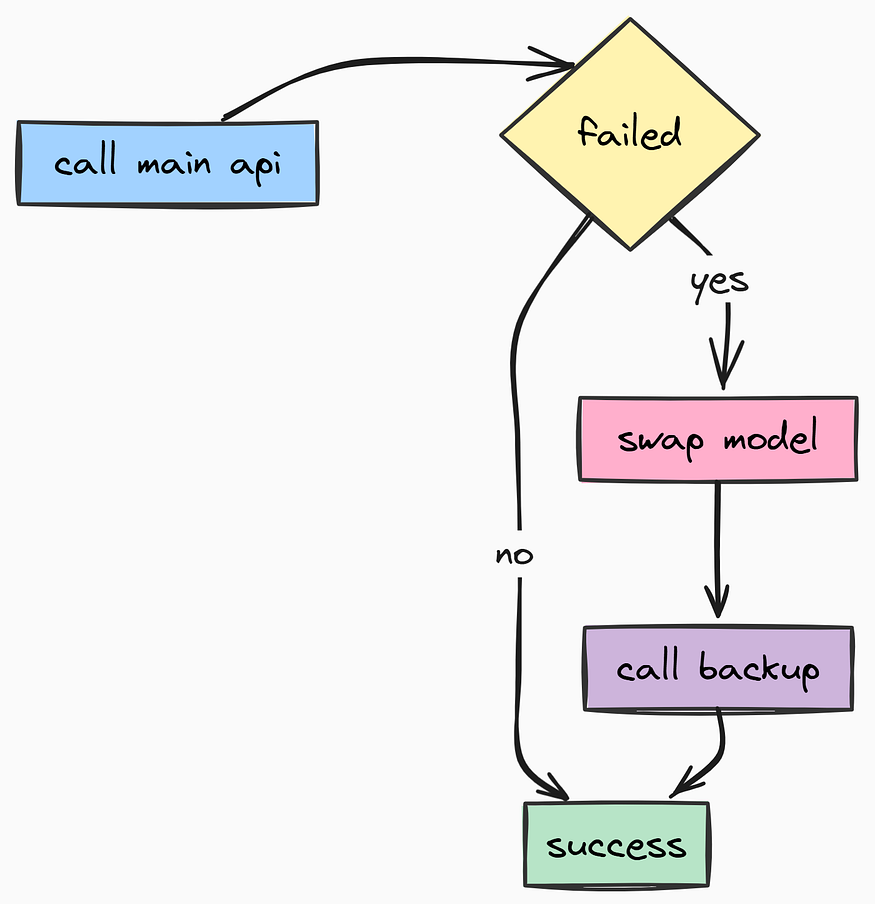

LLM 不可用性处理

依赖单一 AI 模型(如 GPT-4)存在风险。如果 OpenAI 出现故障怎么办?如果达到速率限制又该怎么办?生产系统需要具备弹性和后备机制,以确保高可用性。

LLM 检查(由 Fareed Khan 创作)

LLM 检查(由 Fareed Khan 创作)

我们将在此实现两种高级模式:

- 自动重试: 如果请求因网络波动而失败,就再次尝试。

- 循环回退: 如果

gpt-4o不可用,就自动切换到gpt-4o-mini或其他备用模型。

我们将使用 tenacity 库来实现指数退避重试策略,并使用 LangChain 进行模型抽象。让我们创建 app/services/llm.py 文件:

from typing import Any, Dict, List, Optional

from langchain_core.language_models.chat_models import BaseChatModel

from langchain_core.messages import BaseMessage

from langchain_openai import ChatOpenAI

from openai import APIError, APITimeoutError, OpenAIError, RateLimitError

from tenacity import (

before_sleep_log,

retry,

retry_if_exception_type,

stop_after_attempt,

wait_exponential,

)

from app.core.config import settings

from app.core.logging import logger

# ==================================================

# LLM 注册表

# ==================================================

class LLMRegistry:

"""

可用大模型的注册表。

这使我们能够在不修改代码的情况下动态切换“大脑”。

"""

# 我们预先配置了不同能力与成本的模型

LLMS: List[Dict[str, Any]] = [

{

"name": "gpt-5-mini", # 假设的或特定模型别名

"llm": ChatOpenAI(

model="gpt-5-mini",

api_key=settings.OPENAI_API_KEY,

max_tokens=settings.MAX_TOKENS,

# 新模型中的“推理”功能

reasoning={"effort": "low"},

),

},

{

"name": "gpt-4o",

"llm": ChatOpenAI(

model="gpt-4o",

temperature=settings.DEFAULT_LLM_TEMPERATURE,

api_key=settings.OPENAI_API_KEY,

max_tokens=settings.MAX_TOKENS,

),

},

{

"name": "gpt-4o-mini", # 更便宜的备用模型

"llm": ChatOpenAI(

model="gpt-4o-mini",

temperature=settings.DEFAULT_LLM_TEMPERATURE,

api_key=settings.OPENAI_API_KEY,

),

},

]

@classmethod

def get(cls, model_name: str) -> BaseChatModel:

"""根据名称获取特定模型实例。"""

for entry in cls.LLMS:

if entry["name"] == model_name:

return entry["llm"]

# 如果未找到,则默认使用第一个模型

return cls.LLMS[0]["llm"]

@classmethod

def get_all_names(cls) -> List[str]:

return [entry["name"] for entry in cls.LLMS]

在这个注册表中,我们定义了多种具有不同能力和成本的模型。这使得在需要时可以动态地在它们之间切换。

接下来,我们构建 LLMService,它负责所有与大模型的交互,并处理重试和回退逻辑:

# ==================================================

# LLM服务(弹性层)

# ==================================================

class LLMService:

"""

管理大模型调用,具备自动重试和回退逻辑。

"""

def __init__(self):

self._llm: Optional[BaseChatModel] = None

self._current_model_index: int = 0

# 使用设置中的默认模型进行初始化

try:

self._llm = LLMRegistry.get(settings.DEFAULT_LLM_MODEL)

all_names = LLMRegistry.get_all_names()

self._current_model_index = all_names.index(settings.DEFAULT_LLM_MODEL)

except ValueError:

# 安全回退机制

self._llm = LLMRegistry.LLMS[0]["llm"]

def _switch_to_next_model(self) -> bool:

"""

循环回退:切换到注册表中下一个可用的模型。

如果成功则返回True。

"""

try:

next_index = (self._current_model_index + 1) % len(LLMRegistry.LLMS)

next_model_entry = LLMRegistry.LLMS[next_index]

logger.warning(

"switching_model_fallback",

old_index=self._current_model_index,

new_model=next_model_entry["name"]

)

self._current_model_index = next_index

self._llm = next_model_entry["llm"]

return True

except Exception as e:

logger.error("model_switch_failed", error=str(e))

return False

# --------------------------------------------------

# 重试装饰器

# --------------------------------------------------

# 这是核心逻辑。当函数抛出特定异常时,

# Tenacity 会以指数级方式等待并重试。

@retry(

stop=stop_after_attempt(settings.MAX_LLM_CALL_RETRIES), # 最多重试3次

wait=wait_exponential(multiplier=1, min=2, max=10), # 等待2秒、4秒、8秒...

retry=retry_if_exception_type((RateLimitError, APITimeoutError, APIError)),

before_sleep=before_sleep_log(logger, "WARNING"), # 等待前记录日志

reraise=True,

)

async def _call_with_retry(self, messages: List[BaseMessage]) -> BaseMessage:

"""执行实际API调用的内部方法。"""

if not self._llm:

raise RuntimeError("LLM未初始化")

return await self._llm.ainvoke(messages)

async def call(self, messages: List[BaseMessage]) -> BaseMessage:

"""

公开接口。封装了重试逻辑及回退循环。

如果‘gpt-4o’失败3次,我们将切换到‘gpt-4o-mini’并再次尝试。

"""

total_models = len(LLMRegistry.LLMS)

models_tried = 0

while models_tried < total_models:

try:

# 尝试生成响应

return await self._call_with_retry(messages)

except OpenAIError as e:

# 如果当前模型已用尽重试次数,则记录日志并切换

models_tried += 1

logger.error(

"model_failed_exhausted_retries",

model=LLMRegistry.LLMS[self._current_model_index]["name"],

error=str(e)

)

if models_tried >= total_models:

# 所有模型都尝试过了。世界可能真的要末日了。

break

self._switch_to_next_model()

raise RuntimeError("在耗尽所有选项后,仍未能从任何LLM获得响应。")

def get_llm(self) -> BaseChatModel:

return self._llm

def bind_tools(self, tools: List) -> "LLMService":

"""将工具绑定到当前LLM实例上。"""

if self._llm:

self._llm = self._llm.bind_tools(tools)

return self

在这里,我们以循环方式调用 _switch_to_next_model。如果当前模型在用尽所有重试次数后仍然失败,我们就切换到列表中的下一个模型。在我们的重试装饰器中,我们指定了哪些异常应该触发重试(例如 RateLimitError 或 APITimeoutError)。

熔断机制

我们还将工具绑定到LLM实例上,以便它可以在代理环境中使用这些工具。

熔断(由Fareed Khan创作)

熔断(由Fareed Khan创作)

最后,我们创建一个全局的 LLMService 实例,以便在整个应用中轻松访问:

# 创建全局实例

llm_service = LLMService()

如果某个提供商出现重大故障,tenacity 会自动切换到备用模型。这样即使后端API不稳定,你的用户也很少会看到500错误页面。

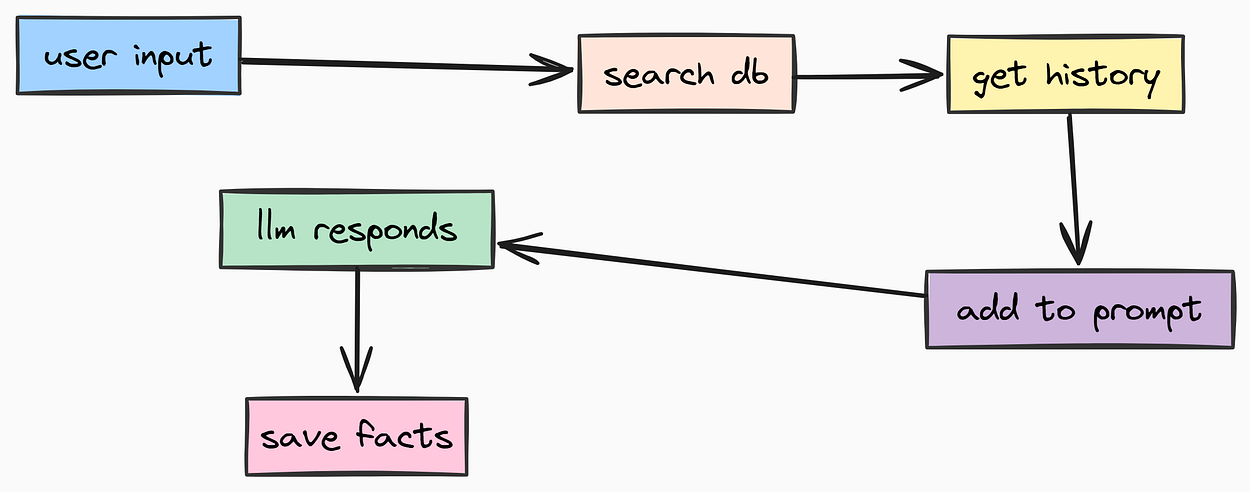

多智能体架构

现在我们将开始使用 LangGraph 构建我们的有状态 AI 智能体系统。与线性链(输入 →→ LLM →→ 输出)不同,LangGraph 允许我们构建 有状态的智能体。

这些智能体可以循环、重试、调用工具、记住过去的交互,并将它们的状态持久化到数据库中,这样即使服务器重启,它们也能从上次停止的地方继续工作。

在许多聊天应用中,用户期望 AI 能够在不同会话之间记住关于他们的 事实。例如,如果用户在一个会话中告诉 AI “我喜欢徒步旅行”,他们希望 AI 在未来的会话中仍然记得这一点。

长期记忆集成

因此,我们还将使用 mem0ai 集成 长期记忆。对话历史(短期记忆)帮助智能体记住 本次 聊天的内容,而长期记忆则帮助它记住用户在所有聊天中的 相关事实。

长期记忆(由 Fareed Khan 创作)

长期记忆(由 Fareed Khan 创作)

在生产系统中,我们将提示视为 资产,这意味着将其与代码分离。这样,提示工程师可以在不更改应用逻辑的情况下更新或改进提示。我们将这些提示存储为 Markdown 文件。让我们创建 app/core/prompts/system.md,用于定义我们智能体的系统提示:

# 名称: {agent_name}

# 角色: 世界级助手

帮助用户解答问题。

# 指令

- 始终保持友好和专业。

- 如果不知道答案,就说不知道,不要编造答案。

- 尽量给出最准确的答案。

# 关于用户的已知信息

{long_term_memory}

# 当前日期和时间

{current_date_and_time}

请注意其中的占位符,如 {long_term_memory}。我们将在运行时动态注入这些内容。

这是一个简单的提示,但在实际应用中,您可能需要使其更加详细,根据您的用例指定智能体的性格、约束条件和行为。

接下来,我们需要一个工具来加载这个提示,因此需要创建 app/core/prompts/__init__.py,用于读取 Markdown 文件并用动态变量进行格式化:

import os

from datetime import datetime

from app.core.config import settings

def load_system_prompt(**kwargs) -> str:

"""

从 Markdown 文件中加载系统提示,并注入动态变量。

"""

prompt_path = os.path.join(os.path.dirname(__file__), "system.md")

with open(prompt_path, "r") as f:

return f.read().format(

agent_name=settings.PROJECT_NAME + " Agent",

current_date_and_time=datetime.now().strftime("%Y-%m-%d %H:%M:%S"),

**kwargs, # 注入动态变量,如 'long_term_memory'

)

许多现代 AI 智能体需要与外部系统交互才能真正发挥作用。我们将这些能力定义为 工具。让我们赋予我们的智能体使用 DuckDuckGo 搜索互联网的能力,它比 Google 更安全且更注重隐私。

工具调用功能

工具功能(由 Fareed Khan 创作)

工具功能(由 Fareed Khan 创作)

我们需要为此单独创建一个文件 app/core/langgraph/tools/duckduck...rch.py,因为每个工具都应该是模块化的并且可测试的:

from langchain_community.tools import DuckDuckGoSearchResults

# 初始化工具

# 我们设置 num_results=10,以便为 LLM 提供充足的上下文

duckduckgo_search_tool = DuckDuckGoSearchResults(num_results=10, handle_tool_error=True)

然后我们在 app/core/langgraph/tools/__init__.py 中将其导出:

from langchain_core.tools.base import BaseTool

from .duckduckgo_search import duckduckgo_search_tool

# 智能体可用工具的中央注册表

tools: list[BaseTool] = [duckduckgo_search_tool]

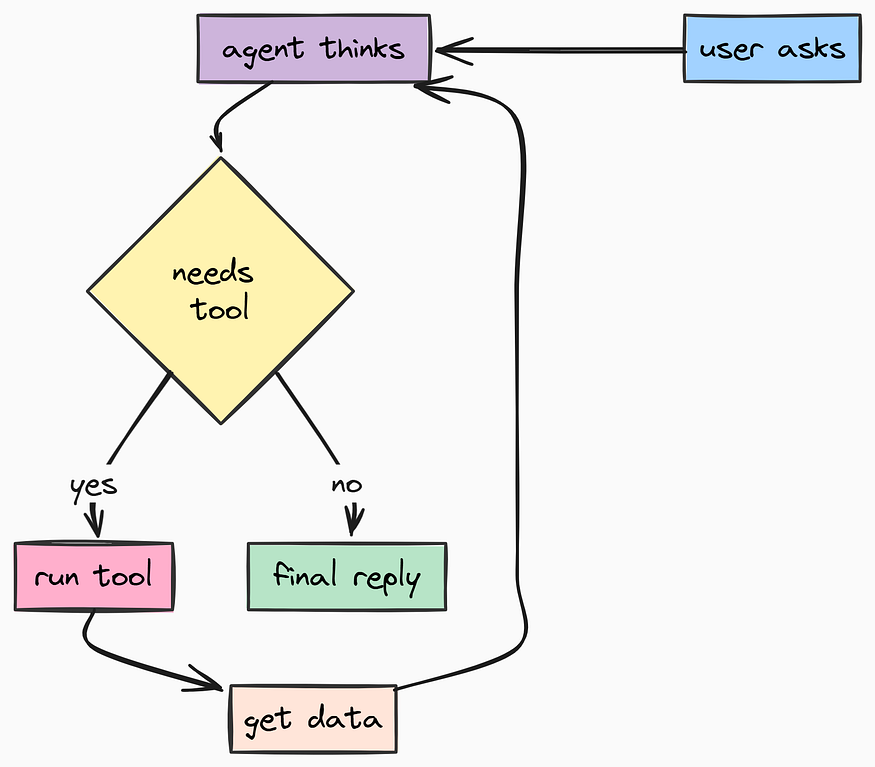

现在,我们将构建整个项目中最复杂、最关键的文件:app/core/langgraph/graph.py。该文件包含四个主要组成部分:

- 状态管理: 加载/保存对话状态到 Postgres 数据库。

- 记忆检索: 从

mem0ai获取用户的相关信息。 - 执行循环: 调用 LLM,解析工具调用并执行它们。

- 流式传输: 实时向用户发送响应令牌。

AI 工程师可能已经了解为什么这些组件是必要的,因为它们包含了 AI 智能体的核心逻辑。

mem0i 是一种针对 AI 应用优化的向量数据库,广泛用于长期记忆的存储。我们将使用它来存储和检索与用户相关的上下文。让我们逐步编写代码:

import asyncio

from typing import AsyncGenerator, Optional

from urllib.parse import quote_plus

from asgiref.sync import sync_to_async

from langchain_core.messages import ToolMessage, convert_to_openai_messages

from langfuse.langchain import CallbackHandler

from langgraph.checkpoint.postgres.aio import AsyncPostgresSaver

from langgraph.graph import END, StateGraph

from langgraph.graph.state import Command, CompiledStateGraph

from langgraph.types import RunnableConfig, StateSnapshot

from mem0 import AsyncMemory

from psycopg_pool import AsyncConnectionPool

from app.core.config import Environment, settings

from app.core.langgraph.tools import tools

from app.core.logging import logger

from app.core.prompts import load_system_prompt

from app.schemas import GraphState, Message

from app.services.llm import llm_service

from app.utils import dump_messages, prepare_messages, process_llm_response

class LangGraphAgent:

"""

管理 LangGraph 工作流、LLM 交互以及记忆的持久化。

"""

def __init__(self):

# 将工具绑定到 LLM 服务,使模型知道它可以调用哪些函数

self.llm_service = llm_service.bind_tools(tools)

self.tools_by_name = {tool.name: tool for tool in tools}

self._connection_pool: Optional[AsyncConnectionPool] = None

self._graph: Optional[CompiledStateGraph] = None

self.memory: Optional[AsyncMemory] = None

logger.info("langgraph_agent_initialized", model=settings.DEFAULT_LLM_MODEL)

async def _long_term_memory(self) -> AsyncMemory:

"""

按需加载 mem0ai 记忆客户端,并配置 pgvector。

"""

if self.memory is None:

self.memory = await AsyncMemory.from_config(

config_dict={

"vector_store": {

"provider": "pgvector",

"config": {

"collection_name": "agent_memory",

"dbname": settings.POSTGRES_DB,

"user": settings.POSTGRES_USER,

"password": settings.POSTGRES_PASSWORD,

"host": settings.POSTGRES_HOST,

"port": settings.POSTGRES_PORT,

},

},

"llm": {

"provider": "openai",

"config": {"model": settings.DEFAULT_LLM_MODEL},

},

"embedder": {

"provider": "openai",

"config": {"model": "text-embedding-3-small"}

},

}

)

return self.memory

async def _get_connection_pool(self) -> AsyncConnectionPool:

"""

建立专门用于 LangGraph 检查点的连接池。

"""

if self._connection_pool is None:

connection_url = (

"postgresql://"

f"{quote_plus(settings.POSTGRES_USER)}:{quote_plus(settings.POSTGRES_PASSWORD)}"

f"@{settings.POSTGRES_HOST}:{settings.POSTGRES_PORT}/{settings.POSTGRES_DB}"

)

self._connection_pool = AsyncConnectionPool(

connection_url,

open=False,

max_size=settings.POSTGRES_POOL_SIZE,

kwargs={"autocommit": True}

)

await self._connection_pool.open()

return self._connection_pool

# ==================================================

# 节点逻辑

# ==================================================

async def _chat(self, state: GraphState, config: RunnableConfig) -> Command:

"""

主聊天节点。

1. 加载包含记忆上下文的系统提示。

2. 准备消息(必要时进行裁剪)。

3. 调用 LLM 服务。

"""

# 加载从先前步骤中获取的长期记忆中的系统提示

SYSTEM_PROMPT = load_system_prompt(long_term_memory=state.long_term_memory)

# 准备上下文窗口(进行裁剪)

current_llm = self.llm_service.get_llm()

messages = prepare_messages(state.messages, current_llm, SYSTEM_PROMPT)

try:

# 调用 LLM(由服务层处理重试)

response_message = await self.llm_service.call(dump_messages(messages))

response_message = process_llm_response(response_message)

# 确定路由:如果 LLM 想使用工具,则转到 'tool_call',否则结束。

if response_message.tool_calls:

goto = "tool_call"

else:

goto = END

# 返回命令以更新状态并进行路由

return Command(update={"messages": [response_message]}, goto=goto)

except Exception as e:

logger.error("llm_call_node_failed", error=str(e))

raise

async def _tool_call(self, state: GraphState) -> Command:

"""

工具执行节点。

执行请求的工具并将结果返回给聊天节点。

"""

outputs = []

for tool_call in state.messages[-1].tool_calls:

# 执行工具

tool_result = await self.tools_by_name[tool_call["name"]].ainvoke(tool_call["args"])

# 将结果格式化为 ToolMessage

outputs.append(

ToolMessage(

content=str(tool_result),

name=tool_call["name"],

tool_call_id=tool_call["id"],

)

)

# 使用工具输出更新状态,并循环回到 '_chat'

return Command(update={"messages": outputs}, goto="chat")

# ==================================================

# 图编译

# ==================================================

async def create_graph(self) -> CompiledStateGraph:

"""

构建状态图并附加 Postgres 检查点器。

"""

if self._graph is not None:

return self._graph

graph_builder = StateGraph(GraphState)

# 添加节点

graph_builder.add_node("chat", self._chat)

graph_builder.add_node("tool_call", self._tool_call)

# 定义流程

graph_builder.set_entry_point("chat")

# 设置持久化

connection_pool = await self._get_connection_pool()

checkpointer = AsyncPostgresSaver(connection_pool)

await checkpointer.setup() # 确保表已存在

self._graph = graph_builder.compile(checkpointer=checkpointer)

return self._graph

# ==================================================

# 公共方法

# ==================================================

async def get_response(self, messages: list[Message], session_id: str, user_id: str) -> list[dict]:

"""

API 的主要入口点。

处理记忆检索 + 图执行 + 记忆更新。

"""

if self._graph is None:

await self.create_graph()

# 1. 从长期记忆中检索相关事实(向量搜索)

# 我们根据用户最后一条消息进行搜索

memory_client = await self._long_term_memory()

relevant_memory = await memory_client.search(

user_id=user_id,

query=messages[-1].content

)

memory_context = "\n".join([f"* {res['memory']}" for res in relevant_memory.get("results", [])])

# 2. 运行图

config = {

"configurable": {"thread_id": session_id},

"callbacks": [CallbackHandler()], # Langfuse 跟踪

}

input_state = {

"messages": dump_messages(messages),

"long_term_memory": memory_context or "未找到相关记忆。"

}

final_state = await self._graph.ainvoke(input_state, config=config)

# 3. 在后台更新记忆(即发即弃)

# 我们不希望用户等待我们保存新记忆。

asyncio.create_task(

self._update_long_term_memory(user_id, final_state["messages"])

)

return self._process_messages(final_state["messages"])

async def _update_long_term_memory(self, user_id: str, messages: list) -> None:

"""从对话中提取并保存新的事实到 pgvector 中"""

try:

memory_client = await self._long_term_memory()

# mem0ai 自动使用 LLM 提取事实

await memory_client.add(messages, user_id=user_id)

except Exception as e:

logger.error("memory_update_failed", error=str(e))

def _process_messages(self, messages: list) -> list[Message]:

"""将内部 LangChain 消息转换回 Pydantic 模型"""

openai_msgs = convert_to_openai_messages(messages)

return [

Message(role=m["role"], content=str(m["content"]))

for m in openai_msgs

if m["role"] in ["assistant", "user"] and m["content"]

]

那么,让我们调试一下刚刚构建的内容:

- 图节点: 我们定义了两个主要节点:

_chat负责调用 LLM,以及_tool_call负责执行任何请求的工具。 - 状态管理: 图使用

AsyncPostgresSaver在每一步后持久化状态,从而可以在崩溃后恢复。 - 记忆集成: 在开始聊天之前,我们会从

mem0ai获取与用户相关的事实,并将其注入系统提示中。聊天结束后,我们会异步提取并保存新的事实。 - 可观测性: 我们附加了

Langfuse CallbackHandler来跟踪图执行的每一步。 - 最后,我们公开了一个简单的

get_response方法,API 可以通过该方法在给定消息历史和会话/用户上下文的情况下获取代理的响应。

在生产环境中,你不能简单地将 AI 代理暴露在公共互联网上。你需要知道 谁 正在调用你的 API(身份验证)以及 他们被允许做什么(授权)。

构建 API 网关

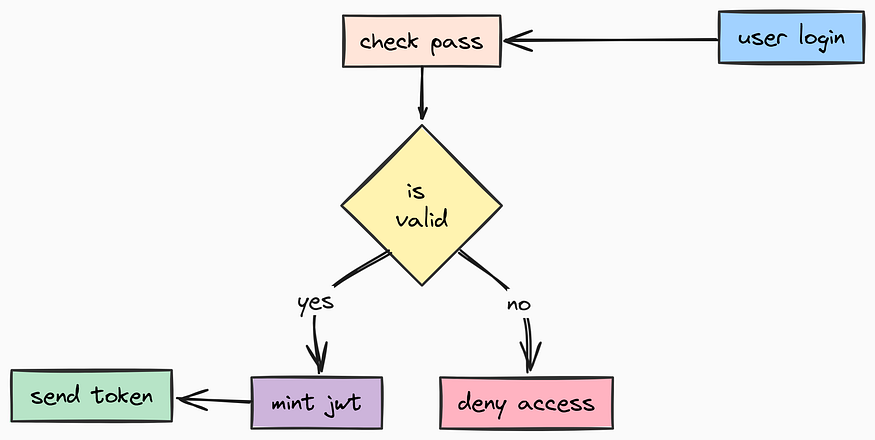

我们将首先构建身份验证端点。这包括注册、登录和会话管理。我们将使用 FastAPI 的 依赖注入 系统来高效地保护我们的路由。

让我们开始构建 app/api/v1/auth.py。

首先,我们需要设置导入并定义安全方案。我们使用 HTTPBearer,它要求一个类似 Authorization: Bearer <token> 的头部。

import uuid

from typing import List

from fastapi import (

APIRouter,

Depends,

Form,

HTTPException,

Request,

)

from fastapi.security import (

HTTPAuthorizationCredentials,

HTTPBearer,

)

from app.core.config import settings

from app.core.limiter import limiter

from app.core.logging import bind_context, logger

from app.models.session import Session

from app.models.user import User

from app.schemas.auth import (

SessionResponse,

TokenResponse,

UserCreate,

UserResponse,

)

from app.services.database import DatabaseService, database_service

from app.utils.auth import create_access_token, verify_token

from app.utils.sanitization import (

sanitize_email,

sanitize_string,

validate_password_strength,

)

router = APIRouter()

security = HTTPBearer()

现在到了我们 API 安全中最关键的部分:依赖函数。

认证端点

在 FastAPI 中,我们不会在每个路由函数中手动检查令牌。那样既重复又容易出错。相反,我们会创建一个可重用的依赖项 get_current_user。

认证流程(由 Fareed Khan 创作)

认证流程(由 Fareed Khan 创作)

当某个路由声明 user: User = Depends(get_current_user) 时,FastAPI 会自动:

- 从请求头中提取令牌。

- 执行该函数。

- 如果成功,则将 User 对象注入到路由中。

- 如果失败,则以 401 错误终止请求。

async def get_current_user(

credentials: HTTPAuthorizationCredentials = Depends(security),

) -> User:

"""

验证 JWT 令牌并返回当前用户的依赖项。

"""

try:

# 对令牌输入进行清理,防止通过请求头注入攻击

token = sanitize_string(credentials.credentials)

user_id = verify_token(token)

if user_id is None:

logger.warning("invalid_token_attempt")

raise HTTPException(

status_code=401,

detail="无效的身份验证凭证",

headers={"WWW-Authenticate": "Bearer"},

)

# 验证用户是否确实存在于数据库中

user_id_int = int(user_id)

user = await database_service.get_user(user_id_int)

if user is None:

logger.warning("user_not_found_from_token", user_id=user_id_int)

raise HTTPException(

status_code=404,

detail="用户未找到",

headers={"WWW-Authenticate": "Bearer"},

)

# 关键:将用户上下文绑定到结构化日志中。

# 此后生成的任何日志都会自动包含 user_id。

bind_context(user_id=user_id_int)

return user

except ValueError as ve:

logger.error("token_validation_error", error=str(ve))

raise HTTPException(

status_code=422,

detail="令牌格式无效",

headers={"WWW-Authenticate": "Bearer"},

)

我们还需要一个用于 会话 的依赖项。由于我们的聊天架构是基于会话的(用户可以有多个聊天线程),有时我们需要对特定会话进行身份验证,而不仅仅是对用户本身。

async def get_current_session(

credentials: HTTPAuthorizationCredentials = Depends(security),

) -> Session:

"""

验证会话专用 JWT 令牌的依赖项。

"""

try:

token = sanitize_string(credentials.credentials)

session_id = verify_token(token)

if session_id is None:

raise HTTPException(status_code=401, detail="无效的令牌")

session_id = sanitize_string(session_id)

# 验证会话是否存在于数据库中

session = await database_service.get_session(session_id)

if session is None:

raise HTTPException(status_code=404, detail="会话未找到")

# 绑定日志上下文

bind_context(user_id=session.user_id, session_id=session.id)

return session

except ValueError as ve:

raise HTTPException(status_code=422, detail="令牌格式无效")

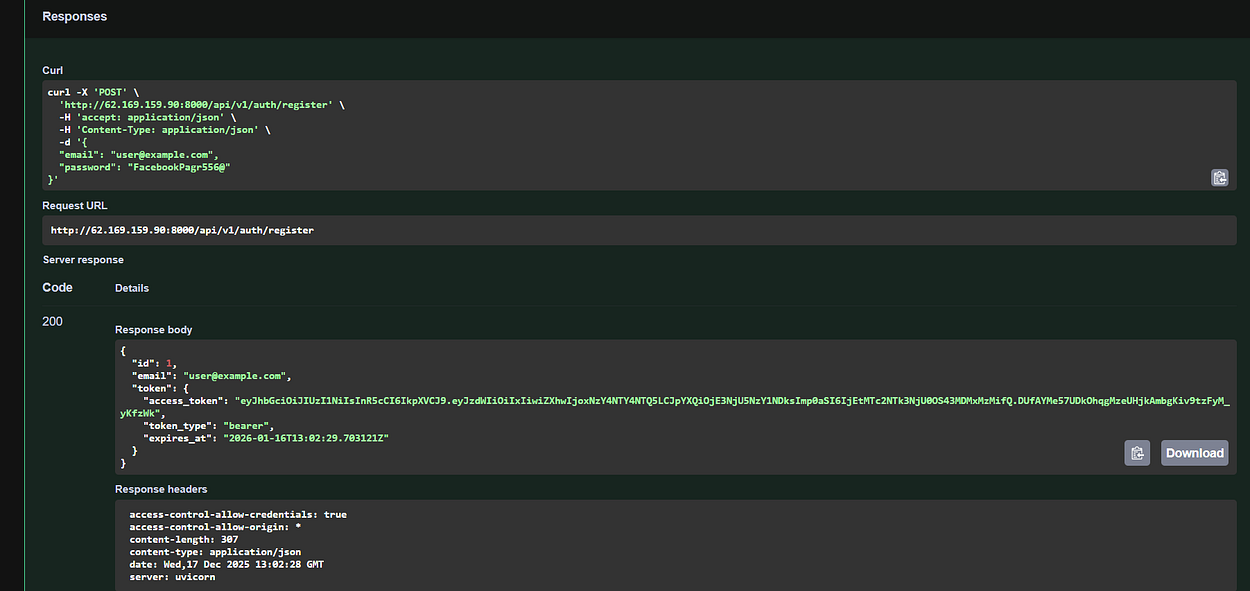

现在我们可以构建端点了。首先是 用户注册。

实时流

我们在这里使用了限流器,因为注册端点是垃圾机器人攻击的主要目标。

实时流(由 Fareed Khan 创作)

实时流(由 Fareed Khan 创作)

我们还对输入进行了严格的清理,以保持数据库的整洁。

@router.post("/register", response_model=UserResponse)

@limiter.limit(settings.RATE_LIMIT_ENDPOINTS["register"][0])

async def register_user(request: Request, user_data: UserCreate):

"""

注册新用户。

"""

try:

# 1. 清理与验证

sanitized_email = sanitize_email(user_data.email)

password = user_data.password.get_secret_value()

validate_password_strength(password)

# 2. 检查是否存在

if await database_service.get_user_by_email(sanitized_email):

raise HTTPException(status_code=400, detail="该邮箱已注册")

# 3. 创建用户(哈希在模型内部完成)

# 注意:User.hash_password 是静态方法,但我们通常在服务或模型逻辑中处理它。

# 在这里,我们将明文密码传递给服务层,由其负责哈希处理,

# 或者如果服务层期望的是哈希值,则在此处进行哈希。

# 根据我们之前的服务实现,我们在这里进行哈希:

hashed = User.hash_password(password)

user = await database_service.create_user(email=sanitized_email, password_hash=hashed)

# 4. 自动登录(生成令牌)

token = create_access_token(str(user.id))

return UserResponse(id=user.id, email=user.email, token=token)

except ValueError as ve:

logger.warning("registration_validation_failed", error=str(ve))

raise HTTPException(status_code=422, detail=str(ve))

接下来是 登录。标准的 OAuth2 流程通常使用表单数据(username 和 password 字段)而不是 JSON 来进行登录。我们在这里也支持这种模式。

@router.post("/login", response_model=TokenResponse)

@limiter.limit(settings.RATE_LIMIT_ENDPOINTS["login"][0])

async def login(

request: Request,

username: str = Form(...),

password: str = Form(...),

grant_type: str = Form(default="password")

):

"""

用户认证并返回 JWT 令牌。

"""

try:

# 清理

username = sanitize_string(username)

password = sanitize_string(password)

if grant_type != "password":

raise HTTPException(status_code=400, detail="不支持的授权类型")

# 验证用户

user = await database_service.get_user_by_email(username)

if not user || !user.verify_password(password):

logger.warning("login_failed", email=username)

raise HTTPException(

status_code=401,

detail="邮箱或密码错误",

headers={"WWW-Authenticate": "Bearer"},

)

token = create_access_token(str(user.id))

logger.info("user_logged_in", user_id=user.id)

return TokenResponse(

access_token=token.access_token,

token_type="bearer",

expires_at=token.expires_at

)

except ValueError as ve:

raise HTTPException(status_code=422, detail=str(ve))

最后,我们需要管理 会话。在我们的 AI 代理架构中,一个用户可以拥有多个“线程”或“会话”。每个会话都有自己的记忆上下文。

/session 端点会生成一个新的唯一 ID(UUID),在数据库中创建一条记录,并返回一个专门用于该会话的令牌。这使得前端可以轻松地在不同的聊天线程之间切换。

@router.post("/session", response_model=SessionResponse)

async def create_session(user: User = Depends(get_current_user)):

"""

为已认证用户创建一个新的聊天会话(线程)。

"""

try:

# 生成一个安全的随机 UUID

session_id = str(uuid.uuid4())

# 存储到数据库

session = await database_service.create_session(session_id, user.id)

# 为该会话 ID 创建一个专用令牌

# 此令牌允许 Chatbot API 识别要写入哪个线程

token = create_access_token(session_id)

logger.info("session_created", session_id=session_id, user_id=user.id)

return SessionResponse(session_id=session_id, name=session.name, token=token)

except Exception as e:

logger.error("session_creation_failed", error=str(e))

raise HTTPException(status_code=500, detail="无法创建会话")

@router.get("/sessions", response_model=List[SessionResponse])

async def get_user_sessions(user: User = Depends(get_current_user)):

"""

获取用户的所有历史聊天会话。

"""

sessions = await database_service.get_user_sessions(user.id)

return [

SessionResponse(

session_id=s.id,

name=s.name,

# 我们重新颁发令牌,以便 UI 可以恢复这些聊天

token=create_access_token(s.id)

)

for s in sessions

]

通过这种方式构建身份验证系统,我们已经为应用程序的安全入口提供了保障。所有请求在进入我们的 AI 逻辑之前,都会经过限流、清理和加密验证。

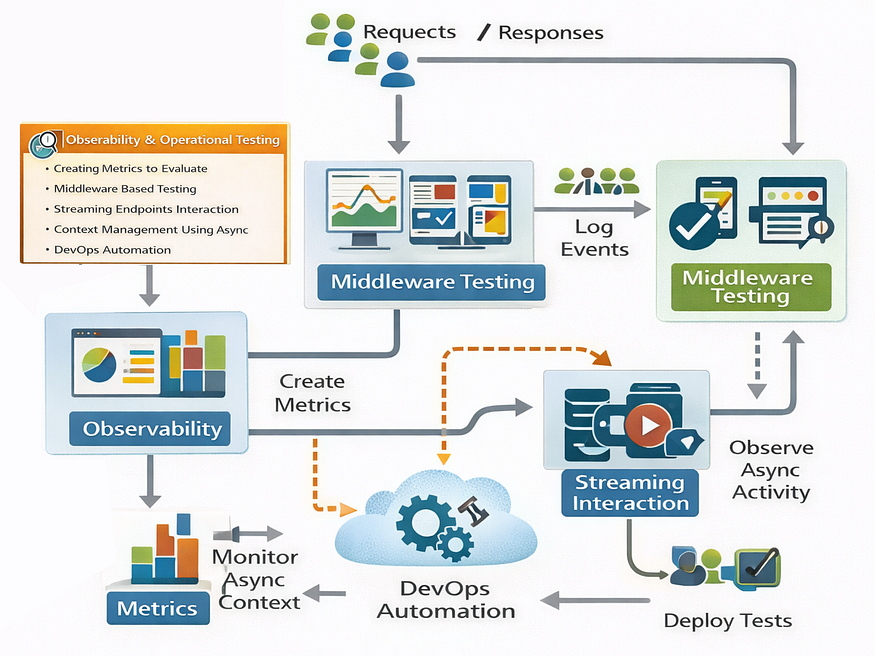

可观测性与运维测试

在一个服务 10,000 名用户的系统中,我们需要知道系统运行的速度、谁在使用它以及哪里出现了错误。这就是所谓的 可观测性。

在生产规模下,我们通过 Prometheus 指标 和 上下文感知日志记录 来实现这一点,这有助于我们将问题追溯到特定的用户或会话。

可观测性(由 Fareed Khan 创作)

可观测性(由 Fareed Khan 创作)

首先,让我们定义想要跟踪的指标。我们使用 prometheus_client 库来暴露计数器和直方图。

创建评估指标

为此,我们需要 app/core/metrics.py 文件来定义并暴露我们的 Prometheus 指标:

from prometheus_client import Counter, Histogram, Gauge

from starlette_prometheus import metrics, PrometheusMiddleware

# ==================================================

# Prometheus 指标定义

# ==================================================

# 1. 标准 HTTP 指标

# 按方法(GET/POST)和状态码(200、400、500)统计总请求数

http_requests_total = Counter(

"http_requests_total",

"HTTP 请求总数",

["method", "endpoint", "status"]

)

# 跟踪延迟分布(p50、p95、p99)

# 这有助于我们识别慢速端点。

http_request_duration_seconds = Histogram(

"http_request_duration_seconds",

"HTTP 请求耗时(秒)",

["method", "endpoint"]

)

# 2. 基础设施指标

# 帮助我们检测 SQLAlchemy 中的连接泄漏

db_connections = Gauge(

"db_connections",

"当前活动的数据库连接数"

)

# 3. AI / 业务逻辑指标

# 对跟踪 LLM 性能和成本至关重要。

# 我们使用自定义的分桶区间,因为 LLM 调用比数据库调用慢得多。

llm_inference_duration_seconds = Histogram(

"llm_inference_duration_seconds",

"LLM 推理处理所花费的时间",

["model"],

buckets=[0.1, 0.5, 1.0, 2.0, 5.0, 10.0, 30.0]

)

llm_stream_duration_seconds = Histogram(

"llm_stream_duration_seconds",

"LLM 流式推理处理所花费的时间",

["model"],

buckets=[0.1, 0.5, 1.0, 2.0, 5.0, 10.0, 60.0]

)

def setup_metrics(app):

"""

配置 Prometheus 中间件并暴露 /metrics 端点。

"""

app.add_middleware(PrometheusMiddleware)

app.add_route("/metrics", metrics)

在这里,我们定义了基本的 HTTP 指标(请求计数和延迟)、数据库连接数量指标,以及用于跟踪推理时间的 LLM 特定指标。

然而,仅仅定义指标是不够的,我们还需要实际更新这些指标。此外,还有一个日志记录问题:通常的日志信息只是“处理请求时出错”。但在繁忙的系统中,具体是哪个请求、哪个用户呢?

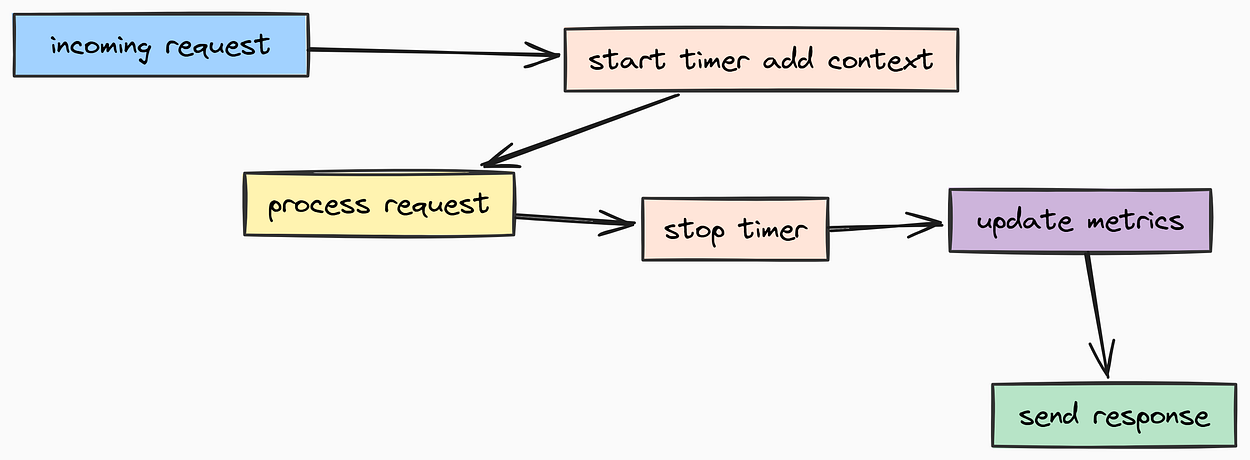

基于中间件的测试

开发人员通常会通过中间件来同时解决这两个问题。中间件会包裹每个请求,从而允许我们:

- 在请求开始前启动计时器;

- 在响应返回后停止计时器;

- 将

user_id和session_id注入到日志上下文中。

中间件测试(由 Fareed Khan 创作)

中间件测试(由 Fareed Khan 创作)

让我们创建 app/core/middleware.py 文件,实现指标监控和日志上下文管理两种中间件:

import time

from typing import Callable

from fastapi import Request

from jose import JWTError, jwt

from starlette.middleware.base import BaseHTTPMiddleware

from starlette.responses import Response

from app.core.config import settings

from app.core.logging import bind_context, clear_context

from app.core.metrics import (

http_request_duration_seconds,

http_requests_total,

)

# ==================================================

# 指标监控中间件

# ==================================================

class MetricsMiddleware(BaseHTTPMiddleware):

"""

自动跟踪请求耗时和状态码的中间件。

"""

async def dispatch(self, request: Request, call_next: Callable) -> Response:

start_time = time.time()

try:

# 处理实际请求

response = await call_next(request)

status_code = response.status_code

return response

except Exception:

# 如果应用崩溃,我们仍希望记录 500 错误

status_code = 500

raise

finally:

# 即使失败也计算耗时

duration = time.time() - start_time

# 记录到 Prometheus

# 我们过滤掉 /metrics 和 /health 路径以避免噪音

if request.url.path not in ["/metrics", "/health"]:

http_requests_total.labels(

method=request.method,

endpoint=request.url.path,

status=status_code

).inc()

http_request_duration_seconds.labels(

method=request.method,

endpoint=request.url.path

).observe(duration)

# ==================================================

# 日志上下文中间件

# ==================================================

class LoggingContextMiddleware(BaseHTTPMiddleware):

"""

在请求到达路由处理器之前,从 JWT 中提取用户 ID 的中间件。

这样可以确保即使认证错误也会带有正确的上下文信息被记录下来。

"""

async def dispatch(self, request: Request, call_next: Callable) -> Response:

try:

# 1. 重置上下文(对异步和线程安全至关重要)

clear_context()

# 2. 尝试读取 Authorization 头部

# 注意:这里我们不验证令牌(这由认证依赖完成),

# 只是为了尽可能地提取 ID 用于日志记录。

auth_header = request.headers.get("authorization")

if auth_header and auth_header.startswith("Bearer "):

token = auth_header.split(" ")[1]

try:

# 使用不安全解码方式仅获取 'sub' 字段(用户/会话 ID)

# 实际的签名验证会在路由处理器中进行。

payload = jwt.get_unverified_claims(token)

subject = payload.get("sub")

if subject:

bind_context(subject_id=subject)

except JWTError:

pass # 在日志中间件中忽略格式错误的令牌

# 3. 处理请求

response = await call_next(request)

# 4. 如果路由处理器设置了特定的上下文信息(如 found_user_id),则将其绑定

if hasattr(request.state, "user_id"):

bind_context(user_id=request.state.user_id)

return response

finally:

# 清理上下文,防止信息泄露到共享该线程的下一个请求

clear_context()

我们编写了两个中间件类:

- MetricsMiddleware: 跟踪请求耗时和状态码,并更新 Prometheus 指标。

- LoggingContextMiddleware: 从 JWT 令牌中提取用户/会话 ID,并将其绑定到日志上下文中,从而生成更丰富的日志信息。

借助这些中间件,我们应用程序中的每一条日志——无论是“数据库已连接”还是“LLM 请求失败”——都会自动携带诸如 {"request_duration": 0.45s, "user_id": 123} 之类的元数据。

流式端点交互

现在我们需要构建前端将调用的、用于与我们的 LangGraph 代理交互的聊天机器人 API 端点。

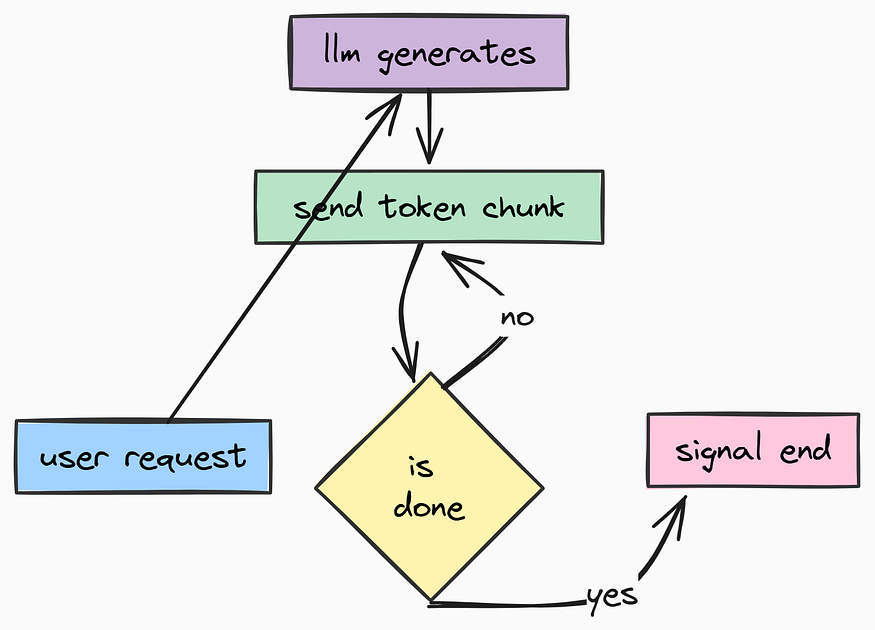

我们需要处理两种类型的交互:

- 标准聊天: 发送消息,等待,获取响应(阻塞式)。

- 流式聊天: 发送消息,实时获取 token(非阻塞式)。

在生产级 AI 系统中,流式处理并不是可选的。大模型的推理速度较慢。如果用户需要等待 10 秒才能看到完整的一段文字,体验会非常糟糕;而当文本即时显示时,用户会感到神奇。我们将使用服务器发送事件(SSE)来实现这一功能。

让我们创建 app/api/v1/chatbot.py。

首先,我们设置导入并初始化代理。请注意,我们在模块级别初始化了 LangGraphAgent。这样做可以确保不会在每次请求时都重新构建图结构,否则将会导致严重的性能问题。

import json

from typing import List

from fastapi import (

APIRouter,

Depends,

HTTPException,

Request,

)

from fastapi.responses import StreamingResponse

from app.api.v1.auth import get_current_session

from app.core.config import settings

from app.core.langgraph.graph import LangGraphAgent

from app.core.limiter import limiter

from app.core.logging import logger

from app.core.metrics import llm_stream_duration_seconds

from app.models.session import Session

from app.schemas.chat import (

ChatRequest,

ChatResponse,

Message,

StreamResponse,

)

router = APIRouter()

# 初始化 Agent 逻辑一次

agent = LangGraphAgent()

此端点适用于简单的交互,或当您需要一次性获取完整的 JSON 响应时(例如,用于自动化测试或非交互式客户端)。

我们使用 Depends(get_current_session) 来确保:

- 用户已登录。

- 他们正在写入属于自己的有效会话。

@router.post("/chat", response_model=ChatResponse)

@limiter.limit(settings.RATE_LIMIT_ENDPOINTS["chat"][0])

async def chat(

request: Request,

chat_request: ChatRequest,

session: Session = Depends(get_current_session),

):

"""

标准的请求/响应聊天端点。执行完整的 LangGraph 工作流并返回最终状态。

"""

try:

logger.info(

"chat_request_received",

session_id=session.id,

message_count=len(chat_request.messages),

)

# 将执行委托给我们的 LangGraph Agent

# session.id 成为图持久化的“thread_id”

result = await agent.get_response(

chat_request.messages,

session_id=session.id,

user_id=str(session.user_id)

)

logger.info("chat_request_processed", session_id=session.id)

return ChatResponse(messages=result)

except Exception as e:

logger.error("chat_request_failed", session_id=session.id, error=str(e), exc_info=True)

raise HTTPException(status_code=500, detail=str(e))

这是旗舰级端点。在 Python/FastAPI 中实现流式传输比较复杂,因为必须从异步生成器中逐段输出数据,同时保持连接打开。

我们将使用 Server-Sent Events (SSE) 格式(data: {...}\n\n)。这是一种标准协议,所有前端框架(React、Vue、HTMX)都能原生理解。

@router.post("/chat/stream")

@limiter.limit(settings.RATE_LIMIT_ENDPOINTS["chat_stream"][0])

async def chat_stream(

request: Request,

chat_request: ChatRequest,

session: Session = Depends(get_current_session),

):

"""

使用 Server-Sent Events (SSE) 的流式聊天端点。允许 UI 在文本生成时逐字符显示。

"""

try:

logger.info("stream_chat_init", session_id=session.id)

async def event_generator():

"""

内部生成器,按 SSE 格式逐段输出数据。

"""

try:

# 我们将执行过程包裹在指标计时器中,以便在 Prometheus 中跟踪延迟

# model = agent.llm_service.get_llm().get_name() # 获取模型名称用于指标

# 注意:agent.get_stream_response() 是我们在 graph.py 中实现的异步生成器

async for chunk in agent.get_stream_response(

chat_request.messages,

session_id=session.id,

user_id=str(session.user_id)

):

# 将原始文本片段包装成结构化的 JSON 模式

response = StreamResponse(content=chunk, done=False)

# 格式化为 SSE

yield f"data: {json.dumps(response.model_dump())}\n\n"

# 发送一个最终的 'done' 信号,以便客户端知道停止监听

final_response = StreamResponse(content="", done=True)

yield f"data: {json.dumps(final_response.model_dump())}\n\n"

except Exception as e:

# 如果流在中途崩溃,我们必须将错误发送到客户端

logger.error("stream_crash", session_id=session.id, error=str(e))

error_response = StreamResponse(content=f"Error: {str(e)}", done=True)

yield f"data: {json.dumps(error_response.model_dump())}\n\n"

# 返回用 StreamingResponse 包装的生成器

return StreamingResponse(event_generator(), media_type="text/event-stream")

except Exception as e:

logger.error("stream_request_failed", session_id=session.id, error=str(e))

raise HTTPException(status_code=500, detail=str(e))

由于我们的代理是有状态的(得益于 Postgres 的检查点),用户可能会重新加载页面,并期望看到之前的对话。因此,我们需要提供端点来获取和清除历史记录。

@router.get("/messages", response_model=ChatResponse)

@limiter.limit(settings.RATE_LIMIT_ENDPOINTS["messages"][0])

async def get_session_messages(

request: Request,

session: Session = Depends(get_current_session),

):

"""

获取当前会话的完整对话历史。直接从 LangGraph 的检查点中读取状态。

"""

try:

messages = await agent.get_chat_history(session.id)

return ChatResponse(messages=messages)

except Exception as e:

logger.error("fetch_history_failed", session_id=session.id, error=str(e))

raise HTTPException(status_code=500, detail="获取历史失败")

@router.delete("/messages")

@limiter.limit(settings.RATE_LIMIT_ENDPOINTS["messages"][0])

async def clear_chat_history(

request: Request,

session: Session = Depends(get_current_session),

):

"""

硬删除对话历史。当上下文过于混乱,用户希望“重新开始”时非常有用。

"""

try:

await agent.clear_chat_history(session.id)

return {"message": "聊天历史已成功清除"}

except Exception as e:

logger.error("clear_history_failed", session_id=session.id, error=str(e))

raise HTTPException(status_code=500, detail="清除历史失败")

最后,我们需要将所有这些路由整合在一起。我们在 app/api/v1/api.py 中创建了一个路由聚合器,以保持主应用文件的整洁。

from fastapi import APIRouter

from app.api.v1.auth import router as auth_router

from app.api.v1.chatbot import router as chatbot_router