Self-Evolving-Agents

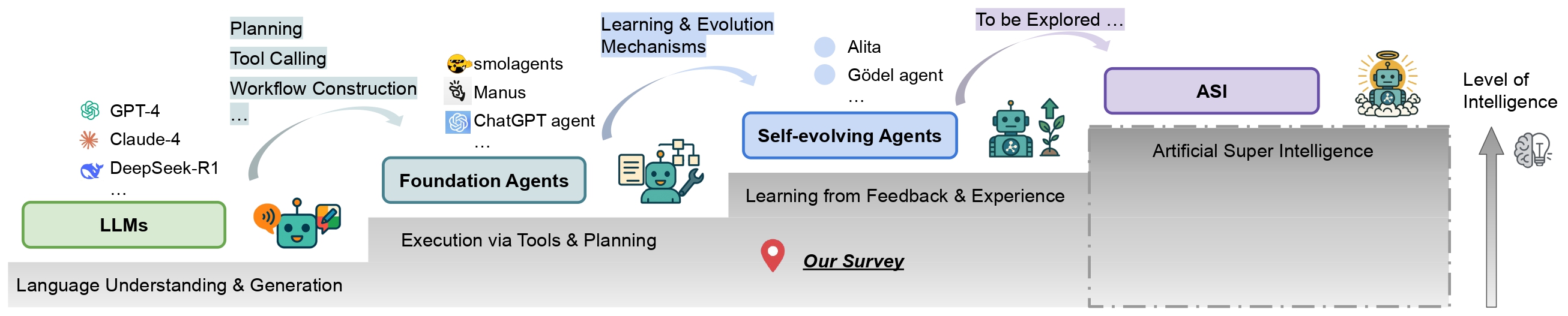

Self-Evolving-Agents 是一个专注于“自进化智能体”领域的学术资源库,旨在系统梳理通往人工超级智能(ASI)的研究路径。它本质上是一份高质量的文献综述合集,而非单一的可执行软件。

它主要解决了当前 AI 智能体难以在动态环境中自主适应、缺乏持续学习能力的问题。通过整合模型优化、记忆演化、工具调用及架构调整等核心内容,Self-Evolving-Agents 为构建能够像生物一样不断自我完善的 AI 系统提供了理论框架。

这份资源非常适合 AI 领域的研究人员、算法工程师以及对通用人工智能(AGI)感兴趣的开发者深入研读。其独特价值在于构建了一个全景式的进化方法论体系,详细探讨了“进化什么”(如模型、上下文)、“何时进化”以及“如何进化”(如基于奖励、模仿学习、群体进化)等关键维度,为研发具备终身学习能力的下一代智能体提供了宝贵的导航图。

使用场景

某金融科技团队正在开发一款智能投研助手,旨在自动分析市场动态并生成投资报告,需要处理海量非结构化数据和瞬息万变的市场环境。

没有 Self-Evolving-Agents 时

- 智能体表现僵化,遇到新出现的金融术语或突发市场事件时,往往因缺乏先验知识而给出过时或错误的分析。

- 缺乏记忆进化机制,同样的数据提取错误(如财报指标计算失误)会在不同用户的对话中反复出现,无法自动修正。

- 提示词和工具调用逻辑固定,当数据源 API 变更或出现更优的分析工具时,系统无法自适应调整,需工程师频繁手动介入维护。

- 面对复杂的多步骤推理任务,无法根据任务难度动态调整思考链,导致长程任务经常半途而废或逻辑断裂。

使用 Self-Evolving-Agents 后

- 智能体具备“自我进化”能力,能通过上下文学习和自我反思,快速适应新的市场术语和突发情况,保持分析结果的时效性。

- 系统建立了记忆进化机制,能从历史交互中汲取教训并优化内部知识库,确保同样的错误只犯一次,实现越用越聪明。

- 智能体能根据反馈自动优化提示词和工具组合,当发现某个数据源不稳定时,能自主尝试切换备用工具,大幅降低了人工维护成本。

- 通过架构层面的自我优化,智能体能根据任务复杂度动态调整推理路径,在处理长周期投研任务时的成功率与逻辑连贯性显著提升。

Self-Evolving-Agents 将 AI 从被动执行指令的静态程序转变为能自主学习、持续优化的动态系统,真正实现了智能体在复杂业务场景下的终身成长。

运行环境要求

- 未说明

未说明

未说明

快速开始

自进化智能体综述:通往人工超级智能之路

自进化智能体综述:通往人工超级智能之路

📢 更新

- 2025.07: 我们发布了一个 GitHub 仓库,用于记录与推理经济(Reasoning Economy)相关的论文。欢迎引用或提交 Pull Request。

📜 目录

1. 引言

2. 定义与基础

Curriculum Learning for Cooperation in Multi-Agent Reinforcement Learning

Lifelong Learning of Large Language Model-based Agents: A Roadmap

3. 演化什么?

3.1 模型

3.2 上下文

3.2.1 记忆演化

3.2.2 提示词 优化

3.3 工具

3.4 架构

4. 何时进化?

4.1 测试时内自进化

AdaPlanner: Adaptive Planning from Feedback with Language Models

Reflexion: Language Agents with Verbal Reinforcement Learning

Test-Time Training on Nearest Neighbors for Large Language Models

Efficiently Learning at Test-Time: Active Fine-Tuning of LLMs

LADDER: Self-Improving LLMs Through Recursive Problem Decomposition

4.2 测试间自进化

Quiet-STaR: Language Models Can Teach Themselves to Think Before Speaking

SiriuS: Self-improving Multi-agent Systems via Bootstrapped Reasoning

RAGEN: Understanding Self-Evolution in LLM Agents via Multi-Turn Reinforcement Learning

DYSTIL: Dynamic Strategy Induction with Large Language Models for Reinforcement Learning

WebRL: Training LLM Web Agents via Self-Evolving Online Curriculum Reinforcement Learning

DigiRL: Training In-The-Wild Device-Control Agents with Autonomous Reinforcement Learning

5. 如何进化?

5.1 基于奖励的自进化

Vision-Zero: Scalable VLM Self-Improvement via Strategic Gamified Self-Play

Training Language Models to Self-Correct via Reinforcement Learning

PAG: Multi-Turn Reinforced LLM Self-Correction with Policy as Generative Verifier

Self-ensemble: Mitigating Confidence Distortion for Large Language Models

Scalable Best-of-N Selection for Large Language Models via Self-Certainty

Unsupervised Post-Training for Multi-Modal LLM Reasoning via GRPO

Consistent Paths Lead to Truth: Self-Rewarding Reinforcement Learning for LLM Reasoning

SWE-Dev: Evaluating and Training Autonomous Feature-Driven Software Development

Feedback Friction: LLMs Struggle to Fully Incorporate External Feedback

AutoRule: Reasoning Chain-of-thought Extracted Rule-based Rewards Improve Preference Learning

Reward Is Enough: LLMs Are In-Context Reinforcement Learners

Generalist Reward Models: Found Inside Large Language Models

5.2 模仿与示范学习

AdaSTaR: Adaptive Data Sampling for Training Self-Taught Reasoners

Enhancing Large Vision Language Models with Self-Training on Image Comprehension

Genixer: Empowering Multimodal Large Language Models as a Powerful Data Generator

SiriuS: Self-improving Multi-agent Systems via Bootstrapped Reasoning

Bridging the Gap: Self-Optimized Fine-Tuning for LLM-based Recommender Systems

Recursive Introspection: Teaching Language Model Agents How to Self-Improve

Confidence Matters: Revisiting Intrinsic Self-Correction Capabilities of Large Language Models

5.3 基于群体与进化的方法

Darwin Godel Machine: Open-Ended Evolution of Self-Improving Agents

Nature-Inspired Population-Based Evolution of Large Language Models

Self-Play Fine-Tuning Converts Weak Language Models to Strong Language Models

SPC: Evolving Self-Play Critic via Adversarial Games for LLM Reasoning

Language Models can Self-Improve at State-Value Estimation for Better Search

elf-Evolving Multi-Agent Collaboration Networks for Software Development

Self-Evolving Multi-Agent Simulations for Realistic Clinical Interactions

6. 何处进化?

6.1 通用领域进化

6.2 特定领域进化

7. 自进化智能体的评估

DSBENCH:数据科学智能体距离成为数据科学专家还有多远?

ICLR 2025ScienceAgentBench:迈向对数据驱动科学发现的语言智能体进行严格评估

ICLR 2025代码AppBench:针对复杂用户指令规划来自不同 App 的多个 API

EMNLP 2025T-Eval:逐步评估大语言模型的工具利用能力

ACL 2024MultiAgentBench:评估 LLM 智能体的协作与竞争

ACL 2025

8. 未来方向

8.1 个性化 AI 智能体

AutoPal: Autonomous Adaptation to Users for Personal AI Companionship

Bleu: a Method for Automatic Evaluation of Machine Translation

8.2 泛化能力

Position: Scaling LLM Agents Requires Asymptotic Analysis with LLM Primitives

Automating Safety Enhancement for LLM-based Agents with Synthetic Risk Scenarios

Foundational Challenges in Assuring Alignment and Safety of Large Language Models

8.3 安全可控的智能体

Automating Safety Enhancement for LLM-based Agents with Synthetic Risk Scenarios

AgentDAM: Privacy Leakage Evaluation for Autonomous Web Agents

Foundational Challenges in Assuring Alignment and Safety of Large Language Models

8.4 多智能体生态系统

Collab-Overcooked: Benchmarking and Evaluating Large Language Models as Collaborative Agents

Self-Evolving Multi-Agent Collaboration Networks for Software Development

MultiAgentBench: Evaluating the Collaboration and Competition of LLM agents

其他

🔎 引用

如需引用该研究论文,您可以使用以下 BibTeX 条目。

@misc{gao2025surveyselfevolvingagentspath,

title={A Survey of Self-Evolving Agents: On Path to Artificial Super Intelligence},

author={Huan-ang Gao and Jiayi Geng and Wenyue Hua and Mengkang Hu and Xinzhe Juan and Hongzhang Liu and Shilong Liu and Jiahao Qiu and Xuan Qi and Yiran Wu and Hongru Wang and Han Xiao and Yuhang Zhou and Shaokun Zhang and Jiayi Zhang and Jinyu Xiang and Yixiong Fang and Qiwen Zhao and Dongrui Liu and Qihan Ren and Cheng Qian and Zhenghailong Wang and Minda Hu and Huazheng Wang and Qingyun Wu and Heng Ji and Mengdi Wang},

year={2025},

eprint={2507.21046},

archivePrefix={arXiv},

primaryClass={cs.AI},

url={https://arxiv.org/abs/2507.21046},

}

常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。

PaddleOCR

PaddleOCR 是一款基于百度飞桨框架开发的高性能开源光学字符识别工具包。它的核心能力是将图片、PDF 等文档中的文字提取出来,转换成计算机可读取的结构化数据,让机器真正“看懂”图文内容。 面对海量纸质或电子文档,PaddleOCR 解决了人工录入效率低、数字化成本高的问题。尤其在人工智能领域,它扮演着连接图像与大型语言模型(LLM)的桥梁角色,能将视觉信息直接转化为文本输入,助力智能问答、文档分析等应用场景落地。 PaddleOCR 适合开发者、算法研究人员以及有文档自动化需求的普通用户。其技术优势十分明显:不仅支持全球 100 多种语言的识别,还能在 Windows、Linux、macOS 等多个系统上运行,并灵活适配 CPU、GPU、NPU 等各类硬件。作为一个轻量级且社区活跃的开源项目,PaddleOCR 既能满足快速集成的需求,也能支撑前沿的视觉语言研究,是处理文字识别任务的理想选择。