DeepResearch

DeepResearch 是由通义实验室推出的开源深度研究智能体,专为处理长周期、高复杂度的信息检索任务而设计。面对传统模型在需要多步推理、跨页面浏览及长时间上下文记忆的场景中表现不足的痛点,DeepResearch 能够自主规划搜索路径,深入挖掘网络信息,从而生成高质量的研究结论。

这款工具非常适合 AI 研究人员、开发者以及需要处理深度调研工作的专业人士使用。其核心亮点在于独特的模型架构:虽然总参数量达 305 亿,但每生成一个 token 仅激活 33 亿参数,这种稀疏激活机制在保持强大推理能力的同时,显著提升了运行效率。此外,DeepResearch 拥有全自动的合成数据生成流水线,支持从预训练到强化学习的全流程优化,并通过大规模的智能体持续预训练,不断刷新其在各类权威评测基准上的表现。无论是希望探索前沿智能体技术的开发者,还是寻求高效深度搜索解决方案的研究者,DeepResearch 都提供了一个性能卓越且开放可用的选择。

使用场景

某金融科技公司的行业分析师需要在 24 小时内完成一份关于“全球固态电池供应链最新突破”的深度研报,以支持投资决策。

没有 DeepResearch 时

- 信息碎片化严重:分析师需手动在数十个学术网站、新闻源和专利库中反复搜索,难以串联起从材料创新到量产落地的完整链条。

- 深度推理缺失:传统搜索工具仅能返回关键词匹配的新闻摘要,无法自动分析技术路线的可行性或对比不同厂商的产能数据。

- 时效性与准确性矛盾:为了赶工期,往往被迫牺牲验证环节,容易引用过时数据或误读非权威来源的信息。

- 长程任务中断:面对需要多步跳转(如:查论文->找作者->追踪其最新项目->核实合作方)的复杂查询,人工操作极易迷失方向或遗漏关键节点。

使用 DeepResearch 后

- 全自动深度挖掘:DeepResearch 自主规划搜索路径,一次性遍历全球主流数据库,自动构建起从实验室突破到工厂投产的全景图谱。

- 智能推理与综合:基于 305 亿参数的大模型能力,DeepResearch 不仅能提取数据,还能交叉验证不同来源,自动生成包含技术壁垒分析和竞争格局的判断。

- 高信源溯源保障:工具在生成报告时自动附带精确的引用链接,确保每一条关键结论都有据可查,大幅降低合规风险。

- 长链路任务闭环:DeepResearch 擅长处理长周期任务,能独立执行“发现线索 - 深入追踪 - 逻辑验证”的完整闭环,无需人工中途干预。

DeepResearch 将原本需要数天的人工情报搜集工作压缩至小时级,让分析师从繁琐的“找资料”转型为高价值的“做决策”。

运行环境要求

- 未说明

- 本地部署需要 GPU(具体型号和显存未说明)

- 也可通过 OpenRouter API 调用无需本地 GPU

未说明

快速开始

🤗 HuggingFace |

ModelScope | 💬 微信 | 📰 博客 | 📑 论文

ModelScope | 💬 微信 | 📰 博客 | 📑 论文

👏 欢迎通过我们的  Modelscope 在线演示 或 🤗 Huggingface 在线演示,或

Modelscope 在线演示 或 🤗 Huggingface 在线演示,或  bailian 服务 来体验通义深度研究!

bailian 服务 来体验通义深度研究!

[!NOTE] 此演示仅供快速探索使用。由于模型延迟和工具 QPS 限制,响应时间可能会有所不同或间歇性失败。为了获得稳定的体验,我们建议进行本地部署;若需生产级服务,请访问

bailian 并按照引导设置。

简介

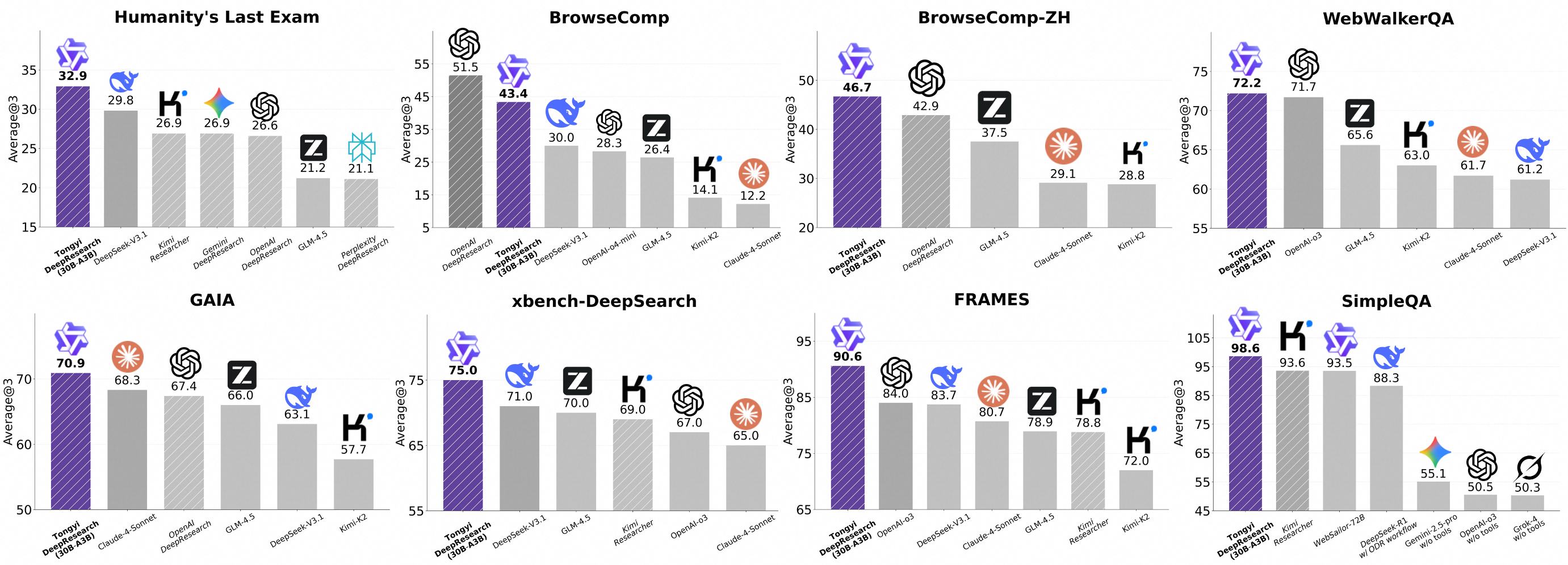

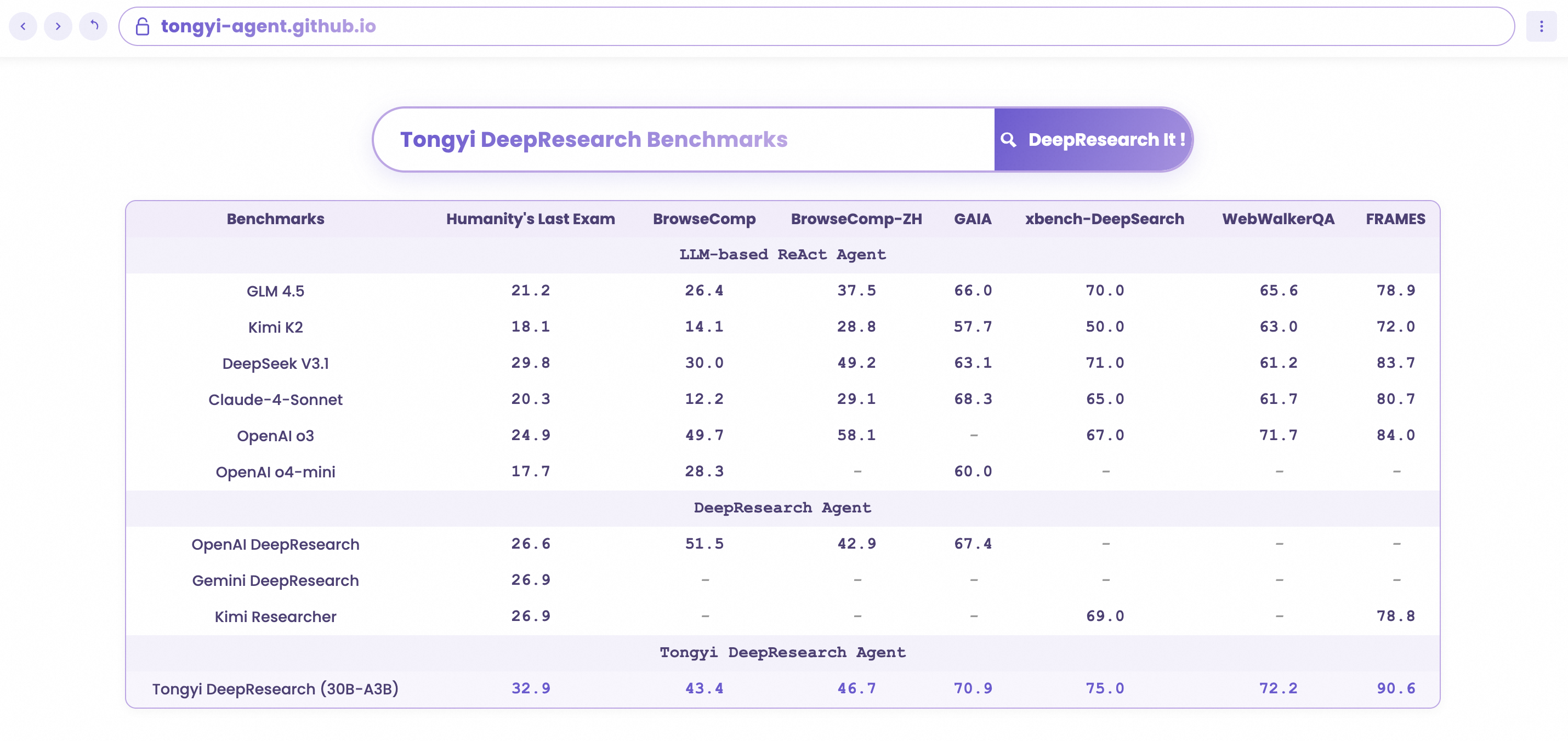

我们推出  通义深度研究,这是一款具有 305 亿总参数的代理型大语言模型,每 token 只激活 33 亿参数。该模型由通义实验室开发,专为 长周期、深度信息检索 任务而设计。通义深度研究在一系列代理式搜索基准测试中表现出最先进的性能,包括 Humanity's Last Exam、BrowseComp、BrowseComp-ZH、WebWalkerQA、xbench-DeepSearch、FRAMES 和 SimpleQA。

通义深度研究,这是一款具有 305 亿总参数的代理型大语言模型,每 token 只激活 33 亿参数。该模型由通义实验室开发,专为 长周期、深度信息检索 任务而设计。通义深度研究在一系列代理式搜索基准测试中表现出最先进的性能,包括 Humanity's Last Exam、BrowseComp、BrowseComp-ZH、WebWalkerQA、xbench-DeepSearch、FRAMES 和 SimpleQA。

通义深度研究基于我们之前在

WebAgent 项目上的工作。

更多详情请参阅我们的 📰 技术博客。

特点

- ⚙️ 全自动合成数据生成流水线:我们设计了一条高度可扩展的自动数据合成流水线,支持代理式预训练、监督微调和强化学习。

- 🔄 大规模持续代理式预训练:利用多样且高质量的代理式交互数据来扩展模型能力、保持模型新鲜度并增强推理性能。

- 🔁 端到端强化学习:我们采用基于自定义 Group Relative Policy Optimization 框架的严格 on-policy RL 方法,结合 token 级别的策略梯度、留一法优势估计以及对负样本的选择性过滤,以在非平稳环境中稳定训练。

- 🤖 兼容代理推理范式:在推理时,通义深度研究兼容两种推理范式:ReAct,用于严格评估模型的核心内在能力;以及基于 IterResearch 的“重型”模式,该模式采用测试时缩放策略来释放模型的最大性能潜力。

模型下载

您可以通过以下链接直接下载模型。

| 模型 | 下载链接 | 模型大小 | 上下文长度 |

|---|---|---|---|

| Tongyi-DeepResearch-30B-A3B | 🤗 HuggingFace 🤖 ModelScope |

30B-A3B | 128K |

新闻

[2025/09/20]🚀 Tongyi-DeepResearch-30B-A3B 现已上线 OpenRouter! 请按照 快速入门 指南操作。

[2025/09/17]🔥 我们发布了 Tongyi-DeepResearch-30B-A3B。

深度研究基准测试结果

快速入门

本指南提供了设置环境和运行位于 inference 文件夹中的推理脚本的说明。

1. 环境设置

- 推荐 Python 版本:3.10.0(使用其他版本可能导致依赖问题)。

- 强烈建议使用

conda或virtualenv创建隔离环境。

# Conda 示例

conda create -n react_infer_env python=3.10.0

conda activate react_infer_env

2. 安装

安装所需的依赖项:

pip install -r requirements.txt

3. 环境配置与评估数据准备

环境配置

通过复制示例环境文件来配置您的 API 密钥和设置:

cp .env.example .env

nano .env

准备评估数据

将评估数据放入 data/eval 文件夹中,并确保其格式符合要求。

4. 运行推理脚本

执行以下命令来运行推理脚本:

python inference.py --model tongyi-deepresearch-30b-a3b --input "你的输入文本"

5. 结果分析

查看输出文件以分析推理结果。

结语

通义深度研究代表了我们在代理式大语言模型领域的最新突破。我们相信,这一模型将在未来的科学研究、信息检索和其他复杂任务中发挥重要作用。感谢您的关注和支持!

---

复制示例环境文件

cp .env.example .env

编辑 `.env` 文件,并填写您实际的 API 密钥和配置值:

- **SERPER_KEY_ID**:从 [Serper.dev](https://serper.dev/) 获取用于网页搜索和 Google 学术的密钥。

- **JINA_API_KEYS**:从 [Jina.ai](https://jina.ai/) 获取用于网页内容读取的密钥。

- **API_KEY/API_BASE**:从 [OpenAI](https://platform.openai.com/) 获取与 OpenAI 兼容的 API,用于页面摘要生成。

- **DASHSCOPE_API_KEY**:从 [Dashscope](https://dashscope.aliyun.com/) 获取用于文件解析的密钥。

- **SANDBOX_FUSION_ENDPOINT**:Python 解释器沙盒端点(参见 [SandboxFusion](https://github.com/bytedance/SandboxFusion))。

- **MODEL_PATH**:您的模型权重路径。

- **DATASET**:您的评估数据集名称。

- **OUTPUT_PATH**:保存结果的目录。

> **注意**:`.env` 文件已被添加到 `.gitignore` 中,因此您的密钥不会被提交到仓库。

#### 准备评估数据

系统支持两种输入文件格式:**JSON** 和 **JSONL**。

#### 支持的文件格式:

**选项 1:JSONL 格式(推荐)**

- 创建以 `.jsonl` 为扩展名的数据文件(例如 `my_questions.jsonl`)。

- 每一行必须是一个有效的 JSON 对象,包含 `question` 和 `answer` 键:

```json

{"question": "法国的首都是什么?", "answer": "巴黎"}

{"question": "请解释量子计算。", "answer": ""}

选项 2:JSON 格式

- 创建以

.json为扩展名的数据文件(例如my_questions.json)。 - 文件必须包含一个 JSON 数组,每个对象都包含

question和answer键:[ { "question": "法国的首都是什么?", "answer": "巴黎" }, { "question": "请解释量子计算。", "answer": "" } ]

重要提示:answer 字段包含用于评估的 真实答案/参考答案。系统会针对问题生成自己的回答,这些参考答案将在基准测试中用于自动评估生成回答的质量。

文档处理中的文件引用:

- 如果使用 文件解析器 工具,请在

question字段前加上文件名。 - 将引用的文件放置在

eval_data/file_corpus/目录下。 - 示例:

{"question": "(已上传 1 个文件:['report.pdf'])\n\n主要发现是什么?", "answer": "..."}

文件组织结构:

project_root/

├── eval_data/

│ ├── my_questions.jsonl # 您的评估数据

│ └── file_corpus/ # 引用的文档

│ ├── report.pdf

│ └── data.xlsx

4. 配置推理脚本

- 打开

run_react_infer.sh,并按照注释中的说明修改以下变量:MODEL_PATH:本地或远程模型权重的路径。DATASET:您的评估文件的完整路径,例如eval_data/my_questions.jsonl或/path/to/my_questions.json。OUTPUT_PATH:保存预测结果的路径,例如./outputs。

- 根据您启用的工具(检索、计算器、网页搜索等),提供所需的

API_KEY、BASE_URL或其他凭证。每个密钥都在 Bash 脚本中进行了说明。

5. 运行推理脚本

bash run_react_infer.sh

通过以上步骤,您可以完全准备好环境、配置数据集并运行模型。如需更多详细信息,请参阅各脚本中的内嵌注释或提交问题。

6. 您可以使用 OpenRouter 的 API 来调用我们的模型

Tongyi-DeepResearch-30B-A3B 现已在 OpenRouter 上可用。您无需任何 GPU 即可运行推理。

您需要在文件 inference/react_agent.py 中进行以下修改:

- 在

call_server函数中:将 API 密钥和 URL 设置为您 OpenRouter 账户的 API 和 URL。 - 将模型名称更改为

alibaba/tongyi-deepresearch-30b-a3b。 - 按照第 88–90 行 注释中的说明调整内容拼接方式。

基准评估

我们提供了针对各种数据集的基准评估脚本。请参阅 evaluation/ 目录以获取更多详细信息。

常见问题解答

请参阅 FAQ 以获取更多详细信息。

深度研究代理家族

Tongyi DeepResearch 还拥有一系列深度研究代理。更多信息请参阅以下论文:

[1] WebWalker:LLM 在网络遍历中的基准测试(ACL 2025)

[2] WebDancer:迈向自主信息搜寻代理(NeurIPS 2025)

[3] WebSailor:为网络代理导航超人类推理能力

[4] WebShaper:通过信息搜寻形式化实现代理式数据合成

[5] WebWatcher:突破视觉-语言深度研究代理的新前沿

[6] WebResearcher:释放长时程代理的无限推理能力

[7] ReSum:通过上下文摘要解锁长时程搜索智能

[8] WebWeaver:通过动态大纲构建网络规模证据,用于开放式深度研究

[9] WebSailor-V2:通过合成数据和可扩展强化学习弥合与专有代理之间的鸿沟

[10] 通过持续预训练扩展代理

[11] 通过环境扩展迈向通用代理智能

[12] AgentFold:具有主动上下文管理功能的长时程网络代理

[13] WebLeaper:赋能高效、信息丰富的网络代理搜索

[14] BrowseConf:面向网络代理的置信度引导测试时缩放

[15] 重新利用合成数据进行细粒度搜索代理监督

[16] ParallelMuse:用于深度信息搜寻的代理式并行思维

[17] AgentFrontier:借助 ZPD 引导的数据合成扩展 LLM 代理的能力边界

[18] 代理式信息搜寻中的嵌套浏览器使用学习

🌟 杂项

🚩 人才招聘

🔥🔥🔥 我们正在招聘!研究实习生岗位开放中(工作地点:杭州、北京、上海)

📚 研究方向:Web智能体、搜索智能体、智能体强化学习、多智能体强化学习、基于智能体的RAG

☎️ 联系方式:yongjiang.jy@alibaba-inc.com

联系方式

如有任何沟通需求,请联系Yong Jiang(yongjiang.jy@alibaba-inc.com)。

引用

@article{tongyidr,

title={通义DeepResearch技术报告},

author={通义DeepResearch团队 and 李百轩 and 张博 and 张丁楚 and 黄飞 and 李广宇 and 陈国新 and 尹慧峰 and 吴嘉龙 and 周景仁 and others},

journal={arXiv预印本 arXiv:2510.24701},

year={2025}

}

常见问题

相似工具推荐

stable-diffusion-webui

stable-diffusion-webui 是一个基于 Gradio 构建的网页版操作界面,旨在让用户能够轻松地在本地运行和使用强大的 Stable Diffusion 图像生成模型。它解决了原始模型依赖命令行、操作门槛高且功能分散的痛点,将复杂的 AI 绘图流程整合进一个直观易用的图形化平台。 无论是希望快速上手的普通创作者、需要精细控制画面细节的设计师,还是想要深入探索模型潜力的开发者与研究人员,都能从中获益。其核心亮点在于极高的功能丰富度:不仅支持文生图、图生图、局部重绘(Inpainting)和外绘(Outpainting)等基础模式,还独创了注意力机制调整、提示词矩阵、负向提示词以及“高清修复”等高级功能。此外,它内置了 GFPGAN 和 CodeFormer 等人脸修复工具,支持多种神经网络放大算法,并允许用户通过插件系统无限扩展能力。即使是显存有限的设备,stable-diffusion-webui 也提供了相应的优化选项,让高质量的 AI 艺术创作变得触手可及。

everything-claude-code

everything-claude-code 是一套专为 AI 编程助手(如 Claude Code、Codex、Cursor 等)打造的高性能优化系统。它不仅仅是一组配置文件,而是一个经过长期实战打磨的完整框架,旨在解决 AI 代理在实际开发中面临的效率低下、记忆丢失、安全隐患及缺乏持续学习能力等核心痛点。 通过引入技能模块化、直觉增强、记忆持久化机制以及内置的安全扫描功能,everything-claude-code 能显著提升 AI 在复杂任务中的表现,帮助开发者构建更稳定、更智能的生产级 AI 代理。其独特的“研究优先”开发理念和针对 Token 消耗的优化策略,使得模型响应更快、成本更低,同时有效防御潜在的攻击向量。 这套工具特别适合软件开发者、AI 研究人员以及希望深度定制 AI 工作流的技术团队使用。无论您是在构建大型代码库,还是需要 AI 协助进行安全审计与自动化测试,everything-claude-code 都能提供强大的底层支持。作为一个曾荣获 Anthropic 黑客大奖的开源项目,它融合了多语言支持与丰富的实战钩子(hooks),让 AI 真正成长为懂上

ComfyUI

ComfyUI 是一款功能强大且高度模块化的视觉 AI 引擎,专为设计和执行复杂的 Stable Diffusion 图像生成流程而打造。它摒弃了传统的代码编写模式,采用直观的节点式流程图界面,让用户通过连接不同的功能模块即可构建个性化的生成管线。 这一设计巧妙解决了高级 AI 绘图工作流配置复杂、灵活性不足的痛点。用户无需具备编程背景,也能自由组合模型、调整参数并实时预览效果,轻松实现从基础文生图到多步骤高清修复等各类复杂任务。ComfyUI 拥有极佳的兼容性,不仅支持 Windows、macOS 和 Linux 全平台,还广泛适配 NVIDIA、AMD、Intel 及苹果 Silicon 等多种硬件架构,并率先支持 SDXL、Flux、SD3 等前沿模型。 无论是希望深入探索算法潜力的研究人员和开发者,还是追求极致创作自由度的设计师与资深 AI 绘画爱好者,ComfyUI 都能提供强大的支持。其独特的模块化架构允许社区不断扩展新功能,使其成为当前最灵活、生态最丰富的开源扩散模型工具之一,帮助用户将创意高效转化为现实。

NextChat

NextChat 是一款轻量且极速的 AI 助手,旨在为用户提供流畅、跨平台的大模型交互体验。它完美解决了用户在多设备间切换时难以保持对话连续性,以及面对众多 AI 模型不知如何统一管理的痛点。无论是日常办公、学习辅助还是创意激发,NextChat 都能让用户随时随地通过网页、iOS、Android、Windows、MacOS 或 Linux 端无缝接入智能服务。 这款工具非常适合普通用户、学生、职场人士以及需要私有化部署的企业团队使用。对于开发者而言,它也提供了便捷的自托管方案,支持一键部署到 Vercel 或 Zeabur 等平台。 NextChat 的核心亮点在于其广泛的模型兼容性,原生支持 Claude、DeepSeek、GPT-4 及 Gemini Pro 等主流大模型,让用户在一个界面即可自由切换不同 AI 能力。此外,它还率先支持 MCP(Model Context Protocol)协议,增强了上下文处理能力。针对企业用户,NextChat 提供专业版解决方案,具备品牌定制、细粒度权限控制、内部知识库整合及安全审计等功能,满足公司对数据隐私和个性化管理的高标准要求。

ML-For-Beginners

ML-For-Beginners 是由微软推出的一套系统化机器学习入门课程,旨在帮助零基础用户轻松掌握经典机器学习知识。这套课程将学习路径规划为 12 周,包含 26 节精炼课程和 52 道配套测验,内容涵盖从基础概念到实际应用的完整流程,有效解决了初学者面对庞大知识体系时无从下手、缺乏结构化指导的痛点。 无论是希望转型的开发者、需要补充算法背景的研究人员,还是对人工智能充满好奇的普通爱好者,都能从中受益。课程不仅提供了清晰的理论讲解,还强调动手实践,让用户在循序渐进中建立扎实的技能基础。其独特的亮点在于强大的多语言支持,通过自动化机制提供了包括简体中文在内的 50 多种语言版本,极大地降低了全球不同背景用户的学习门槛。此外,项目采用开源协作模式,社区活跃且内容持续更新,确保学习者能获取前沿且准确的技术资讯。如果你正寻找一条清晰、友好且专业的机器学习入门之路,ML-For-Beginners 将是理想的起点。

ragflow

RAGFlow 是一款领先的开源检索增强生成(RAG)引擎,旨在为大语言模型构建更精准、可靠的上下文层。它巧妙地将前沿的 RAG 技术与智能体(Agent)能力相结合,不仅支持从各类文档中高效提取知识,还能让模型基于这些知识进行逻辑推理和任务执行。 在大模型应用中,幻觉问题和知识滞后是常见痛点。RAGFlow 通过深度解析复杂文档结构(如表格、图表及混合排版),显著提升了信息检索的准确度,从而有效减少模型“胡编乱造”的现象,确保回答既有据可依又具备时效性。其内置的智能体机制更进一步,使系统不仅能回答问题,还能自主规划步骤解决复杂问题。 这款工具特别适合开发者、企业技术团队以及 AI 研究人员使用。无论是希望快速搭建私有知识库问答系统,还是致力于探索大模型在垂直领域落地的创新者,都能从中受益。RAGFlow 提供了可视化的工作流编排界面和灵活的 API 接口,既降低了非算法背景用户的上手门槛,也满足了专业开发者对系统深度定制的需求。作为基于 Apache 2.0 协议开源的项目,它正成为连接通用大模型与行业专有知识之间的重要桥梁。